빠르고 저렴한 AI 모델을 선택하는 것은 고빈도 호출 환경에서 개발자가 마주하는 핵심 과제입니다. Google은 2026년 3월 3일, Gemini 3 시리즈 중 가장 빠르고 가성비가 뛰어난 Gemini 3.1 Flash Lite Preview를 공식 발표했습니다. 이 모델은 번역, 요약, 분류 등 높은 처리량이 필요한 작업에 최적화되어 있습니다.

핵심 가치: 이 글을 통해 Gemini 3.1 Flash Lite의 기술 사양, 성능 이점, 최적의 사용 사례를 완벽하게 파악하고, 실제 코드를 통해 빠르게 호출하는 방법을 배워보세요.

Gemini 3.1 Flash Lite 핵심 사양 요약

Gemini 3.1 Flash Lite를 자세히 살펴보기 전에 주요 기술 사양을 확인해 보세요.

| 항목 | Gemini 3.1 Flash Lite 사양 | 설명 |

|---|---|---|

| 모델 ID | gemini-3.1-flash-lite-preview |

현재 프리뷰 버전 |

| 컨텍스트 윈도우 | 1,000,000 토큰 | 백만 단위의 긴 컨텍스트 |

| 최대 출력 | 64,000 토큰 | 긴 텍스트 생성 지원 |

| 입력 가격 | $0.25 / 백만 토큰 | 매우 낮은 비용 |

| 출력 가격 | $1.50 / 백만 토큰 | 높은 가성비 |

| 출력 속도 | ~382 토큰/초 | 초고속 응답 |

| 입력 모달리티 | 텍스트, 이미지, 오디오, 비디오 | 네이티브 멀티모달 |

| 출력 모달리티 | 텍스트 | 텍스트 생성 |

| 출시일 | 2026년 3월 3일 | 최신 출시 |

🚀 빠른 시작: Gemini 3.1 Flash Lite Preview는 APIYI(apiyi.com) 플랫폼에 이미 출시되었습니다. OpenAI 호환 인터페이스를 지원하므로 별도의 설정 없이 빠르게 연결할 수 있습니다.

Gemini 3.1 Flash Lite의 5가지 핵심 강점

강점 1: 2.5배 빨라진 속도

Gemini 3.1 Flash Lite는 속도 면에서 비약적인 발전을 이루었습니다. Artificial Analysis의 벤치마크 데이터에 따르면 다음과 같습니다:

- 첫 토큰 응답 시간 (TTFT): Gemini 2.5 Flash 대비 2.5배 단축

- 출력 속도: 382 tokens/초 달성, Gemini 2.5 Flash의 232 tokens/초 대비 64% 향상

- 전체 처리량: 약 45% 향상

이는 실시간 번역, 챗봇, 콘텐츠 요약 등 지연 시간에 민감한 작업에서 사용자가 거의 즉각적인 응답을 경험할 수 있음을 의미합니다.

강점 2: 압도적인 가성비

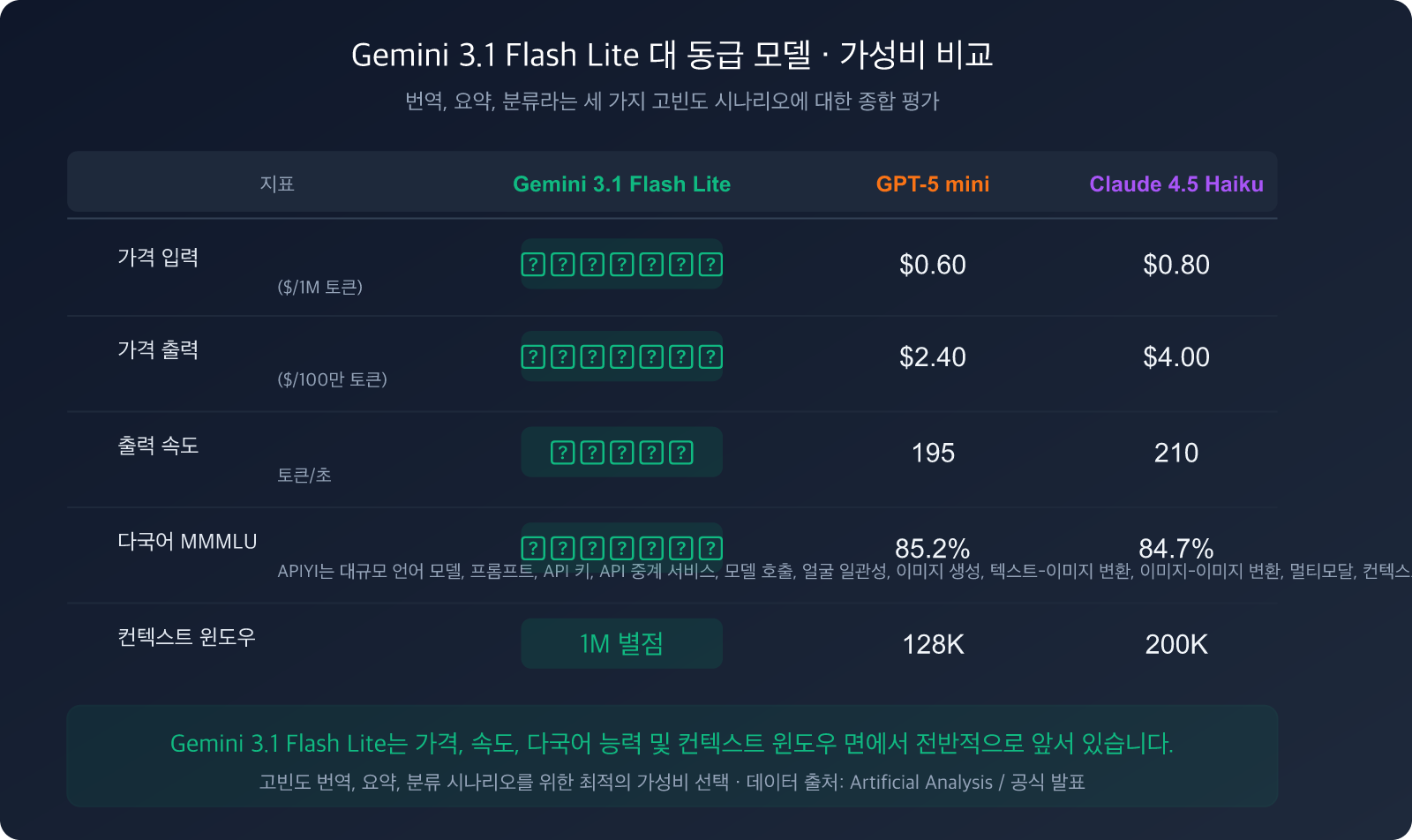

Gemini 3.1 Flash Lite의 가격 정책은 매우 경쟁력이 있습니다:

| 가격 비교 | 입력 가격 ($/1M tokens) | 출력 가격 ($/1M tokens) | 종합 비용 |

|---|---|---|---|

| Gemini 3.1 Flash Lite | $0.25 | $1.50 | ⭐ 최저 |

| Gemini 3 Flash | $1.00 | $4.00 | 보통 |

| Gemini 3 Pro | $2.50 | $15.00 | 높음 |

| Claude 4.5 Haiku | $0.80 | $4.00 | 보통 |

| GPT-5 mini | $0.60 | $2.40 | 보통 |

매일 100만 토큰을 처리한다고 가정할 때, Gemini 3.1 Flash Lite의 월 비용은 약 $52.50에 불과하며, Gemini 3 Pro와 비교하면 80% 이상 비용을 절감할 수 있습니다.

강점 3: 100만 토큰 컨텍스트 윈도우

Gemini 3.1 Flash Lite는 1M 토큰의 컨텍스트 윈도우를 지원하는데, 이는 동급 가격대의 모델에서는 매우 드문 사양입니다. 덕분에 다음과 같은 작업이 가능합니다:

- 책 한 권 분량의 내용을 한 번에 번역하거나 요약

- 수 시간 분량의 회의 녹취록 분석

- 대규모 코드베이스 이해 및 문서 생성

- 긴 문서의 다국어 대조 번역

강점 4: 네이티브 멀티모달 지원

경량 모델임에도 불구하고 Gemini 3.1 Flash Lite는 완전한 멀티모달 입력 기능을 유지하고 있습니다:

- 텍스트: 표준 텍스트 이해 및 생성

- 이미지: 이미지 인식 및 이해

- 오디오: 음성 콘텐츠 처리

- 비디오: 비디오 콘텐츠 이해

이로 인해 단순 텍스트 작업뿐만 아니라 이미지-텍스트 혼합 번역, 비디오 자막 생성 등 다양한 멀티모달 시나리오에 활용할 수 있습니다.

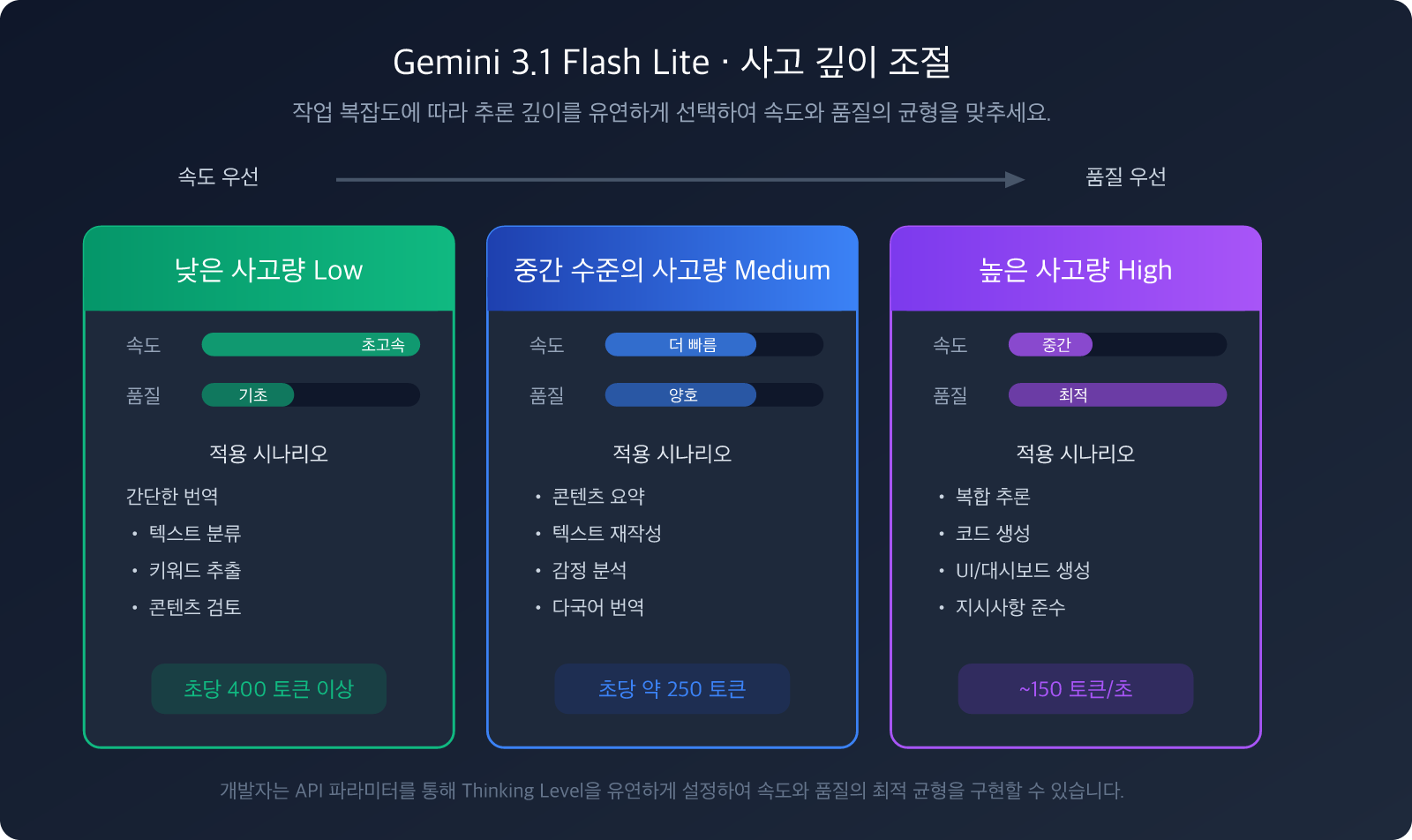

강점 5: 조절 가능한 사고 깊이

Gemini 3.1 Flash Lite는 Thinking Levels(사고 수준) 기능을 지원하여, 개발자가 작업 복잡도에 따라 모델의 추론 깊이를 유연하게 조정할 수 있습니다:

- 낮은 사고량: 간단한 번역, 분류 등 빠른 속도가 중요한 작업에 적합

- 중간 사고량: 요약, 내용 재작성 등 어느 정도의 이해도가 필요한 작업에 적합

- 높은 사고량: 복잡한 추론, 코드 생성 등 깊은 사고가 필요한 작업에 적합

Gemini 3.1 Flash Lite 성능 벤치마크

Gemini 3.1 Flash Lite는 Arena.ai 리더보드에서 1432점의 Elo 점수를 기록하며 동급 모델 중 압도적인 성능을 보여주었습니다.

| 벤치마크 | Gemini 3.1 Flash Lite | 설명 |

|---|---|---|

| GPQA Diamond | 86.9% | 과학적 지식 추론 |

| MMMU-Pro | 76.8% | 멀티모달 추론 |

| MMMLU | 88.9% | 다국어 질의응답 |

| LiveCodeBench | 72.0% | 코드 생성 |

| Video-MMMU | 84.8% | 영상 이해 |

| SimpleQA | 43.3% | 파라미터화된 지식 |

| MRCR v2 (128k) | 60.1% | 긴 컨텍스트 윈도우 이해 |

특히 GPQA Diamond, MMMLU 등 6개 벤치마크에서 Gemini 3.1 Flash Lite가 GPT-5 mini와 Claude 4.5 Haiku를 능가했다는 점은 주목할 만합니다. 이는 경량 모델도 최첨단 수준의 지능을 갖출 수 있음을 증명합니다.

🎯 기술 제안: 위 벤치마크 데이터는 Gemini 3.1 Flash Lite가 다국어 처리 능력(MMMLU 88.9%)에서 특히 뛰어나다는 것을 보여주며, 다국어 번역 작업에 매우 적합합니다. APIYI(apiyi.com)를 통해 해당 모델을 빠르게 호출하여 다국어 작업 테스트를 진행해 보세요.

Gemini 3.1 Flash Lite 빠르게 시작하기

간편한 코드 예제

OpenAI 호환 인터페이스를 사용하면 단 몇 줄의 코드로 Gemini 3.1 Flash Lite를 호출할 수 있습니다.

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI 통합 인터페이스

)

# 번역 시나리오 예시

response = client.chat.completions.create(

model="gemini-3.1-flash-lite-preview",

messages=[

{"role": "system", "content": "당신은 전문 번역가입니다. 사용자가 입력한 중국어를 영어로 번역하되, 원문의 의미와 어조를 유지하세요."},

{"role": "user", "content": "인공지능은 우리의 업무 방식과 생활 방식을 근본적으로 변화시키고 있습니다."}

],

temperature=0.3

)

print(response.choices[0].message.content)

전체 코드 보기: 일괄 번역 + 요약 시나리오

import openai

import time

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI 통합 인터페이스

)

MODEL = "gemini-3.1-flash-lite-preview"

def translate_text(text, target_lang="English"):

"""텍스트를 대상 언어로 번역"""

response = client.chat.completions.create(

model=MODEL,

messages=[

{"role": "system", "content": f"다음 텍스트를 {target_lang}(으)로 번역하세요. 원문의 의미와 어조를 유지하세요."},

{"role": "user", "content": text}

],

temperature=0.3

)

return response.choices[0].message.content

def summarize_text(text, max_words=100):

"""텍스트 요약 생성"""

response = client.chat.completions.create(

model=MODEL,

messages=[

{"role": "system", "content": f"다음 내용의 핵심 요점을 {max_words}자 이내로 요약하세요."},

{"role": "user", "content": text}

],

temperature=0.5

)

return response.choices[0].message.content

def classify_text(text, categories):

"""텍스트 분류"""

cats = "、".join(categories)

response = client.chat.completions.create(

model=MODEL,

messages=[

{"role": "system", "content": f"다음 텍스트를 다음 카테고리 중 하나로 분류하세요: {cats}. 카테고리 이름만 반환하세요."},

{"role": "user", "content": text}

],

temperature=0.1

)

return response.choices[0].message.content

# 사용 예시

texts = [

"양자 컴퓨팅은 향후 10년 내에 암호학 분야를 완전히 뒤바꿀 것입니다.",

"신형 전기차 주행 거리 1,000km 돌파",

"중앙은행, 기준금리 25bp 인하 발표"

]

categories = ["기술", "자동차", "금융", "스포츠", "엔터테인먼트"]

for text in texts:

# 번역

translated = translate_text(text)

# 분류

category = classify_text(text, categories)

# 요약

summary = summarize_text(text, max_words=30)

print(f"원문: {text}")

print(f"번역: {translated}")

print(f"분류: {category}")

print(f"요약: {summary}")

print("---")

💰 비용 최적화: 번역, 요약, 분류 등 빈번한 호출이 필요한 시나리오에서 Gemini 3.1 Flash Lite의 초저가 정책(입력 기준 100만 토큰당 $0.25)은 운영 비용을 획기적으로 낮춰줍니다. APIYI(apiyi.com) 플랫폼을 통해 호출하면 추가적인 가격 혜택과 무료 테스트 크레딧을 받을 수 있습니다.

Gemini 3.1 Flash Lite 최적 활용 사례

사례 1: 고빈도 대량 번역

Gemini 3.1 Flash Lite는 다국어 질의응답 벤치마크인 MMMLU에서 88.9%라는 높은 점수를 기록했습니다. 매우 저렴한 호출 비용과 빠른 응답 속도를 갖추고 있어 대량 번역 작업에 최적입니다.

- 이커머스 상품 설명 번역: 매일 수만 건의 상품 정보를 다국어로 번역

- 사용자 리뷰 번역: 해외 사용자 피드백을 실시간으로 번역

- 기술 문서 국제화: 대규모 문서의 다국어 버전 생성

- 자막 번역: 영상 자막의 신속한 다국어 변환

사례 2: 실시간 콘텐츠 요약

초당 382 토큰의 출력 속도를 자랑하여 실시간 요약 작업에 매우 적합합니다.

- 뉴스 요약 생성: 방대한 뉴스 기사의 자동 요약 추출

- 회의록: 장시간 회의 녹음의 신속한 요약

- 문헌 검토: 학술 논문의 대량 요약 생성

- 메일 요약: 기업 메일의 자동 요약 및 분류

사례 3: 대규모 콘텐츠 검토 및 분류

낮은 지연 시간과 저렴한 비용 덕분에 콘텐츠 검토 파이프라인에 이상적입니다.

- 사용자 생성 콘텐츠 검토: 소셜 플랫폼의 콘텐츠 보안 필터링

- 문의 자동 분류: 고객 서비스 시스템의 지능형 라우팅

- 감정 분석: 브랜드 여론 실시간 모니터링

- 태그 자동 생성: 콘텐츠 관리 시스템의 자동 태그 지정

시나리오 선택 가이드

| 사용 시나리오 | 추천 이유 | 핵심 장점 | 예상 월 비용 |

|---|---|---|---|

| 대량 번역 | MMMLU 88.9% 다국어 능력 탁월 | 저렴한 가격 + 고품질 | ~$50 (일 100만 토큰) |

| 실시간 요약 | 초당 382 토큰 초고속 출력 | 낮은 지연 시간 + 속도 | ~$30 (일 50만 토큰) |

| 콘텐츠 검토 | 높은 분류 정확도 및 빠른 응답 | 저비용 + 대량 처리 | ~$20 (일 30만 토큰) |

| 챗봇 | TTFT 2.5배 빠름 | 즉각적인 응답 | ~$80 (일 200만 토큰) |

| 긴 문서 처리 | 1M 토큰 컨텍스트 윈도우 | 책 한 권 분량 한 번에 처리 | 사용량 기반 과금 |

💡 선택 제안: 고빈도, 대량 처리, 비용 효율성이 중요한 텍스트 작업이라면 Gemini 3.1 Flash Lite가 현재 최고의 가성비 선택지입니다. APIYI(apiyi.com) 플랫폼을 통해 실제 환경에서 테스트해보시는 것을 권장합니다. 해당 플랫폼은 다른 모델로 즉시 전환하여 성능을 비교할 수 있는 기능을 지원합니다.

Gemini 3.1 Flash Lite 사용 시 주의사항

현재 제한 사항

프리뷰 모델인 만큼 다음 사항을 유의하세요:

- 프리뷰 단계: 모델이 아직 Preview 상태이므로 API 인터페이스와 동작이 변경될 수 있습니다.

- 출력 제한: 최대 출력은 64K 토큰이며, 매우 긴 생성 작업은 분할 처리가 필요합니다.

- 초장문 컨텍스트 성능: 1M 토큰의 매우 긴 컨텍스트 환경(MRCR v2 1M 테스트 시 12.3%)에서는 성능이 다소 떨어질 수 있으므로, 최상의 결과를 위해 128K 이내로 제어하는 것을 권장합니다.

- 보안 경계: 이미지-텍스트 변환의 보안 점수는 개선이 필요하며, 민감한 콘텐츠를 다룰 때는 별도의 검토 단계를 추가하세요.

사용 제안

- 온도(Temperature) 파라미터: 번역 작업은

temperature=0.3, 요약 작업은temperature=0.5를 권장합니다. - 시스템 프롬프트: 명확한 역할 정의와 출력 형식 요구사항을 제공하면 출력 품질을 크게 향상시킬 수 있습니다.

- 대량 처리: 비동기 호출 방식을 활용하여 처리량을 높이고 모델의 속도 이점을 극대화하세요.

- 컨텍스트 제어: 1M 컨텍스트를 지원하지만, 최적의 가성비를 위해 일반적인 작업은 128K 이내로 유지하는 것이 좋습니다.

자주 묻는 질문 (FAQ)

Q1: Gemini 3.1 Flash Lite와 Gemini 3 Flash는 어떤 차이가 있나요?

Gemini 3.1 Flash Lite는 Gemini 3 시리즈 중 고빈도, 저비용 시나리오에 최적화된 경량화 버전입니다. Gemini 3 Flash와 비교했을 때 입력 비용은 75% 저렴하며($0.25 vs $1.00), 출력 속도는 약 64% 더 빠릅니다. 다만 복잡한 추론 작업에서의 성능은 다소 낮을 수 있습니다. 간단히 말해, 극강의 가성비가 필요하다면 Flash Lite를, 더 강력한 추론 능력이 필요하다면 Flash를 선택하세요. APIYI apiyi.com 플랫폼을 통해 두 모델을 동시에 테스트하여 여러분의 상황에 가장 적합한 모델을 빠르게 찾아보실 수 있습니다.

Q2: Gemini 3.1 Flash Lite는 번역 작업에 적합한가요?

매우 적합합니다. Gemini 3.1 Flash Lite는 다국어 벤치마크인 MMMLU에서 88.9%라는 높은 점수를 기록하며 동급 모델 중 최상위권을 차지했습니다. 100만 토큰당 $0.25라는 초저가 입력 비용과 초당 382 토큰의 출력 속도를 고려하면, 현재 대량 번역 작업에서 가장 가성비가 뛰어난 모델 중 하나입니다. APIYI apiyi.com에서 무료 테스트 크레딧을 받아 실제 번역 품질을 직접 확인해 보시는 것을 추천합니다.

Q3: OpenAI 호환 인터페이스를 통해 Gemini 3.1 Flash Lite를 호출하려면 어떻게 하나요?

base_url을 APIYI의 인터페이스 주소로 설정하고, model 매개변수에 gemini-3.1-flash-lite-preview를 입력하기만 하면 됩니다. 기존 OpenAI SDK 코드 구조를 수정할 필요 없이 원활하게 전환할 수 있습니다. 자세한 내용은 본문의 '빠른 시작' 섹션에 있는 코드 예제를 참고하세요.

Q4: Gemini 3.1 Flash Lite의 1M 컨텍스트 윈도우는 실제로 쓸만한가요?

128K 토큰 범위 내에서는 우수한 성능(MRCR v2 128K 점수 60.1%)을 보여주지만, 1M 토큰이라는 극단적인 상황에서는 성능이 눈에 띄게 저하됩니다(MRCR v2 1M 점수 12.3%). 일상적인 사용 시에는 128K 이내로 제어하는 것을 권장하며, 초장문 문서를 처리해야 할 경우 분할 전략을 사용하는 것이 좋습니다.

요약

Gemini 3.1 Flash Lite Preview는 100만 입력 토큰당 $0.25의 초저가, 초당 382 토큰의 빠른 출력 속도, 1M 토큰의 컨텍스트 윈도우를 갖추고 있습니다. 또한 다국어 처리(MMMLU 88.9%)와 과학적 추론(GPQA Diamond 86.9%) 등 벤치마크 테스트에서 뛰어난 성적을 거두며, 2026년 번역, 요약, 분류 등 고빈도 작업에서 가성비 최고의 모델로 자리 잡았습니다.

매일 수백만 토큰의 대량 번역을 처리해야 하거나, 저지연 실시간 요약 서비스를 구축하려는 경우 Gemini 3.1 Flash Lite는 가장 먼저 고려해야 할 선택지입니다.

APIYI apiyi.com을 통해 Gemini 3.1 Flash Lite Preview에 빠르게 접속해 보세요. 해당 플랫폼은 OpenAI 호환 인터페이스를 제공하며, 클릭 한 번으로 주요 모델 간 전환이 가능해 효과 검증 및 모델 비교가 매우 편리합니다.

참고 자료

-

Google DeepMind – Gemini 3.1 Flash-Lite 모델 카드: 공식 모델 기술 사양 및 벤치마크 데이터

- 링크:

deepmind.google/models/model-cards/gemini-3-1-flash-lite/

- 링크:

-

Google AI for Developers – Gemini 3.1 Flash-Lite 프리뷰: 공식 API 문서 및 개발 가이드

- 링크:

ai.google.dev/gemini-api/docs/models/gemini-3.1-flash-lite-preview

- 링크:

-

Artificial Analysis – 성능 평가: 독립적인 제3자 속도 및 성능 벤치마크

- 링크:

artificialanalysis.ai/models/gemini-3-1-flash-lite-preview

- 링크:

📝 작성자: APIYI 기술 팀 | 더 많은 AI 모델 사용 가이드와 기술 튜토리얼은 APIYI 도움말 센터 help.apiyi.com에서 확인하세요.