2026年4月14日、OpenAIは正式にGPT-5.4-Cyberをリリースしました。これはGPT-5.4をベースに、防御的なサイバーセキュリティ業務に特化して微調整(ファインチューニング)を施した「cyber-permissive(寛容なネットワークセキュリティ設定)」モデルです。一般的なコンシューマー向けモデルとの最大の違いは、セキュリティ研究関連タスクにおける拒否しきい値が緩和されている点です。さらに、ソースコードなしでコンパイル済みの実行ファイルを分析し、脆弱性や悪意のあるコードを特定するバイナリ・リバースエンジニアリング能力を初めて公式にサポートしました。

このモデルは、OpenAIの「Trusted Access for Cyber」プログラムにおいて最高レベルの認証を受けたセキュリティ研究者や機関のみに提供されており、一般開発者向けの公開APIではありません。リリースのタイミングも非常に戦略的です。Anthropicの同カテゴリ製品である「Claude Mythos」のリリースからわずか1週間後というタイミングであり、「AI × サイバーセキュリティ」という新たな競争領域における両社の火花が激しく散っています。

GPT-5.4-Cyberとは?核心的な事実のクイックまとめ

技術的な詳細はさておき、今回のリリースのポイントを30秒で把握できる表を作成しました。

| 項目 | 内容 |

|---|---|

| リリース日 | 2026年4月14日 |

| 提供元 | OpenAI |

| モデルの立ち位置 | GPT-5.4の「cyber-permissive」微調整版 |

| 中核目標 | 防御的サイバーセキュリティ業務(Defensive Cybersecurity) |

| 新機能 | バイナリ・リバースエンジニアリング(ソースコード不要) |

| アクセス方法 | 「Trusted Access for Cyber」最高レベル認証者限定 |

| 個人向け入口 | chatgpt.com/cyber(本人確認書類の提出が必要) |

| 法人向け入口 | OpenAI担当者による申請審査 |

| 対象規模 | 数千人の個人防御者、数百のセキュリティチーム |

| 価格 | 公式非公開 |

| 主な競合 | Anthropic Claude Mythos(1週間前に先行リリース) |

このモデルは、開発者がこれまで慣れ親しんできたGPTとは一線を画しています。**単なるチャットやコード生成のアシスタントではなく、セキュリティ研究者にとっての「コンプライアンスの鍵」**のような役割を果たします。従来のGPT-5.4では安全策(セーフティガードレール)により回答が拒否されていた特定のシナリオを、専門家のために解禁するものです。

📌 要約:GPT-5.4-Cyberは、OpenAIが「高度なセキュリティ研究者」に向けて開いた狭い門であり、一般的な開発者向けの公開モデルではありません。この記事の後半では、「サードパーティのAPIプラットフォームから利用できるのか?」という重要な疑問についても解説していきます。

GPT-5.4-Cyber の5つの主要能力を解剖

OpenAI の公式声明や第三者の報道から判断すると、このモデルと通常の GPT-5.4 との主な違いは5つの側面に集約されます。

能力1:cyber-permissive(寛容なセキュリティポリシー)

これが本モデルの核となる哲学です。通常の GPT-5.4 はトレーニング時、「悪意のある攻撃や脆弱性の悪用にみえる」リクエストに対してデフォルトで拒否するよう設定されています。この「誤検知を恐れる」戦略は一般ユーザーを守る一方で、正当な業務を行うセキュリティリサーチャーにとっては大きな悩みの種となっていました。彼らがペネトレーションテスト、脆弱性研究、マルウェア解析などを行う際、モデルに「申し訳ありませんが、そのお手伝いはできません」と拒絶されることが頻繁にあったためです。

GPT-5.4-Cyber は、この壁を「認証済みセキュリティリサーチャー」に対してのみ低く設定しており、通常版では対応できない脆弱性の悪用手順の深い分析、エクスプロイト原理の議論、PoC(概念実証)作成の補助などが可能となっています。

能力2:バイナリ・リバースエンジニアリング

今回のリリースで最も技術的な難易度が高い新機能です。従来、バイナリのリバースエンジニアリングは IDA Pro、Ghidra、Binary Ninja といった専門ツールと、セキュリティリサーチャーによる手動解析に依存していました。GPT-5.4-Cyber は、コンパイル済みのバイナリファイルを直接解析し、以下のことが可能です。

- ソースコードなしでの潜在的な脆弱性の特定(バッファオーバーフロー、フォーマット文字列攻撃、UAFなど)

- マルウェアの挙動分析(C2通信、永続化、アンチデバッグ)

- 実行ファイルの制御フロー論理の復元

- YARAルールの生成または検証の補助

つまり、セキュリティチームは初期のスクリーニング作業をAIに任せ、人間はより複雑な部分に集中できるようになります。

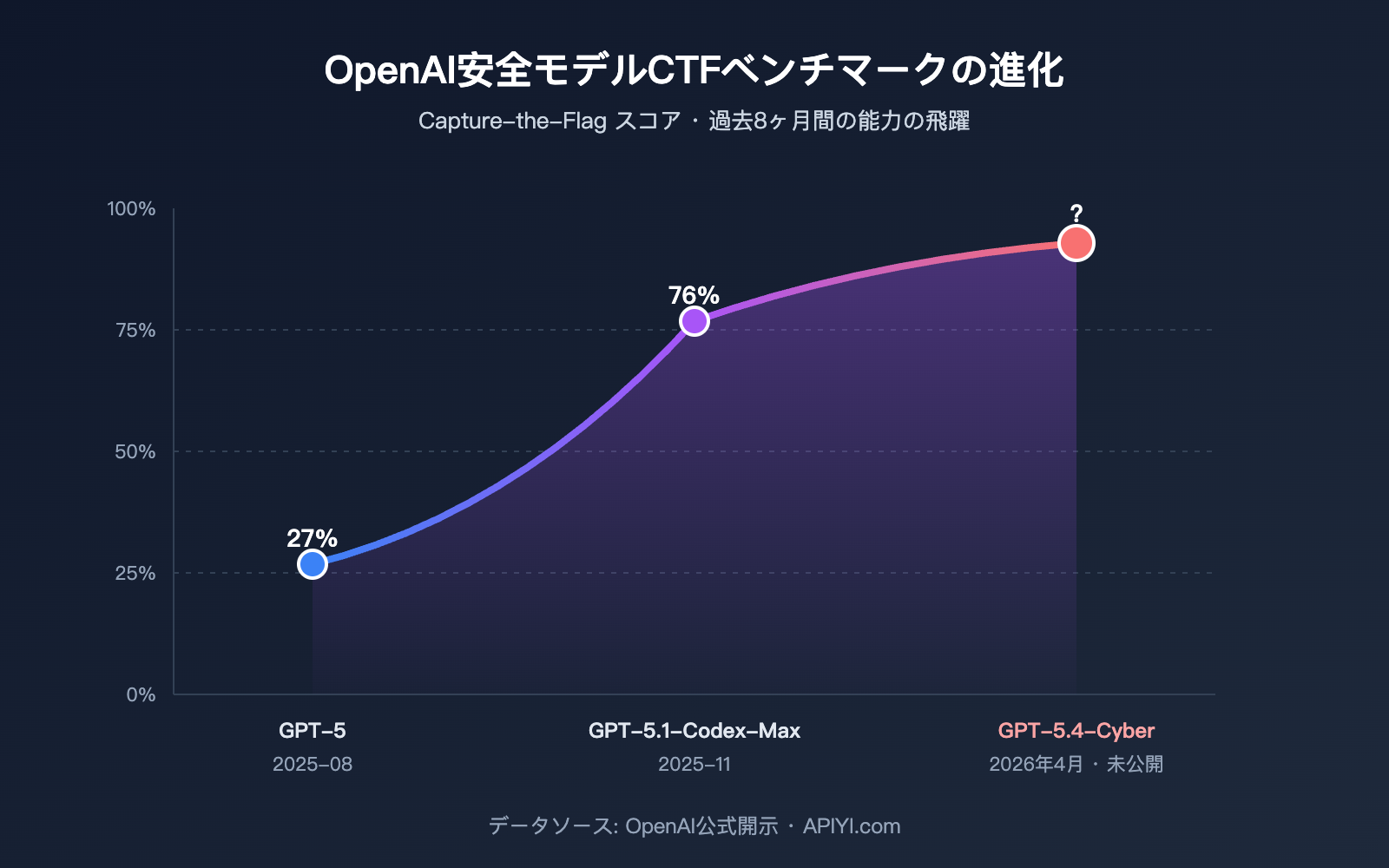

能力3:CTF基準の大幅な向上

OpenAI はリリース資料の中で、サイバーセキュリティのシナリオにおけるモデルの進化を示す、参考価値の高い性能データを公開しました。

- GPT-5(2025年8月)Capture-the-Flag ベンチマークスコア:27%

- GPT-5.1-Codex-Max(2025年11月)CTF ベンチマークスコア:76%

GPT-5.4-Cyber 個別の CTF スコアは公開されていませんが、このグラフは、OpenAI が過去1年間でセキュリティ能力に対し、いかに膨大なトレーニングとアライメントのリソースを投入してきたかを物語っています。

能力4:拒否しきい値(Refusal Boundary)の引き下げ

従来の GPT の安全ガードレールは、セキュリティ研究の文脈で非常に高い誤拒否率を示していました。GPT-5.4-Cyber の重要なプロダクト決定は、「アイデンティティ認証結果」に基づいて拒否しきい値を調整する権限を持たせたことです。認証を受けたユーザーグループに対しては、モデルがより適切な尺度で安全に関する話題を処理します。これにより、「ジェイルブレイク版 GPT」になることもなければ、通常版のようにリスクを示唆する単語に対して一律に拒否することもなくなります。

この背後には、包括的なアイデンティティ信頼チェーンが存在します(Persona 身分証確認 → Trusted Access 階層認証 → 認証レベルに応じたモデルの応答戦略調整)。

能力5:防御的ポジショニング(Defensive Only)

OpenAI は全てのリリース資料において、「defensive cybersecurity(防御的サイバーセキュリティ)」であることを繰り返し強調しています。これは意図的な政治的立ち位置の表明です。モデルは守備側(ブルーチーム、セキュリティベンダー、研究機関)のためのものであり、攻撃側のものではありません。この立場により、アクセス審査は極めて厳格に行われます。

| 能力項目 | 通常の GPT-5.4 | GPT-5.4-Cyber |

|---|---|---|

| セキュリティポリシーの厳格度 | 高(リスクを伴うリクエストはデフォルトで拒否) | 制御された緩和(認証レベルに基づく) |

| バイナリ・リバースエンジニアリング | 限定的サポート | 深層サポート(最大のセールスポイント) |

| 脆弱性悪用原理の議論 | ほとんど拒否 | 認証後に深度ある議論が可能 |

| マルウェア分析 | 浅い説明 | 完全な分析の支援が可能 |

| アクセスの壁 | 一般有料 API | Trusted Access 最高レベルが必須 |

| 想定ユーザー | 全ての開発者 | 認証済みセキュリティリサーチャー |

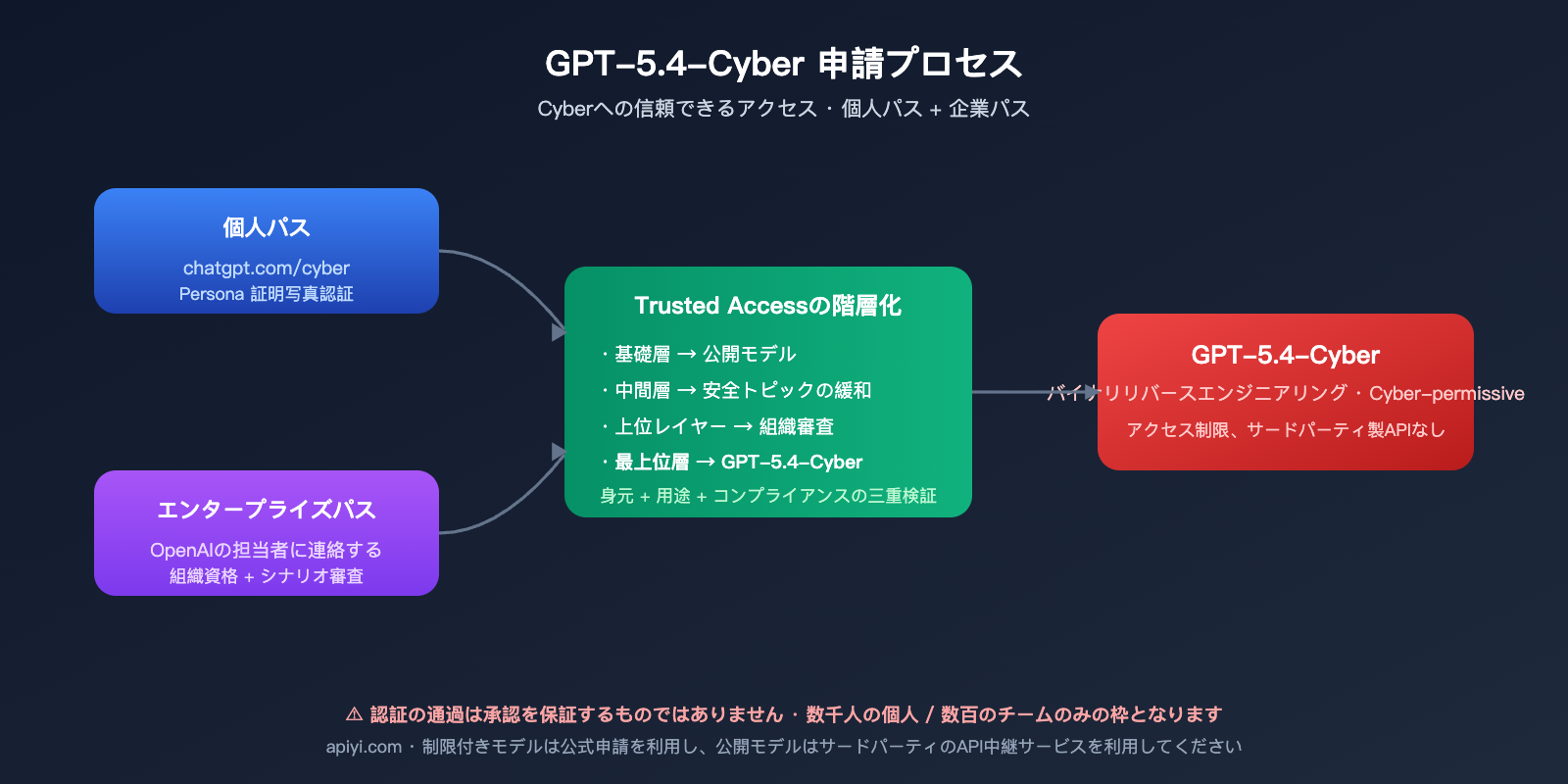

GPT-5.4-Cyber の申請方法:Trusted Access の階層とプロセス

Trusted Access for Cyber は OpenAI が2026年2月に開始したプロジェクトであり、あわせて1,000万ドルのサイバーセキュリティ助成金基金も発表されました。4月14日のアップデートにおける最大の変更点は、従来の「アクセス許可または拒否」という大まかな区分から階層型アクセス制御へと拡大し、最高レベルのアクセス資格を GPT-5.4-Cyber と紐付けたことです。

階層認証の対照表

| 階層 | 対象 | 利用可能な機能 | 認証方法 |

|---|---|---|---|

| 基礎層 | 登録済み ChatGPT ユーザー | 通常の GPT-5.4 等の公開モデル | 通常アカウント |

| 中級層 | 認証済みのセキュリティ専門家 | 制限が緩和された安全関連の回答 | Persona ID認証 |

| 上級層 | 認証済みセキュリティチーム・機関 | より広範なセキュリティ業務への対応 | 組織・個人の二重認証 |

| 最高層 | Trusted Access 認証機関の研究員 | GPT-5.4-Cyber の利用 | OpenAI の審査が必要 |

個人申請プロセス

chatgpt.com/cyberにアクセス- Persona ID認証サービスを使用して、政府発行の本人確認書類の画像をアップロード

- システムが認証レベルを判定

- 最高レベルの資格を満たしている場合、GPT-5.4-Cyber の先行提供リストへの参加を申請可能

企業申請プロセス

- 在籍企業の OpenAI 担当者(Account Manager)に連絡

- チームの背景、使用シナリオの説明、コンプライアンス遵守の誓約を提出

- 審査通過後、ワークスペースにて特定のメンバーに対して Trusted Access 最高レベルの権限を付与

- メンバーがワークスペース内から GPT-5.4-Cyber へのアクセスをリクエスト

⚠️ 注意: OpenAI は初期段階では非常に慎重にアクセス権を拡大するとしており、本人確認を済ませたとしても、必ずしも GPT-5.4-Cyber へのアクセス権が得られるわけではありません。対象範囲は「数千人の個人防御者、数百のセキュリティチーム」を目標としており、世界中のセキュリティ業界の規模から見れば極めて希少なリソースとなっています。

サードパーティAPIプラットフォーム経由でGPT-5.4-Cyberを呼び出せるか?:誠実な回答

これは多くの読者が最も気にかけている質問です。OpenAIが公開している現在のプロダクト設計に基づき、一切の誇張抜きで回答します。

🚨 現時点での結論:不可能

GPT-5.4-Cyberへのアクセス権は、OpenAIアカウントのIDと深く紐付けられており、通常のAPIチャネルを通じて外部に提供されることはありません。つまり、以下のようになります:

- ❌ OpenAIの公式APIを通じて一般ユーザーや汎用開発者に提供されることはありません。

- ❌ APIYI (apiyi.com) を含む、いかなるサードパーティのAPI中継サービスからも呼び出せません。

- ❌ 「支払い証明」ではなく「本人認証」が必要なため、APIキーを購入して取得することも不可能です。

- ✅ 「Trusted Access for Cyber」最高レベルの認証を受けたアカウントのみが、ChatGPTまたは専用のエンタープライズワークスペースを通じて利用可能です。

これはモデルのプロダクトとしての立ち位置によるものです。もしGPT-5.4-Cyberが認証を回避して中継APIで利用できてしまえば、その「サイバー許容(cyber-permissive)」という特性が即座に悪意のあるユーザーによって悪用される恐れがあります。OpenAIはそのようなルートを設計段階で断ち切っています。

利用可能な代替案の比較

開発者や研究者の皆様のニーズに応じて、現実的なパスを提案します。

| ニーズ | 推奨されるアプローチ |

|---|---|

| コンプライアンスを遵守する高度なセキュリティ研究者で、GPT-5.4-Cyber本来の能力が必要 | 公式の chatgpt.com/cyber から申請してください(中継サービスは不可) |

| 通常版のGPT-5.4を使って汎用的なAI開発がしたい | APIYI (apiyi.com) の統合インターフェース経由でGPT-5.4を呼び出してください |

| セキュリティ補助スクリプトを開発したいが、GPT-5.4-Cyberの対象ユーザーではない | APIYI経由でGPT-5 / GPT-5.4 / Claudeなどの公開モデルをご利用ください |

| セキュリティ知識の学習や、非機密な分析を行いたい | 通常版のGPT-5.4で十分であり、あらゆる公開APIプラットフォームで利用可能です |

💡 重要な注意点:APIYI (apiyi.com) はGPT-5.4-Cyberの呼び出しを提供していません。これはOpenAIの制限付き公開戦略によるものであり、APIYIの商業的な選択ではありません。今後、もし「GPT-5.4-Cyberを代理で呼び出せる」と謳うプラットフォームがあれば、それはOpenAIの利用規約に違反しているか、あるいは身分偽装に関わるグレーなサービスの可能性が高いため、十分ご注意ください。

APIYIでできること

GPT-5.4-Cyber以外のほとんどのシナリオにおいて、APIYI (apiyi.com) は引き続き皆様をサポートします:

from openai import OpenAI

client = OpenAI(

api_key="あなたの-APIYI-KEY",

base_url="https://api.apiyi.com/v1"

)

# 通常のGPT-5.4 / GPT-5は呼び出し可能

response = client.chat.completions.create(

model="gpt-5.4",

messages=[

{"role": "user", "content": "このコードに存在する可能性のあるSQLインジェクションのリスクを分析してください"}

]

)

print(response.choices[0].message.content)

上記のコードはAPIYIの統合インターフェース上で安定して動作します。これは公開版のGPT-5.4であり、GPT-5.4-Cyberではありません。通常のコードレビュー、ドキュメント生成、ビジネス統合にはこれで十分対応可能です。

GPT-5.4-Cyber vs Anthropic Claude Mythos:両社の戦略の差異

Claude MythosはGPT-5.4-Cyberの約1週間前に発表されており、両社は「AI × 防御的サイバーセキュリティ」に対する異なる戦略を提示しています。

| 比較項目 | OpenAI GPT-5.4-Cyber | Anthropic Claude Mythos |

|---|---|---|

| リリース日 | 2026年4月14日 | 2026年4月7日(約1週間早い) |

| ベースモデル | GPT-5.4 ファインチューニング版 | Claude 変種 |

| アクセス戦略 | 階層的承認、最高層がリクエスト可 | 深層協力機関との連携 |

| 初期規模 | 数千人の個人+数百のチーム | 約40機関 |

| 主な売り | バイナリ・リバースエンジニアリング + サイバー許容 | 非公開 |

| 提供チャネル | chatgpt.com/cyber + 企業AM | 機関提携 |

| 戦略的意図 | 「認証済みコミュニティ」への大規模展開 | 選別された機関との深層連携 |

ご覧の通り、両社の進む道は明確に異なります。OpenAIは「認証=アクセス権」という規模拡大モデルを選択し、可能な限り多くの認証済みセキュリティ専門家へ恩恵を広げようとしています。一方でAnthropicは「機関提携」という選別モデルを選択し、カバー範囲を絞ることでより厳格な品質管理を優先しています。長期的に見れば、この両ルートにはそれぞれの市場があり、今後長きにわたって共存していく可能性が高いでしょう。

業界と開発者への影響分析

影響1:AIがセキュリティツールチェーンの役割として「公式化」

これまでセキュリティ研究者がChatGPTをコードレビューや脆弱性分析に使う際は「自己流」で行う必要があり、セキュリティポリシーによって遮断されることも頻繁にありました。GPT-5.4-Cyberのリリースは、OpenAIが初めて「セキュリティ研究者」を独立したユーザー層として扱ったことを意味しており、今後このような業界特化型モデルはますます増えていくでしょう。

影響2:本人認証+能力解放が新たなパラダイムに

GPT-5.4-Cyberが採用した「Persona身分証認証+階層別アクセス権限」によって能力を解放する仕組みは、汎用AI製品において非常に新しいプロダクトモデルです。今後、金融、医療、法律といった規制の厳しい分野において、「身分証明+モデル能力の階層化」という組み合わせがより多く登場することが予想されます。

影響3:サードパーティAPIプラットフォームの立ち位置がより明確に

APIYI(apiyi.com)のようなサードパーティの統合APIプラットフォームにとって、GPT-5.4-Cyberの登場は、実質的に境界線を明確にしました。アクセス制限のあるモデルは公式直結で利用し、公開モデルはAPI中継サービスが開発者の利便性をサポートするという形です。両者の市場は補完関係にあり、競合するものではありません。

影響4:ブルーチームの効率が実質的に向上

もしGPT-5.4-Cyberのバイナリリバースエンジニアリング能力が公式の主張通り成熟しているのであれば、ブルーチームの悪意あるサンプル分析、ファームウェア監査、パッチ差分分析といったタスクにおける効率は飛躍的に向上するはずです。これは業界全体にとって朗報と言えます。

FAQ よくある質問

Q1: 個人開発者がGPT-5.4-Cyberを利用するチャンスはありますか?

あなたが登録済みで、明確な業務シナリオを持つセキュリティ研究者であれば、Persona身分証認証を経てTrusted Accessの最高レベルに到達し、利用できる可能性があります。もし単にこのモデルに興味があるという程度であれば、基本的にチャンスはありません。一般的な開発者は、公開されているGPT-5.4に注力することをお勧めします。APIYI(apiyi.com)の統合インターフェースを通じて安定して呼び出すことが可能です。

Q2: VPNや偽造身分で制限を回避できますか?

推奨しませんし、絶対に行わないでください。身分偽造や不正利用が検知された場合、アカウントは即座に停止され、所属組織全体のアクセス資格にも影響を及ぼす可能性があります。Trusted Accessの不正利用検知は非常に厳格です。

Q3: 価格情報はありますか?

OpenAIはGPT-5.4-Cyberの価格を公開していません。業界の慣例からすると、このような高度に制限された特化型モデルは、通常のAPIのようなトークン単位の課金ではなく、企業契約やシート単位のサブスクリプション方式で提供される可能性が高いでしょう。

Q4: GPT-5.4-Cyberを使って攻撃を行うことはできますか?

設計上および利用規約上、許可されていません。このモデルは**「防御的サイバーセキュリティ(defensive cybersecurity)」**を目的としており、規約違反はアカウント停止や法的リスクに直面します。OpenAIのTrusted Accessでは、利用規約への同意が求められます。

Q5: APIYI(apiyi.com)ではいつGPT-5.4-Cyberが利用可能になりますか?

導入予定はありません。このモデルの配信メカニズムは、設計段階からサードパーティの中継を排除しているためです。APIYIは今後も、通常のGPT-5、GPT-5.4、oシリーズ、Claudeなど、広く公開されているモデルの拡充を続け、多くの開発者の日常的なニーズをカバーしていきます。

Q6: GPT-5.4-CyberとCodex、oシリーズとの関係は?

これらはすべてOpenAIの製品ラインですが、位置付けが異なります。Codexはコード生成寄り、oシリーズは深い推論寄り、そしてGPT-5.4-Cyberはセキュリティシナリオ向けに微調整されたバリエーションです。能力に重複があるかもしれませんが、アクセス権限の仕組みは全く異なります。

Q7: 中小規模のセキュリティチームはどうやって申請すればいいですか?

OpenAIの担当者(またはビジネスチャネル)を通じて、チームの資格情報、利用シナリオ、コンプライアンスへの誓約を提出してください。初期段階では、資格が明確で利用目的がはっきりしている組織が優先的に承認されます。直接の窓口がない小規模チームは、まずコンプライアンス関連の資料を準備してから申請することをお勧めします。

Q8: 日本国内の企業でも利用できますか?

OpenAIのサービスには地域制限があり、国内の法人が直接利用するにはコンプライアンスや可用性の面で課題があります。通常のGPT-5.4で汎用的なAI能力を構築したい場合は、APIYI(apiyi.com)の国内からアクセス可能なインターフェースを通じて呼び出すことができます。GPT-5.4-Cyberのような高度に機密性の高い能力については、コンプライアンスを遵守したチャネルを通じてOpenAIの国際部門と直接連携することをお勧めします。

まとめ: 「ニッチ向けだが、影響は甚大」なモデル

冒頭の問いに戻りましょう。GPT-5.4-Cyber は一体何を意味するのでしょうか?

- セキュリティ研究者にとって:これは、通常のモデルでは解読できない分析タスク、特にバイナリのリバースエンジニアリング能力を解放するための「公式認定の鍵」です。ブルーチームの日常的なワークフローを根本から変えることになるでしょう。

- 一般的な開発者にとって:このモデルが必要になるケースはほとんどないはずですが、焦る必要はありません。公開版の GPT-5.4 は日常的な AI 開発ニーズの 95% をカバーしており、APIYI (apiyi.com) を通じて安定かつ便利に利用可能です。

- 業界にとって:ID 認証と階層的なアクセス制御を組み合わせたプロダクトモデルは、今後より多くの専門的な領域で参考にされるでしょう。また、サードパーティの API プラットフォームと公式の制限付きモデルとの役割分担も、より明確になっていきます。

- 競争環境について:サイバーセキュリティモデルにおける OpenAI と Anthropic の真っ向勝負が始まりました。両社の路線の違いは、「AI セキュリティ」に対するそれぞれの異なる解釈を反映しています。

📢 一言アドバイス:コンプライアンスを遵守するセキュリティ研究者は chatgpt.com/cyber から公式申請を行ってください。一般的な開発者は、これまで通り APIYI (apiyi.com) 経由で通常の GPT-5.4 を利用すれば十分です。「GPT-5.4-Cyber を代理で呼び出せる」と謳うサードパーティサービスには警戒してください。それらは利用規約に違反しているか、詐欺である可能性が高いです。

著者:APIYI Team · AI 大規模言語モデルのリリースと接続トレンドを継続的に追跡 · apiyi.com