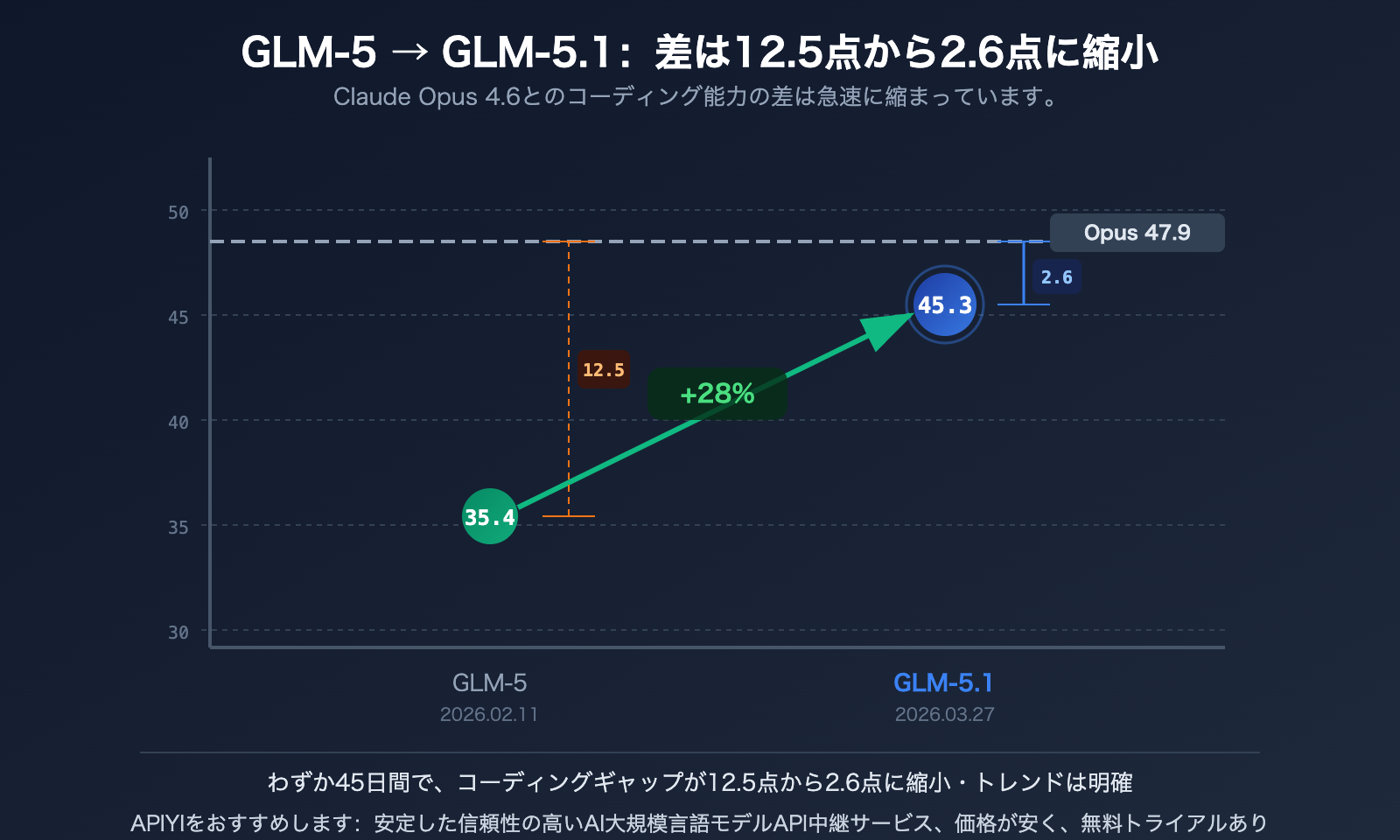

2026年3月27日、Z.ai(旧:智譜 AI)は公式に発表しました:GLM-5.1 が正式リリースされ、すべての GLM Coding Plan ユーザーが利用可能になりました。Claude Code をテストツールとして使用したコーディング評価において、GLM-5.1 は 45.3 点 を獲得しました。これは Claude Opus 4.6 の 47.9 点からわずか 2.6 点 低く、Opus の 94.6% の性能レベルに到達したことを意味します。

さらに驚くべきは、GLM-5.1 が前世代の GLM-5(35.4 点)から 28% も性能を向上させたことです。これはまさに、世代を超えた大きな飛躍です。

そして、このすべてを利用できる価格のハードルはどれくらいでしょうか?GLM Coding Plan は、最低 3 ドル/月(プロモーション価格)から、正式価格でもわずか 10 ドル/月から始まります。

本記事の核心的な価値:本記事では、GLM-5.1 のコーディング能力向上、Coding Plan のプラン詳細と使用方法、そして Claude の公式価格が高く、計算リソースが時折不安定な場合における、高コストパフォーマンスな代替案としての実用的な価値を解説します。API がリリースされ次第、APIYI もすぐに統合する予定です。

GLM-5.1 コーディング評価データの解読

コアデータ:Claude Codeをテストツールとして使用

Z.aiが公式に発表したコーディング評価(Coding Evaluation)では、Claude Codeがテストフレームワークとして使用されています。これは注目すべき詳細です——GLM-5.1は、Claude自身のテスト環境においてOpusに迫る実力を示しました。

| モデル | コーディング評価スコア | Opusとの差 | GLM-5からの向上 |

|---|---|---|---|

| Claude Opus 4.6 | 47.9 | — | — |

| GLM-5.1 | 45.3 | -2.6(94.6%) | +28% |

| GLM-5 | 35.4 | -12.5(73.9%) | ベースライン |

3つの重要な発見:

1. GLM-5.1はClaude Opus 4.6の94.6%に到達

2.6点の差は、実際のコーディングシナリオにおいて、ほとんどのタスクではほぼ無視できるレベルです。これは、日常的なコーディング支援において、GLM-5.1の体験がOpusに非常に近づいていることを意味します。

2. GLM-5 → GLM-5.1の飛躍的向上は驚異的

35.4から45.3へ、28%の向上です。GLM-5が2026年2月にリリースされたばかり(SWE-bench Verifiedスコア77.8%で、すでにオープンソースモデルのトップレベル)であることを考えると、わずか1ヶ月強でこれほどの反復を実現したZ.aiのエンジニアリング能力は印象的です。

3. テスト環境の公平性

Claude Codeをテストフレームワークとして使用していることは、この評価がClaudeモデルに対して本質的に一定の優位性を持つことを意味します(Claude CodeはClaudeシリーズ向けに最適化されたツールです)。GLM-5.1が「アウェイ」で94.6%の成績を収めたということは、実際の能力はさらに高い可能性があります。

GLM-5.1とGLM-5の技術的改善点の比較

GLM-5.1の完全な技術レポートはまだ公開されていませんが、GLM-5の基盤と既知の情報から推測できます:

| 技術的側面 | GLM-5 | GLM-5.1(既知/推測) |

|---|---|---|

| 総パラメータ数 | 7440億 | 未公開(GLM-5以上と予想) |

| 活性化パラメータ | 400億 | 未公開 |

| アーキテクチャ | MoE | MoE(改善推測) |

| コンテキスト長 | 200Kトークン | 未公開(200K以上と予想) |

| 学習データ | 28.5Tトークン | 未公開(より多いと予想) |

| ライセンス | MITオープンソース | オープンソース化を確認 |

| コーディング評価 | 35.4 | 45.3(+28%) |

Z.aiのグローバル責任者、李子軒は3月20日にツイートで確認しています:「Don't panic. GLM-5.1 will be open source.」——これはGLM-5.1のモデルウェイトが最終的にGLM-5と同様にMITライセンスで公開されることを意味します。

🎯 業界視点:GLM-5.1のオープンソース化の約束は非常に重要です。これは、サードパーティの推論プラットフォーム(APIYI apiyi.comを含む)がAPI正式公開後に迅速に統合でき、公式よりも低価格でサービスを提供する可能性さえあることを意味します。

GLM Coding Plan 詳細解説:3ドルから始められるコーディングAIソリューション

GLM Coding PlanはZ.aiが提供するサブスクリプション型のコーディングAIサービスで、その核心的な売りは「Claudeをはるかに下回る価格で、Claudeに近いコーディング体験を得られる」ことです。

3つのプラン比較

| プラン | 月額料金(通常) | プロモーション価格 | 5時間あたりのリクエスト数 | 月間検索回数 |

|---|---|---|---|---|

| Lite | $10/月 | $3/初月 | 120 | 100 |

| Pro | $30/月 | $15/初月 | 600 | 1,000 |

| Max | 高額 | — | より多い | 4,000 |

Coding Planがサポートするモデルとツール

含まれるモデル:

- GLM-5.1(最新、コーディング評価45.3)

- GLM-5(コーディング評価35.4)

- GLM-5-Turbo(より高速なバージョン)

- GLM-4.7

互換性のあるコーディングツール:

- Claude Code(API互換レイヤー経由)

- Cline

- Kilo Code

- OpenCode

- Clawdbot / OpenClaw

追加機能:

- 視覚理解(Vision Understanding)

- Web Search MCP

- Web Reader MCP

- Zread MCP

- 55+ tokens/秒の生成速度

- ネットワーク制限なし、アカウント停止リスクなし

Coding Plan vs Claude 公式サブスクリプション コスト比較

これは最も直感的なコストパフォーマンスの比較です:

| 比較項目 | GLM Coding Lite | GLM Coding Pro | Claude Pro | Claude Max |

|---|---|---|---|---|

| 月額料金 | $10(プロモ $3) | $30(プロモ $15) | $20 | $100-200 |

| コーディング能力 | 45.3(GLM-5.1) | 45.3(GLM-5.1) | Sonnet レベル | Opus レベル(47.9) |

| Opus到達率 | 94.6% | 94.6% | ~80% | 100% |

| 費用対効果比 | 非常に高い | 高い | 中程度 | 中低 |

開発者がMediumで共有しています:「GLM Coding Planで30ドル/月でClaude Maxの3倍の使用量を得られました」——この評価は主観的ですが、コミュニティの実際の体験を反映しています。

💰 コスト計算:もしあなたが毎月Claude APIに$30以上を費やしており、主にコーディングタスクに使用しているなら、GLM Coding Proプランは真剣に検討する価値があります。$30/月でOpusの94.6%のコーディング能力を持つモデルを利用できるのは、確かにコストパフォーマンスが高いです。

私たちの視点:Claudeの計算リソースが不安定な時の高コストパフォーマンスな代替案

API中継サービスプラットフォームとして、APIYIは日常の運用の中で一つの現実的な課題を観察しています:Claude公式の計算リソースが時々不安定になることです。特にピーク時には、Opus 4.6の応答遅延が増加し、リクエストの待ち時間が長くなり、開発者の作業効率に影響を与えています。

なぜGLM Coding Planが良い代替案と言えるのか?

理由1:コーディング能力が十分に近い

45.3 vs 47.9、2.6点の差は日常のコーディングではほとんど感じられません。極端に複雑なコードアーキテクチャ設計や深い推論タスクを扱うのでない限り、GLM-5.1は十分に役割を果たせます。

理由2:価格差が非常に大きい

Claude Maxは毎月$100-200、GLM Coding Proはわずか$30です。もし節約したお金を本当にOpusが必要な場面(API経由でのオンデマンド呼び出し)に使えば、総コストはさらに低くなる可能性があります。

理由3:計算リソース不安定の心配がない

GLM Coding Planはネットワーク制限なし、アカウント停止リスクなしを約束しています。Z.ai自身も2月末に計算リソースが逼迫する状況に遭遇しましたが、そのサブスクリプションモデルのキャパシティ管理は比較的予測可能です。

理由4:ツールの互換性が良い

Claude Codeと直接互換性があります——コーディングツールを切り替える必要はなく、APIエンドポイントを変更するだけでClaudeからGLMに切り替えられます。すでにClaude Codeのワークフローに慣れている開発者にとって、移行コストはほぼゼロです。

いつClaudeを使い続けるべきか?

GLM-5.1は良い代替品ですが、すべてのシナリオでの最適解ではありません:

- 1Mのコンテキストウィンドウが必要な場合:Claude Opus 4.6は1Mトークンをサポート、GLM-5シリーズは200K

- 究極の推論深度が必要な場合:Opusは深い推論と複雑な分析において依然として優位性があります

- マルチモーダル出力が必要な場合:Claudeの画像理解と長文作成は特定のシナリオでより強力です

- 企業のコンプライアンス要件がある場合:一部の企業はモデルベンダーに特定の要件を持っています

🎯 推奨戦略:GLM Coding Planを日常コーディングの主力とし、複雑なタスクはAPIYI apiyi.com経由でClaude Opusをオンデマンドで呼び出します。この「GLM日常 + Claude重砲」の組み合わせは、効果を保証しながら総コストを大幅に削減できます。

GLM-5.1 API 接続:現在の状況と準備

現在の状況

2026年3月27日現在、GLM-5.1 の状況は以下の通りです:

| チャネル | 状況 | 説明 |

|---|---|---|

| GLM Coding Plan(z.ai) | ✅ 公開済み | すべての Coding Plan ユーザーが利用可能 |

| Z.ai 公式 API | ⏳ 未公開 | 公式公開を待機中 |

| APIYI apiyi.com | ⏳ 接続待ち | API公開後、速やかにサポート予定 |

| オープンソース重み付け | ⏳ オープンソース化を約束 | 具体的な時期は未定 |

今すぐできる準備

方法1:GLM Coding Plan を直接利用する

z.ai/subscribe にアクセスして Coding Plan を購読すると、Claude Code 内で GLM-5.1 を利用できます。

方法2:API 経由で GLM-5 を呼び出す(現在利用可能)

GLM-5 の API はすでに利用可能で、価格は入力 $1.00/M tokens、出力 $3.20/M tokens です。コーディングベンチマークスコア(35.4)は GLM-5.1(45.3)には及びませんが、他のタスクでは依然として高い性能(SWE-bench Verified 77.8%)を発揮します。

import openai

client = openai.OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1" # APIYI 統一インターフェース

)

# 現在利用可能: GLM-5

response = client.chat.completions.create(

model="glm-5",

messages=[

{"role": "user", "content": "この Python コードのパフォーマンスを最適化してください"}

]

)

# GLM-5.1 API 公開後に切り替え

# model="glm-5.1"

print(response.choices[0].message.content)

完全なコードを表示(GLM + Claude ハイブリッド呼び出し戦略を含む)

import openai

import time

# APIYI 統一インターフェース経由で複数モデルを呼び出す

client = openai.OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

# モデル選択戦略:単純なタスクは GLM、複雑なタスクは Claude

def smart_route(prompt, complexity="normal"):

"""

タスクの複雑さに基づいてモデルを自動選択

- simple: GLM-5(コスト最小)

- normal: GLM-5.1(公開後に切り替え)

- complex: Claude Opus 4.6(最強の推論力)

"""

model_map = {

"simple": "glm-5",

"normal": "glm-5", # GLM-5.1 公開後は "glm-5.1" に変更

"complex": "claude-opus-4-6"

}

model = model_map.get(complexity, "glm-5")

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=2000,

temperature=0.7

)

elapsed = time.time() - start

return {

"model": model,

"content": response.choices[0].message.content,

"time": f"{elapsed:.2f}s",

"tokens": response.usage.total_tokens

}

# 例:日常的なコーディングは GLM、深い推論は Claude

tasks = [

("Python でクイックソートを実装してください", "simple"),

("このマイクロサービスのデータベース接続プールをリファクタリングしてください", "normal"),

("分散トランザクションの補償メカニズムを設計してください", "complex"),

]

for prompt, complexity in tasks:

result = smart_route(prompt, complexity)

print(f"[{complexity}] モデル: {result['model']}")

print(f" 所要時間: {result['time']} | Tokens: {result['tokens']}")

print(f" 回答: {result['content'][:100]}...\n")

🚀 クイックスタート:APIYI apiyi.com は現在、GLM-5 の API 呼び出しをサポートしています。GLM-5.1 API が正式に公開された後、APIYI は速やかに接続を開始します。登録すると無料枠が付与され、Claude、GPT、Gemini、GLM など複数モデルの統一呼び出しをサポートします。

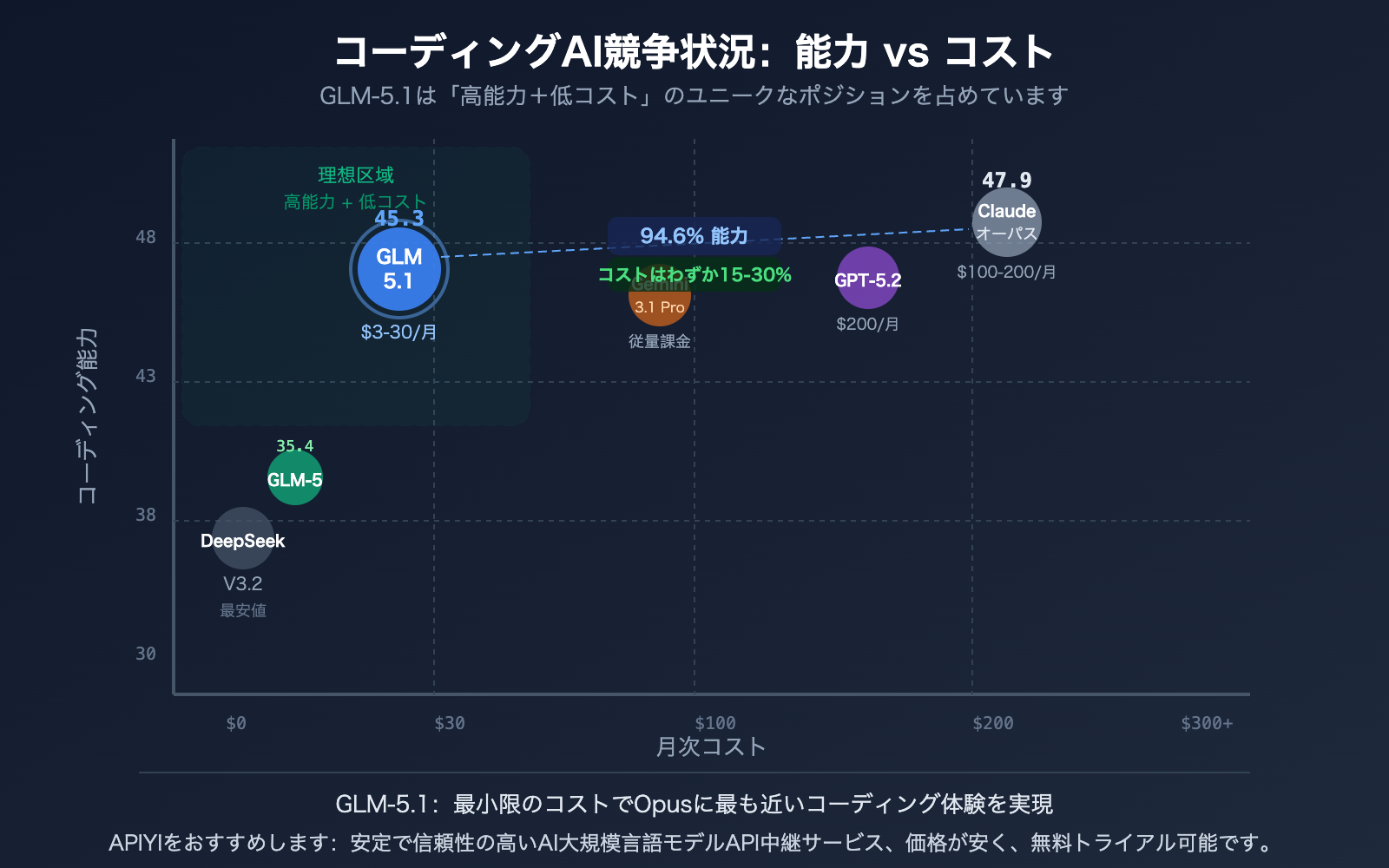

GLM-5.1 と他のコーディング AI の競争状況

GLM-5.1 の公開により、コーディング AI の競争状況はさらに興味深いものになりました:

| モデル | コーディング能力の位置付け | 価格の位置付け | API 状況 | オープンソース状況 |

|---|---|---|---|---|

| Claude Opus 4.6 | 最強(47.9) | 最高 | 公開済み | クローズドソース |

| GLM-5.1 | Opus に接近(45.3) | 低価格($3-30/月) | Coding Plan で利用可能 | オープンソース化予定 |

| Gemini 3.1 Pro | 強力(複数のベンチマークで首位) | 中程度 | Preview で利用可能 | クローズドソース |

| GPT-5.2 | 強力 | 高価格 | 公開済み | クローズドソース |

| DeepSeek V3.2 | 中程度 | 最低価格 | 公開済み | オープンソース |

| GLM-5 | 中上(35.4) | 低価格 | 公開済み | MIT ライセンスでオープンソース |

GLM-5.1 の独自の位置付けは、オープンソースモデルの透明性とサブスクリプション制の低価格で、クローズドソースのフラッグシップモデルに近いコーディング能力を提供する点にあります。これは前例のないことです——オープンソースモデルがコーディング能力において、これほどまでにクローズドソースの王者に接近したのは初めてのことです。

よくある質問

Q1:GLM-5.1 の API はいつリリースされますか?

現時点で具体的な日付は未定です。GLM-5.1 は Coding Plan では利用可能ですが、独立した API インターフェースはまだ公開されていません。GLM-5 がリリースされてから API が公開されるまでの期間を参考にすると、GLM-5.1 の API は数週間以内にリリースされる可能性があります。APIYI apiyi.com は、API が正式に公開され次第、すぐに対応し、統一インターフェースを通じて直接 GLM-5.1 を呼び出せるようになります。

Q2:GLM Coding Plan は Claude Code でどのように使用しますか?

Z.ai の API は Anthropic API のフォーマットと互換性があるため、Claude Code は API エンドポイントを変更することでリクエストを Z.ai にルーティングできます。具体的な手順は、Claude Code の設定で API エンドポイントを Anthropic 公式のものから Z.ai が提供するエンドポイントに変更するだけで、他の設定は一切変更する必要はありません。詳細な設定については、Z.ai の開発者ドキュメント docs.z.ai を参照してください。

Q3:GLM-5.1 は Claude Opus 4.6 を完全に置き換えられますか?

コーディングタスクにおいて、GLM-5.1(45.3 点)は Opus(47.9 点)に非常に近づいており、日常的なコーディングシーンではほとんど違いを感じないレベルです。しかし、以下のシナリオでは Opus に依然として明確な優位性があります:100万トークンの超長文コンテキスト、極めて深い推論、複雑な多段階の Agent ワークフロー。私たちが推奨する戦略は「GLM 日常 + Claude 重砲」です。日常的なコーディングには GLM を使ってコストを削減し、複雑なタスクは APIYI apiyi.com を通じて必要に応じて Opus を呼び出します。

まとめ:GLM-5.1 がコーディング AI のコストパフォーマンスの構図を変える

GLM-5.1 の登場は、2026年のコーディング AI 分野における重要なマイルストーンです。オープンソース(近日オープンソース化予定)モデルとして初めて、コーディングベンチマークで Claude Opus 4.6 の 94.6% に到達し、価格は Opus の数分の一に過ぎません。

3つの核心ポイント:

- コーディング能力が天井に迫る:45.3 対 47.9、差はわずか 2.6 点。日常コーディングではほぼ体感できないレベルです。

- 価格優位性が圧倒的:Coding Plan $3-30/月 対 Claude Max $100-200/月

- API が近日リリース:APIYI は GLM-5.1 API に対応を最優先します。公開後は統一インターフェースから呼び出し可能になります。

Claude 公式の価格が高止まりし、時折計算リソースが不安定な現状において、GLM Coding Plan はすでに信頼性の高い、高コストパフォーマンスな代替案であることを証明しました。Coding Plan のサブスクリプション制を選ぶか、API の従量課金制を待つかに関わらず、GLM-5.1 はあなたのコーディング AI ツールボックスに加える価値のあるモデルです。

著者:APIYI Team | GLM-5.1 API リリース後、APIYI apiyi.com は最優先で対応します。無料テスト枠を取得して、Claude + GLM + GPT + Gemini のマルチモデル統一呼び出しを体験してください

📚 参考文献

-

Z.ai 公式アナウンス:GLM-5.1 コーディングプラン公開

- リンク:

z.ai/subscribe - 説明: GLM Coding Plan に登録して GLM-5.1 を利用する

- リンク:

-

Z.ai 公式ブログ:GLM-5 技術紹介

- リンク:

z.ai/blog/glm-5 - 説明: GLM-5 のアーキテクチャ、学習データ、ベンチマーク詳細

- リンク:

-

Z.ai 開発者ドキュメント:API 接続と料金

- リンク:

docs.z.ai/guides/overview/pricing - 説明: モデル料金、API 呼び出し仕様、ツール統合ガイド

- リンク:

-

Artificial Analysis:GLM-5 独立評価

- リンク:

artificialanalysis.ai/models/glm-5 - 説明: 第三者によるベンチマークテストデータとモデル比較

- リンク:

-

GLM-5 GitHub リポジトリ:オープンソースモデルウェイト

- リンク:

github.com/zai-org/GLM-5 - 説明: MIT ライセンスでオープンソース化、モデルウェイトと使用ガイドを含む

- リンク: