title: "SeeDance 2.0 API 公開テスト開始:ビデオ生成能力の飛躍的進化と活用ガイド"

description: "2026年4月14日、動画生成モデル「SeeDance 2.0」がBytePlus ModelArkで公開テストを開始。APIの仕様、活用法、そして開発者が知るべき重要ポイントを解説します。"

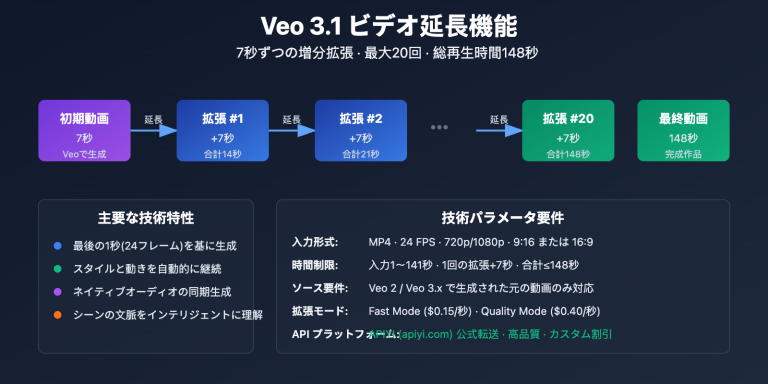

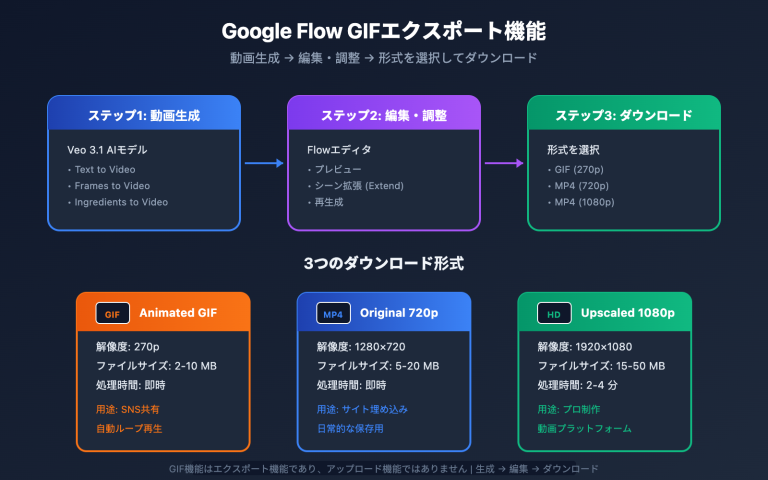

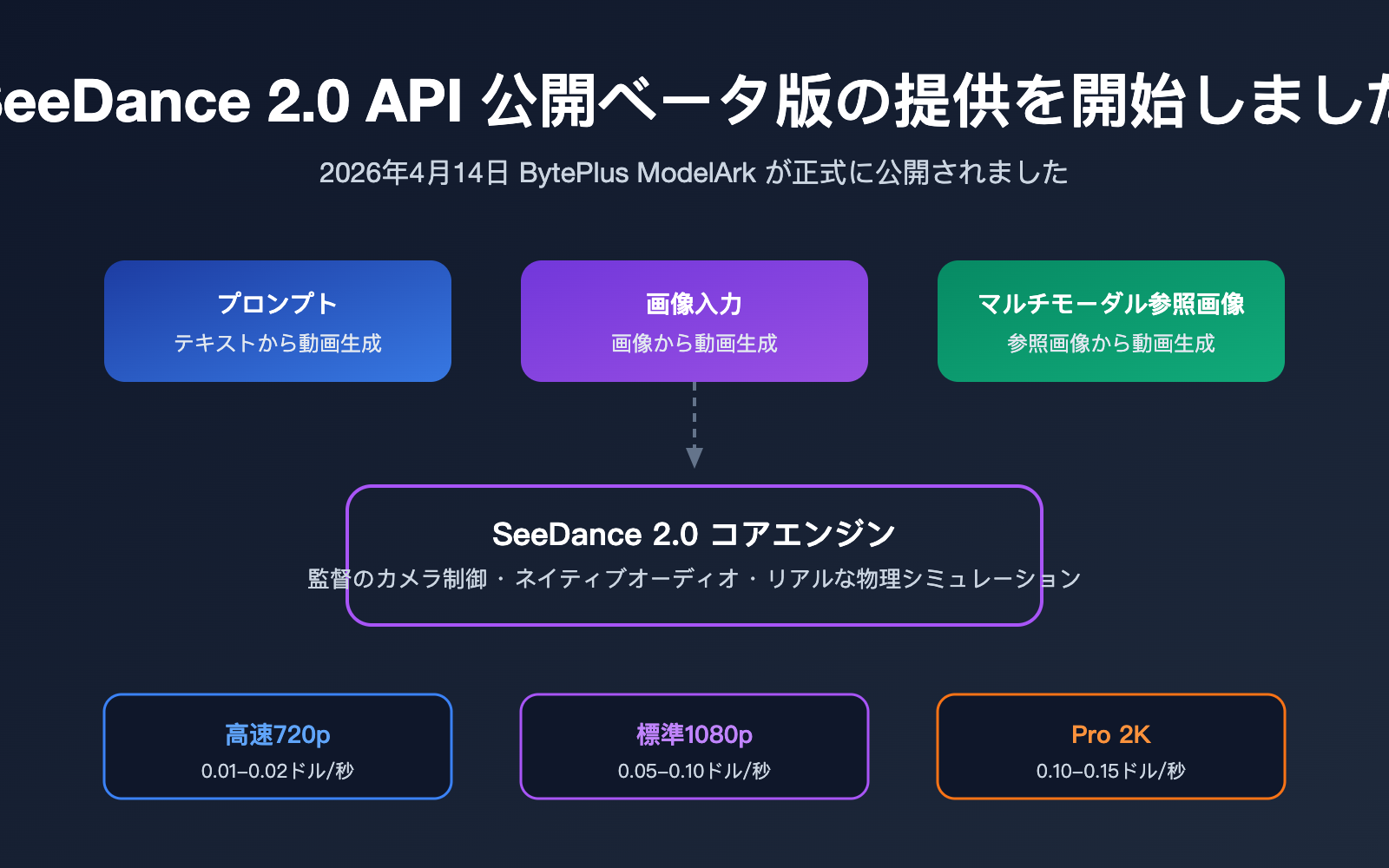

2026 年 4 月 14 日、ByteDance 傘下の動画生成モデル SeeDance 2.0 が BytePlus ModelArk プラットフォームにて正式に公開テストを開始しました。これにより、一般のエンジニアや開発者も標準的な API を介して、業界をリードするこの動画生成技術を自身のサービスに組み込むことが可能となりました。4 月 9 日のリリース当時は体験センターのみの公開でしたが、今回の公開テストでは、テキストから画像生成、画像から動画生成、参照画像を用いた動画生成といったマルチモーダルなインターフェースが解放され、Fast、Standard、Pro という 3 つのモデルバリエーションが提供され、品質とコストのニーズに応じた選択が可能になりました。

本記事では、BytePlus 公式ドキュメント (docs.byteplus.com/en/docs/ModelArk/2291680) の一次情報を基に、国際版での実測データを交えながら、SeeDance 2.0 API のモデル体系、パラメータ仕様、非同期呼び出しのフロー、そして実戦的な活用法を詳しく解説します。短編動画の制作ラインを素早く構築したい方も、Veo 3 や Kling 2 の代替案を探している方も、本記事が明確な判断材料となるはずです。

SeeDance 2.0 API 公開テスト:コア情報の概要

SeeDance 2.0 は、ByteDance が SeeDance 1.5 Pro に続いてリリースした第 2 世代の動画生成基盤モデルであり、「映画レベルの映像」「ネイティブオーディオ」「リアルな物理現象」「ディレクターレベルのカメラ制御」という 4 つの主要なアップグレードを特徴としています。4 月 14 日の公開テスト開始以降、公式 API と体験センターの機能は同期されており、開発者は ModelArk の標準的な推論インターフェースを通じて完全な呼び出し権限を得ることができます。

1.5 Pro と比較した主なアップグレード点

前世代モデルと比較して、SeeDance 2.0 API は以下の項目で大幅な改善が図られています。

| 能力次元 | SeeDance 1.5 Pro | SeeDance 2.0 | アップグレード幅 |

|---|---|---|---|

| 最大解像度 | 1080p | 2K (Pro版) | +1 ランク |

| 最大動画長 | 10秒 | 15秒 | +50% |

| ネイティブオーディオ | 非対応 | 対応(環境音+音声) | 新機能 |

| カメラ制御 | 基本プロンプトのみ | ディレクター級のパラメータ指定 | 飛躍的向上 |

| 参照入力 | 最大3画像 | 9画像+3動画+3音声 | 4倍に拡大 |

| 物理シミュレーション | 限定的 | リアルな物理エンジン搭載 | 飛躍的向上 |

🎯 導入のヒント:SeeDance 2.0 API は現在、BytePlus 国際版および一部の集約プラットフォームで同時にオンライン化されています。APIYI (apiyi.com) プラットフォームを利用して SeeDance 2.0 や他の主要な動画生成モデルを統合呼び出しすることをお勧めします。このプラットフォームは既にインターフェースがカプセル化されており、国内からのアクセスもサポートしているため、海外への直接接続に伴うネットワークの不安定さを回避できます。

公開テストの利用条件と枠組み

BytePlus の公開テスト期間中は一般の開発者にも開放されていますが、一定のレート制限が設けられています。

- 利用方法:ModelArk コンソールにて実名認証を完了すれば申請可能(ホワイトリスト不要)

- 無料枠:公開テスト期間中は、1 アカウントあたり月 20 回の Fast 版呼び出しが可能

- レート制限:1 アカウントにつき QPS=2(上限を超えると HTTP 429 エラーが返されます)

- 同時処理タスク:同時に最大 3 つのタスクが処理可能

SeeDance 2.0 API モデルマトリックスとエンドポイントの説明

BytePlus が提供する SeeDance 2.0 API は、3段階の品質バリエーションと3種類の入力モダリティの組み合わせで構成されており、開発者はシナリオに応じて柔軟に選択できます。

モデルバリエーションの比較

生成時間、画質、コストにおいて、各バリエーションには以下のような違いがあります。

| バリエーション | モデル ID | デフォルト解像度 | 標準生成時間 | 対象シナリオ |

|---|---|---|---|---|

| Fast | seedance-2.0-fast |

720p | 30-60 秒 | 高速プロトタイプ、SNS向けコンテンツ |

| Standard | seedance-2.0 |

1080p | 60-90 秒 | 商用ショート動画、広告 |

| Pro | seedance-2.0-pro |

2K | 90-150 秒 | 映像制作プリビズ、ハイエンド制作 |

3種類の入力エンドポイント

入力モダリティに応じて、SeeDance 2.0 API は3つの独立したエンドポイントを用意しています。

- テキストから画像生成 (Text-to-Video):プロンプトのみで生成可能。スクリプト主導のコンテンツ制作に最適です。

- 画像から画像生成 (Image-to-Video):1枚または複数枚の画像とオプションのプロンプトを入力し、動画を拡張します。

- 参照画像 (Reference-to-Video):画像、動画クリップ、音声を混合入力し、マルチモーダルな融合を行います。

💡 呼び出しのヒント:1回の呼び出しで画像、音声、動画など複数のモダリティを同時に使用する場合は、Reference-to-Video エンドポイントを使用してください。その際、

references配列内の各項目に役割(subject/environment/motion/audio)を指定します。APIYI(apiyi.com)の中継サービスを経由することで、統一された認証と請求管理が可能になり、チーム内のコスト計算が容易になります。

SeeDance 2.0 API リクエストパラメータの詳細

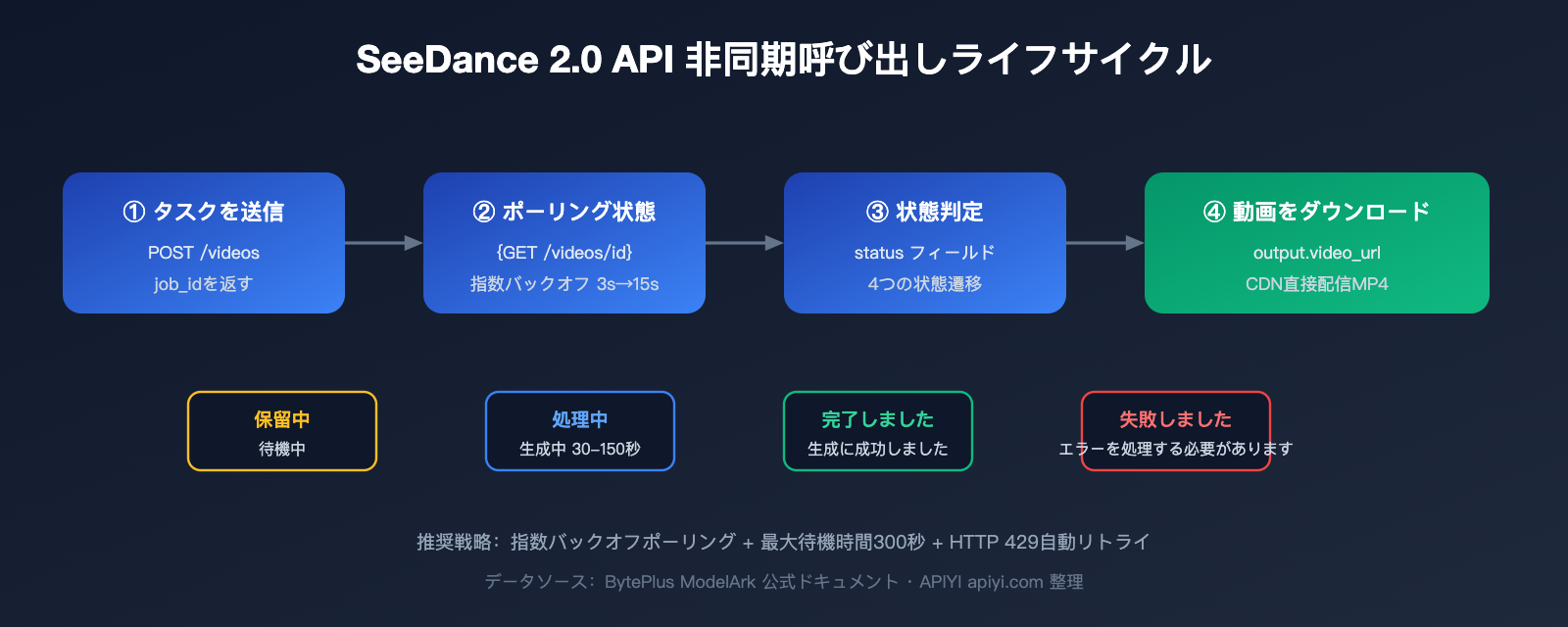

SeeDance 2.0 API は非同期タスクモードを採用しています。リクエスト送信後に job_id が返され、開発者はポーリング(定期的な状態確認)を行うことで最終的な動画 URL を取得します。

主要パラメータ表

テキストから画像生成エンドポイントの完全なパラメータ仕様は以下の通りです。

| パラメータ | 型 | 指定可能値 | 必須 | 説明 |

|---|---|---|---|---|

model |

String | seedance-2.0 / -fast / -pro |

はい | モデル ID |

prompt |

String | ≤ 2000 文字 | はい | 日本語・英語対応 |

resolution |

String | 480p / 720p / 1080p / 2k |

いいえ | デフォルトはモデルに依存 |

duration |

Integer | 4-15(秒) | いいえ | デフォルト 5 秒 |

aspect_ratio |

String | 21:9 / 16:9 / 4:3 / 1:1 / 3:4 / 9:16 | いいえ | デフォルト 16:9 |

audio |

Boolean | true / false | いいえ | 音声生成の有無 |

seed |

Integer | 任意の整数 | いいえ | 再現性確保のための固定シード値 |

negative_prompt |

String | ≤ 500 文字 | いいえ | 除外要素の記述 |

style |

String | cinematic / anime / realistic / 3d_render | いいえ | スタイルプリセット |

クイックスタート用サンプルコード

以下は、送信-ポーリング-ダウンロードという標準的な3ステップフローを示す、最小限のテキストから画像生成の呼び出し例です。

import requests

import time

BASE_URL = "https://api.apiyi.com/seedance/v1" # APIYI を経由したアクセス

API_KEY = "your_apiyi_key"

# ステップ 1:タスクの送信

submit_resp = requests.post(

f"{BASE_URL}/videos",

headers={"Authorization": f"Bearer {API_KEY}"},

json={

"model": "seedance-2.0",

"prompt": "桜が舞う中を散歩する茶トラ猫、映画のような浅い被写界深度、夕暮れの暖色トーン",

"resolution": "1080p",

"duration": 5,

"aspect_ratio": "16:9",

"audio": True,

"seed": 42

}

)

job_id = submit_resp.json()["job_id"]

# ステップ 2:状態のポーリング

while True:

status_resp = requests.get(

f"{BASE_URL}/videos/{job_id}",

headers={"Authorization": f"Bearer {API_KEY}"}

)

data = status_resp.json()

if data["status"] == "completed":

video_url = data["output"]["video_url"]

print(f"動画生成完了: {video_url}")

break

elif data["status"] == "failed":

raise Exception(f"生成失敗: {data.get('error')}")

time.sleep(5)

この例では APIYI(apiyi.com)を接続ポイントとして使用しており、海外プロキシの設定なしで直接アクセス可能です。BytePlus の公式エンドポイントを使用する場合は、BASE_URL を https://api.byteplus.com/seedance/v1 に置き換えてください(他のパラメータは完全に互換性があります)。

画像から画像生成および参照画像ビデオの高度なパラメータ

画像から画像生成エンドポイントでは、テキストから画像生成のパラメータに加え、image_url または image_base64 フィールドを追加します:

{

"model": "seedance-2.0",

"image_url": "https://example.com/start_frame.jpg",

"prompt": "カメラがゆっくりとズームインし、人物が振り返って微笑む",

"duration": 8,

"camera_motion": "dolly_in"

}

参照画像エンドポイントの references 配列には最大12項目(画像9枚+動画3本+音声3つ)を含めることができ、各項目で role と type の指定が必須です:

{

"references": [

{"type": "image", "role": "subject", "url": "https://..."},

{"type": "image", "role": "environment", "url": "https://..."},

{"type": "audio", "role": "audio", "url": "https://..."}

]

}

description: SeeDance 2.0 APIの料金戦略、コスト最適化手法、および動画生成における6つのコア能力を解説します。

SeeDance 2.0 API の価格戦略とコスト最適化

パブリックベータ期間中、SeeDance 2.0 API は動画の実際の長さに基づいて課金され、単位は秒となります。各プランの現在の公式参考価格は以下の通りです。

| プラン | 解像度 | 1秒あたりの価格 (USD) | 5秒動画のコスト | 10秒動画のコスト |

|---|---|---|---|---|

| Fast | 720p | $0.01 – $0.02 | $0.05 – $0.10 | $0.10 – $0.20 |

| Standard | 1080p | $0.05 – $0.10 | $0.25 – $0.50 | $0.50 – $1.00 |

| Pro | 2K | $0.10 – $0.15 | $0.50 – $0.75 | $1.00 – $1.50 |

⚡ コスト最適化のアドバイス: 大量生成を行う場合は、まず「Fast」プランでプロンプトのドラフトを試して方向性を決定してから、「Standard/Pro」プランで最終バージョンを生成することをお勧めします。これにより、コストを60%以上削減可能です。APIYI(apiyi.com)プラットフォーム経由で呼び出すと、日本円決済や請求書の統合が可能になり、経費精算やコスト配分が容易になります。

実際のコスト計算例

1日あたり8秒・1080pの動画を20本制作するショート動画アカウントの場合:

- 1本あたりのコスト: 8秒 × $0.075 ≈ $0.60

- 1日のコスト: 20本 × $0.60 = $12

- 1ヶ月のコスト: $12 × 30 ≈ $360

最初に「Fast」プランで3回ドラフトを作成してから「Standard」で本番生成する場合、月間コストを$180程度まで圧縮可能です。

SeeDance 2.0 API の6つのコア能力と実践

能力1:映画監督級のカメラコントロール

SeeDance 2.0 は10種類以上のカメラワークをネイティブサポートしています。camera_motion パラメータを使用するか、プロンプトで自然に記述することでトリガーできます。

dolly_in/dolly_out:ドリーイン / ドリーアウトpan_left/pan_right:パン左 / パン右tilt_up/tilt_down:チルトアップ / チルトダウンorbit_left/orbit_right:周回(左/右)crane_up/crane_down:クレーンアップ / クレーンダウンzoom_in/zoom_out:ズームイン / ズームアウト

能力2:ネイティブなオーディオ生成

リクエスト内で audio: true を設定すると、モデルは画面の内容に合わせて環境音、人声、BGMを生成します。「雨のカフェ」というシーンを生成する場合、追加の後処理なしで自動的に雨音や雰囲気のある音楽が重ねられます。

能力3:リアルな物理シミュレーション

SeeDance 2.0 の物理エンジンは、液体の飛散、布の揺れ、衝突後の反発など複雑なインタラクションを処理でき、「AI特有の不自然さ」を払拭し、映像の信頼性を大幅に向上させます。

能力4:マルチモーダル参照の融合

Reference-to-Video エンドポイントを使用すると、キャラクターの参照画像、シーンの参照画像、アクションの参照動画、環境音を同時に渡すことができます。モデルはこれらを解読し、適切に融合させます。これはIPビジネスや連続ドラマ制作に不可欠な機能です。

能力5:長時間の安定した生成

SeeDance 2.0 は1回の呼び出しで最大15秒の連続生成をサポートしており、Kling 2(デフォルト5秒)やVeo 3(8秒)と比較して、映像の一貫性やキャラクターの安定性において優れています。

能力6:2Kの高解像度出力

「Pro」プランでは2K解像度での出力が可能です。縦型ショート動画、横型広告、インフィード広告など、多様なサイズニーズをカバーします。

SeeDance 2.0 API エラーハンドリングとレート制限対策

API呼び出し中に発生する一般的なステータスコードと、それに対する対応策は以下の通りです。

| HTTPステータス | 意味 | 推奨される対応 |

|---|---|---|

| 200 | リクエスト成功 | レスポンスを正常に解析 |

| 400 | パラメータエラー | プロンプトの長さと解像度の妥当性を確認 |

| 401 | 認証失敗 | APIキーが有効か検証 |

| 429 | レート制限超過 | 指数バックオフによる再試行(推奨:初期2秒) |

| 500 | サーバー内部エラー | 2〜3回再試行後、Fastプランへダウングレード |

| 503 | サービス一時利用不可 | 代替エンドポイントへ切り替え、または30秒待機 |

非同期ポーリングのベストプラクティス

指数バックオフ + 最大タイムアウト戦略を推奨します:

def poll_with_backoff(job_id, max_wait=300):

start = time.time()

delay = 3

while time.time() - start < max_wait:

resp = get_job_status(job_id)

if resp["status"] in ("completed", "failed"):

return resp

# 遅延時間を計算し、待機します

time.sleep(delay)

delay = min(delay * 1.5, 15)

raise TimeoutError("タスクがタイムアウトしました")

よくある質問 (FAQ)

Q1:SeeDance 2.0 APIと4月9日の初回リリース版は何が違いますか?

4月9日にBytePlusエクスペリエンスセンターでリリースされたSeeDance 2.0は、Web版の試用のみを対象としており、外部向けのAPI呼び出しは公開されていませんでした。4月14日のパブリックベータ開始以降、一般の開発者はModelArkコンソールを通じてフルAPI権限を取得でき、Fast/Standard/Proの3段階および3種類の入力エンドポイントを利用可能です。設定不要で素早く導入したい場合は、海外アカウントの審査が不要なAPIYI (apiyi.com) プラットフォーム経由での直接呼び出しをお勧めします。

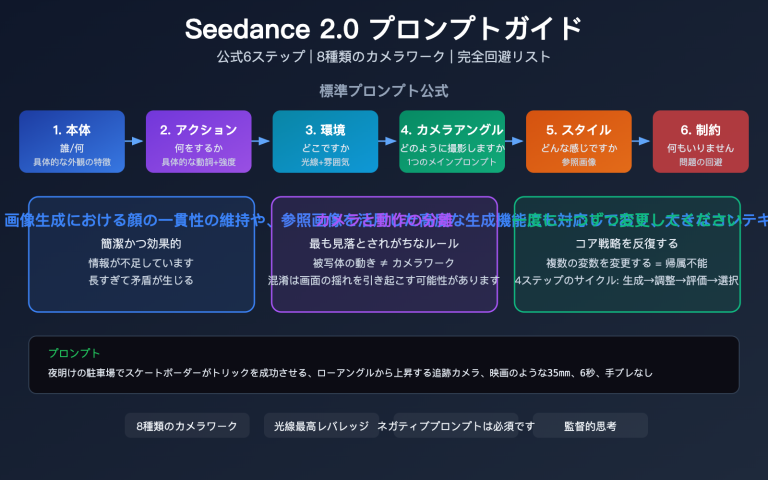

Q2:SeeDance 2.0 APIは日本語のプロンプトに対応していますか?

対応しています。SeeDance 2.0は多言語テキストエンコーダーを採用しており、日本語、英語、中国語のプロンプトを直接入力可能です。日本語のセマンティック(意味)理解精度は英語とほぼ同等です。**「動作 + シーン + スタイル + カメラワーク」**の4段階のプロンプト構造を推奨します。例:「桜の花びらが舞う京都の通りを散歩する茶トラ猫、浮世絵スタイル、広角での追跡ショット」。

Q3:パブリックベータ期間中の無料枠を使い切った後はどうすればいいですか?

公式パブリックベータでは、アカウントごとに毎月20回分のFastプラン呼び出しが無料で提供されます。上限を超えると標準料金が適用されます。より多くの利用枠や企業向けのSLAが必要な場合は、以下をご検討ください。

- BytePlusエンタープライズアカウントへのアップグレード(海外法人の資格が必要)

- APIYI (apiyi.com) プラットフォーム経由での一括API中継サービスの利用。従量課金と日本円決済に対応しており、海外送金の煩わしさがありません。

Q4:生成に失敗する一般的な原因は何ですか?

実測に基づく主な失敗原因は、プロンプトがコンテンツセキュリティポリシーに抵触(約40%)、参照画像の解像度が512px未満(約25%)、ネットワークタイムアウト(約20%)、同時実行数制限の超過(約15%)です。呼び出し前にローカルでプロンプトの匿名化、画像を1024px以上に前処理、429エラー時の再試行ロジックを実装することをお勧めします。

Q5:SeeDance 2.0とVeo 3、Kling 2はどれを選ぶべきですか?

シンプルな判断基準は以下の通りです:物理的なリアリティとネイティブオーディオを追求するならSeeDance 2.0、究極の画質と欧米的な美学を追求するならVeo 3、迅速なイテレーションと日本語シーンを重視するならKling 2。予算に余裕があれば、これら3つを併用して、シーンごとに最適なソリューションをA/Bテストすることをお勧めします。

まとめ

2026年4月14日、SeeDance 2.0 APIのパブリックベータ版が公開されました。これは、ByteDanceの動画生成モデルが正式に開発者向けの商用利用段階に突入したことを意味します。3つのバリエーション、3つのエンドポイント、マルチモーダル入力、ネイティブオーディオ、監督レベルのカメラワーク制御といった機能の組み合わせにより、物理的リアリティ、日本語(中国語)の理解度、コスト管理の面で際立った競争力を備えています。

SeeDance 2.0をいち早く導入したい国内の開発者には、APIYI(apiyi.com)プラットフォーム経由での呼び出しを推奨します。同プラットフォームでは、インターフェースのラップおよびネットワークの最適化が完了しており、Fast/Standard/Proの全プランに対応しています。また、日本円での決済や企業向け技術サポートも提供しており、動画生成機能を迅速に実装するための効率的なパスとなります。

📌 著者について:本記事はAPIYI(apiyi.com)技術チームが、BytePlus公式ドキュメントおよびグローバル版の実測データに基づき作成・公開したものです。すべての価格と仕様は2026年4月14日時点のパブリックベータ版公開アナウンスに準拠します。