title: "Guía de inicio rápido: API de SeeDance 2.0 y su despliegue en BytePlus"

description: "Descubre cómo integrar SeeDance 2.0, el modelo de generación de video de ByteDance, mediante la API de ModelArk. Guía técnica sobre parámetros y flujo de trabajo."

El 14 de abril de 2026, el modelo de generación de video SeeDance 2.0 de ByteDance se lanzó oficialmente en versión beta pública a través de la plataforma BytePlus ModelArk, permitiendo finalmente a los desarrolladores acceder a esta capacidad de vanguardia mediante una API estándar. A diferencia de su lanzamiento inicial el 9 de abril, limitado al centro de experiencias, esta versión beta pública admite interfaces multimodales para texto a video, imagen a video y video basado en imagen de referencia, ofreciendo tres variantes (Fast, Standard y Pro) para ajustarse a diferentes necesidades de calidad y costo.

Este artículo se basa en información de primera mano de la documentación oficial de BytePlus (docs.byteplus.com/en/docs/ModelArk/2291680) y datos de pruebas reales de la versión internacional. Explicamos de forma sistemática la matriz de modelos, las especificaciones de parámetros, el flujo de invocación asíncrona y la implementación práctica de la API de SeeDance 2.0. Tanto si buscas integrar rápidamente una línea de producción de videos cortos como si buscas una alternativa a Veo 3 o Kling 2, este artículo te proporcionará una base clara para la toma de decisiones.

Resumen de la versión beta pública de la API de SeeDance 2.0

SeeDance 2.0 es el modelo base de generación de video de segunda generación lanzado por ByteDance tras SeeDance 1.5 Pro. Se centra en cuatro mejoras principales: calidad de imagen cinematográfica, audio nativo, física realista y control de cámara a nivel de director. Tras el inicio de la versión beta pública el 14 de abril, la API oficial se ha alineado con las capacidades del centro de experiencias, permitiendo a los desarrolladores obtener permisos de invocación completos a través de la interfaz de inferencia estándar de ModelArk.

Mejoras clave respecto a 1.5 Pro

En comparación con la generación anterior, la API de SeeDance 2.0 presenta mejoras significativas en las siguientes dimensiones:

| Dimensión de capacidad | SeeDance 1.5 Pro | SeeDance 2.0 | Magnitud de mejora |

|---|---|---|---|

| Resolución máxima | 1080p | 2K (versión Pro) | +1 nivel |

| Duración máxima | 10 segundos | 15 segundos | +50% |

| Audio nativo | No compatible | Compatible (ambiente + voz) | Capacidad nueva |

| Control de cámara | Indicación básica | Parametrización de director | Mejora cualitativa |

| Entrada de referencia | Máx. 3 imágenes | 9 imágenes + 3 videos + 3 audios | Expansión 4x |

| Simulación física | Limitada | Motor de física del mundo real | Mejora cualitativa |

🎯 Sugerencia de integración: La API de SeeDance 2.0 está disponible actualmente en la versión internacional de BytePlus y en algunas plataformas agregadoras. Recomendamos utilizar la plataforma APIYI (apiyi.com) para invocar de forma unificada SeeDance 2.0 y otros modelos de video principales. Esta plataforma ya ha encapsulado las interfaces y admite el acceso desde China, evitando los problemas de inestabilidad de red de las conexiones directas al extranjero.

Condiciones de acceso y cuotas de la versión beta pública

Durante el periodo de prueba, BytePlus abre el acceso a desarrolladores comunes, aunque existen ciertas limitaciones de velocidad:

- Método de acceso: Se puede solicitar tras completar la verificación de identidad en la consola de ModelArk, sin necesidad de lista blanca.

- Cuota gratuita: 20 invocaciones de la variante Fast por cuenta al mes durante el periodo de prueba.

- Limitación de velocidad: QPS=2 por cuenta; el exceso devuelve un error HTTP 429.

- Tareas concurrentes: Máximo de 3 tareas en proceso al mismo tiempo.

Matriz de modelos y descripción de endpoints de la API de SeeDance 2.0

BytePlus ofrece una matriz de combinación con tres niveles de calidad y tres tipos de modalidades de entrada para la API de SeeDance 2.0, permitiendo a los desarrolladores elegir la opción que mejor se adapte a sus escenarios.

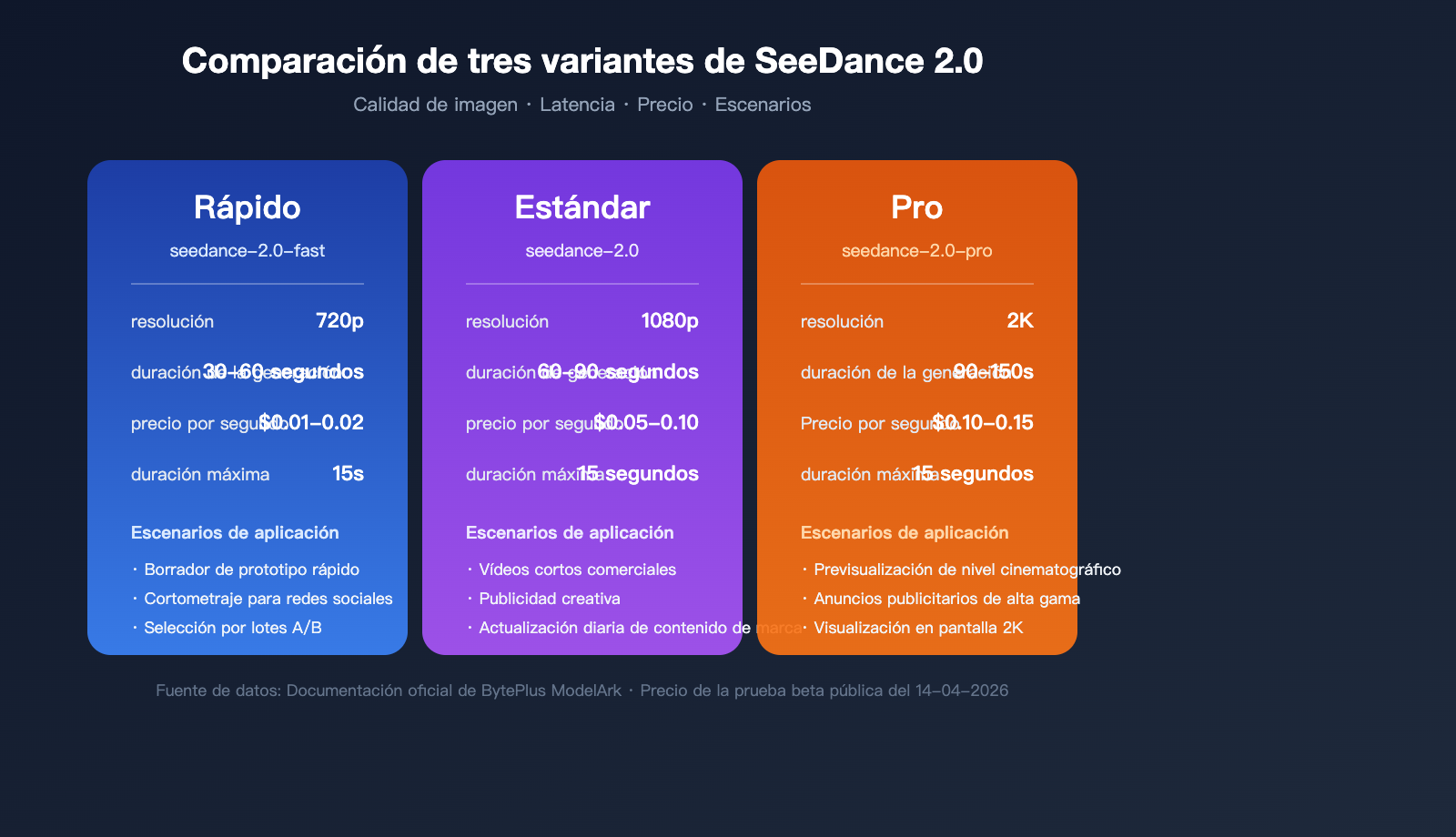

Comparativa de variantes de modelos

Las tres variantes presentan diferencias significativas en el tiempo de generación, calidad de imagen y costos:

| Variante | ID del modelo | Resolución por defecto | Tiempo de generación típico | Escenario objetivo |

|---|---|---|---|---|

| Fast | seedance-2.0-fast |

720p | 30-60 segundos | Prototipos rápidos, contenido social |

| Standard | seedance-2.0 |

1080p | 60-90 segundos | Vídeos comerciales cortos, publicidad |

| Pro | seedance-2.0-pro |

2K | 90-150 segundos | Previsualización cinematográfica, alta producción |

Tres tipos de endpoints de entrada

Dependiendo de la modalidad de entrada, la API de SeeDance 2.0 se divide en tres endpoints independientes:

- Texto a video (Text-to-Video): Solo requiere una indicación (prompt) para generar contenido, ideal para la creación basada en guiones.

- Imagen a video (Image-to-Video): Acepta una o varias imágenes + una indicación opcional para generar animaciones extendidas.

- Video de referencia (Reference-to-Video): Entrada mixta de imágenes, clips de video y audio para realizar una fusión multimodal.

💡 Consejo de invocación: Si necesitas enviar múltiples modalidades (imágenes, audio, video) en una sola llamada, utiliza el endpoint Reference-to-Video y especifica el rol (sujeto/entorno/movimiento/audio) para cada entrada en el array

references. Al realizar la invocación a través del servicio proxy de API de APIYI (apiyi.com), obtendrás una vista unificada de autenticación y facturación, lo que facilita la contabilidad de costos interna de tu equipo.

Detalles de los parámetros de solicitud de la API de SeeDance 2.0

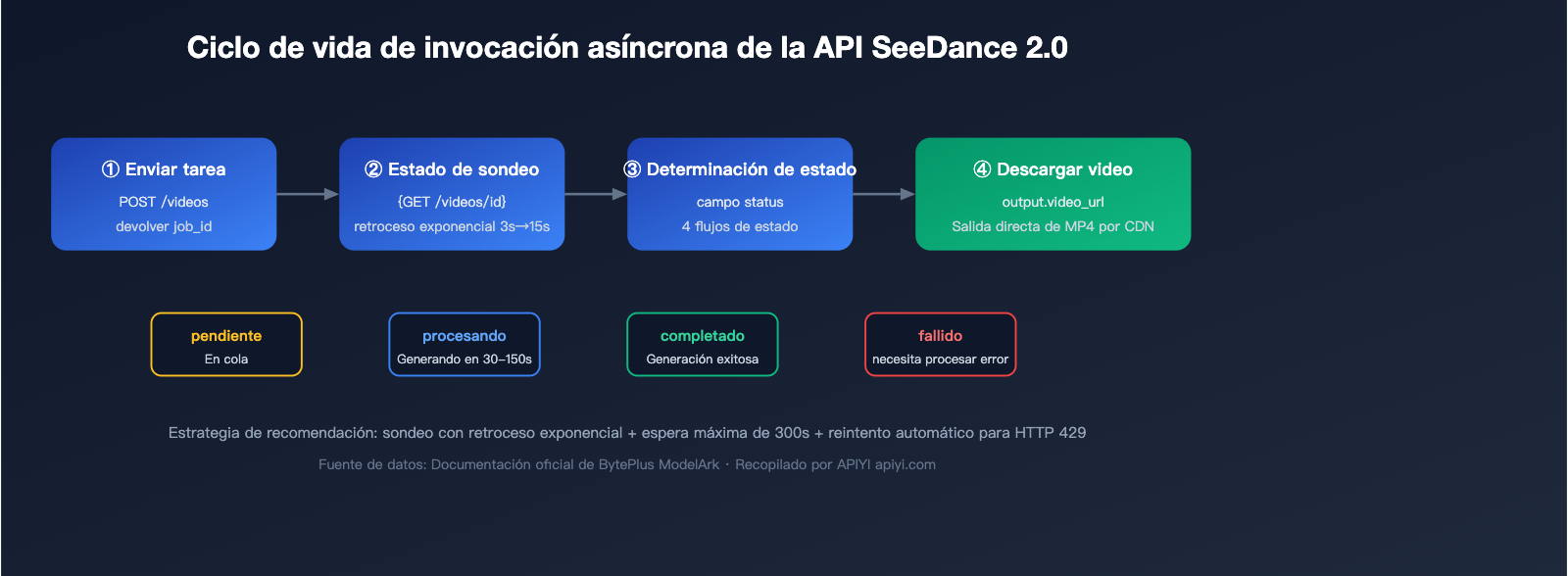

La API de SeeDance 2.0 utiliza un modelo de tareas asíncronas: tras enviar la solicitud, se devuelve un job_id y el desarrollador debe realizar sondeos (polling) para obtener la URL del video final.

Tabla de parámetros clave

La siguiente tabla detalla la especificación completa de los parámetros para el endpoint de texto a video:

| Parámetro | Tipo | Rango de valores | Obligatorio | Descripción |

|---|---|---|---|---|

model |

String | seedance-2.0 / -fast / -pro |

Sí | ID del modelo |

prompt |

String | ≤ 2000 caracteres | Sí | Admitido en chino e inglés |

resolution |

String | 480p / 720p / 1080p / 2k |

No | Por defecto según el nivel del modelo |

duration |

Integer | 4-15 (segundos) | No | Por defecto 5 segundos |

aspect_ratio |

String | 21:9 / 16:9 / 4:3 / 1:1 / 3:4 / 9:16 | No | Por defecto 16:9 |

audio |

Boolean | true / false | No | Generar audio nativo |

seed |

Integer | Cualquier entero | No | Semilla fija para reproducibilidad |

negative_prompt |

String | ≤ 500 caracteres | No | Elementos a excluir |

style |

String | cinematic / anime / realistic / 3d_render | No | Estilo preestablecido |

Ejemplo de código de inicio rápido

A continuación, se muestra un ejemplo mínimo de invocación de texto a video, que ilustra el flujo estándar de envío-sondeo-descarga:

import requests

import time

BASE_URL = "https://api.apiyi.com/seedance/v1" # Acceso a través del servicio proxy de APIYI

API_KEY = "your_apiyi_key"

# Paso 1: Enviar tarea

submit_resp = requests.post(

f"{BASE_URL}/videos",

headers={"Authorization": f"Bearer {API_KEY}"},

json={

"model": "seedance-2.0",

"prompt": "Un gato naranja caminando bajo una lluvia de cerezos, profundidad de campo cinematográfica, tono cálido al atardecer",

"resolution": "1080p",

"duration": 5,

"aspect_ratio": "16:9",

"audio": True,

"seed": 42

}

)

job_id = submit_resp.json()["job_id"]

# Paso 2: Sondeo de estado

while True:

status_resp = requests.get(

f"{BASE_URL}/videos/{job_id}",

headers={"Authorization": f"Bearer {API_KEY}"}

)

data = status_resp.json()

if data["status"] == "completed":

video_url = data["output"]["video_url"]

print(f"Generación de video completada: {video_url}")

break

elif data["status"] == "failed":

raise Exception(f"Error en la generación: {data.get('error')}")

time.sleep(5)

Este ejemplo utiliza APIYI (apiyi.com) como punto de acceso; los desarrolladores locales no necesitan configurar proxies externos para acceder. Si utilizas el endpoint oficial de BytePlus, simplemente reemplaza BASE_URL por https://api.byteplus.com/seedance/v1; los demás parámetros son totalmente compatibles.

Parámetros avanzados para imagen a video y video de referencia

El endpoint de imagen a video añade los campos image_url o image_base64 sobre la base del texto a video:

{

"model": "seedance-2.0",

"image_url": "https://example.com/start_frame.jpg",

"prompt": "Cámara avanzando lentamente, el personaje se gira y sonríe",

"duration": 8,

"camera_motion": "dolly_in"

}

El array references del endpoint de video de referencia puede contener hasta 12 elementos (9 imágenes + 3 videos + 3 audios), donde cada uno debe especificar su role y type:

{

"references": [

{"type": "image", "role": "subject", "url": "https://..."},

{"type": "image", "role": "environment", "url": "https://..."},

{"type": "audio", "role": "audio", "url": "https://..."}

]

}

Estrategia de precios y optimización de costes de la API de SeeDance 2.0

Durante el periodo de prueba beta, la API de SeeDance 2.0 se factura según la duración real del vídeo, medida en segundos. La siguiente tabla muestra los precios oficiales de referencia actuales para cada nivel:

| Nivel | Resolución | Precio por segundo (USD) | Coste vídeo 5s | Coste vídeo 10s |

|---|---|---|---|---|

| Fast | 720p | $0.01 – $0.02 | $0.05 – $0.10 | $0.10 – $0.20 |

| Standard | 1080p | $0.05 – $0.10 | $0.25 – $0.50 | $0.50 – $1.00 |

| Pro | 2K | $0.10 – $0.15 | $0.50 – $0.75 | $1.00 – $1.50 |

⚡ Consejos para la optimización de costes: En escenarios de procesamiento por lotes, se recomienda utilizar primero el nivel Fast para filtrar los borradores de la indicación y, una vez definido el resultado deseado, utilizar el nivel Standard/Pro para generar la versión final. Esto permite ahorrar más del 60% en costes. Al realizar la invocación del modelo a través de la plataforma APIYI (apiyi.com), podrá obtener liquidaciones en RMB y consolidación de facturas, lo que facilita la gestión financiera y el reparto de costes.

Ejemplo de cálculo de costes reales

Supongamos que una cuenta de vídeos cortos produce diariamente 20 piezas de 8 segundos a 1080p:

- Coste por pieza: 8 segundos × $0.075 ≈ $0.60

- Coste diario: 20 piezas × $0.60 = $12

- Coste mensual: $12 × 30 ≈ $360

Si utiliza el nivel Fast para ejecutar 3 rondas de borradores antes de finalizar con el nivel Standard, el coste mensual puede reducirse a unos $180.

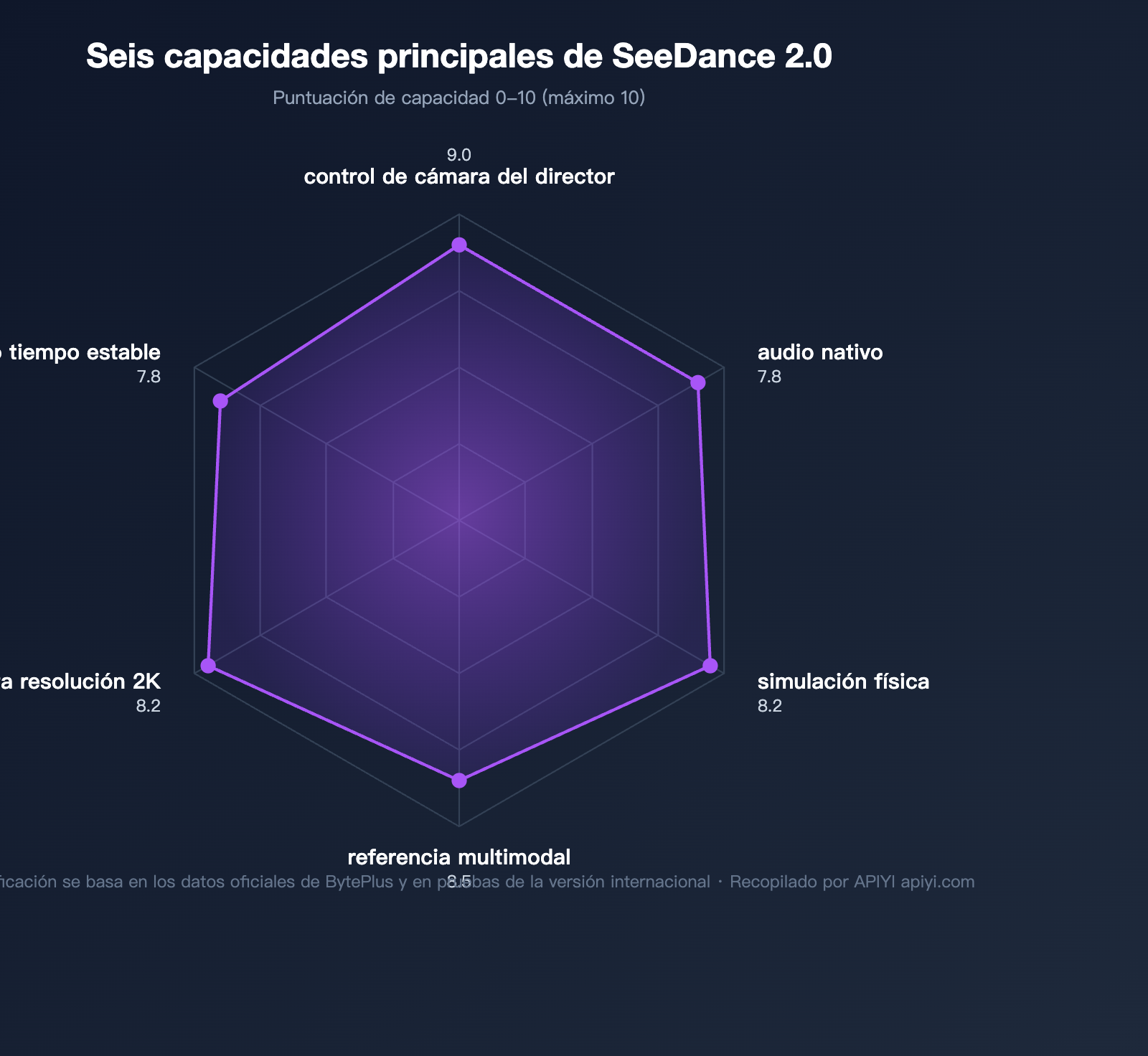

Seis capacidades principales de la API de SeeDance 2.0

Capacidad 1: Control de cámara de nivel cinematográfico

SeeDance 2.0 admite de forma nativa más de 10 tipos de comandos de movimiento de cámara, que pueden activarse mediante el parámetro camera_motion o describirse de forma natural en la indicación:

dolly_in/dolly_out: Acercamiento/alejamiento (dolly)pan_left/pan_right: Paneo horizontaltilt_up/tilt_down: Inclinación verticalorbit_left/orbit_right: Órbitacrane_up/crane_down: Movimiento de grúazoom_in/zoom_out: Zoom

Capacidad 2: Generación de audio nativa

Al configurar audio: true en la solicitud, el modelo generará sonidos ambientales, voces o música de fondo que coincidan con el contenido visual. Por ejemplo, al generar una escena de "cafetería bajo la lluvia", se superpondrán automáticamente sonidos de lluvia y música ambiental, sin necesidad de postproducción adicional.

Capacidad 3: Simulación física realista

El motor físico de SeeDance 2.0 puede manejar interacciones complejas como salpicaduras de líquidos, movimiento de telas y rebotes de colisiones, mejorando significativamente la credibilidad de las imágenes generadas por IA.

Capacidad 4: Fusión multimodal de referencias

El punto de conexión de referencia a vídeo permite a los desarrolladores introducir simultáneamente imágenes de personajes, referencias de escenas, vídeos de referencia de acciones y audio ambiental; el modelo desacoplará y fusionará automáticamente estos elementos. Esto es crucial para la creación de contenido de propiedad intelectual (IP) y series continuas.

Capacidad 5: Generación estable de larga duración

SeeDance 2.0 admite una generación continua de 15 segundos por solicitud, con una consistencia de imagen y estabilidad de personajes superiores a los 5 segundos predeterminados de Kling 2 o los 8 segundos de Veo 3.

Capacidad 6: Salida de alta resolución 2K

El nivel Pro admite de forma nativa una salida de resolución 2K, cubriendo diversas necesidades de formato, como vídeos cortos verticales, anuncios horizontales y distribución en flujos de información.

Manejo de errores y estrategias de limitación de tasa de la API de SeeDance 2.0

A continuación, se detallan los códigos de estado más comunes durante la invocación y las estrategias recomendadas para manejarlos:

| Código HTTP | Significado | Acción recomendada |

|---|---|---|

| 200 | Solicitud exitosa | Procesar la respuesta normalmente |

| 400 | Error de parámetros | Verificar la longitud de la indicación y la validez de la resolución |

| 401 | Fallo de autenticación | Validar que la clave API sea válida |

| 429 | Límite de tasa excedido | Reintento con retroceso exponencial (se sugiere 2s iniciales) |

| 500 | Error interno del servidor | Reintentar 2-3 veces y luego degradar al nivel Fast |

| 503 | Servicio temporalmente no disponible | Cambiar al punto de conexión de respaldo o esperar 30s |

Mejores prácticas para el sondeo asíncrono

Se recomienda utilizar una estrategia de retroceso exponencial + tiempo de espera máximo:

def poll_with_backoff(job_id, max_wait=300):

start = time.time()

delay = 3

while time.time() - start < max_wait:

resp = get_job_status(job_id)

# Comprobar si la tarea ha finalizado o fallado

if resp["status"] in ("completed", "failed"):

return resp

time.sleep(delay)

delay = min(delay * 1.5, 15)

raise TimeoutError("Tiempo de espera de la tarea agotado")

Preguntas frecuentes (FAQ)

P1: ¿Cuál es la diferencia entre la API de SeeDance 2.0 y la versión lanzada el 9 de abril?

Cuando SeeDance 2.0 se lanzó en el centro de experiencias de BytePlus el 9 de abril, solo admitía pruebas web y no permitía la invocación de la API. Tras la beta pública del 14 de abril, los desarrolladores pueden obtener permisos completos de API a través de la consola de ModelArk, cubriendo los niveles Fast/Standard/Pro y tres tipos de puntos de conexión de entrada. Si necesitas una integración rápida sin configuración, recomendamos realizar la invocación directamente a través de la plataforma APIYI (apiyi.com), sin necesidad de pasar por la revisión de cuentas extranjeras.

P2: ¿La API de SeeDance 2.0 admite indicaciones en chino?

Sí. SeeDance 2.0 utiliza un codificador de texto multilingüe, por lo que se pueden ingresar directamente indicaciones en chino, inglés y japonés. Las pruebas demuestran que la precisión de la comprensión semántica en chino es prácticamente idéntica a la del inglés. Se recomienda utilizar una estructura de indicación de cuatro partes: acción + escena + estilo + lente, por ejemplo: "un gato naranja paseando por las calles de Kioto con pétalos de cerezo cayendo, estilo ukiyo-e, toma gran angular".

P3: ¿Cómo seguir utilizando el servicio después de agotar la cuota gratuita del periodo de prueba?

La prueba pública oficial otorga 20 invocaciones de nivel Fast por cuenta al mes; una vez superado este límite, se aplicarán las tarifas estándar. Si necesitas una cuota mayor o un SLA de nivel empresarial, considera:

- Actualizar a una cuenta empresarial de BytePlus (requiere credenciales extranjeras).

- Comprar un servicio proxy de API unificado a través de la plataforma APIYI (apiyi.com), que admite pago por uso y liquidación en RMB, evitando complicaciones con facturas internacionales.

P4: ¿Cuáles son las causas comunes de fallo en la generación?

Las pruebas muestran que las causas más frecuentes son: violación de la política de seguridad de contenido en la indicación (aprox. 40%), resolución de la imagen de referencia inferior a 512px (aprox. 25%), tiempo de espera de red agotado (aprox. 20%) y exceso de concurrencia (aprox. 15%). Se recomienda realizar validaciones locales antes de la invocación: anonimización de la indicación + preprocesamiento de imagen a 1024px+ + implementación de reintentos para errores 429.

P5: ¿Cómo elegir entre SeeDance 2.0, Veo 3 y Kling 2?

Principio de decisión simple: si buscas realismo físico + audio nativo, elige SeeDance 2.0; si buscas una calidad de imagen extrema + estética occidental, elige Veo 3; si buscas iteración rápida + escenas en chino, elige Kling 2. Si el presupuesto lo permite, se recomienda utilizar los tres para realizar pruebas A/B y encontrar la solución óptima para cada escenario.

Resumen

El 14 de abril de 2026, la API de SeeDance 2.0 abrió su fase de prueba pública, lo que marca el inicio de la etapa comercial para desarrolladores del modelo de generación de vídeo de ByteDance. Con una combinación de capacidades que incluyen tres variantes de modelos, tres tipos de puntos finales, entrada multimodal, audio nativo y control de cámara cinematográfica, este modelo destaca por su realismo físico, comprensión del idioma chino y eficiencia en costes.

Para los desarrolladores interesados en integrar SeeDance 2.0 cuanto antes, recomendamos el uso de la plataforma APIYI (apiyi.com). Esta plataforma ya ha completado el encapsulamiento de la interfaz y la optimización de red, ofrece soporte para los niveles Fast/Standard/Pro, permite pagos en RMB y proporciona asistencia técnica a nivel empresarial, lo que la convierte en la ruta más eficiente para implementar capacidades de generación de vídeo rápidamente.

📌 Autoría: Este artículo ha sido preparado y publicado por el equipo técnico de APIYI (apiyi.com). Se basa en la documentación oficial de BytePlus y en datos de pruebas reales de la versión internacional. Todos los precios y parámetros están sujetos al anuncio oficial de la prueba pública del 14 de abril de 2026.