title: "Guia Completo: API do SeeDance 2.0 liberada para testes públicos no BytePlus"

description: "Aprenda a integrar o novo modelo de geração de vídeo SeeDance 2.0. Explore recursos, diferenças de versão e como configurar sua chamada de API com sucesso."

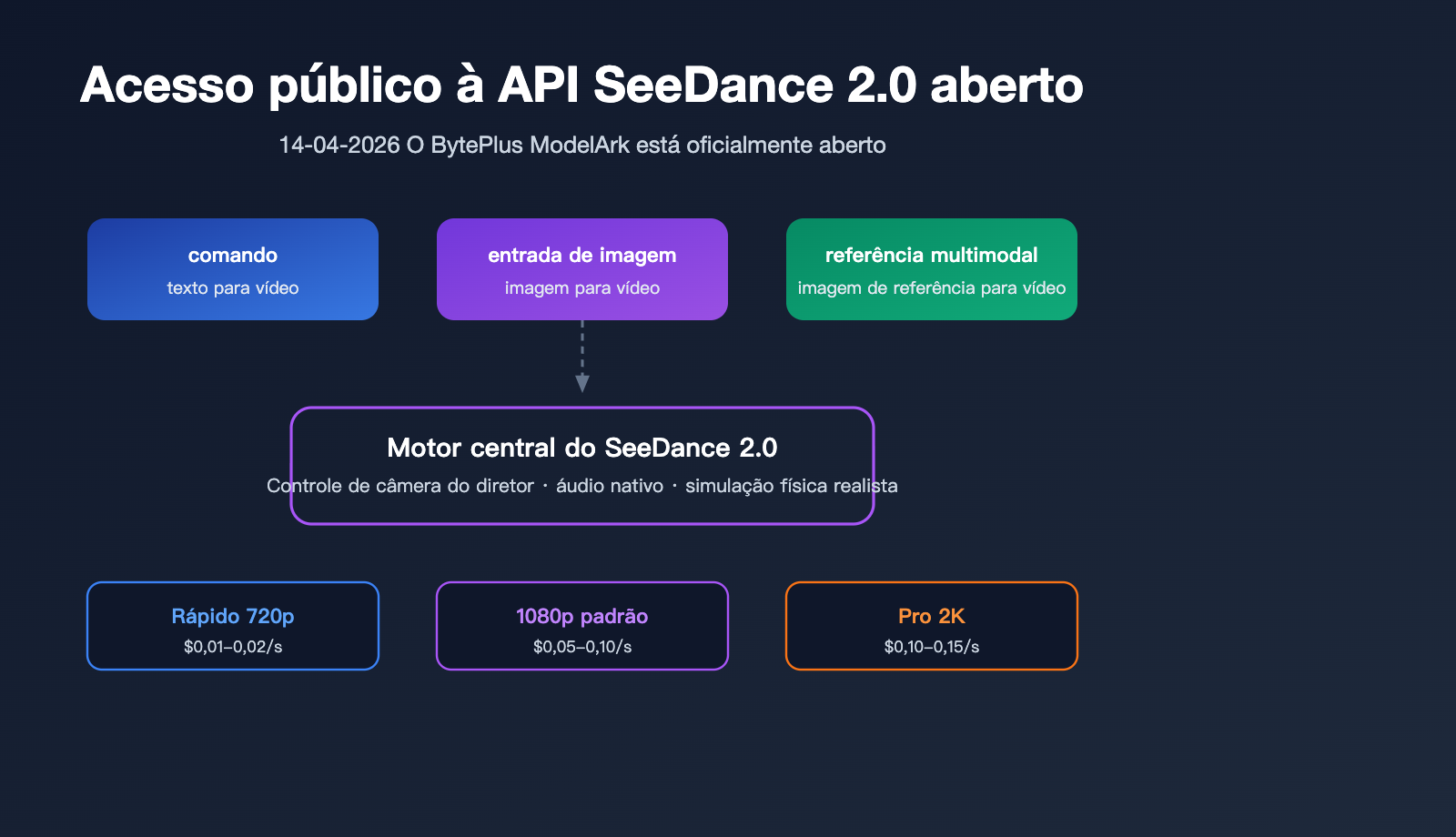

Em 14 de abril de 2026, o modelo de geração de vídeo SeeDance 2.0, desenvolvido pela ByteDance, foi oficialmente aberto para testes públicos na plataforma BytePlus ModelArk, permitindo finalmente que desenvolvedores comuns utilizem essa capacidade de ponta através de APIs padrão. Em comparação com o lançamento inicial em 9 de abril, que estava restrito ao centro de experiência, este teste público suporta interfaces multimodais para texto para vídeo, imagem para vídeo e vídeo com imagem de referência, oferecendo as variantes Fast, Standard e Pro para atender a diferentes necessidades de qualidade e custo.

Este artigo baseia-se em informações de primeira mão da documentação oficial da BytePlus (docs.byteplus.com/en/docs/ModelArk/2291680) e em dados de testes práticos da versão internacional, explicando de forma sistemática a matriz de modelos, especificações de parâmetros, fluxo de chamada assíncrona e implementação prática da API do SeeDance 2.0. Seja você alguém buscando integrar rapidamente uma linha de produção de vídeos curtos ou procurando uma alternativa ao Veo 3 ou Kling 2, este artigo fornecerá uma base clara para sua tomada de decisão.

Visão rápida das informações centrais do teste público da API SeeDance 2.0

O SeeDance 2.0 é o modelo de base para geração de vídeo de segunda geração lançado pela ByteDance após o SeeDance 1.5 Pro, com foco em quatro grandes atualizações: visuais com qualidade de cinema, áudio nativo, física realista e controle de câmera de nível profissional. Após o início do teste público em 14 de abril, a API oficial e os recursos do centro de experiência foram alinhados, e os desenvolvedores podem obter privilégios completos de invocação do modelo por meio da interface de inferência padrão do ModelArk.

Principais pontos de atualização em relação ao 1.5 Pro

Em comparação com a geração anterior, a API do SeeDance 2.0 apresenta melhorias significativas nas seguintes dimensões:

| Dimensão da Capacidade | SeeDance 1.5 Pro | SeeDance 2.0 | Escala de atualização |

|---|---|---|---|

| Resolução máxima | 1080p | 2K (nível Pro) | +1 nível |

| Duração máxima | 10 segundos | 15 segundos | +50% |

| Áudio nativo | Não suportado | Suportado (ambiente+voz) | Nova capacidade |

| Controle de câmera | Comando básico | Parametrizado (diretor) | Salto qualitativo |

| Entrada de referência | Até 3 fotos | 9 fotos + 3 vídeos + 3 áudios | Expansão 4x |

| Simulação física | Limitada | Motor de física real | Salto qualitativo |

🎯 Dica de integração: A API do SeeDance 2.0 está atualmente disponível na versão internacional do BytePlus e em algumas plataformas agregadoras. Recomendamos utilizar a plataforma APIYI (apiyi.com) para invocar unificadamente o SeeDance 2.0 e outros modelos de vídeo populares. A plataforma já concluiu o encapsulamento da interface e oferece suporte ao acesso doméstico, o que evita problemas de instabilidade de rede causados por conexões diretas ao exterior.

Condições de acesso e vagas para o teste público

Durante o período de teste público da BytePlus, o serviço está aberto a desenvolvedores comuns, mas existe um limite de taxa:

- Como acessar: Após concluir a autenticação de identidade no console ModelArk, você pode se inscrever; não é necessária uma lista de permissões (whitelist).

- Cota gratuita: 20 invocações por mês no nível Fast durante o período de teste.

- Limitação de taxa: QPS=2 por conta; o excesso resulta em HTTP 429.

- Tarefas simultâneas: Até 3 tarefas em processamento ao mesmo tempo.

Matriz de Modelos e Descrição de Endpoints da API SeeDance 2.0

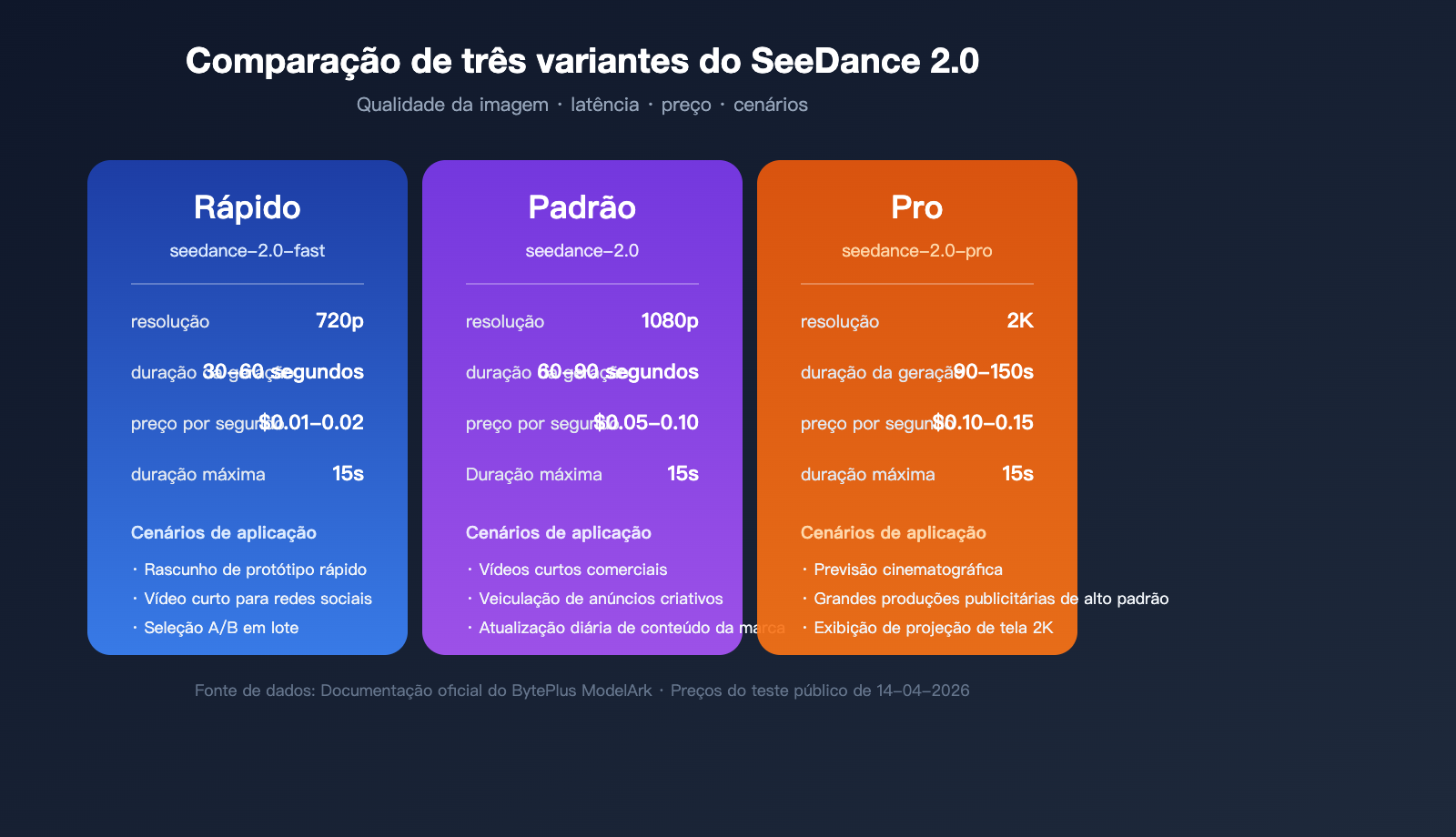

A BytePlus oferece uma matriz de combinações para a API SeeDance 2.0 com três níveis de qualidade e três tipos de modalidades de entrada, permitindo que desenvolvedores escolham a solução ideal para cada cenário.

Comparação de Variantes de Modelos

As três variantes apresentam diferenças significativas em tempo de geração, qualidade visual e custo:

| Variante | ID do Modelo | Resolução Padrão | Tempo Típico de Geração | Cenário Alvo |

|---|---|---|---|---|

| Fast | seedance-2.0-fast |

720p | 30-60 s | Protótipos rápidos, conteúdo para redes sociais |

| Standard | seedance-2.0 |

1080p | 60-90 s | Vídeos curtos comerciais, publicidade |

| Pro | seedance-2.0-pro |

2K | 90-150 s | Pré-visualização cinematográfica, produções high-end |

Três Tipos de Endpoints de Entrada

De acordo com a modalidade de entrada, a API SeeDance 2.0 é dividida em três endpoints independentes:

- Texto para vídeo (Text-to-Video): requer apenas um comando para gerar, ideal para criação de conteúdo baseada em roteiros.

- Imagem para vídeo (Image-to-Video): insere uma ou mais imagens + comando opcional para gerar animações estendidas.

- Vídeo de referência (Reference-to-Video): entrada mista de imagens, clipes de vídeo e áudio para fusão multimodal.

💡 Dica de invocação: Se precisar enviar múltiplas modalidades (como imagens, áudio e vídeo) em uma única chamada, utilize o endpoint Reference-to-Video e especifique a função (sujeito/ambiente/movimento/áudio) para cada item na matriz

references. Ao usar o serviço proxy de API da APIYI (apiyi.com), você obtém uma visualização unificada de autenticação e cobrança, facilitando a contabilidade de custos da sua equipe.

Detalhes dos Parâmetros de Requisição da API SeeDance 2.0

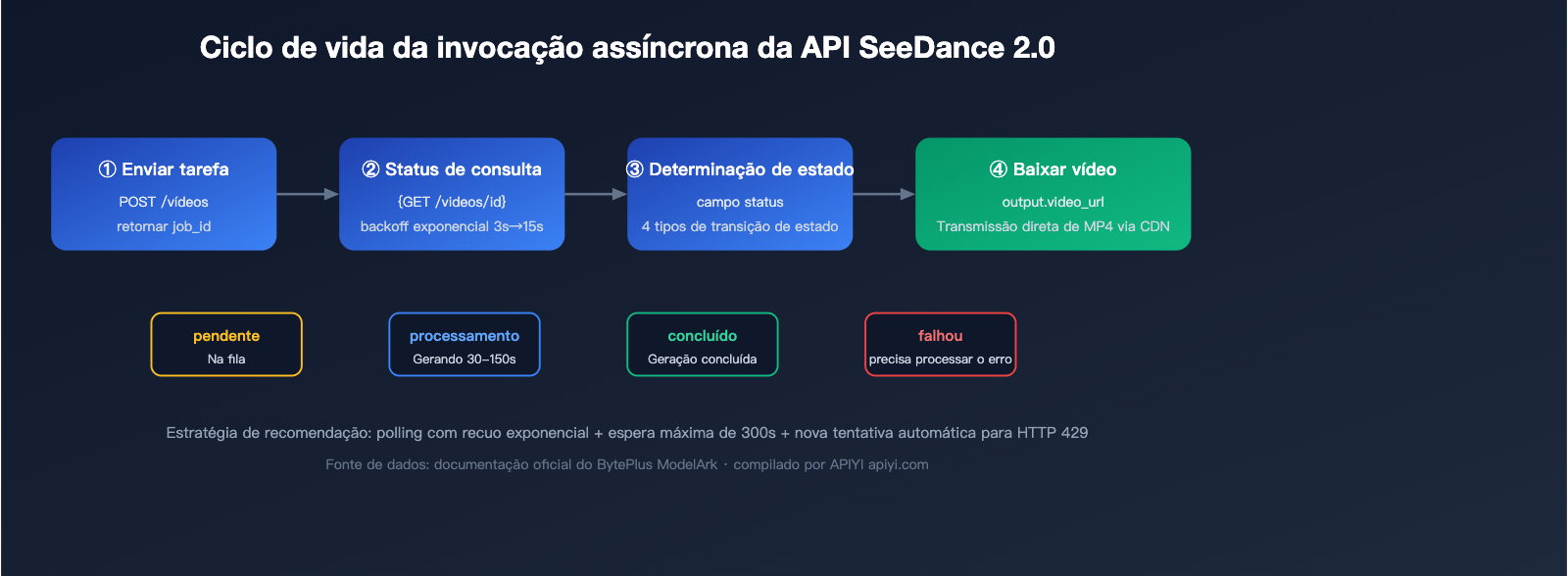

A API SeeDance 2.0 utiliza um modelo de tarefa assíncrona: após enviar a solicitação, você recebe um job_id e utiliza polling para obter a URL final do vídeo.

Tabela de Parâmetros Principais

A tabela abaixo lista a especificação completa de parâmetros para o endpoint de texto para vídeo:

| Parâmetro | Tipo | Intervalo de Valores | Obrigatório | Descrição |

|---|---|---|---|---|

model |

String | seedance-2.0 / -fast / -pro |

Sim | ID do modelo |

prompt |

String | ≤ 2000 caracteres | Sim | Aceita chinês e inglês |

resolution |

String | 480p / 720p / 1080p / 2k |

Não | Segue o padrão do modelo |

duration |

Integer | 4-15 (segundos) | Não | Padrão: 5 segundos |

aspect_ratio |

String | 21:9 / 16:9 / 4:3 / 1:1 / 3:4 / 9:16 | Não | Padrão: 16:9 |

audio |

Boolean | true / false | Não | Gerar áudio nativo |

seed |

Integer | Qualquer inteiro | Não | Semente fixa para reprodutibilidade |

negative_prompt |

String | ≤ 500 caracteres | Não | Descrição de elementos a excluir |

style |

String | cinematic / anime / realistic / 3d_render | Não | Estilo predefinido |

Exemplo de Código para Início Rápido

Abaixo está um exemplo mínimo de invocação de texto para vídeo, mostrando o fluxo padrão de envio-polling-download:

import requests

import time

BASE_URL = "https://api.apiyi.com/seedance/v1" # Acesso via serviço proxy de API da APIYI

API_KEY = "sua_chave_api_apiyi"

# Passo 1: Enviar tarefa

submit_resp = requests.post(

f"{BASE_URL}/videos",

headers={"Authorization": f"Bearer {API_KEY}"},

json={

"model": "seedance-2.0",

"prompt": "Um gato laranja caminhando na chuva de pétalas de cerejeira, profundidade de campo cinematográfica, tons quentes de entardecer",

"resolution": "1080p",

"duration": 5,

"aspect_ratio": "16:9",

"audio": True,

"seed": 42

}

)

job_id = submit_resp.json()["job_id"]

# Passo 2: Polling de status

while True:

status_resp = requests.get(

f"{BASE_URL}/videos/{job_id}",

headers={"Authorization": f"Bearer {API_KEY}"}

)

data = status_resp.json()

if data["status"] == "completed":

video_url = data["output"]["video_url"]

print(f"Geração de vídeo concluída: {video_url}")

break

elif data["status"] == "failed":

raise Exception(f"Falha na geração: {data.get('error')}")

time.sleep(5)

Este exemplo utiliza a APIYI (apiyi.com) como ponto de entrada; desenvolvedores locais podem acessar diretamente sem configurar proxies internacionais. Se preferir usar o endpoint oficial da BytePlus, basta substituir a BASE_URL por https://api.byteplus.com/seedance/v1; os outros parâmetros são totalmente compatíveis.

Parâmetros Avançados para Imagem para Vídeo e Vídeo de Referência

O endpoint de Imagem para vídeo adiciona os campos image_url ou image_base64 sobre a base do Texto para vídeo:

{

"model": "seedance-2.0",

"image_url": "https://example.com/start_frame.jpg",

"prompt": "Câmera avança lentamente, personagem vira e sorri",

"duration": 8,

"camera_motion": "dolly_in"

}

A matriz references do endpoint de Vídeo de referência contém no máximo 12 itens (9 imagens + 3 vídeos + 3 áudios), e cada item deve especificar role (função) e type (tipo):

{

"references": [

{"type": "image", "role": "subject", "url": "https://..."},

{"type": "image", "role": "environment", "url": "https://..."},

{"type": "audio", "role": "audio", "url": "https://..."}

]

}

Estratégia de Preço e Otimização de Custos da API SeeDance 2.0

Durante o período de testes públicos, a API SeeDance 2.0 é cobrada de acordo com a duração real do vídeo, medida em segundos. A tabela abaixo mostra os preços de referência oficiais para cada nível:

| Nível | Resolução | Preço por segundo (USD) | Custo vídeo 5s | Custo vídeo 10s |

|---|---|---|---|---|

| Fast | 720p | $0,01 – $0,02 | $0,05 – $0,10 | $0,10 – $0,20 |

| Standard | 1080p | $0,05 – $0,10 | $0,25 – $0,50 | $0,50 – $1,00 |

| Pro | 2K | $0,10 – $0,15 | $0,50 – $0,75 | $1,00 – $1,50 |

⚡ Dica de otimização de custos: Em cenários de produção em massa, recomendamos usar o nível Fast para filtrar os rascunhos dos comandos, definindo a direção desejada antes de gerar a versão final nos níveis Standard/Pro, o que pode economizar mais de 60% dos custos. Ao utilizar a plataforma APIYI (apiyi.com), você tem acesso a pagamentos em RMB e agregação de faturas, facilitando o reembolso financeiro e a divisão de custos.

Exemplo de cálculo de custo real

Suponha que uma conta de vídeos curtos produza diariamente 20 vídeos de 8 segundos em 1080p:

- Custo por vídeo: 8 segundos × $0,075 ≈ $0,60

- Custo diário: 20 vídeos × $0,60 = $12

- Custo mensal: $12 × 30 ≈ $360

Se você rodar 3 rodadas de rascunhos no nível Fast antes da versão final no nível Standard, o custo mensal pode ser reduzido para cerca de $180.

Seis Principais Capacidades da API SeeDance 2.0

Capacidade 1: Controle de câmera nível cinematográfico

O SeeDance 2.0 suporta nativamente mais de 10 tipos de comandos de movimento de câmera, que podem ser acionados pelo parâmetro camera_motion ou através de uma descrição natural no comando:

dolly_in/dolly_out: Aproximação / Afastamento (Dolly)pan_left/pan_right: Panorâmica horizontaltilt_up/tilt_down: Inclinação verticalorbit_left/orbit_right: Órbita (movimento circular)crane_up/crane_down: Movimento de grua (subida/descida)zoom_in/zoom_out: Zoom

Capacidade 2: Geração de áudio nativa

Ao configurar audio: true na solicitação, o modelo gerará sons ambientes, vozes ou trilhas sonoras compatíveis com o conteúdo da imagem. Por exemplo, gerar uma cena de "cafeteria na chuva" adicionará automaticamente o som da chuva e música ambiente, sem necessidade de pós-produção adicional.

Capacidade 3: Simulação física realista

O motor físico do SeeDance 2.0 pode processar interações complexas, como respingos de líquidos, ondulação de tecidos e colisões, elevando significativamente a credibilidade visual e removendo o aspecto artificial de "IA".

Capacidade 4: Fusão multimodal de referência

O endpoint "Reference-to-Video" permite que os desenvolvedores enviem simultaneamente imagens de personagens, referências de cena, vídeos de referência de movimento e áudio ambiente, e o modelo irá desagregar e fundir esses elementos automaticamente. Isso é crucial para a produção de conteúdo IP e séries contínuas.

Capacidade 5: Geração estável de longa duração

O SeeDance 2.0 suporta geração contínua de até 15 segundos por vez, com consistência de cena e estabilidade de personagem superiores aos 5 segundos padrão do Kling 2 ou 8 segundos do Veo 3.

Capacidade 6: Saída em alta resolução 2K

O nível Pro suporta nativamente saída em resolução 2K, atendendo a diversas necessidades, como vídeos curtos verticais, anúncios horizontais e veiculações em feeds de redes sociais.

Tratamento de erros e estratégias de limite de taxa da API SeeDance 2.0

Confira abaixo os códigos de status mais comuns e as estratégias recomendadas para lidar com eles durante a invocação do modelo:

| Status HTTP | Significado | Ação recomendada |

|---|---|---|

| 200 | Solicitação bem-sucedida | Processe a resposta normalmente |

| 400 | Erro de parâmetro | Verifique o comprimento do comando e a validade da resolução |

| 401 | Falha na autenticação | Verifique se sua chave API é válida |

| 429 | Limite de taxa excedido | Tente novamente com backoff exponencial (recomendado inicial de 2s) |

| 500 | Erro interno do servidor | Tente 2-3 vezes e, se persistir, alterne para o nível Fast |

| 503 | Serviço temporariamente indisponível | Mude para um endpoint de reserva ou aguarde 30s |

Melhores práticas para polling assíncrono

Recomendamos utilizar a estratégia de backoff exponencial + tempo limite máximo:

def poll_with_backoff(job_id, max_wait=300):

# Inicia o cronômetro para controlar o tempo limite

start = time.time()

delay = 3

while time.time() - start < max_wait:

resp = get_job_status(job_id)

if resp["status"] in ("completed", "failed"):

return resp

# Aumenta o tempo de espera gradualmente

time.sleep(delay)

delay = min(delay * 1.5, 15)

raise TimeoutError("O tempo limite da tarefa foi excedido")

Perguntas Frequentes (FAQ)

Q1: Qual a diferença entre a API SeeDance 2.0 e a versão lançada em 9 de abril?

Quando a SeeDance 2.0 foi lançada no centro de experiência BytePlus em 9 de abril, ela estava disponível apenas para testes via web e não permitia a invocação da API externamente. Após o beta público em 14 de abril, desenvolvedores passaram a ter acesso completo à API através do console ModelArk, abrangendo os níveis Fast/Standard/Pro. Para uma integração rápida e sem configuração, recomendamos o uso da plataforma APIYI (apiyi.com), eliminando a necessidade de validação de contas estrangeiras.

Q2: A API SeeDance 2.0 suporta comandos em chinês?

Sim. A SeeDance 2.0 utiliza um codificador de texto multimodal, permitindo a entrada direta de comandos em chinês, inglês e japonês. Testes mostram que a precisão na compreensão semântica do chinês é praticamente idêntica à do inglês. Recomendamos uma estrutura de comando composta por Ação + Cenário + Estilo + Câmera, por exemplo: "Um gato laranja passeando pelas ruas de Quioto com pétalas de cerejeira caindo, estilo ukiyo-e, filmagem com grande angular".

Q3: Como continuar usando após o esgotamento do crédito gratuito do período beta?

O período beta oficial oferece 20 invocações gratuitas no nível Fast por conta/mês; após isso, a cobrança é feita conforme o preço padrão. Se precisar de limites maiores ou SLA empresarial, considere:

- Atualizar para uma conta corporativa BytePlus (requer qualificação internacional).

- Comprar via plataforma APIYI (apiyi.com) para um serviço proxy de API unificado, com suporte a pagamento por uso e liquidação em RMB, evitando problemas com faturas internacionais.

Q4: Quais são as causas comuns de falha na geração?

Testes indicam que as causas mais comuns incluem: violação da política de segurança de conteúdo no comando (cerca de 40%), resolução da imagem de referência abaixo de 512px (cerca de 25%), timeout de rede (cerca de 20%) e limite de concorrência excedido (cerca de 15%). Recomendamos validações locais antes da chamada: higienização do comando + pré-processamento da imagem para 1024px+ + implementação de repetição para erros 429.

Q5: Como escolher entre SeeDance 2.0, Veo 3 e Kling 2?

Princípio de decisão simples: busque realismo físico + áudio nativo na SeeDance 2.0; busque qualidade visual extrema + estética ocidental no Veo 3; busque iteração rápida + cenários em chinês no Kling 2. Se o orçamento permitir, a recomendação é usar os três para testes A/B e encontrar a melhor solução para cada caso.

Resumo

Em 14 de abril de 2026, a API do SeeDance 2.0 entrou em fase de testes públicos, marcando a entrada oficial do modelo de geração de vídeo da ByteDance na fase de comercialização para desenvolvedores. Com uma combinação de três variantes, três tipos de endpoints, entrada multimodal, áudio nativo e controle de direção de câmera, o modelo apresenta uma competitividade notável em fidelidade física, compreensão do idioma chinês e controle de custos.

Para os desenvolvedores nacionais que desejam integrar o SeeDance 2.0 o quanto antes, recomendamos utilizar a plataforma APIYI (apiyi.com). A plataforma já concluiu o encapsulamento da interface e a otimização de rede, oferecendo suporte para chamadas em todos os níveis (Fast/Standard/Pro), além de disponibilizar pagamentos em RMB e suporte técnico de nível empresarial, tornando-se o caminho mais eficiente para implementar recursos de geração de vídeo rapidamente.

📌 Autoria: Este artigo foi organizado e publicado pela equipe técnica da APIYI (apiyi.com), com base na documentação oficial da BytePlus e em dados de testes práticos da versão internacional. Todos os preços e parâmetros estão sujeitos ao anúncio de teste público de 14/04/2026.