OpenAI の最も安価なモデルである gpt-5.4-nano は、$0.20/$1.25 という驚異的な低価格を実現しており、τ2-Bench では 92.5% というスコアを叩き出し、mini モデルに肉薄しています。本記事では、nano モデルに最適な 7 つのアプリケーションシナリオ、mini モデルへ切り替えるべきタイミング、そしてキャッシュ活用による 90% 割引の最適化手法を詳しく解説します。

1 日あたりのモデル呼び出し回数が 1 万回を超える場合や、カスタマーサポート、分類、RAG ルーティングといった高スループットなタスクに最適なモデルを探しているなら、OpenAI が gpt-5.4-nano の価格を「底値」まで引き下げたことに注目すべきです。入力コストは 5.4-mini と比較して 3.75 倍も安くなっています。

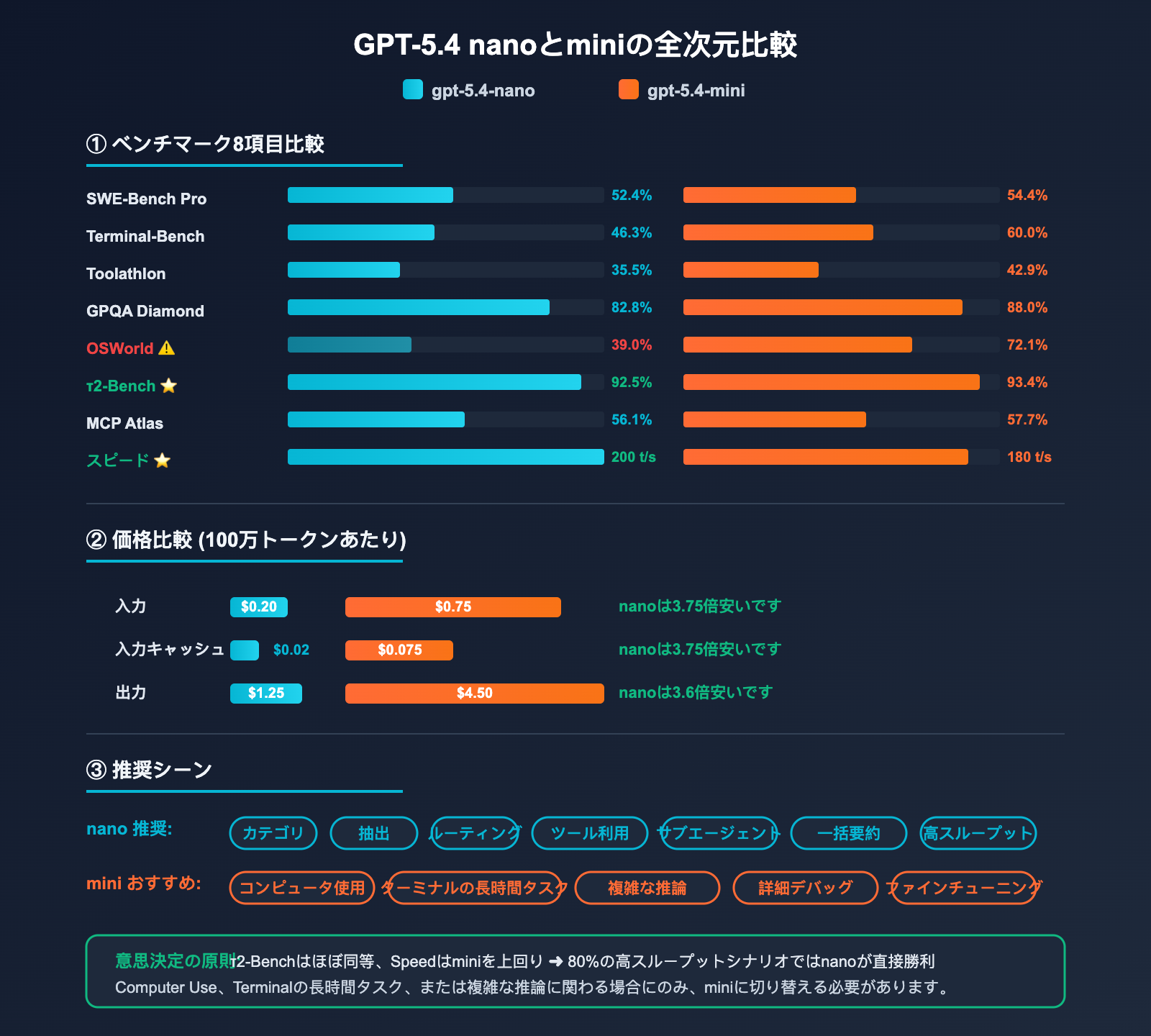

これは単なる「機能制限版の安価なモデル」ではありません。 OpenAI が公開したベンチマークによると、nano はツール呼び出し(τ2-Bench)で 92.5% を達成し、mini の 93.4% にほぼ並んでいます。また、一般的な知識を問う GPQA Diamond でも 82.8% を記録しており、mini との差はわずか 5.2 ポイントです。つまり、多くの「高スループットかつ低複雑度」なシナリオにおいて、nano こそが真の最適解なのです。

核心的価値: 本記事では、7 つの具体的なアプリケーションシナリオから、nano が「十分かつ安価」なタスクと、「mini が必須」なタスクを詳細に分類し、各シナリオのコードスニペットとコスト試算を提供します。

GPT-5.4 nano アプリケーションシナリオの要点

| 要点 | 説明 | 価値 |

|---|---|---|

| 極限の低価格 | $0.20 / $1.25 per 1M tokens | 5.4-mini より 3.75 倍安い |

| キャッシュ -90% | キャッシュ入力はわずか $0.02 / 1M | 高頻度コンテキストでほぼ無料 |

| ツール呼び出しが mini に肉薄 | τ2-Bench 92.5% vs mini 93.4% | 大半のツール呼び出しで十分 |

| 知識問答に強い | GPQA Diamond 82.8% | 一般的な FAQ や知識検索をこなす |

| 400K 長コンテキスト | 入力 400K + 出力 128K | 長文ドキュメントのバッチ処理に最適 |

| 速度がリード | ~200 t/s, mini より 10% 高速 | 高スループットパイプラインの第一候補 |

GPT-5.4 nano の「十分な閾値」をどう判断するか

nano が十分かどうかは、簡単な「3 分類法」で判断できます。

緑ゾーン(安心して nano を使用): ツール呼び出し、構造化データ抽出、分類・タグ付け、知識問答、コンテンツルーティング、バッチ翻訳・要約。これらのタスクでは nano と mini のスコア差が 10 ポイント未満であり、価格優位性が能力差を完全に上回ります。

黄ゾーン(慎重に評価): 複雑な多段階推論、長鎖エージェントのオーケストレーション、コード生成。SWE-Bench Pro で 52.4% の性能を維持していますが、採用前に nano で AB テストを行うことを推奨します。

赤ゾーン(直接 mini を使用): Computer Use(nano の OSWorld スコアは 39%)、ターミナルでの長タスク(46.3% と低め)、ファインチューニングが必要なカスタマイズシナリオ。これらのタスクでは nano の性能が明らかに不足するため、mini または標準モデルを選択してください。

GPT-5.4 nano ユースケース1:リアルタイム分類

シーンの概要

リアルタイム分類は、nano モデルの最も代表的な活用例です。感情分析、意図認識、トピックのタグ付け、コンテンツのモデレーションなどが含まれます。これらのタスクは、1回の呼び出しにつき入力が数百トークン、出力が数十トークン程度で済むことが多く、遅延とコストに対して極めて敏感な領域です。

シンプルなコード例

import openai

import json

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

def classify_intent(user_query: str) -> dict:

"""ユーザーのクエリ意図を分類する"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "あなたは意図分類器です。JSON形式で返してください: {intent, confidence, sub_category}"},

{"role": "user", "content": user_query}

],

response_format={"type": "json_object"}

)

return json.loads(response.choices[0].message.content)

# 使用例

result = classify_intent("先週の注文をキャンセルしたいです")

# {"intent": "refund_request", "confidence": 0.95, "sub_category": "subscription_cancel"}

コスト試算

| シーンの規模 | 1回あたりのコスト | 1日のコスト(10万回) |

|---|---|---|

| 入門レベルのカスタマーサポート(入力50 + 出力20) | $0.000035 | $3.5 |

| 中規模SaaS(入力200 + 出力30) | $0.000078 | $7.8 |

| エンタープライズ級(入力500 + 出力50) | $0.000163 | $16.3 |

💡 最適化のアドバイス: 分類ラベルや例をシステムプロンプトに含め、キャッシュを有効にすることで、入力コストをさらに90%削減できます。APIYI (apiyi.com) を経由して呼び出す場合、キャッシュ割引も完全に適用されます。

GPT-5.4 nano ユースケース2:データ抽出

シーンの概要

非構造化テキスト(履歴書、契約書、ニュース、メールなど)から構造化されたフィールドを抽出します。これは nano の得意分野であり、Structured Outputs(JSON Schemaによる厳格な制約)と組み合わせることで、99%以上のフォーマット正確性を実現できます。

実践コード

from pydantic import BaseModel

from typing import Optional

class ContactInfo(BaseModel):

name: str

email: Optional[str]

phone: Optional[str]

company: Optional[str]

role: Optional[str]

def extract_contact(text: str) -> ContactInfo:

# 連絡先情報を抽出する

response = client.beta.chat.completions.parse(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "連絡先情報を抽出してください。欠損しているフィールドは null を返してください"},

{"role": "user", "content": text}

],

response_format=ContactInfo

)

return response.choices[0].message.parsed

nano に適した抽出タスクリスト

- 履歴書/CVからのキーフィールド抽出

- 請求書/領収書の数値認識

- メール署名の解析

- ニュースのエンティティ認識(人名、地名、組織名)

- フォームデータの正規化

- ログイベントの分類

GPT-5.4 nano アプリケーションシナリオ 3: コンテンツのランキング

シナリオの説明

検索結果、推奨リスト、メッセージキューの再ランキング(リランク)を行います。nano の低コスト化により、LLM を活用したリランク処理が本番環境でも経済的に実行可能となりました。

再ランキングのコード例

def rerank_documents(query: str, candidates: list[str], top_k: int = 5) -> list:

"""クエリとの関連性に基づいて候補ドキュメントを再ランキングする"""

docs_text = "\n".join([f"[{i}] {doc[:300]}" for i, doc in enumerate(candidates)])

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[{

"role": "user",

"content": f"""クエリ "{query}" に基づいて、以下のドキュメントを関連性の高い順に並べ替えてください。

ドキュメント:

{docs_text}

JSON形式で返してください: {{"ranking": [ドキュメントのインデックスリスト、関連性が高い順]}}"""

}],

response_format={"type": "json_object"}

)

ranking = json.loads(response.choices[0].message.content)["ranking"]

return [candidates[i] for i in ranking[:top_k]]

🎯 シナリオのアドバイス: nano による再ランキングは、従来の BM25 + ベクトル検索によるリランカーよりも高い精度を誇り、コストは GPT-5.4-mini のわずか 27% です。APIYI (apiyi.com) を通じて直接接続可能で、Default グループであれば申請不要ですぐに利用できます。

GPT-5.4 nano アプリケーションシナリオ 4: サブエージェントの実行レイヤー

シナリオの説明

マルチエージェントアーキテクチャにおいて、メインエージェント(通常は mini や標準版を使用)が計画立案を担当し、サブエージェント(実行ワーカー)が具体的なツール呼び出し、データクエリ、ステータス更新を担当します。nano は τ2-Bench で 92.5% のスコアを記録しており、ワーカーとしての役割を十分に果たせます。

マルチエージェント連携の例

def execute_subtask(task: dict, available_tools: list) -> dict:

"""サブエージェントとして nano が単一のサブタスクを実行する"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": f"あなたは実行ワーカーです。利用可能なツール: {available_tools}"},

{"role": "user", "content": f"タスクを実行してください: {task['description']}"}

],

tools=task.get("tools", []),

tool_choice="auto"

)

return {

"task_id": task["id"],

"result": response.choices[0].message.content,

"tool_calls": response.choices[0].message.tool_calls

}

# メインエージェントに mini、サブエージェントに nano を使用することで、コストを 60% 以上削減可能

GPT-5.4 nano の活用シーン 5:RAG ルーティング層

シーンの概要

RAG システムにおいて、nano を「ルーティング層」として活用し、クエリの種類(技術的な質問 / プリセールス相談 / 製品フィードバック / 雑談)を判定して、適切なプロセッサに振り分けます。この設計により、コストの高い mini や標準モデルは、本当に必要な場合にのみ呼び出されるようになります。

RAG ルーティングの例

def route_query(query: str) -> str:

"""nano がクエリをどの RAG プロセッサにルーティングするかを判断"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": """クエリの種類に基づいてルーティングラベルを返してください:

- "technical_docs": 技術ドキュメントの照会

- "product_faq": 製品 FAQ

- "code_help": コードに関するヘルプ

- "small_talk": 雑談(RAG 不要)

- "complex_reasoning": 複雑な推論(mini/標準版へ転送)"""},

{"role": "user", "content": query}

],

max_tokens=20

)

return response.choices[0].message.content.strip()

route = route_query(user_input)

if route == "complex_reasoning":

final_model = "gpt-5.4-mini" # mini にアップグレード

else:

final_model = "gpt-5.4-nano" # nano を継続利用

💰 コスト最適化: この「nano によるルーティング + mini/標準版による処理」というアーキテクチャにより、総合的な呼び出しコストを通常 60〜80% 削減できます。APIYI (apiyi.com) を利用すれば、同一の API キーでモデルを柔軟に切り替えることができ、

modelパラメータを変更するだけで対応可能です。

GPT-5.4 nano の活用シーン 6:高スループットな要約と翻訳

シーンの概要

ニュースの要約、ドキュメントの翻訳、コメントのリライトなどのタスクを一括処理します。400K のコンテキストウィンドウを活かし、nano は長文全体を一度に処理できるだけでなく、1件あたりのコストもほぼ無視できるレベルに抑えられます。

Batch API の例

# バッチタスクの準備

batch_requests = []

for doc_id, content in documents.items():

batch_requests.append({

"custom_id": f"summary-{doc_id}",

"method": "POST",

"url": "/v1/chat/completions",

"body": {

"model": "gpt-5.4-nano",

"messages": [

{"role": "system", "content": "以下の内容を 100 字で要約してください"},

{"role": "user", "content": content}

],

"max_tokens": 200

}

})

# Batch API の送信(同価格ですが、オンラインクォータを消費しません)

batch = client.batches.create(

input_file_id=file_id,

endpoint="/v1/chat/completions",

completion_window="24h"

)

GPT-5.4 nano アプリケーションシナリオ 7: ツール呼び出し(Tool Use)

シナリオ概要

τ2-Bench において、nano は 92.5% というスコアを記録し、mini の 93.4% に肉薄する結果となりました。「天気の確認」「注文状況の照会」「ドキュメントの検索」といった標準的な関数呼び出し(Function Calling)のシナリオにおいて、nano は十分にその役割を果たせます。

Function Calling の例

tools = [{

"type": "function",

"function": {

"name": "get_order_status",

"description": "注文状況を照会する",

"parameters": {

"type": "object",

"properties": {

"order_id": {"type": "string"}

},

"required": ["order_id"]

}

}

}]

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[{"role": "user", "content": "私の注文 #12345 はどうなっていますか?"}],

tools=tools,

tool_choice="auto"

)

# nano は get_order_status を呼び出す必要があると正確に判断し、order_id="12345" を抽出します

GPT-5.4 nano 料金詳細

公式料金体系

| 課金タイプ | 料金 (100万トークンあたり) | 備考 |

|---|---|---|

| 入力 | $0.20 | 標準価格 |

| キャッシュ入力 | $0.02 | 90% オフ |

| 出力 | $1.25 | 推論トークンを含む |

| Batch API | $0.20 / $1.25 | 同価格、オンラインクォータを消費しない |

| リージョンデータ保存 | +10% | データコンプライアンス対応 |

nano と mini の料金比較

| 項目 | gpt-5.4-nano | gpt-5.4-mini | 倍率 |

|---|---|---|---|

| 入力 | $0.20 | $0.75 | nano が 3.75倍 お得 |

| キャッシュ入力 | $0.02 | $0.075 | nano が 3.75倍 お得 |

| 出力 | $1.25 | $4.50 | nano が 3.6倍 お得 |

| 応答速度 | ~200 t/s | ~180 t/s | nano が約 10% 高速 |

| コンテキスト | 400K | 400K | 同等 |

| 最大出力 | 128K | 128K | 同等 |

💰 コスト最適化: 1日あたり数百万回のリクエストが発生する高スループットな環境では、nano と mini の価格差は月間で数千ドルもの節約につながります。APIYI (apiyi.com) を経由して利用すれば、100ドルのチャージで10%ボーナスが付与されます。これは公式サイト比で実質15%オフとなり、総合的なコストを最大25%削減可能です。

GPT-5.4 nano vs mini ベンチマーク徹底比較

| 評価項目 | gpt-5.4-nano | gpt-5.4-mini | 差分 | nanoで十分か |

|---|---|---|---|---|

| SWE-Bench Pro | 52.4% | 54.4% | -2.0pp | ✅ ほぼ同等 |

| Terminal-Bench 2.0 | 46.3% | 60.0% | -13.7pp | ⚠️ 長いタスクはmini推奨 |

| Toolathlon | 35.5% | 42.9% | -7.4pp | ✅ 一般的な用途なら十分 |

| GPQA Diamond | 82.8% | 88.0% | -5.2pp | ✅ 知識クイズも対応可能 |

| OSWorld-Verified | 39.0% | 72.1% | -33.1pp | ❌ Computer Useはmini必須 |

| τ2-Bench(Tool Use) | 92.5% | 93.4% | -0.9pp | ✅ ほぼ同等 |

| MCP Atlas | 56.1% | 57.7% | -1.6pp | ✅ ほぼ同等 |

| 応答速度 | ~200 t/s | ~180 t/s | +10% | ✅ nanoの方が高速 |

選定のアドバイス

nanoを優先すべきケース:

- タスクが「グリーンゾーン」(分類、抽出、ソート、ルーティング、ツール使用、バッチ処理)に該当する場合

- API呼び出しが1日1万回を超え、コストに敏感な場合

- 1秒未満の低遅延レスポンスが必要な場合

- サブエージェントの実行層(メインエージェントはmini、ワーカーはnano)

miniへアップグレードすべきケース:

- Computer Use(OSWorldで決定的な差がある)を伴う場合

- ターミナルでの長時間のタスク(10ステップ以上の操作)

- 複雑な多段階推論や詳細なコードデバッグが必要な場合

- コストよりもタスクの品質が重要な場合

📊 推奨: 80%の「高スループット+低複雑度」のシナリオでは、nanoのコストパフォーマンスがminiを圧倒します。APIYI(apiyi.com)を通じて、実際のタスクで両モデルを直接比較してみてください。modelパラメータを変更するだけで簡単にテスト可能です。

GPT-5.4 nano の APIYI への接続ガイド

Default グループでそのまま利用可能

APIYI プラットフォームでは、GPT-5.4 nano と 5.4-mini に対して同一の開放ポリシーを採用しています。

- ✅ Default デフォルトグループ: 全開放、新規ユーザー登録後すぐに呼び出し可能

- ✅ SVIP 高度グループ: 全開放、制限なし

- ✅ キャッシュ割引同期: $0.02/1M のキャッシュ価格がそのまま適用されます

- ✅ Batch API 同期: バッチタスクも同価格で利用可能です

APIYI vs 公式サイトのコスト比較

| 項目 | OpenAI 公式サイト | APIYI (apiyi.com) |

|---|---|---|

| 基本価格 | $0.20 / $1.25 per 1M | $0.20 / $1.25 per 1M (同価格) |

| キャッシュ割引 | $0.02 / 1M (90%) | $0.02 / 1M (完全同期) |

| チャージ特典 | なし | $100 チャージで $10 プレゼント (10%) |

| 実質コスト | 100% 標準価格 | 約 90% 標準価格 (約 15% OFF) |

| 国内アクセス | VPNが必要 | 直結、VPN不要 |

| 決済方法 | 国際クレジットカード | 日本円、Alipay、WeChat Pay 対応 |

| SDK 互換性 | OpenAI ネイティブ | OpenAI SDK と完全互換 |

| 最低チャージ額 | $5 | $1 からチャージ可能 |

💰 コスト最適化: 月間呼び出し数が百万単位を超えるアプリケーションの場合、APIYI (apiyi.com) を通じて nano に接続することで、公式サイトの 15% OFF に加え、キャッシュ最適化を組み合わせ、直接公式サイトを呼び出すよりも総合コストを 25〜35% 削減できます。

よくある質問 (FAQ)

Q1: gpt-5.4-nano とは何ですか?gpt-5.4-mini との主な違いは?

GPT-5.4-nano は、OpenAI GPT-5.4 シリーズの中で最も安価で高速な軽量モデル ($0.20/$1.25 per 1M トークン) で、応答速度は約 200 t/s です。5.4-mini との主な違いは以下の通りです:1) 価格が 3.6〜3.75 倍安い、2) Computer Use (OSWorld 39% 対 72.1%) やターミナルでの長時間のタスク (46.3% 対 60%) において性能が顕著に低い、3) その他のシナリオ (分類、抽出、ツール使用、知識回答) では、性能差は通常 10pp 未満です。

Q2: nano はどのようなアプリケーションに最適ですか?mini を使うべきなのは?

nano に適した用途 (グリーンゾーン):

- リアルタイム分類 (感情、意図、トピック)

- 構造化データの抽出

- コンテンツの並べ替えと再配置

- サブエージェントの実行層

- RAG ルーティング層

- 高スループットな要約/翻訳

- 標準的なツール呼び出し (τ2-Bench 92.5%)

mini を使うべき用途 (レッドゾーン):

- Computer Use デスクトップ自動化 (OSWorld で 33pp の差)

- ターミナルでの長時間タスク (10 ステップ以上)

- 複雑な多段階推論

- ファインチューニングが必要なカスタマイズシナリオ

Q3: なぜ nano は Computer Use に推奨されないのですか?

OSWorld-Verified の評価において、nano は 39.0% と mini の 72.1% を大幅に下回っています。これは、nano が多段階のデスクトップ操作 (ブラウザを開く→検索→クリック→フォーム入力) において失敗率が高く、タスクを安定して完了できないことを意味します。Computer Use が必要な場合は、mini または 5.4 標準版を選択してください。

Q4: nano のキャッシュ割引 ($0.02/1M) はどうすれば有効になりますか?

OpenAI のキャッシュメカニズムは自動的にトリガーされるため、追加のパラメータは不要です。プロンプトのプレフィックス (通常はシステムプロンプト + 共有コンテキスト) が直近 5〜10 分以内のリクエストと一致する場合に自動的にヒットし、90% の割引が適用されます。

最適化のヒント:

- システムプロンプトを messages 配列の先頭に配置する

- 共有コンテキスト (分類ラベル、スキーマ定義) をその直後に配置する

- ユーザーの実際のクエリを最後に配置する

- 呼び出し頻度を維持する (5 分以上経過すると期限切れになります)

APIYI (apiyi.com) 経由で呼び出す場合、キャッシュ割引は公式サイトと完全に同期されます。

Q5: nano でバッチタスクを処理する際のベストプラクティスは?

3 つの重要な戦略:

- Batch API の使用:

/v1/batchesインターフェースを使用してバッチタスクを送信します。24 時間以内に完了し、価格は変わりませんが、オンラインの RPM クォータを消費しません - システムプロンプトの共有: すべてのタスクで同じ指示を使用し、キャッシュヒットを誘発します

- 適切な max_tokens の設定: nano の出力は安価ですが、積み重なるとコストになります。タスクに応じて 50〜500 の妥当な上限を設定してください

APIYI (apiyi.com) を通じてバッチタスクを送信すると、チャージ時の 10% 特典により、実質コストは公式サイトの約 85% になります。

Q6: APIYI を通じて GPT-5.4 nano を呼び出す方法は?

APIYI は OpenAI SDK と完全互換性があります。以下の 3 ステップで完了します:

- APIYI (apiyi.com) にアクセスしてアカウントを登録する (申請不要、Default グループで即利用可能)

- APIキーを取得する

- コード内の

base_urlをhttps://vip.apiyi.com/v1に設定し、modelをgpt-5.4-nanoに設定する

client = openai.OpenAI(

api_key="YOUR_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[...]

)

100 ドルのチャージで 10% 分がプレゼントされるため、実質的に公式サイトの約 15% OFF で利用でき、キャッシュ割引も同期されます。

Q7: どのような場合に nano が mini よりお得になりますか?計算方法は?

判断式:

nano がお得な条件 = (単一タスクの品質低下の許容度) × (呼び出し量) × (価格差)

> (mini にアップグレードすることで得られる品質向上の利益)

実際のシナリオ:

- 呼び出し量 > 10K/日: 1 日あたり $30 以上 ($1000/月) の節約

- 呼び出し量 > 100K/日: 1 日あたり $300 以上 ($9000/月) の節約

- 呼び出し量 > 1M/日: 1 日あたり $3000 以上 ($90000/月) の節約

グリーンゾーンのタスク (分類、抽出、ツール使用) において、nano の品質低下は通常 5% 未満ですが、コストは 73% 削減 (計算上の 3.6 倍の倍率) されます。総合的な ROI では、ほぼ常に nano が勝ります。

Q8: GPT-5.4 nano の既知の制限は何ですか?

主な制限:

- Computer Use 非対応: OSWorld 39% と低く、デスクトップ自動化を安定して完了できない

- ファインチューニング非対応: カスタムデータセットによる微調整不可

- 音声/動画入力非対応: テキストと画像入力のみ

- ターミナルでの長時間タスクに弱い: Terminal-Bench 46.3% で、10 ステップを超える操作で失敗しやすい

- 複雑な推論能力に限界: GPQA 82.8% は mini に近いが、FrontierMath などの極めて難しいタスクではパフォーマンスが著しく低下する

代替案: これらの制限に直面した場合は、gpt-5.4-mini または 5.4 標準版に切り替えてください。

GPT-5.4 nano アプリケーションシナリオの核心ポイント Key Takeaways

- 価格の底値: 100万トークンあたり $0.20/$1.25。5.4-mini と比較して 3.6〜3.75 倍の低価格を実現

- キャッシュ 90% 割引: 入力コストが最低 $0.02/100万トークンまで下がり、高頻度なコンテキスト利用シーンではほぼ無料

- 7 つの推奨シナリオ(グリーンゾーン): 分類、抽出、並べ替え、サブエージェント、ルーティング、バッチ処理、ツール利用

- τ2-Bench 92.5%: ツール呼び出し性能は mini に肉薄し、90% 以上の関数呼び出し(Function Calling)シナリオで十分な性能を発揮

- GPQA 82.8%: 汎用的な知識回答能力が高く、FAQ やコンテンツ審査に適している

- 速度 200 t/s: mini よりも 10% 高速で、高スループットなパイプラインに最適

- 警告(レッドゾーン): Computer Use やターミナルでの長時間タスクは、mini への切り替えが必須

まとめ

GPT-5.4 nano のアプリケーションシナリオにおける核心ポイントは以下の通りです:

- シナリオのポジショニング: nano は高スループットかつ低複雑度のタスクに最適です。リアルタイム分類、データ抽出、サブエージェントの作業、RAG ルーティング、バッチ処理が主な活躍の場となります。

- 能力の境界線: τ2-Bench / GPQA / SWE-Bench Pro では mini とほぼ同等の性能を発揮しますが、Computer Use やターミナルでの長時間タスクには明らかな弱点があります。

- 接続方法: APIYI (apiyi.com) の Default グループから直接呼び出し可能です。キャッシュ割引も同期されており、100ドルのチャージで10ドル分がプレゼントされます。

GPT-5.4 nano は「何でもできるが中途半端」な安物ではありません。OpenAI が高スループットかつ低複雑度なシナリオのために最適化した、軽量かつ強力な武器です。もしあなたのアプリケーションが上記で挙げた 7 つのグリーンゾーンに該当するなら、nano は mini よりも圧倒的にコストパフォーマンスが高い選択肢となります。ただし、Computer Use やターミナルでの長時間タスクが発生する場合は、迷わず mini に切り替えるのが正解です。

GPT-5.4 nano への迅速なアクセスには、APIYI (apiyi.com) プラットフォームの利用を推奨します。Default グループは申請不要で、キャッシュ割引も完全に同期されており、チャージ額の 10% がボーナスとして付与されるほか、国内からの直接接続も安定しています。

延伸阅读 Related Articles

GPT-5.4 nano API に興味をお持ちの方は、以下の記事もぜひご覧ください。

- 📘 GPT-5.4 mini API アップグレードガイド – 一つ上のランクである mini モデルの能力と適用シナリオを解説

- 📊 OpenAI キャッシュメカニズムの深掘り: 90% 割引を実現するベストプラクティス – キャッシュ最適化のエンジニアリングテクニックを習得

- 🚀 GPT-5.4 nano を活用した RAG ルーティング層構築の実践 – 「nano によるルーティング + mini による処理」のハイブリッドアーキテクチャを探索

📚 参考資料

-

OpenAI 公式 GPT-5.4 nano ドキュメント: モデル仕様、価格設定、呼び出しサンプル

- リンク:

developers.openai.com/api/docs/models/gpt-5.4-nano - 説明: 最新かつ最も信頼性の高い公式技術パラメータを入手可能

- リンク:

-

AI Cost Check Benchmark 分析: nano と mini の全方位比較評価

- リンク:

aicostcheck.com/blog/gpt-5-4-mini-nano-pricing-benchmarks - 説明: 第三者による評価レポート。能力差を横断的に比較するのに最適

- リンク:

-

APIYI GPT-5.4 nano 接続ドキュメント: 国内からの呼び出しソリューション、グループ設定、チャージ特典

- リンク:

docs.apiyi.com - 説明: 国内開発者向けの接続実践ガイド

- リンク:

-

OpenAI Pricing Page: 完全な料金表とキャッシュメカニズムの説明

- リンク:

developers.openai.com/api/docs/pricing - 説明: 全モデルの最新課金基準

- リンク:

著者: APIYI 技術チーム

技術交流: GPT-5.4 nano の活用経験について、ぜひコメント欄で共有してください。その他のモデル接続に関する資料は、APIYI ドキュメントセンター(docs.apiyi.com)をご覧ください。