2026年3月,AI界发生了一件极具戏剧性的事件:一个名为 "Hunter Alpha" 的匿名模型悄然出现在 OpenRouter 上。它每周消耗 5000 亿 token,性能直逼 GPT-5.2 和 Claude Opus 4.6,全球开发者纷纷猜测:“这难道是 DeepSeek V4 吗?”

答案出乎所有人的意料——它竟然是小米的 MiMo V2 Pro。一家手机厂商,在不到一年时间内,竟打造出了万亿参数级别的全球一线大规模语言模型。

同期发布的还有 MiMo V2 Omni——一个能够原生处理文本、图片、视频以及超过 10 小时连续音频的全模态模型。目前,这两款模型已上线 APIYI 平台,开发者可以直接进行调用。

核心价值:阅读本文,您将了解 MiMo V2 Pro 和 Omni 的真实能力水平、与竞品的差异,以及为什么它们是当前性价比最高的 AI 模型之一。

Hunter Alpha 事件始末:小米如何震惊 AI 圈

时间线

| 时间 | 事件 |

|---|---|

| 2026 年初 | 代号为 "Hunter Alpha" 的模型匿名上线 OpenRouter |

| 持续数周 | 每周消耗 5000 亿 token,全球开发者争相使用 |

| 社区热议 | 性能接近顶级闭源模型,普遍猜测是 DeepSeek V4 |

| 2026.03.18-19 | 小米正式揭晓:Hunter Alpha 即为 MiMo V2 Pro |

| 同日 | MiMo V2 Omni 和 MiMo V2 Flash 同步发布 |

| 揭晓当日 | 小米股价上涨约 4% |

为什么这件事如此震撼:一家以手机和智能家居闻名的公司,在不到一年时间内训练出了万亿参数规模的大模型,性能直接跻身全球前 10。更令人意外的是,团队核心负责人罗福利此前正是 DeepSeek 突破性模型的核心贡献者之一。

🎯 可用信息:MiMo V2 Pro 和 MiMo V2 Omni 已上线 APIYI (apiyi.com) 平台,开发者可以直接调用。凭借 MiMo V2 Pro 的性能水平以及仅为竞品 1/3 的定价,这是目前性价比最高的推理模型之一。

MiMo V2 Pro:1兆パラメータ推論モデル

主要スペック

| 項目 | 詳細 |

|---|---|

| モデル名 | MiMo V2 Pro (旧 Hunter Alpha) |

| リリース日 | 2026年3月18日〜19日 |

| 総パラメータ数 | 約1兆 (MoEアーキテクチャ) |

| アクティブパラメータ数 | 42B (推論ごとにアクティブ化) |

| コンテキストウィンドウ | 1,048,576 トークン (1M) |

| 最大出力 | 131,072 トークン (128K) |

| 入出力 | テキストのみ |

| 推論能力 | 拡張思考をサポート (<think> タグ) |

| オープンソース状況 | 非公開 (APIアクセスのみ) |

| 開発責任者 | 羅福利 (元 DeepSeek コアメンバー) |

ベンチマーク性能:世界8位、中国2位

| ベンチマーク | MiMo V2 Pro | 順位 |

|---|---|---|

| Artificial Analysis 知能指数 | 49 | 世界 #8 |

| PinchBench | 84.0 | 世界 #3 |

| ClawEval (エージェント能力) | 61.5 | 世界 #3 |

| GDPval-AA | 1434 Elo | 中国モデル #1 |

| 数学正解率 | 94.0% | トップクラス |

| コーディング正解率 | 92.5% | Claude Sonnet 4.6 を凌駕 |

| ハルシネーション率 | 30% | 同クラスで最高水準 |

重要な発見: MiMo V2 Pro はエージェントタスク (ClawEval) において、Claude Opus 4.6 (66.3) および他1モデルに次ぐ世界3位を記録しました。これは、マルチステップ推論、ツール呼び出し、自律的なタスク実行において極めて優れた能力を有していることを示しています。

料金:同等性能モデルの1/6の価格

| コンテキスト範囲 | 入力 (100万トークンあたり) | 出力 (100万トークンあたり) |

|---|---|---|

| ≤ 256K | $1.00 | $3.00 |

| 256K – 1M | $2.00 | $6.00 |

競合他社との価格比較:

| モデル | 入力 | 出力 | MiMo V2 Proとの比較 |

|---|---|---|---|

| MiMo V2 Pro | $1.00 | $3.00 | 基準 |

| Claude Sonnet 4.6 | $3.00 | $15.00 | 5倍高い |

| Claude Opus 4.6 | $15.00 | $75.00 | 25倍高い |

| GPT-5.2 | ~$7.50 | ~$30.00 | 10倍高い |

MiMo V2 Pro のコーディング能力は Claude Sonnet 4.6 を上回りますが、価格はわずか 1/5 です。エージェント能力は Claude Opus 4.6 に匹敵しますが、価格は 1/25 に抑えられています。

💡 コストパフォーマンス推奨: MiMo V2 Pro は現在市場で最も強力な推論能力を持つ低価格モデルの一つです。APIYI (apiyi.com) を通じて直接呼び出すことができ、コストに敏感でありながら品質を求める開発現場に最適です。

MiMo V2 Omni:全モーダルAIモデル

MiMo V2 Omni は、小米(Xiaomi)の全モーダルフラッグシップであり、テキスト、画像、動画、音声を単一のアーキテクチャでネイティブにサポートするモデルです。

主要スペック

| 項目 | 詳細 |

|---|---|

| モデル名 | MiMo V2 Omni |

| リリース日 | 2026年3月18日〜19日 |

| コンテキストウィンドウ | 256K トークン |

| 入力モダリティ | テキスト + 画像 + 動画 + 音声 |

| 出力モダリティ | テキスト |

| 音声処理 | 10時間以上の連続音声をサポート (業界初) |

| 料金 | 入力 $0.40/MTok · 出力 $2.00/MTok |

マルチモーダル能力のハイライト

1. Claude Opus 4.6 を超える視覚推論

MMMU-Pro (多分野視覚推論) および CharXiv RQ (複雑なグラフ分析) ベンチマークにおいて、MiMo V2 Omni は Claude Opus 4.6 を上回り、Gemini 3 レベルに肉薄しています。

2. 10時間の連続音声理解

業界初となる能力で、1回の要求で10時間以上の連続音声を処理でき、品質の低下もありません。利用シーン:

- 会議録音の全編分析と要約

- ポッドキャスト/インタビューの内容抽出

- 長時間の音声対話の理解

- 音声と動画の統合分析

3. ネイティブなツール呼び出しとUI配置

Omni モデルには、構造化されたツール呼び出し、関数実行、UI要素の配置能力が組み込まれており、追加のラッパーなしで AI Agent フレームワークに直接利用可能です。

4. 実践デモ

小米の発表会では、Omni による完全なワークフローが披露されました:

ユーザーが一行の要望を提示

↓

Omni が自律的にスクリプトを作成

↓

4つのシーンを撮影

↓

編集、音声合成、レンダリングエラーの修正

↓

15秒のショート動画をアップロードして公開

このプロセス全体が完全に自律的に完了します。

料金:全モーダルにおける究極のコストパフォーマンス

| 項目 | 料金 |

|---|---|

| 入力 | $0.40 / 100万トークン |

| 出力 | $2.00 / 100万トークン |

これは、現在提供されている全モーダルモデルの中で最も安価な価格設定の一つです。Gemini 3.1 Pro ($2/$12) や Claude Opus 4.6 ($15/$75) と比較しても、Omni の価格優位性は圧倒的です。

🚀 適用シーン: 画像、動画、または長時間の音声を処理する必要があるアプリケーションであれば、MiMo V2 Omni は極めてコストパフォーマンスの高い選択肢です。APIYI (apiyi.com) を経由して直接呼び出すことができ、OpenAI 互換フォーマットを標準サポートしています。

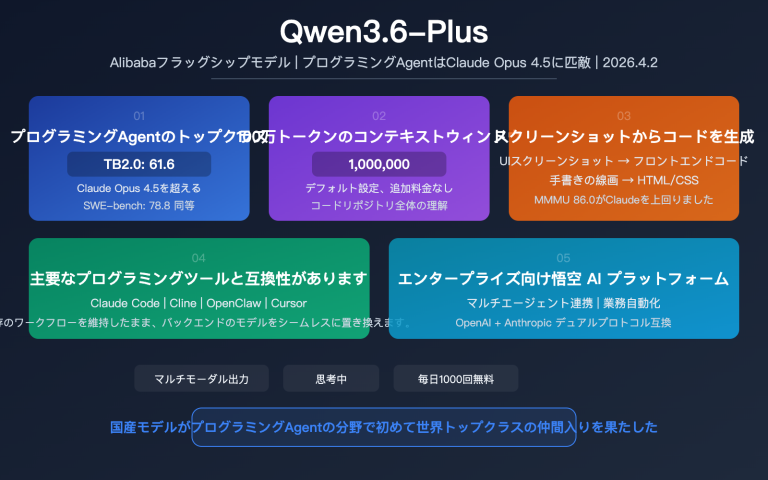

title: MiMo V2 Pro と主要なグローバルモデルの比較分析

description: MiMo V2 Pro と Claude Opus 4.6、GPT-5.2、Grok 4.20 を多角的に比較。コストパフォーマンスと推論能力のバランスを徹底検証し、最適なモデル選定のヒントを提供します。

MiMo V2 Pro vs 全球主流模型横向对比

全項目比較

| 項目 | MiMo V2 Pro | Claude Opus 4.6 | GPT-5.2 | Grok 4.20 |

|---|---|---|---|---|

| アーキテクチャ | 1T MoE (42B アクティブ) | クローズド | クローズド | クローズド MoE |

| コーディング精度 | 92.5% | 最強 (SWE 81.4%) | 強 (SWE ~80%) | SWE ~75% |

| エージェント能力 (ClawEval) | 61.5 (#3) | 66.3 (#1) | 50.0 | — |

| 数学 | 94.0% | — | AIME 100% | AIME 100% |

| コンテキストウィンドウ | 1M | 1M | モデルにより異なる | 2M |

| 入力価格 | $1.00 | $15.00 | ~$7.50 | $2.00 |

| 出力価格 | $3.00 | $75.00 | ~$30.00 | $6.00 |

| 推論モード | <think> タグ |

Adaptive Thinking | 拡張推論 | 推論/非推論 |

| マルチモーダル | ❌ (Proはテキストのみ) | ✅ | ✅ | ✅ 限定的 |

MiMo V2 Pro のポジショニング

性能: Claude Opus 4.6 に匹敵 (エージェント能力の差はわずか5ポイント)

価格: Opus の約 1/25

↓

位置づけ: 「庶民の Opus」 / コスパ最強モデル

MiMo V2 Pro が最適なシーン:

- コストを抑えつつ、高い推論能力が必要なアプリケーション

- エージェント型タスク (多段階推論、ツール呼び出し)

- 大規模なコード生成と解析

- 数学や論理推論

- マルチモーダルが不要な純粋なテキスト処理

Claude Opus 4.6 が依然として優位なシーン:

- 極めて複雑なソフトウェアエンジニアリング (SWE-bench で約6ポイントの差)

- 128K を超える超長文出力が必要な場合

- 企業レベルのセキュリティコンプライアンス要件

- Adaptive Thinking(適応型推論)が必要な場合

💰 選定のアドバイス: 日常的な開発やバッチ処理には、コストを大幅に削減できる MiMo V2 Pro ($1/$3) がおすすめです。一方で、セキュリティが重要なタスクや高度なアーキテクチャ設計には Claude Opus 4.6 を使いましょう。APIYI (apiyi.com) を利用すれば、一つの APIキーで両方のモデルを呼び出し、状況に応じて柔軟に切り替えることが可能です。

MiMo V2 シリーズ全製品ラインナップ

Xiaomiは、超軽量モデルからフラッグシップモデルまで、あらゆるシーンをカバーする3つのモデルを一挙に発表しました。

| モデル | パラメータ | 位置付け | 入力価格 | 出力価格 | オープンソース |

|---|---|---|---|---|---|

| MiMo V2 Flash | 309B (15B アクティブ) | 軽量・高速 | $0.09 | $0.29 | ✅ MIT |

| MiMo V2 Pro | ~1T (42B アクティブ) | 推論フラッグシップ | $1.00 | $3.00 | ❌ API |

| MiMo V2 Omni | — | マルチモーダル | $0.40 | $2.00 | ❌ API |

MiMo V2 Flash 補足説明:

- MITライセンスで完全オープンソース化、ウェイトはHuggingFaceからダウンロード可能

- SWE-bench Verified: 73.4% (オープンソースモデルで第1位)

- AIME 2025: 94.1%

- 推論速度: 150+ トークン/秒

- 8つのテストカテゴリのうち7つでDeepSeek-R1-0528を上回る性能

🎯 フルラインナップ戦略: 単純なタスクにはFlash ($0.09/$0.29 の圧倒的低価格)、推論タスクにはPro ($1/$3 の最高コスパ)、マルチモーダルタスクにはOmni ($0.40/$2.00) を。APIYI (apiyi.com) を通じて、すべてのMiMo V2モデルをワンストップで利用可能です。

API呼び出しの実践

MiMo V2 Proの呼び出し

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI統一インターフェース

)

response = client.chat.completions.create(

model="mimo-v2-pro",

messages=[

{"role": "system", "content": "あなたはコードレビューとアーキテクチャ設計に精通したシニアソフトウェアエンジニアです。"},

{"role": "user", "content": "以下のPythonコードの並行処理の安全性についてレビューしてください..."}

],

max_tokens=8192

)

print(response.choices[0].message.content)

MiMo V2 Omniの呼び出し(マルチモーダル)

# 画像理解の例

response = client.chat.completions.create(

model="mimo-v2-omni",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "このアーキテクチャ図のデータフローを分析してください"},

{"type": "image_url", "image_url": {"url": "data:image/png;base64,..."}}

]

}

]

)

MiMo V2 Pro vs Claude Sonnet 4.6 比較テストコードを表示

import openai

import time

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

models = ["mimo-v2-pro", "claude-sonnet-4-6"]

prompt = "Pythonで並行処理に対応したLRUキャッシュを実装してください。スレッドセーフである必要があります。"

for model in models:

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=4096

)

elapsed = time.time() - start

usage = response.usage

print(f"\n{'='*50}")

print(f"モデル: {model}")

print(f"所要時間: {elapsed:.1f}s")

print(f"トークン: 入力 {usage.prompt_tokens} / 出力 {usage.completion_tokens}")

print(f"プレビュー: {response.choices[0].message.content[:200]}...")

🚀 クイック体験: APIYI (apiyi.com) で登録してAPIキーを取得すれば、すぐにMiMo V2 ProとOmniを呼び出せます。1つのキーでXiaomi、Claude、GPTなど200以上のモデルを同時に利用可能です。

よくある質問

Q1: MiMo V2 Pro は本当に1兆パラメータもあるのですか?なぜこんなに安いのですか?

はい、総パラメータ数は約1兆ですが、MoE(混合エキスパート)アーキテクチャを採用しているため、推論ごとにアクティブ化されるのは約42Bパラメータのみです。つまり、同等のパラメータ数を持つ密なモデルよりも推論コストが大幅に低く抑えられます。これは、DeepSeekやGrokなどのモデルが採用しているのと同じ技術路線です。APIYI (apiyi.com) を通じれば、この1兆パラメータモデルを1/3の価格で呼び出すことが可能です。

Q2: MiMo V2 Pro は Claude の代わりにコードレビューを行えますか?

一部のシナリオでは可能です。MiMo V2 Pro のコーディング精度(92.5%)とエージェント能力(ClawEval 61.5)は非常に強力です。日常的なコードレビューやバグ分析において、極めてコストパフォーマンスの高い選択肢となります。ただし、セキュリティが重要な監査や超大規模なアーキテクチャの再構築に関しては、Claude Opus 4.6 の方が依然として信頼性が高いです。APIYI (apiyi.com) を通じて両方のモデルを同時に接続し、タスクに応じて柔軟に切り替えることをお勧めします。

Q3: MiMo V2 Omni の10時間音声処理は信頼できますか?

Xiaomi は、これが業界初の機能であると主張しています。1回のリクエストで10時間以上の連続した音声理解をサポートし、精度も低下しません。会議の録音分析やポッドキャストのコンテンツ抽出など、長時間の音声タスクに適しています。ただし、リリースされたばかりのモデルですので、まずは重要度の低いタスクでテストを行うことをお勧めします。APIYI (apiyi.com) を通じれば、低コスト($0.40/$2.00)でテストが可能です。

Q4: MiMo V2 Pro はオープンソース化されますか?

Xiaomi は「モデルが十分に安定した段階で」オープンソース化する計画を表明しています。同シリーズの MiMo V2 Flash はすでに MIT ライセンスで HuggingFace にてオープンソース化されています。Xiaomi のオープンソースに対する積極的な姿勢(MiMo V1 もオープンソース化済み)を考慮すれば、V2 Pro のオープンソース化も時間の問題でしょう。

Q5: MiMo V2 Pro、Flash、Omni はどう使い分ければよいですか?

ニーズに合わせて選択してください。純粋なテキスト推論タスクには Pro($1/$3、最強の推論能力)、極めて低いコストやローカルデプロイが必要な場合は Flash($0.09/$0.29、オープンソースで自前デプロイ可能)、画像・動画・音声の処理が必要な場合は Omni($0.40/$2.00)が適しています。APIYI (apiyi.com) なら、1つの APIキーですべてのモデルを呼び出すことができます。

まとめ:Xiaomi の AI に対する野心は侮れない

MiMo V2 シリーズのリリースは、Xiaomi が「スマホメーカーが作る AI」から「世界最先端の AI プレイヤー」へと正式に進化を遂げたことを示しています。Hunter Alpha として匿名で公開された一連の動きは、実力で語り、後から正体を明かすという、教科書のような製品リリースでした。

3つの核心的な判断:

- MiMo V2 Pro は現在最もコストパフォーマンスの高い推論モデル: エージェント能力は世界3位、コーディング能力は Sonnet 4.6 を上回り、価格は Opus のわずか25分の1です。

- MiMo V2 Omni のマルチモーダル能力に注目: 10時間の音声処理は、真の差別化要因となる強みです。

- Xiaomi AI チームの実行力は驚異的: ゼロから1兆パラメータのモデルを構築するまで1年足らずであり、コアチームには DeepSeek 出身のエンジニアも含まれています。

ぜひ APIYI (apiyi.com) を通じて MiMo V2 シリーズを体験し、業界最低水準の価格でトップクラスの AI 推論能力を手に入れてください。

参考資料

-

Xiaomi MiMo V2 Pro 公式ページ: 技術仕様およびベンチマークデータ

- リンク:

mimo.xiaomi.com/mimo-v2-pro

- リンク:

-

Artificial Analysis: MiMo V2 Pro ベンチマーク評価

- リンク:

artificialanalysis.ai/models/mimo-v2-pro

- リンク:

-

VentureBeat: Xiaomi MiMo V2 Pro リリースレポート

- リンク:

venturebeat.com

- リンク:

-

OpenRouter: MiMo V2 モデルの価格および API 情報

- リンク:

openrouter.ai

- リンク:

著者: APIYI Team | 最新の AI モデルをいち早く提供しています。ぜひ APIYI (apiyi.com) にアクセスして、Xiaomi MiMo V2 シリーズの全モデルをご体験ください。