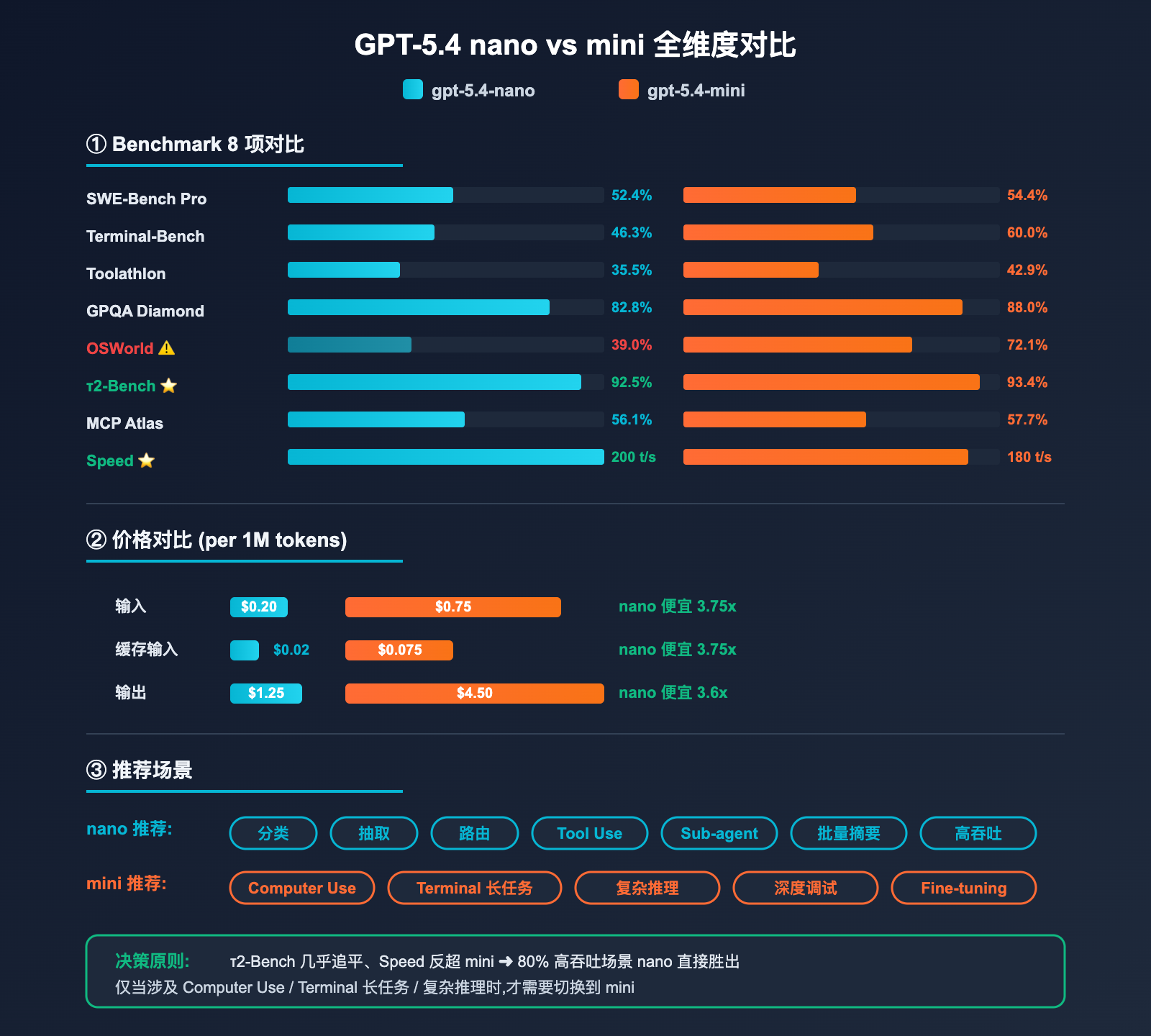

作者注:OpenAI 最便宜的 gpt-5.4-nano 仅 $0.20/$1.25,τ2-Bench 92.5% 追平 mini。本文详解 7 大最适合 nano 的应用场景、何时该用 mini 取代,以及缓存 90% 折扣的极致优化方案。

如果你的应用每天调用次数 > 万次,或者你正在为客服、分类、RAG 路由这样的高吞吐任务挑选模型,你可能注意到 OpenAI 把 GPT-5.4 系列的"地板价"压到了一个新低 —— gpt-5.4-nano,$0.20 输入 / $1.25 输出 per 1M tokens,输入比 5.4-mini 还便宜 3.75 倍。

这不是简单的"阉割版便宜模型"。OpenAI 公开的 Benchmark 显示,nano 在工具调用(τ2-Bench)上达到 92.5%,几乎追平 mini 的 93.4%;在通用知识问答(GPQA Diamond)上拿到 82.8%,只比 mini 低 5.2 个百分点。这意味着对于大量"高吞吐 + 低复杂度"的场景,nano 才是真正的最优解。

核心价值:本文从 7 大具体应用场景切入,详解 nano 在哪些任务上"够用且更便宜"、在哪些任务上"必须用 mini",并给出每个场景的代码片段与成本测算。

GPT-5.4 nano 应用场景核心要点

| 要点 | 说明 | 价值 |

|---|---|---|

| 极致低价 | $0.20 / $1.25 per 1M tokens | 比 5.4-mini 便宜 3.75x |

| 缓存 -90% | 缓存输入仅 $0.02 / 1M | 高频上下文场景几乎免费 |

| 工具调用接近 mini | τ2-Bench 92.5% vs mini 93.4% | 大部分 Tool Use 场景够用 |

| 知识问答强 | GPQA Diamond 82.8% | 通用 FAQ、知识检索胜任 |

| 400K 长上下文 | 输入 400K + 输出 128K | 长文档批量处理无压力 |

| 速度领先 | ~200 t/s,比 mini 还快 10% | 高吞吐管道首选 |

GPT-5.4 nano 的"够用阈值"如何判定

判断 nano 是否够用,可以用一个简单的"三分类法":

绿区(放心用 nano):工具调用、结构化抽取、分类标注、知识问答、内容路由、批量翻译/摘要 —— 这些任务 nano 的得分与 mini 差距 < 10 个百分点,价格优势完全压倒能力差距。

黄区(谨慎评估):复杂多步推理、长链路 Agent 编排、代码生成 —— SWE-Bench Pro 52.4% 仍能胜任,但建议先用 nano 跑一轮 AB 测试再决定。

红区(直接用 mini):Computer Use(nano OSWorld 仅 39%)、Terminal 长任务(46.3% 较弱)、需 Fine-tuning 的定制场景 —— 这些场景 nano 表现明显跟不上,直接选 mini 或标准版。

GPT-5.4 nano 应用场景一:实时分类

场景描述

实时分类是 nano 最经典的应用 —— 包括情感分析、意图识别、主题标注、内容审核标记等。这类任务每次调用通常只需要几百 tokens 输入、几十 tokens 输出,对延迟和成本极度敏感。

极简代码示例

import openai

import json

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

def classify_intent(user_query: str) -> dict:

"""分类用户查询意图"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "你是一个意图分类器。返回 JSON 格式: {intent, confidence, sub_category}"},

{"role": "user", "content": user_query}

],

response_format={"type": "json_object"}

)

return json.loads(response.choices[0].message.content)

# 使用

result = classify_intent("我想退订上周的订单")

# {"intent": "refund_request", "confidence": 0.95, "sub_category": "subscription_cancel"}

成本测算

| 场景规模 | 单次成本 | 日成本(10 万次) |

|---|---|---|

| 入门客服(50 输入 + 20 输出) | $0.000035 | $3.5 |

| 中型 SaaS(200 输入 + 30 输出) | $0.000078 | $7.8 |

| 企业级(500 输入 + 50 输出) | $0.000163 | $16.3 |

💡 优化建议:把分类标签和示例放在 system prompt 中,启用缓存后输入成本可再降 90%。通过 API易 apiyi.com 调用时,缓存折扣完全同步。

GPT-5.4 nano 应用场景二:数据抽取

场景描述

从非结构化文本(简历、合同、新闻、邮件)中提取结构化字段。这是 nano 的强项 —— 配合 Structured Outputs(JSON Schema 强约束)可以做到 99%+ 的格式正确率。

实战代码

from pydantic import BaseModel

from typing import Optional

class ContactInfo(BaseModel):

name: str

email: Optional[str]

phone: Optional[str]

company: Optional[str]

role: Optional[str]

def extract_contact(text: str) -> ContactInfo:

response = client.beta.chat.completions.parse(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "提取联系人信息,缺失字段返回 null"},

{"role": "user", "content": text}

],

response_format=ContactInfo

)

return response.choices[0].message.parsed

适合 nano 的抽取任务清单

- 简历/CV 关键字段提取

- 发票/收据数字识别

- 邮件签名块解析

- 新闻实体识别(人名、地名、机构)

- 表单数据规范化

- 日志事件归类

GPT-5.4 nano 应用场景三:内容排序

场景描述

对搜索结果、推荐列表、消息队列进行重排。nano 的低成本让"用 LLM 做 reranker"在生产环境中变得经济可行。

重排代码示例

def rerank_documents(query: str, candidates: list[str], top_k: int = 5) -> list:

"""对候选文档基于查询相关性重排"""

docs_text = "\n".join([f"[{i}] {doc[:300]}" for i, doc in enumerate(candidates)])

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[{

"role": "user",

"content": f"""基于查询 "{query}" 对以下文档按相关性排序。

文档:

{docs_text}

返回 JSON: {{"ranking": [文档索引列表,从最相关到最不相关]}}"""

}],

response_format={"type": "json_object"}

)

ranking = json.loads(response.choices[0].message.content)["ranking"]

return [candidates[i] for i in ranking[:top_k]]

🎯 场景建议:nano 重排比传统 BM25 + 向量检索的 reranker 准确率更高,但成本仅为 GPT-5.4-mini 的 27%。可通过 API易 apiyi.com 直接接入,Default 分组无需任何申请。

GPT-5.4 nano 应用场景四:Sub-agent 执行层

场景描述

在多 Agent 架构中,主 Agent(通常用 mini 或标准版)负责规划,Sub-agent(执行 worker)负责具体的工具调用、数据查询、状态更新。nano 在 τ2-Bench 上 92.5% 的得分使其完全胜任 worker 角色。

多 Agent 协作示例

def execute_subtask(task: dict, available_tools: list) -> dict:

"""nano 作为 Sub-agent 执行单个子任务"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": f"你是执行 worker。可用工具: {available_tools}"},

{"role": "user", "content": f"执行任务: {task['description']}"}

],

tools=task.get("tools", []),

tool_choice="auto"

)

return {

"task_id": task["id"],

"result": response.choices[0].message.content,

"tool_calls": response.choices[0].message.tool_calls

}

# 主 Agent 用 mini,Sub-agent 用 nano —— 成本节省 60%+

GPT-5.4 nano 应用场景五:RAG 路由层

场景描述

在 RAG 系统中,nano 作为"路由层"判断查询类型(技术问题 / 售前咨询 / 产品反馈 / 闲聊),并分发给不同的处理器。这种设计让昂贵的 mini/标准版只在真正需要时被调用。

RAG 路由示例

def route_query(query: str) -> str:

"""nano 判断查询路由到哪个 RAG 处理器"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": """根据查询类型返回路由标签:

- "technical_docs": 技术文档查询

- "product_faq": 产品 FAQ

- "code_help": 代码帮助

- "small_talk": 闲聊(无需 RAG)

- "complex_reasoning": 复杂推理(转给 mini/标准版)"""},

{"role": "user", "content": query}

],

max_tokens=20

)

return response.choices[0].message.content.strip()

route = route_query(user_input)

if route == "complex_reasoning":

final_model = "gpt-5.4-mini" # 升级到 mini

else:

final_model = "gpt-5.4-nano" # 继续用 nano

💰 成本优化:这种"nano 路由 + mini/标准版处理"的架构,通常能让综合调用成本降低 60-80%。可通过 API易 apiyi.com 在同一 API Key 下灵活切换两个模型,只需修改 model 参数。

GPT-5.4 nano 应用场景六:高吞吐摘要与翻译

场景描述

批量处理新闻摘要、文档翻译、评论改写等任务。配合 400K 上下文,nano 一次可以处理整篇长文,且单条成本几乎可以忽略。

Batch API 示例

# 准备批量任务

batch_requests = []

for doc_id, content in documents.items():

batch_requests.append({

"custom_id": f"summary-{doc_id}",

"method": "POST",

"url": "/v1/chat/completions",

"body": {

"model": "gpt-5.4-nano",

"messages": [

{"role": "system", "content": "用 100 字总结以下内容"},

{"role": "user", "content": content}

],

"max_tokens": 200

}

})

# 提交 Batch API(同价但不占在线配额)

batch = client.batches.create(

input_file_id=file_id,

endpoint="/v1/chat/completions",

completion_window="24h"

)

GPT-5.4 nano 应用场景七:Tool Use 工具调用

场景描述

τ2-Bench 上 nano 拿到 92.5%,几乎追平 mini 的 93.4%。对于"查天气、查订单、查文档"这类标准化的 function calling 场景,nano 完全可以胜任。

Function Calling 示例

tools = [{

"type": "function",

"function": {

"name": "get_order_status",

"description": "查询订单状态",

"parameters": {

"type": "object",

"properties": {

"order_id": {"type": "string"}

},

"required": ["order_id"]

}

}

}]

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[{"role": "user", "content": "我的订单 #12345 怎么样了?"}],

tools=tools,

tool_choice="auto"

)

# nano 准确识别需要调用 get_order_status,提取 order_id="12345"

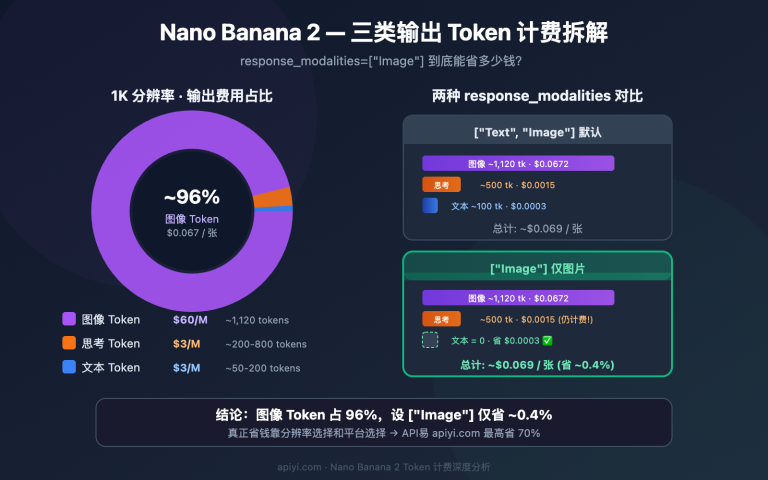

GPT-5.4 nano 价格详解

官方价格结构

| 计费类型 | 价格(per 1M tokens) | 说明 |

|---|---|---|

| 输入 | $0.20 | 标准定价 |

| 缓存输入 | $0.02 | 90% 折扣 |

| 输出 | $1.25 | 含 reasoning tokens |

| Batch API | $0.20 / $1.25 | 同价,不占在线配额 |

| 区域数据驻留 | +10% | 数据合规场景 |

nano vs mini 价格对比

| 维度 | gpt-5.4-nano | gpt-5.4-mini | 倍数 |

|---|---|---|---|

| 输入 | $0.20 | $0.75 | nano 便宜 3.75x |

| 缓存输入 | $0.02 | $0.075 | nano 便宜 3.75x |

| 输出 | $1.25 | $4.50 | nano 便宜 3.6x |

| 响应速度 | ~200 t/s | ~180 t/s | nano 快约 10% |

| 上下文 | 400K | 400K | 持平 |

| 最大输出 | 128K | 128K | 持平 |

💰 成本优化:对于上百万次/天的高吞吐场景,nano 与 mini 的价差可以累积到每月数千美金。通过 API易 apiyi.com 接入还可享受充值 100 美金送 10%,等效官网 85 折,综合成本最多可比官网低 25%。

GPT-5.4 nano vs mini Benchmark 全面对比

| 评测维度 | gpt-5.4-nano | gpt-5.4-mini | 差距 | nano 是否够用 |

|---|---|---|---|---|

| SWE-Bench Pro | 52.4% | 54.4% | -2.0pp | ✅ 几乎持平 |

| Terminal-Bench 2.0 | 46.3% | 60.0% | -13.7pp | ⚠️ 长任务用 mini |

| Toolathlon | 35.5% | 42.9% | -7.4pp | ✅ 一般场景够用 |

| GPQA Diamond | 82.8% | 88.0% | -5.2pp | ✅ 知识问答胜任 |

| OSWorld-Verified | 39.0% | 72.1% | -33.1pp | ❌ Computer Use 必须用 mini |

| τ2-Bench(Tool Use) | 92.5% | 93.4% | -0.9pp | ✅ 几乎追平 |

| MCP Atlas | 56.1% | 57.7% | -1.6pp | ✅ 几乎持平 |

| 响应速度 | ~200 t/s | ~180 t/s | +10% | ✅ nano 反而更快 |

选型决策建议

优先用 nano 的情况:

- 任务属于"绿区"(分类、抽取、排序、路由、Tool Use、批量处理)

- 调用量 > 1 万次/天,成本敏感

- 需要 < 1 秒的低延迟响应

- Sub-agent 执行层(主 Agent 用 mini,worker 用 nano)

升级到 mini 的情况:

- 涉及 Computer Use(OSWorld 决定性差距)

- Terminal 长任务(>10 步操作)

- 需要复杂多步推理或代码深度调试

- 任务质量比成本更重要

📊 取舍建议:在 80% 的"高吞吐 + 低复杂度"场景中,nano 的性价比碾压 mini。可通过 API易 apiyi.com 直接对比两个模型在你的具体任务上的表现,只需修改 model 参数。

GPT-5.4 nano 在 API易 的接入说明

Default 分组直接可用

API易平台对 GPT-5.4 nano 与 5.4-mini 采用相同的开放策略:

- ✅ Default 默认分组:全开放,新用户注册即可调用

- ✅ SVIP 高级分组:全开放,无任何限制

- ✅ 缓存折扣同步:$0.02/1M 缓存价格完全适用

- ✅ Batch API 同步:批量任务也享受同价

API易 vs 官网成本对比

| 项目 | OpenAI 官网 | API易 apiyi.com |

|---|---|---|

| 基础价格 | $0.20 / $1.25 per 1M | $0.20 / $1.25 per 1M(同价) |

| 缓存折扣 | $0.02 / 1M(90%) | $0.02 / 1M(完全同步) |

| 充值优惠 | 无 | 充值 $100 送 $10(10%) |

| 实际成本 | 100% 标准价 | 约 90% 标准价(85 折左右) |

| 国内访问 | 需翻墙 | 直连,无需翻墙 |

| 支付方式 | 国际信用卡 | 支持人民币、支付宝、微信 |

| SDK 兼容 | OpenAI 原生 | 完全兼容 OpenAI SDK |

| 充值最小额 | $5 | $1 起充 |

💰 成本优化:对于每月调用量在百万级以上的应用,通过 API易 apiyi.com 接入 nano 可在官网 85 折基础上叠加缓存优化,综合成本可比直接调用 OpenAI 官网低 25-35%。

常见问题 FAQ

Q1: 什么是 gpt-5.4-nano?它和 gpt-5.4-mini 主要差在哪?

GPT-5.4-nano 是 OpenAI GPT-5.4 系列中最便宜、最快的轻量级模型($0.20/$1.25 per 1M tokens),响应速度约 200 t/s。与 5.4-mini 的核心差异:1)价格便宜 3.6-3.75 倍;2)Computer Use(OSWorld 39% vs 72.1%)和 Terminal 长任务(46.3% vs 60%)显著较弱;3)其他场景(分类、抽取、Tool Use、知识问答)差距通常 < 10pp。

Q2: nano 最适合哪些应用场景?哪些场景必须用 mini?

适合 nano(绿区):

- 实时分类(情感、意图、主题)

- 结构化数据抽取

- 内容排序与重排

- Sub-agent 执行层

- RAG 路由层

- 高吞吐摘要/翻译

- 标准化工具调用(τ2-Bench 92.5%)

必须用 mini 的场景(红区):

- Computer Use 桌面自动化(OSWorld 差距 33pp)

- Terminal 长任务(>10 步)

- 复杂多步推理

- 需要 Fine-tuning 的定制场景

Q3: nano 为什么不推荐用于 Computer Use?

OSWorld-Verified 评测中 nano 仅 39.0%,远低于 mini 的 72.1%。这意味着 nano 在多步桌面操作(打开浏览器→搜索→点击→填表)中失败率过高,无法稳定完成任务链路。如果你的场景需要 Computer Use,应直接选择 mini 或 5.4 标准版。

Q4: nano 的缓存折扣 $0.02/1M 怎么启用?

OpenAI 缓存机制是自动触发的,无需额外参数。当 prompt 前缀(通常是 system prompt + 共享上下文)与最近 5-10 分钟的请求一致时自动命中,享受 90% 折扣。

优化建议:

- system prompt 放在 messages 数组最前面

- 共享上下文(分类标签、Schema 定义)紧随其后

- 用户实际查询放在最后

- 保持调用频率(>5 分钟会过期)

通过 API易 apiyi.com 调用时,缓存折扣完全同步官网。

Q5: nano 处理批量任务的最佳实践是什么?

三个关键策略:

- 使用 Batch API:

/v1/batches接口提交批量任务,24 小时内完成,价格不变,但不占用在线 RPM 配额 - 共享 system prompt:所有任务用相同的指令,触发缓存命中

- 设置合理 max_tokens:nano 输出便宜但累计也是钱,根据任务设置 50-500 的合理上限

通过 API易 apiyi.com 提交 Batch 任务,享受充值 10% 优惠后实际成本约官网 85 折。

Q6: 如何通过 API易 调用 GPT-5.4 nano?

API易完全兼容 OpenAI SDK,只需三步:

- 访问 API易 apiyi.com 注册账号(无需申请,Default 分组直接可用)

- 获取 API Key

- 修改代码 base_url 为

https://vip.apiyi.com/v1,model 设为gpt-5.4-nano

client = openai.OpenAI(

api_key="YOUR_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[...]

)

充值 100 美金赠送 10%,等效官网 85 折左右,缓存折扣同步。

Q7: 什么时候 nano 反而比 mini 划算?具体怎么计算?

判断公式:

nano 划算条件 = (单次任务质量降级容忍度) × (调用量) × (价差)

> (升级到 mini 带来的质量提升收益)

实际场景:

- 调用量 > 10K/天:节省 > $30/天($1000/月)

- 调用量 > 100K/天:节省 > $300/天($9000/月)

- 调用量 > 1M/天:节省 > $3000/天($90000/月)

对于绿区任务(分类、抽取、Tool Use),nano 的质量损失通常 < 5%,但成本节省 73%(纯计算 3.6x 倍数)。综合 ROI 几乎总是 nano 胜出。

Q8: GPT-5.4 nano 有哪些已知限制?

主要限制:

- 不支持 Computer Use:OSWorld 39% 太低,无法稳定完成桌面自动化

- 不支持 Fine-tuning:无法用自定义数据集微调

- 不支持音频/视频输入:仅文本+图像输入

- Terminal 长任务弱:Terminal-Bench 46.3%,超过 10 步操作易失败

- 复杂推理能力有限:GPQA 82.8% 接近 mini,但 FrontierMath 等极难任务表现下降明显

替代方案:遇到这些限制直接切换到 gpt-5.4-mini 或 5.4 标准版。

GPT-5.4 nano 应用场景核心要点 Key Takeaways

- 价格地板:$0.20/$1.25 per 1M tokens,比 5.4-mini 便宜 3.6-3.75 倍

- 缓存 90% 折扣:输入低至 $0.02/1M,高频上下文场景几乎免费

- 7 大绿区场景:分类、抽取、排序、Sub-agent、路由、批量处理、Tool Use

- τ2-Bench 92.5%:工具调用几乎追平 mini,90%+ Function Calling 场景够用

- GPQA 82.8%:通用知识问答能力强,适合 FAQ、内容审核

- 速度 200 t/s:比 mini 还快 10%,高吞吐管道首选

- 红区警告:Computer Use、Terminal 长任务必须切换到 mini

总结

GPT-5.4 nano 应用场景的核心要点:

- 场景定位:nano 是高吞吐、低复杂度任务的最优选 —— 实时分类、数据抽取、Sub-agent worker、RAG 路由、批量处理是它的主战场

- 能力边界:τ2-Bench / GPQA / SWE-Bench Pro 几乎追平 mini,但 Computer Use / Terminal 长任务能力明显较弱

- 接入方式:通过 API易 apiyi.com Default 分组直接调用,缓存折扣同步,充值 100 送 10

GPT-5.4 nano 不是"什么都能做但都做不好"的廉价品,而是 OpenAI 针对高吞吐 + 低复杂度场景精心优化的轻量级武器。如果你的应用属于本文列举的 7 大绿区场景,nano 几乎总是比 mini 更划算。但如果涉及 Computer Use 或 Terminal 长任务,直接切换到 mini 才是正确选择。

推荐通过 API易 apiyi.com 平台快速接入 GPT-5.4 nano,Default 分组无需申请、缓存折扣完全同步、充值赠送 10%、国内直连稳定。

延伸阅读 Related Articles

如果你对 GPT-5.4 nano API 感兴趣,推荐继续阅读:

- 📘 GPT-5.4 mini API 升级指南 – 了解上一档 mini 模型的能力与适用场景

- 📊 OpenAI 缓存机制深度解析:90% 折扣的最佳实践 – 掌握缓存优化的工程技巧

- 🚀 基于 GPT-5.4 nano 构建 RAG 路由层实战 – 探索"nano 路由 + mini 处理"的混合架构

📚 参考资料

-

OpenAI 官方 GPT-5.4 nano 文档:模型规格、定价、调用示例

- 链接:

developers.openai.com/api/docs/models/gpt-5.4-nano - 说明:获取最新最权威的官方技术参数

- 链接:

-

AI Cost Check Benchmark 分析:nano vs mini 全维度评测

- 链接:

aicostcheck.com/blog/gpt-5-4-mini-nano-pricing-benchmarks - 说明:第三方评测,适合横向对比能力差异

- 链接:

-

API易 GPT-5.4 nano 接入文档:国内调用方案、分组说明、充值优惠

- 链接:

docs.apiyi.com - 说明:适合国内开发者的接入实操指南

- 链接:

-

OpenAI Pricing Page:完整价格表与缓存机制说明

- 链接:

developers.openai.com/api/docs/pricing - 说明:所有模型最新计费标准

- 链接:

作者:APIYI 技术团队

技术交流:欢迎在评论区讨论 GPT-5.4 nano 的应用经验,更多模型接入资料可访问 API易 docs.apiyi.com 文档中心