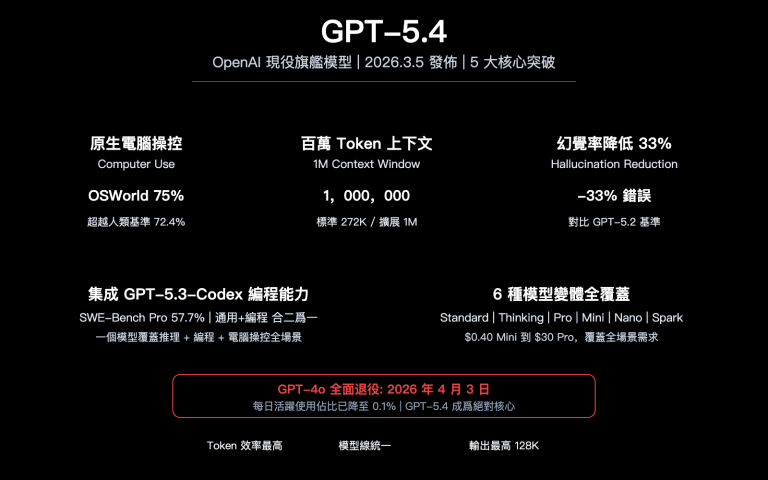

作者注:OpenAI 最便宜的 gpt-5.4-nano 僅 $0.20/$1.25,τ2-Bench 92.5% 追平 mini。本文詳解 7 大最適合 nano 的應用場景、何時該用 mini 取代,以及緩存 90% 折扣的極致優化方案。

如果你的應用每天調用次數 > 萬次,或者你正在爲客服、分類、RAG 路由這樣的高吞吐任務挑選模型,你可能注意到 OpenAI 把 GPT-5.4 系列的"地板價"壓到了一個新低 —— gpt-5.4-nano,$0.20 輸入 / $1.25 輸出 per 1M tokens,輸入比 5.4-mini 還便宜 3.75 倍。

這不是簡單的"閹割版便宜模型"。OpenAI 公開的 Benchmark 顯示,nano 在工具調用(τ2-Bench)上達到 92.5%,幾乎追平 mini 的 93.4%;在通用知識問答(GPQA Diamond)上拿到 82.8%,只比 mini 低 5.2 個百分點。這意味着對於大量"高吞吐 + 低複雜度"的場景,nano 纔是真正的最優解。

核心價值:本文從 7 大具體應用場景切入,詳解 nano 在哪些任務上"夠用且更便宜"、在哪些任務上"必須用 mini",並給出每個場景的代碼片段與成本測算。

GPT-5.4 nano 應用場景核心要點

| 要點 | 說明 | 價值 |

|---|---|---|

| 極致低價 | $0.20 / $1.25 per 1M tokens | 比 5.4-mini 便宜 3.75x |

| 緩存 -90% | 緩存輸入僅 $0.02 / 1M | 高頻上下文場景幾乎免費 |

| 工具調用接近 mini | τ2-Bench 92.5% vs mini 93.4% | 大部分 Tool Use 場景夠用 |

| 知識問答強 | GPQA Diamond 82.8% | 通用 FAQ、知識檢索勝任 |

| 400K 長上下文 | 輸入 400K + 輸出 128K | 長文檔批量處理無壓力 |

| 速度領先 | ~200 t/s,比 mini 還快 10% | 高吞吐管道首選 |

GPT-5.4 nano 的"夠用閾值"如何判定

判斷 nano 是否夠用,可以用一個簡單的"三分類法":

綠區(放心用 nano):工具調用、結構化抽取、分類標註、知識問答、內容路由、批量翻譯/摘要 —— 這些任務 nano 的得分與 mini 差距 < 10 個百分點,價格優勢完全壓倒能力差距。

黃區(謹慎評估):複雜多步推理、長鏈路 Agent 編排、代碼生成 —— SWE-Bench Pro 52.4% 仍能勝任,但建議先用 nano 跑一輪 AB 測試再決定。

紅區(直接用 mini):Computer Use(nano OSWorld 僅 39%)、Terminal 長任務(46.3% 較弱)、需 Fine-tuning 的定製場景 —— 這些場景 nano 表現明顯跟不上,直接選 mini 或標準版。

GPT-5.4 nano 應用場景一:實時分類

場景描述

實時分類是 nano 最經典的應用 —— 包括情感分析、意圖識別、主題標註、內容審覈標記等。這類任務每次調用通常只需要幾百 tokens 輸入、幾十 tokens 輸出,對延遲和成本極度敏感。

極簡代碼示例

import openai

import json

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

def classify_intent(user_query: str) -> dict:

"""分類用戶查詢意圖"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "你是一個意圖分類器。返回 JSON 格式: {intent, confidence, sub_category}"},

{"role": "user", "content": user_query}

],

response_format={"type": "json_object"}

)

return json.loads(response.choices[0].message.content)

# 使用

result = classify_intent("我想退訂上週的訂單")

# {"intent": "refund_request", "confidence": 0.95, "sub_category": "subscription_cancel"}

成本測算

| 場景規模 | 單次成本 | 日成本(10 萬次) |

|---|---|---|

| 入門客服(50 輸入 + 20 輸出) | $0.000035 | $3.5 |

| 中型 SaaS(200 輸入 + 30 輸出) | $0.000078 | $7.8 |

| 企業級(500 輸入 + 50 輸出) | $0.000163 | $16.3 |

💡 優化建議:把分類標籤和示例放在 system prompt 中,啓用緩存後輸入成本可再降 90%。通過 API易 apiyi.com 調用時,緩存摺扣完全同步。

GPT-5.4 nano 應用場景二:數據抽取

場景描述

從非結構化文本(簡歷、合同、新聞、郵件)中提取結構化字段。這是 nano 的強項 —— 配合 Structured Outputs(JSON Schema 強約束)可以做到 99%+ 的格式正確率。

實戰代碼

from pydantic import BaseModel

from typing import Optional

class ContactInfo(BaseModel):

name: str

email: Optional[str]

phone: Optional[str]

company: Optional[str]

role: Optional[str]

def extract_contact(text: str) -> ContactInfo:

response = client.beta.chat.completions.parse(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "提取聯繫人信息,缺失字段返回 null"},

{"role": "user", "content": text}

],

response_format=ContactInfo

)

return response.choices[0].message.parsed

適合 nano 的抽取任務清單

- 簡歷/CV 關鍵字段提取

- 發票/收據數字識別

- 郵件簽名塊解析

- 新聞實體識別(人名、地名、機構)

- 表單數據規範化

- 日誌事件歸類

GPT-5.4 nano 應用場景三:內容排序

場景描述

對搜索結果、推薦列表、消息隊列進行重排。nano 的低成本讓"用 LLM 做 reranker"在生產環境中變得經濟可行。

重排代碼示例

def rerank_documents(query: str, candidates: list[str], top_k: int = 5) -> list:

"""對候選文檔基於查詢相關性重排"""

docs_text = "\n".join([f"[{i}] {doc[:300]}" for i, doc in enumerate(candidates)])

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[{

"role": "user",

"content": f"""基於查詢 "{query}" 對以下文檔按相關性排序。

文檔:

{docs_text}

返回 JSON: {{"ranking": [文檔索引列表,從最相關到最不相關]}}"""

}],

response_format={"type": "json_object"}

)

ranking = json.loads(response.choices[0].message.content)["ranking"]

return [candidates[i] for i in ranking[:top_k]]

🎯 場景建議:nano 重排比傳統 BM25 + 向量檢索的 reranker 準確率更高,但成本僅爲 GPT-5.4-mini 的 27%。可通過 API易 apiyi.com 直接接入,Default 分組無需任何申請。

GPT-5.4 nano 應用場景四:Sub-agent 執行層

場景描述

在多 Agent 架構中,主 Agent(通常用 mini 或標準版)負責規劃,Sub-agent(執行 worker)負責具體的工具調用、數據查詢、狀態更新。nano 在 τ2-Bench 上 92.5% 的得分使其完全勝任 worker 角色。

多 Agent 協作示例

def execute_subtask(task: dict, available_tools: list) -> dict:

"""nano 作爲 Sub-agent 執行單個子任務"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": f"你是執行 worker。可用工具: {available_tools}"},

{"role": "user", "content": f"執行任務: {task['description']}"}

],

tools=task.get("tools", []),

tool_choice="auto"

)

return {

"task_id": task["id"],

"result": response.choices[0].message.content,

"tool_calls": response.choices[0].message.tool_calls

}

# 主 Agent 用 mini,Sub-agent 用 nano —— 成本節省 60%+

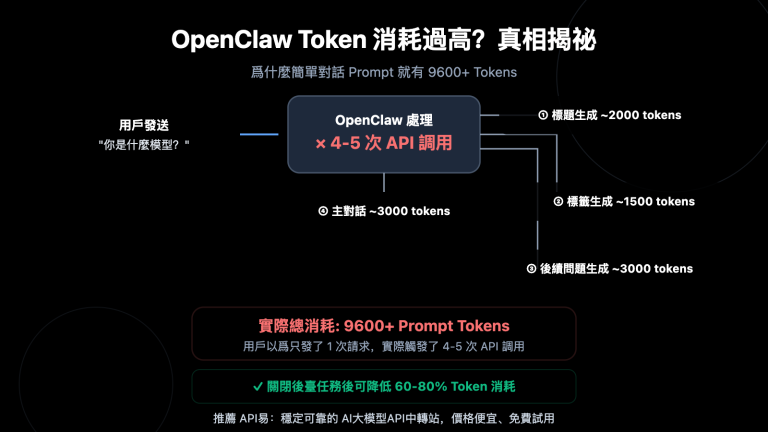

GPT-5.4 nano 應用場景五:RAG 路由層

場景描述

在 RAG 系統中,nano 作爲"路由層"判斷查詢類型(技術問題 / 售前諮詢 / 產品反饋 / 閒聊),並分發給不同的處理器。這種設計讓昂貴的 mini/標準版只在真正需要時被調用。

RAG 路由示例

def route_query(query: str) -> str:

"""nano 判斷查詢路由到哪個 RAG 處理器"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": """根據查詢類型返回路由標籤:

- "technical_docs": 技術文檔查詢

- "product_faq": 產品 FAQ

- "code_help": 代碼幫助

- "small_talk": 閒聊(無需 RAG)

- "complex_reasoning": 複雜推理(轉給 mini/標準版)"""},

{"role": "user", "content": query}

],

max_tokens=20

)

return response.choices[0].message.content.strip()

route = route_query(user_input)

if route == "complex_reasoning":

final_model = "gpt-5.4-mini" # 升級到 mini

else:

final_model = "gpt-5.4-nano" # 繼續用 nano

💰 成本優化:這種"nano 路由 + mini/標準版處理"的架構,通常能讓綜合調用成本降低 60-80%。可通過 API易 apiyi.com 在同一 API Key 下靈活切換兩個模型,只需修改 model 參數。

GPT-5.4 nano 應用場景六:高吞吐摘要與翻譯

場景描述

批量處理新聞摘要、文檔翻譯、評論改寫等任務。配合 400K 上下文,nano 一次可以處理整篇長文,且單條成本幾乎可以忽略。

Batch API 示例

# 準備批量任務

batch_requests = []

for doc_id, content in documents.items():

batch_requests.append({

"custom_id": f"summary-{doc_id}",

"method": "POST",

"url": "/v1/chat/completions",

"body": {

"model": "gpt-5.4-nano",

"messages": [

{"role": "system", "content": "用 100 字總結以下內容"},

{"role": "user", "content": content}

],

"max_tokens": 200

}

})

# 提交 Batch API(同價但不佔在線配額)

batch = client.batches.create(

input_file_id=file_id,

endpoint="/v1/chat/completions",

completion_window="24h"

)

GPT-5.4 nano 應用場景七:Tool Use 工具調用

場景描述

τ2-Bench 上 nano 拿到 92.5%,幾乎追平 mini 的 93.4%。對於"查天氣、查訂單、查文檔"這類標準化的 function calling 場景,nano 完全可以勝任。

Function Calling 示例

tools = [{

"type": "function",

"function": {

"name": "get_order_status",

"description": "查詢訂單狀態",

"parameters": {

"type": "object",

"properties": {

"order_id": {"type": "string"}

},

"required": ["order_id"]

}

}

}]

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[{"role": "user", "content": "我的訂單 #12345 怎麼樣了?"}],

tools=tools,

tool_choice="auto"

)

# nano 準確識別需要調用 get_order_status,提取 order_id="12345"

GPT-5.4 nano 價格詳解

官方價格結構

| 計費類型 | 價格(per 1M tokens) | 說明 |

|---|---|---|

| 輸入 | $0.20 | 標準定價 |

| 緩存輸入 | $0.02 | 90% 折扣 |

| 輸出 | $1.25 | 含 reasoning tokens |

| Batch API | $0.20 / $1.25 | 同價,不佔在線配額 |

| 區域數據駐留 | +10% | 數據合規場景 |

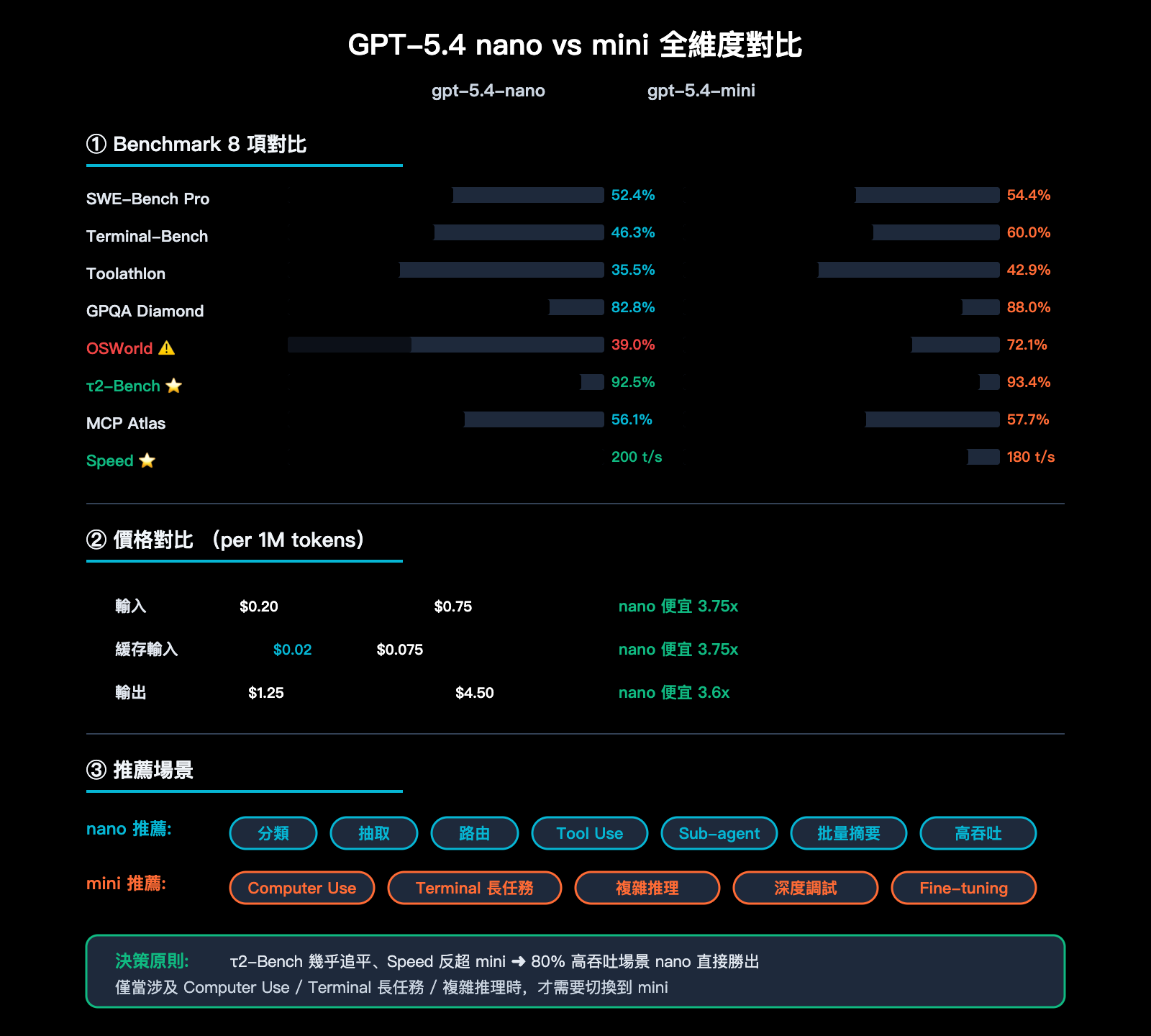

nano vs mini 價格對比

| 維度 | gpt-5.4-nano | gpt-5.4-mini | 倍數 |

|---|---|---|---|

| 輸入 | $0.20 | $0.75 | nano 便宜 3.75x |

| 緩存輸入 | $0.02 | $0.075 | nano 便宜 3.75x |

| 輸出 | $1.25 | $4.50 | nano 便宜 3.6x |

| 響應速度 | ~200 t/s | ~180 t/s | nano 快約 10% |

| 上下文 | 400K | 400K | 持平 |

| 最大輸出 | 128K | 128K | 持平 |

💰 成本優化:對於上百萬次/天的高吞吐場景,nano 與 mini 的價差可以累積到每月數千美金。通過 API易 apiyi.com 接入還可享受充值 100 美金送 10%,等效官網 85 折,綜合成本最多可比官網低 25%。

GPT-5.4 nano vs mini Benchmark 全面對比

| 評測維度 | gpt-5.4-nano | gpt-5.4-mini | 差距 | nano 是否夠用 |

|---|---|---|---|---|

| SWE-Bench Pro | 52.4% | 54.4% | -2.0pp | ✅ 幾乎持平 |

| Terminal-Bench 2.0 | 46.3% | 60.0% | -13.7pp | ⚠️ 長任務用 mini |

| Toolathlon | 35.5% | 42.9% | -7.4pp | ✅ 一般場景夠用 |

| GPQA Diamond | 82.8% | 88.0% | -5.2pp | ✅ 知識問答勝任 |

| OSWorld-Verified | 39.0% | 72.1% | -33.1pp | ❌ Computer Use 必須用 mini |

| τ2-Bench(Tool Use) | 92.5% | 93.4% | -0.9pp | ✅ 幾乎追平 |

| MCP Atlas | 56.1% | 57.7% | -1.6pp | ✅ 幾乎持平 |

| 響應速度 | ~200 t/s | ~180 t/s | +10% | ✅ nano 反而更快 |

選型決策建議

優先用 nano 的情況:

- 任務屬於"綠區"(分類、抽取、排序、路由、Tool Use、批量處理)

- 調用量 > 1 萬次/天,成本敏感

- 需要 < 1 秒的低延遲響應

- Sub-agent 執行層(主 Agent 用 mini,worker 用 nano)

升級到 mini 的情況:

- 涉及 Computer Use(OSWorld 決定性差距)

- Terminal 長任務(>10 步操作)

- 需要複雜多步推理或代碼深度調試

- 任務質量比成本更重要

📊 取捨建議:在 80% 的"高吞吐 + 低複雜度"場景中,nano 的性價比碾壓 mini。可通過 API易 apiyi.com 直接對比兩個模型在你的具體任務上的表現,只需修改 model 參數。

GPT-5.4 nano 在 API易 的接入說明

Default 分組直接可用

API易平臺對 GPT-5.4 nano 與 5.4-mini 採用相同的開放策略:

- ✅ Default 默認分組:全開放,新用戶註冊即可調用

- ✅ SVIP 高級分組:全開放,無任何限制

- ✅ 緩存摺扣同步:$0.02/1M 緩存價格完全適用

- ✅ Batch API 同步:批量任務也享受同價

API易 vs 官網成本對比

| 項目 | OpenAI 官網 | API易 apiyi.com |

|---|---|---|

| 基礎價格 | $0.20 / $1.25 per 1M | $0.20 / $1.25 per 1M(同價) |

| 緩存摺扣 | $0.02 / 1M(90%) | $0.02 / 1M(完全同步) |

| 充值優惠 | 無 | 充值 $100 送 $10(10%) |

| 實際成本 | 100% 標準價 | 約 90% 標準價(85 折左右) |

| 國內訪問 | 需翻牆 | 直連,無需翻牆 |

| 支付方式 | 國際信用卡 | 支持人民幣、支付寶、微信 |

| SDK 兼容 | OpenAI 原生 | 完全兼容 OpenAI SDK |

| 充值最小額 | $5 | $1 起充 |

💰 成本優化:對於每月調用量在百萬級以上的應用,通過 API易 apiyi.com 接入 nano 可在官網 85 折基礎上疊加緩存優化,綜合成本可比直接調用 OpenAI 官網低 25-35%。

常見問題 FAQ

Q1: 什麼是 gpt-5.4-nano?它和 gpt-5.4-mini 主要差在哪?

GPT-5.4-nano 是 OpenAI GPT-5.4 系列中最便宜、最快的輕量級模型($0.20/$1.25 per 1M tokens),響應速度約 200 t/s。與 5.4-mini 的核心差異:1)價格便宜 3.6-3.75 倍;2)Computer Use(OSWorld 39% vs 72.1%)和 Terminal 長任務(46.3% vs 60%)顯著較弱;3)其他場景(分類、抽取、Tool Use、知識問答)差距通常 < 10pp。

Q2: nano 最適合哪些應用場景?哪些場景必須用 mini?

適合 nano(綠區):

- 實時分類(情感、意圖、主題)

- 結構化數據抽取

- 內容排序與重排

- Sub-agent 執行層

- RAG 路由層

- 高吞吐摘要/翻譯

- 標準化工具調用(τ2-Bench 92.5%)

必須用 mini 的場景(紅區):

- Computer Use 桌面自動化(OSWorld 差距 33pp)

- Terminal 長任務(>10 步)

- 複雜多步推理

- 需要 Fine-tuning 的定製場景

Q3: nano 爲什麼不推薦用於 Computer Use?

OSWorld-Verified 評測中 nano 僅 39.0%,遠低於 mini 的 72.1%。這意味着 nano 在多步桌面操作(打開瀏覽器→搜索→點擊→填表)中失敗率過高,無法穩定完成任務鏈路。如果你的場景需要 Computer Use,應直接選擇 mini 或 5.4 標準版。

Q4: nano 的緩存摺扣 $0.02/1M 怎麼啓用?

OpenAI 緩存機制是自動觸發的,無需額外參數。當 prompt 前綴(通常是 system prompt + 共享上下文)與最近 5-10 分鐘的請求一致時自動命中,享受 90% 折扣。

優化建議:

- system prompt 放在 messages 數組最前面

- 共享上下文(分類標籤、Schema 定義)緊隨其後

- 用戶實際查詢放在最後

- 保持調用頻率(>5 分鐘會過期)

通過 API易 apiyi.com 調用時,緩存摺扣完全同步官網。

Q5: nano 處理批量任務的最佳實踐是什麼?

三個關鍵策略:

- 使用 Batch API:

/v1/batches接口提交批量任務,24 小時內完成,價格不變,但不佔用在線 RPM 配額 - 共享 system prompt:所有任務用相同的指令,觸發緩存命中

- 設置合理 max_tokens:nano 輸出便宜但累計也是錢,根據任務設置 50-500 的合理上限

通過 API易 apiyi.com 提交 Batch 任務,享受充值 10% 優惠後實際成本約官網 85 折。

Q6: 如何通過 API易 調用 GPT-5.4 nano?

API易完全兼容 OpenAI SDK,只需三步:

- 訪問 API易 apiyi.com 註冊賬號(無需申請,Default 分組直接可用)

- 獲取 API Key

- 修改代碼 base_url 爲

https://vip.apiyi.com/v1,model 設爲gpt-5.4-nano

client = openai.OpenAI(

api_key="YOUR_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[...]

)

充值 100 美金贈送 10%,等效官網 85 折左右,緩存摺扣同步。

Q7: 什麼時候 nano 反而比 mini 划算?具體怎麼計算?

判斷公式:

nano 划算條件 = (單次任務質量降級容忍度) × (調用量) × (價差)

> (升級到 mini 帶來的質量提升收益)

實際場景:

- 調用量 > 10K/天:節省 > $30/天($1000/月)

- 調用量 > 100K/天:節省 > $300/天($9000/月)

- 調用量 > 1M/天:節省 > $3000/天($90000/月)

對於綠區任務(分類、抽取、Tool Use),nano 的質量損失通常 < 5%,但成本節省 73%(純計算 3.6x 倍數)。綜合 ROI 幾乎總是 nano 勝出。

Q8: GPT-5.4 nano 有哪些已知限制?

主要限制:

- 不支持 Computer Use:OSWorld 39% 太低,無法穩定完成桌面自動化

- 不支持 Fine-tuning:無法用自定義數據集微調

- 不支持音頻/視頻輸入:僅文本+圖像輸入

- Terminal 長任務弱:Terminal-Bench 46.3%,超過 10 步操作易失敗

- 複雜推理能力有限:GPQA 82.8% 接近 mini,但 FrontierMath 等極難任務表現下降明顯

替代方案:遇到這些限制直接切換到 gpt-5.4-mini 或 5.4 標準版。

GPT-5.4 nano 應用場景核心要點 Key Takeaways

- 價格地板:$0.20/$1.25 per 1M tokens,比 5.4-mini 便宜 3.6-3.75 倍

- 緩存 90% 折扣:輸入低至 $0.02/1M,高頻上下文場景幾乎免費

- 7 大綠區場景:分類、抽取、排序、Sub-agent、路由、批量處理、Tool Use

- τ2-Bench 92.5%:工具調用幾乎追平 mini,90%+ Function Calling 場景夠用

- GPQA 82.8%:通用知識問答能力強,適合 FAQ、內容審覈

- 速度 200 t/s:比 mini 還快 10%,高吞吐管道首選

- 紅區警告:Computer Use、Terminal 長任務必須切換到 mini

總結

GPT-5.4 nano 應用場景的核心要點:

- 場景定位:nano 是高吞吐、低複雜度任務的最優選 —— 實時分類、數據抽取、Sub-agent worker、RAG 路由、批量處理是它的主戰場

- 能力邊界:τ2-Bench / GPQA / SWE-Bench Pro 幾乎追平 mini,但 Computer Use / Terminal 長任務能力明顯較弱

- 接入方式:通過 API易 apiyi.com Default 分組直接調用,緩存摺扣同步,充值 100 送 10

GPT-5.4 nano 不是"什麼都能做但都做不好"的廉價品,而是 OpenAI 針對高吞吐 + 低複雜度場景精心優化的輕量級武器。如果你的應用屬於本文列舉的 7 大綠區場景,nano 幾乎總是比 mini 更划算。但如果涉及 Computer Use 或 Terminal 長任務,直接切換到 mini 纔是正確選擇。

推薦通過 API易 apiyi.com 平臺快速接入 GPT-5.4 nano,Default 分組無需申請、緩存摺扣完全同步、充值贈送 10%、國內直連穩定。

延伸閱讀 Related Articles

如果你對 GPT-5.4 nano API 感興趣,推薦繼續閱讀:

- 📘 GPT-5.4 mini API 升級指南 – 瞭解上一檔 mini 模型的能力與適用場景

- 📊 OpenAI 緩存機制深度解析:90% 折扣的最佳實踐 – 掌握緩存優化的工程技巧

- 🚀 基於 GPT-5.4 nano 構建 RAG 路由層實戰 – 探索"nano 路由 + mini 處理"的混合架構

📚 參考資料

-

OpenAI 官方 GPT-5.4 nano 文檔:模型規格、定價、調用示例

- 鏈接:

developers.openai.com/api/docs/models/gpt-5.4-nano - 說明:獲取最新最權威的官方技術參數

- 鏈接:

-

AI Cost Check Benchmark 分析:nano vs mini 全維度評測

- 鏈接:

aicostcheck.com/blog/gpt-5-4-mini-nano-pricing-benchmarks - 說明:第三方評測,適合橫向對比能力差異

- 鏈接:

-

API易 GPT-5.4 nano 接入文檔:國內調用方案、分組說明、充值優惠

- 鏈接:

docs.apiyi.com - 說明:適合國內開發者的接入實操指南

- 鏈接:

-

OpenAI Pricing Page:完整價格表與緩存機制說明

- 鏈接:

developers.openai.com/api/docs/pricing - 說明:所有模型最新計費標準

- 鏈接:

作者:APIYI 技術團隊

技術交流:歡迎在評論區討論 GPT-5.4 nano 的應用經驗,更多模型接入資料可訪問 API易 docs.apiyi.com 文檔中心