Catatan Penulis: Mengungkap penyebab mendasar di balik seringnya overload pada Nano Banana Pro API, mulai dari arsitektur chip TPU buatan Google hingga perbedaan antara AI Studio dan Vertex AI. Mari kita bedah kebenaran teknis di balik tingginya permintaan yang melebihi pasokan.

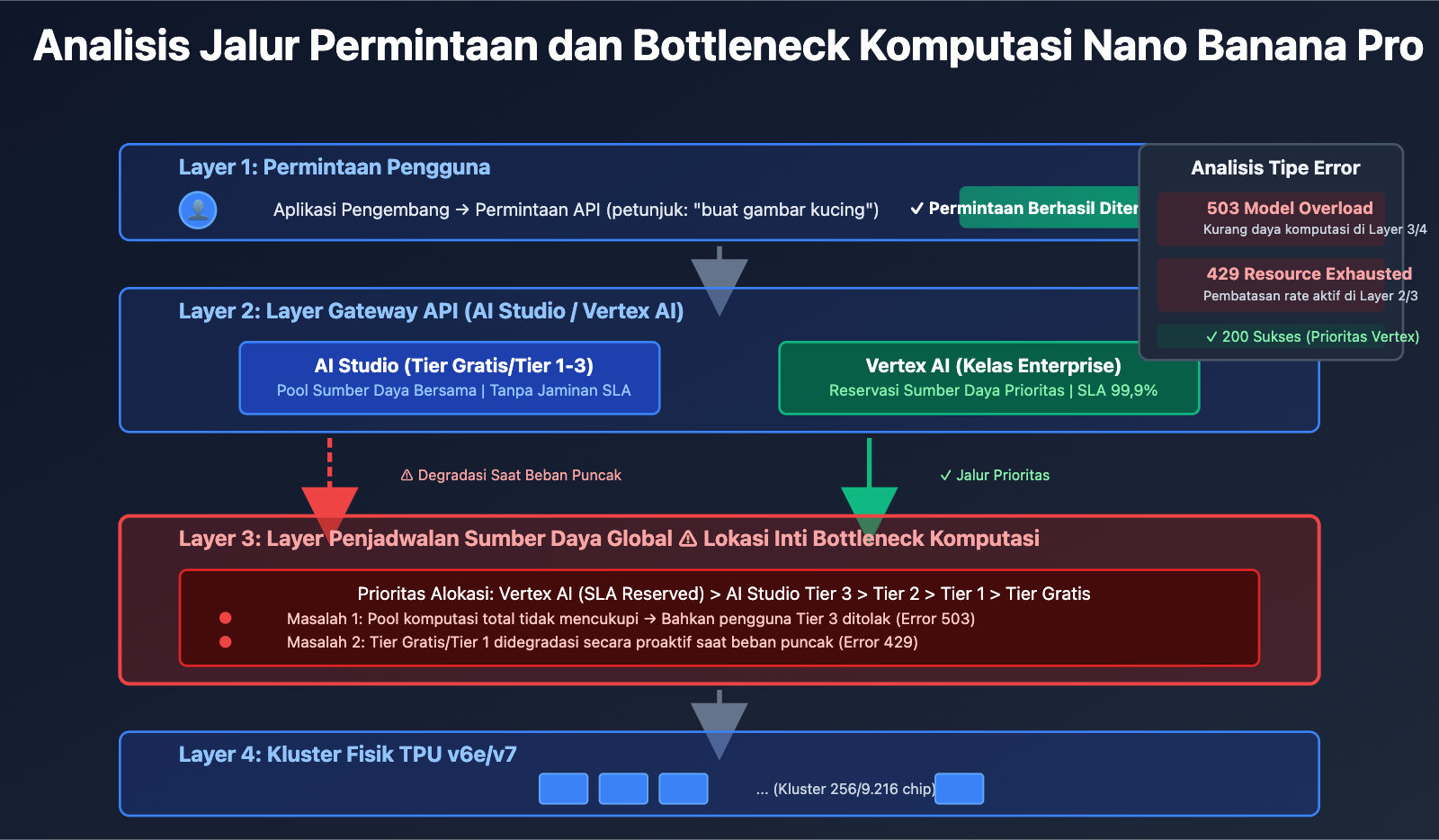

Nano Banana Pro sejak diluncurkan pada November 2025, para pengembang menemukan fenomena yang membingungkan: meskipun Google memiliki chip TPU buatannya sendiri, API pembuatan gambar ini tetap sering mengalami error "model overload" (model kelebihan beban). Mengapa chip buatan sendiri tidak bisa menyelesaikan masalah daya komputasi? Apa perbedaan mendasar antara platform AI Studio dan Vertex AI? Artikel ini akan mengupas tuntas kebenaran teknis dari perspektif logika dasar arsitektur komputasi Google.

Nilai Inti: Melalui data nyata dan analisis arsitektur, membantu Anda memahami penyebab utama masalah stabilitas Nano Banana Pro, serta cara memilih solusi akses API yang lebih andal.

Masalah Inti Stabilitas API Nano Banana Pro

Sejak diluncurkan pada November 2025 hingga saat ini, Nano Banana Pro (gemini-2.0-flash-preview-image-generation) telah mengalami krisis stabilitas yang berkelanjutan. Berikut adalah data masalah inti yang dilaporkan oleh komunitas pengembang:

| Tipe Masalah | Frekuensi Kejadian | Gejala Tipikal | Cakupan Dampak |

|---|---|---|---|

| 503 Model Overload | Frekuensi Tinggi (70%+ dari total error) | Waktu respons melonjak dari 30 detik menjadi 60-100 detik | Semua level pengguna (termasuk pengguna berbayar Tier 3) |

| 429 Resource Exhausted | Sekitar 70% dari error API | Muncul meskipun penggunaan jauh di bawah batas kuota | Pengguna Tier Gratis dan Tier 1 |

| Pemangkasan Kuota Mendadak | 7 Desember 2025 | Tier Gratis turun dari 3 gambar/hari menjadi 2 gambar/hari, 2.5 Pro dihapus dari Tier Gratis | Pengguna Tier Gratis secara global |

| Layanan Tidak Tersedia | Intermiten (Kadang-kadang) | Generasi sangat cepat di hari sebelumnya, tapi tidak bisa digunakan sama sekali keesokan harinya | Pengembang aplikasi yang bergantung pada Tier Gratis |

Penyebab Utama Masalah Stabilitas Nano Banana Pro

Inti dari masalah ini bukanlah cacat pada kode, melainkan bottleneck kapasitas komputasi pada sisi server Google. Bahkan pengguna berbayar Tier 3 (level kuota tertinggi) pun masih menemui error overload saat frekuensi permintaan jauh di bawah batas resmi. Hal ini menunjukkan bahwa masalahnya terletak pada level infrastruktur, bukan pada manajemen kuota pengguna.

Berdasarkan tanggapan resmi Google di forum pengembang, sumber daya komputasi sedang dialokasikan ulang untuk model-model baru di seri Gemini 2.0. Hal ini menyebabkan kapasitas yang tersedia untuk model pembuatan gambar seperti Nano Banana Pro menjadi terbatas. Strategi penjadwalan sumber daya inilah yang secara langsung mengakibatkan ketidakstabilan layanan.

🎯 Saran Teknis: Saat menggunakan Nano Banana Pro di lingkungan produksi, disarankan untuk mengaksesnya melalui platform APIYI (apiyi.com). Platform ini menyediakan mekanisme load balancing cerdas dan failover otomatis yang dapat meningkatkan tingkat keberhasilan dan stabilitas pemanggilan API secara signifikan.

Kenyataan di Balik Arsitektur Chip Mandiri Google TPU

Banyak orang mengira karena Google memiliki chip TPU (Tensor Processing Unit) buatan sendiri, mereka seharusnya bisa dengan mudah memenuhi kebutuhan komputasi Model Bahasa Besar AI. Namun, kenyataannya jauh lebih rumit dari yang dibayangkan.

Arsitektur Terbaru TPU v7 (Ironwood)

Pada April 2025, di konferensi Cloud Next, Google merilis TPU generasi ketujuh—Ironwood, yang merupakan versi paling tangguh hingga saat ini:

| Parameter Arsitektur | TPU v7 (Ironwood) | TPU v6e (Trillium) | Peningkatan |

|---|---|---|---|

| Komputasi Puncak | 4.614 TFLOP/s | Sekitar 2.300 TFLOP/s | ~100% |

| Rasio Efisiensi Energi | Tolok Ukur | Referensi | Performa/Watt naik 100% |

| Konfigurasi Cluster | 256 chip / 9.216 chip | Konfigurasi tunggal | Kemampuan penskalaan fleksibel |

| Unit Matriks | 256×256 MXU (systolic array) | 128×128 MXU | 4x densitas komputasi |

| Skenario Penggunaan | Era Utamakan Inferensi (Inference-first) | Campuran Training + Inferensi | Optimasi khusus performa inferensi |

Komponen Inti Arsitektur TPU

Setiap chip TPU berisi satu atau lebih TensorCore, yang masing-masing terdiri dari:

- Matrix Multiplication Unit (MXU): TPU v6e dan v7x menggunakan array multiply-accumulate 256×256, sedangkan versi sebelumnya 128×128.

- Vector Unit: Menangani operasi non-matriks.

- Scalar Unit: Menjalankan logika kontrol.

Arsitektur systolic array ini sangat cocok untuk inferensi jaringan saraf, tetapi tetap memiliki keterbatasan.

Mengapa Chip Mandiri Tetap Belum Bisa Mengatasi Kekurangan Komputasi?

Meskipun TPU v7 sangat bertenaga, masalah stabilitas pada Nano Banana Pro tetap ada karena tiga alasan utama:

1. Siklus Peningkatan Kapasitas Produksi

TPU v7 dirilis pada April 2025, tetapi penerapan skala besar membutuhkan waktu. Google mengumumkan kerja sama senilai sepuluh miliar dolar dengan Anthropic pada akhir 2025, dengan rencana mengaktifkan lebih dari 1 GW daya komputasi AI pada tahun 2026. Ini berarti November 2025 hingga awal 2026 adalah masa transisi peningkatan kapasitas, di mana pergantian arsitektur lama ke baru menyebabkan keterbatasan sumber daya.

2. Lonjakan Permintaan yang Eksplosif

Setelah seri model Gemini 2.0 dirilis pada akhir 2025, volume permintaan API melonjak melampaui prediksi awal Google. Membludaknya pengguna paket gratis (terutama untuk kebutuhan pembuatan gambar Nano Banana Pro) langsung memakan pool sumber daya pengguna berbayar.

3. Prioritas Alokasi Sumber Daya

Google perlu menyeimbangkan kebutuhan komputasi di berbagai lini produk AI: Gemini 2.5 Pro (teks), Gemini 2.0 Flash (multimodal), Nano Banana Pro (gambar), dan lainnya. Saat daya komputasi terbatas, model dengan nilai komersial lebih tinggi akan mendapatkan prioritas alokasi, yang secara langsung menyebabkan pembatasan kapasitas pada Nano Banana Pro.

🎯 Wawasan Arsitektur: Memiliki chip TPU sendiri bukan berarti daya komputasi menjadi tanpa batas. Kapasitas produksi chip, pembangunan pusat data, dan pasokan energi semuanya merupakan faktor pembatas. Kami menyarankan pengguna bisnis untuk menggunakan platform APIYI apiyi.com guna mendapatkan kemampuan penjadwalan komputasi multi-cloud, demi menghindari risiko kapasitas dari satu vendor saja.

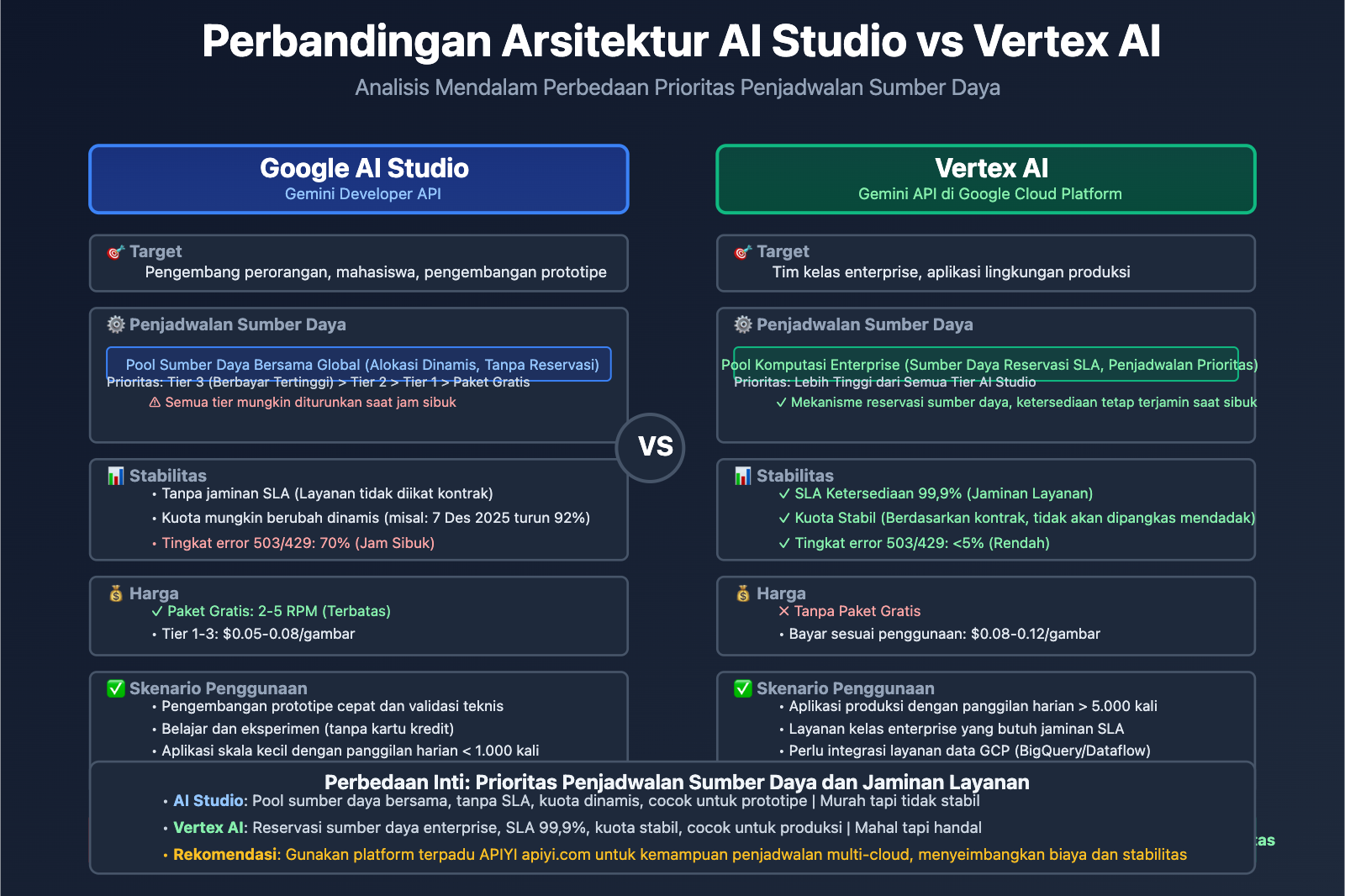

AI Studio vs Vertex AI: Perbedaan Esensial Kedua Platform

Banyak pengembang bingung: Gemini AI Studio dan Vertex AI sama-sama bisa memanggil model Gemini, tapi mengapa stabilitas dan kuotanya berbeda jauh? Jawabannya terletak pada posisi arsitektur keduanya yang sangat berbeda.

Perbandingan Posisi Platform

| Dimensi | Google AI Studio (Gemini Developer API) | Vertex AI (Gemini API on GCP) |

|---|---|---|

| Target Pengguna | Pengembang perorangan, mahasiswa, startup | Tim kelas enterprise, aplikasi lingkungan produksi |

| Batas Penggunaan | Cukup dapatkan API Key, bisa mulai prototipe dalam hitungan menit | Butuh akun Google Cloud dan konfigurasi penagihan |

| Model Harga | Paket Gratis (kuota terbatas) + Bayar Tier 1/2/3 | Bayar sesuai penggunaan (Pay-as-you-go), terintegrasi sistem GCP |

| Jaminan SLA | Tanpa SLA (Service Level Agreement) | Menyediakan SLA kelas enterprise, jaminan ketersediaan 99,9% |

| Cakupan Fitur | Hanya API pemanggilan model + alat prototipe visual | Alur kerja ML lengkap (pelabelan data, training, fine-tuning, deployment, monitoring) |

| Stabilitas Kuota | Dipengaruhi penjadwalan sumber daya global, kuota bisa berubah dinamis | Reservasi kuota kelas enterprise, prioritas alokasi sumber daya |

Keunggulan dan Keterbatasan AI Studio

Keunggulan:

- Mulai dengan Cepat: Langsung dapatkan kunci API setelah daftar, tanpa perlu konfigurasi layanan cloud.

- Alat Prototipe Visual: Antarmuka pengujian petunjuk bawaan, memudahkan iterasi cepat.

- Ramah Paket Gratis: Cocok untuk belajar, eksperimen, dan proyek skala kecil.

Keterbatasan:

- Tanpa Jaminan SLA: Ketersediaan layanan tidak diikat oleh kontrak.

- Kuota Tidak Stabil: Seperti kejadian pemangkasan mendadak pada 7 Desember 2025, di mana Gemini 2.5 Pro dihapus dari paket gratis, dan batas harian 2.5 Flash anjlok dari 250 kali menjadi 20 kali (turun 92%).

- Kurang Fitur Enterprise: Tidak bisa terintegrasi dengan layanan data GCP seperti BigQuery atau Dataflow.

Kemampuan Kelas Enterprise Vertex AI

Keunggulan Utama:

- Prioritas Sumber Daya: Permintaan pengguna berbayar memiliki prioritas lebih tinggi dalam sistem penjadwalan internal Google.

- Integrasi MLOps: Mendukung siklus hidup lengkap mulai dari pelatihan model, manajemen versi, pengujian A/B, hingga pemantauan dan peringatan.

- Kedaulatan Data: Wilayah penyimpanan data bisa ditentukan, sesuai dengan kepatuhan GDPR, CCPA, dll.

- Dukungan Enterprise: Tim dukungan teknis khusus dan layanan konsultasi arsitektur.

Skenario Penggunaan:

- Aplikasi produksi dengan permintaan harian lebih dari 10.000 kali.

- Skenario yang membutuhkan fine-tuning model dan pelatihan khusus.

- Perusahaan dengan persyaratan SLA yang ketat untuk ketersediaan dan waktu respons.

🎯 Saran Pemilihan: Jika aplikasi Anda sudah melewati tahap prototipe dan volume panggilan harian rata-rata melebihi 5.000 kali, disarankan untuk migrasi ke Vertex AI atau terhubung melalui platform terpadu seperti APIYI apiyi.com. Platform ini mengintegrasikan sumber daya komputasi dari berbagai penyedia cloud, memungkinkan penjadwalan lintas platform dalam satu antarmuka, sehingga Anda mendapatkan kemudahan AI Studio sekaligus jaminan stabilitas setara Vertex AI.

Alasan Mendalam di Balik Kelangkaan Nano Banana Pro

Berdasarkan analisis sebelumnya, penyebab Nano Banana Pro terus-menerus mengalami kekurangan pasokan dapat dikelompokkan ke dalam tiga level utama:

1. Level Teknis: Ketidakseimbangan Kapasitas Chip dan Permintaan

- Peningkatan Produksi TPU v7: Dirilis pada April 2025, namun penerapan skala besar baru akan selesai pada tahun 2026.

- Prioritas Pelatihan di atas Inferensi: Tugas pelatihan seri Gemini 3.0 menyedot banyak sumber daya TPU v6e dan v7.

- Komputasi Intensif untuk Pembuatan Gambar: Inferensi model difusi (Diffusion Model) Nano Banana Pro membutuhkan daya komputasi 5-10 kali lipat lebih besar dibandingkan model teks.

2. Level Bisnis: Penyesuaian Strategi Paket Gratis (Free Tier)

| Titik Waktu | Perubahan Kebijakan | Alasan Latar Belakang |

|---|---|---|

| November 2025 | Nano Banana Pro diluncurkan, paket gratis 3 gambar/hari | Mendapatkan umpan balik pengguna dengan cepat, membangun posisi pasar |

| 7 Desember 2025 | Paket gratis turun menjadi 2 gambar/hari, Gemini 2.5 Pro dihapus dari paket gratis | Biaya komputasi melebihi anggaran, perlu mengontrol pertumbuhan pengguna gratis |

| Januari 2026 | RPM paket gratis turun dari 10 ke 5 | Menyediakan sumber daya untuk pelanggan perusahaan Gemini 2.0 Flash |

Google menyatakan secara eksplisit di forum resmi bahwa penyesuaian ini dilakukan untuk "memastikan kualitas layanan yang berkelanjutan". Kenyataannya, lonjakan pengguna paket gratis (terutama alat otomatisasi dan pemanggilan massal) menyebabkan biaya lepas kendali, sehingga memaksa Google memperketat kebijakan.

3. Level Arsitektur: Isolasi Sumber Daya antara AI Studio dan Vertex AI

Meskipun kedua platform memanggil model dasar yang sama, keduanya memiliki prioritas penjadwalan sumber daya yang berbeda di internal Google:

- Vertex AI: Terhubung langsung ke pool komputasi tingkat perusahaan GCP, menikmati reservasi sumber daya dengan jaminan SLA.

- AI Studio: Berbagi pool sumber daya global, dan akan mengalami penurunan prioritas (downgrade) pada jam-jam sibuk.

Desain arsitektur ini menyebabkan pengguna paket gratis dan Tier 1 di AI Studio lebih sering menemui error 429/503, sementara pengguna berbayar di Vertex AI kurang terdampak.

4. Strategi Produk: Dari "Merebut Pasar" ke "Optimasi Profit"

Pada tahap awal peluncuran Nano Banana Pro, Google menerapkan strategi gratis yang agresif untuk bersaing dengan kompetitor seperti DALL-E 3 dan Midjourney. Namun, seiring ledakan jumlah pengguna, Google menyadari bahwa model bisnis paket gratis tidak berkelanjutan dan mulai mengalihkan sumber daya ke "pengguna berbayar bernilai tinggi".

Peristiwa simbolis dari perubahan ini adalah pemotongan kuota pada Desember 2025 dan penghapusan paket gratis 2.5 Pro, yang oleh komunitas pengembang disebut sebagai "Free Tier Fiasco" (Bencana Paket Gratis).

🎯 Strategi Menghadapi: Untuk aplikasi produksi yang bergantung pada Nano Banana Pro, disarankan untuk menggunakan strategi pencadangan multi-cloud. Melalui platform APIYI (apiyi.com), Anda dapat mengonfigurasi aturan pengalihan otomatis antara Nano Banana Pro, DALL-E 3, Stable Diffusion, dan beberapa model lainnya dalam satu antarmuka. Ketika salah satu layanan kelebihan beban, sistem akan otomatis beralih ke solusi cadangan untuk memastikan kelangsungan bisnis.

Cara Pengembang Menghadapi Instabilitas Nano Banana Pro

Berdasarkan analisis sebelumnya, berikut adalah empat solusi teknis yang telah teruji:

Solusi 1: Mengimplementasikan Mekanisme Retry dengan Exponential Backoff

import time

import random

def call_nano_banana_with_retry(prompt, max_retries=5):

"""Memanggil API Nano Banana Pro dengan strategi exponential backoff"""

for attempt in range(max_retries):

try:

response = call_api(prompt) # Fungsi panggilan API Anda yang sebenarnya

return response

except Exception as e:

if "503" in str(e) or "429" in str(e):

# Menghitung waktu tunggu: (2 pangkat attempt) + sedikit variasi acak (jitter)

wait_time = (2 ** attempt) + random.uniform(0, 1)

print(f"Menemui error overload, menunggu {wait_time:.2f} detik sebelum mencoba lagi...")

time.sleep(wait_time)

else:

raise e

raise Exception("Telah mencapai batas maksimal percobaan ulang")

Ide Inti: Saat menemui error 503/429, waktu tunggu akan bertambah secara eksponensial (1 detik → 2 detik → 4 detik → 8 detik) untuk menghindari efek thundering herd (lonjakan beban serentak).

Implementasi Tingkat Produksi Lengkap (Klik untuk Membuka)

import time

import random

import logging

from typing import Optional, Dict, Any

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

class NanoBananaClient:

def __init__(self, api_key: str, base_delay: float = 1.0, max_retries: int = 5):

self.api_key = api_key

self.base_delay = base_delay

self.max_retries = max_retries

def generate_image(self, prompt: str, **kwargs) -> Optional[Dict[str, Any]]:

"""Metode pembuatan gambar tingkat produksi dengan penanganan error dan pemantauan lengkap"""

for attempt in range(self.max_retries):

try:

# Logika panggilan API yang sebenarnya

response = self._call_api(prompt, **kwargs)

logger.info(f"Permintaan berhasil (Percobaan {attempt + 1}/{self.max_retries})")

return response

except Exception as e:

error_code = self._parse_error_code(e)

if error_code in [429, 503]:

if attempt < self.max_retries - 1:

wait_time = self._calculate_backoff(attempt)

logger.warning(

f"Error {error_code}: {str(e)[:100]} | "

f"Menunggu {wait_time:.2f}s (Percobaan {attempt + 1}/{self.max_retries})"

)

time.sleep(wait_time)

else:

logger.error(f"Mencapai batas maksimal retry, gagal: {str(e)}")

raise

else:

logger.error(f"Error yang tidak dapat diulang (non-retryable): {str(e)}")

raise

return None

def _calculate_backoff(self, attempt: int) -> float:

"""Menghitung waktu exponential backoff dengan jitter untuk menghindari sinkronisasi retry"""

exponential_delay = self.base_delay * (2 ** attempt)

jitter = random.uniform(0, self.base_delay)

return min(exponential_delay + jitter, 60.0) # Maksimal menunggu 60 detik

def _parse_error_code(self, error: Exception) -> int:

"""Mengekstrak kode status HTTP dari pengecualian (exception)"""

error_str = str(error)

if "429" in error_str or "RESOURCE_EXHAUSTED" in error_str:

return 429

elif "503" in error_str or "overloaded" in error_str:

return 503

return 500

def _call_api(self, prompt: str, **kwargs) -> Dict[str, Any]:

"""Logika panggilan API yang sebenarnya (perlu diganti dengan implementasi asli)"""

# Masukkan kode panggilan API Anda di sini

pass

# Contoh Penggunaan

client = NanoBananaClient(api_key="your_api_key")

result = client.generate_image("seekor kucing lucu sedang bermain piano")

Solusi 2: Kontrol Interval Permintaan

Berdasarkan masukan dari komunitas pengembang, menambahkan jeda tetap 5-10 detik di antara setiap permintaan dapat secara signifikan mengurangi tingkat error 503:

import time

def batch_generate_images(prompts):

"""Menghasilkan gambar secara massal dengan kontrol frekuensi permintaan yang ketat"""

results = []

for i, prompt in enumerate(prompts):

result = call_api(prompt)

results.append(result)

if i < len(prompts) - 1: # Permintaan terakhir tidak perlu menunggu

time.sleep(7) # Jeda tetap 7 detik

return results

Skenario Penggunaan: Aplikasi non-real-time, seperti pembuatan konten massal atau pemrosesan data luring (offline).

Solusi 3: Strategi Pencadangan Multi-cloud

Mengimplementasikan failover otomatis melalui platform API terpadu:

| Langkah | Implementasi Teknis | Efek yang Diharapkan |

|---|---|---|

| 1. Konfigurasi Model Utama & Cadangan | Nano Banana Pro (Utama) + DALL-E 3 (Cadangan) | Toleransi kegagalan pada satu titik layanan |

| 2. Atur Aturan Pengalihan | Error 503 berturut-turut 3 kali → Otomatis pindah ke cadangan | Mengurangi latensi yang dirasakan pengguna |

| 3. Pantau Status Pemulihan | Deteksi kesehatan layanan utama setiap 5 menit | Pemulihan otomatis ke layanan utama |

🎯 Rekomendasi Implementasi: Platform APIYI (apiyi.com) mendukung strategi penjadwalan multi-cloud ini secara bawaan. Anda hanya perlu mengonfigurasi aturan pengalihan di dasbor, dan sistem akan menangani deteksi kegagalan, pengalihan lalu lintas, dan optimasi biaya secara otomatis tanpa perlu mengubah kode aplikasi Anda.

Solusi 4: Upgrade ke Vertex AI atau Platform Kelas Perusahaan

Jika aplikasi Anda memenuhi salah satu kriteria berikut, disarankan untuk mempertimbangkan upgrade:

- Volume pemanggilan API harian > 5.000 kali.

- Memiliki persyaratan SLA waktu respons yang ketat (misal: persentil ke-95 < 10 detik).

- Tidak dapat mentoleransi gangguan layanan (misal: pembuatan gambar e-commerce, moderasi konten real-time).

Perbandingan Biaya:

AI Studio Tier 1: $0.05/gambar (namun sering overload)

Vertex AI: $0.08/gambar (stabil, ada SLA)

Platform APIYI: $0.06/gambar (penjadwalan multi-cloud, toleransi kesalahan otomatis)

Meskipun harga satuan Vertex AI lebih tinggi, jika mempertimbangkan biaya retry, waktu pengembangan, dan kerugian bisnis, TCO (Total Cost of Ownership) yang sebenarnya mungkin jauh lebih rendah.

Tanya Jawab Umum (FAQ)

Q1: Mengapa pengguna berbayar juga mengalami error "model overloaded"?

A: Bottleneck kapasitas Nano Banana Pro terjadi pada lapisan penjadwalan daya komputasi global Google, bukan pada lapisan kuota pengguna. Meskipun Anda adalah pengguna berbayar Tier 3, Anda akan tetap menerima error 503 saat seluruh pusat daya komputasi sedang penuh. Ini berbeda dengan error batas kuota 429 yang biasa kita temui.

Perbedaannya adalah:

- Error 429: Kuota pribadi Anda habis (seperti batasan RPM).

- Error 503: Daya komputasi di sisi server Google tidak mencukupi, tidak ada hubungannya dengan kuota Anda.

Q2: Apakah AI Studio dan Vertex AI memanggil model yang sama?

A: Ya, model dasar Nano Banana Pro (gemini-2.0-flash-preview-image-generation) yang dipanggil keduanya benar-benar sama. Namun, prioritas penjadwalan sumber dayanya berbeda:

- Vertex AI: Memiliki jaminan SLA level enterprise, dengan prioritas alokasi daya komputasi yang lebih tinggi.

- AI Studio: Menggunakan pusat sumber daya bersama (shared resource pool), sehingga ada kemungkinan diturunkan prioritasnya (downgrade) saat jam sibuk.

Ini mirip dengan perbedaan antara server cloud "pay-as-you-go" dengan "reserved instances" yang sudah dipesan sebelumnya.

Q3: Apakah Google akan terus memangkas kuota tingkat gratis (free tier)?

A: Berdasarkan tren historis, Google kemungkinan akan terus menyesuaikan kebijakan tingkat gratis mereka:

- November 2025: Tingkat gratis menjadi 3 gambar/hari.

- 7 Desember 2025: Turun menjadi 2 gambar/hari, versi 2.5 Pro dihapus.

- Januari 2026: RPM diturunkan dari 10 menjadi 5.

Pernyataan resmi Google adalah untuk "memastikan kualitas layanan yang berkelanjutan", namun pada kenyataannya ini adalah upaya mencari keseimbangan antara kontrol biaya dan pertumbuhan pengguna. Disarankan agar aplikasi produksi tidak bergantung pada tingkat gratis; sebaiknya rencanakan skema berbayar atau cadangan multi-cloud sejak awal.

Q4: Kapan stabilitas Nano Banana Pro akan membaik?

A: Menurut informasi publik dari Google, titik waktu krusialnya adalah pertengahan 2026:

- Kuartal 2, 2026: Penyelesaian penerapan skala besar TPU v7 (Ironwood).

- Kuartal 3, 2026: Kapasitas komputasi 1 GW hasil kerja sama dengan Anthropic mulai online.

Pada saat itu, pasokan daya komputasi akan meningkat secara signifikan, meski permintaan juga mungkin tumbuh di saat yang sama. Estimasi konservatifnya, stabilitas baru akan membaik secara substansial pada paruh kedua tahun 2026.

Q5: Bagaimana cara memilih metode akses Nano Banana Pro?

A: Pilih berdasarkan tahap aplikasi Anda:

| Tahap | Solusi yang Direkomendasikan | Alasan |

|---|---|---|

| Pengembangan Prototipe | AI Studio Tingkat Gratis | Biaya terendah, validasi ide dengan cepat |

| Peluncuran Skala Kecil | AI Studio Tier 1 + Mekanisme Retry | Menyeimbangkan biaya dan stabilitas |

| Lingkungan Produksi | Vertex AI atau Platform APIYI | Jaminan SLA, dukungan level enterprise |

| Bisnis Kritis | Strategi Cadangan Multi-cloud (seperti Platform APIYI) | Ketersediaan tertinggi, pengalihan kegagalan (failover) otomatis |

🎯 Saran Keputusan: Jika Anda tidak yakin harus memilih yang mana, disarankan untuk melakukan pengujian A/B melalui platform APIYI apiyi.com. Platform ini memungkinkan Anda membandingkan performa aktual model Nano Banana Pro (AI Studio), Nano Banana Pro (Vertex AI), DALL-E 3, dan model lainnya dalam permintaan yang sama, membantu Anda membuat keputusan berdasarkan data nyata.

Ringkasan: Melihat Tantangan Daya Komputasi Nano Banana Pro Secara Rasional

Masalah stabilitas Nano Banana Pro bukanlah kejadian terisolasi, melainkan cerminan dari kontradiksi antara permintaan dan penawaran daya komputasi yang dihadapi oleh seluruh industri AI:

Kontradiksi Inti:

- Sisi Permintaan: Pertumbuhan eksplosif aplikasi AI generatif, terutama di bidang pembuatan gambar.

- Sisi Penawaran: Peningkatan kapasitas produksi chip yang lambat, serta siklus pembangunan pusat data yang lama (12-18 bulan).

- Model Ekonomi: Strategi tingkat gratis tidak berkelanjutan dalam jangka panjang, namun tingkat konversi ke pengguna berbayar masih rendah.

Tiga Fakta Teknis Utama:

-

Mandiri di TPU ≠ Daya Komputasi Tak Terbatas: Meskipun Google memiliki chip canggih seperti TPU v7, peningkatan produksi, pasokan energi, dan pembangunan pusat data semuanya membutuhkan waktu. Tahun 2026 akan menjadi titik balik yang krusial.

-

Esensi AI Studio vs Vertex AI: Keduanya bukan sekadar hubungan "versi gratis" dan "versi berbayar", melainkan manifestasi dari prioritas penjadwalan sumber daya yang berbeda. Di balik SLA level enterprise Vertex AI, terdapat mekanisme reservasi daya komputasi yang independen.

-

Kondisi Kurang Pasokan Akan Bertahan Lama: Seiring dengan peluncuran model generasi baru seperti Gemini 3.0 dan GPT-5, permintaan daya komputasi akan terus tumbuh. Dalam jangka pendek (2026-2027), ketegangan antara penawaran dan permintaan tidak akan berubah secara fundamental.

Saran Praktis:

- Jangka Pendek: Gunakan metode rekayasa seperti mekanisme retry (mencoba kembali) dan kontrol interval permintaan untuk memitigasi masalah.

- Jangka Menengah: Evaluasi ROI (Return on Investment) untuk upgrade ke Vertex AI atau platform multi-cloud.

- Jangka Panjang: Pantau progres ekspansi daya komputasi Google di pertengahan 2026 dan sesuaikan strategi Anda tepat waktu.

Untuk aplikasi level enterprise, kami sangat menyarankan penggunaan strategi cadangan multi-cloud untuk menghindari risiko kapasitas dari satu vendor saja. Melalui platform terpadu seperti APIYI apiyi.com, Anda bisa mendapatkan kemampuan penjadwalan lintas cloud, failover otomatis, dan optimalisasi biaya tanpa menambah kompleksitas kode Anda.

Pemikiran Akhir: Tantangan pada Nano Banana Pro mengingatkan kita bahwa stabilitas aplikasi AI tidak hanya bergantung pada kemampuan model, tetapi juga pada kematangan infrastruktur yang mendasarinya. Di era di mana daya komputasi adalah segalanya, kekokohan desain arsitektur dan diversifikasi vendor menjadi kunci daya saing produk.

Bacaan Terkait:

- Panduan Penggunaan API Nano Banana Pro

- Analisis Mendalam Arsitektur Google TPU v7

- Cara Memilih API Gambar AI: Nano Banana Pro vs DALL-E 3 vs Stable Diffusion

- 10 Praktik Terbaik Pemanggilan API AI di Lingkungan Produksi