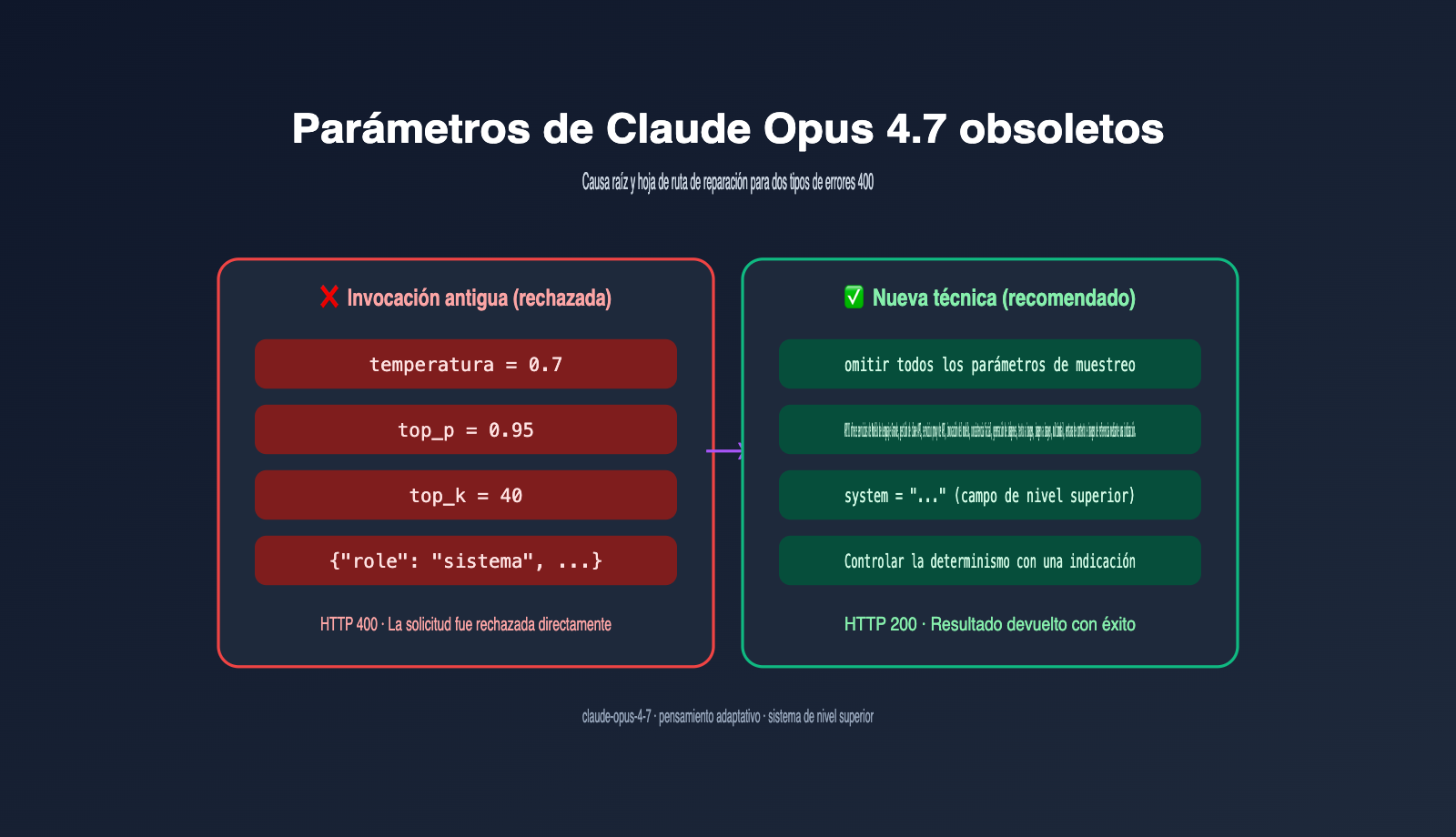

Nota del autor: Claude Opus 4.7 ha dejado obsoletos los parámetros de muestreo como temperature, top_p y top_k, y exige que el system se maneje en el nivel superior en lugar de como un rol dentro de los mensajes. Este artículo explica las causas raíz de los dos errores 400 más comunes y ofrece soluciones de código para corregirlos.

Tras actualizar a Claude Opus 4.7, lo que más suele bloquear a los desarrolladores no es el modelo en sí, sino los parámetros de la solicitud. El primer error frecuente es temperature is deprecated for this model, y el segundo es Unexpected role "system". The Messages API accepts a top-level system parameter, not "system" as an input message role. Ambos errores son HTTP 400 y, aunque parecen no tener relación, apuntan al mismo hecho: Anthropic ha realizado una convergencia de API relativamente agresiva en Opus 4.7.

Muchos equipos, antes de comprender este cambio, suelen recurrir por costumbre a "ajustar la temperatura a 0" o "añadir un mensaje de sistema adicional" como una solución mágica para mejorar la determinismo. Opus 4.7 bloquea directamente ambos caminos. Esta guía explicará a fondo ambos problemas desde las causas, los errores y las soluciones, incluyendo código de migración que puedes copiar directamente. Después de leer esto, no solo podrás resolver tus errores 400 en 10 minutos, sino que también entenderás la lógica profunda detrás de este cambio de diseño de Anthropic, evitando caer en la misma trampa en la próxima actualización del modelo.

Qué parámetros ha dejado obsoletos Claude Opus 4.7

Antes de entender el error, revisemos la "lista de obsolescencia" completa. Los cambios que Anthropic ha realizado en Opus 4.7 son más profundos de lo que parecen y su impacto es mucho mayor que las deprecaciones de la era 4.6.

| Parámetro | Estado | Comportamiento | Alternativa |

|---|---|---|---|

temperature |

Obsoleto | Cualquier valor distinto al predeterminado devuelve 400 | Omitir por completo, controlar la aleatoriedad mediante la indicación |

top_p |

Obsoleto | Igual que el anterior | Omitir por completo |

top_k |

Obsoleto | Igual que el anterior | Omitir por completo |

thinking.budget_tokens |

Eliminado | El presupuesto explícito devuelve 400 | thinking: { type: "adaptive" } |

reasoning_effort (antiguo) |

Eliminado | El campo antiguo ya no funciona | output_config: { effort: "max" } |

role: "system" en mensajes |

No soportado | Siempre ha sido así, pero en 4.7 el error es más estricto | Parámetro system de nivel superior |

🎯 Imprescindible antes de actualizar: Si usas el SDK de Python, cualquier código antiguo que contenga

temperature=0.7,top_p=0.95omessages=[{"role": "system", ...}]lanzará un error 400 en Opus 4.7. Recomendamos acceder a Opus 4.7 a través de APIYI (apiyi.com), ya que la plataforma realiza una degradación elegante de la compatibilidad de parámetros, permitiendo una transición fluida a la nueva interfaz.

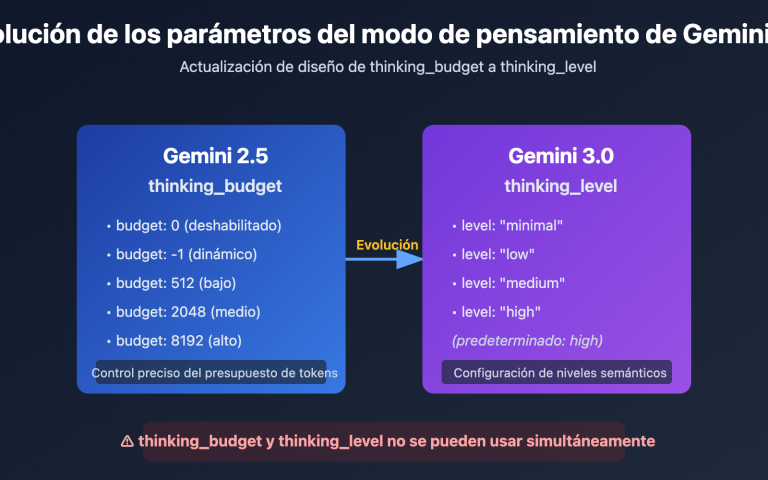

Lo que más fácilmente se pasa por alto en la lista es el parámetro thinking. En la era de Opus 4.6 podías pasar thinking: {"type": "enabled", "budget_tokens": 8000} para que el modelo pensara un poco más, pero en Opus 4.7 este uso es rechazado directamente. La nueva versión solo acepta el tipo adaptive, donde el modelo decide por sí mismo la intensidad del razonamiento; además, el razonamiento adaptativo está desactivado por defecto y debe activarse explícitamente.

Otro cambio oculto es el tokenizador. Opus 4.7 utiliza un nuevo tokenizador, por lo que el número de tokens para el mismo texto en el nuevo modelo será entre un 0% y un 35% mayor que en la versión 4.6. Esto significa que tu presupuesto estimado según la versión 4.6 probablemente sufrirá un "aumento de precio silencioso" en la 4.7, por lo que deberás revisar tus facturas.

Por qué Claude Opus 4.7 ha eliminado el parámetro temperature

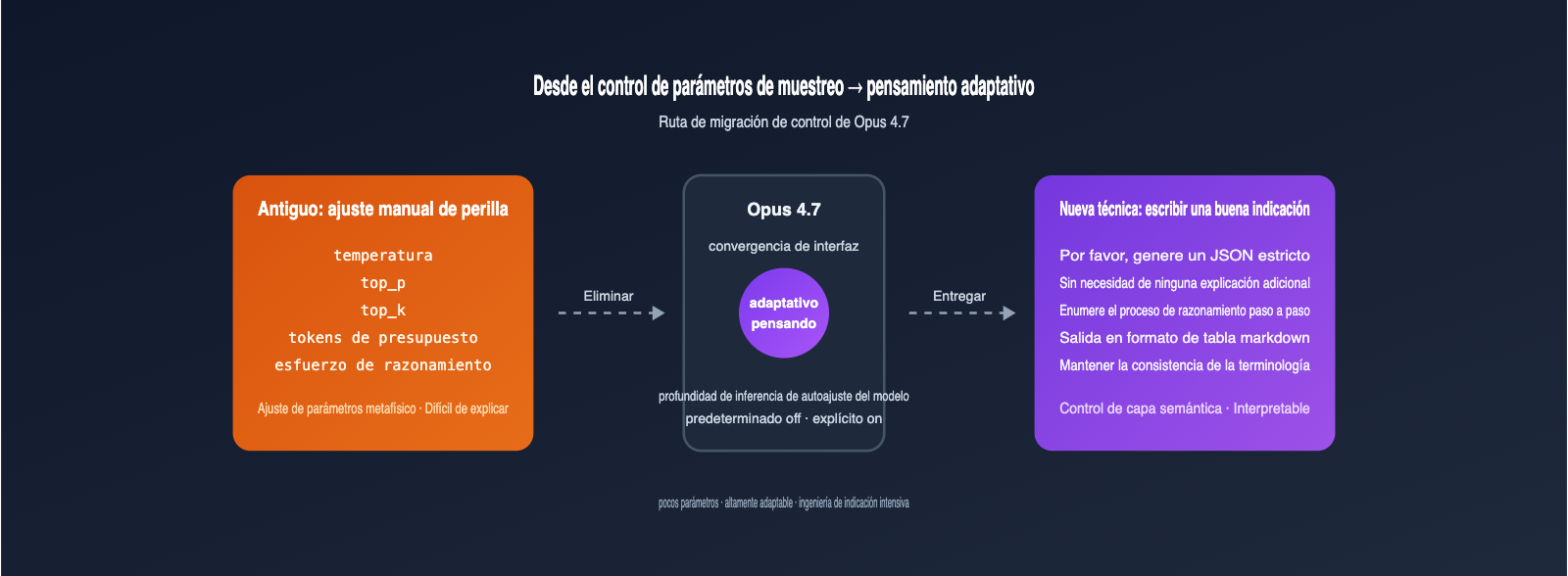

Entender la lógica detrás de este cambio te ahorrará muchos dolores de cabeza. La razón por la que Anthropic ha "retirado" los parámetros de muestreo temperature, top_p y top_k en Opus 4.7 es, en esencia, porque el modelo ha pasado de ser una "caja de herramientas con parámetros ajustables" a una "caja negra autoadaptativa".

Desde la perspectiva de la arquitectura del modelo, Opus 4.7 ha delegado el control de la intensidad del razonamiento al módulo de adaptive thinking, que ya incluye internamente la gestión de la incertidumbre. En otras palabras, los métodos como la temperatura, que "ajustan la aleatoriedad en la capa de muestreo", ya no son compatibles con la lógica de razonamiento interna del modelo; forzar su uso solo terminaría arruinando la ruta de optimización de la nueva versión. Anthropic lo deja claro en su documentación: en sus pruebas internas, el adaptive thinking es consistentemente superior a la combinación de extended thinking con una temperatura ajustada manualmente.

Mirándolo desde otro ángulo, esta eliminación de "perillas" es también una mejora amigable para los principiantes. En el pasado, cuando los desarrolladores ajustaban un Modelo de Lenguaje Grande, era fácil caer en la obsesión metafísica de "¿será que la temperatura no está bien ajustada?", perdiendo tiempo sin encontrar un valor óptimo ni poder explicar las diferencias en los resultados. Opus 4.7 cierra directamente esta ruta de optimización "ambigua", permitiendo que todos centren sus esfuerzos en el diseño de la indicación y la gestión del contexto, que son las áreas que realmente aportan beneficios estables.

Desde el punto de vista de la ingeniería, la eliminación de los tres parámetros de muestreo también significa que Anthropic ya no fomenta la vieja práctica de "depender de la temperatura para mejorar la estabilidad". La recomendación en la nueva versión es utilizar la ingeniería de indicaciones para especificar claramente que "necesitas una respuesta determinista" o "por favor, genera un JSON estricto", permitiendo que el modelo se autolimite en la capa semántica en lugar de intentar controlarlo a la fuerza desde la capa de muestreo. Recomendamos a los equipos que, al utilizar APIYI (apiyi.com) para invocar Opus 4.7, migren gradualmente el código que dependía de temperature=0 hacia una estructura que "exija explícitamente la determinación en el system prompt".

Esta idea contrasta con el "razonamiento de cinco niveles" (reasoning effort) de GPT-5.5. OpenAI ofrece a los desarrolladores interruptores más finos, mientras que Anthropic prefiere "retirar los interruptores y dejar que el modelo se encargue". Ninguna filosofía es mejor que la otra, pero ambas debilitan claramente el papel del ajuste tradicional de hiperparámetros. La mayor lección para los desarrolladores es que el enfoque del ajuste de LLM se desplazará de "girar perillas" a "escribir mejores indicaciones y gestionar el contexto".

Vale la pena mencionar que esta "convergencia radical" de Anthropic no carecía de señales previas. En la era de Opus 4.6, la documentación ya marcaba el extended thinking como obsoleto y sugería a los desarrolladores hacer la transición al adaptive thinking. Si empezaste a escribir código siguiendo las recomendaciones desde entonces, esta actualización a 4.7 será prácticamente indolora; por el contrario, si seguías dependiendo de la vieja estrategia de "subir la temperatura para la creatividad y bajarla para la estabilidad", esta migración será un poco más difícil.

Solución para el error 400 del parámetro temperature

Una vez conocida la causa, la solución es directa. A continuación, presentamos un ejemplo de reparación mínima que, junto con la base_url de APIYI (apiyi.com), te permitirá ejecutarlo de forma estable.

# pip install anthropic

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # Invocación unificada de Opus 4.7 a través de APIYI

)

# ❌ Código antiguo: activará un error 400 (temperature is deprecated)

# response = client.messages.create(

# model="claude-opus-4-7",

# max_tokens=1024,

# temperature=0.7,

# top_p=0.95,

# messages=[{"role": "user", "content": "Hello"}]

# )

# ✅ Código nuevo: se omiten por completo los parámetros de muestreo

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You must return strict JSON. No extra commentary.",

messages=[{"role": "user", "content": "Hello"}]

)

🎯 Consejo de reparación rápida: Cambia la

base_urlahttps://api.apiyi.comy utiliza la clave API compatible con Anthropic proporcionada por APIYI. Solo necesitas eliminar las tres líneas de parámetros de muestreo en tu código antiguo para que funcione. Si te preocupa no poder realizar los cambios de inmediato, APIYI (apiyi.com) realiza una degradación suave de los parámetros obsoletos por defecto, lo que te da un margen de maniobra para tu migración.

La siguiente tabla resume tres posturas típicas de migración para ayudarte a elegir la solución más adecuada.

| Uso antiguo | Nueva postura | Beneficio |

|---|---|---|

temperature=0 para buscar determinación |

Escribir en el system prompt: "devuelve JSON estricto, sin texto extra" | Salida más estable, ahorro de tokens |

temperature=1 para buscar creatividad |

No configurar parámetros de muestreo, dejar que el modelo fluya | Más cercano al rendimiento nativo de 4.7 |

top_p / top_k para limitar el muestreo |

Combinar con effort: "max" del adaptive thinking |

Sustituir el recorte de muestreo por profundidad de razonamiento |

Si utilizas el protocolo compatible con OpenAI (que muchos marcos de terceros usan por defecto), deberás verificar adicionalmente si el SDK está forzando internamente temperature=1.0. Ya hay muchos problemas reportados en la comunidad donde el valor predeterminado codificado en el marco provoca que Opus 4.7 rechace la solicitud; en estos casos, o actualizas el marco o utilizas la capa de compatibilidad de APIYI (apiyi.com).

La esencia del error de rol "system" y cómo solucionarlo

El segundo error 400 más frecuente no tiene nada que ver con la temperature, es un viejo problema que se ha "magnificado" en los nuevos modelos. La API Messages de Anthropic nunca ha permitido definir el rol system dentro de los mensajes, pero mucho código migrado desde OpenAI Chat Completions lo hace por inercia, lo que dispara el error Unexpected role "system".

La clave para entender esto es: Anthropic considera el system como una "configuración de nivel de sesión" y no como "contenido de la conversación". Debe aparecer en el nivel superior del cuerpo de la solicitud, no dentro del array messages. La siguiente tabla compara las diferencias entre OpenAI y Anthropic.

| Proyecto | OpenAI Chat Completions | Anthropic Messages |

|---|---|---|

Ubicación de system |

Primer elemento del array messages |

Campo system en el nivel superior |

Cantidad de system |

Múltiples permitidos | Solo una cadena de texto |

| Error en 4.7 | Ninguno | Unexpected role "system" 400 |

| Dificultad de migración | — | Baja, solo mover la ubicación |

🎯 Consejo de migración: Si tu proyecto tiene una lógica de "doble ejecución OpenAI / Claude", te recomiendo encapsular un adaptador: al llamar a OpenAI, coloca el

systemdentro demessages; al llamar a Claude, muévelo alsystemde nivel superior. Al integrar ambos modelos a través de APIYI (apiyi.com), puedes gestionar ambos con el mismo sistema de claves, evitando configuraciones duplicadas.

La solución es directa. Aquí tienes la comparación entre la forma incorrecta y la correcta; solo tienes que copiarla.

# ❌ Forma incorrecta: dispara el error 400 Unexpected role "system"

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

messages=[

{"role": "system", "content": "You are a coding assistant."},

{"role": "user", "content": "Write a quicksort in Python."}

]

)

# ✅ Forma correcta: el system va como parámetro de nivel superior

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You are a coding assistant.",

messages=[

{"role": "user", "content": "Write a quicksort in Python."}

]

)

Vale la pena añadir que, si realmente necesitas darle a Claude "múltiples instrucciones de sistema", la forma correcta es combinarlas en una sola cadena de texto, separadas por saltos de línea o numeración. El SDK de Anthropic también permite que el campo system sea un array de bloques de contenido, pero eso es un uso avanzado; los principiantes pueden entenderlo simplemente como una "cadena única". Esto tiene una ventaja oculta: al combinarlo en una sola cadena, es más fácil activar el caché de indicaciones de APIYI (apiyi.com), lo que reduce aún más los costos en tareas de larga duración.

Plantilla de código para la migración completa a Claude Opus 4.7

Combinando las soluciones para ambos tipos de errores, el siguiente código es un "punto de partida listo para usar con Opus 4.7", que incluye adaptive thinking, parámetros de nivel superior para system y una estructura optimizada para el ahorro en caché.

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # Llamada a Opus 4.7 a través de APIYI

)

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=2048,

system="You are an expert Python engineer. Always return strict JSON.",

thinking={

"type": "adaptive",

"display": "summarized"

},

messages=[

{"role": "user", "content": "Refactor my quicksort to be O(n log n) average."}

]

)

print(response.content[0].text)

🎯 Recomendación para producción: Al llamar a Opus 4.7 en APIYI (apiyi.com), coloca el system prompt estable y las descripciones de herramientas al principio para activar el ahorro de caché (0.1x), lo que puede reducir el costo de solicitudes repetidas hasta un 10% del precio original. Esto es especialmente útil para agentes de larga ejecución y tareas de generación de documentos.

Al realizar la migración, hay algunos detalles a tener en cuenta. Primero, el campo thinking no es obligatorio, pero si tu tarea es sensible a la profundidad de razonamiento, te recomiendo activar explícitamente el adaptive thinking; de lo contrario, el modelo mantendrá el modo de razonamiento ligero predeterminado. Segundo, dado que el nuevo tokenizer hará que el mismo texto cuente entre un 0% y un 35% más de tokens, el presupuesto de max_tokens debe ajustarse al alza, de lo contrario, podrías sufrir cortes en escenarios de salida larga. Tercero, los parámetros periféricos de versiones anteriores como thinking_budget también deben eliminarse; los campos residuales no generan error, pero son ignorados, lo que puede llevarte a pensar erróneamente que siguen activos. Cuarto, si tu aplicación llama simultáneamente a 4.6 y 4.7, es mejor registrar la facturación por nombre de modelo para evitar que la confusión entre los tokenizers antiguos y nuevos distorsione la atribución de costos.

Si mantienes una base de código que debe ser compatible tanto con Opus 4.6 como con Opus 4.7, lo más seguro es crear una lista blanca de parámetros por nombre de modelo. Omite los "parámetros de muestreo + campos de thinking antiguos" al llamar a 4.7 y mantenlos al llamar a 4.6; así no tendrás que mantener dos funciones de llamada distintas para cada modelo.

La siguiente tabla de consulta rápida de errores resume los errores 400 más comunes durante la actualización a Opus 4.7, para que puedas localizar y solucionar el problema directamente según el texto del error.

| Palabra clave del error | Significado del error | Método de reparación |

|---|---|---|

temperature is deprecated |

Se pasó el campo temperature (obsoleto) |

Eliminar completamente temperature del cuerpo |

top_p is deprecated |

Se pasó el campo top_p (obsoleto) |

Eliminar top_p, dejar que el modelo se adapte |

top_k is deprecated |

Se pasó el campo top_k (obsoleto) |

Eliminar top_k, dejar que el modelo se adapte |

| Unexpected role "system" | system se escribió en el array messages |

Cambiar al campo system de nivel superior |

Invalid budget_tokens |

Se usó presupuesto de extended thinking antiguo | Cambiar a adaptive thinking sin pasar budget |

Unknown parameter reasoning_effort |

Se usó campo de intensidad de razonamiento antiguo | Cambiar a output_config: {effort: "max"} |

Preguntas frecuentes sobre la eliminación de parámetros en Claude Opus 4.7

P1: ¿Por qué Opus 4.7 elimina tantos parámetros de una sola vez?

La razón principal es que el adaptive thinking (pensamiento adaptativo) ha asumido las responsabilidades de "controlar la aleatoriedad y la profundidad de razonamiento", funciones que antes recaían en temperature, top_p, top_k y thinking budget. Las evaluaciones internas de Anthropic muestran que el adaptive thinking supera constantemente al ajuste manual, por lo que decidieron centralizar el control.

P2: ¿Puedo establecer temperature en 1.0 para "evitar" el error?

No. La validación de Opus 4.7 para los parámetros de muestreo comprueba "si se han enviado", no "qué valor tienen". Si el cuerpo de la solicitud contiene esta clave, se identifica como una configuración no predeterminada y devuelve un error 400. La forma correcta es omitir completamente este campo en la solicitud y dejar que el SDK utilice el comportamiento de muestreo predeterminado del modelo.

P3: ¿El uso del SDK de OpenAI a través de APIYI para invocar a Opus 4.7 provocará un error de temperature?

Depende de la versión del SDK y del marco de trabajo subyacente. El SDK de OpenAI incluye temperature=1.0 por defecto; si se reenvía directamente al backend de Anthropic, Opus 4.7 lo rechazará. Al realizar la invocación a través de APIYI (apiyi.com), la plataforma gestiona de forma elegante este tipo de problemas de compatibilidad comunes, filtrando automáticamente los campos obsoletos.

P4: ¿El error de system solo ocurre en la versión 4.7? ¿Los modelos Claude anteriores no lo tenían?

No es así. La API de mensajes de Anthropic nunca ha permitido incluir system dentro del array messages, pero la validación de Opus 4.7 es más estricta; algunos modelos anteriores podían ser "más permisivos". La mejor práctica siempre ha sido colocar system en el nivel superior del cuerpo de la solicitud. Tras migrarlo a la parte superior, todos los modelos Claude funcionarán correctamente.

P5: Si migro código desde OpenAI, ¿cuántas líneas debo cambiar como mínimo para ejecutar Opus 4.7?

Normalmente tres: 1) cambiar model a claude-opus-4-7; 2) mover la entrada system dentro de messages al campo system de nivel superior; 3) eliminar los parámetros de muestreo como temperature o top_p. Al cambiar la base_url a https://api.apiyi.com, el proyecto suele estar listo en menos de 10 minutos. Si tu proyecto tiene decenas de puntos de llamada, te sugiero encapsular una función de utilidad call_claude() para centralizar estos cambios y facilitar futuras actualizaciones de la API.

P6: ¿El adaptive thinking está activado por defecto? ¿Debo activarlo explícitamente?

Está desactivado por defecto. Si tu tarea requiere una gran profundidad de razonamiento (razonamiento matemático, refactorización de código, planificación compleja), te recomiendo pasar explícitamente thinking: {type: "adaptive"}. Puedes combinarlo con output_config: {effort: "max"} para obtener la máxima capacidad de pensamiento, a costa de un mayor consumo de tokens; deberás equilibrar la calidad y el costo.

P7: ¿Es estable la invocación de Opus 4.7 desde China?

La conexión directa a la interfaz de Anthropic puede verse afectada por el entorno de red, lo que provoca desconexiones frecuentes en tareas largas. Invocar a Opus 4.7 a través de APIYI (apiyi.com) resuelve los problemas de estabilidad de acceso local, ofreciendo una plataforma estable y, además, permitiendo reducir costos significativamente mediante el uso de caché con facturación de 0.1x.

P8: ¿Cuánto aumenta el costo con el nuevo tokenizador? ¿Cómo puedo gestionarlo?

La tasa de expansión del nuevo tokenizador en diferentes textos oscila entre el 0% y el 35%, con un promedio del 10% al 15%. La estrategia más práctica es priorizar el almacenamiento en caché de los system prompts y las descripciones de herramientas, activando la facturación de caché de 0.1x; de esta forma, el costo unitario disminuirá en lugar de aumentar.

Puntos clave sobre la eliminación de parámetros en Claude Opus 4.7

- Opus 4.7 elimina por completo los tres parámetros de muestreo:

temperature,top_pytop_k. Cualquier valor enviado provocará un error 400. - Se ha eliminado el extended thinking; ahora solo se admite adaptive thinking, el cual está desactivado por defecto y debe habilitarse explícitamente.

Unexpected role "system"es una regla histórica de la API de mensajes;systemdebe ir en el nivel superior y no como un rol dentro de los mensajes.- El nuevo tokenizador hace que el número de tokens para el mismo texto sea entre un 0% y un 35% mayor que en la versión 4.6, por lo que se deben recalcular el presupuesto y los

max_tokens. - La corrección mínima requiere solo tres pasos: eliminar los parámetros de muestreo, mover

systemal nivel superior y cambiar el nombre del modelo aclaude-opus-4-7. - Invocar a Opus 4.7 a través de APIYI (apiyi.com) permite disfrutar de una degradación elegante de parámetros, facturación de caché de 0.1x y una conexión estable desde China.

- El uso de adaptive thinking junto con

output_config: {effort: "max"}es la forma estándar de obtener la máxima capacidad de razonamiento en Opus 4.7.

Resumen

La eliminación de parámetros en Claude Opus 4.7 puede parecer un "cambio disruptivo", pero en realidad es un paso clave en la evolución de Anthropic: pasar de un modelo que es una "herramienta con detalles expuestos" a una "caja negra adaptativa". Para los desarrolladores, esto significa que la estabilidad que antes se lograba ajustando "interruptores" como temperature o thinking budget debe migrar gradualmente hacia una combinación de ingeniería de indicaciones y pensamiento adaptativo. A corto plazo, esto implica costes de migración, pero a largo plazo resultará en un código más limpio y un rendimiento del modelo más estable. Esta trayectoria evolutiva no es un caso aislado; los principales Modelos de Lenguaje Grande se dirigen hacia una dirección de "menos parámetros, mayor autoadaptación", y cuanto antes te adaptes, mayores serán las ventajas.

Si estás actualizando a Opus 4.7 o evaluando el impacto de este cambio en tu entorno de producción, te recomendamos probar la nueva versión en APIYI (apiyi.com). La plataforma ya ofrece soporte estable para Opus 4.7 y ha implementado una degradación compatible para los parámetros obsoletos. Además, al combinarlo con el almacenamiento en caché a una tarifa de 0.1x, obtendrás la ruta de migración más accesible actualmente.

Esperamos que evites complicaciones y termines tu jornada a tiempo.

— Equipo técnico de APIYI, encuentra más tutoriales prácticos sobre modelos de IA en APIYI apiyi.com