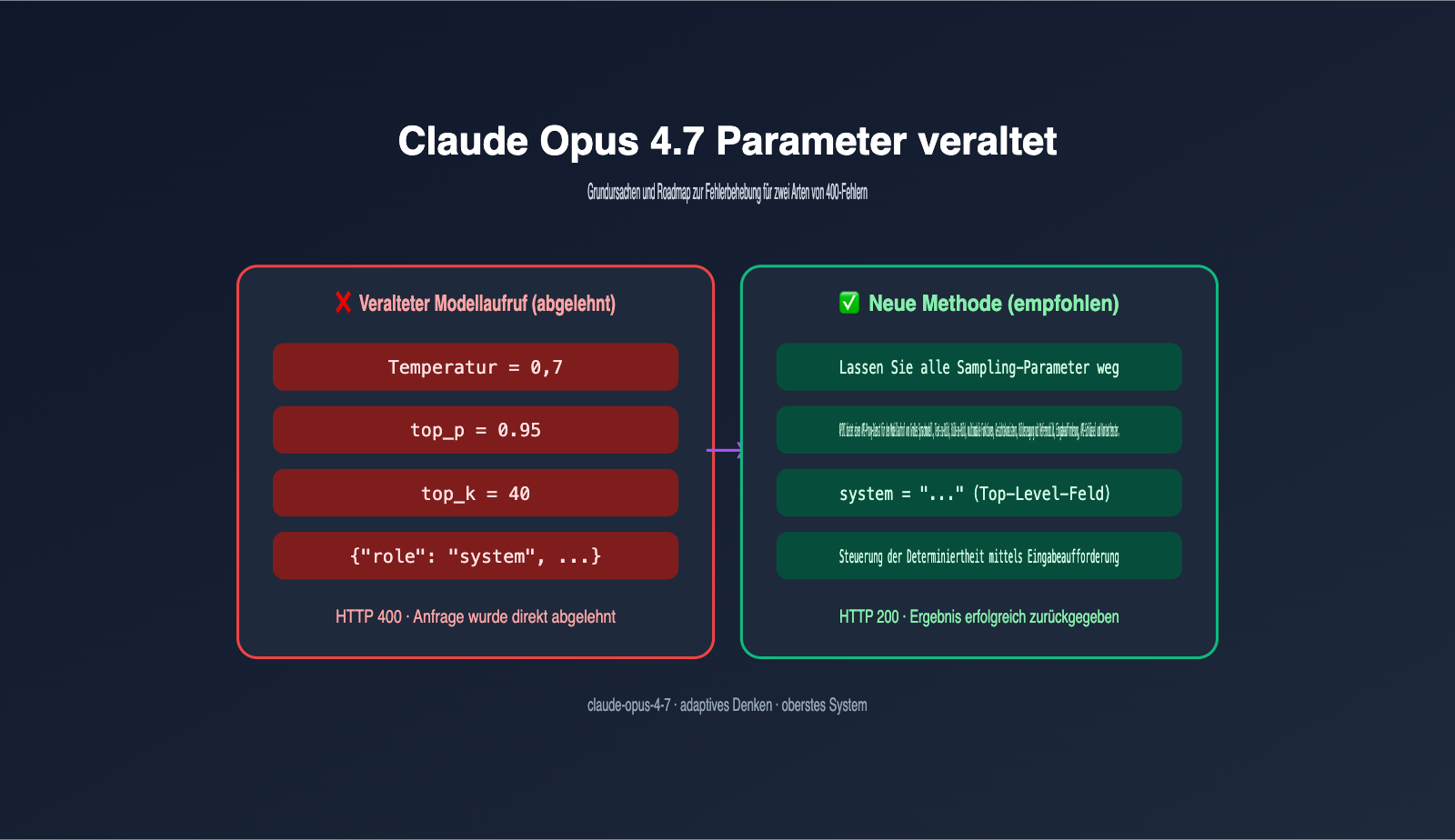

Anmerkung des Autors: Claude Opus 4.7 hat die Sampling-Parameter temperature, top_p und top_k abgeschafft und verlangt, dass system-Anweisungen auf der obersten Ebene und nicht als Nachrichtenrolle übergeben werden. Dieser Artikel erläutert die Grundursachen für die zwei häufigsten 400-Fehler und bietet Lösungen für den Code.

Nach dem Upgrade auf Claude Opus 4.7 ist für Entwickler oft nicht das Modell selbst die größte Hürde, sondern die Anfrageparameter. Der erste häufige Fehler ist temperature is deprecated for this model, der zweite lautet Unexpected role "system". The Messages API accepts a top-level system parameter, not "system" as an input message role. Beide Fehler führen zu einem HTTP 400. Auch wenn sie unterschiedlich aussehen, weisen sie auf dieselbe Tatsache hin: Anthropic hat mit Opus 4.7 eine relativ aggressive API-Konsolidierung durchgeführt.

Viele Teams, die diese Änderung nicht genau geprüft haben, neigen dazu, die "Temperatur auf 0 zu stellen" oder "eine weitere System-Nachricht hinzuzufügen", um die Vorhersehbarkeit zu erhöhen. Opus 4.7 blockiert diese Wege direkt. Dieser Leitfaden erklärt die Hintergründe, die Fehlermeldungen und die Korrekturen aus drei Perspektiven und enthält Migrationscode, den Sie direkt kopieren können. Nach dem Lesen werden Sie nicht nur Ihre 400-Fehler innerhalb von 10 Minuten beheben können, sondern auch die tiefere Logik hinter dieser Designänderung von Anthropic verstehen, um bei zukünftigen Modell-Upgrades keine Fehler mehr zu machen.

Welche Parameter wurden in Claude Opus 4.7 abgeschafft?

Bevor Sie die Fehlermeldungen verstehen, werfen Sie einen Blick auf die vollständige "Liste der veralteten Funktionen". Die Änderungen, die Anthropic bei Opus 4.7 vorgenommen hat, sind weitreichender, als sie auf den ersten Blick erscheinen, und die Auswirkungen sind deutlich größer als bei den Veraltungen in der 4.6-Ära.

| Parameter | Status | Verhalten | Alternative |

|---|---|---|---|

temperature |

Abgeschafft | Jeder Wert außer dem Standard führt zu 400 | Komplett weglassen, Zufälligkeit über die Eingabeaufforderung steuern |

top_p |

Abgeschafft | Wie oben | Komplett weglassen |

top_k |

Abgeschafft | Wie oben | Komplett weglassen |

thinking.budget_tokens |

Entfernt | Explizites Budget führt zu 400 | thinking: { type: "adaptive" } |

reasoning_effort (alt) |

Entfernt | Altes Feld ist nicht mehr wirksam | output_config: { effort: "max" } |

role: "system" in Nachrichten |

Nicht unterstützt | War schon immer so, aber in 4.7 strengere Fehlermeldung | Oberster system-Parameter |

🎯 Wichtig vor dem Upgrade: Wenn Sie das Python SDK verwenden und in Ihrem alten Code

temperature=0.7,top_p=0.95odermessages=[{"role": "system", ...}]vorkommen, wird Opus 4.7 einen 400-Fehler ausgeben. Wir empfehlen, Opus 4.7 über den API-Proxy-Dienst APIYI (apiyi.com) anzubinden. Die Plattform bietet eine elegante Abwärtskompatibilität für Parameter, sodass Sie reibungslos auf die neue Schnittstelle umsteigen können.

Der am leichtesten zu übersehende Punkt in der Liste ist der thinking-Parameter. In der Ära von Opus 4.6 konnten Sie thinking: {"type": "enabled", "budget_tokens": 8000} übergeben, damit das Modell länger nachdenkt, aber bei Opus 4.7 wird diese Verwendung direkt abgelehnt. Die neue Version akzeptiert nur den Typ adaptive, bei dem das Modell die Intensität des logischen Denkens selbst bestimmt. Zudem ist das adaptive Denken standardmäßig deaktiviert und muss explizit aktiviert werden.

Eine weitere versteckte Änderung betrifft den Tokenizer. Opus 4.7 verwendet einen neuen Tokenizer; derselbe Text kann im neuen Modell 0 % bis 35 % mehr Token verbrauchen als in 4.6. Das bedeutet, dass Ihr auf 4.6 basierendes Kostenbudget bei 4.7 wahrscheinlich "stillschweigend teurer" wird und Sie Ihre Abrechnung überprüfen sollten.

Warum Claude Opus 4.7 den temperature-Parameter entfernt hat

Das Verständnis der Logik hinter dieser Änderung erspart Ihnen viele Probleme. Dass Anthropic bei Opus 4.7 die drei Sampling-Parameter temperature, top_p und top_k „zurückgezogen“ hat, liegt im Grunde daran, dass das Modell von einer „Bibliothek mit einstellbaren Parametern“ zu einer „selbstanpassenden Blackbox“ geworden ist.

Aus Sicht der Modellarchitektur hat Opus 4.7 die Kontrolle über die Inferenzintensität an das Adaptive Thinking-Modul übergeben. Dieses Modul enthält bereits eine interne Steuerung für Unsicherheiten. Das bedeutet, dass Methoden wie die „Temperatur“, die die Zufälligkeit auf der Sampling-Ebene regulieren, nicht mehr mit der internen Inferenzlogik des Modells kompatibel sind. Ein erzwungenes Setzen dieser Werte würde den Optimierungspfad der neuen Version sogar stören. Anthropic stellt in der Dokumentation klar: In internen Tests ist Adaptive Thinking stabil und überlegen gegenüber der Kombination aus Extended Thinking und manueller Temperatursteuerung.

Betrachtet man es aus einem anderen Blickwinkel, ist das „Entfernen der Stellschrauben“ auch ein freundliches Upgrade für Einsteiger. Früher verfielen Entwickler bei der LLM-Optimierung oft in eine Art „Voodoo-Zauber“, bei dem sie sich fragten, ob die Temperatur falsch eingestellt sei – ohne jemals einen optimalen Wert zu finden oder Ergebnisunterschiede erklären zu können. Opus 4.7 schließt diesen „pseudo-optimierenden“ Pfad direkt und ermöglicht es allen, ihre Energie auf das Design von Eingabeaufforderungen und das Kontextfenster-Management zu konzentrieren – Dinge, die wirklich zu stabilen Ergebnissen führen.

Aus der Praxis bedeutet der Wegfall der drei Sampling-Parameter auch, dass Anthropic die alte Methode, „Stabilität durch Temperatur-Anpassung zu erzwingen“, nicht mehr unterstützt. Der empfohlene Ansatz der neuen Version ist es, mittels Prompt-Engineering klar zu definieren: „Du benötigst deterministische Antworten“, „Bitte gib striktes JSON aus“ usw. Das Modell soll sich auf semantischer Ebene selbst einschränken, anstatt auf Sampling-Ebene hart kontrolliert zu werden. Wir empfehlen Teams, die Opus 4.7 über APIYI (apiyi.com) aufrufen, den Code, der bisher auf temperature=0 basierte, schrittweise auf eine Schreibweise umzustellen, die „Determiniertheit explizit in der System-Eingabeaufforderung fordert“.

Dieser Ansatz steht im Kontrast zu den „fünf Stufen des Reasoning Effort“ von GPT-5.5. OpenAI bietet Entwicklern feinere Schalter, während Anthropic die Schalter zurücknimmt und sie dem Modell selbst überlässt. Beide Philosophien haben ihre Berechtigung, aber beide schwächen die Rolle des traditionellen Hyperparameter-Tunings deutlich ab. Die wichtigste Erkenntnis für Entwickler ist: Der Schwerpunkt beim LLM-Tuning verlagert sich vom „Drehen an Knöpfen“ hin zum „Schreiben besserer Eingabeaufforderungen und Kontextverwaltung“.

Erwähnenswert ist, dass diese „radikale Konvergenz“ von Anthropic nicht ohne Vorankündigung kam. Bereits in der Ära von Opus 4.6 wurde Extended Thinking in der Dokumentation als veraltet markiert und Entwicklern der Übergang zu Adaptive Thinking nahegelegt. Wer damals schon mit dem empfohlenen Ansatz programmiert hat, für den ist das Upgrade auf 4.7 fast kostenlos. Wer hingegen immer noch auf die alte Methode „hohe Temperatur für Kreativität, niedrige für Stabilität“ gesetzt hat, für den wird dieser Umstieg etwas schmerzhaft sein.

Lösung für den 400-Fehler beim temperature-Parameter

Sobald die Ursache bekannt ist, ist die Fehlerbehebung direkt. Hier ist ein minimales Beispiel, das in Verbindung mit der base_url von APIYI (apiyi.com) im Inland stabil läuft.

# pip install anthropic

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # Einheitlicher Aufruf von Opus 4.7 über APIYI

)

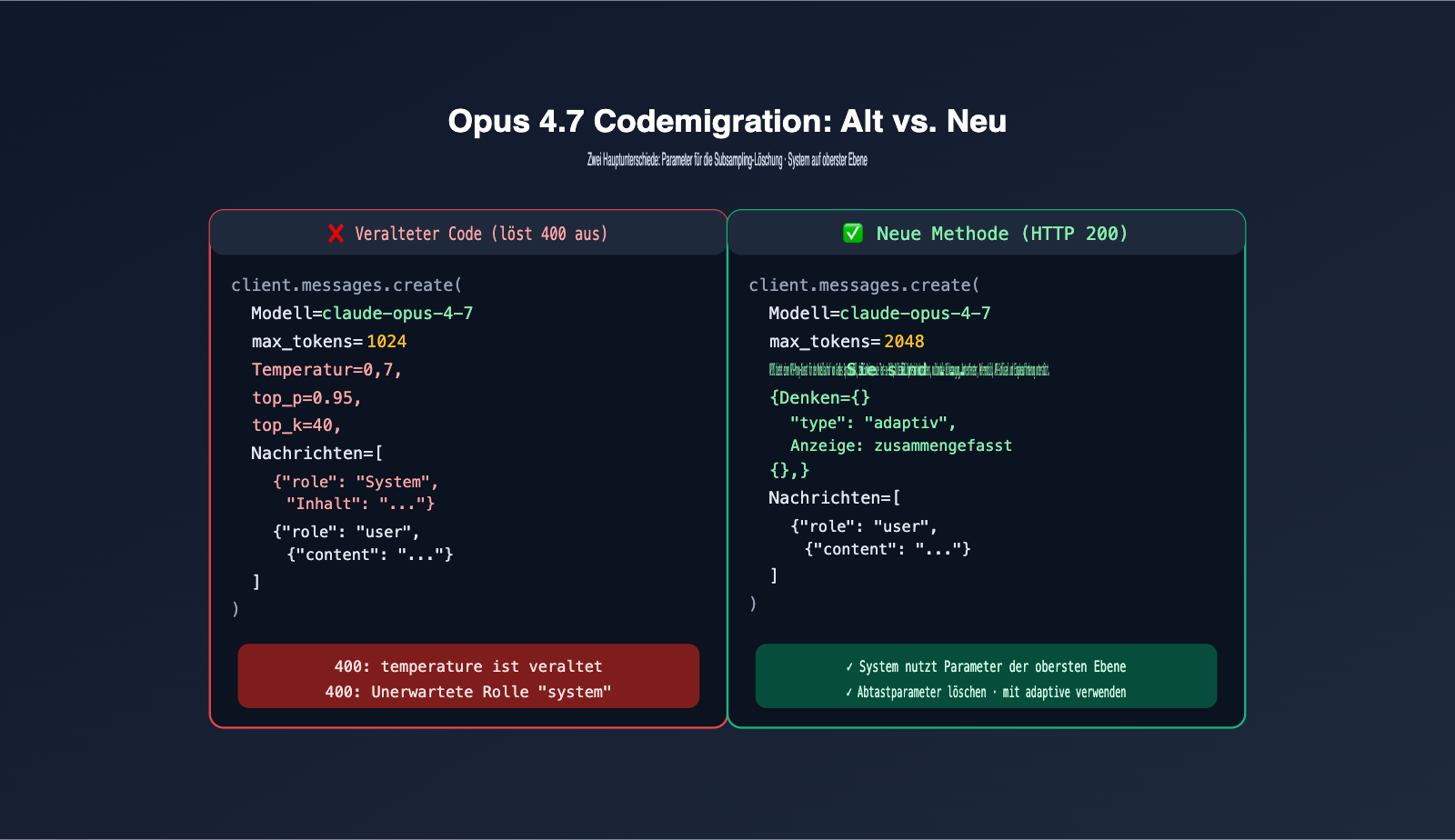

# ❌ Alter Code: Löst einen 400-Fehler aus (temperature is deprecated)

# response = client.messages.create(

# model="claude-opus-4-7",

# max_tokens=1024,

# temperature=0.7,

# top_p=0.95,

# messages=[{"role": "user", "content": "Hello"}]

# )

# ✅ Neuer Code: Sampling-Parameter komplett weglassen

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You must return strict JSON. No extra commentary.",

messages=[{"role": "user", "content": "Hello"}]

)

🎯 Schnelle Empfehlung: Stellen Sie die

base_urlaufhttps://api.apiyi.comum und verwenden Sie den Anthropic-kompatiblen Schlüssel von APIYI (apiyi.com). Im alten Code müssen lediglich die drei Zeilen mit den Sampling-Parametern gelöscht werden. Falls Sie Bedenken wegen der Umstellung haben: APIYI (apiyi.com) führt standardmäßig ein sanftes Downgrade für veraltete Parameter durch, um Ihnen einen Puffer für die Migration zu geben.

Die folgende Tabelle fasst drei typische Migrationsansätze zusammen, um Ihnen bei der Auswahl der besten Lösung zu helfen.

| Alte Methode | Neue Vorgehensweise | Nutzen |

|---|---|---|

temperature=0 für Determiniertheit |

System-Prompt: "Gib striktes JSON zurück, kein zusätzlicher Text" | Stabilere Ausgabe, weniger Token |

temperature=1 für Kreativität |

Keine Sampling-Parameter setzen, Modell frei agieren lassen | Näher an der nativen Leistung von 4.7 |

top_p / top_k zur Sampling-Begrenzung |

In Kombination mit effort: "max" im Adaptive Thinking |

Inferenz-Tiefe statt Sampling-Zuschnitt |

Falls Sie das OpenAI-kompatible Protokoll verwenden (viele Drittanbieter-Frameworks nutzen dies standardmäßig), sollten Sie zusätzlich prüfen, ob das SDK im Hintergrund hart temperature=1.0 einfügt. In der Community gibt es bereits viele Issues, bei denen Frameworks Standardwerte hart codieren, was dazu führt, dass Opus 4.7 die Anfrage ablehnt. In solchen Fällen sollten Sie entweder das Framework aktualisieren oder die Kompatibilitätsschicht von APIYI (apiyi.com) nutzen.

Die Essenz des „System“-Rollenfehlers und seine Behebung

Der zweite häufige 400-Fehler hat nichts mit der temperature zu tun. Es ist ein altes Problem, das bei neuen Modellen „wieder verstärkt“ auftritt. Die Messages API von Anthropic hat es noch nie unterstützt, system als Nachrichtenrolle zu definieren. Viele Entwickler, die von der OpenAI Chat Completions API migrieren, schreiben dies jedoch intuitiv so, was den Fehler Unexpected role "system" auslöst.

Der Schlüssel zum Verständnis: Anthropic betrachtet system als „Konfigurationsparameter auf Sitzungsebene“ und nicht als Teil des „Dialoginhalts“. Er muss auf der obersten Ebene des Request-Bodys stehen, nicht im messages-Array. Die folgende Tabelle zeigt die Unterschiede zwischen OpenAI und Anthropic:

| Element | OpenAI Chat Completions | Anthropic Messages |

|---|---|---|

Position von system |

Erstes Element im messages-Array |

system-Feld auf oberster Ebene |

Anzahl system |

Mehrere möglich | Nur ein String |

| Fehler bei 4.7 | Keiner | Unexpected role "system" (400) |

| Migrationsaufwand | — | Gering, nur Verschieben der Position |

🎯 Migrationstipp: Falls Ihr Projekt eine „OpenAI / Claude“-Dual-Logik verwendet, empfiehlt sich ein Adapter: Bei OpenAI-Aufrufen wird

systemin dasmessages-Array verschoben, bei Claude-Aufrufen in das oberstesystem-Feld. Durch die Anbindung über APIYI (apiyi.com) können Sie beide Modelle mit demselben Schlüssel-System verwalten und doppelte Konfigurationen vermeiden.

Die Fehlerbehebung ist sehr direkt. Hier ist der Vergleich zwischen der fehlerhaften und der korrekten Schreibweise:

# ❌ Fehlerhaft: Löst Unexpected role "system" 400 aus

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

messages=[

{"role": "system", "content": "You are a coding assistant."},

{"role": "user", "content": "Write a quicksort in Python."}

]

)

# ✅ Korrekt: system als Parameter auf oberster Ebene

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You are a coding assistant.",

messages=[

{"role": "user", "content": "Write a quicksort in Python."}

]

)

Ein wichtiger Hinweis: Wenn Sie Claude tatsächlich „mehrere System-Anweisungen“ geben möchten, ist der richtige Weg, diese zu einem einzigen String zusammenzufügen, getrennt durch Zeilenumbrüche oder Nummerierungen. Das Anthropic SDK unterstützt zwar auch Inhaltsblöcke für das system-Feld, aber für Einsteiger reicht das Verständnis als „einzelner String“ völlig aus. Ein versteckter Vorteil: Als einzelner String lässt sich das Prompt-Caching von APIYI (apiyi.com) leichter auslösen, was die Kosten bei langen Aufgaben weiter senkt.

Vollständige Migrationsvorlage für Claude Opus 4.7

Die folgende Vorlage kombiniert die Korrekturen beider Fehlertypen und dient als „Startpunkt für Opus 4.7“, inklusive adaptivem Denken (Thinking), system-Parameter auf oberster Ebene und einer für das Caching optimierten Struktur.

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # Aufruf von Opus 4.7 über APIYI

)

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=2048,

system="You are an expert Python engineer. Always return strict JSON.",

thinking={

"type": "adaptive",

"display": "summarized"

},

messages=[

{"role": "user", "content": "Refactor my quicksort to be O(n log n) average."}

]

)

print(response.content[0].text)

🎯 Empfehlung für die Produktion: Wenn Sie Opus 4.7 über APIYI (apiyi.com) aufrufen, platzieren Sie den stabilen

system-Prompt und die Tool-Beschreibungen am Anfang. Dies löst eine Cache-Abrechnung von 0,1x aus und kann die Kosten für wiederholte Anfragen auf 10 % des Originalpreises senken. Dies ist besonders vorteilhaft für langlebige Agenten und Aufgaben zur Dokumentenerstellung.

Bei der tatsächlichen Migration gibt es noch einige Details zu beachten. Erstens: Das thinking-Feld ist nicht zwingend erforderlich, aber wenn Ihre Aufgabe eine hohe logische Tiefe erfordert, sollten Sie das adaptive Denken explizit aktivieren, da das Modell sonst im standardmäßigen, leichtgewichtigen Modus bleibt. Zweitens: Da der neue Tokenizer bei gleichem Text 0 % bis 35 % mehr Token berechnet, sollte das max_tokens-Budget entsprechend angepasst werden, um bei langen Ausgaben keine vorzeitigen Abbrüche zu riskieren. Drittens: Veraltete Parameter wie thinking_budget sollten entfernt werden; sie lösen zwar keinen Fehler aus, werden aber ignoriert, was zu der falschen Annahme führen kann, sie seien noch aktiv. Viertens: Wenn Ihre Anwendung sowohl 4.6 als auch 4.7 aufruft, sollten Sie die Abrechnung nach Modellnamen trennen, um Verzerrungen durch unterschiedliche Tokenizer-Logiken zu vermeiden.

Wenn Sie eine Codebasis pflegen, die sowohl Opus 4.6 als auch Opus 4.7 unterstützen muss, ist der sicherste Weg eine Whitelist für Parameter basierend auf dem Modellnamen. Überspringen Sie „Sampling-Parameter + alte Thinking-Felder“ bei 4.7 und behalten Sie diese bei 4.6 bei, damit Sie nicht zwei separate Aufruffunktionen für verschiedene Modelle pflegen müssen.

Die folgende Tabelle fasst die häufigsten 400-Fehler während des Upgrades auf Opus 4.7 zusammen, damit Sie diese anhand der Fehlermeldung direkt lokalisieren und beheben können.

| Fehler-Schlüsselwort | Bedeutung | Behebung |

|---|---|---|

temperature is deprecated |

Veraltetes Feld temperature übergeben |

temperature vollständig aus dem Request-Body entfernen |

top_p is deprecated |

Veraltetes Feld top_p übergeben |

top_p entfernen, Modell passt sich selbst an |

top_k is deprecated |

Veraltetes Feld top_k übergeben |

top_k entfernen, Modell passt sich selbst an |

| Unexpected role "system" | system im messages-Array platziert |

In das oberste system-Feld verschieben |

Invalid budget_tokens |

Altes extended thinking-Budget verwendet |

Auf adaptive thinking umstellen (kein Budget-Parameter) |

Unknown parameter reasoning_effort |

Altes Feld für logische Intensität verwendet | Auf output_config: {effort: "max"} umstellen |

Häufige Fragen zur Einstellung von Parametern bei Claude Opus 4.7

F1: Warum schafft Opus 4.7 so viele Parameter auf einmal ab?

Der Hauptgrund ist, dass das „adaptive thinking“ die Verantwortung für die Steuerung von Zufälligkeit und Schlussfolgerungstiefe übernommen hat, die zuvor individuell von temperature, top_p, top_k und dem thinking budget getragen wurde. Interne Evaluierungen bei Anthropic zeigen, dass „adaptive thinking“ die manuelle Parameteranpassung konstant übertrifft, weshalb man sich dazu entschieden hat, die Schnittstellen zu vereinheitlichen.

F2: Kann ich temperature auf 1.0 setzen, um die Fehlermeldung zu „umgehen“?

Nein. Opus 4.7 prüft bei den Sampling-Parametern nicht den Wert, sondern ob sie überhaupt übermittelt wurden. Sobald dieser Schlüssel im Request-Body auftaucht, wird er als Nicht-Standard-Konfiguration erkannt und mit einem 400-Fehler quittiert. Der korrekte Weg ist, das Feld im Request komplett wegzulassen, damit das SDK das Standardverhalten des Modells für das Sampling nutzt.

F3: Löst die Verwendung des OpenAI SDK über APIYI für Opus 4.7 einen temperature-Fehler aus?

Das hängt von der SDK-Version und dem verwendeten Framework ab. Das OpenAI SDK fügt standardmäßig temperature=1.0 hinzu. Wenn dies direkt an das Anthropic-Backend weitergeleitet wird, wird es von Opus 4.7 weiterhin abgelehnt. Bei einem Aufruf über APIYI (apiyi.com) hat die Plattform diese Art von Kompatibilitätsproblemen bereits elegant gelöst und filtert die veralteten Felder automatisch heraus.

F4: Tritt der system-Fehler nur bei 4.7 auf? War das bei früheren Claude-Modellen nicht der Fall?

Nicht unbedingt. Die Anthropic Messages API hat es noch nie erlaubt, system in das messages-Array zu schreiben, aber die Validierung bei Opus 4.7 ist nun strenger. Einige frühere Modelle waren hier „toleranter“. Die bewährte Methode (Best Practice) ist es jedoch immer, system auf der obersten Ebene des Request-Bodys zu platzieren. Nach der Migration auf die oberste Ebene funktionieren alle Claude-Modelle einwandfrei.

F5: Wie viele Zeilen Code muss ich mindestens ändern, um von OpenAI auf Opus 4.7 zu migrieren?

Normalerweise sind es drei Stellen: 1) model auf claude-opus-4-7 ändern; 2) den system-Eintrag aus messages in das oberste system-Feld verschieben; 3) Sampling-Parameter wie temperature oder top_p löschen. Wenn Sie die base_url auf https://api.apiyi.com umstellen, ist das gesamte Projekt meist in 10 Minuten einsatzbereit. Falls Ihr Projekt Dutzende von Aufrufstellen hat, empfiehlt es sich, eine zentrale Hilfsfunktion call_claude() zu erstellen, um diese drei Änderungen zu bündeln – so müssen Sie bei zukünftigen API-Änderungen nur an einer Stelle anpassen.

F6: Ist „adaptive thinking“ standardmäßig aktiviert? Muss ich es explizit einschalten?

Es ist standardmäßig deaktiviert. Wenn Ihre Aufgabe eine hohe Schlussfolgerungstiefe erfordert (mathematische Herleitungen, Code-Refactoring, komplexe Planung), sollten Sie explizit thinking: {type: "adaptive"} übergeben. In Kombination mit output_config: {effort: "max"} erhalten Sie die maximale Denkfähigkeit. Der Preis dafür ist ein höherer Token-Verbrauch, was eine Abwägung zwischen Qualität und Kosten erfordert.

F7: Ist der Aufruf von Opus 4.7 innerhalb Chinas stabil?

Direkte Verbindungen zur Anthropic-Schnittstelle können durch die Netzwerkumgebung beeinträchtigt werden, was besonders bei lang laufenden Aufgaben zu Verbindungsabbrüchen führt. Die Nutzung von Opus 4.7 über APIYI (apiyi.com) löst dieses Stabilitätsproblem. Die Plattform läuft stabil und ermöglicht zudem durch die Cache-Abrechnung von 0,1x eine deutliche Kostensenkung.

F8: Wie stark steigen die Kosten durch den neuen Tokenizer und wie gehe ich damit um?

Die Ausdehnung des neuen Tokenizers variiert je nach Text zwischen 0 % und 35 %, im Durchschnitt etwa 10 % bis 15 %. Der effektivste Weg, damit umzugehen, ist das Voranstellen von cachebaren System-Prompts und Tool-Beschreibungen, um die Cache-Abrechnung von 0,1x auszulösen. Dadurch sinken die Kosten pro Aufruf effektiv, anstatt zu steigen.

Kernpunkte zur Parameter-Einstellung bei Claude Opus 4.7

- Opus 4.7 schafft die drei Sampling-Parameter

temperature,top_pundtop_kvollständig ab; die Übermittlung beliebiger Werte führt zu einem 400-Fehler. - „Extended thinking“ wurde entfernt; es wird nur noch „adaptive thinking“ unterstützt, welches standardmäßig deaktiviert ist und explizit aktiviert werden muss.

Unexpected role "system"ist eine historische Regel der Messages API;systemmuss auf der obersten Ebene stehen, nicht als Nachrichtenrolle.- Der neue Tokenizer führt bei gleichem Text zu einer um 0 % bis 35 % höheren Token-Anzahl als bei 4.6; Budget und

max_tokensmüssen neu berechnet werden. - Die Korrektur erfordert mindestens drei Schritte: Sampling-Parameter löschen,

systemauf die oberste Ebene verschieben und den Modellnamen aufclaude-opus-4-7ändern. - Aufrufe von Opus 4.7 über APIYI (apiyi.com) bieten eine elegante Kompatibilitäts-Degradierung, eine Cache-Abrechnung von 0,1x und eine stabile Anbindung innerhalb Chinas.

- „Adaptive thinking“ in Kombination mit

output_config: {effort: "max"}ist der Standardweg, um die maximale Schlussfolgerungsleistung bei Opus 4.7 zu erzielen.

Zusammenfassung

Die Einstellung der Parameter für Claude Opus 4.7 mag auf den ersten Blick wie eine „Breaking Change“ wirken, ist jedoch im Kern ein entscheidender Schritt von Anthropic, das Modell von einem „Werkzeug mit offenliegenden Details“ zu einer „adaptiven Blackbox“ weiterzuentwickeln. Für Entwickler bedeutet dies, dass die Stabilität, die bisher über „Schalter“ wie temperature oder thinking budget erreicht wurde, schrittweise auf eine Kombination aus Prompt-Engineering und adaptivem Denken verlagert werden muss. Kurzfristig entstehen dadurch Migrationskosten, langfristig führt dies jedoch zu saubererem Code und einer stabileren Modellleistung. Dieser Entwicklungspfad ist kein Einzelfall; führende große Sprachmodelle bewegen sich alle in Richtung „weniger Parameter, stärkere Selbstadaption“. Wer sich frühzeitig darauf einstellt, profitiert am meisten.

Wenn Sie gerade auf Opus 4.7 umsteigen oder die Auswirkungen dieser Änderung auf Ihre Produktion bewerten, empfehlen wir, die neue Version zunächst über APIYI (apiyi.com) zu testen. Die Plattform unterstützt Opus 4.7 bereits stabil und bietet eine Kompatibilitäts-Abwärtslösung für die eingestellten Parameter. In Kombination mit der Cache-Abrechnung von 0,1x ist dies derzeit der kostengünstigste Migrationspfad.

Wir wünschen Ihnen wenig Probleme bei der Implementierung und einen pünktlichen Feierabend.

— APIYI Technik-Team, weitere Praxis-Tutorials zu KI-Modellen finden Sie auf APIYI apiyi.com