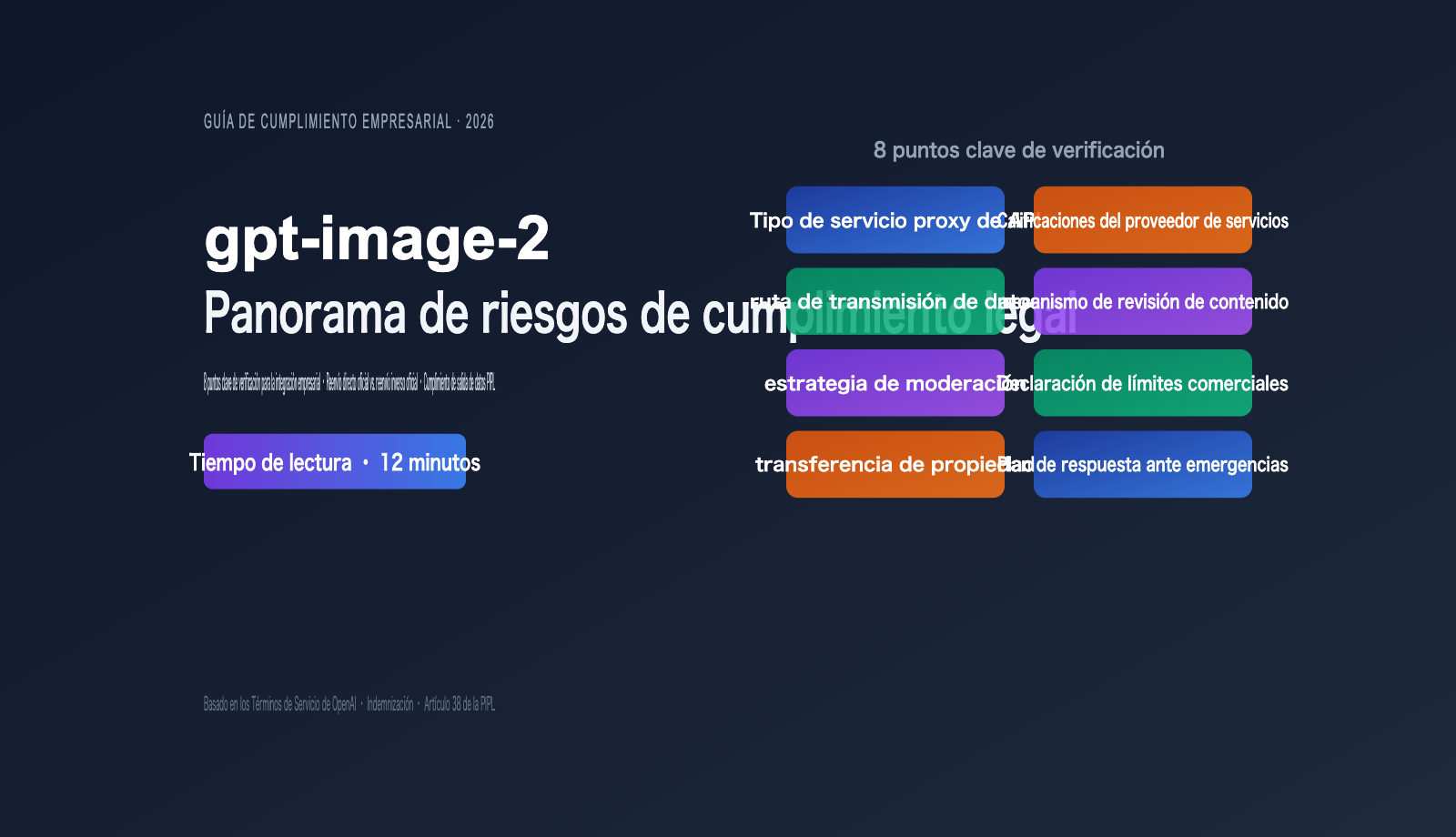

Conclusión en una frase: al acceder a gpt-image-2 mediante un servicio proxy de API (Official Relay), no existen riesgos legales adicionales siempre que se haga un uso razonable; la estructura de riesgo es idéntica a la de una empresa que invoca la API oficial de OpenAI por cuenta propia. Sin embargo, si el proveedor de servicios utiliza un canal inverso (Reverse-engineered), el riesgo de cumplimiento se traslada a la empresa a lo largo de la cadena de invocación. Este artículo ofrece un método de evaluación riguroso y una lista de verificación legal de 8 puntos.

Desde que OpenAI lanzó oficialmente gpt-image-2 el 21 de abril de 2026, ha sido ampliamente adoptado en escenarios B2B en el mercado nacional. Las tres preguntas más frecuentes de los equipos legales de las empresas son: ¿Podemos usarlo directamente? ¿Existe algún riesgo de cumplimiento? ¿A quién pertenecen las imágenes generadas?

Aunque parecen sencillas, estas preguntas involucran los Términos de Servicio de OpenAI, las Políticas de Uso, las cláusulas de indemnización, los mecanismos de seguridad de contenido, la propiedad comercial y, lo que es más importante para las empresas locales, la "diferencia entre tipos de proveedores de servicios proxy". Sin haber leído los tres documentos legales en inglés de OpenAI, es fácil para un equipo legal llegar a una conclusión conservadora pero errónea.

Este artículo desglosa el panorama de cumplimiento de gpt-image-2 siguiendo el orden del flujo de aprobación real de una empresa.

I. Dos canales que debes distinguir antes de integrar gpt-image-2

Para el equipo legal, el núcleo de la revisión de cumplimiento de los servicios de IA no es el modelo en sí, sino si la "cadena de invocación es trazable hasta una autorización legal". Es por esto que primero debemos desglosar el rol del "proveedor de servicios proxy".

1.1 Relevo oficial vs. Inverso: diferencias fundamentales en la naturaleza legal

| Tipo de canal | Implementación técnica | Método de autenticación de OpenAI | Origen de facturación | Calificación legal |

|---|---|---|---|---|

| Relevo oficial (Relay) | El proveedor posee una clave API legítima, recibe y reenvía solicitudes | Estándar Authorization: Bearer sk-xxx |

Pago a través de la factura oficial de OpenAI | Reventa legal de API |

| Inverso (Reverse) | Sesión/cuenta de ChatGPT web inversa, omite autenticación API | Simula sesión/cookie del navegador | Rotación de cuentas múltiples/omisión de facturación | Viola los ToS de OpenAI, zona gris legal |

| Autohospedado (Self-hosted) | La empresa posee su propia clave API y la invoca directamente | Clave propia | Pago propio | Usuario estándar, cumplimiento total |

Juicio clave: Cuando envías una solicitud a un endpoint como https://api.example.com/v1/images/generations, necesitas saber cómo llega el proveedor a OpenAI en el nivel inferior.

🎯 Nota importante: Al elegir un servicio proxy, asegúrate de confirmar que el proveedor utilice un canal de relevo oficial. Por ejemplo, la plataforma APIYI (apiyi.com) accede a la API oficial de OpenAI, utiliza internamente claves API de nivel empresarial legítimamente obtenidas y mantiene una relación comercial B2B estándar con OpenAI. Esto determina el límite de cumplimiento para las empresas usuarias.

1.2 Por qué el "canal inverso" hace que la empresa asuma riesgos solidarios

Los [Términos de Servicio] de OpenAI establecen explícitamente que los usuarios de la API no deben "eludir, interferir o interrumpir las restricciones de acceso de OpenAI". Si el proveedor logra el servicio mediante ingeniería inversa de ChatGPT:

- La responsabilidad por incumplimiento se transmite a lo largo de la cadena contractual: El proveedor incumple → La empresa, como usuario final, aún puede ser considerada en "incumplimiento indirecto" si no puede demostrar que desconocía la situación.

- La indemnización de OpenAI no es aplicable: Como se explicará más adelante, en un canal inverso no obtienes la protección de "defensa en nombre de" de OpenAI ante acusaciones de infracción de propiedad intelectual de terceros.

- El mecanismo de seguridad de contenido puede ser omitido: Los canales inversos suelen modificar parámetros de seguridad como

moderation, lo que puede provocar que las imágenes generadas por la empresa infrinjan categorías prohibidas por OpenAI sin que la empresa lo sepa.

1.3 Cómo identificar rápidamente el tipo de canal proxy

Al realizar la debida diligencia sobre los proveedores de servicios, el equipo legal puede utilizar las siguientes preguntas para identificar rápidamente el tipo de canal:

✅ Tres preguntas clave para determinar el cumplimiento del canal

P1: "¿Pueden proporcionar una prueba de su relación de servicio API con OpenAI?

(Por ejemplo, tipo de cuenta de OpenAI, capturas de pantalla de cuenta empresarial, facturas mensuales)"

P2: "¿El endpoint que invocan es api.openai.com o una interfaz derivada de

chat.openai.com?"

P3: "Si nuestra solicitud activa la moderación de contenido de OpenAI,

¿el código de error se devuelve tal cual? ¿O ha sido reescrito por ustedes?"

El relevo oficial suele responder directamente a las dos primeras preguntas, y la respuesta a la tercera es "se devuelve tal cual 400/safety_violations". Por el contrario, los canales inversos suelen ser vagos o negarse a proporcionar credenciales.

二、Límites comerciales de gpt-image-2 bajo los términos oficiales de OpenAI

Una vez confirmada la conformidad del canal, el siguiente punto de preocupación legal es: "¿Podemos usar directamente las imágenes generadas con fines comerciales?". Esta parte está definida conjuntamente por tres documentos: los Términos de uso de OpenAI, los Términos de servicio y las Políticas de uso.

2.1 Propiedad de la salida: OpenAI la asigna explícitamente al usuario

La sección 3 "Contenido" de los Términos de uso de OpenAI establece claramente:

"OpenAI le asigna por la presente todos sus derechos, títulos e intereses sobre la Salida (Output)."

Puntos clave de la traducción:

- El usuario conserva la propiedad de la entrada (Input).

- El usuario posee derechos completos sobre la salida (Output); OpenAI transfiere activamente los derechos al usuario.

- Esto significa que, legalmente, tú eres el titular de los derechos de las imágenes generadas por

gpt-image-2.

2.2 Alcance comercial: Incluye todas las actividades comerciales, incluida la reventa

| Actividad comercial | ¿Está permitida? | Base de los términos de OpenAI |

|---|---|---|

| Uso interno de la empresa (promoción interna/PPT/prototipos) | ✅ Permitido | Términos §3 |

| Publicidad y marketing | ✅ Permitido | Términos §3 |

| Empaquetado de productos/material impreso | ✅ Permitido | Términos §3 |

| Imágenes de productos de comercio electrónico/venta directa (impresión) | ✅ Permitido | Términos §3 |

| Reventa como servicio SaaS (invocación de API para terceros) | ✅ Permitido | Términos §3 + Términos de servicio |

| Entrenamiento de modelos competidores | ❌ Prohibido | Términos de servicio §2(c) |

Línea roja única: No está permitido utilizar la salida de gpt-image-2 para entrenar ningún modelo que compita con los servicios de OpenAI. Este es el único uso comercial expresamente prohibido por OpenAI.

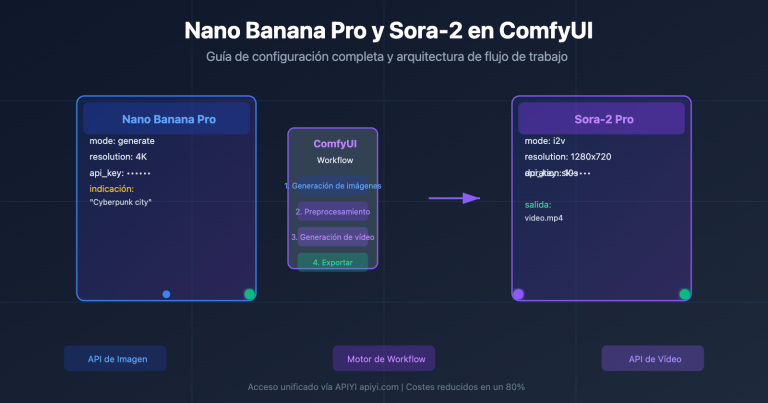

🎯 Recomendación para empresas: Si tu negocio implica proporcionar un "SaaS de generación de imágenes por IA" a clientes, esta ruta está permitida por los términos de OpenAI. Recomendamos realizar pruebas comparativas de múltiples modelos a través de la plataforma APIYI (apiyi.com), la cual admite una interfaz unificada para

gpt-image-2,Imagen 4,Flux 1.1 Proy otros modelos de imagen principales, facilitando la selección técnica y la comparación bajo un marco de cumplimiento.

2.3 La realidad de la protección de derechos de autor: "Posees" pero es difícil "reclamar"

Este es el punto donde los departamentos legales suelen confundirse más. Que OpenAI te "asigne" los derechos no significa que esta imagen goce de "protección por ley de derechos de autor".

| Dimensión | Términos de OpenAI | Ley de derechos de autor (práctica judicial en EE. UU. y China) |

|---|---|---|

| Propiedad | OpenAI transfiere todos los derechos al usuario | Depende del caso |

| Derechos de autor completos | No garantizado | Oficina de Derechos de Autor de EE. UU.: La IA pura no tiene copyright; algunos casos en China reconocen la contribución humana |

| Derechos comerciales | Totalmente permitidos, incluida la reventa | No afecta: es un derecho contractual, independiente del copyright |

| Protección contra robo | No se garantiza exclusividad | Puede ser imposible reclamar remedios por infracción de copyright |

Conclusión práctica: Puedes usar con confianza las imágenes generadas por gpt-image-2 para fines comerciales, pero no asumas que obtendrán la misma protección de derechos de autor que una obra dibujada a mano por un diseñador. Si se trata de material de alto valor (como logotipos de marca o mascotas corporativas), se recomienda que un diseñador humano realice una creación secundaria sustancial sobre la salida de la IA para asegurar la posibilidad de reclamar derechos de autor.

三、Mecanismos de seguridad de contenido de gpt-image-2 y obligaciones de revisión previa de las empresas

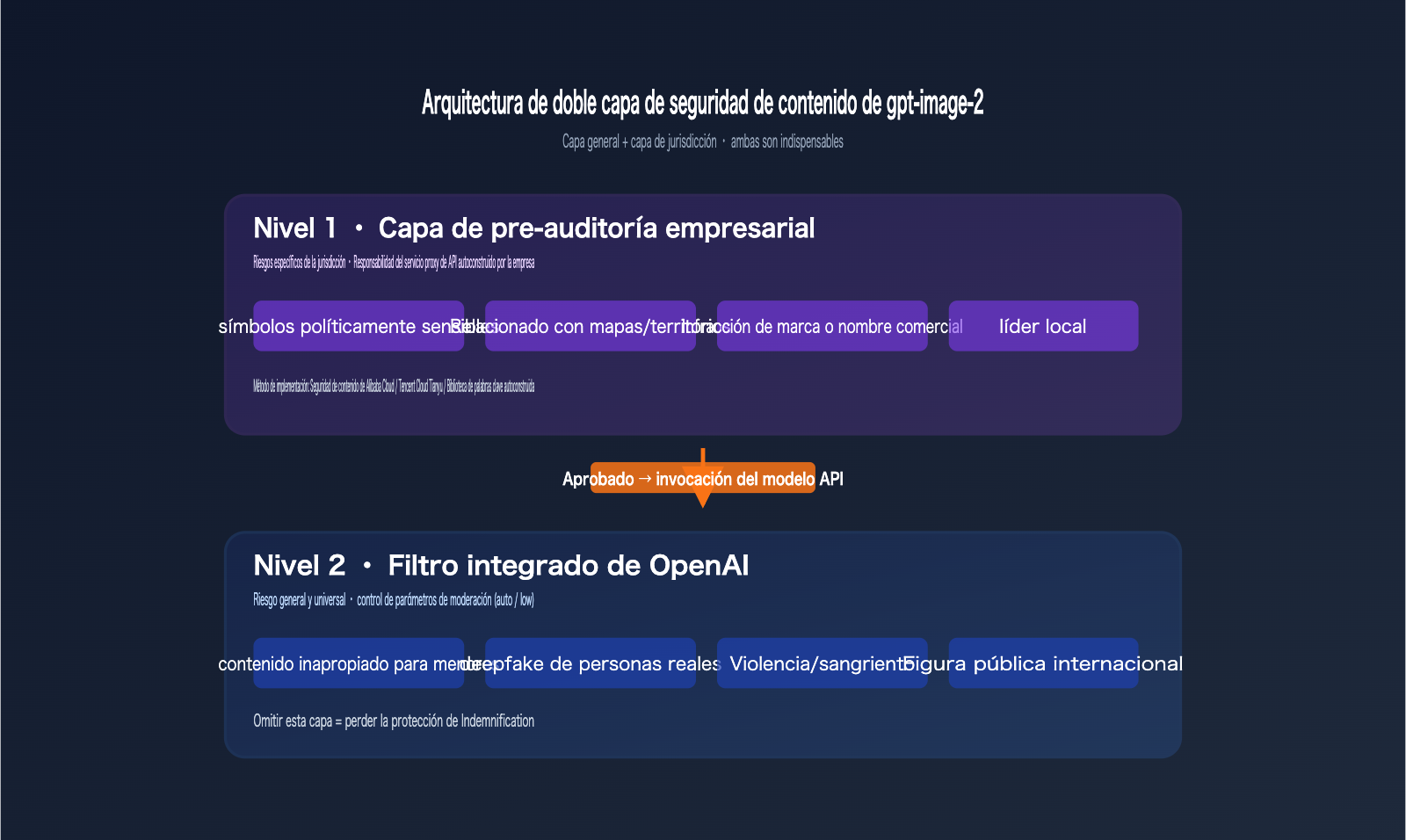

La seguridad del contenido de OpenAI es un eslabón subestimado en el mapa de cumplimiento. Muchos abogados corporativos creen que "es suficiente con que el modelo tenga filtros de seguridad", lo cual es un malentendido peligroso.

3.1 Dos niveles de mecanismos de seguridad integrados en gpt-image-2

La API de gpt-image-2 tiene dos niveles de verificación de seguridad integrados al generar imágenes:

# Nivel 1: Verificación de la indicación (antes de generar)

# Nivel 2: Verificación de la imagen de salida (antes de devolverla)

# Parámetros controlables por la empresa:

{

"model": "gpt-image-2",

"prompt": "tu indicación aquí",

"moderation": "auto", # Valor predeterminado, filtrado estándar

# "moderation": "low", # Opcional, filtrado laxo, pero no se puede desactivar

"size": "1024x1024",

"quality": "high"

}

Importante: El parámetro moderation solo permite elegir entre auto (predeterminado) y low; no existe la opción "off". Esto significa que OpenAI siempre mantiene un filtrado de seguridad básico (por ejemplo, contenido dañino para menores, deepfakes de figuras públicas reales, etc.), que será rechazado en cualquier modo.

3.2 Categorías de contenido no cubiertas por el filtrado de seguridad de OpenAI

Los filtros de OpenAI se centran en riesgos generales, pero no cubren los riesgos específicos de la jurisdicción donde opera la empresa:

| Categoría de riesgo | Filtrado de OpenAI | Requisitos de la jurisdicción de China continental |

|---|---|---|

| Contenido inapropiado para menores | ✅ Filtrado fuerte | ✅ Coincide |

| Deepfakes de personas reales | ✅ Filtrado fuerte | ✅ Coincide |

| Violencia/sangre | ⚠️ Según gravedad | ✅ Control estricto |

| Símbolos políticamente sensibles | ⚠️ Cubierto parcialmente | ❗️ Requiere revisión previa de la empresa |

| Imagen de líderes nacionales | ⚠️ Solo figuras públicas internacionales | ❗️ Requiere revisión previa de la empresa |

| Mapas/territorios | ❌ No cubierto | ❗️ Requiere revisión previa de la empresa |

| Logos comerciales/infracción de marca | ❌ No cubierto | ❗️ Requiere revisión previa de la empresa |

Conclusión clave: La seguridad de contenido de OpenAI es una capa general; las empresas en China continental tienen obligaciones de cumplimiento a nivel jurisdiccional. Incluso al acceder a gpt-image-2 a través de canales conformes, las empresas deben realizar una "revisión de contenido previa" en el cliente o en su propia pasarela.

🎯 Recomendación de integración: En la práctica, sugerimos que las empresas utilicen una capa de API de seguridad de contenido local (como Alibaba Cloud Content Security o Tencent Cloud Tianyu) para filtrar palabras clave en la indicación antes de invocar

gpt-image-2, y realicen una verificación de salida con una API de auditoría de contenido de imagen tras recibir el resultado. Plataformas de servicio proxy de API como APIYI (apiyi.com) devuelven los códigos de errorsafety_violationsde OpenAI tal cual, lo que facilita la centralización de los registros de ambas capas de auditoría.

3.3 Vinculación estricta entre seguridad, cumplimiento e indemnización

Este es el detalle legal que más fácilmente se pasa por alto. La sección 7 de los Términos de servicio de OpenAI proporciona una cláusula de Indemnización (defensa en nombre de):

Cuando los usuarios de la API utilizan la salida dentro de un alcance legal y son demandados por terceros por infracción de derechos de propiedad intelectual, OpenAI asumirá los costos de defensa y compensación razonable.

Sin embargo, esta protección tiene dos condiciones de exclusión:

- El usuario sabe o debería saber que la salida podría infringir derechos y, aun así, la utiliza.

- El usuario desactiva o elude los mecanismos de seguridad proporcionados por OpenAI.

Implicación práctica: Si insistes en usar moderation: low o eludes el filtrado de seguridad de OpenAI mediante medios técnicos, renuncias voluntariamente a la protección de indemnización. Incluso si obtienes una salida de API perfecta, si eres demandado por infracción, OpenAI no intervendrá para defenderte en los tribunales.

IV. Cumplimiento de la transferencia de datos de gpt-image-2: PIPL y la Ley de Seguridad de Datos

Para las empresas en China continental, la integración de gpt-image-2 conlleva un problema más fundamental y previo a la elección del "canal de proxy": el cumplimiento de la transferencia de datos al extranjero. Este es un punto de alta prioridad para los equipos legales, aunque a menudo pasa desapercibido durante la selección técnica.

4.1 Qué datos se consideran "transferidos al extranjero"

Los servidores de procesamiento de la API de OpenAI se encuentran en Estados Unidos, por lo que cualquier solicitud enviada a gpt-image-2 implica una transferencia de datos al extranjero. Específicamente en escenarios de generación de imágenes, se transmiten los siguientes datos:

| Tipo de datos | ¿Se transfieren? | Sensibilidad PIPL |

|---|---|---|

| Texto de la indicación | ✅ Sí | Depende del contenido |

| Imagen de referencia (escenario imagen a imagen) | ✅ Sí | Alta (puede contener rostros/escenas) |

| Imagen generada | ✅ Sí (retorno tras salida) | Media |

| IP/UA del usuario | ✅ Sí (si es conexión directa) | Baja |

| Datos comerciales asociados (user_id, session_id) | ⚠️ Depende de la implementación | Media |

🎯 Sugerencia de ruta de transmisión de datos: A través de un servicio proxy de API conforme a la normativa nacional (como la plataforma APIYI, apiyi.com), la indicación llega primero a un servidor nacional y luego se transfiere al extranjero a través de la red nacional, lo que reduce el riesgo de cumplimiento de una "conexión directa del terminal del usuario al extranjero". La arquitectura de entrada nacional de esta plataforma cumple con los requisitos de cumplimiento de la PIPL para el rol de "procesador de datos".

4.2 Tres rutas de cumplimiento bajo el marco PIPL

El artículo 38 de la Ley de Protección de Información Personal (PIPL) establece tres rutas de cumplimiento para la transferencia de datos al extranjero:

Ruta 1: Evaluación de seguridad organizada por el departamento nacional de ciberseguridad

- Aplicable a: Operadores de infraestructura de información crítica, procesamiento de datos de más de 1 millón de personas

- Dificultad: ★★★★★ (Evaluación gubernamental, ciclo de 6-12 meses)

Ruta 2: Certificación de protección de información personal

- Aplicable a: Empresas generales, mediante certificación de organismos profesionales

- Dificultad: ★★★ (Certificación institucional, ciclo de 2-3 meses)

Ruta 3: Presentación de contrato estándar (SCC)

- Aplicable a: La mayoría de las empresas, mediante la firma y registro de un contrato estándar

- Dificultad: ★★ (Relativamente sencillo, pero requiere supervisión posterior)

Para el escenario de integración de gpt-image-2, la gran mayoría de las empresas aplican la Ruta 3 (Contrato estándar). Esto significa que usted debe:

- Firmar acuerdos que incluyan cláusulas SCC con los usuarios finales.

- Evaluar el tipo y la sensibilidad de los datos transferidos.

- Realizar el registro ante la oficina local de la Administración del Ciberespacio.

4.3 Mejores prácticas para reducir la sensibilidad de los datos transferidos

Sin afectar al negocio, existen varias formas de reducir la complejidad del cumplimiento de los datos transferidos:

| Método práctico | Coste de implementación | Beneficio de cumplimiento |

|---|---|---|

| Plantillas de indicación estandarizadas (evitar concatenar privacidad del usuario) | Bajo | Alto |

| Anonimización de imágenes de referencia (difuminado de rostros/reemplazo de fondo) | Medio | Alto |

| Hash de ID de usuario (no transmitir el user_id real) | Bajo | Medio |

| Preprocesamiento local (filtrado de palabras clave sensibles) | Medio | Alto |

| Servicio proxy de API conforme (procesado por proveedor nacional) | Bajo | Alto |

4.4 Relación entre el cumplimiento de la PIPL y el negocio de gpt-image-2

| Escenario de negocio | Complejidad de datos transferidos | Ruta de cumplimiento recomendada |

|---|---|---|

| Ilustraciones para documentos internos | Baja (sin datos personales) | Presentación de contrato estándar |

| Generación de material de marketing (sin rostros) | Baja | Presentación de contrato estándar |

| Generación de perfiles de usuario (con rostros) | Alta | Certificación de protección + SCC |

| Imágenes de productos de comercio electrónico (con modelos) | Media | Presentación de contrato estándar + autorización de imagen del modelo |

| Generación de avatares para redes sociales (con fotos de usuarios) | Alta | Certificación de protección + consentimiento individual del usuario |

V. Lista de verificación de 8 puntos para la auditoría legal de la integración de gpt-image-2 en empresas

Tras integrar el análisis anterior, aquí tienes una lista de verificación lista para ser entregada a tu equipo legal o de cumplimiento.

5.1 Checklist completo (por orden de aprobación)

| N.º | Elemento de verificación | Estándar de aprobación | Nivel de riesgo |

|---|---|---|---|

| 1 | Tipo de canal del servicio proxy de API | Debe ser conexión directa oficial, con comprobantes de facturación de OpenAI | Alto |

| 2 | Calificación del proveedor del servicio proxy | Empresa registrada legalmente (nacional/extranjera), con licencias ICP/operativas | Alto |

| 3 | Ruta de transmisión de datos | Claridad sobre si la indicación/imagen pasa por SSL y si se almacena | Medio |

| 4 | Capa de moderación de contenido previa | Mecanismo doble: revisión de indicación propia + revisión de imagen de salida | Alto |

| 5 | Estrategia del parámetro moderation |

Uso predeterminado en auto; si se requiere low, debe haber una excepción por escrito |

Medio |

| 6 | Declaración de límites comerciales | Declaración en los Términos de Servicio (ToS) de no usarlo para entrenar modelos competidores | Medio |

| 7 | Transferencia de propiedad de imágenes | Acuerdo claro de propiedad con clientes finales/usuarios | Medio |

| 8 | Plan de respuesta ante emergencias | Flujo de gestión ante quejas o litigios derivados de imágenes generadas | Alto |

5.2 Diferencias de prioridad según el rol de la empresa

| Rol de la empresa | Elementos clave a verificar | Foco del equipo legal |

|---|---|---|

| Llamada directa (uso interno) | 1, 4, 5 | Cumplimiento del canal proxy, seguridad de contenido |

| Proveedor SaaS (reventa) | 1, 6, 7 | Límites comerciales, acuerdos de derechos con clientes |

| Empresa cotizada / Estatal | Los 8 puntos | Pista de auditoría completa, comprobantes trazables |

| Comercio transfronterizo | 1, 4, 7 | Cumplimiento multijurisdiccional, gestión de propiedad |

🎯 Recomendación de ruta de integración: Para empresas cotizadas o estatales, sugerimos priorizar proveedores de servicios proxy que puedan emitir facturas oficiales, aceptar pagos corporativos y ofrecer acuerdos SLA. La plataforma APIYI (apiyi.com) permite la facturación corporativa y la firma de acuerdos de servicio formales, cumpliendo con todos los requisitos de auditoría de cumplimiento para empresas cotizadas.

5.3 Plantilla de "Carta de Compromiso de Cumplimiento del Proveedor"

Para llevar este checklist al plano contractual, se recomienda exigir al proveedor de servicios proxy que confirme por escrito las siguientes cláusulas:

Cláusulas clave de la Carta de Compromiso de Cumplimiento (para referencia legal)

1. Cumplimiento del canal: El proveedor garantiza que todas las solicitudes

de API se realizan a través del endpoint oficial de OpenAI

(api.openai.com), sin utilizar ingeniería inversa ni métodos

para saltar la autenticación.

2. Retención de credenciales: El proveedor se compromete a conservar los

comprobantes de su relación de servicio con OpenAI durante al menos

36 meses y facilitarlos durante auditorías de cumplimiento.

3. Transparencia de parámetros de seguridad: El proveedor se compromete a

no modificar el parámetro moderation enviado por el cliente; cualquier

ajuste requiere notificación previa por escrito.

4. Transmisión de códigos de error: El proveedor se compromete a transmitir

al cliente, sin alteraciones, todos los códigos de error de

safety violation y policy violation devueltos por OpenAI.

5. No retención de datos: El proveedor se compromete a almacenar

temporalmente la indicación y la imagen solo durante el procesamiento,

eliminándolas en un plazo de N horas tras finalizar.

VI. Implementación práctica de gpt-image-2: Ejemplo de código mínimo de cumplimiento

Tras la parte legal, veamos un ejemplo de código mínimo ejecutable con revisión previa, ayudando al equipo técnico a establecer una base de cumplimiento.

6.1 Código de llamada simplificado

# pip install openai

from openai import OpenAI

# A través de un proxy de cumplimiento (ejemplo: APIYI apiyi.com), manteniendo la llamada estándar del SDK de OpenAI

client = OpenAI(

api_key="sk-your-key",

base_url="https://api.apiyi.com/v1" # Reemplazar por el endpoint del proxy de cumplimiento

)

response = client.images.generate(

model="gpt-image-2",

prompt="A modern minimalist office workspace, natural lighting",

size="1024x1024",

quality="high",

moderation="auto" # Valor predeterminado, mantiene la protección de Indemnización

)

print(response.data[0].url)

📦 Versión completa con doble revisión (clic para desplegar)

import os

import logging

from openai import OpenAI

from openai import BadRequestError

# Reemplazar por tu endpoint de cumplimiento, usando APIYI apiyi.com como ejemplo

client = OpenAI(

api_key=os.environ["OPENAI_API_KEY"],

base_url="https://api.apiyi.com/v1"

)

def pre_check_prompt(prompt: str) -> bool:

"""

Revisión previa: Llamada a API de seguridad de contenido local

Ejemplo de marcador de posición, integrar con servicios de seguridad de Alibaba/Tencent Cloud

"""

forbidden_keywords = [

# Palabras clave específicas de la jurisdicción

"líderes nacionales", "términos políticamente sensibles",

# Palabras clave de riesgo comercial

"nombre de marca famosa + imitación", "logo de competidor"

]

return not any(kw in prompt for kw in forbidden_keywords)

def post_check_image(image_url: str) -> bool:

"""

Revisión posterior: Llamada a API de revisión de imágenes

Ejemplo de marcador de posición, integrar con servicio de seguridad de contenido de imagen

"""

# En un entorno real, llamar a la revisión de imágenes de Alibaba/Tencent Cloud

return True

def generate_compliant_image(prompt: str):

# Paso 1: Revisión previa

if not pre_check_prompt(prompt):

logging.warning("La indicación no pasó la revisión previa")

return None

# Paso 2: Llamada a gpt-image-2

try:

response = client.images.generate(

model="gpt-image-2",

prompt=prompt,

size="1024x1024",

quality="high",

moderation="auto" # Debe mantenerse el valor predeterminado para conservar la Indemnización

)

image_url = response.data[0].url

except BadRequestError as e:

# Las safety_violations de OpenAI se transmitirán aquí tal cual

logging.error(f"OpenAI rechazó la generación: {e}")

return None

# Paso 3: Revisión posterior

if not post_check_image(image_url):

logging.warning("La imagen no pasó la revisión posterior")

return None

return image_url

if __name__ == "__main__":

url = generate_compliant_image(

"A modern minimalist office workspace, natural lighting"

)

print(f"URL de imagen conforme: {url}")

6.2 Registro de logs en tres niveles: Para auditorías legales

Un detalle de la integración de cumplimiento que a menudo se pasa por alto es la retención de registros (logs). A continuación, se sugieren tres niveles de registro:

[L1] Logs de nivel de solicitud

- request_id, timestamp, user_id

- indicación (anonimizada o con hash)

- valor del parámetro moderation

[L2] Logs de nivel de respuesta

- status_code devuelto por OpenAI

- Si es safety_violations, registrar el tipo de error

- url y hash de la imagen generada

[L3] Logs de nivel de revisión

- Resultado de aprobación/rechazo de la revisión previa

- Resultado de aprobación/rechazo de la revisión posterior

- Motivo del rechazo y palabras clave detectadas

🎯 Recomendación de retención de logs: Las auditorías legales suelen exigir conservar los registros completos de llamadas durante al menos 6-12 meses. La plataforma APIYI (apiyi.com) ofrece capacidades de consulta de logs a nivel de solicitud para empresas, permitiendo buscar por user_id, rango de tiempo, tipo de error, etc., facilitando la auditoría de cumplimiento interna de la empresa.

VII. Matriz de niveles de riesgo de gpt-image-2: Prioridades de cumplimiento según el caso de uso

No todos los escenarios de aplicación de gpt-image-2 requieren un "cumplimiento de nivel máximo". Proporcionar al equipo legal una matriz de niveles de riesgo ayuda a las áreas de negocio a asignar recursos de cumplimiento de manera prioritaria.

7.1 Matriz de niveles de riesgo (basada en las dimensiones "Sensibilidad de datos × Uso comercial")

| Caso de uso | Sensibilidad de datos | Uso comercial | Riesgo integral | Nivel de cumplimiento recomendado |

|---|---|---|---|---|

| Imágenes para PPT interno | Baja | Baja (uso interno) | 🟢 Bajo | Básico: Registro SCC |

| Material de marketing (sin rostros) | Baja | Media (publicación externa) | 🟡 Medio | Estándar: SCC + revisión de contenido general |

| Imágenes de productos de e-commerce | Media | Alta (venta directa) | 🟡 Medio | Estándar: SCC + revisión de marcas e IP |

| Generación de avatares (con rostros) | Alta | Media (uso del usuario) | 🟠 Alto | Avanzado: Certificación de protección de datos + consentimiento individual |

| Generación de imágenes de celebridades | Alta | Cualquiera | 🔴 Muy alto | No recomendado: Riesgo legal excesivo |

| Proyectos gubernamentales/sin fines de lucro | Alta | Baja | 🟠 Alto | Avanzado: Evaluación de seguridad + sustitución nacional |

| Reventa SaaS | Media | Alta | 🟠 Alto | Avanzado: Cadena de cumplimiento completa + acuerdo de usuario |

7.2 Rutas de cumplimiento para tres tipos de empresas

Tipo A: Pequeñas y medianas empresas de Internet (menos de 100 empleados)

Estrategia de cumplimiento: Pragmática

- Canal: Elegir un servicio proxy de API nacional con buena reputación

- Documentación: Registro de contrato estándar (SCC) es suficiente

- Revisión de contenido: API de seguridad de contenido de Alibaba Cloud/Tencent Cloud

- Registros (logs): Retención por 6 meses

- Presupuesto: 50,000 - 100,000 / año

Tipo B: Grandes empresas / Empresas cotizadas

Estrategia de cumplimiento: Rigurosa

- Canal: Priorizar servicios proxy con certificaciones (Xinchuang/protección de seguridad)

- Documentación: Contrato estándar + certificación de protección de datos + manual de cumplimiento interno

- Revisión de contenido: Doble capa de revisión + muestreo manual

- Registros (logs): Retención por 12 meses, auditable

- Presupuesto: 300,000 - 500,000 / año

Tipo C: Empresas estatales / Proyectos gubernamentales

Estrategia de cumplimiento: Evasión de riesgos

- Canal: Solo proveedores certificados, priorizando modelos nacionales

- Documentación: Evaluación de seguridad de la Administración del Ciberespacio

- Revisión de contenido: Triple capa de revisión (previa/intermedia/posterior)

- Registros (logs): 36 meses o más, pista de auditoría completa

- Presupuesto: 1 millón+ / año

7.3 Plan de respuesta ante incidentes de riesgo

Independientemente de lo bien que se gestione el cumplimiento, siempre debe haber un plan de contingencia. Los eventos de riesgo relacionados con gpt-image-2 se dividen principalmente en tres categorías:

| Tipo de evento | Escenario desencadenante | Respuesta inmediata | Acción en 7 días |

|---|---|---|---|

| Queja de usuario por infracción | Atención al cliente recibe acusación de IP | Retirar la imagen de inmediato | Iniciar proceso de indemnización de OpenAI |

| Filtración de contenido prohibido | Notificación de autoridades reguladoras | Suspender servicio, retirar todo el contenido | Cooperar con la investigación, entregar logs |

| Problemas de cumplimiento del proveedor | Proveedor reportado / abandono | Cambiar a endpoint de respaldo | Evaluar riesgo de datos, notificar usuarios |

| Ataque de inyección de Prompt | Usuario evade plantillas para generar contenido dañino | Desactivar temporalmente la entrada del usuario | Actualizar mecanismo de revisión previa |

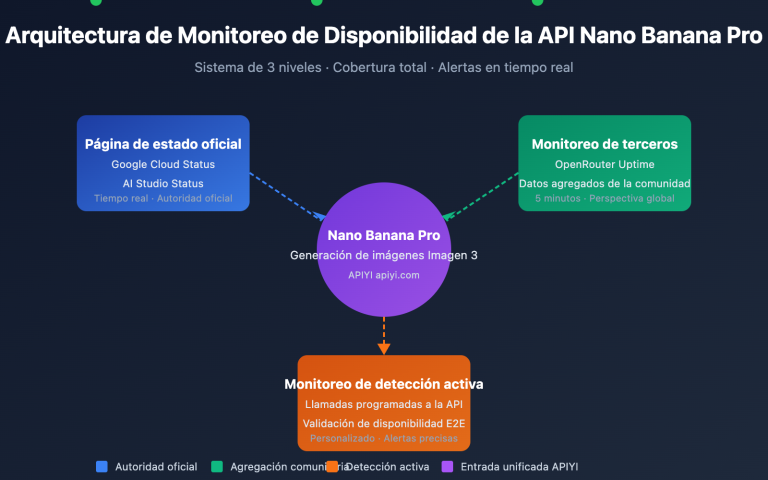

🎯 Construcción de capacidad de respuesta: Una respuesta eficaz requiere que el servicio proxy proporcione capacidad de "búsqueda rápida de logs a nivel de solicitud". APIYI (apiyi.com) ofrece interfaces de registro de nivel empresarial que permiten búsquedas en tiempo real por

request_id,user_id, rango de tiempo y tipo de error, reduciendo significativamente el tiempo de respuesta ante auditorías o quejas.

7.4 Equilibrio entre costos de cumplimiento y valor de negocio

Desde la perspectiva de la toma de decisiones, analicemos el retorno de inversión (ROI) del cumplimiento:

| Dirección de inversión | Costo único | Costo continuo | Valor de negocio |

|---|---|---|---|

| Elegir el canal proxy correcto | 0 | Casi 0 | ⭐⭐⭐⭐⭐ |

| Desplegar doble capa de seguridad | 50k-150k | 10k-20k/mes | ⭐⭐⭐⭐⭐ |

| Registro de contrato estándar SCC | 20k-50k | 0 | ⭐⭐⭐⭐ |

| Certificación de protección de datos | 100k-300k | 0 | ⭐⭐⭐ |

| Evaluación de seguridad | 500k-1M | 0 | ⭐⭐⭐ |

| Sistema completo de logs de auditoría | 50k-100k | 10k/mes | ⭐⭐⭐⭐⭐ |

Conclusión: Elegir el canal proxy adecuado es la decisión de cumplimiento con mayor ROI: el costo es casi nulo, pero cubre más del 60% de los riesgos de cumplimiento.

VIII. Preguntas frecuentes (FAQ) sobre cumplimiento legal de gpt-image-2

Q1: Si nuestra empresa está en China, ¿usar gpt-image-2 se considera "acceso ilegal a servicios extranjeros"?

No. Las leyes de ciberseguridad y seguridad de datos de China no prohíben que las empresas accedan a servicios de API extranjeros para fines comerciales. Los puntos clave son: (a) si la transferencia de datos al extranjero cumple con la normativa (si la indicación contiene información personal); (b) si el proveedor tiene una entidad legal en China. Al acceder a través de un servicio proxy nacional, la ruta de transmisión de datos se procesa adecuadamente, reduciendo drásticamente la fricción legal.

Q2: Si el equipo legal pregunta "¿quién asume la responsabilidad si algo sale mal?", ¿qué respondemos?

Se debe definir según la cadena contractual:

- OpenAI: Infracciones de propiedad intelectual de terceros (bajo uso conforme, mediante indemnización).

- Servicio proxy: Cumplimiento del canal, autenticidad de la clave API, precisión en la facturación.

- Empresa propia: Legalidad de la entrada de contenido, uso final y acuerdos de usuario.

- Usuario final: Cumplimiento del uso secundario (si usted es un proveedor SaaS).

Estas cuatro capas de responsabilidad deben estar claramente estipuladas en los contratos.

Q3: ¿Qué cambios legales hay entre gpt-image-2 y gpt-image-1?

En términos de términos de API, no hay cambios. Ambos se rigen por los mismos términos de servicio y políticas de uso de OpenAI. Técnicamente, gpt-image-2 introduce razonamiento agente, lo que significa que el filtrado de seguridad será más inteligente pero más estricto. Se recomienda realizar pruebas de regresión con las indicaciones históricas.

Q4: ¿Podemos registrar derechos de autor de las imágenes generadas con gpt-image-2?

Teóricamente es posible, pero la tasa de éxito varía según la jurisdicción:

- Oficina de Derechos de Autor de EE. UU.: No acepta registro de contenido puramente generado por IA.

- China: Algunos tribunales reconocen la "contribución creativa del ingeniero de indicaciones", pero se evalúa caso por caso.

- UE: Conservadora, tiende a no proteger.

Recomendación: Si es un activo de IP central (logo, personaje), realice una creación secundaria sustancial por parte de un diseñador tras el borrador de IA.

Q5: Si el servicio proxy desaparece, ¿podemos seguir usando las imágenes generadas?

Sí. OpenAI asigna la propiedad de las imágenes al "usuario que invoca la API" (la empresa). Es un derecho contractual independiente del proveedor. Asegúrese de guardar los logs de solicitud/respuesta como prueba de propiedad.

Q6: ¿Debemos incluir gpt-image-2 en nuestros Términos de Servicio (ToS) / Política de Privacidad?

Altamente recomendado. Divulgue tres puntos:

- Que su producto utiliza el modelo gpt-image-2 de OpenAI.

- Que las indicaciones (prompts) se transmiten a OpenAI/servicio proxy.

- El alcance de uso de las imágenes generadas (comercial/no comercial, exclusivo/no exclusivo).

Q7: ¿Pueden los clientes gubernamentales/instituciones usar gpt-image-2?

Sí, pero deben hacer dos cosas adicionales:

- Elegir un proveedor proxy con certificaciones de seguridad (Xinchuang/protección de seguridad).

- Realizar una desensibilización estricta de las indicaciones, sin transmitir información confidencial o política.

Q8: ¿Debemos etiquetar las imágenes generadas por gpt-image-2 como "Generadas por IA"?

Altamente recomendado. Según el artículo 12 de las "Medidas provisionales para la gestión de servicios de IA generativa" de China, se debe etiquetar el contenido generado.

- Etiquetado explícito: Texto visible en la imagen o metadatos.

- Marca de agua implícita: Marcas de agua digitales invisibles.

gpt-image-2 incrusta metadatos C2PA por defecto, pero se recomienda añadir una etiqueta explícita según la normativa local.

Q9: Si el usuario sube una imagen para i2i (imagen a imagen), ¿cómo se manejan los derechos de autor?

| Escenario | Derechos de la imagen de entrada | Derechos de la imagen de salida |

|---|---|---|

| Usuario sube foto propia | Original del usuario | Usuario (creación secundaria) |

| Usuario sube obra de terceros | Propiedad de terceros | Riesgo legal alto |

| Usuario sube rostro de celebridad | Derechos de imagen | Riesgo legal muy alto |

Mejor práctica: Exigir en los ToS que el usuario garantice la legalidad de los derechos de autor y de imagen de lo que sube, y mantener logs de actividad.

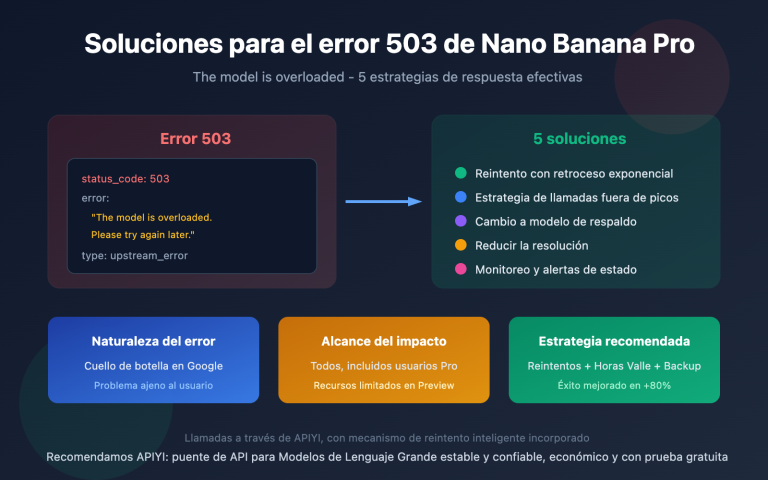

Q10: ¿Qué pasa si OpenAI restringe el acceso desde China?

Los proveedores proxy nacionales suelen tener nodos en el extranjero y configuraciones de múltiples endpoints, permitiendo una conmutación sin interrupciones. Esta es una razón clave para priorizar una solución proxy sobre una conexión directa. Asegúrese de incluir un SLA de alta disponibilidad en el contrato con el proveedor.

IX. Conclusión: Los tres juicios clave para el cumplimiento legal de gpt-image-2

Volviendo a la pregunta inicial del artículo, si necesitas responder a las dudas del departamento legal de tu empresa de la manera más concisa posible, solo necesitas estos tres puntos:

9.1 Tres juicios clave

✅ Juicio 1: El uso comercial de gpt-image-2 no conlleva riesgos legales adicionales

Condición: A través de canales oficiales + sin eludir mecanismos de seguridad + sin usarlo para entrenar modelos de la competencia.

✅ Juicio 2: La propiedad de las imágenes generadas pertenece al usuario corporativo que invoca la API

Nota: La propiedad no equivale a derechos de autor completos; para activos de propiedad intelectual (IP) clave, se recomienda la creación humana secundaria.

✅ Juicio 3: La empresa tiene la obligación de realizar una "revisión de contenido previa"

Razón: OpenAI solo aplica filtros generales; los riesgos específicos de cada jurisdicción deben ser gestionados por la propia empresa.

9.2 Tres recomendaciones de acción para el departamento legal

- Establecer una lista de verificación de debida diligencia para proveedores de servicios proxy de API: Debe incluir al menos tres puntos clave: tipo de canal, calificaciones de la entidad y retención de datos.

- Establecer un mecanismo de seguridad de contenido de doble capa: Filtros de seguridad de OpenAI + API de seguridad de contenido local, para asegurar la cobertura de riesgos específicos de la jurisdicción.

- Establecer un sistema completo de registros de invocación: Conservar al menos 12 meses de registros de solicitudes, respuestas y auditorías para futuras revisiones.

9.3 Recomendaciones de mejores prácticas

🎯 Recomendación general:

gpt-image-2es totalmente seguro para su uso en escenarios empresariales; la clave está en elegir el método de acceso correcto y contar con mecanismos de cumplimiento adecuados. Recomendamos a las empresas acceder a través de plataformas como APIYI (apiyi.com), que cuentan con una cadena de cumplimiento completa, soporte para facturación corporativa, registros de invocación detallados y transmisión transparente de códigos de error de seguridad, cumpliendo con los estándares de la mayoría de los equipos legales.

El cumplimiento no es un freno para el negocio, sino una forma de poner los riesgos sobre la mesa. Cuando puedes presentarle a tu equipo legal un plan completo que incluya "certificación de cumplimiento del canal + doble capa de seguridad de contenido + 12 meses de registros de auditoría", la aprobación para integrar gpt-image-2 suele ser mucho más fluida.

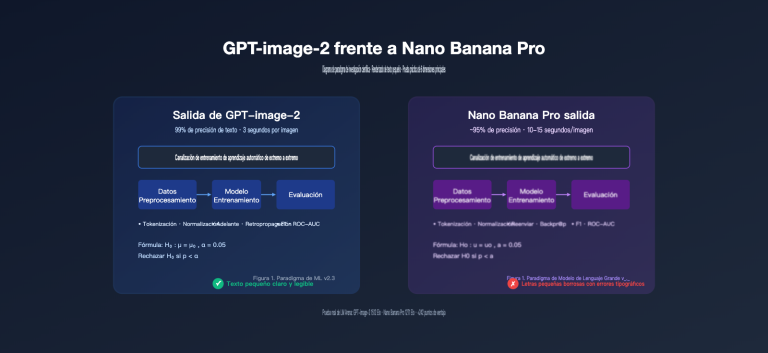

gpt-image-2 es actualmente uno de los modelos de generación de imágenes más potentes de OpenAI, destacando en resolución 2K, renderizado de texto y composiciones complejas. Al hacer bien la tarea de cumplimiento legal, el camino hacia la iteración del producto y la comercialización será mucho más sencillo.

Una última frase para los equipos legales: "El propósito de la revisión de cumplimiento no es decir que no, sino definir claramente 'cómo usarlo de forma segura'." Esperamos que este artículo sirva como punto de partida para tu decisión sobre si implementar o no gpt-image-2.

Si durante el proceso de revisión legal surgen problemas específicos —como listas de verificación de proveedores, plantillas de contratos SCC o selección de API de moderación de contenido—, estos son temas que pueden tratarse de forma independiente y que abordaremos en futuras guías prácticas.

Autor: Equipo de APIYI — Plataforma de acceso a API de Modelos de Lenguaje Grande de nivel empresarial (apiyi.com). Ofrecemos una interfaz unificada para más de 200 modelos líderes como gpt-image-2, Claude 4.7 y Gemini 3 Pro, atendiendo las necesidades de cumplimiento de empresas que cotizan en bolsa, empresas estatales y corporaciones transfronterizas.

Términos de referencia: Términos de uso de OpenAI, Términos de servicio de OpenAI, Políticas de uso de OpenAI, Política de indemnización de OpenAI. Este artículo no constituye asesoramiento legal; para decisiones de cumplimiento específicas, consulte con el equipo legal de su empresa o con un abogado profesional.