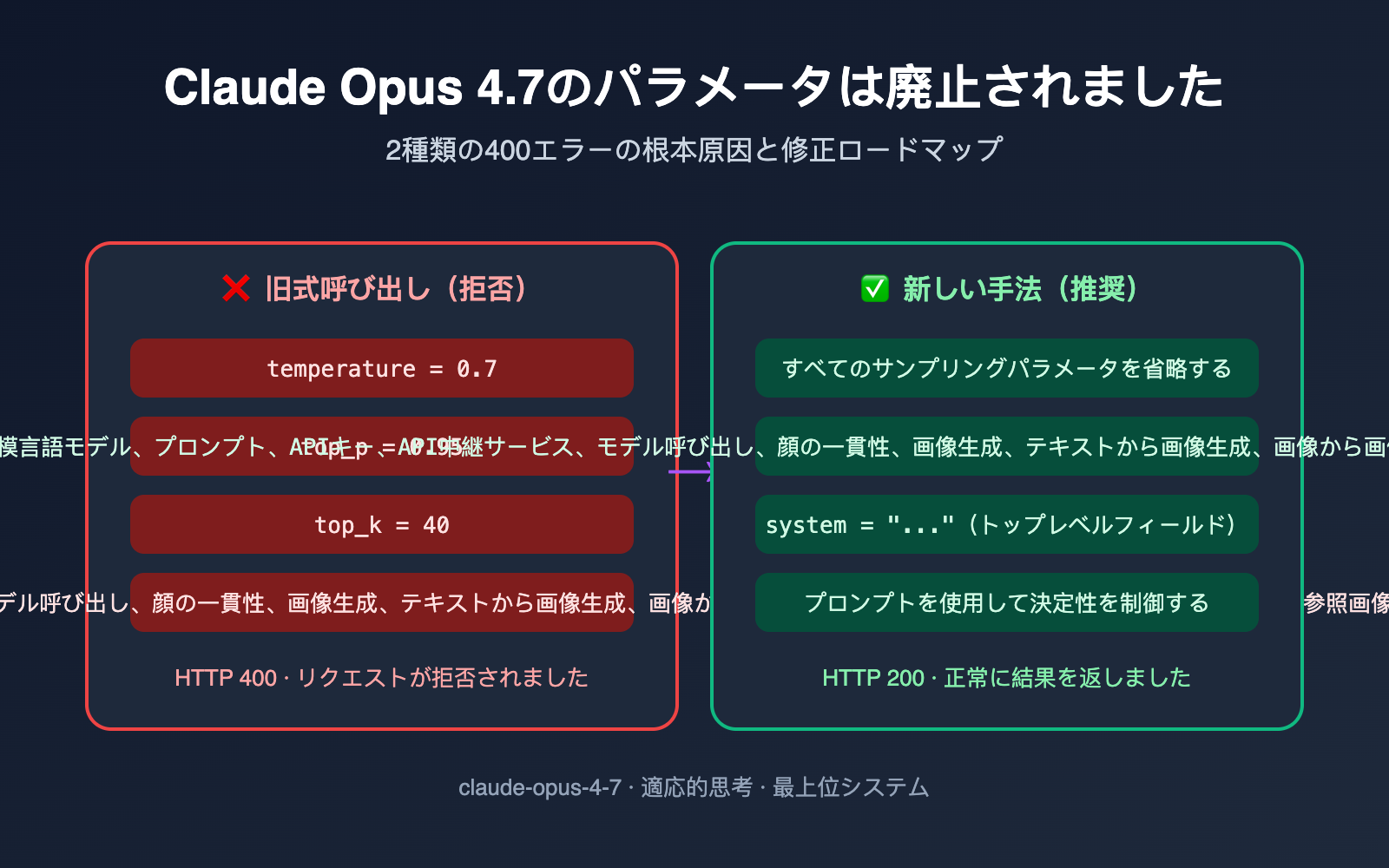

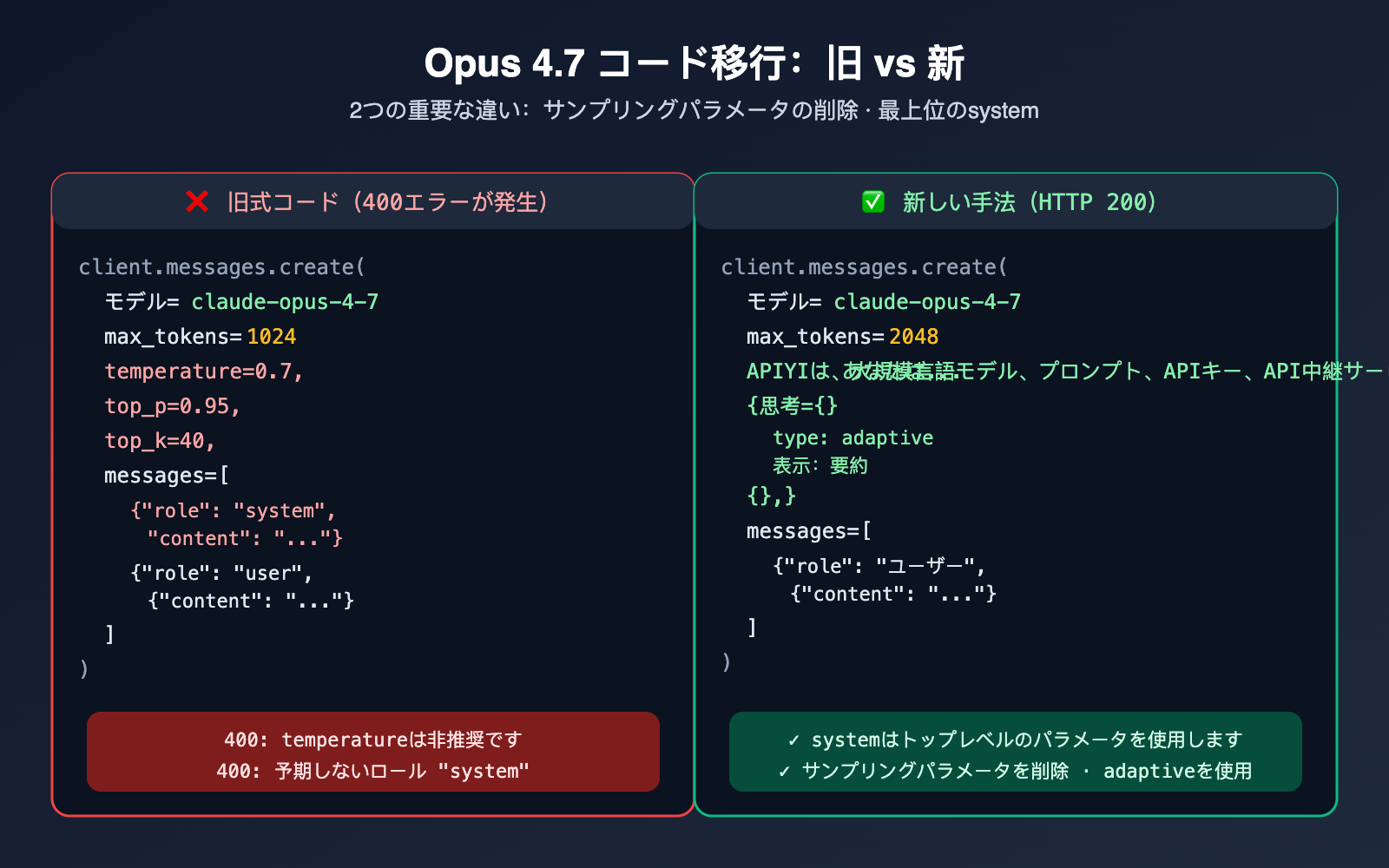

作者注:Claude Opus 4.7 では temperature、top_p、top_k などのサンプリングパラメータが廃止され、system プロンプトはメッセージロールではなくトップレベルでの指定が必須となりました。本記事では、よくある2つの 400 エラーの原因とコードの修正案を解説します。

Claude Opus 4.7 にアップグレードした後、開発者が最もつまずきやすいのはモデルそのものではなく、リクエストパラメータです。1つ目の高頻度エラーは temperature is deprecated for this model、2つ目は Unexpected role "system". The Messages API accepts a top-level system parameter, not "system" as an input message role です。これら2つのエラーはどちらも HTTP 400 であり、一見無関係に見えますが、その背景には Anthropic が Opus 4.7 で行った比較的急進的な API の集約という共通の事実があります。

多くのチームがこの変更を十分に理解しないまま、「温度(temperature)を 0 に設定する」あるいは「system メッセージをもう1つ追加する」といった手法を、確実性を高めるための「銀の弾丸」として使い続けています。しかし、Opus 4.7 はこれらの道を直接塞ぎました。本ガイドでは、原因、エラー内容、修正方法の3つの観点から、これら2つの問題を徹底的に解説し、そのままコピーして使える移行コードを提供します。読み終える頃には、手元の 400 エラーを10分以内に解消できるだけでなく、Anthropic の今回の設計変更の背後にある深い論理を理解し、次回のモデルアップグレード時に再び同じ罠に陥ることを防げるようになるはずです。

Claude Opus 4.7 で廃止されたパラメータ

エラーを理解する前に、まずは完全な「廃止リスト」を確認しましょう。Anthropic が Opus 4.7 で行った変更は見た目以上に大きく、4.6 時代の非推奨化(deprecation)よりも影響範囲が広くなっています。

| パラメータ | 状態 | 動作 | 代替案 |

|---|---|---|---|

temperature |

廃止 | デフォルト以外の値を設定すると 400 エラー | 省略し、プロンプトでランダム性を制御 |

top_p |

廃止 | 同上 | 省略 |

top_k |

廃止 | 同上 | 省略 |

thinking.budget_tokens |

削除 | 明示的な予算指定で 400 エラー | thinking: { type: "adaptive" } |

reasoning_effort(旧式) |

削除 | 旧フィールドは無効 | output_config: { effort: "max" } |

メッセージ内の role: "system" |

非対応 | 従来から非対応だが、4.7 ではエラーが厳格化 | トップレベルの system パラメータ |

🎯 アップグレード前の注意点:Python SDK を使用している場合、古いコード内に

temperature=0.7、top_p=0.95、またはmessages=[{"role": "system", ...}]のいずれかが含まれていると、Opus 4.7 では 400 エラーが発生します。APIYI (apiyi.com) を通じて Opus 4.7 に接続することを推奨します。プラットフォーム側でパラメータの互換性を保つための「優雅なダウングレード」処理が行われており、新しいインターフェースへスムーズに移行できます。

リストの中で最も見落としがちなのが thinking パラメータです。Opus 4.6 時代は thinking: {"type": "enabled", "budget_tokens": 8000} を渡すことでモデルに長く考えさせることができましたが、Opus 4.7 ではこの使い方は直接拒否されます。新しいバージョンでは adaptive タイプのみを受け付け、モデルが自ら推論の強度を決定します。なお、adaptive thinking はデフォルトでオフになっているため、明示的に有効化する必要があります。

もう1つの隠れた変更点はトークナイザーです。Opus 4.7 では新しいトークナイザーが採用されており、同じテキストでも 4.6 と比較してトークン数が 0% から 35% 増加します。これは、4.6 の時点で計算していたコスト予算が、4.7 では「サイレント値上げ」されている可能性が高いため、請求書を再確認する必要があることを意味します。

なぜ Claude Opus 4.7 は temperature パラメータを廃止したのか

今回の変更の背景にあるロジックを理解すれば、無駄なトラブルを避けられます。Anthropic が Opus 4.7 で temperature、top_p、top_k という3つのサンプリングパラメータを「廃止」した本質的な理由は、モデルを「パラメータ調整可能なライブラリ」から「自己適応型のブラックボックス」へと転換させたことにあります。

モデルアーキテクチャの観点から見ると、Opus 4.7 は推論強度の制御権を「adaptive thinking(適応的思考)」モジュールに委ねました。このモジュール自体が、不確実性に対するスケジューリング機能を内包しています。つまり、温度パラメータのように「サンプリング層でランダム性を調整する」手法は、モデル内部の推論ロジックと互換性がなく、無理に設定すると新しい最適化パスを破壊してしまうのです。Anthropic はドキュメントで、「内部評価において、adaptive thinking は extended thinking と手動 temperature 設定の組み合わせよりも安定して優れている」と明言しています。

別の視点で見れば、この「つまみを廃止する」という決断は、初心者にとっての優しいアップグレードでもあります。これまで開発者は LLM を調整する際、「温度設定が悪いのではないか?」という迷信的な悩みに陥りがちでした。調整しても最適値は見つからず、結果の差異も説明できないという状況です。Opus 4.7 はこの「もっともらしいが効果の薄い」最適化パスを閉じることで、開発者がプロンプト設計やコンテキスト管理といった、真に安定した成果を生む作業に集中できるようにしました。

エンジニアリングの実践という観点では、3つのサンプリングパラメータの廃止は、Anthropic が「温度調整で安定性を高める」という古臭い手法を推奨しなくなったことを意味します。新版での推奨アプローチは、プロンプトエンジニアリングを用いて「確定的な回答が必要」「厳密な JSON を出力せよ」といった指示を明確にし、サンプリング層での強制制御ではなく、セマンティック(意味)層でモデルを自己制約させることです。APIYI (apiyi.com) を通じて Opus 4.7 を呼び出す際は、temperature=0 に依存していたコードを、「システムプロンプトで確定性を明確に要求する」書き方へ順次移行することをお勧めします。

この考え方は、GPT-5.5 の「5段階の reasoning effort(推論努力)」と対照的です。OpenAI は「開発者により細かいスイッチを与える」方針ですが、Anthropic は「スイッチを回収してモデル自身に任せる」方針をとっています。どちらの哲学が正しいというわけではありませんが、両者とも従来のハイパーパラメータ調整の役割を弱めている点は共通しています。開発者にとっての最大の教訓は、今後の LLM 調整の重心が「つまみを回すこと」から「プロンプトとコンテキストを磨くこと」へと移るということです。

付け加えると、今回の Anthropic による「急進的な収束」には前兆がありました。Opus 4.6 の時代から、ドキュメントでは extended thinking が非推奨(deprecated)とされ、adaptive thinking への移行が促されていました。当時から推奨される方法でコードを書いていた人にとって、今回の 4.7 へのアップグレードはほぼコストゼロです。逆に、「温度を上げて創造性を出し、下げて安定させる」という古い手法に頼り続けていた場合、今回の移行は少し手間に感じるかもしれません。

temperature パラメータによる 400 エラーの修正案

理由が分かれば、修正は簡単です。以下に最小限の修正例を示します。APIYI (apiyi.com) の base_url と組み合わせることで、国内から安定して利用できます。

# pip install anthropic

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # APIYI を通じて Opus 4.7 を呼び出し

)

# ❌ 旧コード:temperature is deprecated 400 エラーが発生します

# response = client.messages.create(

# model="claude-opus-4-7",

# max_tokens=1024,

# temperature=0.7,

# top_p=0.95,

# messages=[{"role": "user", "content": "Hello"}]

# )

# ✅ 新コード:サンプリングパラメータを完全に省略

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You must return strict JSON. No extra commentary.",

messages=[{"role": "user", "content": "Hello"}]

)

🎯 クイック修正アドバイス:

base_urlをhttps://api.apiyi.comに切り替え、APIYI (apiyi.com) が発行する Anthropic 互換キーを使用してください。旧コードからは3つのサンプリングパラメータを削除するだけで動作します。もし修正が間に合わない場合でも、APIYI (apiyi.com) はデフォルトで廃止されたパラメータに対してスムーズなダウングレード処理を行っているため、移行期間を確保できます。

以下の表は、3つの典型的な移行パターンをまとめたものです。最適な方法を選択してください。

| 旧用法 | 新しいアプローチ | メリット |

|---|---|---|

temperature=0 で確定性を追求 |

システムプロンプトに「厳密な JSON を返し、余計な文字は不要」と記述 | 出力が安定し、トークンも節約 |

temperature=1 で創造性を追求 |

サンプリングパラメータを設定せず、モデルを自由に動かす | 4.7 本来の性能を最大限に発揮 |

top_p / top_k でサンプリングを制限 |

adaptive thinking の effort: "max" を併用 |

推論深度でサンプリング制御を代替 |

OpenAI 互換プロトコルを使用している場合(多くのサードパーティフレームワークがデフォルトで採用しています)、SDK が内部で temperature=1.0 を強制的に挿入していないか確認が必要です。コミュニティでは、フレームワークのハードコードされたデフォルト値が原因で Opus 4.7 がリクエストを拒否するケースが報告されています。その場合はフレームワークをアップグレードするか、APIYI (apiyi.com) の互換レイヤーを経由させてください。

system 役割エラーの本質と修正方法

2つ目の頻出エラーである「400エラー」は、temperatureとは無関係で、新しいモデルで「再浮上した」古い問題です。AnthropicのMessages APIは、systemをメッセージの役割として記述することをサポートしていませんが、OpenAIのChat Completionsから移行したコードの多くは、無意識のうちにこのように記述してしまい、Unexpected role "system" というエラーを引き起こします。

この問題を理解する鍵は、Anthropicがsystemを「会話の内容」ではなく「セッションレベルの設定」と見なしている点にあります。そのため、messages配列の中ではなく、リクエストボディのトップレベルに配置する必要があります。以下の表は、OpenAIとAnthropicの仕様の違いをまとめたものです。

| 項目 | OpenAI Chat Completions | Anthropic Messages |

|---|---|---|

| system の位置 | messages 配列の先頭 |

リクエストボディのトップレベル system フィールド |

| system の数 | 複数可 | 文字列1つのみ |

| 4.7 でのエラー | なし | Unexpected role "system" (400) |

| 移行難易度 | — | 低い(位置を移動するだけ) |

🎯 移行のヒント:プロジェクトで「OpenAI / Claude 両対応」のロジックを組んでいる場合は、アダプター層を設けることを推奨します。OpenAIを呼び出すときはsystemをmessagesに入れ、Claudeを呼び出すときはトップレベルの

systemに変更するようにします。APIYI (apiyi.com) を通じて両方のモデルに接続すれば、同一のAPIキー体系で管理でき、設定の重複を避けられます。

修正方法は非常にシンプルです。以下の誤った書き方と正しい書き方の比較を参考にしてください。

# ❌ 誤った書き方:Unexpected role "system" 400 エラーが発生

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

messages=[

{"role": "system", "content": "You are a coding assistant."},

{"role": "user", "content": "Write a quicksort in Python."}

]

)

# ✅ 正しい書き方:system はトップレベルのパラメータとして渡す

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You are a coding assistant.",

messages=[

{"role": "user", "content": "Write a quicksort in Python."}

]

)

補足として、もしClaudeに「複数のsystem指示」を与えたい場合は、それらを1つの文字列に結合し、改行や番号で区切るのが正解です。Anthropic SDKはsystemフィールドをコンテンツブロックの配列形式にすることもサポートしていますが、これは高度な使い方であり、初心者は「単一の文字列」として理解しておけば十分です。このように記述すると、もう一つの隠れたメリットがあります。単一文字列に結合することで、APIYI (apiyi.com) のプロンプトキャッシュにヒットしやすくなり、長期的なタスクのコストをさらに削減できます。

Claude Opus 4.7 移行用コードテンプレート

2つのエラー修正を統合した、そのまま実行可能な「Opus 4.7 スタートアップコード」を紹介します。アダプティブ・シンキング(adaptive thinking)、systemのトップレベル配置、およびキャッシュ効率を考慮した書き方になっています。

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # APIYI経由でOpus 4.7を呼び出し

)

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=2048,

system="You are an expert Python engineer. Always return strict JSON.",

thinking={

"type": "adaptive",

"display": "summarized"

},

messages=[

{"role": "user", "content": "Refactor my quicksort to be O(n log n) average."}

]

)

print(response.content[0].text)

🎯 本番環境へのアドバイス:APIYI (apiyi.com) でOpus 4.7を呼び出す際は、不変のsystemプロンプトとツール定義を先頭に配置してください。これによりキャッシュ課金(0.1倍)がトリガーされ、繰り返しリクエストのコストを元の10%まで抑えることができます。これは長期間稼働するエージェントやドキュメント生成タスクにおいて特に有効です。

実際の移行時には、いくつか注意すべき細かい点があります。第一に、thinking フィールドは必須ではありませんが、タスクが推論の深さに依存する場合は、明示的にadaptive thinkingを有効にすることをお勧めします。そうしないと、モデルはデフォルトの軽量推論モードのままになります。第二に、新しいトークナイザーでは同じテキストでもトークン数が0%から35%増加するため、max_tokens の予算を適宜引き上げる必要があります。そうしないと、長い出力が必要な場面で途中で切れてしまう可能性があります。第三に、旧版の thinking_budget などの周辺パラメータも削除してください。残っていてもエラーにはなりませんが無視されるため、有効だと誤解する原因になります。第四に、アプリケーションが4.6と4.7の両方を呼び出す場合は、モデル名ごとに課金状況を記録し、新旧トークナイザーの混在によるコスト計算のズレを防ぐのがベストです。

Opus 4.6と4.7の両方をサポートするコードベースを維持している場合は、モデル名に基づいてパラメータのホワイトリストを作成するのが最も堅実です。4.7を呼び出すときは「サンプリングパラメータ + 旧thinkingフィールド」をスキップし、4.6のときは保持するようにすれば、モデルごとに2つの呼び出し関数を管理する必要はありません。

以下のエラーチェック表は、Opus 4.7へのアップグレード中に発生しやすい400エラーをまとめたものです。エラーメッセージから直接修正箇所を特定するのに役立ててください。

| エラーキーワード | エラーの意味 | 修正方法 |

|---|---|---|

temperature is deprecated |

非推奨のtemperatureフィールドが渡された | リクエストボディからtemperatureを完全に削除 |

top_p is deprecated |

非推奨のtop_pフィールドが渡された | top_pを削除し、モデルの適応に任せる |

top_k is deprecated |

非推奨のtop_kフィールドが渡された | top_kを削除し、モデルの適応に任せる |

| Unexpected role "system" | systemがmessages配列内に記述されている | リクエストボディのトップレベルのsystemフィールドに変更 |

Invalid budget_tokens |

旧版のextended thinking予算が使用されている | adaptive thinkingに変更し、budgetを渡さない |

Unknown parameter reasoning_effort |

旧版の推論強度フィールドが使用されている | output_config: {effort: "max"} に変更 |

Claude Opus 4.7 パラメータ廃止に関するFAQ

Q1:なぜOpus 4.7ではこれほど多くのパラメータが一度に廃止されたのですか?

最大の理由は、これまで temperature、top_p、top_k、thinking budget が個別に担っていた「ランダム性と推論深度の制御」という役割を、adaptive thinking が一手に引き受けるようになったためです。Anthropicの内部評価によると、adaptive thinking は手動でのパラメータ調整よりも安定して高いパフォーマンスを発揮するため、入口を一本化する判断がなされました。

Q2:temperature を 1.0 に設定すればエラーを「回避」できますか?

できません。Opus 4.7 はサンプリングパラメータに対して「何の値が設定されているか」ではなく「そのキーが含まれているか」を判定します。リクエストボディにこれらのキーが存在するだけで、デフォルト設定ではないとみなされ 400 エラーが返されます。正しい対応は、リクエストからこれらのフィールドを完全に削除し、SDKを通じてモデル自身のデフォルトのサンプリング動作に任せることです。

Q3:OpenAI SDK を使用して APIYI 経由で Opus 4.7 を呼び出すと temperature エラーが発生しますか?

SDKのバージョンや使用しているフレームワークによります。OpenAI SDK はデフォルトで temperature=1.0 を付与するため、そのままAnthropicのバックエンドに転送すると、Opus 4.7 に拒否されます。APIYI (apiyi.com) を経由して呼び出す場合、プラットフォーム側でこのような一般的な互換性の問題を適切に処理しており、廃止されたフィールドを自動的にフィルタリングするため問題なく動作します。

Q4:system エラーは 4.7 だけで発生するものですか?以前の Claude モデルでは発生しませんでしたか?

いいえ、そうではありません。Anthropic Messages API では元々 system を messages 配列内に記述することは許可されていませんでしたが、Opus 4.7 では検証がより厳格化されました。一部の初期モデルでは「寛容に受け入れられていた」だけです。ベストプラクティスとしては、常に system をリクエストボディのトップレベルに配置することです。トップレベルへの移行を行えば、すべての Claude モデルで正常に動作します。

Q5:OpenAI から移行する場合、最低何行の修正で Opus 4.7 を動かせますか?

通常は以下の3箇所です:1)model を claude-opus-4-7 に変更、2)messages 内の system エントリをトップレベルの system フィールドに移動、3)temperature や top_p などのサンプリングパラメータを削除。base_url を https://api.apiyi.com に切り替えれば、プロジェクト全体を通常10分以内に稼働させることができます。もし数十箇所の呼び出しポイントがある場合は、統一された call_claude() ユーティリティ関数を定義し、これら3箇所の修正をそこに集約することをお勧めします。そうすれば、将来APIに変更があっても1箇所修正するだけで済みます。

Q6:adaptive thinking はデフォルトで有効ですか?明示的にオンにする必要がありますか?

デフォルトではオフになっています。数学的推論、コードのリファクタリング、複雑な計画立案など、推論の深さが重要なタスクを行う場合は、thinking: {type: "adaptive"} を明示的に渡すことをお勧めします。さらに output_config: {effort: "max"} を組み合わせることで、最高レベルの思考能力を引き出すことができます。ただし、トークン消費量が増加するため、品質とコストのバランスを考慮してください。

Q7:Opus 4.7 は国内(中国)からの呼び出しで安定していますか?

Anthropic のインターフェースに直接接続する場合、ネットワーク環境の影響を受けやすく、特に長時間のタスクでは切断されやすい傾向があります。APIYI (apiyi.com) を経由して Opus 4.7 を呼び出すことで、国内からのアクセスの安定性問題を解決できます。プラットフォームは安定稼働しており、キャッシュ課金 0.1x を併用することで大幅なコスト削減も可能です。

Q8:新しいトークナイザーによりコストが上昇しますか?どう対応すべきですか?

新しいトークナイザーによる膨張率は、テキストの内容によって 0% から 35% の範囲(平均して約 10% から 15%)です。最も実用的な対策は、キャッシュ可能な system prompt やツール記述を前方に配置し、キャッシュ課金 0.1x をトリガーすることです。これにより、単価は上昇するどころか、逆にコストを抑えることが可能になります。

Claude Opus 4.7 パラメータ廃止の重要ポイント

- Opus 4.7 では

temperature、top_p、top_kの3大サンプリングパラメータが完全に廃止されました。値を渡すと 400 エラーが発生します。 Extended thinkingは削除され、adaptive thinkingのみがサポートされています。デフォルトはオフのため、明示的な有効化が必要です。Unexpected role "system"は Messages API の歴史的なルールです。systemはメッセージロールではなく、トップレベルに配置する必要があります。- 新しいトークナイザーにより、同じテキストでもトークン数が 4.6 より 0%〜35% 増加するため、予算と

max_tokensの再計算が必要です。 - 修正は最低3ステップ:サンプリングパラメータの削除、

systemのトップレベルへの移動、モデル名をclaude-opus-4-7に変更。 - APIYI (apiyi.com) 経由で呼び出すと、パラメータの互換性維持、キャッシュ課金 0.1x、国内からの安定した接続が利用可能です。

adaptive thinkingとoutput_config: {effort: "max"}の組み合わせが、Opus 4.7 で最高レベルの推論能力を引き出す標準的な手法です。

まとめ

Claude Opus 4.7 におけるパラメータの廃止は、一見すると「破壊的変更」のように思えますが、本質的には Anthropic がモデルを「詳細を露出するツール」から「適応型のブラックボックス」へと進化させるための重要な一歩です。開発者にとっては、これまで temperature や thinking budget といった「スイッチ」で調整していた安定性を、今後はプロンプトエンジニアリングと適応型思考(adaptive thinking)の組み合わせへと徐々に移行させる必要があることを意味します。短期的には移行コストが発生しますが、長期的にはコードが簡潔になり、モデルのパフォーマンスもより安定するでしょう。この進化の道筋は孤立したものではなく、主要な大規模言語モデルはすべて「パラメータを減らし、適応力を高める」方向へ向かっており、早く適応するほどその恩恵を享受できます。

もし現在、Opus 4.7 へのアップグレードを検討中、あるいは今回の変更が本番環境に与える影響を評価中であれば、まずは APIYI (apiyi.com) で新バージョンのデバッグを行うことをお勧めします。当プラットフォームでは Opus 4.7 を安定してサポートしており、廃止されたパラメータに対する互換性のあるダウングレード処理も実装済みです。キャッシュ利用時の課金が 0.1 倍となる点と合わせ、現在最も低コストで移行できる選択肢となっています。

トラブルを避け、効率的に開発を進められることを願っています。

— APIYI 技術チーム、AI モデルの実践的なチュートリアルは APIYI (apiyi.com) をご覧ください。