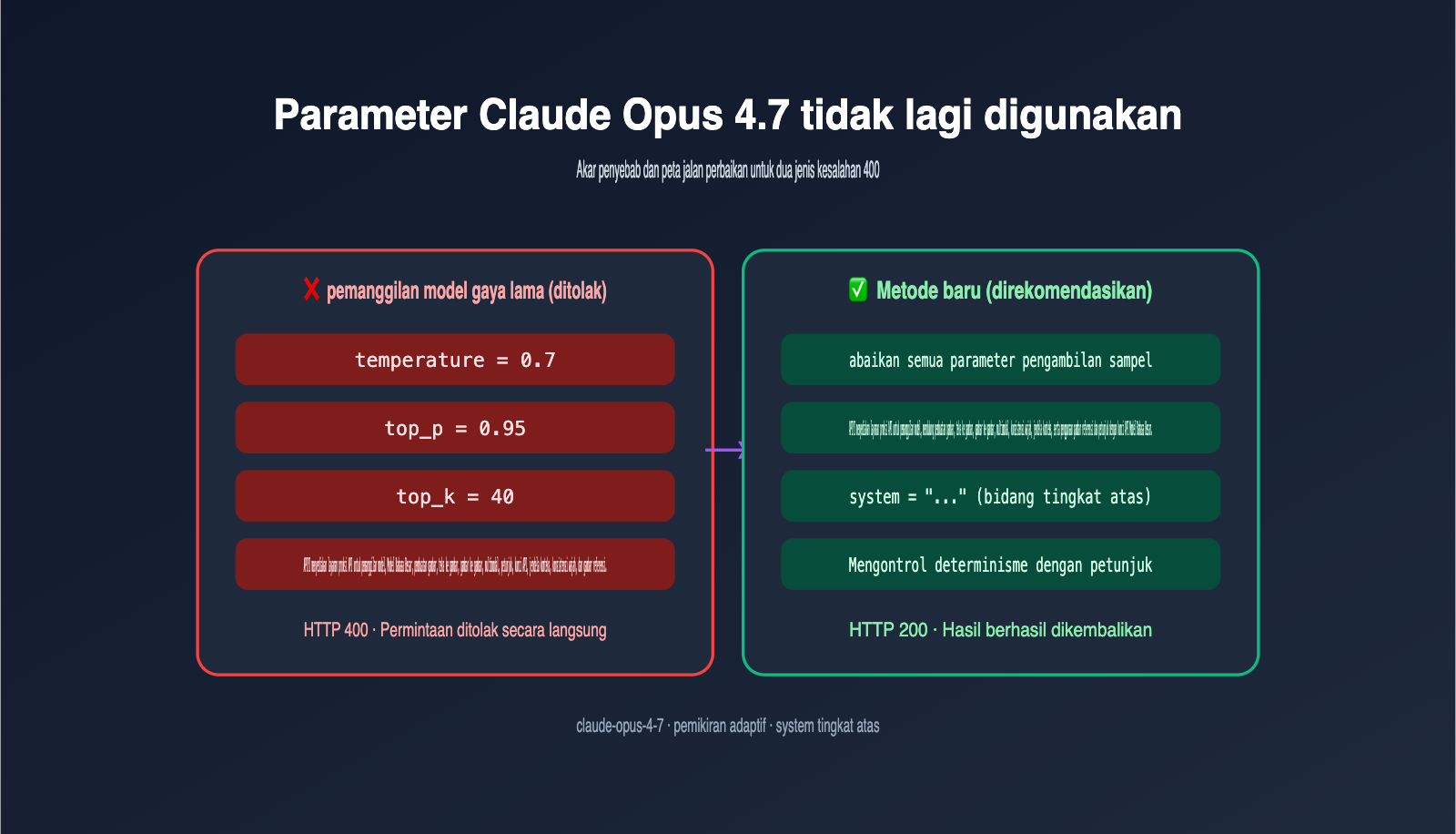

Catatan Penulis: Claude Opus 4.7 telah menghapus parameter sampling seperti temperature, top_p, top_k, dan mewajibkan penggunaan system di tingkat atas (top-level) alih-alih sebagai peran pesan (message role). Artikel ini akan menjelaskan akar penyebab dari 2 kesalahan 400 yang umum terjadi beserta solusi perbaikan kodenya.

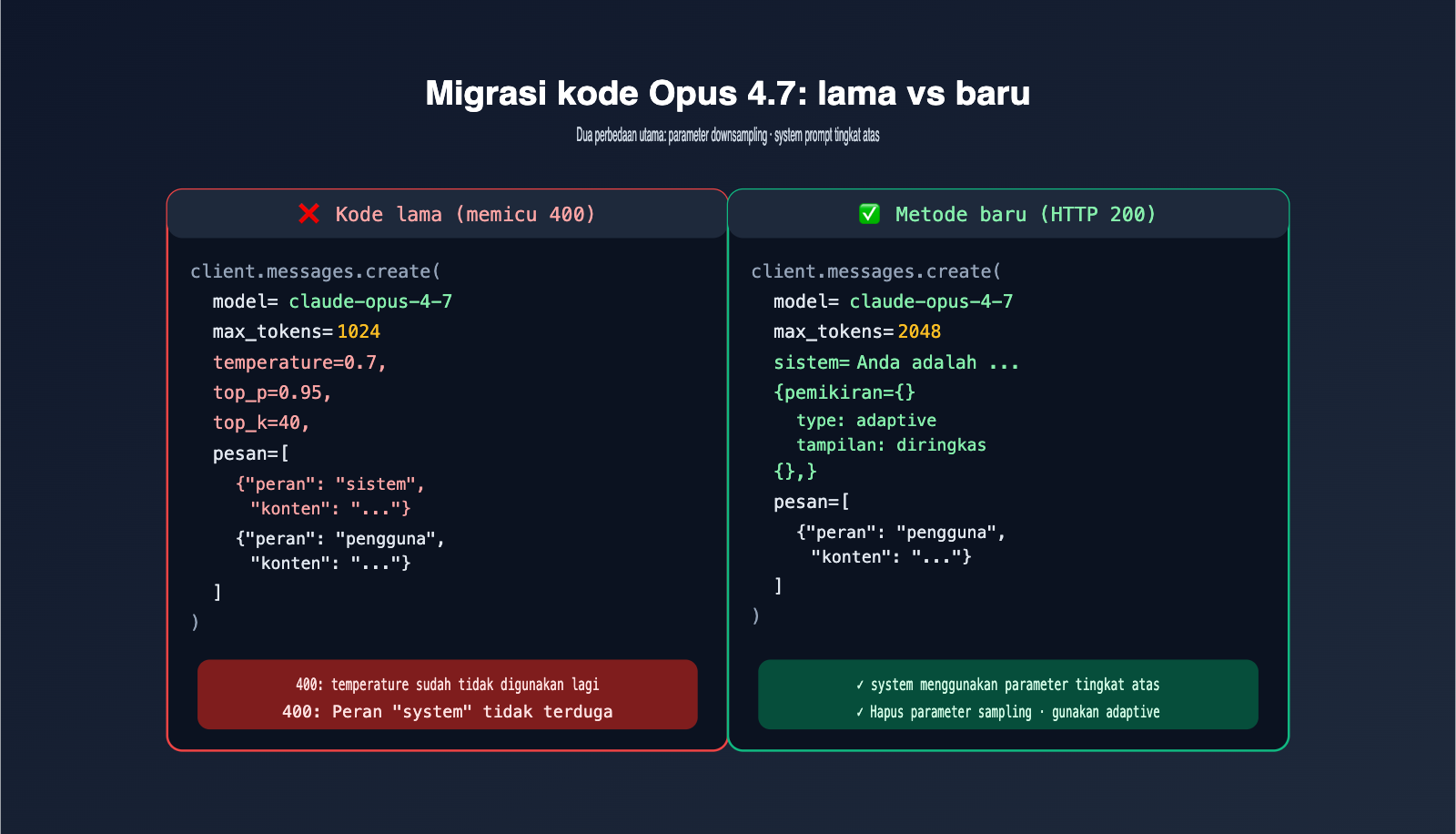

Setelah beralih ke Claude Opus 4.7, hal yang paling sering membuat pengembang terjebak bukanlah modelnya itu sendiri, melainkan parameter permintaannya. Kesalahan frekuensi tinggi pertama adalah temperature is deprecated for this model, dan yang kedua adalah Unexpected role "system". The Messages API accepts a top-level system parameter, not "system" as an input message role. Kedua kesalahan tersebut merupakan HTTP 400, yang sekilas tampak tidak berhubungan, namun sebenarnya merujuk pada satu fakta yang sama: Anthropic telah melakukan konvergensi API yang cukup agresif pada Opus 4.7.

Banyak tim, sebelum memahami perubahan ini, terbiasa menggunakan "mengatur suhu (temperature) ke 0" atau "menambahkan pesan system tambahan" sebagai solusi instan untuk meningkatkan determinisme. Opus 4.7 menutup kedua jalan tersebut secara langsung. Panduan ini akan mengupas tuntas kedua masalah ini dari sisi penyebab, pesan kesalahan, dan perbaikan, lengkap dengan kode migrasi yang bisa langsung Anda salin. Setelah membacanya, Anda tidak hanya dapat menyelesaikan kesalahan 400 dalam 10 menit, tetapi juga memahami logika di balik perubahan desain Anthropic ini agar tidak terjebak lagi saat pembaruan model berikutnya.

Parameter apa saja yang dihapus di Claude Opus 4.7

Sebelum memahami pesan kesalahan, mari kita lihat "daftar penghapusan" yang lengkap. Perubahan yang dilakukan Anthropic pada Opus 4.7 lebih banyak dari yang terlihat, dan dampaknya jauh lebih besar daripada deprecation di era 4.6.

| Parameter | Status | Perilaku | Alternatif |

|---|---|---|---|

temperature |

Dihapus | Mengatur nilai non-default akan mengembalikan 400 | Hilangkan sepenuhnya, gunakan petunjuk untuk mengontrol keacakan |

top_p |

Dihapus | Sama seperti di atas | Hilangkan sepenuhnya |

top_k |

Dihapus | Sama seperti di atas | Hilangkan sepenuhnya |

thinking.budget_tokens |

Dihapus | Anggaran eksplisit mengembalikan 400 | thinking: { type: "adaptive" } |

reasoning_effort (lama) |

Dihapus | Bidang lama tidak lagi berfungsi | output_config: { effort: "max" } |

role: "system" dalam pesan |

Tidak didukung | Selalu demikian, namun lebih ketat di 4.7 | Parameter system tingkat atas |

🎯 Wajib dibaca sebelum upgrade: Jika Anda menggunakan SDK Python, kode lama yang mengandung

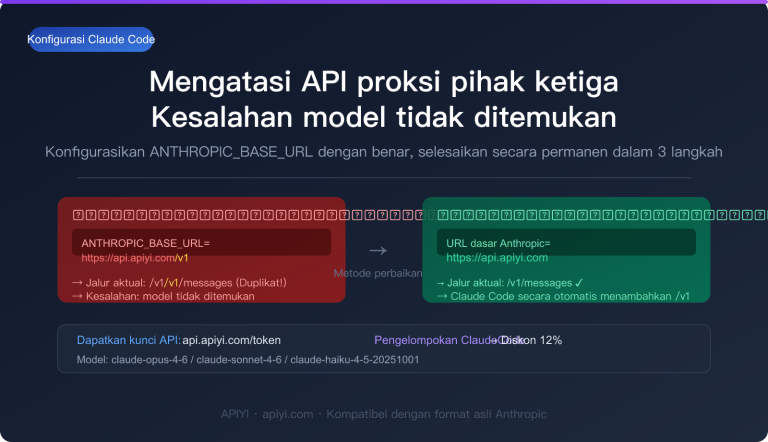

temperature=0.7,top_p=0.95, ataumessages=[{"role": "system", ...}]akan menghasilkan kesalahan 400 pada Opus 4.7. Kami menyarankan untuk mengakses Opus 4.7 melalui APIYI (apiyi.com), karena platform tersebut melakukan penurunan versi (graceful degradation) pada kompatibilitas parameter, sehingga Anda dapat beralih ke antarmuka baru dengan lancar.

Hal yang paling mudah terlewatkan dalam daftar tersebut adalah parameter thinking. Di era Opus 4.6, Anda bisa mengirim thinking: {"type": "enabled", "budget_tokens": 8000} agar model berpikir lebih lama, namun pada Opus 4.7, penggunaan ini langsung ditolak. Versi baru hanya menerima tipe adaptive, di mana model menentukan sendiri intensitas penalaran, dan adaptive thinking dinonaktifkan secara default, sehingga perlu diaktifkan secara eksplisit.

Perubahan tersembunyi lainnya adalah tokenizer. Opus 4.7 menggunakan tokenizer baru; jumlah token untuk teks yang sama pada model baru akan 0% hingga 35% lebih banyak dibandingkan 4.6. Ini berarti anggaran biaya yang Anda perkirakan berdasarkan 4.6 kemungkinan besar akan "naik secara diam-diam" di 4.7, sehingga Anda perlu memeriksa kembali tagihan Anda.

Mengapa Claude Opus 4.7 Menghapus Parameter Temperature

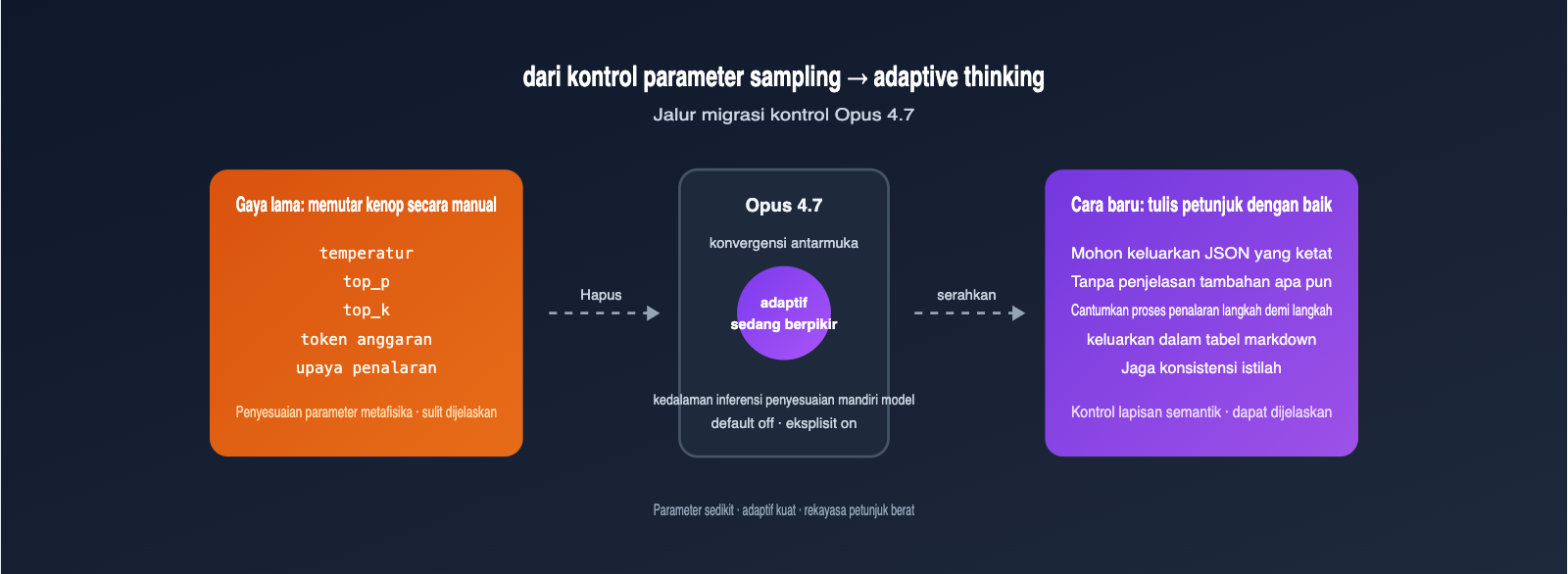

Memahami logika di balik perubahan ini akan menyelamatkan Anda dari banyak masalah. Alasan Anthropic "menarik kembali" tiga parameter sampling—temperature, top_p, dan top_k—pada Opus 4.7 pada dasarnya adalah mengubah model dari "perpustakaan parameter yang dapat disesuaikan" menjadi "kotak hitam adaptif".

Dilihat dari arsitektur modelnya, Opus 4.7 menyerahkan kendali intensitas penalaran kepada modul adaptive thinking, yang secara inheren sudah mencakup penjadwalan ketidakpastian. Artinya, metode seperti temperature untuk "mengatur keacakan pada lapisan sampling" tidak lagi kompatibel dengan logika penalaran internal model. Memaksanya justru akan merusak jalur optimasi versi baru. Anthropic secara langsung memberikan kesimpulan dalam dokumentasinya: dalam evaluasi internal, adaptive thinking secara stabil mengungguli kombinasi extended thinking dengan temperature manual.

Dari sudut pandang lain, "menghapus kenop" ini juga merupakan peningkatan yang ramah bagi pemula. Dulu, saat mengembangkan LLM, pengembang paling sering terjebak dalam kebingungan metafisika tentang "apakah temperature-nya sudah benar?". Mengaturnya bolak-balik tidak memberikan nilai optimal dan tidak bisa menjelaskan perbedaan hasil. Opus 4.7 langsung menutup jalur optimasi yang "semu" ini, sehingga semua orang bisa fokus pada desain petunjuk dan manajemen konteks, hal-hal yang benar-benar memberikan hasil stabil.

Dari sisi praktik rekayasa, penghapusan tiga parameter sampling juga berarti Anthropic tidak lagi mendorong praktik lama "mengandalkan pengaturan temperature untuk meningkatkan stabilitas". Pendekatan yang disarankan versi baru adalah menggunakan rekayasa petunjuk untuk memperjelas "Anda membutuhkan jawaban yang deterministik", "tolong keluarkan JSON yang ketat", dan sebagainya, agar model membatasi diri pada lapisan semantik, bukan dikontrol secara paksa pada lapisan sampling. Kami menyarankan tim yang menggunakan APIYI apiyi.com untuk memanggil Opus 4.7 agar secara bertahap memigrasikan kode yang sebelumnya bergantung pada temperature=0 ke penulisan "meminta determinisme secara eksplisit dalam system prompt".

Pemikiran ini sebenarnya kontras dengan "lima tingkat reasoning effort" pada GPT-5.5. OpenAI "memberikan pengembang sakelar yang lebih detail", sementara Anthropic "menarik kembali sakelar tersebut dan menyerahkannya kepada model itu sendiri". Tidak ada filosofi yang benar atau salah, tetapi keduanya jelas melemahkan peran penyetelan hiperparameter tradisional. Pelajaran terbesar bagi pengembang adalah: penyetelan LLM di masa depan akan bergeser dari "memutar kenop" menjadi "menulis petunjuk dan konteks dengan baik".

Perlu dicatat bahwa "konvergensi radikal" Anthropic kali ini bukannya tanpa pertanda. Di era Opus 4.6, dokumentasi sudah menandai extended thinking sebagai deprecated dan mengarahkan pengembang untuk beralih ke adaptive thinking. Jika Anda sudah mulai menulis kode sesuai saran saat itu, peningkatan ke 4.7 hampir tanpa biaya; sebaliknya, jika Anda selalu mengandalkan taktik lama "menaikkan temperature untuk kreativitas, menurunkan temperature untuk stabilitas", maka migrasi kali ini akan terasa cukup menyakitkan.

Solusi Perbaikan Error 400 pada Parameter Temperature

Setelah mengetahui penyebabnya, perbaikannya sangat mudah. Berikut adalah contoh perbaikan minimal yang dapat berjalan stabil di Indonesia dengan menggunakan base_url dari APIYI apiyi.com.

# pip install anthropic

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # Panggilan terpadu Opus 4.7 melalui APIYI

)

# ❌ Kode lama: akan memicu error 400 (temperature is deprecated)

# response = client.messages.create(

# model="claude-opus-4-7",

# max_tokens=1024,

# temperature=0.7,

# top_p=0.95,

# messages=[{"role": "user", "content": "Hello"}]

# )

# ✅ Kode baru: hilangkan parameter sampling sepenuhnya

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You must return strict JSON. No extra commentary.",

messages=[{"role": "user", "content": "Hello"}]

)

🎯 Saran perbaikan cepat: Ubah

base_urlkehttps://api.apiyi.comdan gunakan kunci Anthropic yang kompatibel dari APIYI apiyi.com. Anda hanya perlu menghapus tiga baris parameter sampling di kode lama agar bisa berjalan. Jika Anda khawatir tidak sempat mengubah semuanya, APIYI apiyi.com secara default melakukan penurunan versi yang mulus untuk parameter yang sudah tidak digunakan, sehingga memberikan waktu penyangga untuk migrasi Anda.

Tabel di bawah ini merangkum tiga gaya migrasi tipikal untuk membantu Anda memilih solusi yang paling tepat.

| Penggunaan Lama | Gaya Baru | Manfaat |

|---|---|---|

temperature=0 untuk determinisme |

Tulis di system prompt: "kembalikan JSON ketat, jangan ada teks tambahan" | Output lebih stabil, hemat token |

temperature=1 untuk kreativitas |

Jangan atur parameter sampling apa pun, biarkan model berkreasi | Lebih mendekati performa asli 4.7 |

top_p / top_k untuk membatasi sampling |

Gunakan effort: "max" pada adaptive thinking |

Mengganti pemotongan sampling dengan kedalaman penalaran |

Jika Anda menggunakan protokol yang kompatibel dengan OpenAI (banyak kerangka kerja pihak ketiga menggunakan standar ini), Anda perlu memeriksa apakah SDK secara diam-diam menyisipkan temperature=1.0 di latar belakang. Sudah banyak issue di komunitas karena kerangka kerja melakukan hardcode nilai default yang menyebabkan Opus 4.7 menolak permintaan. Jika menemui hal ini, Anda bisa memperbarui kerangka kerja atau menggunakan lapisan kompatibilitas dari APIYI apiyi.com.

Esensi dan Perbaikan Error Peran System

Kesalahan 400 frekuensi tinggi kedua tidak ada hubungannya dengan temperature, melainkan masalah lama yang "diperbesar kembali" pada model baru. API Messages dari Anthropic tidak pernah mendukung penulisan system sebagai peran pesan (role), namun banyak kode yang dimigrasikan dari OpenAI Chat Completions secara tidak sadar menulisnya seperti itu, sehingga memicu error Unexpected role "system".

Kunci untuk memahami hal ini adalah: Anthropic menganggap system sebagai "konfigurasi tingkat sesi" dan bukan "konten percakapan". Ia harus muncul di tingkat teratas badan permintaan, bukan di dalam array messages. Tabel di bawah ini membandingkan perbedaan antara OpenAI dan Anthropic.

| Item | OpenAI Chat Completions | Anthropic Messages |

|---|---|---|

| Posisi system | Item pertama di array messages |

Field system di tingkat teratas |

| Jumlah system | Bisa lebih dari satu | Hanya satu string |

| Error di 4.7 | Tidak ada | Unexpected role "system" 400 |

| Kesulitan migrasi | — | Rendah, cukup pindahkan posisinya |

🎯 Tips Migrasi: Jika proyek Anda memiliki logika "OpenAI / Claude dual-run", disarankan untuk membungkusnya dengan lapisan adaptor: saat memanggil OpenAI, masukkan system ke dalam messages; saat memanggil Claude, ubah menjadi

systemtingkat teratas. Dengan mengakses kedua model melalui APIYI (apiyi.com), Anda dapat mengelola keduanya dengan sistem kunci yang sama, menghindari konfigurasi berulang.

Cara memperbaikinya sangat mudah. Berikut adalah perbandingan antara penulisan yang salah dan yang benar, Anda bisa langsung menirunya.

# ❌ Penulisan salah: memicu error Unexpected role "system" 400

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

messages=[

{"role": "system", "content": "You are a coding assistant."},

{"role": "user", "content": "Write a quicksort in Python."}

]

)

# ✅ Penulisan benar: system menggunakan parameter tingkat teratas

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You are a coding assistant.",

messages=[

{"role": "user", "content": "Write a quicksort in Python."}

]

)

Perlu ditambahkan bahwa jika Anda memang ingin memberikan "instruksi system multi-bagian" kepada Claude, cara yang benar adalah menggabungkannya menjadi satu string, dipisahkan dengan baris baru atau penomoran. SDK Anthropic juga mendukung pembuatan field system dalam bentuk blok konten array, tetapi ini adalah penggunaan tingkat lanjut; bagi pemula, cukup pahami sebagai "string tunggal". Menulis seperti ini memiliki keuntungan tersembunyi: setelah digabungkan menjadi string tunggal, lebih mudah untuk memicu prompt caching di APIYI (apiyi.com), sehingga biaya tugas jangka panjang akan semakin turun.

Templat Kode Migrasi Lengkap Claude Opus 4.7

Dengan menggabungkan perbaikan untuk kedua jenis error tersebut, kode di bawah ini adalah "langkah awal Opus 4.7 yang bisa langsung dijalankan", mencakup adaptive thinking, parameter system tingkat teratas, dan penulisan yang ramah terhadap penagihan caching.

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # Memanggil Opus 4.7 melalui APIYI

)

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=2048,

system="You are an expert Python engineer. Always return strict JSON.",

thinking={

"type": "adaptive",

"display": "summarized"

},

messages=[

{"role": "user", "content": "Refactor my quicksort to be O(n log n) average."}

]

)

print(response.content[0].text)

🎯 Saran Lingkungan Produksi: Saat memanggil Opus 4.7 di APIYI (apiyi.com), letakkan system prompt yang stabil dan deskripsi alat di depan untuk memicu penagihan caching 0,1x, biaya permintaan berulang bisa ditekan hingga 10% dari harga asli. Ini sangat ramah untuk Agent jangka panjang dan tugas pembuatan dokumen.

Ada beberapa detail kecil yang perlu diperhatikan saat migrasi. Pertama, field thinking tidak wajib, tetapi jika tugas Anda sensitif terhadap kedalaman penalaran, disarankan untuk mengaktifkan adaptive thinking secara eksplisit, jika tidak, model akan tetap menggunakan mode penalaran ringan standar. Kedua, karena tokenizer baru membuat teks yang sama dihitung 0% hingga 35% lebih banyak token, anggaran max_tokens harus disesuaikan, jika tidak, output mungkin terpotong dalam skenario output panjang. Ketiga, parameter pendukung versi lama seperti thinking_budget juga harus dihapus; field yang tersisa tidak akan menyebabkan error tetapi akan diabaikan, yang dapat membuat Anda salah mengira bahwa parameter tersebut masih berlaku. Keempat, jika aplikasi Anda memanggil 4.6 dan 4.7 secara bersamaan, sebaiknya catat kaliber penagihan berdasarkan nama model untuk menghindari distorsi atribusi biaya akibat pencampuran tokenizer baru dan lama.

Jika Anda memelihara basis kode yang harus kompatibel dengan Opus 4.6 dan Opus 4.7, cara paling aman adalah membuat daftar putih parameter berdasarkan nama model. Lewati "parameter sampling + field thinking lama" saat memanggil 4.7, dan pertahankan saat memanggil 4.6, sehingga Anda tidak perlu memelihara dua fungsi pemanggilan untuk model yang berbeda.

Tabel ringkasan error di bawah ini merangkum beberapa jenis error 400 yang paling umum selama proses peningkatan ke Opus 4.7, agar Anda dapat langsung menemukan titik perbaikan berdasarkan teks error.

| Kata Kunci Error | Arti Error | Cara Perbaikan |

|---|---|---|

temperature is deprecated |

Memasukkan field temperature yang sudah tidak digunakan | Hapus sepenuhnya temperature dari badan permintaan |

top_p is deprecated |

Memasukkan field top_p yang sudah tidak digunakan | Hapus top_p, biarkan model beradaptasi |

top_k is deprecated |

Memasukkan field top_k yang sudah tidak digunakan | Hapus top_k, biarkan model beradaptasi |

| Unexpected role "system" | system ditulis di dalam array messages | Ubah menjadi field system tingkat teratas badan permintaan |

Invalid budget_tokens |

Menggunakan anggaran extended thinking versi lama | Ubah ke adaptive thinking tanpa mengirim budget |

Unknown parameter reasoning_effort |

Menggunakan field intensitas penalaran versi lama | Ubah menjadi output_config: {effort: "max"} |

FAQ Seputar Penghentian Parameter Claude Opus 4.7

Q1: Mengapa Opus 4.7 menghentikan begitu banyak parameter sekaligus?

Alasan utamanya adalah adaptive thinking kini mengambil alih tanggung jawab "mengontrol keacakan dan kedalaman penalaran" yang sebelumnya dipegang oleh temperature, top_p, top_k, dan thinking budget. Evaluasi internal Anthropic menunjukkan bahwa adaptive thinking secara konsisten mengungguli penyesuaian parameter manual, sehingga mereka memutuskan untuk menyederhanakan aksesnya.

Q2: Bisakah saya mengatur temperature ke 1.0 untuk "melewati" error?

Tidak bisa. Opus 4.7 menilai parameter sampling berdasarkan "apakah parameter tersebut dikirim", bukan "apa nilai yang dikirim". Selama kunci tersebut muncul di badan permintaan, sistem akan menganggapnya sebagai konfigurasi non-default dan mengembalikan error 400. Cara yang benar adalah dengan tidak menyertakan kolom tersebut sama sekali dalam permintaan, sehingga SDK akan menggunakan perilaku sampling default dari model itu sendiri.

Q3: Apakah memanggil Opus 4.7 melalui APIYI menggunakan OpenAI SDK akan memicu error temperature?

Tergantung pada versi SDK dan framework yang digunakan. OpenAI SDK secara default akan menyertakan temperature=1.0. Jika diteruskan langsung ke backend Anthropic, permintaan tersebut akan tetap ditolak oleh Opus 4.7. Saat menggunakan APIYI (apiyi.com), platform telah menangani masalah kompatibilitas umum semacam ini dengan elegan, sehingga kolom yang sudah tidak digunakan akan difilter secara otomatis.

Q4: Apakah error system hanya muncul di 4.7? Apakah model Claude sebelumnya tidak mengalaminya?

Tidak. API Messages Anthropic sebenarnya tidak pernah mengizinkan system ditulis di dalam array messages. Namun, validasi pada Opus 4.7 jauh lebih ketat, sementara beberapa model lama mungkin "menerimanya dengan longgar". Praktik terbaiknya adalah selalu menempatkan system di tingkat teratas badan permintaan. Setelah dipindahkan ke tingkat teratas, semua model Claude akan berfungsi dengan normal.

Q5: Berapa baris kode minimal yang perlu diubah untuk menjalankan Opus 4.7 jika migrasi dari OpenAI?

Biasanya ada tiga bagian: 1) Ubah model menjadi claude-opus-4-7; 2) Pindahkan entri system di dalam messages ke kolom system tingkat teratas; 3) Hapus parameter sampling seperti temperature, top_p, dan lainnya. Jika Anda mengarahkan base_url ke https://api.apiyi.com, seluruh proyek biasanya bisa berjalan dalam waktu kurang dari 10 menit. Jika proyek Anda memiliki puluhan titik pemanggilan, disarankan untuk membungkusnya ke dalam fungsi utilitas call_claude() agar perubahan terpusat di satu tempat jika ada perubahan API di masa mendatang.

Q6: Apakah adaptive thinking aktif secara default? Perlukah diaktifkan secara eksplisit?

Fitur ini dinonaktifkan secara default. Jika tugas Anda sensitif terhadap kedalaman penalaran (penalaran matematika, refactoring kode, perencanaan kompleks), disarankan untuk mengirim thinking: {type: "adaptive"} secara eksplisit. Anda juga bisa mengombinasikannya dengan output_config: {effort: "max"} untuk mendapatkan kemampuan berpikir maksimal. Konsekuensinya adalah penggunaan token yang lebih tinggi, jadi Anda perlu menyeimbangkan antara kualitas dan biaya.

Q7: Apakah pemanggilan Opus 4.7 stabil di Indonesia?

Koneksi langsung ke antarmuka Anthropic mungkin terpengaruh oleh kondisi jaringan, terutama untuk tugas panjang yang sering terputus. Menggunakan Opus 4.7 melalui APIYI (apiyi.com) dapat mengatasi masalah stabilitas akses domestik. Platform ini telah berjalan stabil dan mendukung caching dengan biaya 0,1x yang dapat membantu menghemat biaya secara signifikan.

Q8: Berapa kenaikan biaya akibat tokenizer baru? Bagaimana cara mengatasinya?

Inflasi token pada tokenizer baru berkisar antara 0% hingga 35% tergantung pada teksnya, dengan rata-rata sekitar 10% hingga 15%. Cara paling praktis untuk mengatasinya adalah dengan menempatkan system prompt dan deskripsi alat yang dapat di-cache di bagian depan untuk memicu penagihan caching 0,1x. Dengan cara ini, biaya per pemanggilan justru akan turun, bukan naik.

Poin Utama Penghentian Parameter Claude Opus 4.7

- Opus 4.7 sepenuhnya menghentikan tiga parameter sampling utama:

temperature,top_p, dantop_k. Mengirim nilai apa pun akan memicu error 400. - Extended thinking telah dihapus, hanya mendukung adaptive thinking, dan harus diaktifkan secara eksplisit karena default-nya mati.

Unexpected role "system"adalah aturan historis dari Messages API;systemharus berada di tingkat teratas, bukan sebagai peran dalam pesan.- Tokenizer baru membuat jumlah token untuk teks yang sama meningkat 0% hingga 35% dibandingkan versi 4.6, sehingga anggaran dan

max_tokensperlu dihitung ulang. - Perbaikan minimal hanya butuh tiga langkah: hapus parameter sampling, pindahkan

systemke tingkat teratas, dan ubah nama model menjadiclaude-opus-4-7. - Memanggil Opus 4.7 melalui APIYI (apiyi.com) memberikan keuntungan berupa penurunan versi parameter yang elegan, penagihan caching 0,1x, dan akses domestik yang stabil.

- Adaptive thinking yang dikombinasikan dengan

output_config: {effort: "max"}adalah cara standar untuk mendapatkan kemampuan penalaran terkuat di Opus 4.7.

Kesimpulan

Penghapusan parameter pada Claude Opus 4.7 mungkin terlihat seperti "perubahan destruktif", namun pada dasarnya ini adalah langkah krusial bagi Anthropic untuk mengubah model dari "alat yang mengekspos detail teknis" menjadi "kotak hitam adaptif". Bagi pengembang, ini berarti stabilitas yang dulunya dicapai melalui "tombol" seperti temperature atau thinking budget kini harus dialihkan ke kombinasi rekayasa petunjuk (prompt engineering) dan adaptive thinking. Dalam jangka pendek, ini memang membawa biaya migrasi, namun dalam jangka panjang, kode Anda akan lebih ringkas dan performa model menjadi lebih stabil. Jalur evolusi ini tidak terjadi sendirian; model bahasa besar arus utama lainnya juga bergerak ke arah "parameter lebih sedikit, adaptivitas lebih kuat". Semakin cepat Anda beradaptasi, semakin besar keuntungan yang Anda peroleh.

Jika Anda sedang melakukan peningkatan ke Opus 4.7 atau mengevaluasi dampak perubahan ini terhadap produksi, kami sarankan untuk mencoba versi baru ini melalui APIYI di apiyi.com. Platform kami telah mendukung Opus 4.7 secara stabil dan melakukan degradasi kompatibilitas untuk parameter yang sudah tidak digunakan. Ditambah dengan penagihan caching sebesar 0,1x, ini adalah jalur migrasi dengan hambatan terendah saat ini.

Semoga Anda terhindar dari kendala teknis dan bisa pulang tepat waktu.

— Tim Teknis APIYI, temukan tutorial praktis model AI lainnya di APIYI apiyi.com