El 14 de abril de 2026, OpenAI lanzó oficialmente GPT-5.4-Cyber, una variante ajustada de GPT-5.4 con un enfoque de "ciberseguridad permisiva", diseñada específicamente para labores de defensa en ciberseguridad. A diferencia del modelo de consumo general, este reduce el umbral de rechazo para tareas relacionadas con la investigación de seguridad y, por primera vez, admite de forma pública capacidades de ingeniería inversa binaria, permitiendo analizar ejecutables compilados sin necesidad de código fuente para identificar vulnerabilidades y código malicioso.

Este modelo solo está disponible para investigadores de seguridad e instituciones que cuentan con la certificación de nivel más alto del programa Trusted Access for Cyber de OpenAI; no es una API pública para desarrolladores comunes. El momento del lanzamiento también es estratégico: ocurrió exactamente una semana después del producto equivalente de Anthropic, Claude Mythos, lo que demuestra que la competencia en el nuevo sector de "IA × Ciberseguridad" se está intensificando.

¿Qué es GPT-5.4-Cyber? Un resumen rápido

Dejando de lado los detalles técnicos, aquí tienes una tabla para captar toda la información clave de este lanzamiento en 30 segundos:

| Dimensión | Hecho |

|---|---|

| Fecha de lanzamiento | 14 de abril de 2026 |

| Desarrollador | OpenAI |

| Posicionamiento del modelo | Variante ajustada "cyber-permissive" de GPT-5.4 |

| Objetivo principal | Trabajos de defensa en ciberseguridad |

| Nueva capacidad clave | Ingeniería inversa binaria (sin código fuente) |

| Método de acceso | Certificación de nivel superior del programa Trusted Access for Cyber |

| Acceso personal | chatgpt.com/cyber (verificación de identidad) |

| Acceso empresarial | Solicitud a través de representantes de OpenAI |

| Alcance | Miles de defensores individuales, cientos de equipos de seguridad |

| Precios | No revelados oficialmente |

| Competencia principal | Anthropic Claude Mythos (lanzado una semana antes) |

Este modelo es diferente a cualquier GPT que los desarrolladores conozcan: no está diseñado para chatear, escribir código o actuar como asistente, sino que es una "llave de cumplimiento" para investigadores de seguridad, destinada a desbloquear escenarios específicos que, bajo las políticas de seguridad del GPT-5.4 estándar, serían rechazados.

📌 Conclusión en una frase: GPT-5.4-Cyber es una puerta estrecha que OpenAI ha abierto para el grupo de "investigadores de seguridad de alto nivel"; no es un modelo público para desarrolladores comunes. Más adelante en este artículo responderemos a la pregunta clave: "¿Se puede acceder a él a través de plataformas de API de terceros?".

Desglose de las cinco capacidades clave de GPT-5.4-Cyber

Según las declaraciones oficiales de OpenAI y los informes de terceros, las diferencias entre este modelo y el GPT-5.4 estándar se centran en cinco dimensiones.

Capacidad 1: Estrategia de seguridad flexible (cyber-permissive)

Esta es la filosofía central de todo el modelo. Durante el entrenamiento, el GPT-5.4 ordinario rechaza por defecto las solicitudes que "parecen ataques maliciosos o explotación de vulnerabilidades". Esta estrategia de "más vale prevenir que lamentar" protege al usuario promedio, pero es un dolor de cabeza para los investigadores de seguridad legítimos, quienes a menudo son bloqueados por el modelo con un "lo siento, no puedo ayudarte con esto" al realizar pruebas de penetración, investigación de vulnerabilidades o análisis de código malicioso.

GPT-5.4-Cyber baja esta barrera específicamente para los "investigadores de seguridad certificados", permitiéndole analizar a fondo ideas de explotación de vulnerabilidades, discutir principios de exploits, ayudar a escribir PoCs y otros escenarios en los que la versión estándar no colaboraría.

Capacidad 2: Ingeniería inversa de binarios

Esta es la nueva capacidad con mayor carga técnica de este lanzamiento. Tradicionalmente, la ingeniería inversa de binarios depende de herramientas profesionales como IDA Pro, Ghidra o Binary Ninja, sumadas al análisis manual de investigadores de seguridad. GPT-5.4-Cyber puede analizar directamente archivos binarios compilados, logrando:

- Identificar posibles vulnerabilidades (desbordamiento de búfer, cadenas de formato, UAF, etc.) sin tener acceso al código fuente.

- Analizar el comportamiento de muestras maliciosas (comunicaciones C2, persistencia, anti-depuración).

- Restaurar la lógica de flujo de control de archivos ejecutables.

- Ayudar a generar o verificar reglas YARA.

Esto significa que los equipos de seguridad pueden delegar la etapa de filtrado inicial a la IA, permitiendo que los investigadores humanos se centren en las partes más complejas.

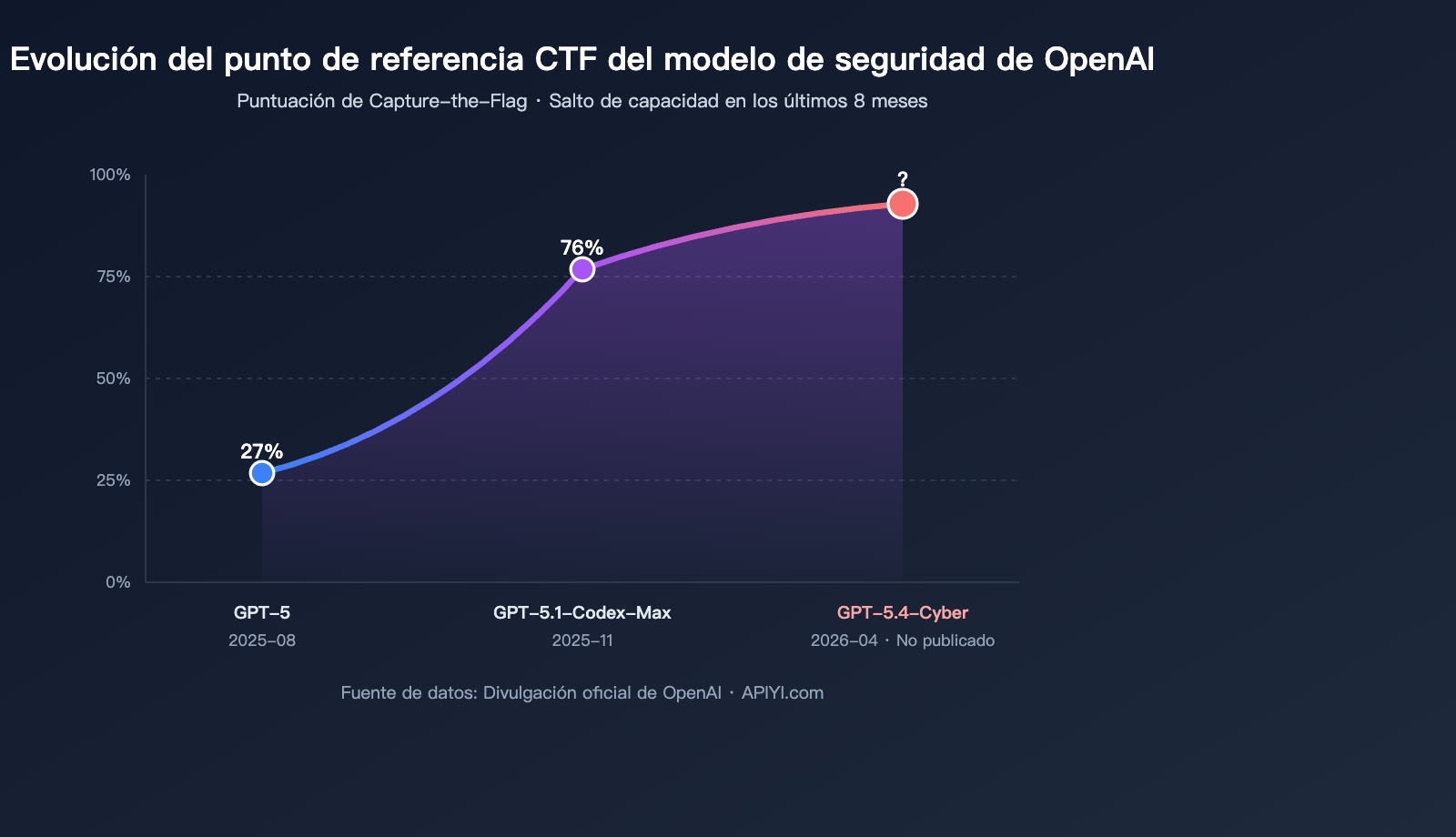

Capacidad 3: Salto rápido en la referencia CTF

OpenAI reveló en sus materiales de lanzamiento un conjunto de datos de rendimiento con valor de referencia, que reflejan la evolución del modelo en escenarios de ciberseguridad:

- Puntuación de referencia en Capture-the-Flag para GPT-5 (agosto de 2025): 27%

- Puntuación de referencia en CTF para GPT-5.1-Codex-Max (noviembre de 2025): 76%

Aunque no se han hecho públicas las puntuaciones específicas de CTF del propio GPT-5.4-Cyber, esta curva indica que OpenAI ha invertido una gran cantidad de recursos de entrenamiento y alineación en capacidades de seguridad durante el último año.

Capacidad 4: Reducción del umbral de rechazo (Refusal Boundary)

Los filtros de seguridad de los GPT tradicionales tienen una tasa de falsos rechazos muy alta en escenarios de investigación de seguridad. La decisión de producto clave de GPT-5.4-Cyber es: poner la potestad de ajustar el umbral de rechazo en manos de la "autenticación de identidad". Dentro del grupo de usuarios autenticados, el modelo utiliza una escala más apropiada para abordar temas de seguridad, evitando convertirse en una "versión jailbreak" de GPT, pero sin bloquear radicalmente cualquier palabra de riesgo como la versión estándar.

Detrás de esto hay una cadena de confianza de identidad completa: verificación de documento de identidad Persona → autenticación en niveles de Trusted Access → el modelo ajusta la estrategia de respuesta según el nivel de certificación.

Capacidad 5: Posicionamiento defensivo (Defensive Only)

En todos los materiales de lanzamiento, OpenAI enfatiza repetidamente la "ciberseguridad defensiva" en lugar de la ofensiva. Se trata de un posicionamiento político deliberado: el modelo es para los defensores (equipos azules, proveedores de seguridad, instituciones de investigación), no para los atacantes. Esta postura determina que la auditoría de acceso sea muy estricta, algo que se detallará más adelante.

| Dimensión de capacidad | GPT-5.4 estándar | GPT-5.4-Cyber |

|---|---|---|

| Rigurosidad de la estrategia de seguridad | Alta (rechazo por defecto) | Flexible y controlada (basada en el nivel de certificación) |

| Ingeniería inversa de binarios | Soporte limitado | Soporte profundo (punto de venta principal) |

| Discusión sobre principios de explotación | Rechazo en la mayoría de casos | Discusión profunda tras la certificación |

| Análisis de muestras maliciosas | Descripción superficial | Puede asistir en un análisis completo |

| Requisito de acceso | API de pago pública | Requiere el nivel más alto de Trusted Access |

| Usuarios previstos | Todos los desarrolladores | Investigadores de seguridad certificados |

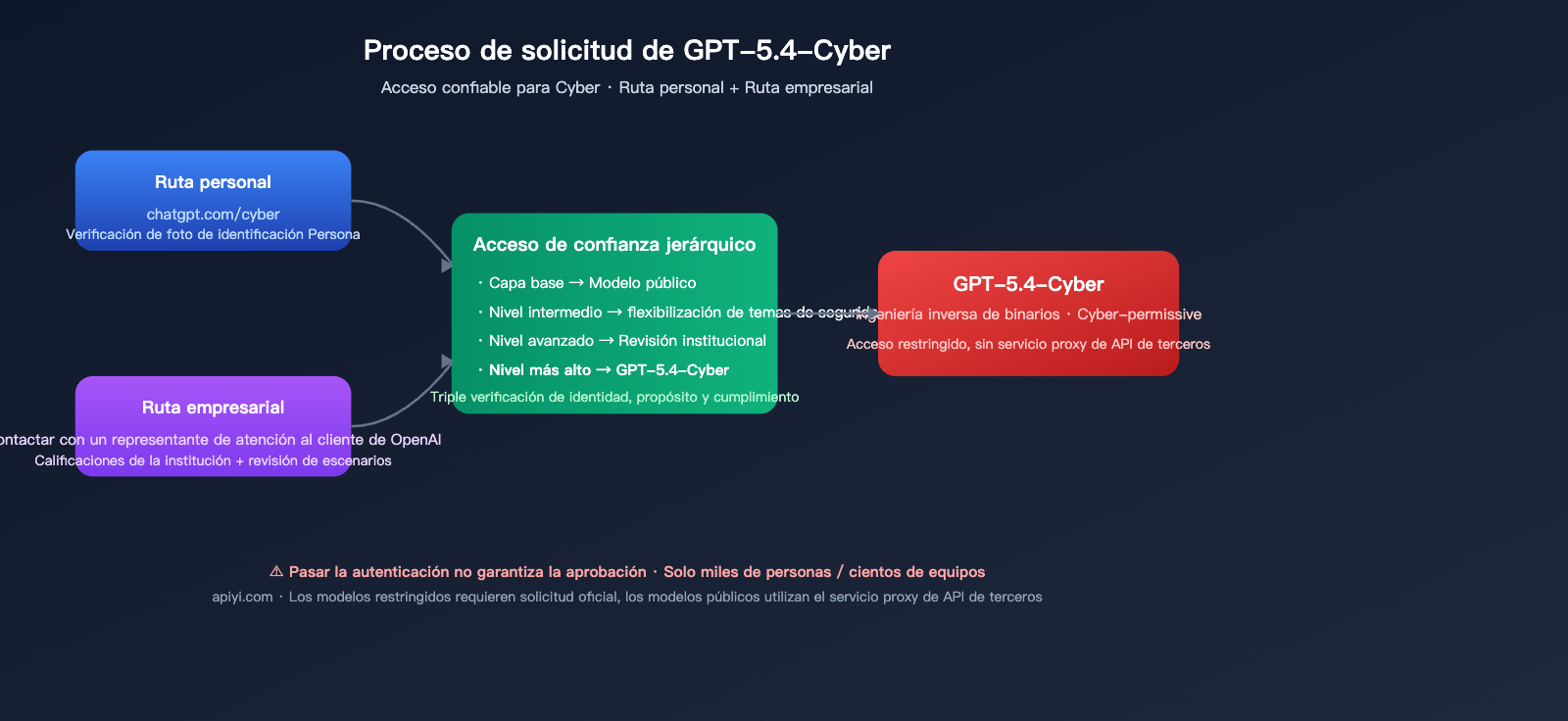

¿Cómo solicitar GPT-5.4-Cyber? Niveles y proceso de Trusted Access

Trusted Access for Cyber es un proyecto iniciado por OpenAI en febrero de 2026, junto con el cual se lanzó un fondo de subvenciones para ciberseguridad de 10 millones de dólares. La mayor novedad de la actualización del 14 de abril es la expansión de la "admisión o rechazo" de grano grueso original a una admisión por niveles, vinculando la calificación de acceso al nivel más alto con GPT-5.4-Cyber.

Tabla comparativa de certificación por niveles

| Nivel | Público objetivo | Capacidad disponible | Método de verificación |

|---|---|---|---|

| Nivel base | Usuarios de ChatGPT registrados | Modelos públicos como GPT-5.4 estándar | Cuenta convencional |

| Nivel medio | Profesionales de seguridad verificados | Respuestas a temas de seguridad con menos restricciones | Foto de documento de identidad Persona |

| Nivel alto | Equipos e instituciones de seguridad verificados | Procesamiento de tareas de seguridad más flexible | Verificación doble (institución + personal) |

| Nivel superior | Investigadores clave de instituciones certificadas | Acceso a GPT-5.4-Cyber | Requiere auditoría de OpenAI |

Proceso de solicitud personal

- Visita

chatgpt.com/cyber. - Usa el servicio de verificación de identidad Persona para subir una foto de un documento de identidad emitido por el gobierno.

- El sistema determina el nivel de certificación.

- Si se obtiene la calificación del nivel superior, se puede solicitar la inclusión en la lista gris de GPT-5.4-Cyber.

Proceso de solicitud empresarial

- Contacta a tu representante de cuenta de OpenAI.

- Presenta los antecedentes del equipo, la explicación de los casos de uso y los compromisos de cumplimiento.

- Tras pasar la auditoría, activa el nivel superior de Trusted Access para miembros específicos en el espacio de trabajo.

- Los miembros solicitan el acceso a GPT-5.4-Cyber dentro del espacio de trabajo.

⚠️ Nota: OpenAI ha declarado explícitamente que ampliará el acceso con mucha precaución inicialmente; incluso después de completar la verificación de identidad, no significa que necesariamente se obtendrá el derecho de acceso a GPT-5.4-Cyber. El objetivo de cobertura son "miles de defensores individuales y cientos de equipos de seguridad", lo cual representa un recurso muy escaso comparado con la escala global de la industria de la seguridad.

¿Es posible invocar GPT-5.4-Cyber a través de plataformas API de terceros? La respuesta honesta

Esta es la pregunta que más preocupa a muchos lectores. Basándonos en el diseño de producto expuesto públicamente por OpenAI, ofrecemos una respuesta sin rodeos.

🚨 Conclusión actual: No es posible

El acceso a GPT-5.4-Cyber está profundamente vinculado a la identidad de la cuenta de OpenAI y no se suministra a través de los canales de API convencionales. Esto significa que:

- ❌ No está disponible para el público general ni para desarrolladores a través de la API oficial de OpenAI.

- ❌ No se puede invocar a través de ninguna plataforma de servicio proxy de API de terceros, incluyendo APIYI (apiyi.com).

- ❌ No se puede obtener mediante la compra de una clave API, ya que se trata de una "credencial de identidad" y no de una "credencial de pago".

- ✅ Solo se puede utilizar en ChatGPT o en entornos de trabajo empresariales exclusivos mediante cuentas con la certificación de nivel superior Trusted Access for Cyber.

Esto viene determinado por el posicionamiento del producto: si GPT-5.4-Cyber pudiera saltarse la verificación de identidad mediante un servicio proxy de API, sus características "cyber-permissive" se convertirían inmediatamente en blanco de abusos por parte de atacantes. OpenAI ha eliminado esta ruta desde el diseño mismo.

Comparativa de alternativas disponibles

Para desarrolladores e investigadores con diferentes necesidades, sugerimos las siguientes rutas realistas:

| Tu necesidad | Solución recomendada |

|---|---|

| Soy un investigador de seguridad avanzado certificado y requiero las capacidades genuinas de GPT-5.4-Cyber | Solicita acceso oficial en chatgpt.com/cyber, no utilices servicios proxy |

| Necesito un GPT-5.4 estándar para desarrollo de IA general | Invócalo a través de la interfaz unificada de APIYI (apiyi.com) |

| Desarrollo scripts de asistencia de seguridad, pero no soy el usuario objetivo de GPT-5.4-Cyber | Invoca modelos públicos como GPT-5 / GPT-5.4 / Claude a través de APIYI |

| Solo quiero aprender sobre seguridad o realizar análisis no sensibles | Un GPT-5.4 estándar es suficiente; cualquier plataforma API pública sirve |

💡 Recordatorio honesto importante: APIYI (apiyi.com) no proporciona acceso a GPT-5.4-Cyber, esto se debe a la estricta política de lanzamiento de OpenAI, no es una elección comercial de APIYI. Si en el futuro alguna plataforma de terceros afirma "poder gestionar GPT-5.4-Cyber", lo más probable es que sea un servicio gris que viola los términos de uso de OpenAI o que incluso incurre en suplantación de identidad; por favor, actúa con cautela.

¿Qué puede hacer APIYI por ti?

Para la gran mayoría de los escenarios que no involucran a GPT-5.4-Cyber, APIYI (apiyi.com) sigue siendo tu mejor aliado:

from openai import OpenAI

client = OpenAI(

api_key="TU-CLAVE-APIYI",

base_url="https://api.apiyi.com/v1"

)

# Puedes invocar tanto GPT-5.4 estándar como GPT-5

response = client.chat.completions.create(

model="gpt-5.4",

messages=[

{"role": "user", "content": "Ayúdame a analizar posibles riesgos de inyección SQL en este código"}

]

)

print(response.choices[0].message.content)

Este código puede ejecutarse de forma estable en la interfaz unificada de APIYI, correspondiendo a la versión pública de GPT-5.4, no a GPT-5.4-Cyber. Es más que suficiente para realizar revisiones de código, generación de documentación e integración de negocios.

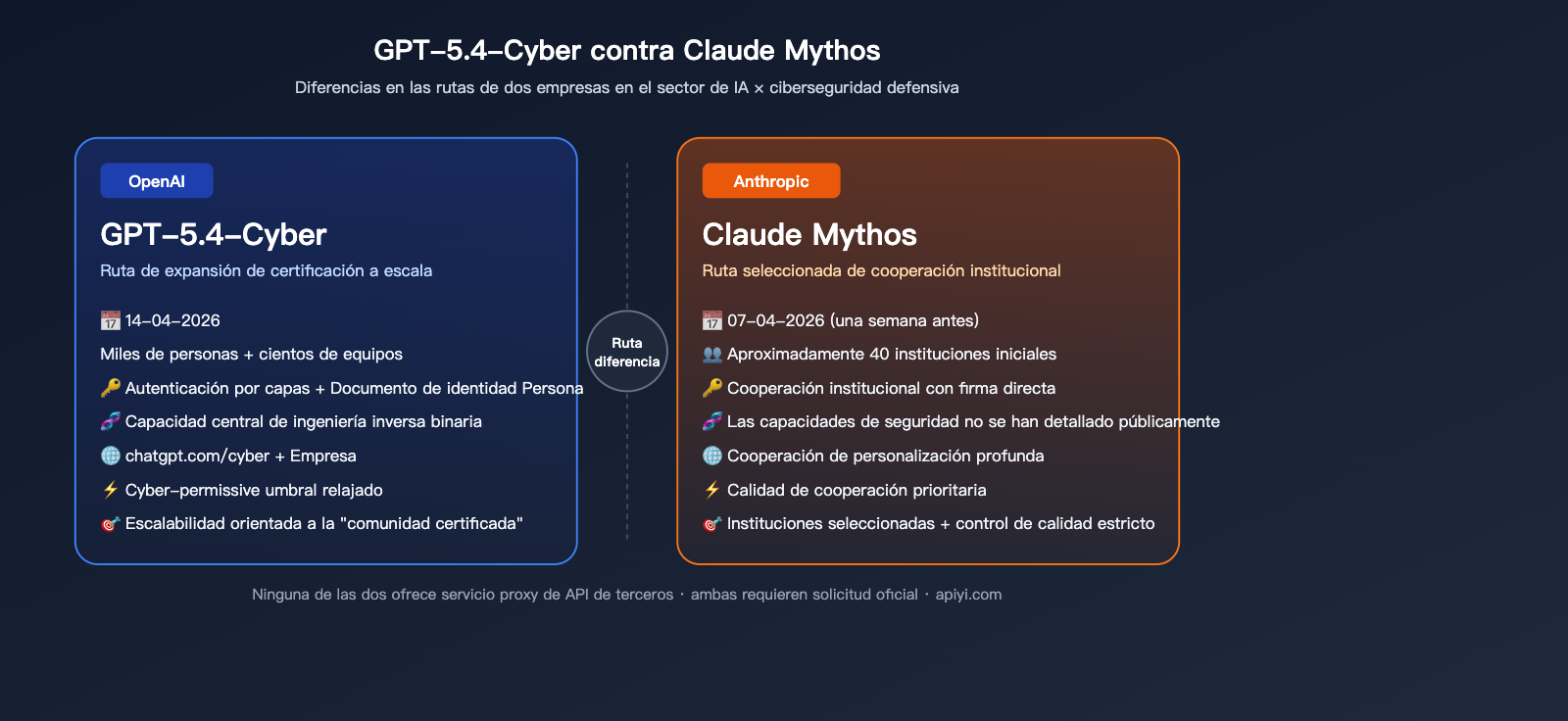

GPT-5.4-Cyber frente a Anthropic Claude Mythos: Diferencias en sus estrategias

Claude Mythos se lanzó una semana antes que GPT-5.4-Cyber, y ambos representan dos enfoques diferentes de la "IA aplicada a la ciberseguridad defensiva".

| Dimensión comparativa | OpenAI GPT-5.4-Cyber | Anthropic Claude Mythos |

|---|---|---|

| Fecha de lanzamiento | 14-04-2026 | 07-04-2026 (una semana antes) |

| Modelo base | Variante ajustada de GPT-5.4 | Variante de Claude |

| Estrategia de acceso | Acceso por niveles, abierto a petición | Cooperación institucional profunda |

| Escala inicial | Miles de personas + cientos de equipos | Alrededor de 40 organizaciones |

| Principal atractivo | Ingeniería inversa binaria + cyber-permissive | No detallado públicamente |

| Canales de distribución | chatgpt.com/cyber + gestión de cuentas corporativas | Cooperación institucional |

| Tendencia estratégica | Escalar hacia una "comunidad certificada" | Selección de instituciones para cooperación profunda |

Podemos observar que las rutas elegidas por ambas empresas son completamente distintas: OpenAI elige un modelo escalable basado en la "verificación como acceso", esperando beneficiar al mayor número posible de profesionales de seguridad certificados; mientras que Anthropic elige un modelo selectivo de "cooperación institucional", sacrificando la cobertura a gran escala para asegurar un control de calidad más riguroso. A largo plazo, ambas rutas tienen su mercado y, lo más probable, es que coexistan durante muchos años.

Análisis del impacto en la industria y los desarrolladores

Impacto 1: El rol de la IA en la cadena de herramientas de seguridad se "oficializa"

En el pasado, los investigadores de seguridad utilizaban ChatGPT para revisiones de código y análisis de vulnerabilidades de forma "improvisada", enfrentándose constantemente a bloqueos por políticas de seguridad. El lanzamiento de GPT-5.4-Cyber significa que, por primera vez, OpenAI trata a los "investigadores de seguridad" como un grupo de usuarios independiente. En el futuro, veremos cada vez más modelos verticales específicos para la industria.

Impacto 2: La autenticación de identidad + desbloqueo de capacidades se convierte en un nuevo paradigma

GPT-5.4-Cyber utiliza la verificación de identidad mediante Persona y un acceso por niveles para desbloquear capacidades; este es un modelo de producto bastante novedoso dentro de la IA de propósito general. En escenarios altamente regulados como las finanzas, la medicina y el derecho, podemos esperar la aparición de más combinaciones de "identidad + niveles de capacidad del modelo".

Impacto 3: El posicionamiento de las plataformas de API de terceros es más claro

Para plataformas de API unificadas de terceros como APIYI (apiyi.com), el caso de GPT-5.4-Cyber marca una frontera clara: los modelos de acceso restringido se gestionan mediante conexión oficial directa, mientras que los modelos públicos son gestionados por plataformas de servicio proxy de API para facilitar la labor de los desarrolladores. Ambos mercados son complementarios, no competitivos.

Impacto 4: Mejora sustancial en la eficiencia del equipo azul (Blue Team)

Si la capacidad de ingeniería inversa de binarios de GPT-5.4-Cyber es tan madura como afirma la empresa, la eficiencia de los equipos azules en tareas como el análisis de muestras maliciosas, auditoría de firmware y análisis de Patch Diff experimentará un salto de magnitud. Esta es una excelente noticia para toda la industria.

Preguntas frecuentes (FAQ)

P1: ¿Tienen los desarrolladores individuales oportunidad de usar GPT-5.4-Cyber?

Si usted es un investigador de seguridad registrado con escenarios de negocio claros, y logra alcanzar el nivel más alto de Trusted Access mediante la verificación de identidad de Persona, tiene oportunidad. Si solo siente curiosidad por probar el modelo, básicamente no tiene oportunidad. Se recomienda a los desarrolladores comunes centrarse en el GPT-5.4 de acceso público, el cual se puede invocar de forma estable a través de la interfaz unificada de APIYI (apiyi.com).

P2: ¿Se pueden saltar las restricciones mediante VPN o falsificando la identidad?

No es recomendable, y no debería hacerlo. Una vez detectada la falsificación de identidad o el abuso, la cuenta será bloqueada directamente y podría afectar la elegibilidad de acceso de toda su institución. El control de riesgos de Trusted Access es muy estricto.

P3: ¿Existe información sobre precios?

OpenAI no ha revelado los precios de GPT-5.4-Cyber. Según la práctica habitual de la industria, es muy probable que este tipo de modelo vertical altamente restringido se suministre mediante acuerdos empresariales o suscripciones por puesto, en lugar de utilizar el modelo de facturación por token de las API comunes.

P4: ¿Se puede usar GPT-5.4-Cyber para realizar ataques?

Tanto por diseño como por los términos de uso, no está permitido. El modelo está orientado a la "ciberseguridad defensiva"; violar los términos conlleva el riesgo de bloqueo de cuenta y consecuencias legales. El sistema Trusted Access de OpenAI le exigirá firmar un compromiso de normas de uso.

P5: ¿Cuándo estará disponible GPT-5.4-Cyber en APIYI (apiyi.com)?

No se espera que esté disponible, ya que el mecanismo de distribución del modelo excluye por diseño el uso de proxies de terceros. APIYI continuará expandiendo el soporte para modelos de lanzamiento público como GPT-5, GPT-5.4, la serie o y Claude, cubriendo las necesidades diarias de la mayoría de los desarrolladores.

P6: ¿Qué relación tiene GPT-5.4-Cyber con Codex y la serie o?

Los tres son líneas de productos de OpenAI pero con posicionamientos diferentes: Codex se centra en la generación de código, la serie o en el razonamiento profundo, y GPT-5.4-Cyber es una variante ajustada para escenarios de seguridad. Puede haber solapamiento en capacidades, pero los mecanismos de acceso son totalmente distintos.

P7: ¿Cómo pueden solicitarlo los equipos de seguridad pequeños y medianos?

A través de los representantes de clientes (o canales comerciales) de OpenAI, enviando las credenciales del equipo, escenarios de uso y compromisos de cumplimiento. Inicialmente, OpenAI dará prioridad a las instituciones con credenciales claras y propósitos de uso definidos. Se recomienda a los equipos pequeños sin canales directos acumular primero materiales de cumplimiento antes de solicitarlo.

P8: ¿Pueden usarlo las empresas en China?

Los servicios de OpenAI están sujetos a restricciones geográficas, y la conexión directa desde entidades locales presenta problemas de cumplimiento y disponibilidad. Si solo necesita utilizar GPT-5.4 para capacidades de IA general, puede realizar la invocación a través de las interfaces accesibles de APIYI (apiyi.com); para capacidades de alta sensibilidad como GPT-5.4-Cyber, se recomienda contactar con el negocio internacional de OpenAI a través de canales de cumplimiento.

Resumen: Un modelo "para nichos, pero con un impacto enorme"

Volviendo a la pregunta inicial: ¿Qué significa realmente GPT-5.4-Cyber?

- Para los investigadores de seguridad: Es una llave certificada oficialmente que permite desbloquear tareas de análisis que los modelos estándar no pueden resolver, especialmente en capacidades de ingeniería inversa de binarios, lo que cambiará sustancialmente el flujo de trabajo diario del equipo azul (blue team).

- Para los desarrolladores comunes: Es muy probable que no necesites este modelo, pero no te preocupes: la versión pública de GPT-5.4 ya es suficiente para cubrir el 95% de las necesidades diarias de desarrollo con IA, y puedes acceder a ella de forma estable y sencilla a través de APIYI apiyi.com.

- Para la industria: El modelo de producto basado en autenticación de identidad y acceso estratificado será adoptado por más escenarios verticales; la división del trabajo entre las plataformas de API de terceros y los modelos restringidos oficiales será cada vez más clara.

- Para el panorama competitivo: El enfrentamiento directo entre OpenAI y Anthropic en modelos de ciberseguridad ya ha comenzado, y las diferencias en sus enfoques reflejan sus distintas interpretaciones sobre la "seguridad de la IA".

📢 Recomendación rápida: Los investigadores de seguridad que cumplan con los requisitos deben realizar la solicitud oficial en chatgpt.com/cyber; los desarrolladores comunes pueden seguir utilizando el GPT-5.4 estándar a través de APIYI apiyi.com, es más que suficiente. Ten cuidado con cualquier servicio de terceros que afirme "poder realizar llamadas en nombre de GPT-5.4-Cyber", ya que eso viola los términos de servicio o, simplemente, es una estafa.

Autor: Equipo de APIYI · Seguimiento continuo de las tendencias de lanzamiento e integración de Modelos de Lenguaje Grande · apiyi.com