¿Quieres usar IA para generar vídeos 2K en alta definición con audio nativo por lotes, pero te has dado cuenta de que la API de Seedance 2.0 aún no está abierta oficialmente? Este es el dilema al que se enfrentan muchos desarrolladores y creadores de contenido hoy en día. En este artículo, analizaremos a fondo las 5 capacidades principales de Seedance 2.0 para ayudarte a dominar la arquitectura técnica y los métodos de acceso a la API de este último modelo de generación de vídeo de ByteDance.

Valor principal: Al terminar de leer, conocerás a fondo las capacidades técnicas, las formas de acceso a la API y las mejores prácticas de Seedance 2.0, para que puedas integrarlo en cuanto la API esté disponible oficialmente.

Vistazo rápido a la información clave de la API de Seedance 2.0

Antes de profundizar en los detalles técnicos, echemos un vistazo rápido a los datos fundamentales de Seedance 2.0.

| Elemento | Detalles |

|---|---|

| Nombre del modelo | Seedance 2.0 (Serie Seed de ByteDance) |

| Publicado por | ByteDance |

| Lanzamiento previsto de la API | 24 de febrero de 2025 (Volcán Engine/BytePlus) |

| Canales disponibles actualmente | Sitio web de Jimeng (Dreamina), depuración en línea en el panel de Volcán Engine/BytePlus |

| Resolución de salida | Hasta 2K (soporta salida de nivel de producción a 1080p) |

| Duración del vídeo | 4-15 segundos |

| Relaciones de aspecto | 16:9, 9:16, 4:3, 3:4, 21:9, 1:1 |

| Modalidades de entrada | Texto + Imágenes (0-5) + Vídeo + Audio |

| Audio nativo | Generación sincronizada de diálogos, sonido ambiental y efectos |

| Plataformas disponibles | Jimeng, Volcán Engine, APIYI apiyi.com (soporte simultáneo tras el lanzamiento de la API) |

🎯 Nota importante: Se espera que la API de Seedance 2.0 se lance el 24 de febrero. En ese momento, los desarrolladores podrán acceder rápidamente a través de la interfaz unificada de la plataforma APIYI (apiyi.com), sin necesidad de realizar la integración por separado con Volcán Engine.

Las 5 capacidades principales de la API de Seedance 2.0

Seedance 2.0 representa una actualización integral en comparación con su predecesor, Seedance 1.5 Pro. A continuación, presentamos las 5 capacidades principales que más interesan a los desarrolladores.

Capacidad 1 de Seedance 2.0: Texto a video (Text-to-Video)

La capacidad de generar video a partir de texto es la función más básica y, a la vez, la más potente de Seedance 2.0. Solo necesitas ingresar una descripción textual y el modelo generará contenido de video de alta calidad.

Mejoras clave respecto a la versión 1.5:

| Dimensión de mejora | Seedance 1.5 Pro | Seedance 2.0 | Magnitud de la mejora |

|---|---|---|---|

| Realismo físico | Simulación física básica | Gravedad, momento y causalidad precisos | Mejora significativa |

| Dinámica de movimiento | Fluida pero a veces poco natural | Continuidad de movimiento altamente natural | Mejora significativa |

| Estética visual | Calidad HD | Calidad estética de nivel cinematográfico | Mejora notable |

| Resolución de imagen | 1080p | Hasta 2K | Resolución duplicada |

| Generación de escenas | Principalmente escenas únicas | Generación automática de escenas/guion gráfico | Nueva capacidad |

| Velocidad de generación | Velocidad estándar | Aumento de velocidad de aprox. 30% | Eficiencia mejorada |

La comprensión de las leyes físicas en Seedance 2.0 ha alcanzado un nuevo nivel: en secuencias de acción complejas, la gravedad, el momento y las relaciones de causa y efecto se mantienen precisos. Esto significa que en los videos que generes, las trayectorias de los objetos, los efectos de colisión y la interacción con el entorno serán mucho más realistas y creíbles.

La función de guion gráfico automático es uno de los aspectos más destacados de la función de texto a video de Seedance 2.0. El modelo puede descomponer automáticamente un texto narrativo en múltiples tomas coherentes, asegurando que la apariencia de los personajes, los detalles del entorno y la continuidad narrativa se mantengan consistentes entre las diferentes tomas.

Capacidad 2 de Seedance 2.0: Imagen a video (Image-to-Video)

La generación de imagen a video es la capacidad de transformar imágenes de referencia estáticas en videos dinámicos. Seedance 2.0 ha logrado un salto cualitativo en esta dirección.

Puntos clave de la actualización:

- Optimización de microexpresiones: Las microexpresiones faciales de los personajes son más delicadas y naturales, con transiciones fluidas en parpadeos, sonrisas y ceños fruncidos.

- Continuidad del movimiento: La transición de la imagen estática al video dinámico es más natural, sin saltos de fotogramas ni vibraciones.

- Consistencia del personaje: Los rasgos faciales, la vestimenta y la complexión del personaje se mantienen constantes en diferentes ángulos y secuencias de múltiples tomas.

- Consistencia de los objetos: La forma, posición y relación de luces y sombras de los objetos en la escena permanecen estables.

- Coherencia de la escena: El entorno de fondo no sufre cambios bruscos durante la reproducción del video.

- Representación de detalles del producto: Se ha reforzado significativamente la capacidad de recrear texturas, logotipos, empaques y otros detalles de los productos.

🎯 Consejo para aplicaciones comerciales: La capacidad mejorada de Seedance 2.0 para representar detalles de productos la hace ideal para la creación de videos de productos para comercio electrónico. Al llamar a la API de Seedance 2.0 a través de APIYI (apiyi.com), puedes generar videos de exhibición para tus productos de forma masiva.

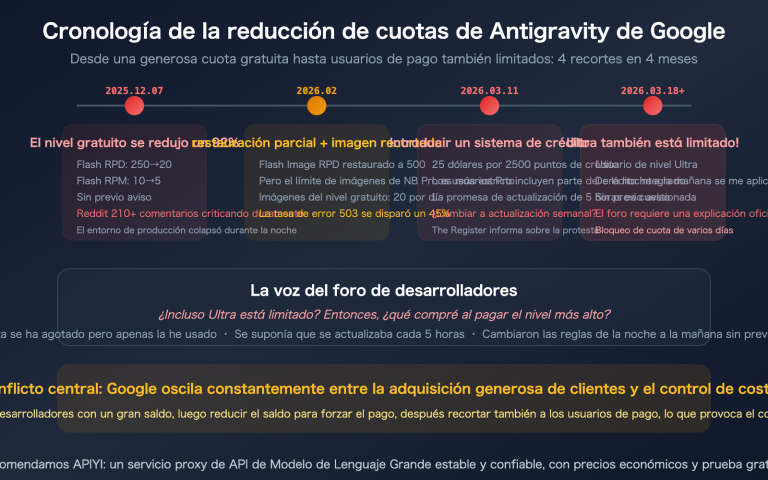

Capacidad 3 de Seedance 2.0: Múltiples imágenes de referencia y entrada multimodal

Esta es una de las capacidades más diferenciadoras de Seedance 2.0. El modelo admite la recepción simultánea de múltiples modalidades de entrada, logrando un control preciso sobre la creación.

Sistema de entrada de cuatro modalidades:

| Modalidad de entrada | Cantidad soportada | Uso |

|---|---|---|

| Imagen | 0-5 imágenes (hasta 9 en ciertos casos) | Referencia de personaje, de escena o de estilo |

| Video | Hasta 3 clips (duración total ≤15s) | Referencia de movimiento o de movimiento de cámara |

| Audio | Hasta 3 clips (MP3, duración total ≤15s) | Referencia de ritmo, de diálogo o de sonido ambiental |

| Texto | Descripción en lenguaje natural | Descripción de la escena, comandos de acción o especificación de estilo |

La capacidad de búsqueda de múltiples imágenes de referencia es una ventaja única de Seedance 2.0. Puedes proporcionar de 0 a 5 imágenes de referencia, y el modelo extraerá las características clave para fusionarlas en el video generado. Por ejemplo:

- Proporcionar 1 imagen de rostro + 1 video de movimiento + 1 ritmo de audio → Generar un video de un personaje específico bailando al ritmo.

- Proporcionar 3 imágenes de un producto desde diferentes ángulos → Generar un video de exhibición del producto con una rotación de 360 grados.

- Proporcionar 1 imagen de escena + descripción de texto → Generar un video con una acción específica en la escena indicada.

Capacidad 4 de Seedance 2.0: Generación de audio nativa

Seedance 2.0 ha implementado la primera cogeneración audiovisual nativa (Audio-Visual Co-generation) de la industria, sincronizando la generación de imágenes de video y contenido de audio en un solo proceso de inferencia.

Puntos destacados de la capacidad de audio:

- Generación de diálogos: Soporta generación de voz en múltiples idiomas como chino, inglés y español, con una sincronización labial precisa.

- Efectos de sonido ambiental: Genera automáticamente sonidos ambientales que coinciden con la imagen (viento, agua, ruido urbano, etc.).

- Sincronización de efectos: Los efectos de sonido de las acciones se sincronizan con precisión con los movimientos en pantalla (pasos, colisiones, etc.).

- Referencia de voz real: Permite la entrada de voz real de referencia para más de 2 sujetos.

- Precisión de voz: La precisión en la generación de voz para idiomas como chino, inglés y español ha mejorado significativamente.

- Sin necesidad de postproducción: Mientras que los flujos tradicionales requieren añadir efectos de sonido y doblaje por separado, Seedance 2.0 lo completa todo de una vez.

Esto significa que los desarrolladores pueden obtener directamente un archivo de video con audio completo mediante una sola llamada a la API, simplificando enormemente el flujo de producción de contenido.

Capacidad 5 de Seedance 2.0: Edición y extensión de video

Además de generar videos desde cero, Seedance 2.0 también permite la edición y extensión de videos ya existentes.

| Capacidad de edición | Descripción | Limitaciones |

|---|---|---|

| Extensión de video | Extiende de forma natural la imagen y la trama basándose en un video existente | Video de entrada ≤15s |

| Completado de video | Completa de forma inteligente las partes faltantes de un video | Video de entrada ≤15s |

| Edición limitada | Ajusta el estilo, el tono cromático y otros aspectos de videos cortos | Video de entrada <15s |

| Entrada simultánea | Permite ingresar imágenes y videos simultáneamente como referencia | Hay límites en la cantidad total de imágenes + videos |

Guía de integración de la API de Seedance 2.0

Estado actual de la API de Seedance 2.0

Al momento de publicar este artículo (febrero de 2025), el estado de la API de Seedance 2.0 es el siguiente:

- Volcengine: Aún no se ha lanzado oficialmente; el panel de control ofrece depuración en línea.

- BytePlus (versión internacional): Aún no se ha lanzado oficialmente; el panel de control ofrece depuración en línea.

- Dreamina (即梦): Ya se puede experimentar en su versión web.

- Lanzamiento oficial de la API: Previsto para el 24 de febrero de 2025.

Para los desarrolladores que ya utilizan las API de Seedance 1.5 Pro o Seedream 4.5, la buena noticia es que la interfaz de la API de Seedance 2.0 mantiene una alta compatibilidad, por lo que el costo de migración es muy bajo.

Código de inicio rápido para la API de Seedance 2.0

A continuación, se muestra un ejemplo básico de llamada a la API de Seedance 2.0 (basado en el estilo de la API de Volcengine; podrá usarse directamente tras el lanzamiento oficial):

Ejemplo minimalista de Texto a video (T2V)

import requests

import json

# Llamada a la API de Seedance 2.0 a través de APIYI

API_BASE = "https://api.apiyi.com/v1"

API_KEY = "your-api-key"

def text_to_video(prompt, aspect_ratio="16:9", duration=5):

"""Llamada a Texto a video de Seedance 2.0"""

response = requests.post(

f"{API_BASE}/video/generations",

headers={

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

},

json={

"model": "seedance-2.0",

"prompt": prompt,

"aspect_ratio": aspect_ratio,

"duration": duration,

"audio": True # Habilitar generación de audio nativo

}

)

return response.json()

# Generar un video con audio

result = text_to_video(

prompt="Un Golden Retriever corriendo por la playa, el sol brilla sobre el mar, las olas rompen en la orilla",

aspect_ratio="16:9",

duration=8

)

print(f"URL del video: {result['data']['url']}")

print(f"Audio generado en sincronía: {result['data']['has_audio']}")

Ver código completo de Imagen a video (I2V)

import requests

import json

import base64

from pathlib import Path

API_BASE = "https://api.apiyi.com/v1"

API_KEY = "your-api-key"

def image_to_video(image_paths, prompt, aspect_ratio="16:9", duration=5):

"""

Llamada a Imagen a video de Seedance 2.0

Soporta la entrada de 0 a 5 imágenes de referencia

"""

# Codificar imágenes de referencia

images = []

for path in image_paths:

with open(path, "rb") as f:

img_data = base64.b64encode(f.read()).decode()

images.append({

"type": "image",

"data": img_data

})

response = requests.post(

f"{API_BASE}/video/generations",

headers={

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

},

json={

"model": "seedance-2.0",

"prompt": prompt,

"references": images,

"aspect_ratio": aspect_ratio,

"duration": duration,

"audio": True,

"resolution": "2k" # Usar resolución 2K

}

)

result = response.json()

if result.get("status") == "processing":

task_id = result["data"]["task_id"]

print(f"Tarea enviada, ID: {task_id}")

# Las tareas asíncronas requieren polling para obtener el resultado

return poll_result(task_id)

return result

def poll_result(task_id, max_wait=300):

"""Consulta continua (polling) para obtener el resultado de la generación"""

import time

for _ in range(max_wait // 5):

time.sleep(5)

resp = requests.get(

f"{API_BASE}/video/generations/{task_id}",

headers={"Authorization": f"Bearer {API_KEY}"}

)

data = resp.json()

if data["data"]["status"] == "completed":

return data

elif data["data"]["status"] == "failed":

raise Exception(f"Error en la generación: {data['data']['error']}")

raise TimeoutError("Tiempo de espera agotado")

# Ejemplo de uso: generar un video de exhibición a partir de fotos de un producto

result = image_to_video(

image_paths=["product_front.jpg", "product_side.jpg"],

prompt="Exhibición del producto con rotación de 360 grados, iluminación suave, fondo blanco",

aspect_ratio="1:1",

duration=6

)

print(f"Video generado: {result['data']['url']}")

🚀 Inicio rápido: Se recomienda utilizar la plataforma APIYI (apiyi.com) para acceder a la API de Seedance 2.0. Esta plataforma ofrece una interfaz unificada compatible con Volcengine, sin necesidad de registrar una cuenta por separado en Volcengine, permitiendo completar la integración en solo 5 minutos.

Comparativa entre Seedance 2.0 y los principales modelos de video de IA

Conocer el posicionamiento de Seedance 2.0 en el panorama actual de la generación de video por IA te ayudará a tomar mejores decisiones tecnológicas.

| Dimensión de comparativa | Seedance 2.0 | Sora 2 | Kling 3.0 | Veo 3.1 |

|---|---|---|---|---|

| Resolución máxima | 2K | 1080p | 1080p | 1080p |

| Duración del video | 4-15s | 5-20s | 5-10s | 5-8s |

| Audio nativo | ✅ Soporte completo | ✅ Soportado | ❌ No soportado | ✅ Soportado |

| Entrada de múltiples imágenes de ref. | ✅ 0-5 imágenes | ❌ No soportado | ✅ 1-2 imágenes | ❌ No soportado |

| Entrada multimodal | Cuatro modalidades (Texto/Imagen/Video/Audio) | Texto/Imagen | Texto/Imagen | Texto/Imagen |

| Realismo físico | Excelente | Nivel superior | Excelente | Excelente |

| Naturalidad del movimiento | Excelente | Excelente | Nivel superior | Excelente |

| Narrativa multicámara | ✅ Guion gráfico auto. | ✅ Soportado | ❌ No soportado | ✅ Soportado |

| Edición de video | ✅ Soporte limitado | ✅ Soportado | ❌ No soportado | ❌ No soportado |

| Velocidad de generación | Rápida (video de 5s < 60s) | Más lenta | Rápida | Media |

| Disponibilidad de la API | Lanzamiento 24 feb | Ya disponible | Ya disponible | Ya disponible |

| Plataformas disponibles | Volcengine, APIYI apiyi.com | OpenAI | Kuaishou |

Ventajas únicas de Seedance 2.0

Seedance 2.0 presenta ventajas competitivas claras en los siguientes tres aspectos:

- Sistema de entrada de cuatro modalidades: Actualmente es el único modelo de generación de video que soporta la entrada simultánea de texto, imagen, video y audio, ofreciendo una precisión de control creativo muy superior a productos similares.

- Soporte para múltiples imágenes de referencia: Permite la extracción y fusión de características de 0 a 5 imágenes de referencia, lo cual es ideal para aplicaciones comerciales que requieren un control preciso de personajes y escenarios.

- Resolución nativa 2K: Ofrece la resolución de salida más alta entre los modelos de su clase, satisfaciendo las demandas de producción de contenido de nivel profesional.

💡 Sugerencia de elección: El modelo de video que elijas dependerá de tu caso de uso específico. Si necesitas un control preciso multimodal y resolución 2K, Seedance 2.0 es la mejor opción. Recomendamos probar varios modelos simultáneamente a través de la plataforma APIYI (apiyi.com), que permite llamadas unificadas a Seedance 2.0, Sora 2 y otros modelos líderes para comparar resultados rápidamente.

Escenarios de aplicación típicos de la API de Seedance 2.0

Las capacidades multimodales de Seedance 2.0 la hacen ideal para diversos escenarios comerciales y creativos.

Videos de productos para comercio electrónico

Gracias a la función de imagen a video (Image-to-Video) y la capacidad de usar múltiples imágenes de referencia, los vendedores pueden generar rápidamente videos de exhibición de alta calidad a partir de unas pocas fotos. La expresividad mejorada de Seedance 2.0 en los detalles permite recrear con precisión texturas, logotipos y empaques del producto.

Creación de contenido para videos cortos

La función de guion gráfico (storyboard) automático en la generación de texto a video y la creación de audio nativo permiten a los creadores generar videos cortos con locución y efectos de sonido completos a partir de una simple descripción de texto, reduciendo significativamente la barrera de entrada para la producción de contenido.

Humanos digitales y presentadores virtuales

La optimización de microexpresiones de Seedance 2.0 y su capacidad de generación de voz multilingüe (compatible con chino, inglés, español, entre otros), junto con la entrada de voz de referencia, permite crear videos de humanos digitales con expresiones ricas y una sincronización labial precisa.

Generación masiva de material publicitario

Combinando la entrada de múltiples imágenes de referencia y las capacidades de edición de video, los equipos de publicidad pueden generar rápidamente múltiples versiones de un video publicitario basadas en el mismo conjunto de materiales para realizar pruebas A/B.

Preguntas frecuentes sobre la API de Seedance 2.0

P1: ¿Cuándo estará disponible oficialmente la API de Seedance 2.0?

Según fuentes internas, se espera que la API de Seedance 2.0 se lance oficialmente el 24 de febrero de 2025. En ese momento, los servicios de API estarán disponibles a través de Volcano Engine (Volcano Ark) y BytePlus. Si quieres ser de los primeros en usarla, te recomendamos seguir la plataforma APIYI (apiyi.com), que ofrecerá el servicio de acceso a la interfaz unificada de Seedance 2.0 en cuanto la API esté disponible.

P2: ¿Es muy costoso migrar de Seedance 1.5 Pro a la versión 2.0?

El costo de migración es muy bajo. La interfaz de la API de Seedance 2.0 mantiene una alta compatibilidad con la versión 1.5 Pro; los cambios principales son la adición de parámetros para múltiples imágenes de referencia y entrada de audio. El código existente para llamadas de texto a video e imagen a video funcionará en la versión 2.0 básicamente sin modificaciones.

P3: ¿Cuál es el precio por uso de la API de Seedance 2.0?

Aún no se ha anunciado el precio oficial de Seedance 2.0. Tomando como referencia el sistema de precios de Seedance 1.5 Pro, se espera que se facture según la duración del video y la resolución. Te sugerimos estar atento a la plataforma APIYI (apiyi.com) para obtener la información de precios más reciente, ya que suelen ofrecer métodos de facturación más flexibles.

P4: ¿Hay alguna forma de probar Seedance 2.0 con antelación?

Puedes probarlo a través de los siguientes canales:

- Sitio web de Dreamina: Visita el sitio oficial

jimeng.jianying.compara usar Seedance 2.0 directamente en línea. - Panel de Volcano Engine: Inicia sesión en la consola de Volcano Engine; puedes realizar pruebas en línea en el área de depuración de modelos.

- Panel de BytePlus: Los usuarios fuera de China pueden realizar pruebas y depuraciones a través de la consola de BytePlus.

P5: ¿Qué idiomas admite la generación de voz de Seedance 2.0?

La generación de audio nativo de Seedance 2.0 admite varios idiomas, incluidos chino, inglés y español. En cuanto a la precisión de la generación de voz, estos idiomas han tenido mejoras significativas, especialmente en la precisión de la sincronización labial y la naturalidad de la entonación.

Resumen de integración de la API de Seedance 2.0

Seedance 2.0, la última generación de modelos de generación de video de ByteDance, ha logrado avances significativos en áreas como la entrada multimodal, el audio nativo y la resolución 2K. Especialmente su sistema de entrada de cuatro modalidades y la capacidad de búsqueda con múltiples imágenes de referencia ofrecen a los desarrolladores una precisión de control creativo sin precedentes.

Resumen de puntos clave:

- Soporte para entrada de cuatro modalidades: texto + imágenes (0-5 fotos) + video + audio.

- Salida nativa en resolución 2K, con una velocidad de generación un 30% más rápida.

- Co-generación sincronizada de audio y video (pionera en la industria): obtén un video completo con una sola llamada.

- Narrativa automática con múltiples tomas (storyboarding), manteniendo una alta consistencia en personajes y escenarios.

- Se espera que la API se lance el 24 de febrero, con una alta compatibilidad con la interfaz de la versión 1.5 Pro.

Recomendamos integrar la API de Seedance 2.0 rápidamente a través de APIYI (apiyi.com). Esta plataforma permite llamar a múltiples modelos de generación de video dominantes mediante una interfaz unificada, lo que facilita la comparación de resultados y la selección de la mejor solución para tu proyecto.

Este artículo fue escrito por el equipo técnico de APIYI, enfocado en las últimas tendencias en el campo de la generación de video con IA. Para más tutoriales sobre el uso de modelos de IA, visita el centro de ayuda de APIYI en apiyi.com.

Referencias

-

Presentación oficial de Seedance: Documentación de la serie de modelos Seed de ByteDance.

- Enlace:

byteplus.com/en/product/seedance

- Enlace:

-

Plataforma Dreamina (Jimeng): Acceso para probar Seedance 2.0 online.

- Enlace:

jimeng.jianying.com

- Enlace:

-

Volcano Engine ModelArk: Registro de lanzamiento del modelo.

- Enlace:

docs.byteplus.com/en/docs/ModelArk/1159178

- Enlace: