El evento más dramático de la IA en marzo de 2026: un modelo anónimo llamado "Hunter Alpha" apareció silenciosamente en OpenRouter, consumiendo 500 mil millones de tokens por semana y con un rendimiento que rivaliza con GPT-5.2 y Claude Opus 4.6. Los desarrolladores de todo el mundo se preguntaban: "¿Es este el DeepSeek V4?".

La respuesta sorprendió a todos: se trata del MiMo V2 Pro de Xiaomi. Una empresa de telefonía móvil que, en menos de un año, ha creado un Modelo de Lenguaje Grande de billones de parámetros de primer nivel mundial.

Junto a este, se lanzó el MiMo V2 Omni, un modelo multimodal capaz de procesar de forma nativa texto, imágenes, vídeo y más de 10 horas de audio continuo. Ambos modelos ya están disponibles en la plataforma APIYI para que los desarrolladores puedan invocarlos directamente.

Valor principal: Al leer este artículo, conocerás el nivel real de capacidad de MiMo V2 Pro y Omni, sus diferencias frente a la competencia y por qué son actualmente unos de los modelos de IA con mejor relación calidad-precio.

El caso Hunter Alpha: cómo Xiaomi sacudió el mundo de la IA

Cronología

| Fecha | Evento |

|---|---|

| Principios de 2026 | Un modelo con el nombre en clave "Hunter Alpha" aparece de forma anónima en OpenRouter |

| Durante varias semanas | Consume 500 mil millones de tokens por semana; desarrolladores de todo el mundo lo usan |

| Debate en la comunidad | Rendimiento cercano a modelos cerrados de primer nivel; se especula que es DeepSeek V4 |

| 18-19 de marzo de 2026 | Xiaomi revela oficialmente: Hunter Alpha = MiMo V2 Pro |

| Mismo día | Se lanzan simultáneamente MiMo V2 Omni y MiMo V2 Flash |

| Día del anuncio | Las acciones de Xiaomi suben aproximadamente un 4% |

Por qué este evento es tan impactante: Una empresa conocida por sus teléfonos y domótica ha entrenado, en menos de un año, un Modelo de Lenguaje Grande de billones de parámetros, situándose directamente en el top 10 mundial. Lo más sorprendente es que el responsable principal del equipo, Luo Fuli, fue uno de los contribuyentes clave de los modelos innovadores de DeepSeek.

🎯 Información útil: MiMo V2 Pro y MiMo V2 Omni ya están disponibles en la plataforma APIYI (apiyi.com), donde los desarrolladores pueden invocarlos directamente. Con el nivel de rendimiento de MiMo V2 Pro y un precio de $1/$3, es uno de los modelos de inferencia con mejor relación calidad-precio del mercado.

title: "Análisis de MiMo V2: El nuevo estándar en modelos de lenguaje y multimodales"

description: "Descubre las capacidades de MiMo V2 Pro y Omni, los nuevos modelos de alto rendimiento con una relación costo-beneficio sin precedentes."

MiMo V2 Pro: Modelo de inferencia de un billón de parámetros

Especificaciones clave

| Parámetro | Detalles |

|---|---|

| Nombre del modelo | MiMo V2 Pro (anteriormente Hunter Alpha) |

| Fecha de lanzamiento | 18-19 de marzo de 2026 |

| Parámetros totales | Aprox. 1 billón (arquitectura MoE) |

| Parámetros activos | 42B (activados por inferencia) |

| Ventana de contexto | 1,048,576 tokens (1M) |

| Salida máxima | 131,072 tokens (128K) |

| Entrada/Salida | Solo texto |

| Capacidad de razonamiento | Soporta razonamiento extendido (etiqueta <think>) |

| Estado de código abierto | Cerrado (acceso vía API) |

| Líder de desarrollo | Luo Fuli (ex miembro clave de DeepSeek) |

Rendimiento en benchmarks: 8.º a nivel mundial, 2.º en China

| Benchmark | MiMo V2 Pro | Ranking |

|---|---|---|

| Índice de inteligencia Artificial Analysis | 49 | #8 mundial |

| PinchBench | 84.0 | #3 mundial |

| ClawEval (Capacidad de agente) | 61.5 | #3 mundial |

| GDPval-AA | 1434 Elo | #1 en China |

| Precisión matemática | 94.0% | Top |

| Precisión de codificación | 92.5% | Supera a Claude Sonnet 4.6 |

| Tasa de alucinación | 30% | Superior a su clase |

Hallazgo clave: MiMo V2 Pro ocupa el 3.er lugar mundial en tareas de tipo agente (ClawEval), solo por detrás de Claude Opus 4.6 (66.3) y otro modelo. Esto significa que destaca en razonamiento de múltiples pasos, invocación de herramientas y ejecución autónoma de tareas.

Precios: 1/6 del costo para un rendimiento equivalente

| Rango de contexto | Entrada (por millón de tokens) | Salida (por millón de tokens) |

|---|---|---|

| ≤ 256K | $1.00 | $3.00 |

| 256K – 1M | $2.00 | $6.00 |

Comparativa de precios con la competencia:

| Modelo | Entrada | Salida | Relativo a MiMo V2 Pro |

|---|---|---|---|

| MiMo V2 Pro | $1.00 | $3.00 | Base |

| Claude Sonnet 4.6 | $3.00 | $15.00 | 5x más caro |

| Claude Opus 4.6 | $15.00 | $75.00 | 25x más caro |

| GPT-5.2 | ~$7.50 | ~$30.00 | 10x más caro |

La capacidad de codificación de MiMo V2 Pro supera a Claude Sonnet 4.6, pero a solo 1/5 de su precio. Su capacidad de agente se acerca a Claude Opus 4.6, pero a solo 1/25 del costo.

💡 Recomendación de valor: MiMo V2 Pro es actualmente uno de los modelos de bajo costo con mayor capacidad de inferencia del mercado. Puedes invocarlo directamente a través de APIYI (apiyi.com), ideal para escenarios de desarrollo sensibles al costo pero exigentes en calidad.

MiMo V2 Omni: Modelo de IA multimodal

MiMo V2 Omni es el buque insignia multimodal de Xiaomi: un modelo con arquitectura unificada que soporta nativamente texto, imágenes, video y audio.

Especificaciones clave

| Parámetro | Detalles |

|---|---|

| Nombre del modelo | MiMo V2 Omni |

| Fecha de lanzamiento | 18-19 de marzo de 2026 |

| Ventana de contexto | 256K tokens |

| Modalidades de entrada | Texto + Imagen + Video + Audio |

| Modalidades de salida | Texto |

| Procesamiento de audio | Soporta 10+ horas de audio continuo (primicia en la industria) |

| Precios | Entrada $0.40/MTok · Salida $2.00/MTok |

Destacados de capacidad multimodal

1. Razonamiento visual superior a Claude Opus 4.6

En los benchmarks MMMU-Pro (razonamiento visual multidisciplinario) y CharXiv RQ (análisis de gráficos complejos), MiMo V2 Omni supera a Claude Opus 4.6, acercándose al nivel de Gemini 3.

2. Comprensión de 10 horas de audio continuo

Esta es una capacidad pionera en la industria: puede procesar más de 10 horas de audio continuo en una sola solicitud sin degradación de calidad. Escenarios de aplicación:

- Análisis y resumen completo de grabaciones de reuniones

- Extracción de contenido de podcasts/entrevistas

- Comprensión de diálogos de voz de larga duración

- Análisis conjunto de audio y video

3. Invocación nativa de herramientas y posicionamiento de UI

El modelo Omni incorpora capacidades de invocación de herramientas estructuradas, ejecución de funciones y posicionamiento de elementos de UI, lo que permite su uso directo en marcos de trabajo de agentes de IA sin necesidad de encapsulamiento adicional.

4. Demostración práctica

En la presentación, Xiaomi mostró un flujo de trabajo completo de Omni:

El usuario proporciona una solicitud

↓

Omni redacta el guion de forma autónoma

↓

Se graban 4 escenas

↓

Edición, síntesis de voz, reparación de errores de renderizado

↓

Se sube y publica un video corto de 15 segundos

Todo el proceso se completó de forma totalmente autónoma.

Precios: Máxima rentabilidad multimodal

| Ítem de facturación | Precio |

|---|---|

| Entrada | $0.40 / millón de tokens |

| Salida | $2.00 / millón de tokens |

Es uno de los modelos multimodales con el precio más bajo actualmente. En comparación con Gemini 3.1 Pro ($2/$12) y Claude Opus 4.6 ($15/$75), la ventaja de precio de Omni es enorme.

🚀 Escenarios de aplicación: Si tu aplicación necesita procesar imágenes, videos o audio de larga duración, MiMo V2 Omni es una opción extremadamente rentable. Puedes invocarlo directamente a través de APIYI (apiyi.com), con soporte para el formato estándar compatible con OpenAI.

title: "MiMo V2 Pro vs Modelos líderes globales: Análisis comparativo"

description: "Comparamos el rendimiento de MiMo V2 Pro frente a los gigantes del sector. Descubre por qué es el rey de la relación calidad-precio."

MiMo V2 Pro vs Modelos líderes globales: Análisis comparativo

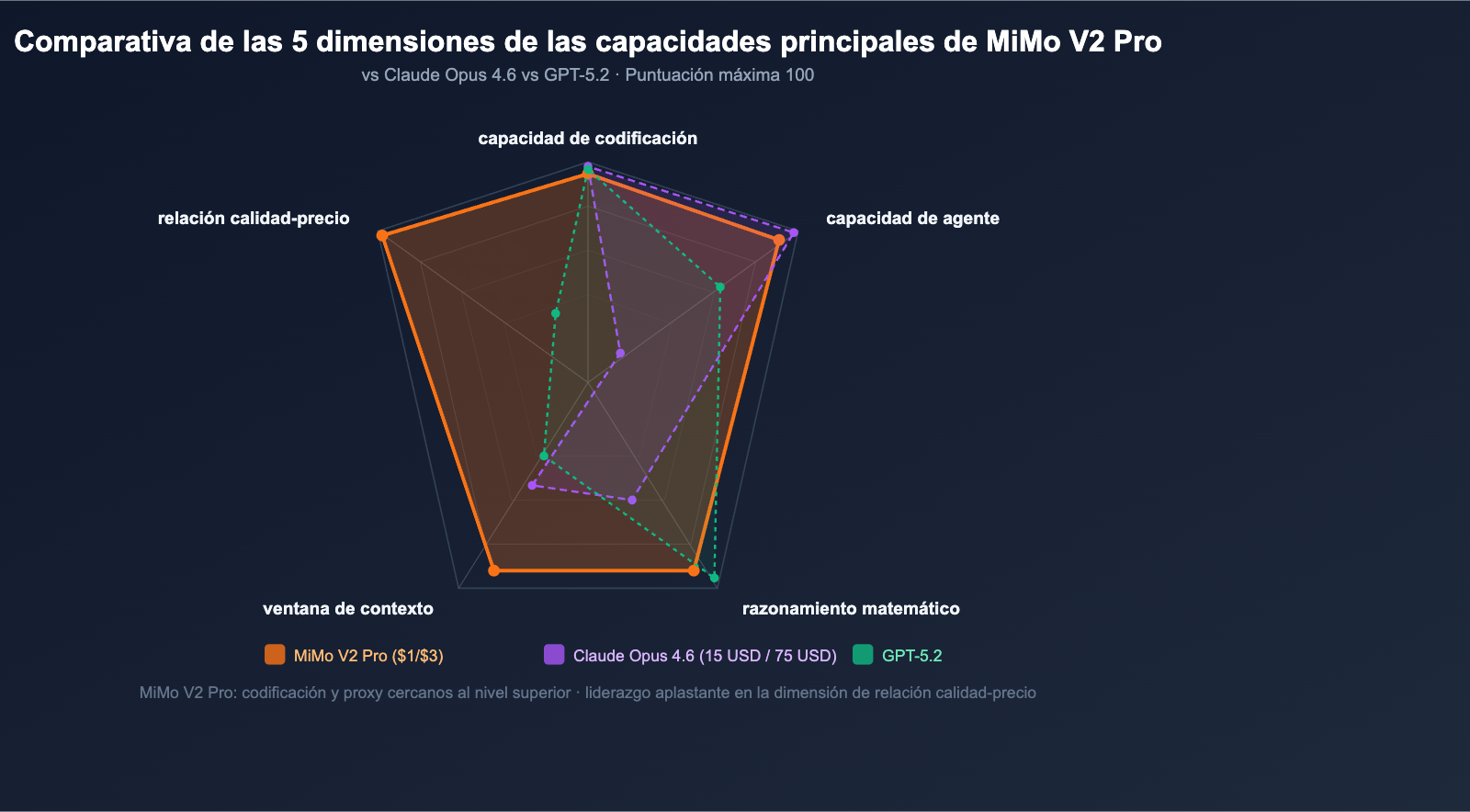

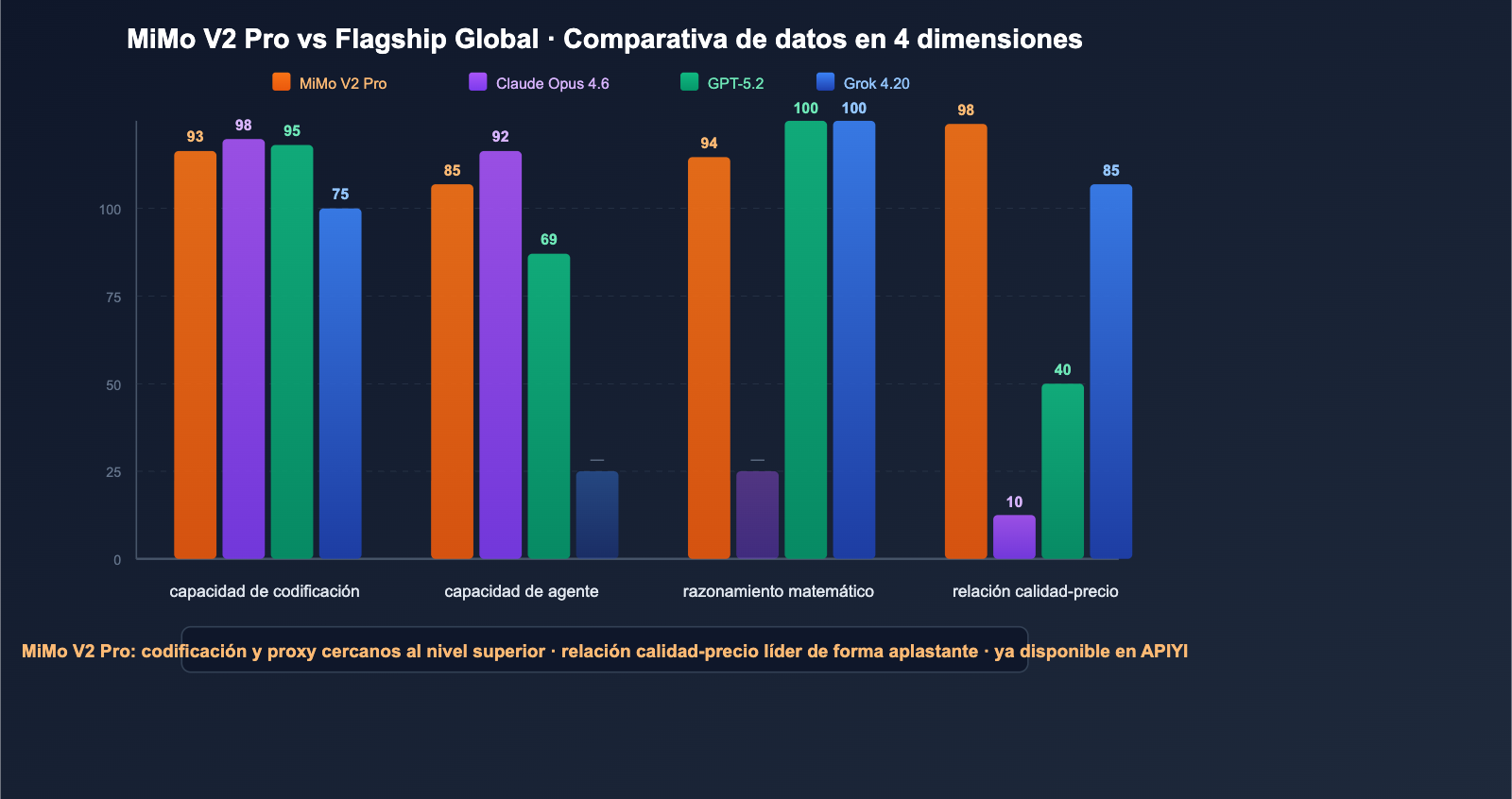

Comparativa multidimensional

| Dimensión | MiMo V2 Pro | Claude Opus 4.6 | GPT-5.2 | Grok 4.20 |

|---|---|---|---|---|

| Arquitectura | 1T MoE (42B activos) | Cerrada | Cerrada | MoE cerrada |

| Precisión de código | 92.5% | Superior (SWE 81.4%) | Alta (SWE ~80%) | SWE ~75% |

| Capacidad de agente (ClawEval) | 61.5 (#3) | 66.3 (#1) | 50.0 | — |

| Matemáticas | 94.0% | — | AIME 100% | AIME 100% |

| Ventana de contexto | 1M | 1M | Variable | 2M |

| Precio de entrada | $1.00 | $15.00 | ~$7.50 | $2.00 |

| Precio de salida | $3.00 | $75.00 | ~$30.00 | $6.00 |

| Modo de razonamiento | Etiqueta <think> |

Razonamiento adaptativo | Razonamiento extendido | Razonamiento/Normal |

| Multimodal | ❌ (Pro solo texto) | ✅ | ✅ | ✅ Limitado |

Posicionamiento de MiMo V2 Pro

Rendimiento: Cercano a Claude Opus 4.6 (diferencia de solo 5 puntos en capacidad de agente)

Precio: Aprox. 1/25 del costo de Opus

↓

Posicionamiento: "El Opus para presupuestos ajustados" / Rey de la relación calidad-precio

Escenarios ideales para MiMo V2 Pro:

- Aplicaciones sensibles al costo que requieren alta capacidad de razonamiento.

- Tareas de agentes (razonamiento multietapa, invocación de herramientas).

- Generación y análisis masivo de código.

- Razonamiento matemático y lógico.

- Escenarios de solo texto donde no se requiere capacidad multimodal.

Escenarios donde Claude Opus 4.6 sigue siendo superior:

- Ingeniería de software extremadamente compleja (diferencia de ~6 puntos porcentuales en SWE-bench).

- Necesidad de salidas ultra largas de 128K.

- Requisitos de cumplimiento y seguridad de nivel empresarial.

- Necesidad de razonamiento adaptativo (Adaptive Thinking).

💰 Consejo de selección: Para el desarrollo diario y tareas por lotes, usa MiMo V2 Pro ($1/$3) para ahorrar significativamente. Para tareas críticas de seguridad y arquitectura, utiliza Claude Opus 4.6. Con el servicio proxy de API de APIYI (apiyi.com), puedes usar una sola clave API para invocar ambos modelos y alternar según tus necesidades.

Resumen de la familia MiMo V2

Xiaomi ha lanzado tres modelos de una sola vez, cubriendo todos los escenarios, desde los ultraligeros hasta los de gama alta.

| Modelo | Parámetros | Posicionamiento | Precio entrada | Precio salida | Código abierto |

|---|---|---|---|---|---|

| MiMo V2 Flash | 309B (15B activos) | Ligero y rápido | $0.09 | $0.29 | ✅ MIT |

| MiMo V2 Pro | ~1T (42B activos) | Insignia en razonamiento | $1.00 | $3.00 | ❌ API |

| MiMo V2 Omni | — | Multimodal | $0.40 | $2.00 | ❌ API |

Notas adicionales sobre MiMo V2 Flash:

- Licencia MIT de código abierto completo, los pesos se pueden descargar en HuggingFace.

- SWE-bench Verified: 73.4% (el mejor entre los modelos de código abierto).

- AIME 2025: 94.1%.

- Velocidad de inferencia: 150+ tokens/segundo.

- Supera a DeepSeek-R1-0528 en 7 de las 8 categorías de prueba.

🎯 Estrategia de la familia: Usa Flash para tareas sencillas (precio ultra bajo de $0.09/$0.29), Pro para tareas de razonamiento (la mejor relación calidad-precio de $1/$3) y Omni para tareas multimodales ($0.40/$2.00). Puedes acceder a todos los modelos MiMo V2 en un solo lugar a través de APIYI apiyi.com.

Práctica de invocación de API

Invocación de MiMo V2 Pro

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # Interfaz unificada de APIYI

)

response = client.chat.completions.create(

model="mimo-v2-pro",

messages=[

{"role": "system", "content": "Eres un ingeniero de software senior, experto en revisión de código y diseño de arquitectura."},

{"role": "user", "content": "Revisa la seguridad de concurrencia del siguiente código Python..."}

],

max_tokens=8192

)

print(response.choices[0].message.content)

Invocación de MiMo V2 Omni (multimodal)

# Ejemplo de comprensión de imágenes

response = client.chat.completions.create(

model="mimo-v2-omni",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Analiza el flujo de datos en este diagrama de arquitectura"},

{"type": "image_url", "image_url": {"url": "data:image/png;base64,..."}}

]

}

]

)

Ver código de prueba comparativa entre MiMo V2 Pro y Claude Sonnet 4.6

import openai

import time

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

models = ["mimo-v2-pro", "claude-sonnet-4-6"]

prompt = "Implementa en Python una caché LRU que soporte concurrencia, asegurando que sea segura para hilos"

for model in models:

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=4096

)

elapsed = time.time() - start

usage = response.usage

print(f"\n{'='*50}")

print(f"Modelo: {model}")

print(f"Tiempo transcurrido: {elapsed:.1f}s")

print(f"Token: Entrada {usage.prompt_tokens} / Salida {usage.completion_tokens}")

print(f"Vista previa: {response.choices[0].message.content[:200]}...")

🚀 Experiencia rápida: Regístrate en APIYI apiyi.com para obtener tu clave y comenzar a invocar MiMo V2 Pro y Omni. Con una sola clave puedes acceder a más de 200 modelos, incluyendo los de Xiaomi, Claude, GPT y más.

Preguntas frecuentes

Q1: ¿Realmente MiMo V2 Pro tiene un billón de parámetros? ¿Por qué es tan barato?

Así es, cuenta con un total de aproximadamente un billón de parámetros, pero utiliza una arquitectura MoE (Mezcla de Expertos), por lo que solo activa unos 42B de parámetros en cada inferencia. Esto significa que el costo de inferencia es mucho menor que el de un modelo denso con la misma cantidad de parámetros. Esta es la misma ruta tecnológica que utilizan modelos como DeepSeek o Grok. A través de APIYI (apiyi.com), puedes invocar este modelo de un billón de parámetros a un tercio del precio habitual.

Q2: ¿Puede MiMo V2 Pro reemplazar a Claude para la revisión de código?

En algunos escenarios, sí. La precisión de codificación (92.5%) y la capacidad de agente (ClawEval 61.5) de MiMo V2 Pro son extremadamente sólidas. Para la revisión de código diaria y el análisis de errores, es una opción con una relación costo-beneficio muy alta. Sin embargo, para auditorías críticas de seguridad y refactorización de arquitecturas de gran escala, Claude Opus 4.6 sigue siendo más fiable. Recomendamos acceder a ambos modelos a través de APIYI (apiyi.com) para cambiar entre ellos de forma flexible según la tarea.

Q3: ¿Es fiable el procesamiento de audio de 10 horas de MiMo V2 Omni?

Xiaomi afirma que esta es una capacidad pionera en la industria: admite la comprensión de audio continuo de más de 10 horas en una sola solicitud sin degradación. Es ideal para escenarios de audio prolongado, como el análisis de grabaciones de reuniones o la extracción de contenido de podcasts. No obstante, al ser un modelo recién lanzado, sugerimos probarlo primero en tareas no críticas. Puedes realizar pruebas a bajo costo ($0.40/$2.00) a través de APIYI (apiyi.com).

Q4: ¿MiMo V2 Pro será de código abierto?

Xiaomi ha indicado que planea hacerlo cuando el modelo sea "lo suficientemente estable". La serie MiMo V2 Flash ya se ha publicado bajo licencia MIT en HuggingFace. Teniendo en cuenta la actitud positiva de Xiaomi hacia el código abierto (MiMo V1 también fue liberado), es solo cuestión de tiempo para que V2 Pro sea abierto.

Q5: ¿Cómo elegir entre MiMo V2 Pro, Flash y Omni?

Elige según tus necesidades: para tareas de inferencia de solo texto, usa Pro ($1/$3, la inferencia más potente); si necesitas un precio extremadamente bajo o despliegue local, elige Flash ($0.09/$0.29, código abierto y desplegable); si necesitas procesar imágenes, videos o audio, elige Omni ($0.40/$2.00). Con una sola clave API de APIYI (apiyi.com), puedes invocar los tres modelos.

Conclusión: La ambición de IA de Xiaomi no debe subestimarse

El lanzamiento de la serie MiMo V2 marca la transición oficial de Xiaomi de ser una "empresa de telefonía que hace IA" a un "jugador de IA de vanguardia global". La estrategia de lanzar Hunter Alpha de forma anónima fue una clase magistral de lanzamiento de producto: primero demostrar con hechos y luego revelar la identidad.

3 juicios clave:

- MiMo V2 Pro es actualmente el modelo de inferencia con mejor relación costo-beneficio: capacidad de agente #3 a nivel mundial, codificación superior a Sonnet 4.6 y un precio que es solo 1/25 del de Opus.

- La capacidad multimodal de MiMo V2 Omni merece atención: el procesamiento de 10 horas de audio es una ventaja diferencial real.

- La capacidad de ejecución del equipo de IA de Xiaomi es asombrosa: menos de un año desde cero hasta un modelo de un billón de parámetros, con un equipo central proveniente de DeepSeek.

Te recomendamos experimentar con toda la serie MiMo V2 a través de APIYI (apiyi.com) para obtener capacidades de inferencia de IA casi de primer nivel al precio más bajo de la industria.

Referencias

-

Página oficial de Xiaomi MiMo V2 Pro: Especificaciones técnicas y datos de referencia

- Enlace:

mimo.xiaomi.com/mimo-v2-pro

- Enlace:

-

Artificial Analysis: Evaluación comparativa del MiMo V2 Pro

- Enlace:

artificialanalysis.ai/models/mimo-v2-pro

- Enlace:

-

VentureBeat: Reporte del lanzamiento del Xiaomi MiMo V2 Pro

- Enlace:

venturebeat.com

- Enlace:

-

OpenRouter: Precios e información de la clave API del modelo MiMo V2

- Enlace:

openrouter.ai

- Enlace:

Autor: Equipo de APIYI | Lanzamos los modelos de IA más recientes al instante. Te invitamos a visitar APIYI en apiyi.com para probar la serie completa de modelos Xiaomi MiMo V2.