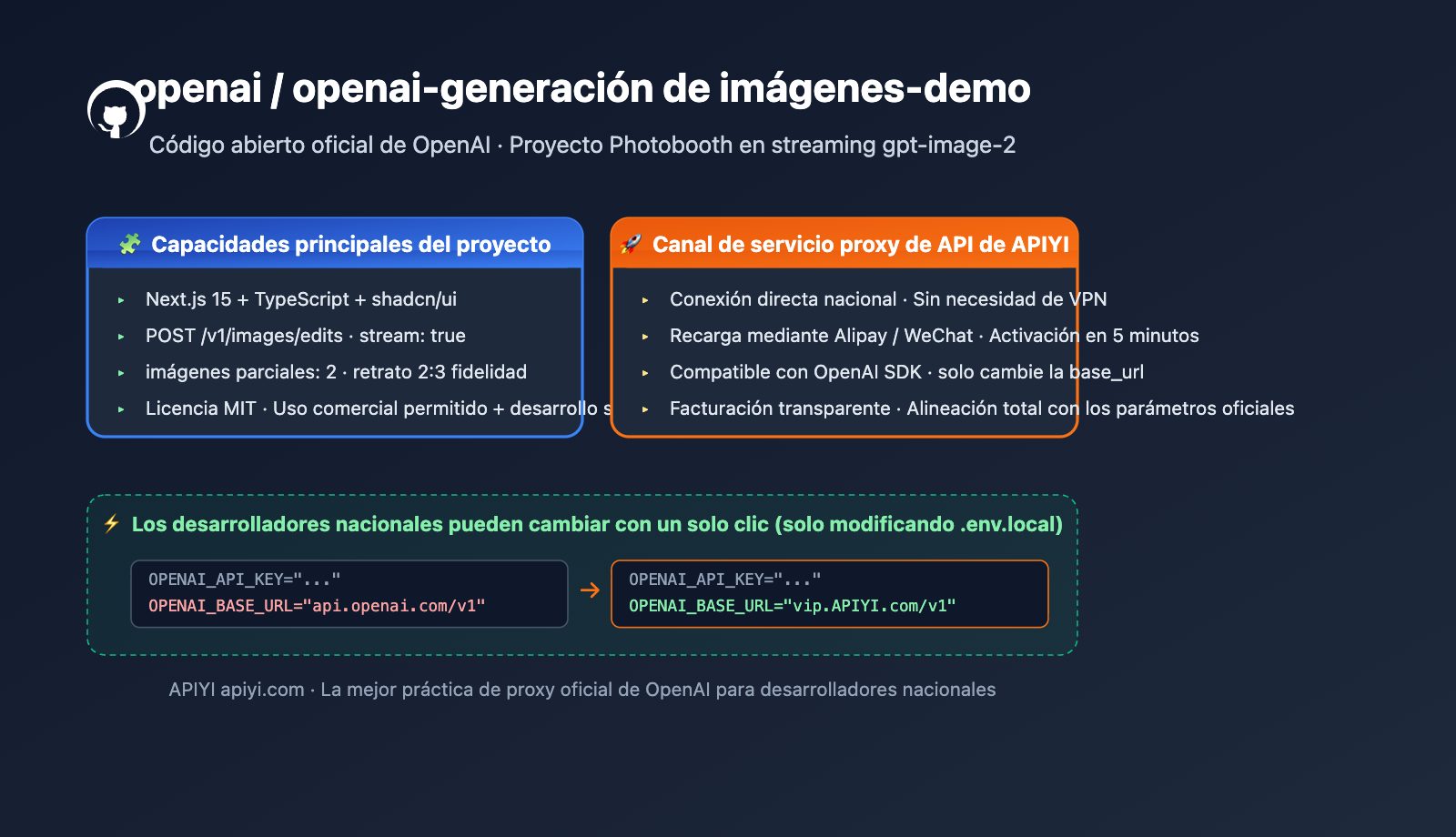

Nota del autor: OpenAI ha publicado el código abierto de la demostración Photobooth basada en gpt-image-2. En este artículo, analizamos en profundidad el código fuente, el principio de implementación del streaming y cómo replicar esta capacidad sin obstáculos utilizando el canal de proxy oficial de APIYI.

OpenAI ha liberado en GitHub el proyecto openai-imagegen-demo, una aplicación de demostración en Next.js lanzada junto con gpt-image-2 que muestra capacidades únicas del nuevo modelo, como la generación de imágenes en streaming, la estilización de retratos y la concurrencia multiestilo. Enlace del proyecto: github.com/openai/openai-imagegen-demo.

Esto no es otro ejemplo de "Hola Mundo": el código fuente esconde el modo de salida progresiva partial_images recomendado oficialmente por OpenAI, así como el uso más reciente del endpoint /v1/images/edits en escenarios de edición de múltiples imágenes.

Valor central: Al terminar de leer este artículo, comprenderás a fondo la arquitectura, los parámetros clave y los pasos de replicación de esta demostración oficial, además de saber cómo utilizar la misma API de gpt-image-2 en China sin necesidad de VPN ni esperas, a través del canal de proxy oficial de APIYI.

Puntos clave de openai-imagegen-demo

| Punto | Descripción | Valor |

|---|---|---|

| Posicionamiento | Demostración oficial de Photobooth, muestra la estilización de retratos con gpt-image-2 |

La referencia más autorizada de integración de gpt-image-2 |

| Stack técnico | Next.js 15 App Router + TypeScript + Tailwind + shadcn/ui | Stack web moderno, reutilizable a nivel de producción |

| Endpoint clave | POST /v1/images/edits, junto con stream: true y partial_images |

Primera demo oficial de generación de imágenes en streaming |

| Modelo | gpt-image-2, calidad high, tamaño 1024x1536 (retrato 2:3) |

Énfasis en fidelidad facial y restauración de expresiones |

| Licencia | Licencia MIT, uso comercial y desarrollo secundario libre | Integración directa en proyectos comerciales |

| Acceso | Requiere clave API de OpenAI; canal de proxy apiyi.com para conexión directa en China |

Menor barrera de entrada, sin necesidad de VPN |

Detalle del posicionamiento del proyecto imagegen-demo

openai-imagegen-demo es, en esencia, un fotomatón interactivo: el usuario sube o toma una selfie, elige hasta 4 estilos preestablecidos (como estilo tejido, arte digital, pintura al óleo, etc.), y la aplicación invoca de forma concurrente el endpoint images/edits de gpt-image-2, devolviendo gradualmente el resultado de cada estilo en el flujo de streaming.

A diferencia de las "demos de texto a imagen" comunes en el mercado, este repositorio oficial se centra en dos nuevas capacidades: imagen a imagen (edición de imágenes) y salida progresiva en streaming (partial_images). Lo primero resuelve el desafío de ingeniería de "mantener la consistencia facial", mientras que lo segundo transforma la experiencia de espera de una pantalla negra de 30 segundos a una aparición gradual fotograma a fotograma.

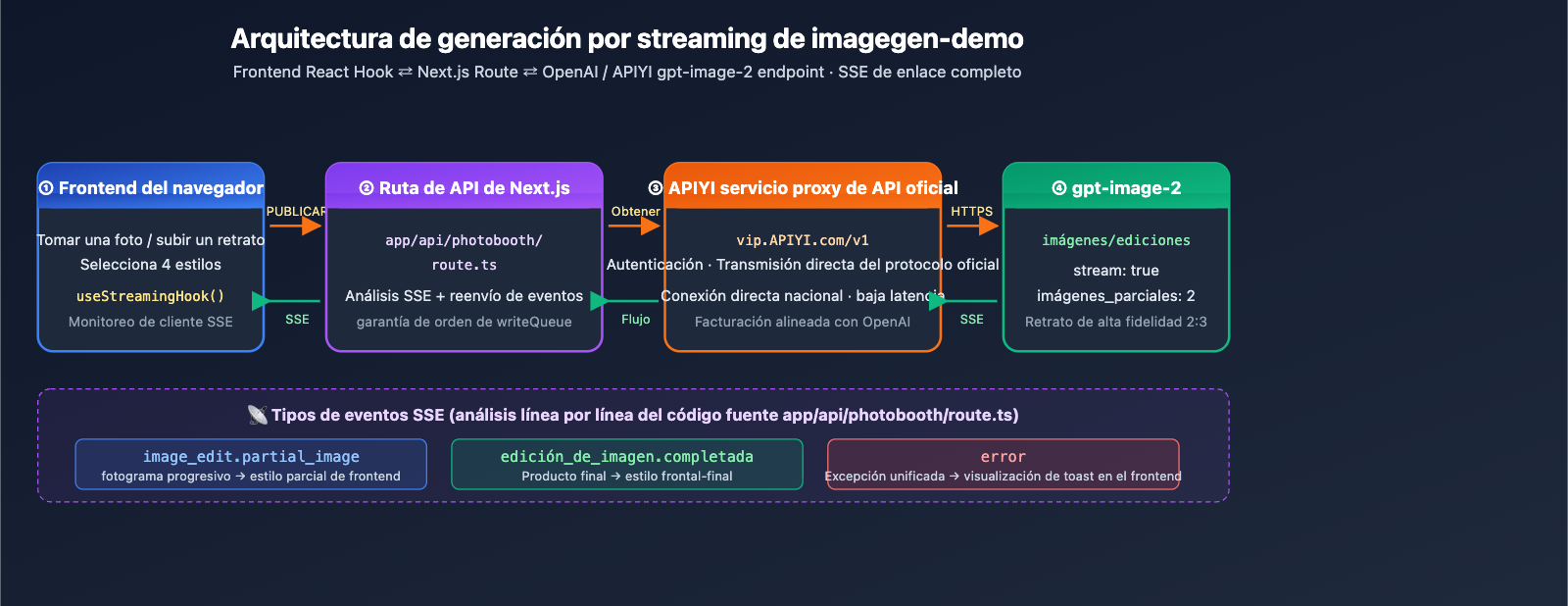

Interpretación de la arquitectura del proyecto imagegen-demo

Análisis del código fuente clave

El núcleo del proyecto consiste en una única ruta de API: app/api/photobooth/route.ts, la cual se encarga de empaquetar la imagen de retrato y la indicación de estilo del frontend para realizar una solicitud en modo streaming al endpoint /v1/images/edits de OpenAI. La estructura del cuerpo de la solicitud es la siguiente:

const body = {

model: "gpt-image-2",

prompt: `${style.prompt}\n\n${OPENAI_IMAGE_OUTPUT_REQUIREMENTS}`,

images: [{ image_url: imageDataUrl }],

size: "1024x1536",

quality: "high",

output_format: "png",

stream: true,

partial_images: 2,

};

Hay tres detalles que vale la pena destacar:

stream: true+partial_images: 2: Es una capacidad de streaming exclusiva de gpt-image-2; el servidor enviará 2 fotogramas intermedios antes de entregar la imagen final.- Parámetro

images: Acepta la URL de datos de una o varias imágenes de referencia, permitiendo la edición y fusión de múltiples imágenes. OPENAI_IMAGE_OUTPUT_REQUIREMENTS: Establece requisitos obligatorios como "proporción de retrato 2:3, manteniendo la postura y expresión del personaje", lo cual es el paradigma ideal para escribir indicaciones de edición de imágenes.

Análisis de eventos de streaming

La ruta escucha la respuesta oficial a través de SSE (Server-Sent Events) y procesa tres tipos de eventos:

image_edit.partial_image: Fotogramas intermedios, envíastyle-partialal frontend.image_edit.completed: Producto final, envíastyle-finalal frontend.error: Lanza excepciones que son capturadas de forma unificada por el frontend.

En el lado de React, el frontend utiliza un hook personalizado para gestionar una cadena de promesas writeQueue, asegurando que el orden de los eventos no se altere durante la concurrencia de múltiples estilos. Esta es, sin duda, la parte con mayor valor de ingeniería de este demo.

Primeros pasos con imagegen-demo

Pasos para una réplica minimalista

Siguiendo el README oficial, puedes ponerlo en marcha con solo 5 comandos:

git clone https://github.com/openai/openai-imagegen-demo

cd openai-imagegen-demo

cp .env.example .env.local

echo "OPENAI_API_KEY=sk-xxxxx" >> .env.local

npm install && npm run dev

Ver la configuración completa de .env.local utilizando el canal de proxy de APIYI

# Opción 1: Usar la API oficial de OpenAI (requiere red externa + cuota de API)

OPENAI_API_KEY="sk-proj-xxxxx"

# Opción 2: Usar el canal de proxy de APIYI (conexión directa desde China, sin necesidad de VPN)

OPENAI_API_KEY="your-apiyi-key"

OPENAI_BASE_URL="https://vip.apiyi.com/v1"

# Opcional: ID de organización y proyecto

OPENAI_ORG_ID=""

OPENAI_PROJECT_ID=""

Luego, solo necesitas reemplazar el endpointBase codificado en app/api/photobooth/route.ts para que lea process.env.OPENAI_BASE_URL ?? "https://api.openai.com/v1", permitiendo cambiar sin problemas entre el canal oficial y el canal de proxy.

const endpointBase = process.env.OPENAI_BASE_URL ?? "https://api.openai.com/v1";

const response = await fetch(`${endpointBase}/images/edits`, {

method: "POST",

headers: {

"Authorization": `Bearer ${apiKey}`,

"Content-Type": "application/json",

},

body: JSON.stringify(body),

});

Sugerencia de integración: Los desarrolladores en China pueden encontrar tres obstáculos al ejecutar el demo oficial de OpenAI (red, cuota de API y métodos de pago). Se recomienda obtener una clave compatible a través del servicio proxy de APIYI (apiyi.com) y apuntar

OPENAI_BASE_URLahttps://vip.apiyi.com/v1para iniciar localmente con un solo clic, manteniendo los eventos de streaming y los parámetros totalmente alineados con los oficiales.

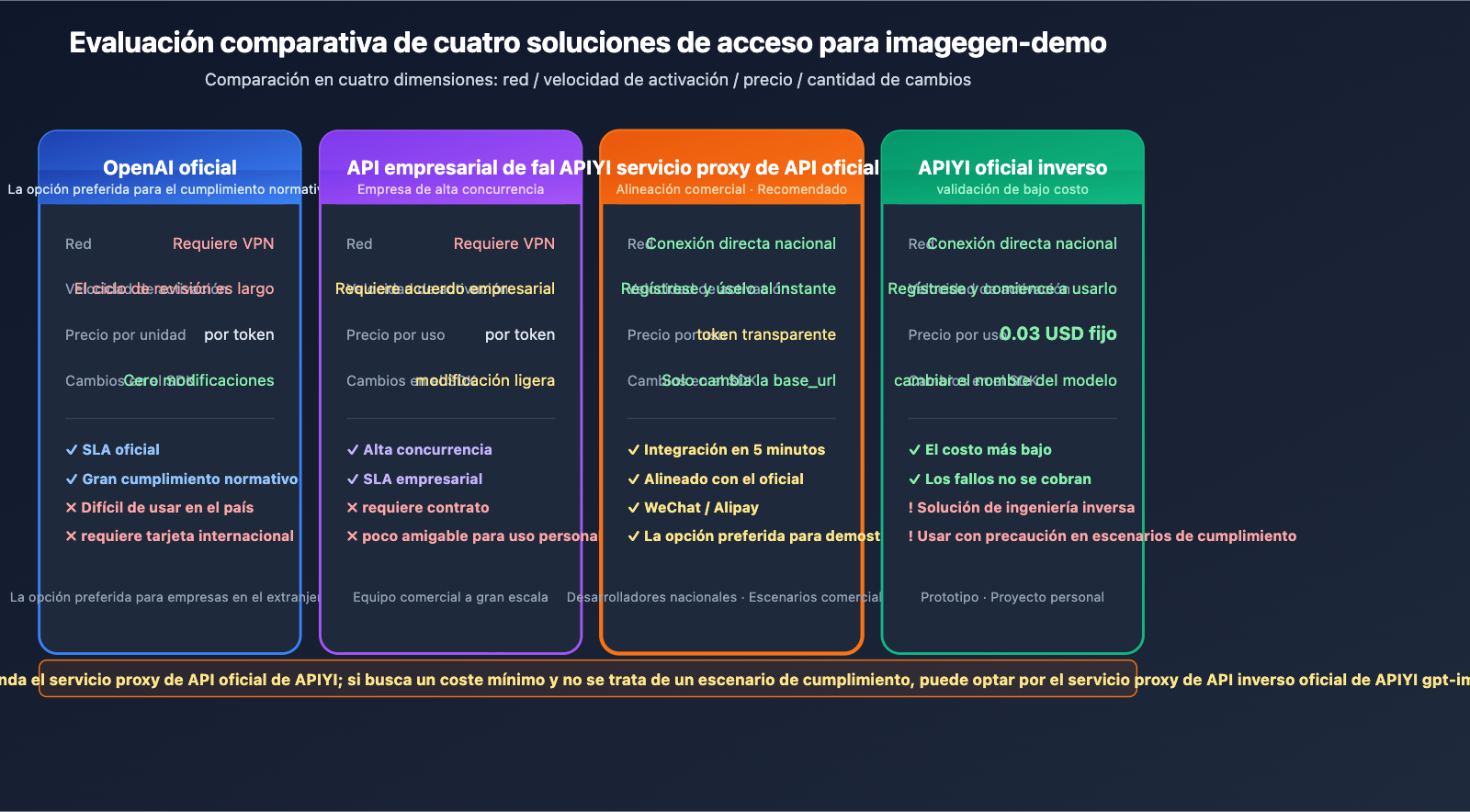

Comparativa de soluciones de integración para imagegen-demo

| Solución de integración | Requisitos de red | Velocidad de activación | Precio por uso | Cambios en SDK |

|---|---|---|---|---|

| OpenAI oficial | Red internacional | Requiere tarjeta + revisión | Según tokens (~$0.15+/img) | Sin cambios |

| API empresarial fal | Acceso internacional | Requiere contrato | Según tokens | Modificación leve |

| Canal proxy APIYI | Acceso directo local | Registro inmediato | Precio transparente | Solo cambiar base_url |

| Canal inverso APIYI | Acceso directo local | Registro inmediato | Fijo $0.03 / img | Solo cambiar nombre modelo |

Análisis de las soluciones

Análisis de la conexión oficial de OpenAI: El canal oficial mantiene una ventaja absoluta en cumplimiento y SLA, siendo el entorno objetivo predeterminado para imagegen-demo. Sin embargo, ejecutarlo desde China requiere VPN, tarjeta de crédito internacional y un largo periodo de revisión de cuotas de API. En comparación, el canal proxy de APIYI es mucho más adecuado para la fase de validación y entornos de producción locales debido a su accesibilidad de red y rapidez de activación.

Análisis de la API empresarial de fal: fal lanzó su endpoint empresarial para gpt-image-2 el 21 de abril de 2026, destacando en SLA de alta concurrencia. No obstante, para clientes empresariales, la barrera de entrada para desarrolladores independientes es alta. Para quienes buscan ejecutar imagegen-demo localmente, APIYI resulta una opción mucho más ligera.

Diferencia entre proxy oficial y canal inverso de APIYI: El proxy oficial significa que APIYI transmite tu solicitud a la API oficial de OpenAI; la facturación, el SLA y las funciones son idénticas a las oficiales, ideal para escenarios comerciales. El canal inverso se logra mediante ingeniería inversa de la interfaz web de ChatGPT, ofreciendo un precio fijo de $0.03/imagen, lo que lo hace más económico y perfecto para prototipado. Ambos canales están disponibles en la plataforma APIYI, permitiendo a los desarrolladores cambiar entre ellos según sus necesidades.

Nota sobre la comparativa: Los datos anteriores se han recopilado de la lista de precios oficial de OpenAI, los comunicados de prensa de fal y la documentación técnica de

docs.apiyi.com. Puedes verificar los resultados mediante pruebas reales en APIYI (apiyi.com).

Análisis detallado de los parámetros clave de gpt-image-2 (del código fuente de imagegen-demo)

Basado en el archivo lib/constants.ts de imagegen-demo, aquí tienes la combinación de parámetros predeterminados recomendada oficialmente para gpt-image-2:

| Parámetro | Valor predeterminado del Demo | Descripción | Sugerencia de ajuste |

|---|---|---|---|

| model | gpt-image-2 |

Modelo de imagen más reciente | Mantener igual |

| size | 1024x1536 |

Relación de aspecto 2:3 (retrato) | Cambiar a 1536x1024 para redes sociales |

| quality | high |

Máxima calidad | medium/low para reducir costes |

| output_format | png |

Soporta fondo transparente | Usar webp para ahorrar ancho de banda en web |

| stream | true |

Habilitar flujo SSE | Obligatorio para aplicaciones en tiempo real |

| partial_images | 2 |

Envía 2 fotogramas intermedios | Máximo 3; equilibrio entre experiencia y ancho de banda |

Mejores prácticas de ingeniería de indicaciones (Prompt Engineering)

La constante OPENAI_IMAGE_OUTPUT_REQUIREMENTS del Demo es una plantilla de indicación de gran valor:

"portrait orientation (2:3 aspect ratio), preserve the exact people, poses, facial expressions, and scene composition as faithfully as possible"

Este fragmento revela el paradigma de oro para la edición de imágenes con gpt-image-2:

- Especificar la relación de aspecto explícitamente: Incluso si se establece el parámetro

size, es recomendable reiterar la proporción en la indicación para mejorar la precisión. - Enfatizar la fidelidad:

preserve the exact ...es el hechizo clave para mantener la consistencia facial. - Enumerar dimensiones de fidelidad: Mencionar explícitamente personas, poses, expresiones y composición de la escena garantiza una mayor fidelidad.

Preguntas frecuentes (FAQ)

Q1: ¿Qué es el proyecto openai-imagegen-demo?

openai-imagegen-demo es una aplicación de demostración tipo "Photobooth" de código abierto de OpenAI en GitHub. Utiliza Next.js 15 + TypeScript + gpt-image-2 para implementar un flujo de trabajo completo de "subir retrato → elegir estilo → generación de imágenes multiestilo por streaming". Es la referencia más autorizada para la integración del endpoint images/edits de gpt-image-2 y permite uso comercial bajo licencia MIT.

Q2: ¿En qué se diferencia imagegen-demo de otras demos de generación de imágenes?

La diferencia radica principalmente en dos puntos: primero, utiliza el nuevo endpoint /v1/images/edits de gpt-image-2 para realizar imagen a imagen (en lugar del texto a imagen tradicional de DALL-E), lo que permite mantener la consistencia facial; segundo, habilita la capacidad de streaming con stream: true + partial_images, permitiendo que el usuario vea el proceso de renderizado gradual de la imagen en lugar de esperar 30 segundos frente a una pantalla negra. La mayoría de las demos de la comunidad utilizan texto a imagen de DALL-E 3, que carece de estas dos capacidades.

Q3: ¿Cuándo se lanzó imagegen-demo?

El repositorio se publicó junto con el lanzamiento de ChatGPT Images 2.0 por parte de OpenAI el 21 de abril de 2026. Con el lanzamiento oficial del modelo gpt-image-2 en la API y Codex, la intención oficial es reducir la barrera de entrada para los desarrolladores. El README se mantiene actualizado constantemente.

Q4: ¿Para qué escenarios de aplicación es más adecuado imagegen-demo?

Es ideal para cuatro tipos de escenarios:

- Cambio de estilo / vestuario en aplicaciones sociales: Usuarios que suben selfies para generar versiones en estilo tradicional, pintura al óleo o ciberpunk.

- Unificación de estilo en imágenes de productos de comercio electrónico: Convertir fotos de productos a un estilo visual de marca unificado.

- Cabinas de fotos con IA para eventos / conferencias: Instalaciones interactivas para eventos presenciales.

- Prototipos para hackathons / demostraciones educativas: Demostrar rápidamente las nuevas capacidades de gpt-image-2.

Q5: ¿Cómo ejecutar imagegen-demo rápidamente a través de la API?

Recomendamos utilizar el canal de proxy de APIYI para una réplica rápida:

- Visita APIYI (apiyi.com), registra una cuenta y crea una clave API.

- Clona el repositorio:

git clone https://github.com/openai/openai-imagegen-demo - En

.env.local, escribeOPENAI_API_KEYyOPENAI_BASE_URL=https://vip.apiyi.com/v1 - Modifica

route.tspara queendpointBaseleaprocess.env.OPENAI_BASE_URL. - Ejecuta

npm install && npm run devy podrás ver el resultado enlocalhost:3000.

APIYI admite la integración unificada de múltiples modelos de imagen convencionales como gpt-image-2, Nano Banana Pro y Flux, facilitando la comparación y el cambio rápido en local.

Q6: ¿Cómo funciona el parámetro partial_images de imagegen-demo?

partial_images especifica cuántos fotogramas intermedios debe enviar el servidor antes de devolver la imagen final. El valor predeterminado del Demo es 2, lo que significa que una sola generación pasará por tres etapas: "boceto inicial → optimización secundaria → producto final". Cada fotograma intermedio se envía a través del evento SSE image_edit.partial_image, permitiendo al frontend renderizar en tiempo real y evitar la espera de 30 segundos. Este parámetro admite un máximo de 3, pero cuantos más fotogramas intermedios, mayor será el consumo de ancho de banda.

Q7: ¿Cómo pueden los desarrolladores locales ejecutar imagegen-demo sin barreras?

Ejecutar la demo oficial directamente desde regiones con restricciones enfrenta tres obstáculos: acceso a la red a la API de OpenAI, necesidad de tarjetas de crédito internacionales y largos periodos de revisión de cuotas de API. El canal de proxy de APIYI resuelve esto de una vez:

- Regístrate en

apiyi.com(admite pagos locales). - Obtén una clave API compatible con el protocolo de OpenAI.

- Configura

OPENAI_BASE_URL=https://vip.apiyi.com/v1en.env.local. route.tsleerá esta variable de entorno, sin cambios adicionales en el código.

El proceso toma unos 5 minutos, sin necesidad de VPN, y la facturación es transparente y alineada con la oficial de OpenAI.

Q8: ¿Qué limitaciones conocidas tiene imagegen-demo?

Limitaciones actuales:

- Tiempo de generación por imagen: En calidad alta (

quality: high), cada imagen tarda entre 20 y 30 segundos; para lotes, se requiere optimización de concurrencia. - Consistencia facial no al 100%: En poses complejas o escenas con múltiples personas, aún pueden ocurrir ligeras deformaciones.

- Consideraciones de costes: OpenAI factura por token; una imagen de alta calidad cuesta desde $0.15, por lo que para escenarios masivos se recomienda usar calidad

mediumo el canal de APIYI ($0.03/imagen). - Estilos preestablecidos limitados: El Demo solo incluye ~10 estilos; es necesario extender

lib/styles.tspor cuenta propia. - Compatibilidad con cámaras móviles: Es posible que se requiera autorización manual para el acceso a la cámara en iOS Safari durante la primera visita.

Puntos clave de openai-imagegen-demo

- Código abierto oficial de OpenAI: Demo autorizada lanzada junto con gpt-image-2, bajo licencia MIT para uso comercial.

- Enfoque en capacidades de imagen a imagen: Utiliza el endpoint

/v1/images/edits, estableciendo un paradigma de ingeniería para mantener la consistencia facial. - Tecnología de renderizado en streaming:

stream: true+partial_images: 2transforma la espera de una pantalla negra a un renderizado progresivo. - Next.js 15 Full-stack: La arquitectura App Router + SSE es la mejor práctica moderna para aplicaciones de generación de imágenes.

- Atajo para acceso local: A través del canal de servicio proxy de API de APIYI (apiyi.com), basta con modificar una

base_urlpara conectar directamente. - Paradigma de oro de la indicación:

preserve the exact ...es el hechizo clave para la fidelidad, vale la pena copiarlo en tus propios proyectos. - Doble canal (Oficial vs. Inverso): Para uso comercial, elige el servicio proxy de API (alineado con OpenAI); para validación, elige el canal inverso (precio fijo de $0.03 por imagen).

Resumen

openai-imagegen-demo es la mejor puerta de entrada para comprender las nuevas capacidades de gpt-image-2. Su valor principal reside en tres puntos:

- Referencia autorizada: Un paradigma de integración escrito por el equipo oficial; parámetros, indicaciones y arquitectura de streaming, todo alineado.

- Código de nivel de producción: Next.js 15 + SSE + concurrencia multiestilo, listo para reutilizarse directamente en tus proyectos.

- Reproducible localmente: A través del canal de servicio proxy de API de APIYI, los desarrolladores locales pueden poner en marcha la demo oficial en 5 minutos.

Si deseas probar de inmediato la capacidad de edición de imágenes en streaming de gpt-image-2, te recomendamos obtener una clave compatible directamente a través de APIYI (apiyi.com), clonar openai-imagegen-demo y apuntar OPENAI_BASE_URL a https://vip.apiyi.com/v1. Con esto, podrás replicar localmente los efectos de la demostración oficial de OpenAI.

Lecturas recomendadas

Si te interesan gpt-image-2 y openai-imagegen-demo, te recomendamos seguir leyendo:

- 📘 ¿Dónde encontrar la API inversa de gpt-image-2? Conéctate al canal oficial de APIYI en 3 minutos – Descubre la solución de bajo costo a $0.03 por imagen a través del canal oficial.

- 📊 Comparativa: gpt-image-2 vs Nano Banana Pro – Analizamos las diferencias de capacidad entre los modelos de imagen más populares.

- 🚀 Guía de implementación de gpt-image-2 en 6 sectores – Explora casos de uso reales en comercio electrónico, educación, redes sociales y más.

📚 Referencias

-

Repositorio oficial de OpenAI imagegen-demo: Código fuente completo, README y documentación de instalación.

- Enlace:

github.com/openai/openai-imagegen-demo - Nota: El punto de partida definitivo para entender el paradigma de integración de gpt-image-2 con el código fuente original.

- Enlace:

-

Documentación oficial de la API de gpt-image-2 de OpenAI: Parámetros del modelo, endpoints y detalles de facturación.

- Enlace:

developers.openai.com/api/docs/models/gpt-image-2 - Nota: Consulta todos los parámetros soportados, precios y reglas de limitación de tasa (rate limits).

- Enlace:

-

Página de lanzamiento de OpenAI ChatGPT Images 2.0: Introducción a las capacidades del nuevo modelo.

- Enlace:

openai.com/index/introducing-chatgpt-images-2-0/ - Nota: Conoce la filosofía de diseño, las capacidades principales y los casos de uso de gpt-image-2.

- Enlace:

-

Documentación del canal oficial de APIYI para gpt-image-2: Guía de acceso directo desde China.

- Enlace:

docs.apiyi.com/en/api-capabilities/gpt-image-2-all/overview - Nota: Obtén tu clave API compatible, configuración de base_url y detalles de precios.

- Enlace:

Autor: Equipo técnico de APIYI

Intercambio técnico: Te invitamos a compartir tus casos de uso reales con imagegen-demo en la sección de comentarios. Para más documentación, visita el centro de ayuda de APIYI en docs.apiyi.com.