Nota do autor: A OpenAI disponibilizou oficialmente o código-fonte do projeto de demonstração Photobooth baseado no gpt-image-2. Neste artigo, faremos uma análise profunda do código-fonte, do princípio de implementação de streaming e explicaremos como replicar essa capacidade sem barreiras através do canal de proxy da APIYI.

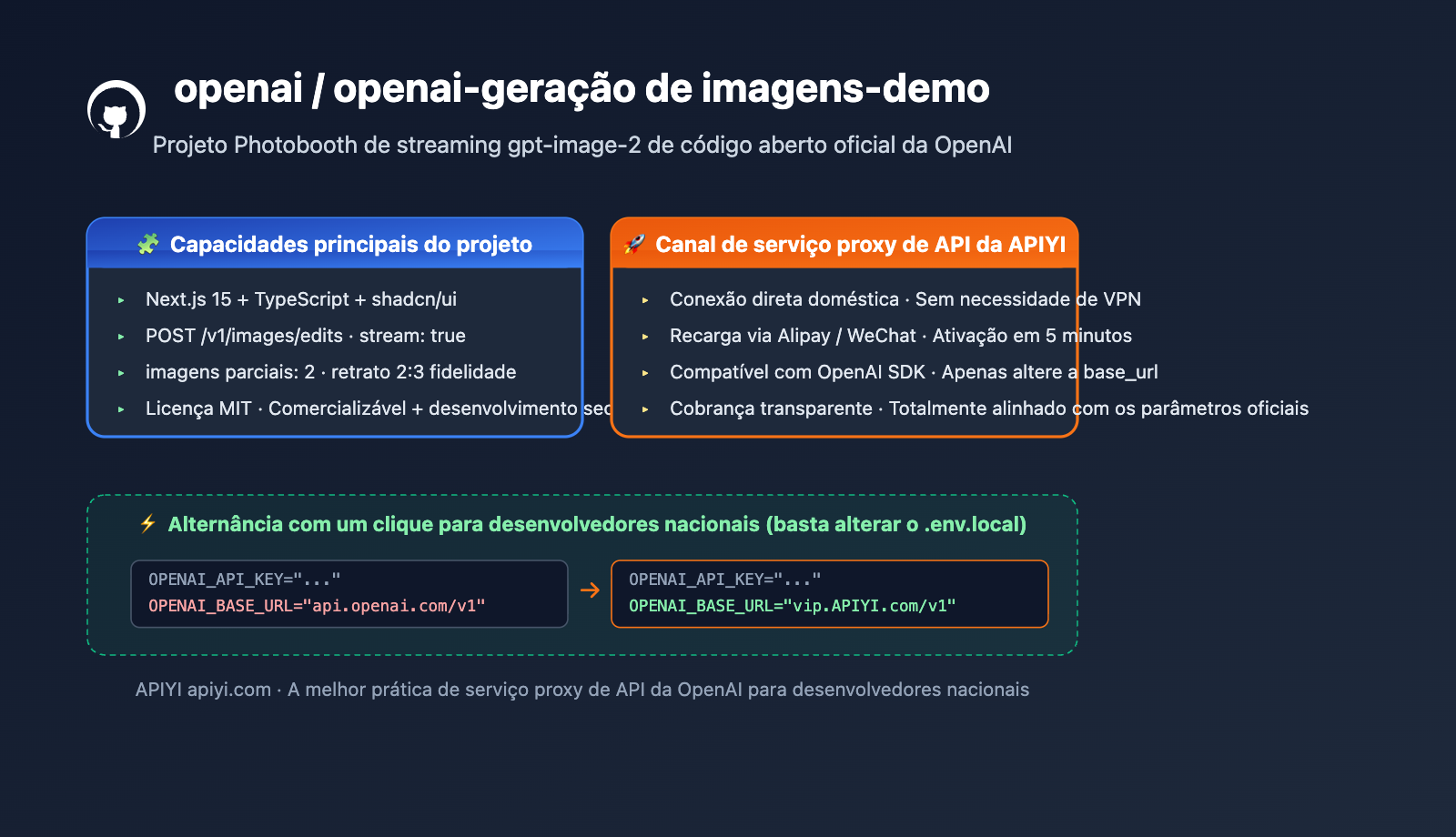

A OpenAI abriu o código do projeto openai-imagegen-demo no GitHub. Esta é uma aplicação de demonstração em Next.js lançada junto com o gpt-image-2, que exibe capacidades exclusivas do novo modelo, como geração de imagens em streaming, estilização de retratos e concorrência de múltiplos estilos. Endereço do projeto: github.com/openai/openai-imagegen-demo.

Este não é apenas mais um exemplo de "Hello World". O código-fonte esconde o modo de saída de streaming progressivo partial_images recomendado pela OpenAI, bem como o uso mais recente do endpoint /v1/images/edits em cenários de edição de múltiplas imagens.

Valor central: Ao terminar de ler este artigo, você entenderá completamente a arquitetura, os parâmetros-chave e as etapas de replicação desta demonstração oficial, além de saber como usar a mesma API do gpt-image-2 no Brasil sem precisar de VPN ou esperas, através do serviço proxy da APIYI.

Pontos principais do openai-imagegen-demo

| Ponto | Descrição | Valor |

|---|---|---|

| Posicionamento | Demonstração oficial de Photobooth da OpenAI, exibindo a estilização de retratos do gpt-image-2 | A referência mais autorizada de integração do gpt-image-2 |

| Stack Tecnológico | Next.js 15 App Router + TypeScript + Tailwind + shadcn/ui | Stack web moderna, reutilizável em produção |

| Endpoint Principal | POST /v1/images/edits, com stream: true e partial_images |

Primeira demonstração oficial de geração de imagem em streaming |

| Modelo | gpt-image-2, qualidade high, tamanho 1024x1536 (retrato 2:3) |

Foco na fidelidade do retrato e restauração de expressões |

| Licença | MIT, livre para uso comercial e desenvolvimento secundário | Pode ser integrado diretamente em projetos comerciais |

| Como acessar | Oficial requer chave API da OpenAI; canal de proxy apiyi.com permite conexão direta |

Reduz barreiras, sem necessidade de VPN |

Detalhes do posicionamento do projeto imagegen-demo

O openai-imagegen-demo é essencialmente uma cabine fotográfica interativa (Photobooth): o usuário envia ou tira uma selfie, escolhe até 4 estilos predefinidos (como estilo tricô, arte digital, pintura a óleo, etc.), e a aplicação invoca de forma concorrente o endpoint images/edits do gpt-image-2, retornando gradualmente o resultado de cada estilo via streaming.

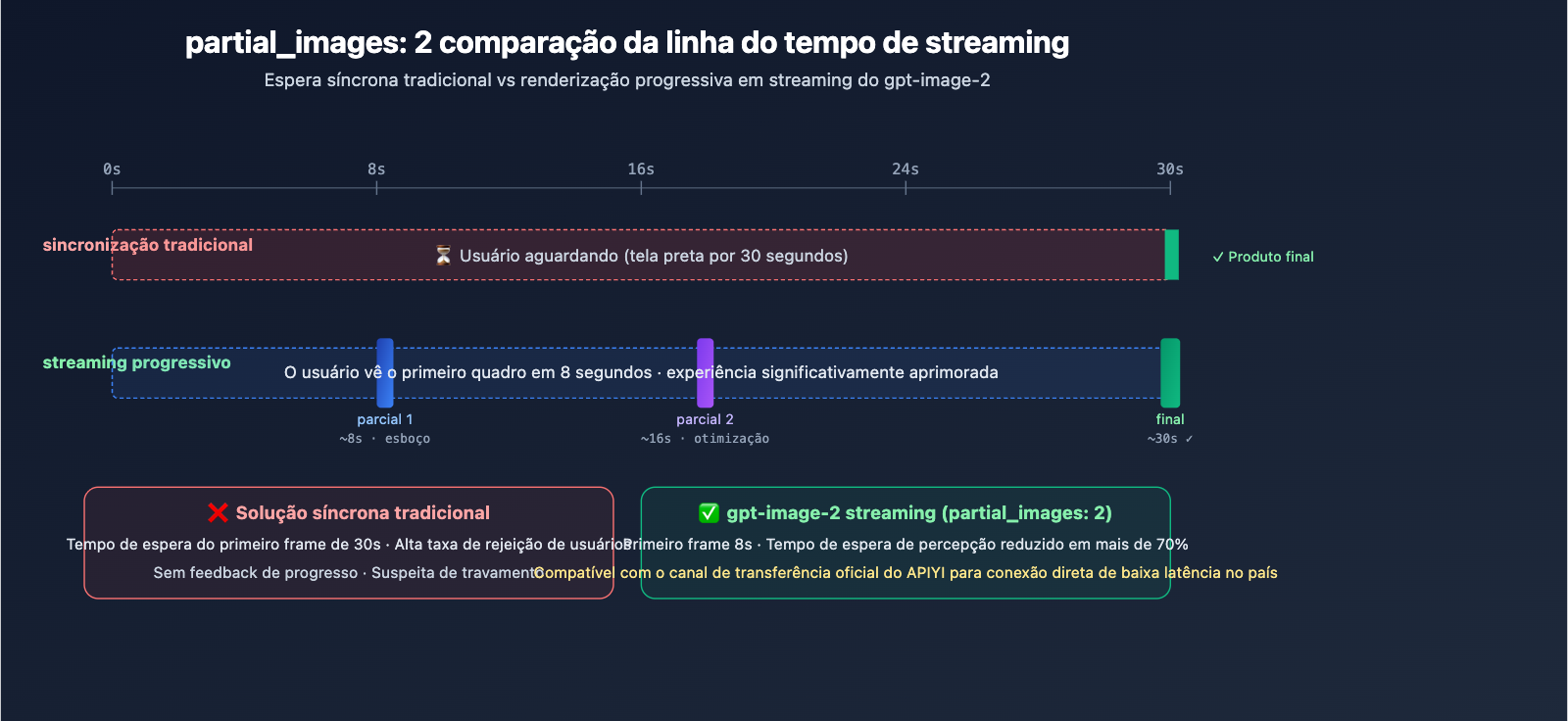

Diferente das "demonstrações de texto para imagem" comuns no mercado, este repositório oficial foca em duas novas capacidades: imagem para imagem (edição de imagem) e saída progressiva em streaming (partial_images). O primeiro resolve o desafio de engenharia de "manter a consistência facial", enquanto o segundo transforma a experiência de espera de 30 segundos de tela preta em uma exibição que surge quadro a quadro.

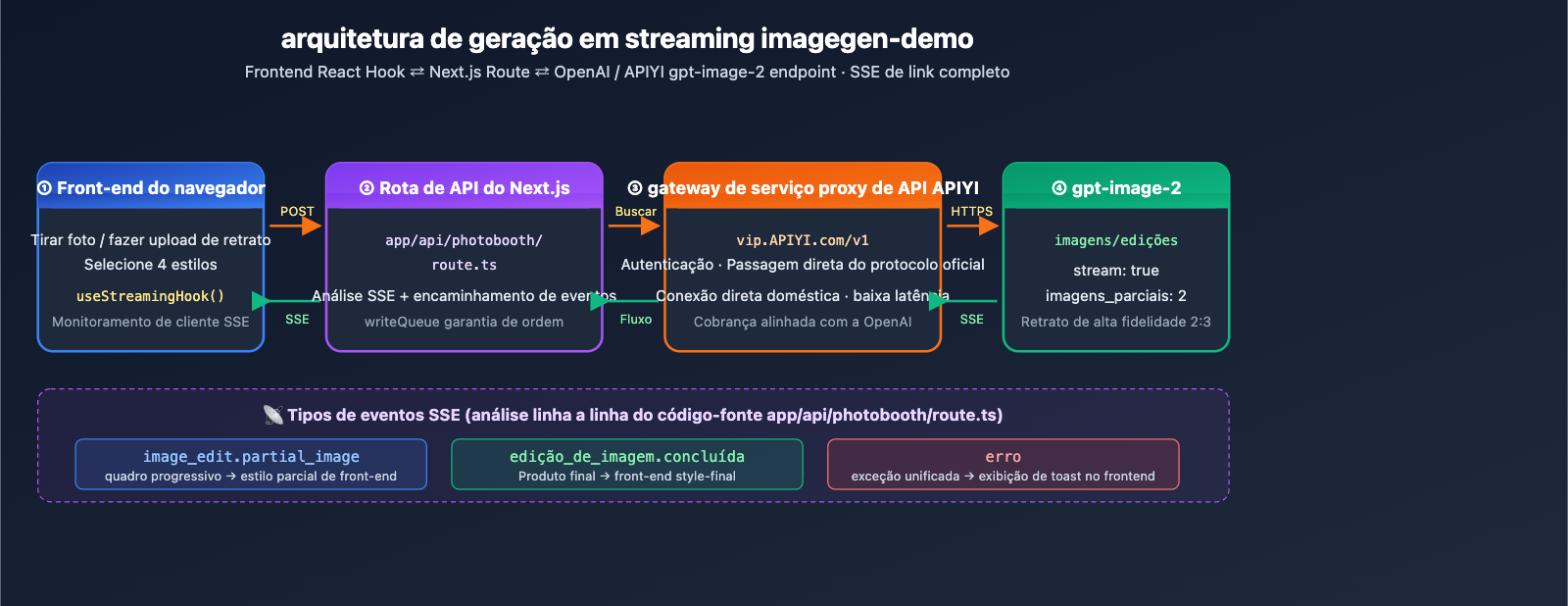

Interpretação da arquitetura do projeto imagegen-demo

Análise do código-fonte principal

O núcleo do projeto consiste em uma única rota de API: app/api/photobooth/route.ts. Ela é responsável por empacotar a imagem de retrato do frontend e o comando de estilo, enviando uma solicitação em modo de streaming para o endpoint /v1/images/edits da OpenAI. A estrutura do corpo da requisição é a seguinte:

const body = {

model: "gpt-image-2",

prompt: `${style.prompt}\n\n${OPENAI_IMAGE_OUTPUT_REQUIREMENTS}`,

images: [{ image_url: imageDataUrl }],

size: "1024x1536",

quality: "high",

output_format: "png",

stream: true,

partial_images: 2,

};

Três detalhes merecem atenção:

stream: true+partial_images: 2: Esta é uma capacidade de streaming exclusiva do gpt-image-2. O servidor enviará 2 quadros intermediários antes de entregar a imagem final.- Parâmetro

images: Aceita o data URL de uma ou várias imagens de referência, suportando a edição e fusão de múltiplas imagens. OPENAI_IMAGE_OUTPUT_REQUIREMENTS: Impõe requisitos como "proporção de retrato 2:3, mantendo a postura e a expressão do personagem", que é o padrão ideal para escrever bons comandos de edição de imagem.

Análise de eventos de streaming

A rota utiliza SSE (Server-Sent Events) para monitorar a resposta oficial, processando três tipos de eventos:

image_edit.partial_image: Quadros intermediários, enviandostyle-partialpara o frontend.image_edit.completed: Produto final, enviandostyle-finalpara o frontend.error: Lança exceções, que são capturadas de forma unificada pelo frontend.

No lado do React, o frontend utiliza um hook personalizado para manter uma cadeia de Promises writeQueue, garantindo que a ordem dos eventos não seja corrompida durante a concorrência de múltiplos estilos. Esta é, sem dúvida, a parte do demo com maior valor de referência em engenharia.

Primeiros passos com o imagegen-demo

Passos para uma reprodução minimalista

Seguindo o README oficial, você pode colocar o projeto para rodar com apenas 5 comandos:

git clone https://github.com/openai/openai-imagegen-demo

cd openai-imagegen-demo

cp .env.example .env.local

echo "OPENAI_API_KEY=sk-xxxxx" >> .env.local

npm install && npm run dev

Ver a configuração completa do .env.local usando o canal de proxy da APIYI

# Opção 1: Usar a API oficial da OpenAI (requer rede externa + cota de API)

OPENAI_API_KEY="sk-proj-xxxxx"

# Opção 2: Usar o canal de proxy da APIYI (conexão direta no Brasil, sem necessidade de VPN)

OPENAI_API_KEY="your-apiyi-key"

OPENAI_BASE_URL="https://vip.apiyi.com/v1"

# Opcional: IDs de organização e projeto

OPENAI_ORG_ID=""

OPENAI_PROJECT_ID=""

Em seguida, basta substituir o endpointBase codificado em app/api/photobooth/route.ts para ler process.env.OPENAI_BASE_URL ?? "https://api.openai.com/v1", permitindo alternar perfeitamente entre o canal oficial e o canal de proxy.

const endpointBase = process.env.OPENAI_BASE_URL ?? "https://api.openai.com/v1";

const response = await fetch(`${endpointBase}/images/edits`, {

method: "POST",

headers: {

"Authorization": `Bearer ${apiKey}`,

"Content-Type": "application/json",

},

body: JSON.stringify(body),

});

Dica de integração: Desenvolvedores locais podem encontrar três grandes obstáculos ao rodar o demo oficial da OpenAI (rede, cota de API e métodos de pagamento). Recomendamos obter uma chave compatível através do serviço proxy da APIYI (apiyi.com). Basta apontar a

OPENAI_BASE_URLparahttps://vip.apiyi.com/v1para iniciar o projeto localmente com um clique, mantendo total compatibilidade com os eventos de streaming e parâmetros oficiais.

Comparativo de soluções de integração para imagegen-demo

| Solução de Integração | Requisitos de Rede | Velocidade de Acesso | Preço por Unidade | Alterações no SDK |

|---|---|---|---|---|

| Conexão Direta OpenAI | Requer rede externa | Requer cartão + aprovação | Cobrança por token (aprox. $0,15+/img) | Nenhuma |

| API Corporativa fal | Acesso externo | Requer contrato corporativo | Cobrança por token | Adaptação leve |

| Canal Proxy APIYI | Acesso direto nacional | Imediato após registro | Cobrança transparente por token | Apenas base_url |

| Canal Reverso APIYI | Acesso direto nacional | Imediato após registro | Fixo $0,03 / img | Apenas nome do modelo |

Análise das Soluções

Análise da Conexão Direta OpenAI: O canal oficial mantém a liderança absoluta em conformidade e SLA, sendo o ambiente alvo padrão do imagegen-demo. No entanto, para operar no Brasil, exige contorno de restrições geográficas, cartão de crédito internacional e um longo ciclo de aprovação de cota de API. Em comparação, o canal proxy da APIYI é mais adequado para a fase de validação e ambientes de produção locais devido à acessibilidade de rede e velocidade de ativação.

Análise da API Corporativa fal: A fal lançou o endpoint corporativo do gpt-image-2 em 21 de abril de 2026, com excelente desempenho em SLA de alta concorrência. Contudo, voltada para clientes corporativos, a barreira de entrada para desenvolvedores independentes é alta. Para desenvolvedores que desejam rodar o imagegen-demo localmente, a APIYI oferece uma solução muito mais leve.

Diferença entre Proxy e Reverso da APIYI: O Proxy significa que a APIYI encaminha sua solicitação para a API oficial da OpenAI; a cobrança, o SLA e as funcionalidades são idênticos aos oficiais, sendo ideal para cenários comerciais. O Reverso é implementado através da engenharia reversa da interface web do ChatGPT; com um preço fixo de $0,03/img, é mais econômico e ideal para validação de protótipos. Ambos os canais são oferecidos em paralelo na plataforma APIYI, permitindo que os desenvolvedores alternem conforme a necessidade.

Nota de comparação: Os dados acima foram compilados a partir da precificação oficial da OpenAI, comunicados de lançamento corporativo da fal e da documentação técnica em

docs.apiyi.com, podendo ser verificados na prática através da APIYI (apiyi.com).

Detalhamento dos parâmetros principais do gpt-image-2 (do código-fonte do imagegen-demo)

Com base no arquivo lib/constants.ts do imagegen-demo, aqui estão as combinações de parâmetros padrão recomendadas oficialmente para o gpt-image-2:

| Parâmetro | Valor padrão do Demo | Descrição | Sugestão de ajuste |

|---|---|---|---|

| model | gpt-image-2 |

Modelo de imagem mais recente | Manter inalterado |

| size | 1024x1536 |

Proporção retrato 2:3 | Para redes sociais, use 1536x1024 |

| quality | high |

Qualidade máxima | medium/low para reduzir custos |

| output_format | png |

Suporta fundo transparente | Use webp em cenários Web para economizar banda |

| stream | true |

Ativa fluxo SSE | Essencial para aplicações em tempo real |

| partial_images | 2 |

Envia 2 quadros intermediários | Máximo de 3; equilibre entre experiência e banda |

Melhores práticas de engenharia de comando

A constante OPENAI_IMAGE_OUTPUT_REQUIREMENTS do Demo é um modelo de comando extremamente valioso:

"portrait orientation (2:3 aspect ratio), preserve the exact people, poses, facial expressions, and scene composition as faithfully as possible"

Este trecho revela o paradigma de ouro para a edição de imagens com o gpt-image-2:

- Especifique a proporção explicitamente: Mesmo definindo o parâmetro

size, reitere a proporção no comando para aumentar a precisão. - Enfatize a fidelidade:

preserve the exact ...é o comando chave para manter a consistência facial. - Liste as dimensões de fidelidade: Mencione explicitamente pessoas, poses, expressões faciais e composição da cena; quanto mais específico, maior a fidelidade da restauração.

Perguntas Frequentes (FAQ)

Q1: O que é o projeto openai-imagegen-demo?

O openai-imagegen-demo é uma aplicação de demonstração "Photobooth" de código aberto da OpenAI no GitHub, utilizando Next.js 15 + TypeScript + gpt-image-2 para implementar um fluxo de trabalho completo de "upload de retrato → seleção de estilo → geração de imagens com múltiplos estilos via streaming". É atualmente a referência mais autorizada para a integração do endpoint images/edits do gpt-image-2, licenciada sob MIT para uso comercial.

Q2: Qual a diferença entre o imagegen-demo e outras demos de geração de imagem?

A diferença reside principalmente em dois pontos: primeiro, utiliza o novo endpoint /v1/images/edits do gpt-image-2 para imagem para imagem (em vez do texto para imagem tradicional do DALL-E), o que permite manter a consistência facial; segundo, ativa a capacidade de streaming stream: true + partial_images, permitindo que o usuário veja o processo de renderização da imagem gradualmente, em vez de esperar 30 segundos com uma tela preta. Outras demos da comunidade são, em sua maioria, texto para imagem do DALL-E 3, que não possuem essas duas capacidades.

Q3: Quando o imagegen-demo foi lançado?

O repositório foi aberto simultaneamente ao lançamento do ChatGPT Images 2.0 pela OpenAI em 21 de abril de 2026. Com o lançamento oficial do modelo gpt-image-2 na API e no Codex, a OpenAI espera reduzir a barreira de entrada para desenvolvedores através deste Demo, que continua recebendo atualizações no README.

Q4: Para quais cenários de aplicação o imagegen-demo é mais adequado?

É ideal para quatro tipos de cenários:

- Troca de roupas/estilos em apps sociais: Usuários fazem upload de selfies para gerar versões em estilo chinês, pintura a óleo ou cyberpunk.

- Unificação de estilo em fotos de produtos de e-commerce: Converter em lote fotos de produtos para um estilo visual unificado da marca.

- Cabines de fotos com IA para conferências/eventos: Dispositivos de fotos interativos para eventos presenciais.

- Demos de ensino / Protótipos de hackathons: Demonstrar rapidamente as novas capacidades do gpt-image-2.

Q5: Como executar o imagegen-demo rapidamente via API?

Recomendamos o uso do canal de proxy da APIYI para uma reprodução rápida:

- Acesse APIYI (apiyi.com), registre uma conta e crie uma chave API.

- Clone o repositório:

git clone https://github.com/openai/openai-imagegen-demo - No arquivo

.env.local, insiraOPENAI_API_KEYeOPENAI_BASE_URL=https://vip.apiyi.com/v1 - Modifique o

route.tspara queendpointBaseleiaprocess.env.OPENAI_BASE_URL - Execute

npm install && npm run devpara ver o resultado emlocalhost:3000

A APIYI suporta a integração unificada de vários modelos de imagem populares, como gpt-image-2, Nano Banana Pro e Flux, facilitando a comparação e alternância local.

Q6: Como funciona o parâmetro partial_images do imagegen-demo?

O partial_images especifica quantos quadros intermediários o servidor deve enviar antes de retornar a imagem final. O valor padrão do Demo é 2, o que significa que uma única geração passará por três estágios: "esboço inicial → otimização secundária → produto final". Cada quadro intermediário é enviado através do evento SSE image_edit.partial_image, permitindo que o frontend renderize em tempo real e evite a espera de 30 segundos. O parâmetro suporta no máximo 3, mas quanto mais quadros, maior o custo de banda.

Q7: Como desenvolvedores brasileiros podem executar o imagegen-demo sem barreiras?

Executar o Demo oficial diretamente pode enfrentar obstáculos como acesso à rede da API da OpenAI, necessidade de cartão de crédito internacional e ciclos de aprovação de cota. O canal de proxy da APIYI resolve isso de uma vez:

- Registre-se em

apiyi.com, que aceita pagamentos locais. - Obtenha uma chave API compatível com o protocolo OpenAI.

- Configure

OPENAI_BASE_URL=https://vip.apiyi.com/v1no.env.local. - O

route.tslerá essa variável de ambiente, sem necessidade de alterar outros códigos.

O processo leva cerca de 5 minutos, sem necessidade de VPN, e a cobrança é transparente e alinhada com a oficial da OpenAI.

Q8: Quais são as limitações conhecidas do imagegen-demo?

Aqui estão as limitações atuais:

- Tempo de geração por imagem: No modo de alta qualidade (

quality: high), leva cerca de 20-30 segundos por imagem; para lotes, é necessária otimização de concorrência. - Consistência facial não é 100%: Em poses complexas ou cenas com várias pessoas, ainda podem ocorrer pequenas deformações.

- Custos: A OpenAI cobra por token; uma imagem de alta qualidade custa a partir de $0,15. Para cenários de lote, recomenda-se usar a qualidade

mediumou o canal da APIYI ($0,03/imagem). - Predefinições de estilo limitadas: O Demo vem com apenas ~10 estilos; é necessário expandir o

lib/styles.tsmanualmente. - Compatibilidade de câmera em dispositivos móveis: No iOS Safari, a permissão da câmera pode exigir autorização manual no primeiro acesso.

Principais pontos do openai-imagegen-demo

- Código aberto oficial da OpenAI: Demo oficial lançada com o gpt-image-2, sob licença MIT para uso comercial.

- Foco na capacidade de imagem para imagem: Utiliza o endpoint

/v1/images/edits, estabelecendo um padrão de engenharia para manter a consistência facial. - Tecnologia de renderização em streaming:

stream: true+partial_images: 2transforma a espera de uma tela preta em uma renderização progressiva. - Next.js 15 Full-stack: A arquitetura App Router + SSE é a melhor prática moderna para aplicações de geração de imagens.

- Atalho para acesso no Brasil: Através do serviço proxy de API da APIYI (apiyi.com), basta alterar a

base_urlpara conectar diretamente. - Paradigma de ouro para comandos:

preserve the exact ...é o "feitiço" chave para a fidelidade, vale a pena copiar para seus próprios projetos. - Canais duplos (Oficial vs. Proxy): Para uso comercial, escolha o canal oficial (alinhado com a OpenAI); para testes, escolha o canal proxy (custo fixo de $0,03/imagem).

Resumo

O openai-imagegen-demo é a melhor porta de entrada para entender as novas capacidades do gpt-image-2. Seu valor central reside em três pontos:

- Referência autorizada: O padrão de integração escrito pela própria OpenAI, cobrindo parâmetros, comandos e arquitetura de streaming de uma só vez.

- Código de nível de produção: Next.js 15 + SSE + concorrência multiestilo, pronto para ser reutilizado em seus próprios projetos.

- Reproduzível localmente: Através do canal proxy da APIYI, desenvolvedores podem colocar a demo oficial para rodar em 5 minutos.

Se você deseja experimentar imediatamente a capacidade de edição de imagem via streaming do gpt-image-2, recomendo obter uma chave compatível diretamente na APIYI (apiyi.com), clonar o openai-imagegen-demo e apontar a OPENAI_BASE_URL para https://vip.apiyi.com/v1. Assim, você poderá reproduzir localmente o efeito da demonstração oficial da OpenAI.

Leitura Complementar

Se você se interessou pelo gpt-image-2 e pelo openai-imagegen-demo, recomendo continuar a leitura:

- 📘 Onde encontrar a API reversa do gpt-image-2? Conecte-se ao canal oficial da APIYI em 3 minutos – Conheça a solução de baixo custo a $0,03 por imagem através do canal oficial.

- 📊 Comparativo: gpt-image-2 vs Nano Banana Pro – Analisamos as diferenças de capacidade entre os principais modelos de geração de imagens.

- 🚀 Guia de aplicação do gpt-image-2 em 6 grandes setores – Explore casos de uso reais em e-commerce, educação, redes sociais e muito mais.

📚 Referências

-

Repositório oficial do OpenAI imagegen-demo: Código-fonte completo, README e documentação de instalação.

- Link:

github.com/openai/openai-imagegen-demo - Descrição: O ponto de partida definitivo para entender o paradigma de integração do gpt-image-2 com o código-fonte original e guias de instalação.

- Link:

-

Documentação oficial da API do gpt-image-2 da OpenAI: Parâmetros do modelo, endpoints e informações de cobrança.

- Link:

developers.openai.com/api/docs/models/gpt-image-2 - Descrição: Consulte todos os parâmetros suportados, preços e regras de limite de taxa (rate limits).

- Link:

-

Página de lançamento do OpenAI ChatGPT Images 2.0: Introdução às capacidades do novo modelo.

- Link:

openai.com/index/introducing-chatgpt-images-2-0/ - Descrição: Entenda a filosofia de design, as capacidades principais e os cenários de uso do gpt-image-2.

- Link:

-

Documentação do canal oficial de conversão do gpt-image-2 da APIYI: Guia de acesso direto a partir do Brasil/China.

- Link:

docs.apiyi.com/en/api-capabilities/gpt-image-2-all/overview - Descrição: Obtenha a chave compatível, configurações de

base_urle detalhes de preços.

- Link:

Autor: Equipe Técnica APIYI

Troca de conhecimentos: Sinta-se à vontade para compartilhar seus casos práticos com o imagegen-demo na seção de comentários. Para mais documentação, acesse a central de documentos da APIYI em docs.apiyi.com.