ملاحظة من المؤلف: أطلقت OpenAI رسميًا مشروع Photobooth التجريبي القائم على gpt-image-2. في هذا المقال، سنقوم بتفكيك الكود المصدري ومبدأ عمل البث المباشر (Streaming) بعمق، وسنشرح كيفية إعادة إنتاج هذه القدرات دون أي عوائق تقنية عبر قناة وكيل APIYI.

أطلقت OpenAI رسميًا مشروع openai-imagegen-demo على GitHub، وهو تطبيق تجريبي مبني بإطار Next.js تم إصداره بالتزامن مع gpt-image-2. يستعرض هذا التطبيق قدرات النموذج الفريدة مثل توليد الصور بالبث المباشر، أسلوب البورتريه، والتوليد المتزامن متعدد الأنماط. رابط المشروع: github.com/openai/openai-imagegen-demo.

هذا ليس مجرد مثال "Hello World" تقليدي؛ فالكود المصدري يخفي خلفه نمط الإخراج التدريجي partial_images الموصى به من قبل OpenAI، بالإضافة إلى أحدث طرق استخدام نقطة النهاية /v1/images/edits في سيناريوهات تحرير الصور المتعددة.

القيمة الجوهرية: بعد قراءة هذا المقال، ستفهم تمامًا بنية هذا العرض التوضيحي الرسمي، والمعايير الرئيسية، وخطوات إعادة الإنتاج، وستعرف كيف تستخدم نفس API الخاص بـ gpt-image-2 داخل البلاد دون الحاجة إلى تجاوز الحجب أو الانتظار، وذلك عبر قناة وكيل APIYI.

النقاط الجوهرية لـ openai-imagegen-demo

| النقطة | الشرح | القيمة |

|---|---|---|

| موقع المشروع | عرض توضيحي رسمي من OpenAI لـ Photobooth، يستعرض أسلوب gpt-image-2 في معالجة الصور الشخصية |

المرجع الأكثر موثوقية لتكامل gpt-image-2 |

| حزمة التقنيات | Next.js 15 App Router + TypeScript + Tailwind + shadcn/ui | حزمة تقنيات ويب حديثة، جاهزة للإنتاج وقابلة لإعادة الاستخدام |

| نقاط النهاية الأساسية | POST /v1/images/edits، مع استخدام stream: true و partial_images |

أول عرض توضيحي رسمي لتوليد الصور بالبث المباشر |

| النموذج | gpt-image-2، جودة high، أبعاد 1024x1536 (نسبة 2:3 للصور الشخصية) |

التركيز على دقة الوجوه واستعادة التعابير |

| الترخيص | رخصة MIT، متاح للاستخدام التجاري والتطوير الثانوي | يمكن دمجه مباشرة في المشاريع التجارية |

| طريقة الوصول | يتطلب مفتاح API من OpenAI؛ خدمة وكيل API apiyi.com تتيح الاتصال المباشر محلياً |

تقليل العوائق، لا حاجة لـ VPN |

تفاصيل موقع مشروع imagegen-demo

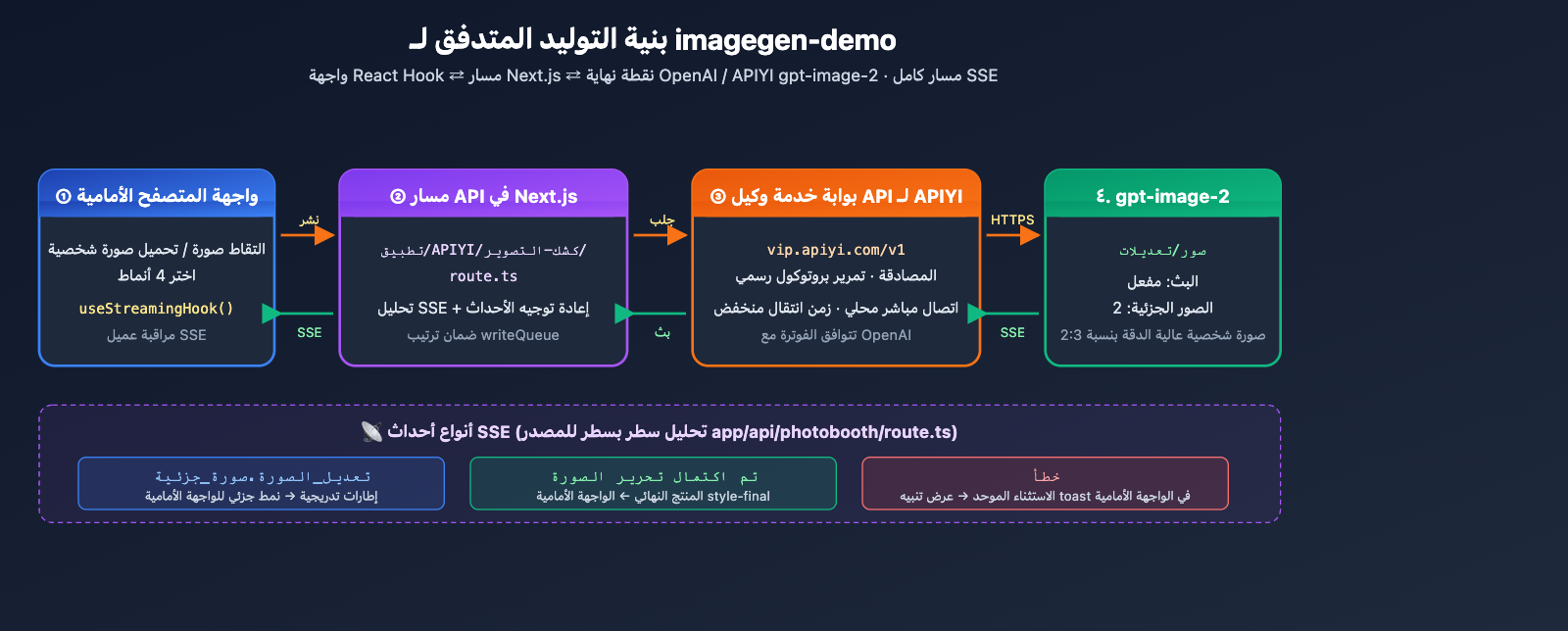

يُعد openai-imagegen-demo في جوهره استوديو تصوير تفاعلي (Photobooth): حيث يقوم المستخدم برفع أو التقاط صورة شخصية، واختيار ما يصل إلى 4 أنماط محددة مسبقاً (مثل نمط الحياكة، الفن الرقمي، الرسم الزيتي، إلخ)، ليقوم التطبيق باستدعاء متزامن لنقطة نهاية images/edits الخاصة بـ gpt-image-2 عبر البث المباشر، مع إرجاع النتائج لكل نمط تدريجياً.

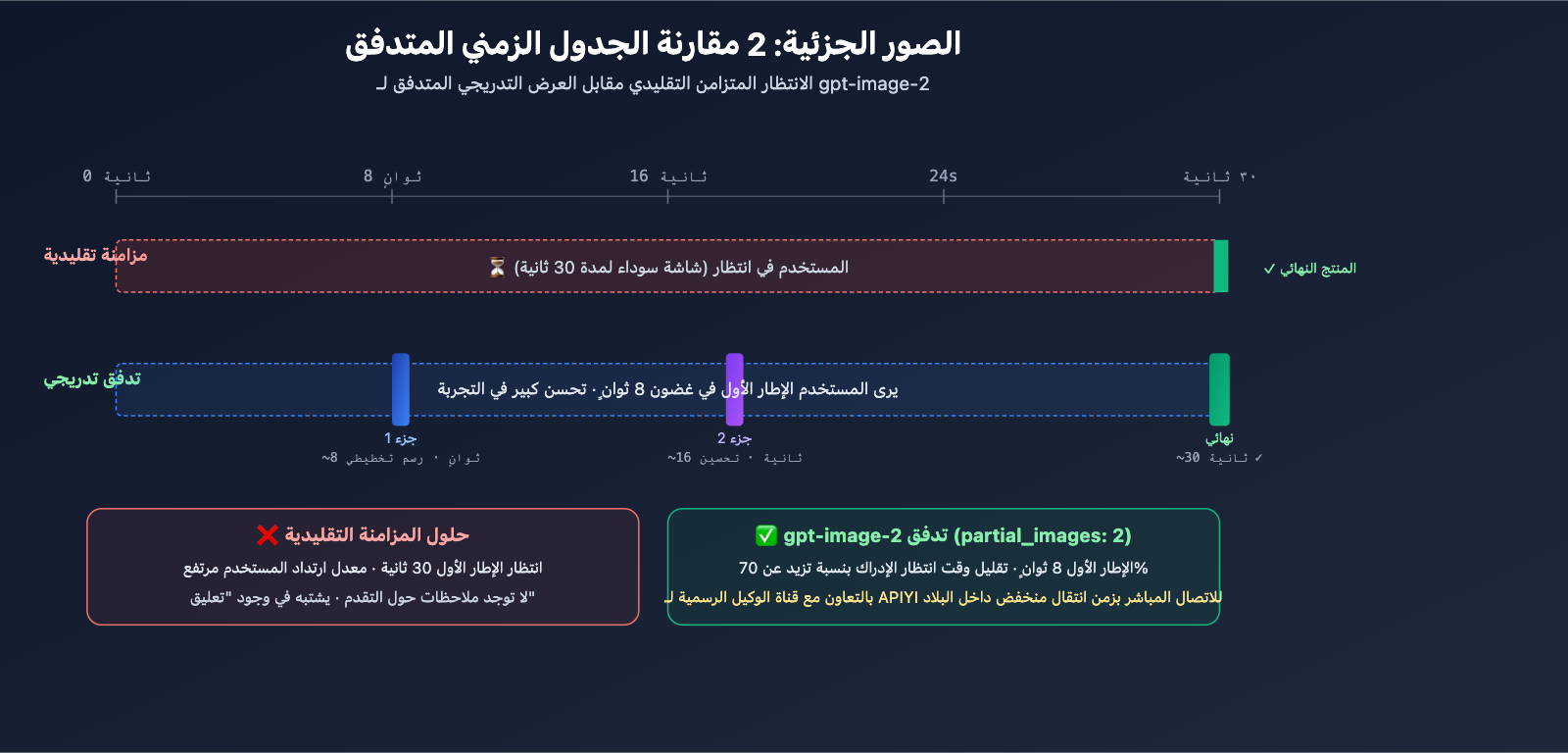

على عكس "عروض تحويل النص إلى صورة" الشائعة في السوق، يركز هذا المستودع الرسمي على قدرتين جديدتين: تحويل صورة إلى صورة (image editing) و المخرجات التدريجية المتدفقة (partial_images). الأولى تحل التحدي الهندسي المتمثل في "الحفاظ على اتساق الوجوه"، بينما تجعل الثانية تجربة الانتظار تتحول من شاشة سوداء لمدة 30 ثانية إلى ظهور تدريجي للإطارات.

شرح بنية مشروع imagegen-demo

تحليل الكود المصدري الرئيسي

يحتوي المشروع على مسار API واحد فقط وهو: app/api/photobooth/route.ts، وهو المسؤول عن حزم صورة البورتريه (الوجه) من الواجهة الأمامية مع "الموجه" (prompt) الخاص بالنمط، ثم إرسال طلب إلى نقطة النهاية /v1/images/edits الخاصة بـ OpenAI باستخدام نمط البث (Streaming). هيكل جسم الطلب الأساسي هو كما يلي:

const body = {

model: "gpt-image-2",

prompt: `${style.prompt}\n\n${OPENAI_IMAGE_OUTPUT_REQUIREMENTS}`,

images: [{ image_url: imageDataUrl }],

size: "1024x1536",

quality: "high",

output_format: "png",

stream: true,

partial_images: 2,

};

هناك ثلاث تفاصيل تستحق الاهتمام:

stream: true+partial_images: 2: هي قدرة بث حصرية لنموذجgpt-image-2؛ حيث يقوم الخادم بدفع إطارين وسيطين قبل تسليم الصورة النهائية.- معامل

images: يستقبل رابط البيانات (data URL) لصورة مرجعية واحدة أو أكثر، مما يدعم تحرير ودمج صور متعددة. OPENAI_IMAGE_OUTPUT_REQUIREMENTS: يفرض متطلبات مثل "نسبة أبعاد 2:3 للبورتريه، والحفاظ على وضعية الشخص وتعبيراته"، وهو النموذج الذهبي لكتابة "موجه" فعال لتحرير الصور.

تحليل أحداث البث

يقوم المسار (Route) بمراقبة استجابة OpenAI الرسمية عبر تقنية SSE (Server-Sent Events)، ويعالج الأنواع الثلاثة التالية من الأحداث:

image_edit.partial_image: إطار وسيط، يقوم بدفعstyle-partialإلى الواجهة الأمامية.image_edit.completed: المنتج النهائي، يقوم بدفعstyle-finalإلى الواجهة الأمامية.error: طرح استثناء، حيث تقوم الواجهة الأمامية بالتقاطه ومعالجته بشكل موحد.

في جانب React، تستخدم الواجهة الأمامية خطافًا (hook) مخصصًا للحفاظ على سلسلة writeQueue من نوع Promise، مما يضمن عدم تداخل ترتيب الأحداث عند وجود أنماط متعددة متزامنة، وهو الجزء الأكثر قيمة من الناحية الهندسية في هذا العرض التوضيحي.

البدء السريع مع imagegen-demo

خطوات التشغيل البسيطة

وفقًا لملف README الرسمي، يمكنك تشغيل المشروع بالكامل بـ 5 أوامر فقط:

git clone https://github.com/openai/openai-imagegen-demo

cd openai-imagegen-demo

cp .env.example .env.local

echo "OPENAI_API_KEY=sk-xxxxx" >> .env.local

npm install && npm run dev

عرض إعدادات .env.local الكاملة للتشغيل عبر قناة التحويل الرسمية لـ APIYI

# الخيار الأول: استخدام API الرسمي لـ OpenAI (يتطلب شبكة خارجية + حصة API)

OPENAI_API_KEY="sk-proj-xxxxx"

# الخيار الثاني: استخدام قناة التحويل لـ APIYI (اتصال مباشر محلي، بدون الحاجة لـ VPN)

OPENAI_API_KEY="your-apiyi-key"

OPENAI_BASE_URL="https://vip.apiyi.com/v1"

# اختياري: معرف المؤسسة والمشروع

OPENAI_ORG_ID=""

OPENAI_PROJECT_ID=""

بعد ذلك، ما عليك سوى استبدال endpointBase المكتوب برمجياً في app/api/photobooth/route.ts ليقرأ من process.env.OPENAI_BASE_URL ?? "https://api.openai.com/v1"، وبذلك يمكنك التبديل بسلاسة بين القناة الرسمية وقناة التحويل.

const endpointBase = process.env.OPENAI_BASE_URL ?? "https://api.openai.com/v1";

const response = await fetch(`${endpointBase}/images/edits`, {

method: "POST",

headers: {

"Authorization": `Bearer ${apiKey}`,

"Content-Type": "application/json",

},

body: JSON.stringify(body),

});

نصيحة للربط: سيواجه المطورون في المناطق المحلية ثلاث عقبات رئيسية عند تشغيل العرض التوضيحي الرسمي لـ OpenAI (الشبكة، حصة API، وطرق الدفع). نوصي بالحصول على مفتاح متوافق عبر قناة التحويل الرسمية من APIYI (apiyi.com)، وتوجيه

OPENAI_BASE_URLإلىhttps://vip.apiyi.com/v1للبدء محلياً بضغطة زر واحدة، مع ضمان توافق أحداث البث والمعاملات تماماً مع النسخة الرسمية.

مقارنة حلول الربط لـ imagegen-demo

| حل الربط | متطلبات الشبكة | سرعة التفعيل | السعر لكل عملية | تعديلات SDK |

|---|---|---|---|---|

| OpenAI الرسمي | يتطلب شبكة دولية | يتطلب بطاقة دفع + مراجعة | حسب الـ token (حوالي $0.15+/صورة) | لا يوجد |

| fal Enterprise API | يتطلب شبكة دولية | يتطلب اتفاقية مؤسسية | حسب الـ token | تعديلات طفيفة |

| APIYI (قناة الوكيل) | ربط مباشر محلي | فوري بعد التسجيل | شفاف حسب الـ token | تغيير base_url فقط |

| APIYI (قناة عكسية) | ربط مباشر محلي | فوري بعد التسجيل | ثابت $0.03 / صورة | تغيير اسم النموذج فقط |

تحليل الحلول

تحليل الربط المباشر بـ OpenAI: تظل القناة الرسمية رائدة في الامتثال ومستوى الخدمة (SLA)، وهي البيئة الافتراضية المستهدفة لـ imagegen-demo. ومع ذلك، يتطلب التشغيل محلياً تجاوز قيود الشبكة، وامتلاك بطاقة ائتمان دولية، كما أن فترة مراجعة حصص الـ API طويلة. في المقابل، توفر قناة وكيل APIYI سهولة أكبر في الوصول وسرعة في التفعيل، مما يجعلها مثالية لمرحلة التحقق وبيئات الإنتاج المحلية.

تحليل fal Enterprise API: أطلقت fal في 21 أبريل 2026 نقطة نهاية مؤسسية لـ gpt-image-2، والتي تتميز بأداء عالٍ في التعامل مع الطلبات المتزامنة. لكن بالنسبة للمطورين المستقلين، فإن عتبة الدخول مرتفعة. بالنسبة للمطورين الذين يرغبون في تشغيل imagegen-demo محلياً، تعتبر APIYI خياراً أكثر مرونة وخفة.

الفرق بين قناة APIYI الرسمية (الوكيل) والقناة العكسية: قناة الوكيل تعني أن APIYI تقوم بتمرير طلباتك إلى API الرسمي الخاص بـ OpenAI، حيث تكون الفواتير، ومستوى الخدمة، والميزات مطابقة تماماً للرسمي، وهي مناسبة للسيناريوهات التجارية. أما القناة العكسية فهي تتحقق عبر عكس هندسة واجهة الويب لـ ChatGPT، وتوفر سعراً ثابتاً قدره $0.03 للصورة، مما يجعلها مثالية للنماذج الأولية. تتوفر كلتا القناتين بالتوازي على منصة APIYI، ويمكن للمطورين التبديل بينهما حسب الحاجة.

ملاحظة المقارنة: البيانات أعلاه مجمعة من تسعير OpenAI الرسمي، وإصدارات fal للمؤسسات، والوثائق التقنية لـ

docs.apiyi.com؛ ويمكن التحقق منها عملياً عبر APIYI على apiyi.com.

شرح مفصل للمعلمات الرئيسية لـ gpt-image-2 (من كود المصدر لـ imagegen-demo)

بناءً على ملف lib/constants.ts في مشروع imagegen-demo، إليك مجموعات المعلمات الافتراضية الموصى بها رسمياً لنموذج gpt-image-2:

| المعلمة | القيمة الافتراضية في العرض التوضيحي | الوصف | نصيحة للضبط |

|---|---|---|---|

| model | gpt-image-2 |

أحدث نموذج صور حالي | يفضل تركه كما هو |

| size | 1024x1536 |

نسبة العرض إلى الارتفاع 2:3 (بورتريه) | للصور العرضية على التواصل الاجتماعي استخدم 1536x1024 |

| quality | high |

أعلى جودة ممكنة | استخدم medium/low لتقليل التكاليف |

| output_format | png |

يدعم الخلفيات الشفافة | استخدم webp لتوفير استهلاك البيانات في الويب |

| stream | true |

تفعيل البث عبر SSE | ضروري للتطبيقات التي تتطلب استجابة فورية |

| partial_images | 2 |

إرسال إطارين وسيطين | بحد أقصى 3، وازن بين تجربة الانتظار واستهلاك النطاق الترددي |

أفضل الممارسات لهندسة الموجه (Prompt Engineering)

يعد الثابت OPENAI_IMAGE_OUTPUT_REQUIREMENTS في العرض التوضيحي نموذجاً للموجه (prompt) ذا قيمة مرجعية عالية:

"portrait orientation (2:3 aspect ratio), preserve the exact people, poses, facial expressions, and scene composition as faithfully as possible"

تكشف هذه العبارة عن النموذج الذهبي لتحرير الصور باستخدام gpt-image-2:

- تحديد النسبة بوضوح: حتى لو قمت بضبط معلمة

size، يجب إعادة ذكر النسبة في الموجه لزيادة دقة النتائج. - التأكيد على متطلبات الدقة: عبارة

preserve the exact ...هي "التعويذة" الأساسية للحفاظ على اتساق الوجوه. - تعداد أبعاد الدقة: حدد بوضوح العناصر المراد الحفاظ عليها (الأشخاص، الوضعيات، تعابير الوجه، وتكوين المشهد)؛ فكلما كنت أكثر تحديداً، زادت دقة الاستعادة.

الأسئلة الشائعة (FAQ)

س1: ما هو مشروع openai-imagegen-demo؟

مشروع openai-imagegen-demo هو تطبيق تجريبي (Photobooth) مفتوح المصدر من OpenAI على GitHub. يستخدم Next.js 15 و TypeScript و gpt-image-2 لتنفيذ سير عمل متكامل يبدأ بـ "رفع صورة شخصية ← اختيار النمط ← توليد صور متعددة الأنماط بالبث المباشر". يُعد حالياً المرجع الأكثر موثوقية لدمج نقطة النهاية images/edits الخاصة بـ gpt-image-2، وهو مرخص بموجب رخصة MIT التي تسمح بالاستخدام التجاري.

س2: ما الفرق بين imagegen-demo وتطبيقات توليد الصور التجريبية الأخرى؟

يكمن الفرق في نقطتين أساسيتين: الأولى هي استخدام نقطة النهاية الجديدة كلياً /v1/images/edits من gpt-image-2 لتنفيذ "تحويل صورة إلى صورة" (بدلاً من "تحويل النص إلى صورة" التقليدي في DALL-E)، مما يضمن الحفاظ على اتساق الوجوه؛ والثانية هي تفعيل قدرة البث المباشر stream: true + partial_images، مما يتيح للمستخدم رؤية عملية تصيير الصورة تدريجياً بدلاً من انتظار شاشة سوداء لمدة 30 ثانية. معظم التطبيقات التجريبية الأخرى في المجتمع تعتمد على DALL-E 3 ولا تمتلك هاتين القدرتين.

س3: متى تم إطلاق imagegen-demo؟

تم إطلاق المستودع بالتزامن مع إصدار ChatGPT Images 2.0 من قبل OpenAI في 21 أبريل 2026. ومع الإطلاق الرسمي لنموذج gpt-image-2 عبر API و Codex، تهدف الشركة من خلال هذا العرض التوضيحي إلى خفض حاجز الدخول للمطورين، ويتم تحديث ملف README الخاص به باستمرار.

س4: ما هي سيناريوهات الاستخدام الأنسب لـ imagegen-demo؟

هو مناسب بشكل أساسي لأربع فئات من السيناريوهات:

- تطبيقات التواصل الاجتماعي لتغيير الملابس/الأنماط: حيث يرفع المستخدم صورة سيلفي ويحصل على نسخ بنمط الرسم الصيني، أو اللوحات الزيتية، أو نمط "سايبر بانك".

- توحيد نمط صور المنتجات في التجارة الإلكترونية: تحويل صور المنتجات بشكل جماعي إلى نمط بصري موحد للعلامة التجارية.

- أكشاك التصوير بالذكاء الاصطناعي في المؤتمرات/الفعاليات: أجهزة تصوير تفاعلية في الفعاليات الواقعية.

- نماذج تعليمية / نماذج أولية للهاكاثون: لعرض قدرات gpt-image-2 الجديدة بسرعة.

س5: كيف يمكن تشغيل imagegen-demo بسرعة عبر API؟

نوصي باستخدام قناة APIYI الرسمية للتشغيل السريع:

- قم بزيارة موقع APIYI (apiyi.com) لإنشاء حساب والحصول على مفتاح API.

- استنسخ المستودع:

git clone https://github.com/openai/openai-imagegen-demo - أضف

OPENAI_API_KEYوOPENAI_BASE_URL=https://vip.apiyi.com/v1إلى ملف.env.local. - قم بتعديل

route.tsليقومendpointBaseبقراءةprocess.env.OPENAI_BASE_URL. - نفذ

npm install && npm run devوستتمكن من رؤية النتائج علىlocalhost:3000.

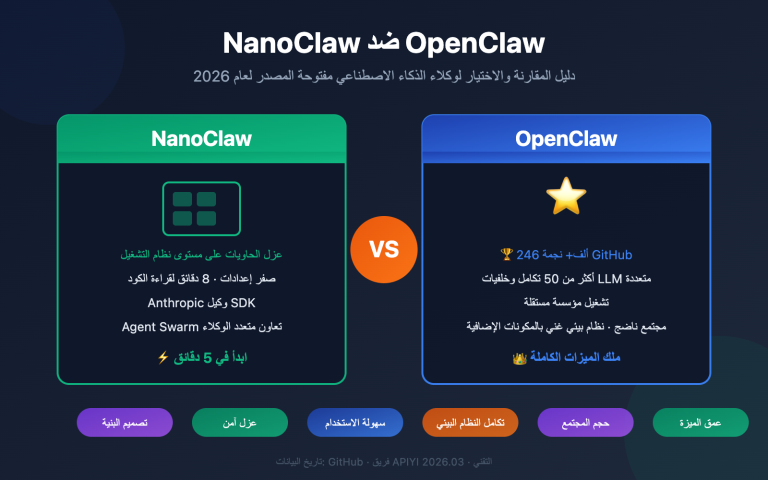

يدعم APIYI الربط الموحد لنماذج صور رئيسية مثل gpt-image-2، و Nano Banana Pro، و Flux، مما يسهل المقارنة والتبديل بينها محلياً.

س6: كيف يعمل معامل partial_images في imagegen-demo؟

يحدد partial_images عدد المرات التي يقوم فيها الخادم بدفع الإطارات المتوسطة قبل إرجاع الصورة النهائية. القيمة الافتراضية في العرض هي 2، مما يعني أن التوليد الفردي يمر بثلاث مراحل: "المسودة الأولية ← التحسين الثاني ← المنتج النهائي". يتم دفع كل إطار متوسط عبر حدث SSE باسم image_edit.partial_image ليتمكن الواجهة الأمامية من تصييره لحظياً، مما يغني المستخدم عن تجربة الانتظار المملة لمدة 30 ثانية. يدعم المعامل قيمة قصوى تصل إلى 3، ولكن زيادة الإطارات المتوسطة تزيد من استهلاك النطاق الترددي.

س7: كيف يمكن للمطورين في الصين تشغيل imagegen-demo دون عوائق؟

يواجه المطورون في الصين ثلاث عقبات عند تشغيل العرض الرسمي: الوصول إلى شبكة OpenAI API، الحاجة لبطاقة ائتمان دولية، وفترات مراجعة حصص API الطويلة. يمكن حل ذلك دفعة واحدة عبر قناة APIYI:

- سجل حساباً في

apiyi.com(يدعم الدفع عبر Alipay / WeChat). - احصل على مفتاح API متوافق مع بروتوكول OpenAI.

- اضبط

OPENAI_BASE_URL=https://vip.apiyi.com/v1في ملف.env.local. - سيقوم

route.tsبقراءة متغير البيئة هذا، دون الحاجة لتعديل أي كود آخر.

تستغرق العملية حوالي 5 دقائق، ولا تتطلب تجاوز الحجب، وتكون تكاليف الاستخدام متوافقة تماماً مع أسعار OpenAI الرسمية.

س8: ما هي القيود المعروفة لـ imagegen-demo؟

توضيح للقيود الحالية:

- مدة توليد الصورة الواحدة: تستغرق الجودة العالية (

quality: high) حوالي 20-30 ثانية للصورة الواحدة، لذا يتطلب التوليد الجماعي تحسين التزامن. - اتساق الوجوه ليس 100%: قد تحدث تشوهات طفيفة في الوضعيات المعقدة أو المشاهد التي تضم عدة أشخاص.

- اعتبارات التكلفة: تحاسب OpenAI رسمياً بناءً على الرموز (tokens)، حيث تبدأ تكلفة الصورة الواحدة عالية الجودة من 0.15 دولار. للسيناريوهات الجماعية، يُنصح باستخدام جودة

mediumأو استخدام القناة العكسية الرسمية لـ APIYI (بتكلفة 0.03 دولار/صورة). - أنماط محدودة مسبقاً: يحتوي العرض على حوالي 10 أنماط فقط، ويجب توسيع

lib/styles.tsيدوياً. - التوافق مع كاميرات الهواتف: قد يتطلب إذن الوصول للكاميرا في iOS Safari تفويضاً يدوياً عند الزيارة الأولى.

النقاط الجوهرية لـ openai-imagegen-demo

- مشروع مفتوح المصدر من OpenAI: عرض توضيحي رسمي مصاحب لـ gpt-image-2، مرخص بـ MIT للاستخدام التجاري.

- التركيز على "تحويل صورة إلى صورة": استخدام نقطة النهاية

/v1/images/editsكنموذج هندسي للحفاظ على اتساق الوجوه. - تقنية البث المباشر: استخدام

stream: true+partial_images: 2لتحويل الانتظار من شاشة سوداء إلى تصيير تدريجي. - Next.js 15: بنية App Router + SSE هي الممارسة المثلى الحديثة لتطبيقات توليد الصور.

- طريق مختصر للربط: عبر APIYI (apiyi.com)، يكفي تعديل

base_urlواحد للاتصال المباشر. - صيغة الموجه (Prompt) الذهبية: عبارة

preserve the exact ...هي مفتاح الحفاظ على الدقة، وتستحق إضافتها لمشاريعك الخاصة. - قنوات مزدوجة (رسمية وعكسية): اختر القناة الرسمية للأعمال (متوافقة مع OpenAI)، والقناة العكسية للتجارب (بسعر ثابت 0.03 دولار/صورة).

ملخص

يُعد openai-imagegen-demo أفضل نقطة انطلاق لفهم القدرات الجديدة لنموذج gpt-image-2، وتكمن قيمته الجوهرية في ثلاثة جوانب:

- مرجع موثوق: نموذج تكامل رسمي من الشركة المطورة، يغطي المعلمات (Parameters)، الموجهات (Prompts)، وبنية التدفق (Streaming Architecture) بشكل كامل.

- كود جاهز للإنتاج: يعتمد على Next.js 15 + SSE + التزامن متعدد الأنماط، مما يجعله قابلاً لإعادة الاستخدام مباشرة في مشاريعك الخاصة.

- قابلية التشغيل محلياً: من خلال قناة وكيل APIYI، يمكن للمطورين تشغيل العرض التوضيحي الرسمي في غضون 5 دقائق فقط.

إذا كنت ترغب في تجربة قدرات تحرير الصور المتدفقة لنموذج gpt-image-2 على الفور، نوصي بالحصول على مفتاح API متوافق عبر منصة APIYI (apiyi.com)، ثم استنساخ openai-imagegen-demo وتوجيه OPENAI_BASE_URL إلى https://vip.apiyi.com/v1؛ وبذلك ستتمكن من محاكاة تأثير العرض التوضيحي الرسمي لـ OpenAI محلياً.

قراءات إضافية

إذا كنت مهتماً بـ gpt-image-2 و openai-imagegen-demo، نوصي بمتابعة القراءة حول المواضيع التالية:

- 📘 أين تجد واجهة برمجة تطبيقات (API) معكوسة لـ gpt-image-2؟ تعرف على قناة APIYI في 3 دقائق – اكتشف حلولاً منخفضة التكلفة بتكلفة 0.03 دولار للصورة الواحدة.

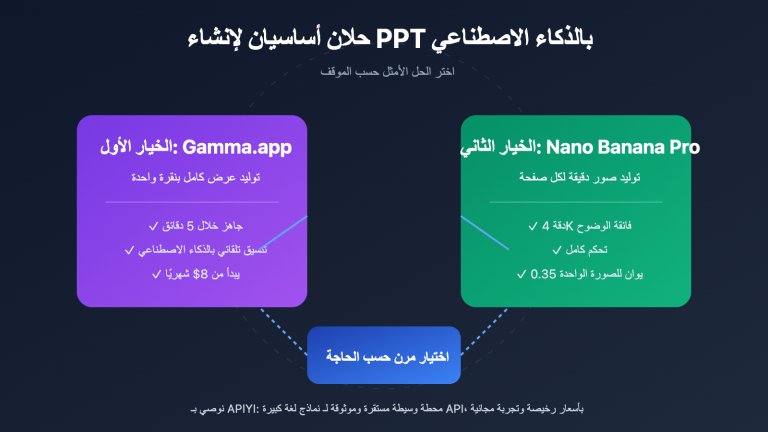

- 📊 مقارنة بين gpt-image-2 ونموذج Nano Banana Pro – تحليل للفروقات في قدرات نماذج الصور الرائدة.

- 🚀 دليل تطبيق gpt-image-2 في 6 قطاعات صناعية – استكشف حالات استخدام واقعية في التجارة الإلكترونية، التعليم، ووسائل التواصل الاجتماعي.

📚 المراجع

-

المستودع الرسمي لـ OpenAI imagegen-demo: الكود المصدري الكامل، ملف README، ووثائق التثبيت.

- الرابط:

github.com/openai/openai-imagegen-demo - الوصف: المصدر الأساسي للكود ودليل التثبيت، وهو نقطة البداية الموثوقة لفهم نمط دمج gpt-image-2.

- الرابط:

-

وثائق OpenAI الرسمية لـ gpt-image-2 API: معلمات النموذج، نقاط النهاية (endpoints)، وتفاصيل الفوترة.

- الرابط:

developers.openai.com/api/docs/models/gpt-image-2 - الوصف: للاطلاع على كافة المعلمات المدعومة، الأسعار، وقواعد تحديد معدل الاستخدام.

- الرابط:

-

صفحة إطلاق OpenAI ChatGPT Images 2.0: مقدمة حول قدرات النموذج الجديد.

- الرابط:

openai.com/index/introducing-chatgpt-images-2-0/ - الوصف: لفهم فلسفة تصميم gpt-image-2، قدراته الأساسية، وسيناريوهات الاستخدام.

- الرابط:

-

وثائق خدمة وكيل APIYI لـ gpt-image-2: دليل الربط المباشر داخل الصين.

- الرابط:

docs.apiyi.com/en/api-capabilities/gpt-image-2-all/overview - الوصف: للحصول على مفتاح API متوافق، إعدادات base_url، وتفاصيل الأسعار.

- الرابط:

المؤلف: الفريق التقني لـ APIYI

تبادل الخبرات: نرحب بمشاركتكم لتجاربكم العملية مع imagegen-demo في قسم التعليقات، وللمزيد من الوثائق يمكنكم زيارة مركز توثيق APIYI عبر الرابط docs.apiyi.com