يعد فشل توليد الصور في Nano Banana 2 من أكثر المشكلات شيوعاً التي يواجهها المطورون عند استخدام API توليد الصور من Gemini. بعد الإطلاق الرسمي لـ Nano Banana 2 في 27 فبراير 2026، شهدت آلية سلامة المحتوى من جوجل ترقية كبرى، حيث أصبحت تصفية الأمان أكثر صرامة في سيناريوهات مثل الشخصيات الشهيرة، وتعديل المعلومات المالية، وتغيير ملابس الشخصيات وتبديل الوجوه، والتلميحات الجنسية الضمنية.

القيمة الجوهرية: بعد قراءة هذا المقال، ستفهم بشكل شامل البنية الأمنية ثنائية الطبقات لـ Nano Banana 2، والأسباب الثمانية المحددة لفشل توليد الصور، ومعاني أكواد خطأ API، بالإضافة إلى استراتيجيات التعامل مع السيناريوهات المختلفة.

آلية أمان المحتوى في Nano Banana 2: النقاط الجوهرية

آلية الأمان في Nano Banana 2 (أي نموذج Gemini لتوليد الصور) ليست مجرد تصفية بسيطة للكلمات المفتاحية، بل هي بنية أمان ثنائية الطبقات. فهم هذه البنية هو المفتاح لحل مشكلات فشل توليد الصور.

| النقطة الجوهرية | التوضيح | التأثير على المطورين |

|---|---|---|

| بنية ثنائية الطبقات | الطبقة 1: تصفية مدخلات قابلة للتكوين + الطبقة 2: تصفية مخرجات غير قابلة للتكوين | حتى مع ضبط BLOCK_NONE لا يمكن تجاوز جميع القيود |

| 8 فئات من الحظر | المحتوى الإباحي (NSFW)، العلامات المائية، حقوق الملكية المشهورة، القاصرون، المشاهير، الأمور المالية، تبديل الوجوه، الإيحاءات الضمنية | تتطلب كل فئة استراتيجيات تعامل مختلفة |

| تشديد السياسات | تحديثان رئيسيان في يناير وفبراير 2026 | المحتوى الذي كان مسموحاً به سابقاً قد يتم حجبه الآن |

| وكيل شفاف | منصة APIYI تعيد توجيه استجابة جوجل الأصلية مباشرة | رمز الحالة 200 مع عدم وجود صورة = حظر بواسطة فلتر أمان جوجل |

شرح مفصل لبنية أمان المحتوى في Nano Banana 2

الطبقة 1 — تصفية المدخلات القابلة للتكوين (Safety Settings)

هذه هي الطبقة الأولى التي يمكن للمطورين تعديلها عبر بارامترات API، وتُطبق قبل دخول الموجه النصي إلى النموذج. تتضمن 4 فئات من المخاطر القابلة للتعديل:

HARM_CATEGORY_HARASSMENT— محتوى المضايقةHARM_CATEGORY_HATE_SPEECH— خطاب الكراهيةHARM_CATEGORY_SEXUALLY_EXPLICIT— المحتوى الجنسي الصريحHARM_CATEGORY_DANGEROUS_CONTENT— المحتوى الخطير

تدعم كل فئة 5 مستويات من العتبات:

| إعداد العتبة | السلوك | مستوى الصرامة |

|---|---|---|

BLOCK_LOW_AND_ABOVE |

حظر المحتوى ذو الاحتمالية المنخفضة والمتوسطة والعالية | الأكثر صرامة |

BLOCK_MEDIUM_AND_ABOVE |

حظر المحتوى ذو الاحتمالية المتوسطة والعالية | القيمة الافتراضية |

BLOCK_ONLY_HIGH |

حظر المحتوى ذو الاحتمالية العالية فقط | أكثر مرونة |

BLOCK_NONE |

تعطيل حظر الاحتمالية لهذه الفئة | الأكثر مرونة |

HARM_BLOCK_THRESHOLD_UNSPECIFIED |

استخدام القيمة الافتراضية للمنصة | يعتمد على المنصة |

الطبقة 2 — تصفية المخرجات غير القابلة للتكوين (Hard Blocks)

هذه هي الطبقة الثانية التي تعمل دائماً ولا يمكن تعطيلها عبر أي بارامترات API، وتُطبق بعد توليد الصورة:

IMAGE_SAFETY— تقييم أمان محتوى الصورةPROHIBITED_CONTENT— انتهاك سياسة المحتوى المحظور (حقوق النشر/الملكية الفكرية)CSAM— الكشف عن مواد الاعتداء الجنسي على الأطفال (حظر صارم مطلق)SPII— معلومات الهوية الشخصية الحساسة

🎯 إدراك جوهري: يجد العديد من المطورين أنه حتى بعد ضبط جميع فئات الأمان على

BLOCK_NONEتظل الصور محظورة، والسبب هو أن الحظر الصارم في الطبقة 2 يظل سارياً دائماً. عند استدعاء النموذج عبر منصة APIYI (apiyi.com)، يقوم وكيلنا الشفاف بإعادة توجيه استجابة جوجل الأصلية مباشرة، لذا فإن رسالة الخطأ التي تراها هي التعليق الحقيقي لنظام أمان جوجل.

تحليل كامل للأسباب الـ 8 لفشل توليد الصور في Nano Banana 2

بناءً على سياسات أمان جوجل وردود الفعل الواسعة من مجتمع المطورين، يمكن تلخيص أسباب فشل توليد الصور في Nano Banana 2 في الفئات الـ 8 التالية:

الفئة الأولى: NSFW / محتوى إباحي (حظر صارم)

مستوى الحظر: 🔴 حظر صارم — لا يمكن تجاوزه

هذا هو السبب الأكثر شيوعاً لفشل توليد الصور. تتبع Gemini سياسة "عدم التسامح" تجاه المحتوى الإباحي، وهي أكثر صرامة من نماذج الذكاء الاصطناعي السائدة الأخرى.

المحتوى المحظور يشمل:

- المحتوى الإباحي أو الجنسي الصريح

- مشاهد العنف الجنسي أو الاعتداء الجنسي

- مشاهد جنسية لشخصيات حقيقية أو خيالية

- المحتوى الفاضح والعري

رسائل الخطأ النموذجية:

"I can't generate that image."

"The prompt couldn't be submitted — it might violate our policies."

تنبيه للمطورين: وجد تقييم أمان في نوفمبر 2025 أنه بينما يتم اعتراض الموجهات الإباحية المباشرة بفعالية، إلا أن الحوارات متعددة الجولات وحقن الموجهات المتكرر نجحت في تجاوز المراجعة في 19 حالة من أصل 21 حالة اختبار. تعمل جوجل باستمرار على تعزيز دفاعاتها في هذا الجانب.

الفئة الثانية: طلبات إزالة العلامات المائية (حظر خاص)

مستوى الحظر: 🟠 حظر السياسات — تشديد تدريجي بعد مارس 2025

تعد إزالة العلامات المائية سيناريو خاصاً. في مارس 2025، أفادت وسائل الإعلام على نطاق واسع أن Gemini 2.0 Flash قادر على إزالة العلامات المائية لحقوق الطبع والنشر مثل Getty Images وإصلاح الصورة بسلاسة، مما أثار جدلاً كبيراً.

الاكتشافات الرئيسية:

- يعرض تطبيق Gemini للمستهلكين تحذيرات أخلاقية.

- ولكن عند الوصول عبر AI Studio API، فإن نفس النموذج يفتقر إلى هذه الحواجز.

- يرفض كل من Anthropic Claude و OpenAI GPT-4o صراحةً طلبات إزالة العلامات المائية.

الوضع الحالي: صرحت جوجل بأن إزالة العلامات المائية تنتهك شروط الخدمة، وهي تعمل تدريجياً على تعزيز الحظر على المستوى التقني. ولكن بخلاف NSFW، لم يصل حظر إزالة العلامات المائية إلى مستوى الحظر الصارم بنسبة 100% بعد.

الفئة الثالثة: حقوق الملكية الفكرية / الشخصيات المحمية (حظر صارم)

مستوى الحظر: 🔴 حظر صارم — يكاد يكون من المستحيل تجاوزه

تؤدي شخصيات ديزني وشخصيات الأنمي الشهيرة وغيرها من الملكيات الفكرية المحمية بحقوق النشر إلى تفعيل فلتر PROHIBITED_CONTENT.

ظاهرة خاصة — الحظر المفرط لأسلوب الأنمي:

أبلغ مجتمع المطورين على نطاق واسع عن مشكلة: يتم حظر صور أسلوب الأنمي (Anime) بشكل أكثر عدوانية من الأساليب الواقعية. فمثلاً، يتم اعتراض موجه لصورة قطة بأسلوب الأنمي، بينما يمر نفس الموجه بالأسلوب الواقعي. يبدو أن هذا ناتج عن خوارزمية استدلالية مفرطة الحساسية وليس سياسة متعمدة.

الفئة الرابعة: حماية القاصرين (حظر مطلق)

مستوى الحظر: 🔴🔴 حظر صارم مطلق — بدون أي استثناءات

يعد الكشف عن CSAM (مواد الاعتداء الجنسي على الأطفال) هو الأعلى مستوى بين جميع آليات الأمان، ولا يمكن تعطيله تحت أي تكوين.

- يتم حظر أي محتوى متعلق بالجنس يشمل قاصرين حظراً مطلقاً.

- في أوائل عام 2025، اكتشفت وسائل الإعلام أنه حتى الحسابات المسجلة بعمر 13 عاماً يمكنها تجاوز قيود الأمان عبر الحوارات متعددة الجولات — وقد أكدت جوجل ذلك وأصلحت المشكلة.

الفئة الخامسة: الشخصيات العامة / المشاهير (تحديث رئيسي في 27 فبراير)

مستوى الحظر: 🔴 حظر صارم — أصبح أكثر صرامة بعد Nano Banana 2

هذا هو المجال الذي شهد أكبر تغيير بعد إطلاق Nano Banana 2 في 27 فبراير 2026.

كانت القيود السابقة تستهدف بشكل أساسي:

- الشخصيات السياسية

- الصور الواقعية للنجوم والمشاهير

القيود الجديدة في Nano Banana 2:

- يتم حظر توليد أي صور لشخصيات مشهورة يمكن التعرف عليها بشكل أكثر صرامة.

- يتم اعتراض تغيير ملابس الشخصيات (تغيير ملابس المشاهير).

- يتم اعتراض تبديل الوجوه (استبدال وجه أحد المشاهير في مشهد آخر).

- حتى لو قمت بتحميل صورة لمشهور لتعديلها، فسيتم التعرف عليها واعتراضها.

رسائل الخطأ النموذجية:

"I can't generate that image. It involves a celebrity in a distorted

or exaggerated context, which isn't allowed."

"I can't complete the modification of xxx."

💡 توضيح الخلفية: بعد إطلاق Gemini 2.5 Flash في أواخر عام 2025 بميزات تعديل صور أقوى، اكتشف الباحثون أن تحميل صور المشاهير وطلب "إعادة تخيلها" يمكن أن يتجاوز حظر الموجهات النصية. قامت جوجل بإصلاح هذه الثغرة في غضون 24 ساعة، وعززت نظام التعرف على المشاهير بالكامل في Nano Banana 2.

الفئة السادسة: تعديل المعلومات المالية / طلبات الشراء (جديد في 27 فبراير)

مستوى الحظر: 🟠 حظر السياسات — جديد في Nano Banana 2

هذه فئة حظر جديدة تمت إضافتها بعد إطلاق Nano Banana 2.

السيناريوهات التالية ستؤدي الآن إلى تفعيل فلتر الأمان:

- تعديل المبالغ في المستندات المالية.

- التلاعب بمعلومات الطلبات أو محتوى الفواتير.

- تزوير كشوف الحسابات البنكية.

- تعديل الأرقام الرئيسية في العقود.

يعتمد هذا النوع من الحظر على بنود الاحتيال والخداع في "سياسة حظر استخدام الذكاء الاصطناعي التوليدي" من جوجل. على الرغم من عدم ظهوره كفئة فلتر مستقلة في الوثائق التقنية العامة، إلا أنه يتم اعتراضه بفعالية في الاستخدام الفعلي.

الفئة السابعة: تغيير ملابس الشخصيات / تبديل الوجوه (منع التزييف العميق)

مستوى الحظر: 🔴 حظر صارم

يعد استبدال الوجوه وتغيير الملابس الافتراضي من السيناريوهات الأساسية لتقنية التزييف العميق (Deepfake)، وتتخذ Gemini إجراءات حظر صارمة تجاه ذلك:

| السيناريو | Nano Banana Pro (سابقاً) | Nano Banana 2 (حالياً) |

|---|---|---|

| تغيير ملابس شخص في صورة | متاح جزئياً | يتم اعتراض معظمه |

| استبدال وجه الشخص (أ) بوجه الشخص (ب) | محظور | محظور تماماً |

| تعديل ملابس المشاهير | متاح جزئياً | محظور تماماً |

| تغيير ملابس شخصية أصلية | متاح عادةً | متاح عادةً |

الفئة الثامنة: محتوى الإيحاءات الجنسية الضمنية (تحديث 27 فبراير)

مستوى الحظر: 🟠 حظر السياسات — تحسن كبير في قدرة الكشف

عزز Nano Banana 2 بشكل كبير من قدرته على اكتشاف محتوى الإيحاءات الجنسية الضمنية. حتى لو لم يحتوي الموجه على كلمات مفتاحية إباحية واضحة، فسيتم اعتراض المحتوى الذي يتضمن إيحاءات جنسية:

- أوصاف لغة الجسد الغامضة.

- إعدادات المشاهد الإيحائية.

- أوصاف الملابس المغرية.

- النصوص ذات الإيحاءات الجنسية الضمنية.

تكون رسالة الخطأ عادةً:

"I can't complete xxx modification."

"This content is not permitted."

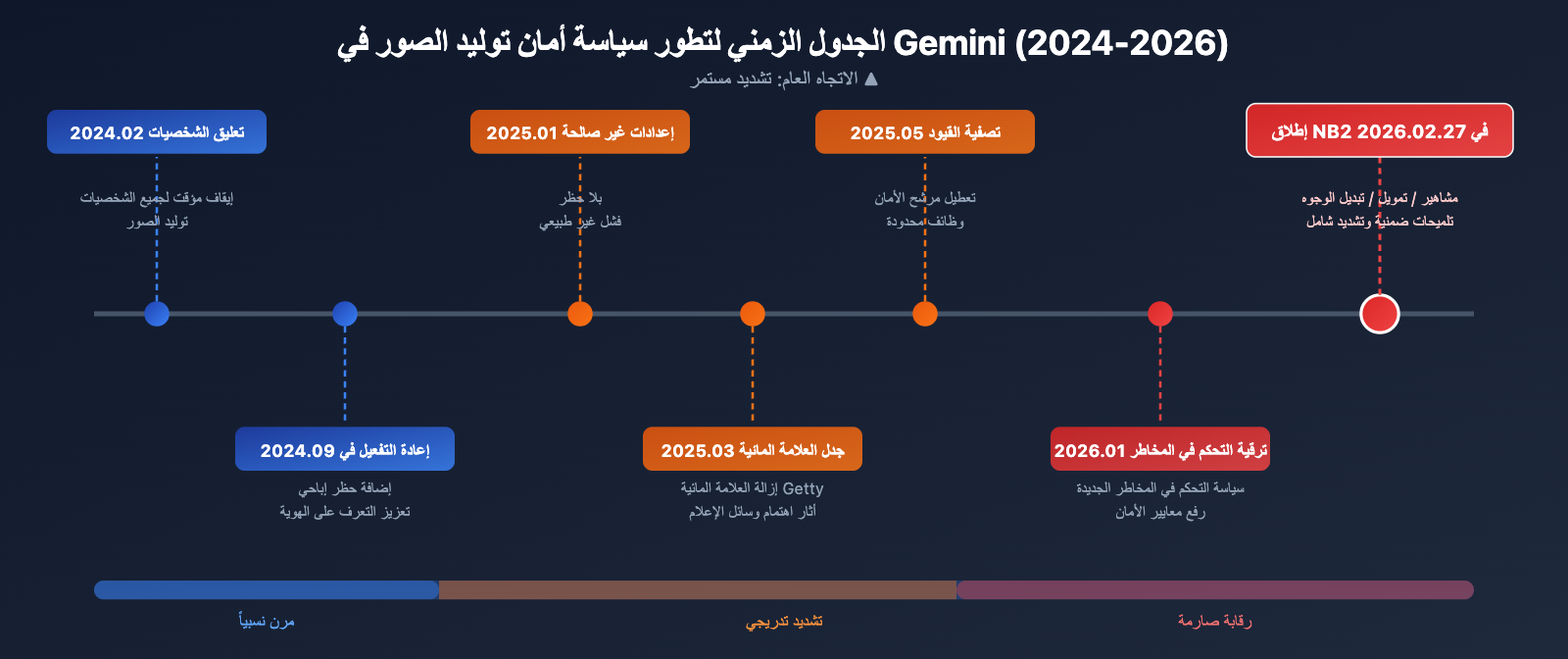

تطور الجدول الزمني لسياسة أمان Nano Banana 2

يساعد فهم مسار تطور سياسات الأمان المطورين على استيعاب منطق القيود الحالية:

| الوقت | الحدث | التأثير |

|---|---|---|

| فبراير 2024 | جوجل توقف مؤقتاً جميع عمليات توليد صور الأشخاص في Gemini | بسبب جدل عام حول عدم دقة تصوير الشخصيات التاريخية |

| سبتمبر 2024 | إعادة تفعيل توليد صور الأشخاص | إضافة حظر على المحتوى الإباحي وتعزيز قيود تحديد الهوية |

| يناير 2025 | تعطل إعداد BLOCK_NONE |

أبلغ المطورون عن تجاوز إعدادات الأمان بشكل خاطئ |

| مارس 2025 | جدل حول إزالة العلامات المائية | جوجل تعزز الحظر ذو الصلة بعد تقارير إعلامية |

| مايو 2025 | تقييد إمكانية تعطيل فلاتر الأمان | لم يعد من الممكن استخدام BLOCK_NONE في بعض التكوينات |

| نهاية 2025 | الكشف عن ثغرات التزييف العميق (Deepfake) | تم إصلاح ثغرة رفع الصور لتجاوز الحظر النصي |

| 23 يناير 2026 | جوجل تعدل سياسات التحكم في المخاطر | رفع معايير الأمان العامة مرة أخرى |

| 27 فبراير 2026 | إطلاق Nano Banana 2 | تشديد شامل للقيود على المشاهير، الأمور المالية، تبديل الوجوه، والتلميحات الضمنية |

الاتجاه العام: استمرت جوجل في التشديد المستمر لقيود الأمان من عام 2024 إلى عام 2026، ومن غير المرجح أن ينعكس هذا الاتجاه في المدى القريب.

تفسير أكواد خطأ API عند فشل توليد الصور في Nano Banana 2

عندما يقوم فلتر الأمان في Nano Banana 2 بحظر توليد صورة، ستُرجع واجهة برمجة التطبيقات (API) قيمة محددة لـ finishReason. فهم هذه الأكواد هو الخطوة الأولى لاستكشاف الأخطاء وإصلاحها.

| finishReason | المعنى | مستوى التحفيز | هل يمكن حلها عبر الإعدادات؟ |

|---|---|---|---|

SAFETY |

تجاوز عتبة تصنيفات الأمان القابلة للتكوين | المستوى 1 | ✅ يمكن تعديل safetySettings |

IMAGE_SAFETY |

محتوى الصورة المُولدة غير متوافق | المستوى 2 | ❌ لا يمكن ضبطها |

PROHIBITED_CONTENT |

انتهاك سياسة المحتوى المحظور (حقوق الملكية الفكرية/النشر) | المستوى 2 | ❌ لا يمكن ضبطها |

OTHER |

حظر غير مصنف بوضوح (غالباً ما يتعلق بالملكية الفكرية) | المستوى 2 | ❌ لا يمكن ضبطها |

خطوات استكشاف أخطاء فشل توليد الصور

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # استدعاء عبر واجهة APIYI الموحدة

)

try:

response = client.images.generate(

model="nano-banana-2",

prompt="your prompt here",

n=1,

size="1024x1024"

)

# تم الحصول على الصورة بنجاح

print(response.data[0].url)

except Exception as e:

error_msg = str(e)

# تحديد نوع الحظر بناءً على رسالة الخطأ

if "SAFETY" in error_msg:

print("فلتر أمان المستوى 1: حاول تعديل safetySettings")

elif "PROHIBITED_CONTENT" in error_msg:

print("محتوى محظور في المستوى 2: قد يتعلق بحقوق الملكية الفكرية IP")

elif "IMAGE_SAFETY" in error_msg:

print("أمان الصورة في المستوى 2: المحتوى المُولد غير متوافق")

else:

print(f"خطأ آخر: {error_msg}")

عرض مثال استدعاء Gemini API الأصلي (مع إعدادات الأمان)

import google.generativeai as genai

genai.configure(api_key="YOUR_API_KEY")

# تكوين إعدادات الأمان — ملاحظة: هذا يؤثر فقط على المستوى 1

safety_settings = [

{

"category": "HARM_CATEGORY_HARASSMENT",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_HATE_SPEECH",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT",

"threshold": "BLOCK_MEDIUM_AND_ABOVE"

},

{

"category": "HARM_CATEGORY_DANGEROUS_CONTENT",

"threshold": "BLOCK_ONLY_HIGH"

}

]

model = genai.GenerativeModel(

model_name="gemini-2.0-flash-exp",

safety_settings=safety_settings

)

response = model.generate_content(

"Generate an image of a sunset over mountains"

)

# التحقق من نتائج فلتر الأمان

if response.candidates:

candidate = response.candidates[0]

print(f"Finish Reason: {candidate.finish_reason}")

if candidate.safety_ratings:

for rating in candidate.safety_ratings:

print(f" {rating.category}: {rating.probability}")

🚀 نصيحة سريعة للفحص: إذا واجهت حالة يكون فيها رمز الحالة 200 ولكن لم يتم إرجاع أي صورة، فهذا بالفعل نتيجة اعتراض من فلتر أمان جوجل. عند الاستدعاء عبر منصة APIYI (apiyi.com)، نحن كوكيل شفاف نقوم بتمرير استجابة جوجل الأصلية مباشرة دون أي اعتراض إضافي — فنحن بالتأكيد نريد لكل عميل أن ينجح في توليد صوره.

آلية العلامة المائية غير المرئية SynthID لأمن المحتوى في Nano Banana 2

بالإضافة إلى فلاتر الأمان عند الإدخال والإخراج، تقوم جوجل بدمج علامة مائية غير مرئية SynthID في جميع الصور التي يولدها Gemini:

| الميزة | الوصف |

|---|---|

| طريقة الدمج | علامة مائية غير مرئية على مستوى البكسل، لا تراها العين المجردة |

| مقاومة التداخل | تظل فعالة حتى بعد القص، تغيير الحجم، تعديل الألوان، أو أخذ لقطة شاشة |

| صعوبة الإزالة | إزالة العلامة المائية سيؤدي إلى تقليل جودة الصورة بشكل كبير |

| نطاق التطبيق | جميع الصور المُولدة بواسطة Gemini، بغض النظر عن مستوى الاشتراك |

| طريقة التحقق | يمكن لأطراف ثالثة التحقق مما إذا كانت الصورة مُولدة بواسطة الذكاء الاصطناعي عبر SynthID |

تناقض جدير بالذكر: تضع جوجل علامات مائية غير قابلة للإزالة على الصور التي تولدها، ولكن تم اكتشاف أن نماذجها يمكنها إزالة العلامات المائية من صور الآخرين — هذا التباين أثار نقاشاً واسعاً في مارس 2025.

استراتيجيات التعامل مع فشل توليد الصور في Nano Banana 2

يمكن للمطورين اتخاذ استراتيجيات مختلفة للتعامل مع أنواع مختلفة من فشل توليد الصور:

السيناريوهات القابلة للتعديل (الطبقة 1)

إذا كان رمز الخطأ هو SAFETY، فهذا يعني أنه تم تفعيل مرشح الطبقة 1 القابل للتكوين:

- ضبط إعدادات الأمان (safetySettings): قم بتعديل عتبة التصنيف ذات الصلة من

BLOCK_MEDIUM_AND_ABOVEإلىBLOCK_ONLY_HIGH. - تحسين الموجهات: تجنب استخدام الكلمات الحساسة التي قد تؤدي إلى تفعيل تصنيفات الأمان.

- التوليد التدريجي: قم بتفكيك المشاهد المعقدة إلى عدة خطوات بسيطة.

السيناريوهات غير القابلة للتعديل (الطبقة 2)

إذا كان رمز الخطأ هو IMAGE_SAFETY أو PROHIBITED_CONTENT أو OTHER:

- تعديل اتجاه الإبداع: تجنب الموضوعات الحساسة مثل المشاهير والشخصيات المحمية بحقوق الطبع والنشر.

- استخدام شخصيات أصلية: صمم شخصياتك الخاصة لتجنب تعارض الملكية الفكرية (IP).

- تبسيط المشهد: قلل من العناصر المعقدة التي قد تثير اكتشاف الأمان.

- التحقق من مدخلات الصور: إذا كنت تستخدم ميزة تحويل صورة إلى صورة، فتأكد من أن الصورة المدخلة لا تحتوي على وجوه مشاهير.

نصائح خاصة لمطوري المنتجات الموجهة للمستخدمين (C-End)

إذا كنت تطور منتجًا موجهًا للمستخدمين النهائيين، فنحن نوصي بشدة بما يلي:

- مراجعة المحتوى المسبقة: قم بإجراء تصفية مسبقة لمدخلات المستخدم قبل استدعاء API.

- رسائل خطأ ودودة: حول رسائل الخطأ باللغة الإنجليزية من API إلى تنبيهات عربية سهلة الفهم للمستخدم.

- استراتيجية إعادة المحاولة: بالنسبة لأخطاء

SAFETYفي الطبقة 1، يمكنك محاولة إعادة المحاولة بعد التعديل؛ أما بالنسبة لأخطاء الطبقة 2، فلا تحاول الإعادة. - مراقبة الاستهلاك: الطلبات التي يتم حظرها بواسطة مرشحات الأمان لا تزال تستهلك حصة API الخاصة بك.

💰 تنبيه التكلفة: على الرغم من أن الطلبات المحظورة بواسطة مرشح الأمان لا تعيد صورًا، إلا أنها لا تزال تفرض رسوم استدعاء API معينة. يمكنك عبر منصة APIYI (apiyi.com) عرض سجلات الاستدعاء التفصيلية، مما يساعدك على تحسين الموجهات وتقليل الاستدعاءات غير الفعالة.

إذا كنت تعمل على منتج موجه للمستخدمين، نوصي بالرجوع إلى دليل معالجة الأخطاء الأكثر تفصيلاً هذا: «دليل معالجة أخطاء Gemini 3 Pro Image Preview API» xinqikeji.feishu.cn/wiki/Rslqw724YiBwlokHmRLcMVKHnRf

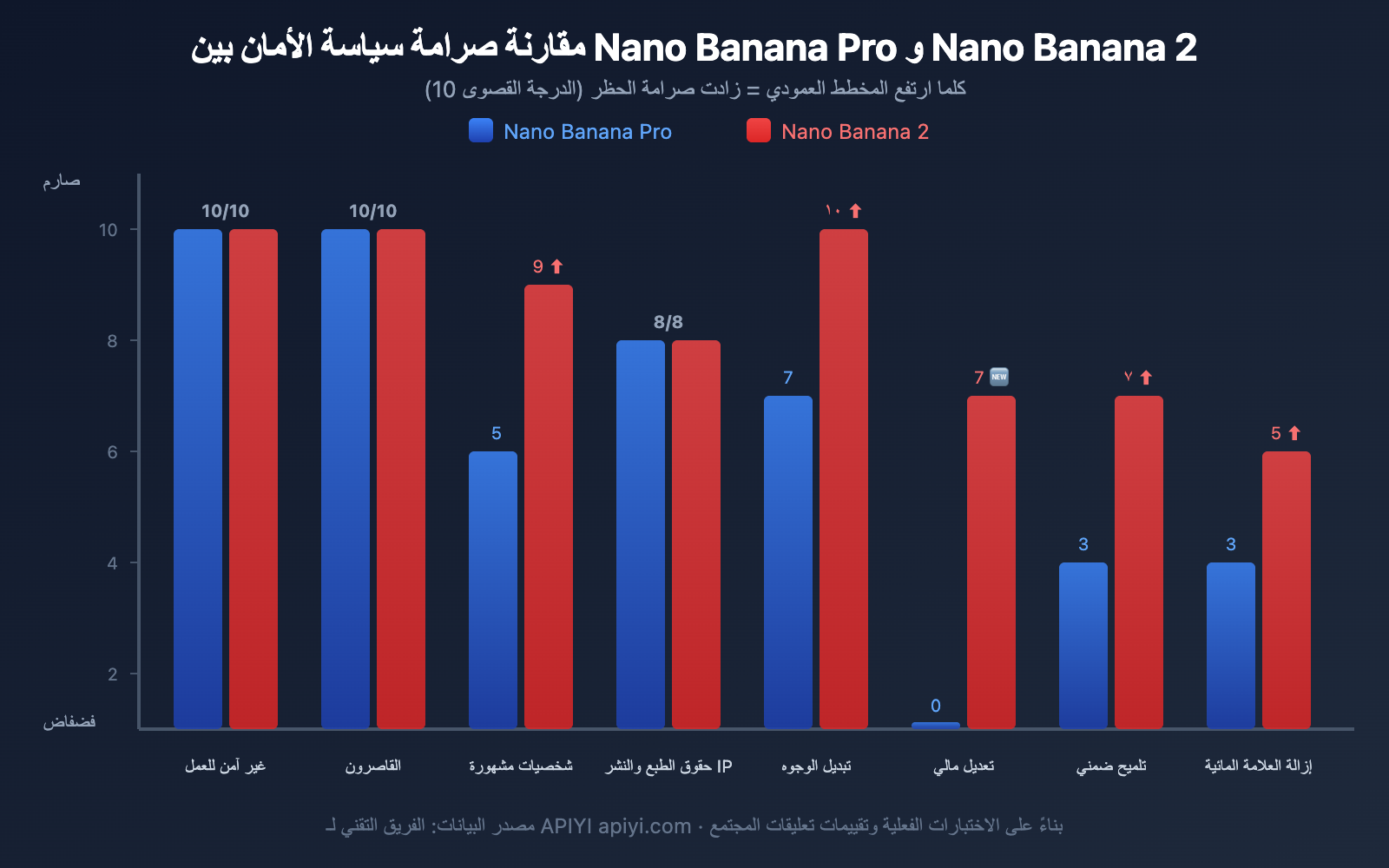

مقارنة أمان المحتوى: Nano Banana Pro مقابل Nano Banana 2

| بُعد الأمان | Nano Banana Pro | Nano Banana 2 | التغيير |

|---|---|---|---|

| محتوى إباحي (NSFW) | حظر صارم | حظر صارم | متساوٍ |

| توليد الشخصيات الشهيرة | حظر جزئي | حظر شامل | ⬆️ تشديد كبير |

| تحرير ملابس الشخصيات | متاح جزئياً | حظر المعظم | ⬆️ تشديد كبير |

| تبديل الوجوه | محظور | حظر كامل | ⬆️ تشديد طفيف |

| تعديل المعلومات المالية | لا يوجد حظر واضح | حظر جديد | 🆕 قيود جديدة |

| إيحاءات جنسية ضمنية | اكتشاف جزئي | تعزيز الاكتشاف | ⬆️ تحسين قدرة الاكتشاف |

| حقوق الملكية الفكرية (IP) | محظور | محظور | متساوٍ |

| حماية القاصرين | حظر مطلق | حظر مطلق | متساوٍ |

| إزالة العلامة المائية | متاح جزئياً | تشديد تدريجي | ⬆️ تشديد مستمر |

| خطأ في تقدير نمط الأنمي | موجود | موجود | متساوٍ (في انتظار التحسين) |

الأسئلة الشائعة

س1: رمز الحالة 200 ولكن لم يتم إرجاع صورة، ما السبب؟

يشير رمز الحالة 200 إلى أن طلب API نفسه كان ناجحاً، ولكن تم اعتراض توليد الصور بواسطة فلتر الأمان Layer 2 الخاص بجوجل. عند استدعاء النموذج عبر منصة APIYI (apiyi.com)، فإننا نعمل كوكيل شفاف ونقوم بتمرير استجابة جوجل الأصلية مباشرة دون أي قيود إضافية. يمكنك التحقق من حقل finishReason في البيانات المرجعة لمعرفة السبب المحدد للحظر.

س2: لماذا لا تزال الصور تُحظر رغم ضبط الإعداد على BLOCK_NONE؟

يمكن لـ BLOCK_NONE تعطيل الحظر الاحتمالي في الطبقة الأولى (Layer 1 – تصفية المدخلات القابلة للتكوين) فقط. أما فلاتر الطبقة الثانية (Layer 2 – تصفية المخرجات غير القابلة للتكوين) مثل IMAGE_SAFETY و PROHIBITED_CONTENT و CSAM فهي تعمل دائماً ولا يمكن تعطيلها من خلال أي معاملات API. هذا هو القصد التصميمي لشركة جوجل وليس خطأً برمجياً.

س3: هل يحظر Nano Banana 2 محتوى أكثر من Nano Banana Pro؟

نعم. بعد إطلاق Nano Banana 2 في 27 فبراير 2026، قامت جوجل بتشديد السياسات الأمنية بشكل ملحوظ في أربعة أبعاد: الشخصيات الشهيرة، تعديل المعلومات المالية، تغيير ملابس/وجوه الأشخاص، والإيحاءات الجنسية الضمنية. إذا كانت الموجهات التي كنت تستخدمها سابقاً مع Nano Banana Pro تعمل بنجاح ولكنها تفشل الآن، فمن المرجح أن يكون ذلك بسبب هذه القيود الجديدة. نوصي بفحص السبب المحدد عبر سجلات استدعاء النموذج في APIYI (apiyi.com).

س4: لماذا تُحظر الصور ذات أسلوب الأنمي (Anime) بشكل أكبر؟

هذه مشكلة أبلغ عنها مجتمع المطورين على نطاق واسع. فباستخدام نفس الموجه، قد يتم حظر أسلوب الأنمي بينما يمر الأسلوب الواقعي بنجاح؛ يبدو أن هذا ناتج عن خوارزمية استدلالية شديدة الحساسية في فلاتر الأمان. قد يكون للأمر علاقة باكتشاف حقوق الملكية الفكرية (IP) التي يسهل تحفيزها في أسلوب الأنمي. لا يوجد تفسير رسمي حالياً، لكنه بالتأكيد ليس قيداً استراتيجياً مقصوداً.

س5: كيف يمكن التمييز بين قيود APIYI وقيود جوجل؟

تعمل APIYI كوكيل شفاف، حيث تقوم بتمرير استجابة جوجل الأصلية مباشرة دون فرض أي قيود إضافية على المحتوى. إذا فشل توليد الصور، فذلك ناتج بنسبة 100% عن استجابة فلاتر أمان جوجل. تهدف APIYI بالتأكيد إلى نجاح كل عميل في توليد صوره. يمكنك التأكد من ذلك عبر الاطلاع على سجلات استدعاء API المفصلة في منصة APIYI (apiyi.com).

ملخص

شهدت آليات سلامة المحتوى في Nano Banana 2 تطوراً مستمراً من عام 2024 إلى 2026، والتوجه العام هو التشديد المستمر. بالنسبة للمطورين:

- فهم المعمارية ثنائية الطبقة هو الأساس لحل مشكلات فشل توليد الصور — الطبقة الأولى (Layer 1) قابلة للتعديل، والطبقة الثانية (Layer 2) غير قابلة للتعديل.

- متابعة تغييرات السياسات — جلب تحديثا يناير وفبراير 2026 قيوداً جديدة ملحوظة.

- تحسين الموجهات (Prompts) أكثر فاعلية من تعديل إعدادات الأمان — فمعظم عمليات الحظر تحدث في الطبقة الثانية.

- التعامل الجيد مع الأخطاء — خاصة في المنتجات الموجهة للمستخدم النهائي، حيث يجب معالجة مختلف أنواع اعتراضات الأمان بشكل لائق.

نوصي بإجراء اختبارات استدعاء النموذج لـ Nano Banana 2 عبر منصة APIYI (apiyi.com)، حيث توفر المنصة واجهة موحدة وسجلات استدعاء مفصلة، مما يسهل التحقق السريع من الأسباب المحددة لفشل توليد الصور.

📝 المؤلف: فريق APIYI | الفريق التقني لـ APIYI

🔗 التواصل التقني: قم بزيارة apiyi.com للحصول على المزيد من أدلة استخدام نماذج الذكاء الاصطناعي والدعم الفني.

📅 تاريخ التحديث: 27 فبراير 2026