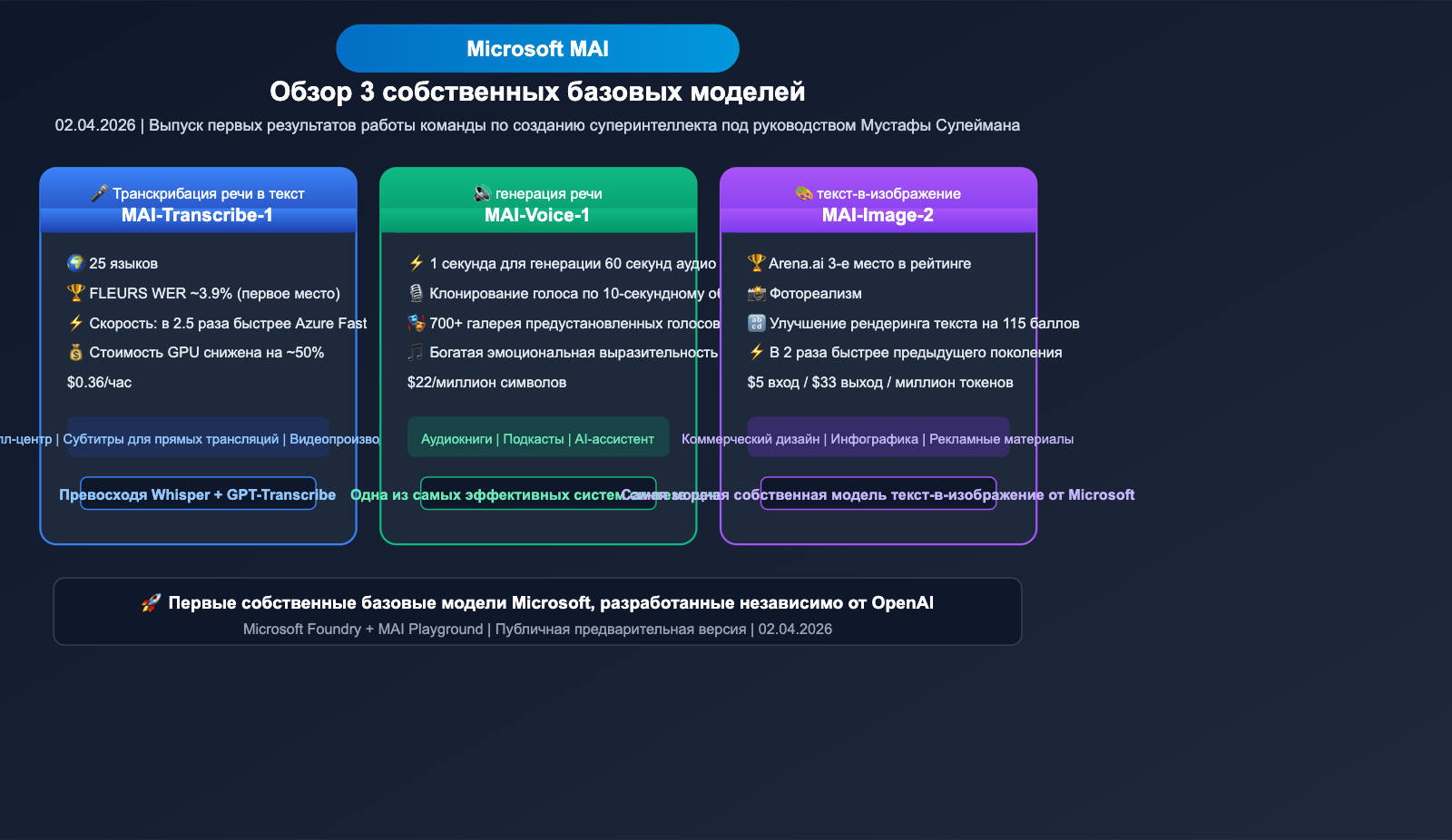

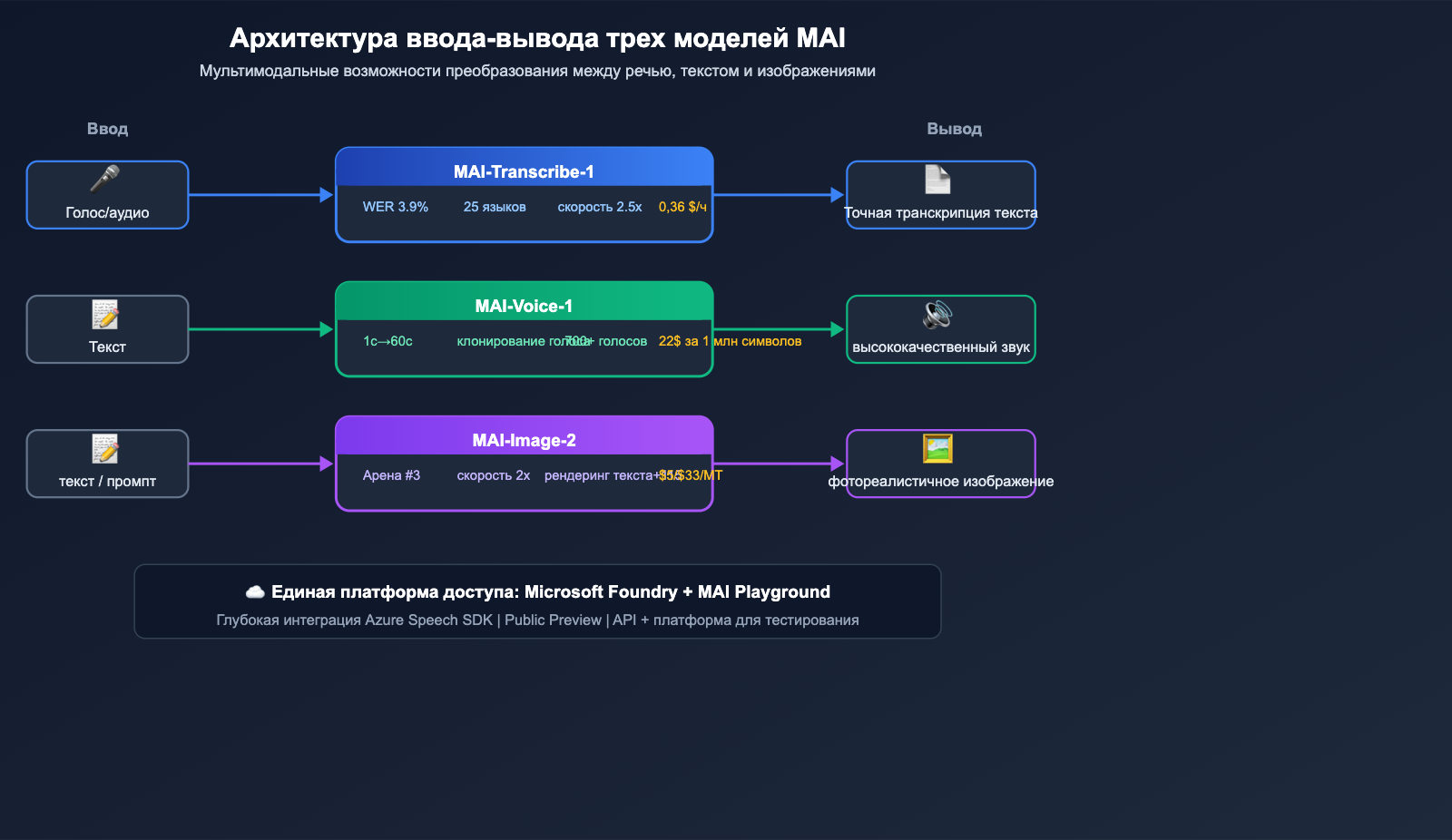

2 апреля 2026 года команда Microsoft MAI Super Intelligence официально представила 3 собственные базовые модели: MAI-Transcribe-1 (распознавание речи), MAI-Voice-1 (генерация речи) и MAI-Image-2 (текст-в-изображение). Это первый крупный релиз продуктов с момента формирования команды MAI под руководством Мустафы Сулеймана, что знаменует начало пути Microsoft к созданию возможностей ИИ-моделей, независимых от OpenAI.

Ключевая ценность: за 3 минуты вы узнаете основные технические параметры, результаты бенчмарков, цены на API и влияние новых моделей Microsoft MAI на индустрию ИИ.

Краткий обзор трех новых моделей Microsoft MAI

| Параметр | Детали |

|---|---|

| Дата выпуска | 2 апреля 2026 г. |

| Разработчик | Команда Microsoft MAI Super Intelligence (CEO: Мустафа Сулейман) |

| Модели | MAI-Transcribe-1 / MAI-Voice-1 / MAI-Image-2 |

| Точка входа | Microsoft Foundry + MAI Playground |

| Стратегическое значение | Первые собственные мультимодальные базовые модели Microsoft, снижающие зависимость от OpenAI |

| Текущий статус | Публичная предварительная версия (Public Preview) |

Эти три модели охватывают ключевые направления: распознавание речи, генерацию голоса и генерацию изображений. Это первый случай, когда Microsoft самостоятельно выпускает конкурентоспособные базовые модели после пересмотра условий партнерства с OpenAI.

Глубокий разбор модели распознавания речи MAI-Transcribe-1

Основные технические характеристики MAI-Transcribe-1

MAI-Transcribe-1 — это самая мощная модель распознавания речи от Microsoft на текущий момент, занявшая первое место в комплексном тестировании по бенчмарку FLEURS.

| Параметр | MAI-Transcribe-1 |

|---|---|

| Поддерживаемые языки | 25 языков |

| WER (бенчмарк FLEURS) | ~3,9% (первое место) |

| Скорость обработки | в 2,5 раза быстрее решения Azure Fast |

| Затраты на GPU | примерно на 50% ниже, чем у конкурентов |

| Цена API | $0,36/час |

| Ключевое преимущество | Самый низкий WER для 11 основных языков |

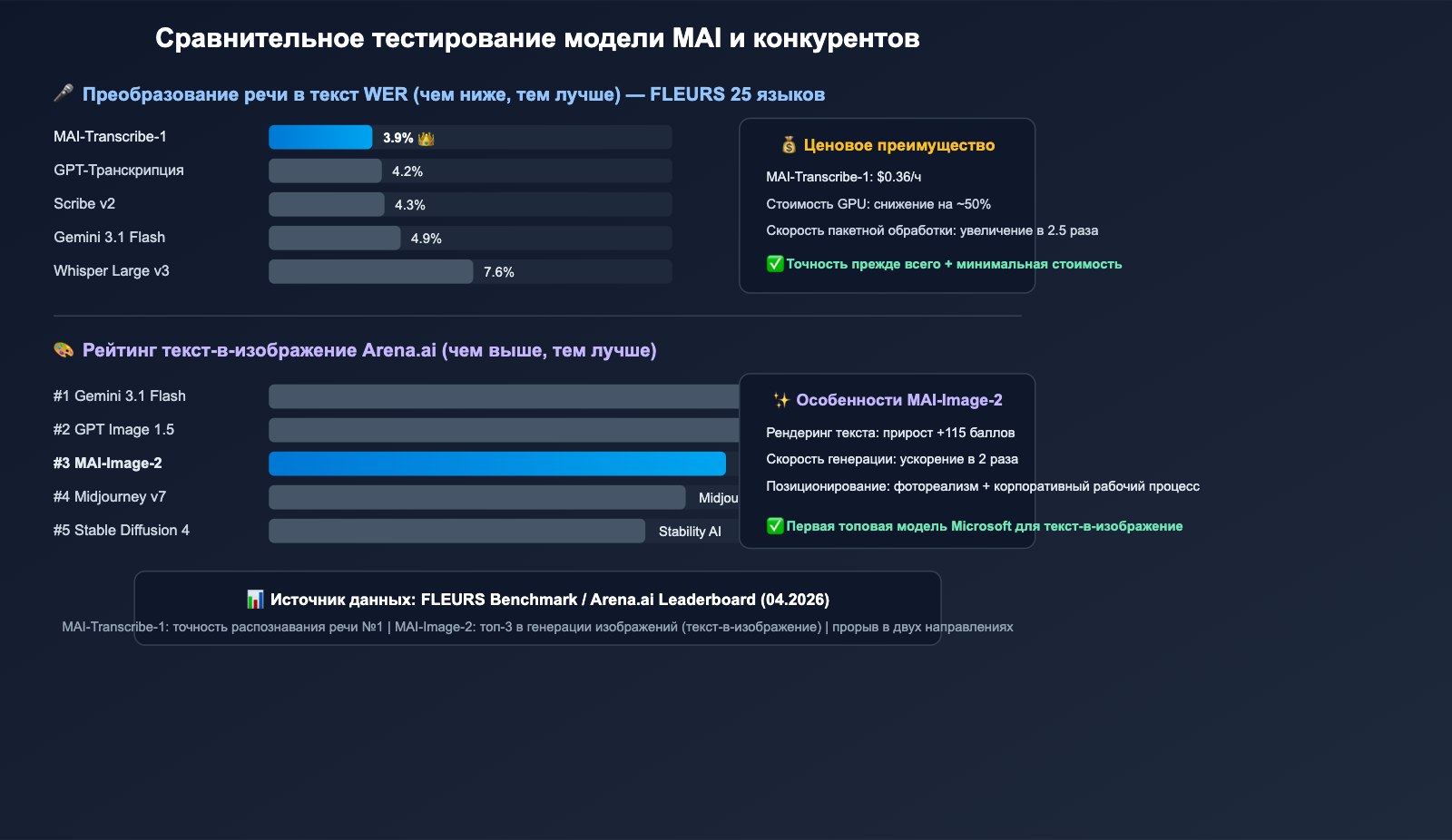

Сравнение WER модели MAI-Transcribe-1 с конкурентами

В бенчмарке FLEURS по 25 языкам модель MAI-Transcribe-1 демонстрирует явное лидерство по показателю частоты ошибок в словах (WER):

| Модель | FLEURS WER | Кол-во лучших языков | Цена (справка) |

|---|---|---|---|

| MAI-Transcribe-1 | ~3,9% | 11 из 25 | $0,36/час |

| GPT-Transcribe (OpenAI) | ~4,2% | — | Оплата за токен |

| Scribe v2 (ElevenLabs) | ~4,3% | — | от $0,40/час |

| Gemini 3.1 Flash | ~4,9% | — | Оплата за токен |

| Whisper Large v3 | ~7,6% | — | Open-source (бесплатно) |

5 главных преимуществ MAI-Transcribe-1

1. Точность корпоративного уровня для многих языков

MAI-Transcribe-1 занимает первое место в общем зачете по 25 языкам, при этом для 11 ключевых языков (включая английский, китайский, японский, испанский и др.) достигнут самый низкий показатель WER в индустрии. Для остальных 14 языков модель также превосходит Whisper Large v3 и обходит Gemini 3.1 Flash в 11 из них.

2. Увеличение скорости пакетной обработки в 2,5 раза

По сравнению с предыдущим решением Azure Fast, скорость пакетной транскрипции в MAI-Transcribe-1 выросла в 2,5 раза. Это обеспечивает значительный прирост эффективности для таких задач, как анализ записей колл-центров, автоматическое создание протоколов совещаний и производство субтитров для видео.

3. Снижение затрат на GPU примерно на 50%

Благодаря оптимизации архитектуры модели, затраты на GPU-инференс снизились почти вдвое при сохранении топовой точности. Это существенно уменьшает совокупную стоимость владения (TCO) для масштабных задач по транскрипции речи.

4. Широкий спектр сценариев применения

- IVR-системы: транскрипция в реальном времени для интерактивных голосовых ответов.

- Колл-центры: автоматическая расшифровка и анализ диалогов с клиентами.

- Субтитры для стриминга: генерация субтитров в реальном времени для мероприятий и конференций.

- Видеопроизводство: автоматическое создание субтитров для видеоконтента.

- Маркетинговые исследования: пакетная транскрипция записей интервью.

5. Конкурентоспособная цена API

Цена $0,36/час дает явное ценовое преимущество на рынке корпоративных услуг транскрипции, особенно с учетом лидирующих показателей WER.

🎯 Совет разработчикам: Если вам нужно интегрировать функции транскрипции в свои приложения, MAI-Transcribe-1 предоставляет API через Microsoft Foundry. Если же вам необходимо вызывать несколько моделей ИИ одновременно (например, транскрипция + генерация текста + генерация изображений), вы можете использовать платформу APIYI (apiyi.com) для централизованного управления вызовами API от разных вендоров, что значительно упрощает инженерную сложность интеграции.

Технический обзор модели генерации речи MAI-Voice-1 от Microsoft

Основные параметры MAI-Voice-1

MAI-Voice-1 — это высокоэффективная модель генерации речи от Microsoft, главной особенностью которой является невероятная скорость работы.

| Параметр | MAI-Voice-1 |

|---|---|

| Скорость генерации | Менее 1 секунды на 60 секунд аудио (на одном GPU) |

| Клонирование голоса | Создание кастомного голоса всего по 10 секундам аудио |

| Библиотека голосов | 700+ предустановленных вариантов |

| Стоимость API | $22 за миллион символов |

| Интеграция | Azure Speech / Microsoft Foundry |

| Где используется | Аудиофункции Copilot и подкасты |

Ключевые технические особенности MAI-Voice-1

1. Высочайшая скорость генерации

Модель способна генерировать 60 секунд высококачественной речи менее чем за 1 секунду на одном графическом процессоре. Такая производительность делает MAI-Voice-1 одной из самых эффективных систем синтеза речи, что идеально подходит для приложений, требующих мгновенного голосового отклика.

2. Клонирование голоса за 10 секунд

Функция Personal Voice позволяет пользователям создать высокоточную копию голоса, имея на руках всего 10-секундный аудиофрагмент. Важно отметить, что для использования этой функции необходимо пройти процедуру проверки Microsoft в рамках политики ответственного использования ИИ.

3. Галерея из 700+ голосов

Благодаря интеграции с Azure Speech, разработчики получают доступ к более чем 700 предустановленным голосам, охватывающим множество языков, акцентов и стилей, что позволяет подобрать подходящий вариант для любого проекта.

4. Эмоционально окрашенная речь

MAI-Voice-1 не просто озвучивает текст, но и имитирует эмоциональные нюансы: изменения тона, ритмические паузы и интонации, делая сгенерированную речь естественной и выразительной.

💡 Сценарии использования: MAI-Voice-1 отлично подходит для создания аудиокниг, автоматической генерации подкастов, голосовых ответов в поддержке и вспомогательных технологий для людей с ограниченными возможностями. Разработчики могут использовать большую языковую модель для генерации текста, а затем преобразовывать его в речь с помощью MAI-Voice-1, выстраивая полноценный конвейер ИИ-ассистента. Удобно интегрировать этап генерации текста через LLM можно с помощью платформы APIYI (apiyi.com).

MAI-Image-2: подробный разбор мощнейшей модели генерации изображений от Microsoft

Основные характеристики MAI-Image-2

MAI-Image-2 — это первая собственная разработка Microsoft в области генерации изображений, которая сразу заняла лидирующие позиции в отраслевых рейтингах.

| Параметр | MAI-Image-2 |

|---|---|

| Рейтинг Arena.ai | 3-е место (уступает только Gemini 3.1 Flash и GPT Image 1.5) |

| Скорость генерации | В 2 раза быстрее предыдущего поколения |

| Рендеринг текста | Улучшение на 115 баллов |

| Цена (вход) | $5 за 1 млн токенов |

| Цена (выход) | $33 за 1 млн токенов |

| Ключевые преимущества | Фотореализм, качественный рендеринг текста, точность сложной компоновки |

Позиции MAI-Image-2 в рейтинге Arena.ai

| Место | Модель | Разработчик | Ключевое преимущество |

|---|---|---|---|

| 1 | Gemini 3.1 Flash Image | Лучшая мультимодальность | |

| 2 | GPT Image 1.5 | OpenAI | Лидерство в креативности |

| 3 | MAI-Image-2 | Microsoft | Рендеринг текста + фотореализм |

| 4 | Midjourney v7 | Midjourney | Выдающийся художественный стиль |

| 5 | Stable Diffusion 4 | Stability AI | Открытая экосистема |

4 главных технических преимущества MAI-Image-2

1. Фотореализм

MAI-Image-2 подняла планку генерации изображений в стиле реалистичной фотографии. Объемное освещение, проработка текстур материалов и плавность светотеневых переходов приближают результат к уровню профессиональных снимков, что идеально подходит для коммерческой рекламы и презентации продуктов.

2. Значительное улучшение рендеринга текста

По сравнению с предыдущей версией, возможности MAI-Image-2 по отрисовке текста внутри изображений выросли на 115 баллов. Это означает, что при создании инфографики, постеров, вывесок и других элементов с текстом, четкость и точность символов стали заметно выше.

3. Точность обработки сложных композиций

При выполнении задач, требующих размещения множества объектов, сложных пространственных связей и детализированных сцен, MAI-Image-2 демонстрирует более высокую точность композиции, чем конкуренты, минимизируя проблемы с наложением объектов и нарушением пропорций.

4. Интеграция в корпоративные рабочие процессы

Крупнейший в мире рекламный холдинг WPP уже активно использует MAI-Image-2 для создания креативов. Microsoft позиционирует эту модель как инструмент продуктивности для дизайнеров и маркетологов, глубоко интегрированный в экосистему Microsoft 365.

🔧 Техническая практика: В реальных проектах по генерации ИИ-изображений разработчикам часто приходится сравнивать результаты работы разных моделей. Платформа APIYI (apiyi.com) позволяет централизованно подключать API различных моделей, таких как DALL-E или Stable Diffusion, что упрощает переключение между ними и сравнение качества генерации.

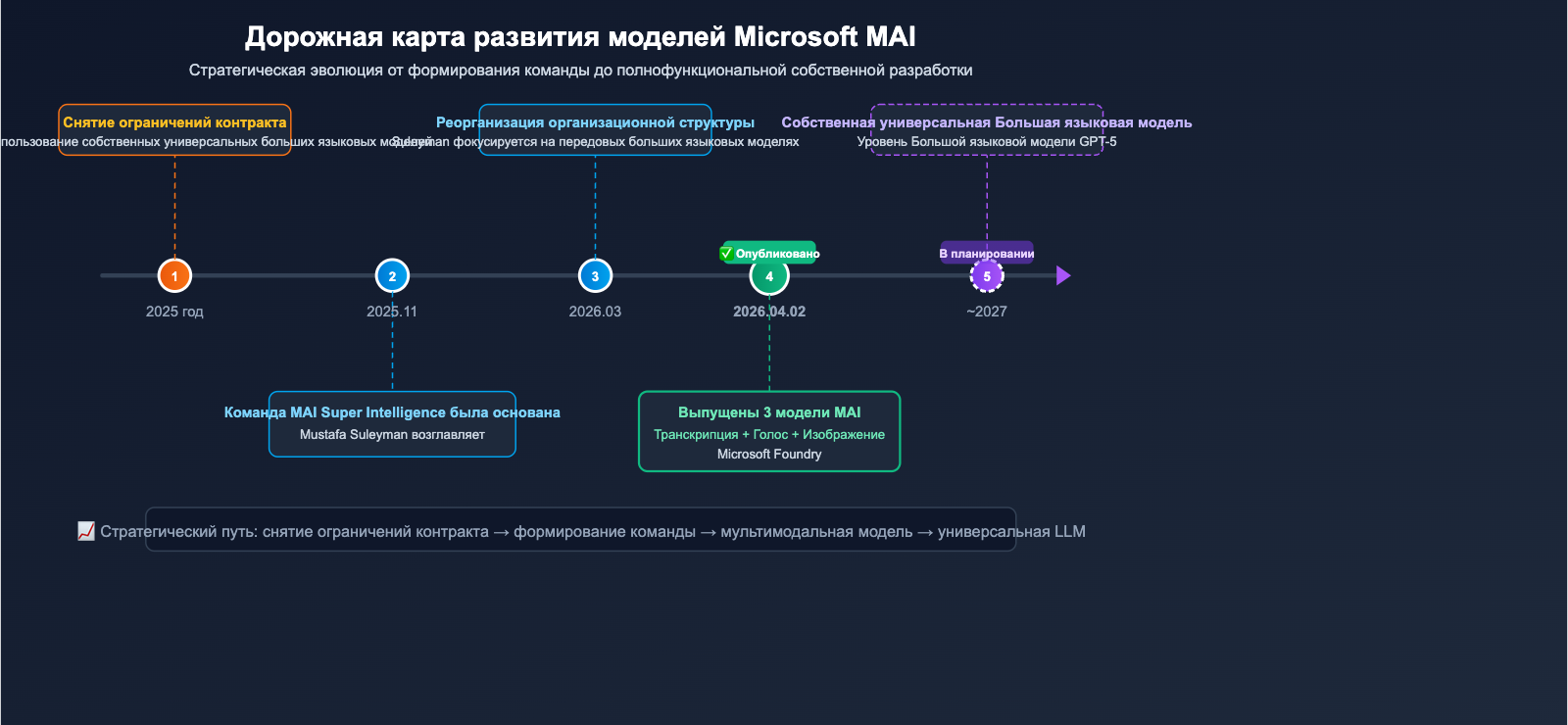

Стратегия Microsoft MAI: первый шаг к независимости от OpenAI

Почему Microsoft развивает собственные модели

Отношения между Microsoft и OpenAI претерпевают изменения. Выпуск трех моделей семейства MAI — это четкий стратегический сигнал.

Ключевые этапы:

- 2025 год: Microsoft пересмотрела условия сотрудничества с OpenAI, сняв контрактные ограничения, которые ранее запрещали компании разрабатывать собственные универсальные ИИ-модели.

- Ноябрь 2025: Мустафа Сулейман сформировал команду MAI (Super Intelligence), сосредоточенную на исследованиях передовых моделей.

- Март 2026: Сатья Наделла объявил о реорганизации: Сулейман полностью сфокусировался на разработке моделей, отойдя от операционного управления Copilot.

- 2 апреля 2026: Команда MAI представила первые три базовые модели собственной разработки.

- Цель на 2027 год: Выпуск универсальной большой языковой модели, способной конкурировать с уровнем GPT-5.

Текущая матрица ИИ-моделей Microsoft

| Категория модели | Решения OpenAI | Собственные разработки (MAI) |

|---|---|---|

| Универсальные LLM | GPT-5.4 (ядро Copilot) | В планах (2027) |

| Распознавание речи | Whisper / GPT-Transcribe | MAI-Transcribe-1 ✅ |

| Генерация речи | — | MAI-Voice-1 ✅ |

| Текст-в-изображение | DALL-E 3 | MAI-Image-2 ✅ |

| Кодовые модели | Codex | В планах |

Что это значит для разработчиков

Microsoft выстраивает систему «двухрельсового» обеспечения ИИ-моделями: с одной стороны, компания продолжает использовать универсальные LLM от OpenAI (GPT-5.4), а с другой — внедряет собственные альтернативы в сферах работы с голосом и изображениями. Для разработчиков в экосистеме Microsoft это означает расширение выбора.

🎯 Инсайт индустрии: Появление собственных моделей Microsoft означает дальнейшее обострение конкуренции на рынке ИИ. Для разработчиков выбор модели и канала доступа становится критически важным. Платформа APIYI (apiyi.com) позволяет унифицировать работу с API различных вендоров, обеспечивая гибкое переключение между моделями без необходимости изменения кода в условиях быстро меняющегося рынка.

Ценообразование и способы подключения к моделям Microsoft MAI

Обзор цен на три модели

| Модель | Способ тарификации | Цена | Платформа подключения |

|---|---|---|---|

| MAI-Transcribe-1 | За час аудио | $0.36/час | Microsoft Foundry / Azure Speech |

| MAI-Voice-1 | За количество символов | $22/млн символов | Microsoft Foundry / Azure Speech |

| MAI-Image-2 | За количество токенов | Вход $5/млн + Выход $33/млн токенов | Microsoft Foundry |

Способы подключения

Способ 1: Microsoft Foundry

Все три модели доступны для подключения через API на платформе для разработчиков Microsoft Foundry в режиме публичного превью. Разработчики могут вызывать их напрямую через API-эндпоинты Foundry.

Способ 2: MAI Playground

MAI Playground — это новая платформа от Microsoft для тестирования моделей. Здесь разработчики могут бесплатно опробовать возможности MAI-Transcribe-1 и MAI-Voice-1, чтобы быстро оценить, подходят ли они для конкретных задач.

Способ 3: Интеграция с Azure Speech

Модели MAI-Transcribe-1 и MAI-Voice-1 глубоко интегрированы в сервис Azure Speech, поэтому текущие пользователи Azure могут вызывать их напрямую через SDK Azure Speech.

💰 Оптимизация затрат: При создании мультимодальных AI-приложений часто приходится комбинировать модели от разных поставщиков для транскрибации речи, генерации текста и изображений. Платформа APIYI (apiyi.com) позволяет централизованно управлять API-ключами и расходом средств, избавляя от необходимости регистрироваться на множестве площадок. Платформа поддерживает подключение моделей от Microsoft, OpenAI, Anthropic, Alibaba Cloud и других вендоров.

Анализ влияния моделей Microsoft MAI на индустрию ИИ

Влияние на рынок ИИ-моделей

1. Изменения в сфере распознавания речи

MAI-Transcribe-1 с показателем WER 3.9% бросает прямой вызов OpenAI GPT-Transcribe (4.2%) и ElevenLabs Scribe v2 (~4.3%). Учитывая 50% преимущество в стоимости, модель имеет все шансы быстро захватить долю рынка корпоративной транскрибации.

2. Обострение конкуренции в генерации изображений (текст-в-изображение)

MAI-Image-2 вошла в тройку лидеров Arena.ai, сформировав «большую тройку» в сегменте текст-в-изображение: Google (Gemini 3.1 Flash), OpenAI (GPT Image 1.5) и Microsoft (MAI-Image-2). Это создает дополнительное давление на независимых игроков, таких как Midjourney и Stability AI.

3. Тренд на «полный стек собственной разработки» у ИИ-гигантов

Вслед за Google (серия Gemini) и Meta (серия Llama), Microsoft также начала выстраивать возможности полного стека ИИ-моделей. Это означает, что конкуренция на рынке ИИ в будущем будет все больше концентрироваться вокруг нескольких крупных корпораций.

Влияние на разработчиков

- Больше выбора: В экосистеме Microsoft теперь есть альтернатива OpenAI.

- Усиление ценовой конкуренции: Соперничество между вендорами приведет к дальнейшему снижению цен на API.

- Комбинирование моделей: Разработчикам нужно учиться гибко подбирать модели разных производителей под конкретные задачи.

🚀 Совет для разработчиков: В условиях быстрого роста числа доступных ИИ-моделей рекомендуем использовать единые платформы подключения, такие как APIYI (apiyi.com), для управления вызовами моделей и предотвращения привязки к одному поставщику. Платформа предоставляет стандартный интерфейс, совместимый с OpenAI, поэтому для смены модели достаточно просто изменить параметр

model.

Часто задаваемые вопросы о моделях Microsoft MAI

Q1: Какая связь между моделями MAI и моделями OpenAI?

Модели MAI были разработаны независимой командой Microsoft MAI Super Intelligence и никак не связаны с OpenAI. В настоящее время Microsoft придерживается стратегии «двух путей»: для универсальных больших языковых моделей компания продолжает использовать GPT-5.4 от OpenAI, а в сферах работы с голосом и изображениями развивает собственную линейку MAI. После пересмотра соглашения с OpenAI в 2025 году из контракта были исключены пункты, ограничивавшие разработку собственных моделей Microsoft.

Q2: Насколько MAI-Transcribe-1 лучше, чем Whisper?

В бенчмарке FLEURS (25 языков) показатель WER (частота ошибок распознавания) у MAI-Transcribe-1 составляет около 3,9%, тогда как у Whisper Large v3 — около 7,6%, что говорит о заметном преимуществе в точности. Кроме того, скорость пакетной обработки у MAI-Transcribe-1 в 2,5 раза выше, чем у решения Azure Fast, а затраты на GPU снижены примерно на 50%. Однако преимущество Whisper заключается в том, что это бесплатное решение с открытым исходным кодом, которое отлично подходит для сценариев, где критически важна стоимость.

Q3: Может ли MAI-Image-2 заменить DALL-E?

Судя по рейтингу Arena.ai, MAI-Image-2 занимает 3-е место, опережая DALL-E 3. Модель особенно сильна в отрисовке текста и фотореализме. Тем не менее, DALL-E по-прежнему уникален в некоторых творческих стилях. Для корпоративных клиентов более весомым аргументом может стать глубокая интеграция MAI-Image-2 в экосистему Microsoft.

Q4: Как быстро протестировать эти три модели MAI?

Самый быстрый способ — воспользоваться MAI Playground (новой платформой Microsoft для тестирования моделей). Для полноценного доступа через API необходимо использовать платформу для разработчиков Microsoft Foundry. Если вашему приложению требуется одновременный вызов нескольких AI-моделей, вы можете использовать сервис-прокси API APIYI (apiyi.com) для централизованного управления API от разных поставщиков, что значительно упрощает процесс разработки.

Q5: Когда Microsoft планирует выпустить собственную универсальную большую языковую модель?

Согласно открытым данным, Microsoft развертывает кластеры чипов Nvidia GB200 и планирует создать вычислительные мощности передового уровня в течение следующих 12–18 месяцев. Ожидается, что примерно к 2027 году будет представлена собственная универсальная большая языковая модель, способная конкурировать с уровнем GPT-5. До этого момента в качестве основной модели для Copilot будет использоваться GPT-5.4 от OpenAI.

Итоги запуска трех новых моделей от Microsoft MAI

Команда Microsoft MAI всего за 5 месяцев работы представила впечатляющие результаты:

- MAI-Transcribe-1: заняла первое место в бенчмарке FLEURS по показателю WER (~3,9%), при этом скорость работы выросла в 2,5 раза, а затраты снизились на 50%. Стоимость составляет $0,36/час.

- MAI-Voice-1: генерирует 60 секунд речи менее чем за 1 секунду на одном GPU, поддерживает клонирование голоса по 10-секундному фрагменту и включает более 700 предустановленных голосов.

- MAI-Image-2: заняла 3-е место в рейтинге текст-в-изображение на Arena.ai, улучшила рендеринг текста на 115 баллов и поддерживает сложные макеты с фотореалистичным качеством.

Выпуск этих моделей не только демонстрирует возможности Microsoft в области собственных разработок, но и подтверждает ускоряющийся тренд «полностековой разработки» среди ИИ-гигантов. Для разработчиков выбор моделей становится всё шире, поэтому использование единых платформ, таких как APIYI (apiyi.com), для управления вызовами моделей от разных вендоров станет ключевой стратегией для повышения эффективности разработки и снижения затрат при переключении между ними.

📝 Автор: Команда APIYI | Больше технических разборов ИИ-моделей и руководств по подключению API вы найдете в справочном центре APIYI: help.apiyi.com