Примечание автора: Подробный разбор того, как пользоваться Seedance 2.0. Рассказываем про Jimeng (Dreamina), Xiao Yunque, Doubao, Volcengine и другие точки входа, а также приводим прогноз по стоимости и срокам доступа к API, чтобы вы могли начать работу с мощнейшей нейросетью для генерации видео от ByteDance в числе первых.

Как пользоваться Seedance 2.0? Это сейчас самый популярный вопрос. 12 февраля 2026 года компания ByteDance официально представила Seedance 2.0 — модель для генерации AI-видео, которая мгновенно стала темой номер один в соцсетях благодаря своей мультимодальной архитектуре совместной генерации аудио и видео и возможности многокадрового повествования. В этой статье мы подробно разберем все способы доступа к Seedance 2.0, чтобы вы могли быстро освоить этот инструмент.

Ключевая ценность: прочитав эту статью, вы узнаете о 5 способах доступа к Seedance 2.0, ее основных функциях и характеристиках, а также получите актуальную информацию о сроках подключения к API и ценах.

Обзор ключевых функций Seedance 2.0

Прежде чем разбираться, как пользоваться Seedance 2.0, давайте быстро пробежимся по его основным возможностям:

| Функция | Описание | Улучшения по сравнению с прошлой версией |

|---|---|---|

| Мультимодальный ввод | Поддержка 4 типов данных: текст, изображения, аудио и видео | Добавлен ввод аудио |

| Многокадровое повествование | Генерация последовательных сцен за один проход с сохранением персонажей и стиля | Совершенно новая функция |

| Нативная генерация аудио | Автоматическое создание звуковых эффектов и фоновой музыки, синхронизированных с видео | Совершенно новая функция |

| Вывод в разрешении 2K | Поддержка профессионального качества до 1080p | Разрешение увеличено вдвое |

| Репликация движений/танцев | Загрузка референсного видео для точного копирования движений камеры и хореографии | Значительное повышение точности |

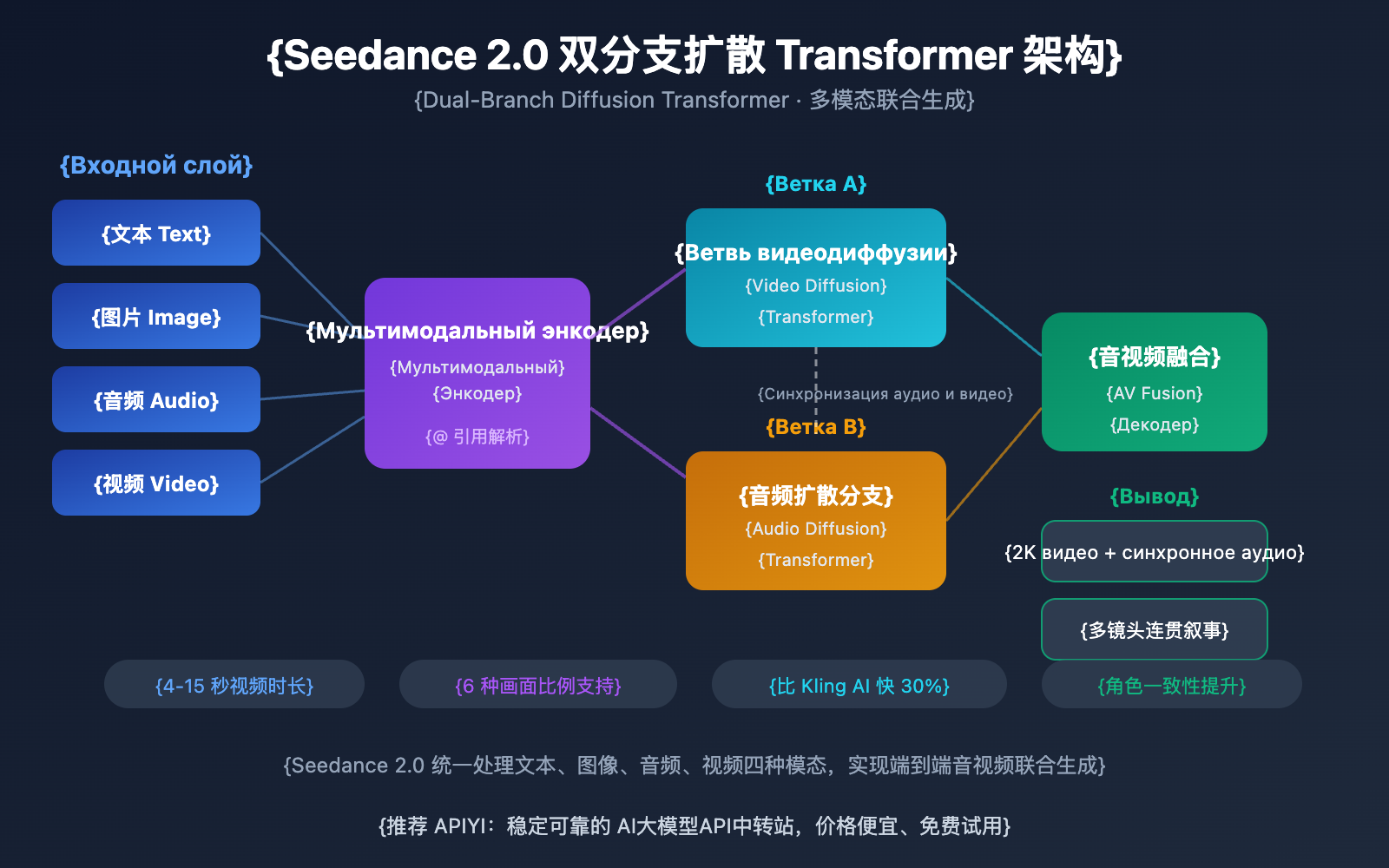

Подробный разбор технической архитектуры Seedance 2.0

Seedance 2.0 использует двухветвевую архитектуру Diffusion Transformer (Dual-Branch Diffusion Transformer) — это ключевое решение для реализации совместной мультимодальной генерации. Архитектура унифицированно обрабатывает текстовые, графические, аудио- и видеосигналы, что позволяет модели генерировать видео одновременно с идеально синхронизированным звуком.

Что касается качества видео, скорость генерации в Seedance 2.0 примерно на 30% выше, чем у конкурентов (например, Kling AI). Модель поддерживает ролики длительностью от 4 до 15 секунд и различные соотношения сторон: 16:9, 9:16, 4:3, 3:4, 21:9 и 1:1. Согласованность лиц, одежды, текста и окружения заметно выросла по сравнению с первой версией, что эффективно решает проблему «дрейфа» персонажей и резких скачков стиля, характерных для AI-видео.

Как пользоваться Seedance 2.0: 5 способов протестировать нейросеть

На данный момент Seedance 2.0 уже официально запущена, но API пока не открыт для широкого доступа. Вот все актуальные способы, которыми можно воспользоваться прямо сейчас, чтобы оценить возможности Seedance 2.0:

Способ 1: Jimeng (即梦) — самый полный функционал

Jimeng — это креативная AI-платформа от ByteDance (материнская компания TikTok). Именно здесь Seedance 2.0 появилась в первую очередь, и тут доступен самый широкий набор инструментов.

Как пользоваться:

- Перейдите на платформу Jimeng:

jimeng.jianying.com - Авторизуйтесь через аккаунт Douyin (китайская версия TikTok).

- Зайдите в раздел «Генерация» (生成) и выберите «Генерация видео» (视频生成).

- В списке моделей выберите Seedance 2.0.

- Введите текстовый промпт или загрузите референсы, чтобы начать генерацию.

Стоимость: Jimeng работает по модели подписки. Новые пользователи часто могут оформить пробный период на 7 дней всего за 1 юань. Seedance 2.0 доступна для платных подписчиков.

🎯 Совет: Jimeng — это сейчас лучшая площадка для полноценного знакомства с Seedance 2.0. Если же вам в будущем понадобится массовый вызов через API, следите за обновлениями на APIYI (apiyi.com) — мы подключим модель сразу после открытия официального API.

Способ 2: Xiao Yunque (小云雀) — бесплатный доступ

Xiao Yunque — еще одно приложение от ByteDance, которое дает возможность бесплатно потестировать Seedance 2.0.

Как пользоваться:

- Скачайте приложение Xiao Yunque.

- После входа в систему вы получите 3 бесплатные попытки генерации видео через Seedance 2.0.

- Ежедневно начисляется 120 баллов, которые можно тратить на дальнейшие эксперименты.

Кому подойдет: Тем, кто хочет просто «пощупать» Seedance 2.0 бесплатно и понять, на что она способна.

Способ 3: Doubao (豆包) — через универсального AI-помощника

Doubao — это флагманский AI-ассистент от ByteDance, в который также интегрировали возможности генерации видео Seedance 2.0.

Как пользоваться:

- Скачайте приложение Doubao или откройте веб-версию.

- Выберите функцию генерации видео в чате.

- Выберите модель Seedance 2.0 для создания контента.

Способ 4: Volcengine — для корпоративных пользователей

Volcengine — это облачная платформа ByteDance (аналог AWS или Google Cloud), где доступна пробная версия рабочего стола Seedance 2.0 для бизнеса.

| Платформа | Как получить доступ | Особенности | Есть ли API? |

|---|---|---|---|

| Volcengine | Консоль volcengine.com |

Для компаний внутри Китая | Пока нет, ожидается 24 февраля |

| BytePlus | Консоль byteplus.com |

Для международных компаний | Пока нет, ожидается 24 февраля |

Важно: Сейчас на Volcengine и BytePlus можно только потестировать интерфейс в режиме «песочницы», сам API-интерфейс пока закрыт.

Способ 5: Подключение по API — для разработчиков (скоро)

Для разработчиков и компаний, которым нужно встраивать Seedance 2.0 в свои продукты, API — самый важный способ доступа.

График запуска API:

| Дата | Событие | Описание |

|---|---|---|

| 12 февраля 2026 г. | Официальный релиз Seedance 2.0 | Запуск в пользовательских продуктах |

| 24 февраля 2026 г. | Ожидаемое открытие официального API | Через Volcengine / BytePlus |

| Сразу после открытия API | Запуск на платформе APIYI | Цена примерно на 10% ниже официальной |

🎯 Совет разработчикам: Ожидается, что API Seedance 2.0 станет доступен 24 февраля 2026 года. Платформа APIYI (apiyi.com) оперативно добавит поддержку Seedance 2.0. Мы предложим цену примерно на 10% ниже официальной и предоставим единый интерфейс, совместимый с форматом OpenAI, для быстрой интеграции. Не пропустите!

Советы и лучшие практики по использованию Seedance 2.0

Чтобы выжать максимум из Seedance 2.0, воспользуйтесь этими рекомендациями:

Как писать промпты для Seedance 2.0

Для режима Text-to-Video (текст в видео):

- Описывайте сцену максимально детально: персонажи, действия, окружение, освещение.

- Указывайте движение камеры (наезд/отъезд, панорамирование, слежение и т.д.).

- Уточняйте стиль (кинематографичный, документальный, аниме и т.д.).

- Задавайте темп и ритм (например, «медленное приближение», «динамичная склейка»).

Пример промпта:

Молодая женщина в белом платье танцует под вишневым деревом,

камера плавно переходит от общего плана к среднему,

мягкий естественный свет падает слева, лепестки сакуры кружатся на ветру,

кинематографичное качество, малая глубина резкости, 4K.

Работа с референсными видео

Система упоминаний через @ в Seedance 2.0 — это её киллер-фича. Вы можете загрузить референс и контролировать разные аспекты:

- Референс движения камеры: загрузите видео с нужным пролетом камеры, и модель в точности его повторит.

- Хореография: загрузите видео с танцем, и модель синхронизирует движения персонажа с ритмом и движениями из референса.

- Стилевой референс: используйте картинку или видео, чтобы сохранить визуальное единообразие.

🎯 Продвинутый уровень: В мультимодальном режиме можно назначать конкретные роли каждому референсу через

@(например,@движение_камеры,@персонаж). Это дает невероятную точность управления. После открытия API платформа APIYI также будет поддерживать все эти мультимодальные возможности.

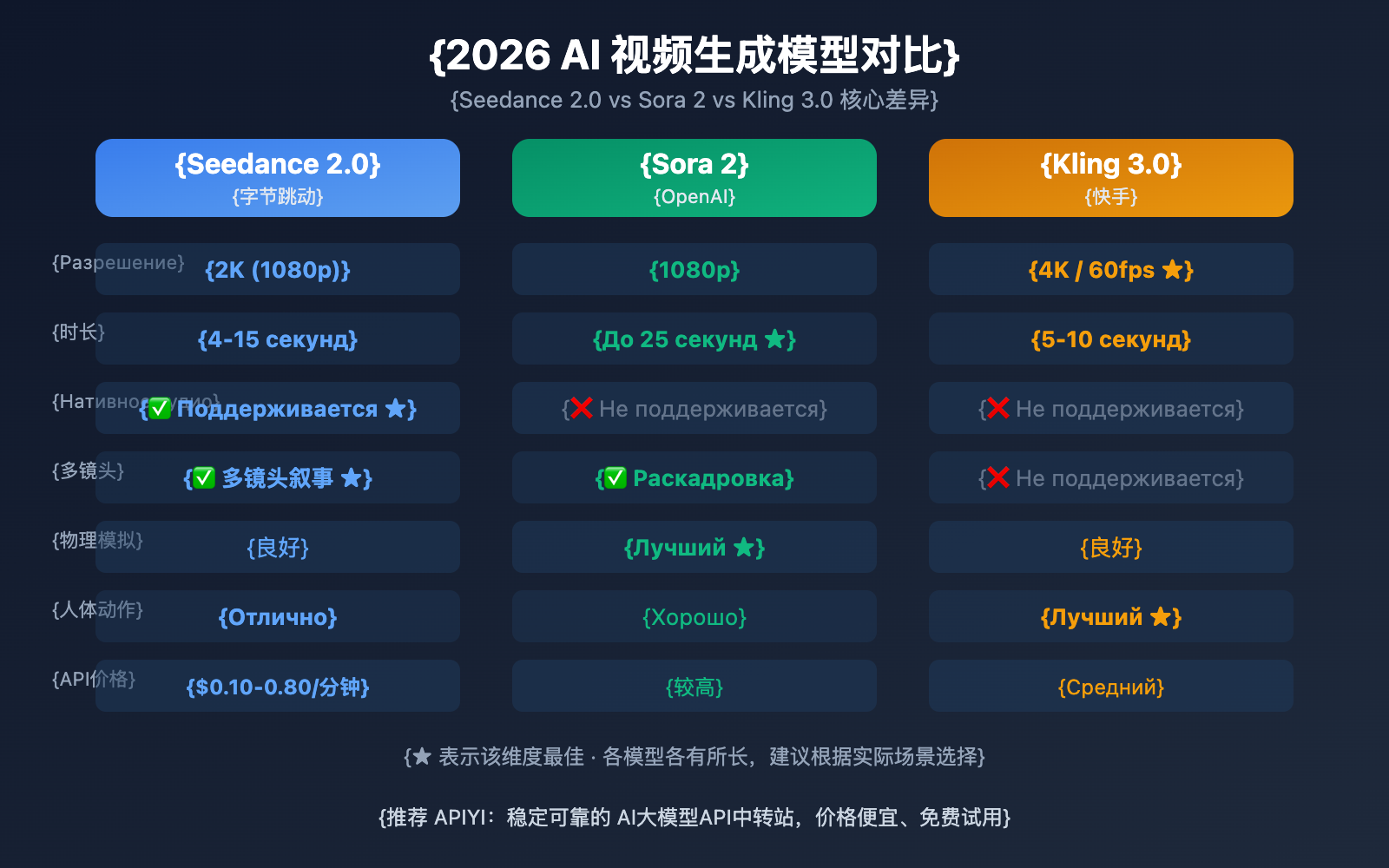

Сравнение Seedance 2.0 с конкурентами

| Параметр | Seedance 2.0 | Sora 2 | Kling 3.0 |

|---|---|---|---|

| Разработчик | ByteDance | OpenAI | Kuaishou |

| Макс. разрешение | 2K (1080p) | 1080p | 4K/60fps |

| Длительность видео | 4-15 сек | До 25 сек | 5-10 сек |

| Нативный звук | ✅ Поддерживается | ❌ Не поддерживается | ❌ Не поддерживается |

| Мультикамерное повествование | ✅ Поддерживается | ✅ Storyboard | ❌ Не поддерживается |

| Входное референс-видео | ✅ Мультимодальные ссылки (@) | ❌ Ограничено | ✅ Поддерживается |

| Симуляция физики | Хорошо | Лучшая | Хорошо |

| Движения человека | Отлично | Хорошо | Лучшая |

| Оценочная цена API | $0.10-0.80/мин. | Высокая | Средняя |

Примечание к сравнению: У каждой модели свои сильные стороны. Seedance 2.0 лидирует в плане нативного звука и мультимодальных ссылок; Sora 2 остается самой мощной в симуляции физики и создании длинных видео; Kling 3.0 выделяется разрешением и качеством движений человека. Рекомендуем выбирать модель под конкретные задачи, а с помощью APIYI (apiyi.com) можно удобно протестировать и сравнить сразу несколько моделей генерации видео.

Часто задаваемые вопросы

Q1: Где можно использовать Seedance 2.0? Какие есть способы доступа?

На данный момент Seedance 2.0 доступен через официальные приложения ByteDance: Jimeng (即梦), Xiao Yunque (小云雀) и Doubao (豆包). Корпоративные пользователи могут протестировать модель через рабочие области Volcengine и BytePlus. Запуск API ожидается 24 февраля 2026 года.

Q2: Когда выйдет API Seedance 2.0 и сколько это будет стоить?

Релиз API Seedance 2.0 намечен на 24 февраля 2026 года через платформы Volcengine и BytePlus. Ориентировочная стоимость составит $0.10–0.80 за минуту генерации (в зависимости от разрешения). На платформе APIYI (apiyi.com) доступ появится в кратчайшие сроки, а цена будет примерно на 10% ниже официальной.

Q3: Seedance 2.0 бесплатный?

Seedance 2.0 не является полностью бесплатным. На платформе Jimeng требуется платная подписка (для новых пользователей доступен пробный период за 1 юань на 7 дней). В приложении Xiao Yunque дают 3 бесплатные попытки и 120 баллов ежедневно. После открытия API оплата будет производиться по факту использования (pay-as-you-go).

Q4: Как пользоваться международной версией Seedance 2.0? Как получить доступ из-за границы?

Сейчас полноценно потестировать Seedance 2.0 можно в основном через китайскую версию платформы Jimeng. В международных версиях — Dreamina (dreamina.capcut.com) и Pippit — Seedance 2.0 пока не появилась. Зарубежным пользователям стоит следить за обновлениями на платформе BytePlus или дождаться выхода API и подключиться через APIYI (apiyi.com).

На что стоит обратить внимание при использовании Seedance 2.0

При работе с Seedance 2.0 учитывайте несколько важных моментов:

- Клонирование голоса временно приостановлено: Функция «создание голоса по фото», представленная вместе с Seedance 2.0, была отключена ByteDance в течение 48 часов из-за споров о дипфейках. Она вернется позже, когда в систему внедрят механизмы верификации личности.

- Соблюдение правил: Генерируемый контент должен соответствовать законодательству. Избегайте создания материалов, нарушающих авторские права или этические нормы.

- Требования к аккаунту: Для работы с платформой Jimeng требуется аккаунт Douyin, что подразумевает верификацию по номеру телефона материкового Китая.

Итоги

Основные моменты: как начать пользоваться Seedance 2.0:

- Попробовать прямо сейчас: Seedance 2.0 уже доступен в официальных приложениях ByteDance, таких как Jimeng (即梦), Xiaoyunque (小云雀) и Doubao (豆包).

- Для бизнеса: Платформы Volcengine и BytePlus предлагают пробный период через интерфейс рабочей области, но API пока закрыт.

- Доступ к API: Открытие запланировано на 24 февраля 2026 года. С этой даты модель можно будет интегрировать в свои программные решения.

- Ключевые преимущества: Нативная генерация аудио + многокадровое повествование + мультимодальные @-упоминания. Эти три фишки дают модели серьезное преимущество перед конкурентами.

Рекомендуем следить за обновлениями на APIYI (apiyi.com), чтобы первыми узнать о запуске Seedance 2.0 API. Платформа предложит доступ со скидкой около 10% от официальной цены и обеспечит единый интерфейс, совместимый с форматом OpenAI, для быстрой интеграции.

📚 Справочные материалы

-

Официальная страница Seedance 2.0: Подробности о модели от команды Seed (ByteDance)

- Ссылка:

seed.bytedance.com/en/seedance2_0 - Описание: Полные технические характеристики и обзор функций.

- Ссылка:

-

Платформа для творчества Jimeng AI: Первая площадка, где можно протестировать Seedance 2.0

- Ссылка:

jimeng.jianying.com - Описание: На данный момент это сервис с самым полным набором функций Seedance 2.0.

- Ссылка:

-

Официальный блог о релизе Seedance 2.0: Анонс от команды Seed

- Ссылка:

seed.bytedance.com/en/blog/official-launch-of-seedance-2-0 - Описание: Информация о дате выхода, ключевых особенностях и официальные новости.

- Ссылка:

Автор: Техническая команда

Техническое сообщество: Обсудить опыт использования Seedance 2.0 можно в комментариях. Больше новостей о моделях генерации AI-видео ищите в сообществе APIYI (apiyi.com).