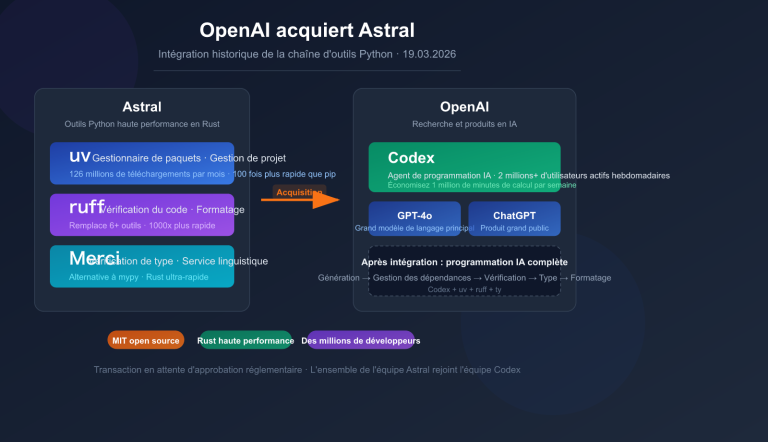

Note de l'auteur : Guide détaillé sur l'utilisation de Seedance 2.0, couvrant les points d'accès comme Jimeng, Lark, Doubao, Volcengine, ainsi que les prévisions de temps d'accès API et de prix, pour vous aider à utiliser le modèle vidéo IA le plus puissant de ByteDance dès que possible.

Comment utiliser Seedance 2.0 ? C'est la question que tout le monde se pose en ce moment. ByteDance a officiellement lancé le modèle de génération vidéo Seedance 2.0 le 12 février 2026. Grâce à son architecture de génération conjointe audio-vidéo multimodale et sa capacité de narration multi-plans, il a rapidement fait le buzz sur les réseaux sociaux mondiaux. Cet article détaille toutes les façons d'utiliser Seedance 2.0 pour vous aider à démarrer rapidement.

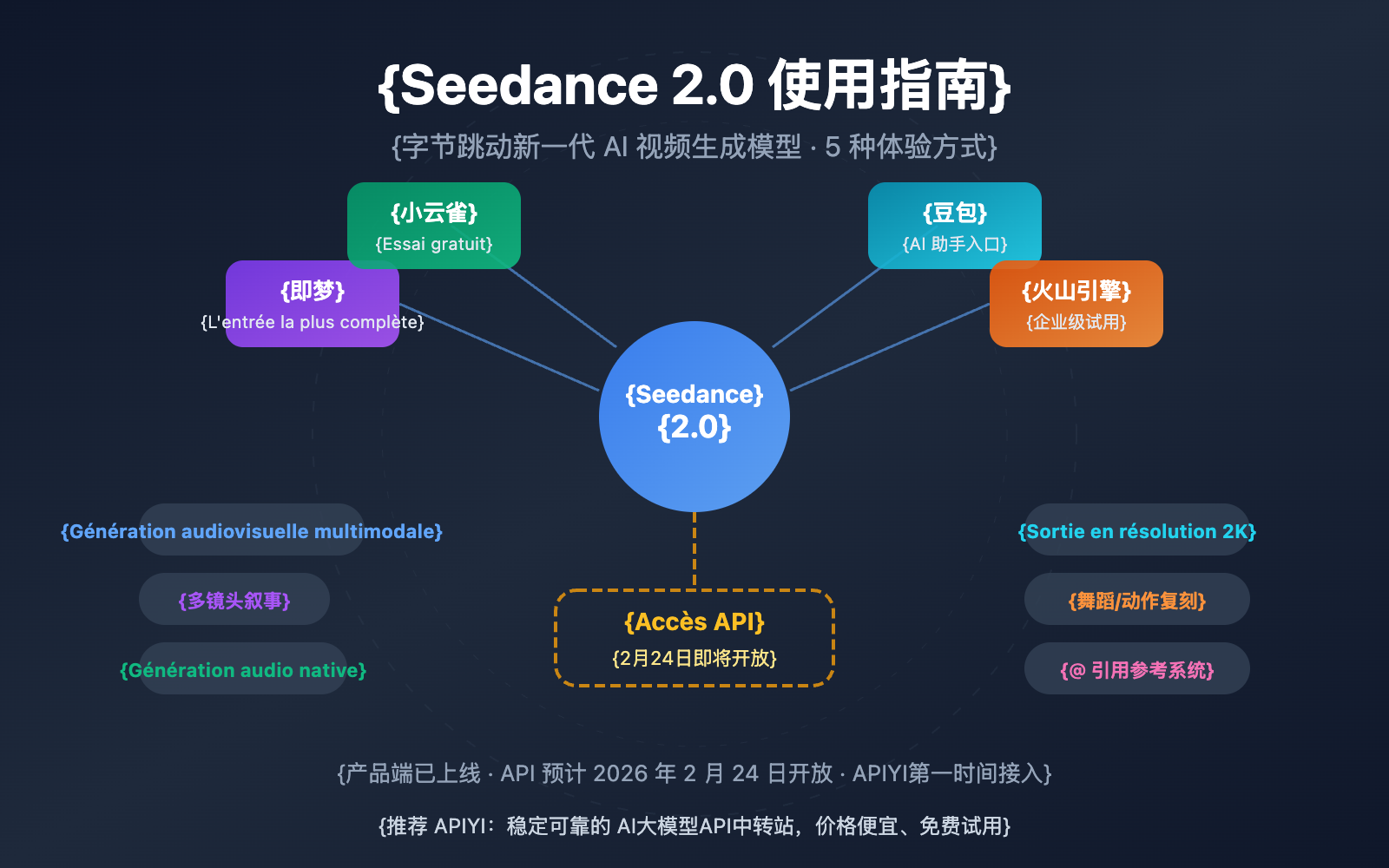

Valeur ajoutée : En lisant cet article, vous maîtriserez les 5 points d'accès à Seedance 2.0, ses fonctionnalités clés, ainsi que les dernières infos sur le calendrier d'accès API et les tarifs.

Aperçu des fonctionnalités clés de Seedance 2.0

Avant de découvrir comment utiliser Seedance 2.0, jetons un coup d'œil rapide à ses capacités principales :

| Fonctionnalités | Description détaillée | Amélioration par rapport à la V1 |

|---|---|---|

| Entrée multimodale | Supporte 4 types d'entrées : texte, image, audio et vidéo | Ajout de l'entrée audio |

| Narration multi-plans | Génération de vidéos cohérentes multi-scènes en une seule fois, avec une constance des personnages et du style | Nouvelle capacité |

| Génération audio native | Génération automatique d'effets sonores et de musique de fond synchronisés avec l'image | Nouvelle capacité |

| Sortie en résolution 2K | Supporte jusqu'à une sortie de qualité production en 1080p | Résolution doublée |

| Reproduction de mouvements | Téléchargez une vidéo de référence pour copier précisément les mouvements de caméra et la chorégraphie | Précision considérablement accrue |

Zoom sur l'architecture technique de Seedance 2.0

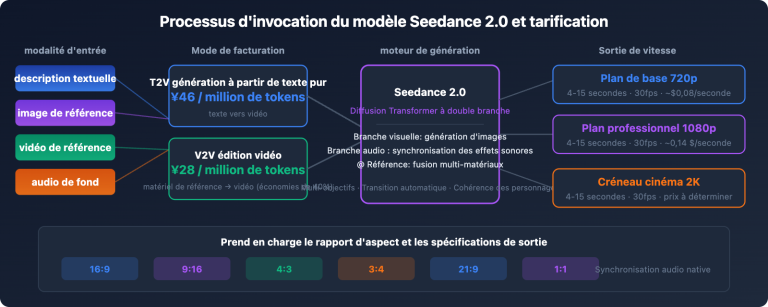

Seedance 2.0 s'appuie sur une architecture Transformer de diffusion à double branche (Dual-Branch Diffusion Transformer), ce qui est la clé de sa génération multimodale combinée. Cette architecture traite de manière unifiée les signaux textuels, d'image, audio et vidéo, permettant au modèle de produire un son parfaitement synchronisé tout en générant la vidéo.

En termes de qualité vidéo, la vitesse de génération de Seedance 2.0 est environ 30 % plus rapide que celle de ses concurrents (comme Kling AI). Il supporte des durées de vidéo allant de 4 à 15 secondes, couvrant divers formats d'image tels que 16:9, 9:16, 4:3, 3:4, 21:9 et 1:1. La cohérence des visages, des vêtements, du texte et des scènes s'est nettement améliorée par rapport à la génération précédente, résolvant efficacement les problèmes courants de dérive des personnages et de sauts de style dans les vidéos générées par IA.

Comment utiliser Seedance 2.0 : 5 façons de le tester en détail

Actuellement, Seedance 2.0 est officiellement lancé, mais l'API n'est pas encore ouverte. Voici toutes les méthodes disponibles pour utiliser Seedance 2.0 dès maintenant :

Option 1 : Jimeng — La porte d'entrée la plus complète

Jimeng est la plateforme de création IA de ByteDance et le premier point d'accès pour tester Seedance 2.0. C'est ici que les fonctionnalités sont les plus complètes.

Étapes d'utilisation :

- Accédez à la plateforme Jimeng :

jimeng.jianying.com - Connectez-vous avec votre compte Douyin.

- Allez dans la section « Générer » et choisissez « Génération de vidéo ».

- Dans les options de modèle, sélectionnez Seedance 2.0.

- Saisissez votre invite textuelle ou uploadez vos ressources de référence pour lancer la génération.

Tarification : Jimeng propose un système d'abonnement payant. Les nouveaux utilisateurs peuvent tester le service pendant 7 jours pour 1 yuan. Seedance 2.0 est une fonctionnalité réservée aux membres payants.

🎯 Conseil d'utilisation : Jimeng est actuellement la plateforme la plus complète pour tester Seedance 2.0, nous vous recommandons de l'utiliser en priorité. Si vous avez besoin d'appels API en masse par la suite, vous pouvez suivre les annonces sur APIYI (apiyi.com), nous l'intégrerons dès l'ouverture de l'API.

Option 2 : Xiao Yunque — L'accès gratuit

Xiao Yunque est une autre application IA de ByteDance qui offre la possibilité de tester Seedance 2.0 gratuitement.

Étapes d'utilisation :

- Téléchargez l'application Xiao Yunque.

- Une fois connecté, vous recevrez 3 essais gratuits pour générer des vidéos avec Seedance 2.0.

- 120 points sont offerts quotidiennement pour continuer l'expérience.

Public cible : Idéal pour les utilisateurs qui souhaitent essayer Seedance 2.0 gratuitement, notamment pour se faire une idée des résultats.

Option 3 : Doubao — L'assistant IA polyvalent

Doubao est l'application d'assistant IA polyvalent de ByteDance, qui intègre désormais les capacités de génération vidéo de Seedance 2.0.

Étapes d'utilisation :

- Téléchargez l'application Doubao ou accédez à la version web.

- Choisissez la fonction de génération vidéo dans la conversation.

- Sélectionnez le modèle Seedance 2.0 pour vos créations.

Option 4 : Volcengine — Essai pour les entreprises

Volcengine est la plateforme de services cloud de ByteDance, proposant un essai de Seedance 2.0 via une console de travail de niveau entreprise.

| Plateforme | Mode d'accès | Caractéristiques | API disponible ? |

|---|---|---|---|

| Volcengine | Console volcengine.com |

Destiné aux entreprises en Chine | Pas encore, prévue pour le 24 février |

| BytePlus | Console byteplus.com |

Destiné aux entreprises internationales | Pas encore, prévue pour le 24 février |

Note : Pour l'instant, Volcengine et BytePlus ne proposent qu'un essai via l'interface de la console de travail ; l'interface API n'est pas encore ouverte.

Option 5 : Accès API — Le choix des développeurs (Bientôt disponible)

Pour les développeurs et les entreprises qui ont besoin d'appeler Seedance 2.0 de manière programmatique, l'API est le mode d'accès le plus important.

Calendrier de lancement de l'API :

| Échéance | Événement | Description |

|---|---|---|

| 12 février 2026 | Lancement officiel de Seedance 2.0 | Mise en ligne côté produit |

| 24 février 2026 | Ouverture prévue de l'API officielle | Via Volcengine / BytePlus |

| Dès l'ouverture de l'API | Mise en ligne sur la plateforme APIYI | Environ 10 % moins cher que le prix officiel |

🎯 Conseil aux développeurs : L'API Seedance 2.0 devrait être officiellement ouverte le 24 février 2026. APIYI (apiyi.com) proposera le service d'accès à l'API Seedance 2.0 dès son lancement, à un tarif environ 10 % inférieur au prix officiel, avec une interface unifiée compatible OpenAI pour faciliter une intégration rapide. Restez à l'écoute.

Conseils d'utilisation et meilleures pratiques pour Seedance 2.0

Maîtriser les astuces suivantes peut considérablement améliorer la qualité de vos générations avec Seedance 2.0 :

Techniques de rédaction d'invites pour Seedance 2.0

Conseils pour les invites de Texte-en-vidéo (Text-to-Video) :

- Décrivez précisément la scène : personnages, actions, environnement, éclairage.

- Spécifiez le mouvement de la caméra (zoom, panoramique, travelling, suivi, etc.).

- Précisez le style visuel (qualité cinématographique, style documentaire, style anime, etc.).

- Indiquez le timing et le rythme (ex: "progression lente", "changement rapide").

Exemple d'invite :

Une jeune femme vêtue d'une robe blanche danse gracieusement sous des cerisiers en fleurs,

la caméra passe lentement d'un plan large à un plan moyen,

une lumière naturelle douce vient de la gauche, des pétales tombent au gré du vent,

image de qualité cinématographique, faible profondeur de champ, qualité 4K.

Techniques d'utilisation des vidéos de référence

Le système de citation "@" de Seedance 2.0 est un avantage unique. Vous pouvez uploader une vidéo de référence pour contrôler :

- Référence de mouvement de caméra : uploadez un mouvement de caméra que vous aimez, le modèle le reproduira avec précision.

- Chorégraphie de danse : uploadez une vidéo de danse de référence, le modèle pourra générer un contenu chorégraphié synchronisé sur le rythme.

- Référence de style : uploadez une image ou une vidéo de référence pour maintenir un style visuel cohérent.

🎯 Conseil avancé : Dans les scénarios d'entrée multimodale, l'utilisation des citations @ pour assigner un rôle clair à chaque ressource de référence (comme @RéférenceMouvement, @RéférencePersonnage) permet d'obtenir un contrôle plus précis. Une fois l'API ouverte, APIYI (apiyi.com) prendra également en charge ces capacités d'entrée multimodale complètes.

Seedance 2.0 vs Concurrence

| Dimension de comparaison | Seedance 2.0 | Sora 2 | Kling 3.0 |

|---|---|---|---|

| Éditeur | ByteDance | OpenAI | Kuaishou |

| Résolution max | 2K (1080p) | 1080p | 4K/60fps |

| Durée de la vidéo | 4-15 secondes | Jusqu'à 25 s | 5-10 secondes |

| Audio natif | ✅ Supporté | ❌ Non supporté | ❌ Non supporté |

| Narration multi-angles | ✅ Supporté | ✅ Storyboard | ❌ Non supporté |

| Entrée vidéo de référence | ✅ Multimodal @ Réf | ❌ Limité | ✅ Supporté |

| Simulation physique | Bonne | Excellente | Bonne |

| Mouvements humains | Excellents | Bons | Excellents |

| Prix API estimé | 0,10 $ – 0,80 $/min | Élevé | Moyen |

Note comparative : Chaque modèle possède ses propres atouts. Seedance 2.0 se distingue par son audio natif et ses capacités de référence multimodale ; Sora 2 reste le plus performant pour la simulation physique et les vidéos de longue durée ; Kling 3.0 brille par sa résolution et la fluidité des mouvements humains. Nous vous conseillons de choisir en fonction de vos besoins spécifiques. Via APIYI (apiyi.com), vous pouvez facilement comparer et tester plusieurs modèles de génération vidéo.

Questions fréquemment posées

Q1 : Où utiliser Seedance 2.0 ? Quels sont les points d’accès actuels ?

Actuellement, vous pouvez découvrir Seedance 2.0 via les canaux suivants : les applications officielles de ByteDance telles que Jimeng (即梦), Xiao Yunque et Doubao. Les entreprises peuvent également l'essayer via les consoles Volcengine et BytePlus. L'API devrait être disponible le 24 février 2026.

Q2 : Quand l’API de Seedance 2.0 sera-t-elle disponible ? Quel est son prix ?

L'API de Seedance 2.0 devrait être officiellement lancée le 24 février 2026 via Volcengine (火山引擎) et BytePlus. Le prix officiel est estimé entre 0,10 $ et 0,80 $ par minute (selon la résolution). APIYI (apiyi.com) la proposera dès sa sortie avec un tarif environ 10 % moins cher que le prix officiel.

Q3 : Seedance 2.0 est-il gratuit ?

Seedance 2.0 n'est pas totalement gratuit. Sur la plateforme Jimeng, un abonnement payant est nécessaire (offre d'essai de 7 jours pour 1 yuan pour les nouveaux utilisateurs). Xiao Yunque propose 3 essais gratuits et 120 points quotidiens. L'accès via API sera facturé à l'usage.

Q4 : Comment utiliser la version internationale de Seedance 2.0 ? Comment les utilisateurs à l’étranger peuvent-ils l’essayer ?

Pour l'instant, l'expérience complète de Seedance 2.0 est principalement proposée via la version chinoise de la plateforme Jimeng. Les versions internationales Dreamina (dreamina.capcut.com) et Pippit n'ont pas encore intégré Seedance 2.0. Les utilisateurs à l'étranger peuvent suivre les mises à jour sur la plateforme BytePlus ou attendre l'ouverture de l'API pour y accéder via APIYI (apiyi.com).

Précautions d'utilisation de Seedance 2.0

Lors de l'utilisation de Seedance 2.0, il convient de noter les points suivants :

- La fonction de clonage de voix est suspendue : La fonctionnalité "génération de voix à partir d'une photo" lancée avec Seedance 2.0 a été suspendue par ByteDance dans les 48 heures suivant sa sortie en raison de controverses liées aux deepfakes. Elle sera remise en ligne ultérieurement après l'intégration d'un mécanisme de vérification d'identité.

- Conformité du contenu : Le contenu généré doit respecter les lois et réglementations en vigueur afin d'éviter la création de contenus portant atteinte aux droits d'auteur ou soulevant des questions éthiques.

- Exigences relatives au compte : La plateforme Jimeng nécessite une connexion via un compte Douyin, ce qui implique une vérification par un numéro de téléphone de Chine continentale.

Résumé

Voici les points clés pour savoir comment utiliser Seedance 2.0 :

- Expérience immédiate : Vous pouvez utiliser Seedance 2.0 via les applications officielles de ByteDance telles que Jimeng, Xiaoyunque ou Doubao.

- Essai en entreprise : Volcengine et BytePlus proposent un essai via leur interface de console, mais l'API n'est pas encore ouverte.

- Accès API : L'ouverture est prévue pour le 24 février 2026, date à laquelle il sera possible d'effectuer des appels de manière programmatique.

- Avantages clés : Génération audio native + narration multi-plans + références @ multimodales ; trois capacités différenciatrices majeures face à la concurrence.

Nous vous recommandons de suivre APIYI (apiyi.com) pour être informé du lancement de l'API Seedance 2.0. La plateforme proposera un accès à environ 90 % du tarif officiel, avec une interface unifiée compatible OpenAI pour faciliter l'intégration rapide par les développeurs.

📚 Références

-

Page de présentation officielle de Seedance 2.0 : Détails du modèle publiés par l'équipe Seed de ByteDance.

- Lien :

seed.bytedance.com/en/seedance2_0 - Description : Contient les spécifications techniques complètes et la présentation des fonctionnalités.

- Lien :

-

Plateforme de création Jimeng AI : Le premier point d'accès pour tester Seedance 2.0.

- Lien :

jimeng.jianying.com - Description : Actuellement la plateforme la plus complète pour utiliser Seedance 2.0.

- Lien :

-

Blog de lancement officiel de Seedance 2.0 : Annonce de l'équipe Seed de ByteDance.

- Lien :

seed.bytedance.com/en/blog/official-launch-of-seedance-2-0 - Description : Contient les dates de sortie, les points forts des fonctionnalités et d'autres informations officielles.

- Lien :

Auteur : Équipe technique

Échanges techniques : N'hésitez pas à discuter de votre expérience avec Seedance 2.0 dans l'espace commentaires. Pour plus d'actualités sur les modèles de génération vidéo par IA, vous pouvez visiter la communauté technique d'APIYI (apiyi.com).