Примечание автора: подробное руководство по вызову модели kimi-k2.5 через платформу APIYI с активацией параметра enable_thinking. Вы узнаете, как получить доступ к модели по цене, которая на 20% ниже официальной, с примерами кода на curl, Python и JavaScript.

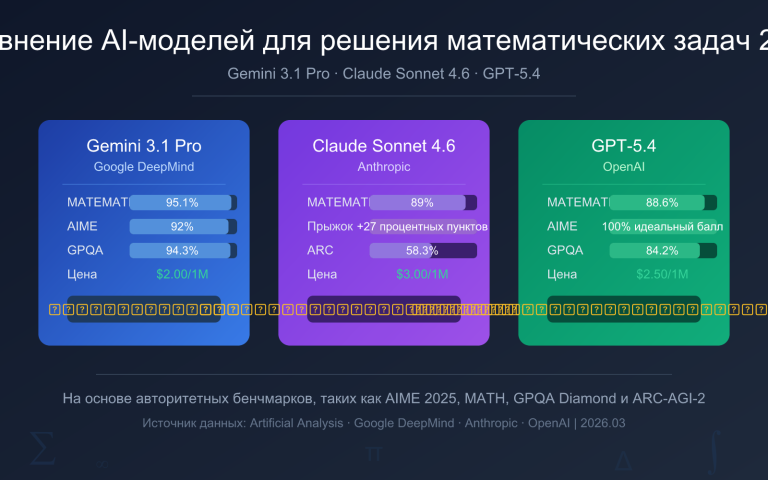

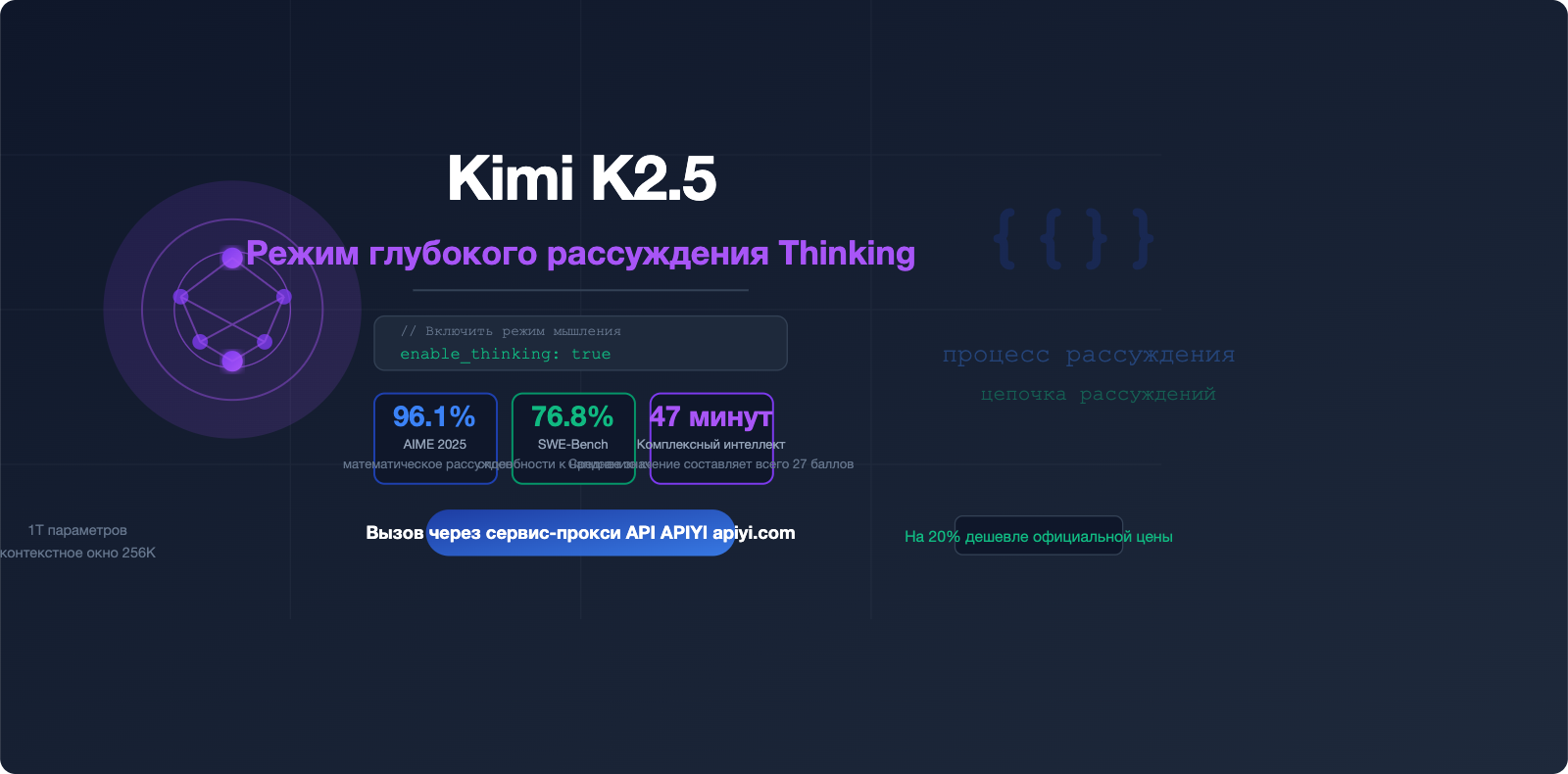

Режим мышления (thinking) в модели Kimi K2.5 — это одна из самых мощных функций для логических рассуждений среди всех доступных моделей, с результатом 96,1% в математическом бенчмарке AIME 2025. Однако многие разработчики при интеграции сталкиваются с одной и той же проблемой: после вызова API модель не выводит процесс размышлений.

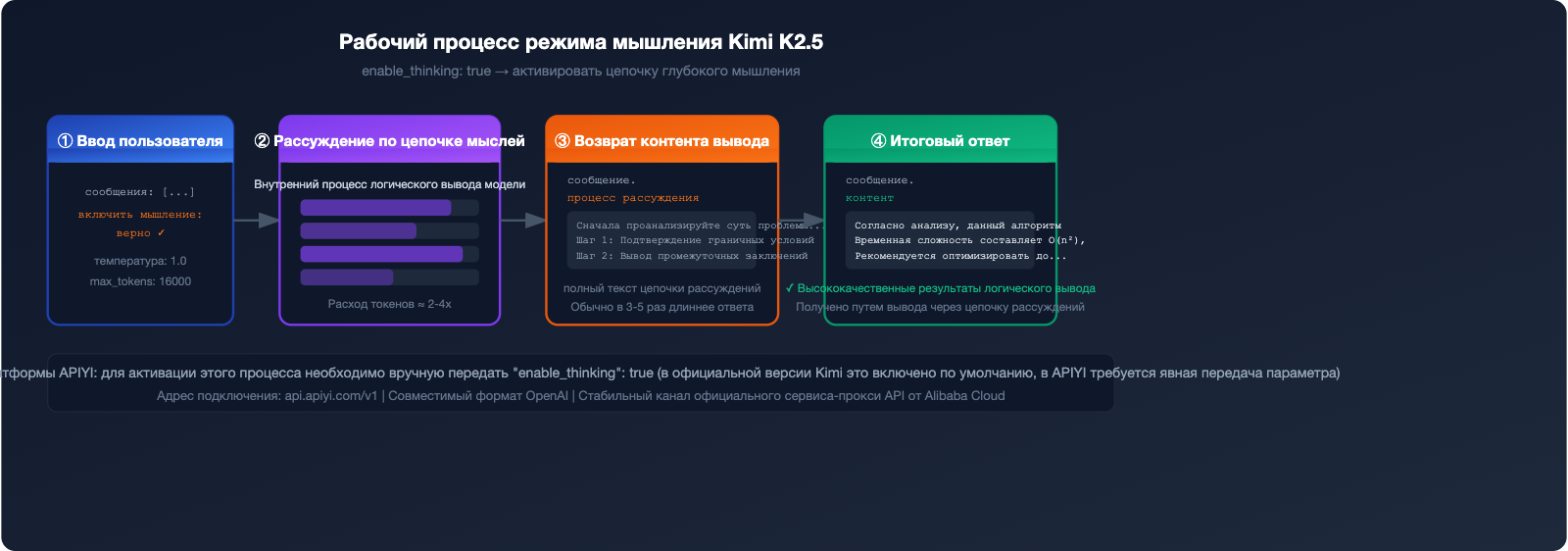

Это происходит потому, что на платформе APIYI необходимо вручную передать параметр "enable_thinking": true, чтобы активировать этот режим. В этой статье мы с нуля разберем, как правильно настроить доступ к режиму мышления Kimi K2.5.

🎯 Основная ценность: Прочитав эту статью, вы освоите полный процесс вызова режима мышления kimi-k2.5 и узнаете, как использовать эту возможность через APIYI по цене, которая на 20% ниже официальной.

Основные моменты режима Kimi K2.5 Thinking

| Пункт | Описание | Ценность |

|---|---|---|

| Параметры активации | Нужно передать "enable_thinking": true |

Разблокирует глубокое рассуждение |

| Рекомендуемый temperature | Установить 1.0 (фиксированное значение) |

Гарантирует стабильное качество мышления |

| Рекомендуемый max_tokens | ≥ 16000 | Обеспечивает полный вывод процесса рассуждений |

| Ценовое преимущество | Групповая цена 0.88, ниже официальной на 20% | Значительное снижение затрат на вычисления |

| Стабильность | Уровень официального прокси Alibaba Cloud | Гарантия надежности корпоративного класса |

💡 Быстрый старт: Зарегистрируйтесь на APIYI (apiyi.com), пополните баланс и используйте kimi-k2.5. Поддерживается совместимый с OpenAI интерфейс, менять текущий код не нужно.

Что такое Kimi K2.5: флагман с 1 триллионом параметров

Kimi K2.5, представленная Moonshot AI 27 января 2026 года, является одной из самых мощных мультимодальных больших языковых моделей с открытым исходным кодом.

Основные технические характеристики Kimi K2.5

| Характеристика | Значение | Примечание |

|---|---|---|

| Общее кол-во параметров | 1 триллион (1T) | Архитектура MoE (смесь экспертов) |

| Активные параметры | 32 миллиарда (32B) | Фактически используются при вызове модели |

| Контекстное окно | 256K токенов | Обработка сверхдлинных документов |

| Количество экспертов | 384 экспертных слоя | Двойная архитектура MLA + MoE |

| Данные обучения | ~15 триллионов токенов | Текст + изображения |

| Статус | Полностью открытый код | Доступно на HuggingFace |

Kimi K2.5 использует многоголовое латентное внимание (MLA) и структуру MoE из 384 экспертов. При общем объеме в 1 триллион параметров, во время работы активируются только 32 миллиарда, что обеспечивает идеальный баланс между производительностью и стоимостью.

Четыре режима работы Kimi K2.5

K2.5 Instant → Мгновенный отклик, без процесса рассуждения, для простых задач

K2.5 Thinking → Глубокое рассуждение, вывод reasoning_content, для сложных задач

K2.5 Agent → Автономное выполнение задач, вызов инструментов

K2.5 Agent Swarm → Коллаборация агентов, до 100 под-агентов параллельно

Платформа APIYI в настоящее время поддерживает режим K2.5 Thinking, который активируется параметром enable_thinking: true и выводит полную цепочку рассуждений.

💡 Совет по использованию: Рекомендуем подключаться к kimi-k2.5 через APIYI (apiyi.com). Стабильный канал через официальный прокси Alibaba Cloud гарантирует отсутствие перебоев в работе.

Бенчмарки производительности Kimi K2.5: реальные данные режима «размышления»

После активации режима «размышления» (thinking mode) производительность логических рассуждений модели Kimi K2.5 значительно возросла. Ниже приведены ключевые результаты бенчмарков:

Основные результаты тестирования

| Бенчмарк | Результат Kimi K2.5 | Комментарий |

|---|---|---|

| AIME 2025 (математические рассуждения) | 96.1% | Почти идеальный результат, топовый уровень математических способностей |

| SWE-Bench Verified (код) | 76.8% | Лидирующие позиции среди моделей с открытым исходным кодом |

| HLE-Full w/ tools (агенты) | +4.7 балла | Первое место в задачах по вызову инструментов |

| BrowseComp (веб-серфинг) | 60.6% / 78.4%* | *В режиме Agent Swarm |

| Комплексный индекс интеллекта | 47 баллов | Среднеотраслевой показатель — 27 баллов |

Примечание: Данные основаны на результатах Artificial Analysis Intelligence Index за январь 2026 года.

Режим «размышления» (thinking mode) по сравнению со стандартным режимом обеспечивает значительный прирост в 30-50% в задачах, связанных со сложной математикой, многошаговыми рассуждениями и генерацией кода. Платой за это является расход токенов, который в 2-4 раза выше, чем в стандартном режиме, поэтому грамотное управление max_tokens — ключ к оптимизации затрат.

3 шага для активации режима Kimi K2.5 Thinking через APIYI

Шаг 1: Регистрация и получение API-ключа

Перейдите на официальный сайт APIYI apiyi.com, зарегистрируйте аккаунт и выполните следующие действия:

- Зарегистрируйтесь и подтвердите адрес электронной почты.

- Перейдите в «Консоль» (控制台) → «Управление API-ключами» (API Key 管理).

- Создайте новый API-ключ и сохраните его.

🎯 Ценовое преимущество: При пополнении на 100 долларов вы получаете 10 долларов в подарок. Тарифная группа 0.88 (входящие токены), фактическая стоимость использования ниже, чем при 20% скидке на официальном сайте Kimi. APIYI предоставляет стабильные каналы уровня официальных API Alibaba Cloud с надежностью корпоративного класса.

Шаг 2: Настройка параметров запроса

Ключ к активации режима размышления Kimi K2.5 заключается в настройке следующих трех параметров:

{

"model": "kimi-k2.5",

"enable_thinking": true,

"temperature": 1.0,

"max_tokens": 16000

}

⚠️ Важное примечание: Логика параметров на платформе APIYI отличается от официального API Kimi:

- Официальный Kimi: режим размышления включен по умолчанию, его нужно отключать принудительно.

- Платформа APIYI: необходимо вручную передать

"enable_thinking": trueдля активации.

Шаг 3: Отправка запроса и разбор процесса размышления

Ниже приведен полный пример вызова, включающий активацию режима размышления и разбор ответа.

Пример cURL (самый быстрый способ проверки)

curl --location 'https://api.apiyi.com/v1/chat/completions' \

--header "Authorization: Bearer sk-ВАШ_API_KEY" \

--header 'Content-Type: application/json' \

--data '{

"model": "kimi-k2.5",

"messages": [

{

"role": "system",

"content": "You are a helpful assistant."

},

{

"role": "user",

"content": "Объясни пошагово: почему 0.1 + 0.2 в компьютерных вычислениях не равно 0.3?"

}

],

"enable_thinking": true,

"temperature": 1.0,

"max_tokens": 16000

}'

Пример на Python (рекомендуется для продакшена)

from openai import OpenAI

client = OpenAI(

api_key="sk-ВАШ_API_KEY",

base_url="https://api.apiyi.com/v1"

)

response = client.chat.completions.create(

model="kimi-k2.5",

messages=[

{

"role": "system",

"content": "You are a helpful assistant."

},

{

"role": "user",

"content": "Проанализируй временную сложность этого кода и дай рекомендации по оптимизации:\n\ndef find_duplicates(arr):\n result = []\n for i in range(len(arr)):\n for j in range(i+1, len(arr)):\n if arr[i] == arr[j] and arr[i] not in result:\n result.append(arr[i])\n return result"

}

],

extra_body={

"enable_thinking": True

},

temperature=1.0,

max_tokens=16000

)

# Разбор процесса размышления (если он есть)

message = response.choices[0].message

# Вывод процесса размышления (поле reasoning_content)

if hasattr(message, 'reasoning_content') and message.reasoning_content:

print("=== Процесс размышления ===")

print(message.reasoning_content)

print()

# Вывод итогового ответа

print("=== Итоговый ответ ===")

print(message.content)

Развернуть полный пример на JavaScript / Node.js

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: 'sk-ВАШ_API_KEY',

baseURL: 'https://api.apiyi.com/v1',

});

async function callKimiThinking(userMessage) {

const response = await client.chat.completions.create({

model: 'kimi-k2.5',

messages: [

{

role: 'system',

content: 'You are a helpful assistant.',

},

{

role: 'user',

content: userMessage,

},

],

// Передача параметра enable_thinking через extra_body

// @ts-ignore

enable_thinking: true,

temperature: 1.0,

max_tokens: 16000,

});

const message = response.choices[0].message;

// Извлечение процесса размышления

const reasoningContent = message.reasoning_content;

if (reasoningContent) {

console.log('=== Процесс размышления ===');

console.log(reasoningContent);

console.log();

}

// Извлечение итогового ответа

console.log('=== Итоговый ответ ===');

console.log(message.content);

return {

thinking: reasoningContent,

answer: message.content,

};

}

// Пример использования

callKimiThinking('Докажи пошагово: простых чисел бесконечно много (доказательство Евклида)');

💡 Совет по интеграции: Просто замените

base_urlнаhttps://api.apiyi.com/v1, остальные параметры полностью совместимы с OpenAI SDK, поэтому дополнительное обучение не требуется. APIYI apiyi.com поддерживает вызов всех основных моделей через один ключ.

Подробный разбор ключевых параметров: настраиваем правильно и избегаем ошибок

Таблица конфигурации параметров

| Параметр | Рекомендуемое значение | Описание | Пример ошибки |

|---|---|---|---|

model |

"kimi-k2.5" |

Идентификатор модели | Не пишите kimi-k2 или kimi-k2.5-thinking |

enable_thinking |

true |

Активация режима мышления (эксклюзивно для APIYI) | Без этого параметра рассуждения не будут выведены |

temperature |

1.0 |

Фиксированное значение, рекомендованное разработчиками | Установка 0.7 и других значений приведет к нестабильному качеству |

max_tokens |

≥ 16000 |

Гарантия полного вывода | Слишком малое значение обрежет процесс мышления |

stream |

false (для первого теста) |

Поддерживаются оба режима (потоковый и обычный) | Потоковый режим требует дополнительной обработки поля reasoning |

Структура ответа API

{

"choices": [

{

"message": {

"role": "assistant",

"content": "Итоговый ответ...",

"reasoning_content": "Процесс мышления модели, включая пошаговые рассуждения..."

}

}

],

"usage": {

"prompt_tokens": 150,

"completion_tokens": 3200,

"total_tokens": 3350

}

}

Поле reasoning_content содержит полную цепочку рассуждений. Обычно оно в 3–5 раз длиннее, чем поле content, и является ключевым для понимания того, как модель пришла к своему решению.

🎯 Совет по контролю затрат: в режиме мышления (thinking) потребление токенов возрастает в 2–4 раза по сравнению с обычным режимом. Мы рекомендуем подключаться через сервис-прокси APIYI (apiyi.com): групповые тарифы по 0.88 позволяют значительно снизить расходы на логические выводы, а при пополнении на 100 долларов вы получите бонус в размере 10 долларов.

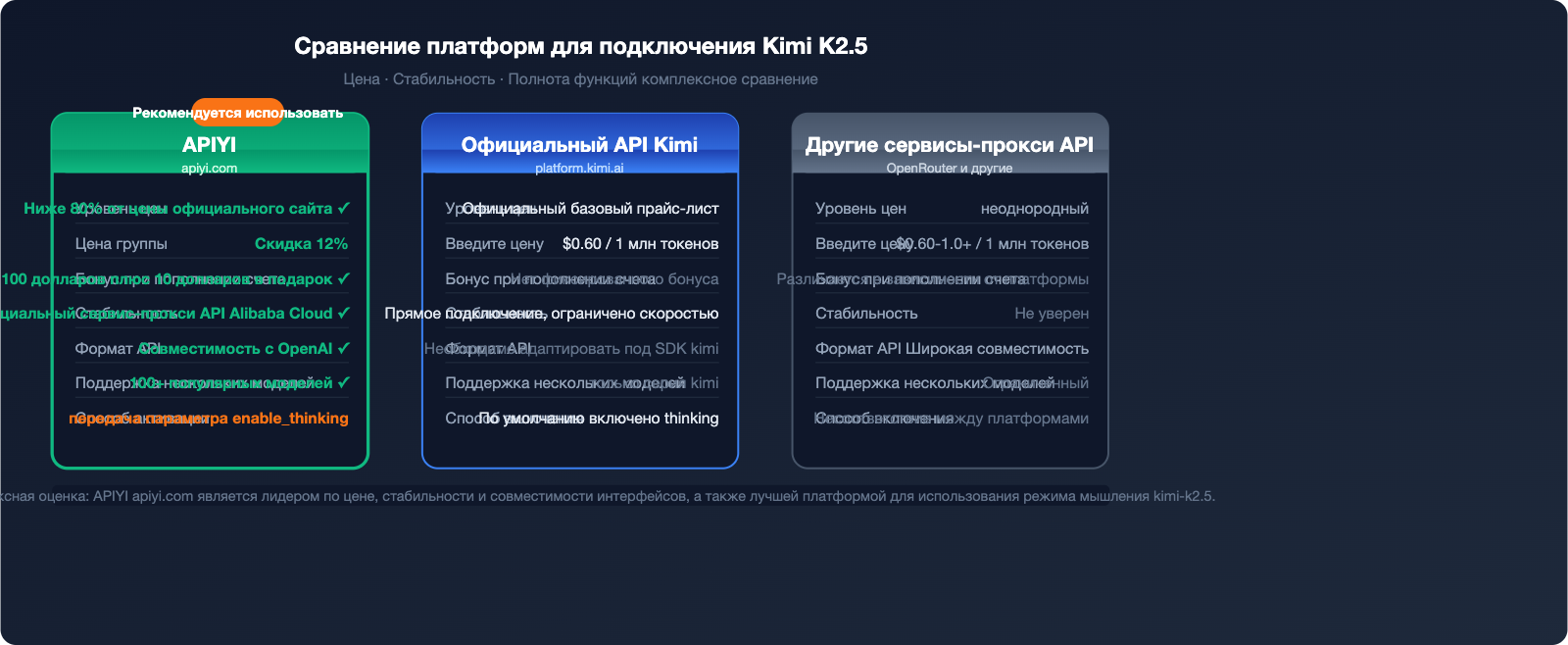

APIYI против официального сайта: сравнение цен и стабильности

Обзор платформ

| Параметр сравнения | APIYI (apiyi.com) | Официальный API Kimi | Другие сервисы-прокси API |

|---|---|---|---|

| Уровень цен | Ниже официальных на 20% (скидка 0.88) | Официальный прайс | Разный |

| Стабильность | Уровень официального прокси Alibaba Cloud | Прямое подключение, лимиты скорости | Непредсказуемо |

| Бонусы при пополнении | $100 + $10 в подарок | Нет | Разные |

| Совместимость API | Формат OpenAI, 100% совместимость | Требуется SDK Kimi | Частичная |

| Поддержка моделей | 100+ популярных моделей | Только серия Kimi | Ограниченно |

| Поддержка бизнеса | Персональный менеджер + счета | Стандартная | Ограниченно |

Пример расчета выгоды APIYI

Рассмотрим ежемесячный вызов модели kimi-k2.5 thinking (в среднем 3000 токенов на вход + 5000 токенов на выход, 1000 запросов):

Стоимость входных токенов:

Официальная цена ~$0.60/1M → 1000 запросов × 3000 токенов = 3M токенов → $1.80

Цена APIYI со скидкой 0.88 → ~$1.58

Стоимость выходных токенов (включая reasoning):

Официальная цена ~$2.50/1M → 1000 запросов × 5000 токенов = 5M токенов → $12.50

Цена APIYI со скидкой 0.88 → ~$11.00

Ежемесячная экономия: ~$1.72 + дополнительные 10% за счет бонусов при пополнении

💡 Реальная выгода: Скидка APIYI складывается из двух частей: базовой скидки (0.88) и бонусов при пополнении (при внесении $100 вы получаете $10, что дает еще 10% экономии). Итоговая стоимость составляет около 79-80% от официальной.

Лучшие сценарии использования режима Kimi K2.5 Thinking

Когда стоит включить Thinking

1. Сложные математические вычисления

# Подходит для режима thinking

prompt = "Докажите Великую теорему Ферма для случая n=3, приведя подробные шаги"

2. Отладка и оптимизация кода

# Подходит для режима thinking

prompt = """

В этом коде есть скрытая ошибка конкурентности, найдите и исправьте её:

[вставьте сложный многопоточный код]

"""

3. Многоэтапный логический анализ

# Подходит для режима thinking

prompt = "Проанализируйте логические уязвимости в этом бизнес-плане и расставьте их по приоритету"

4. Научные выводы

# Подходит для режима thinking

prompt = "Выведите формулу уровней энергии атома водорода из фундаментальных принципов квантовой механики"

Когда Thinking НЕ нужен

# В этих сценариях используйте обычный режим (не передавайте enable_thinking),

# это сэкономит 50-70% затрат на токены

# Простые вопросы

"Какая сегодня погода?" # Рассуждения не требуются

# Перевод текста

"Переведи следующий текст на английский: ..." # Рассуждения не требуются

# Форматирование вывода

"Отформатируй следующие JSON-данные" # Рассуждения не требуются

# Творческое письмо

"Напиши стихотворение о весне" # Глубокие рассуждения не требуются

🎯 Совет: Рекомендуем переключать режимы в зависимости от сложности задачи. При подключении через APIYI (apiyi.com) вы можете использовать один API-ключ для гибкого вызова как kimi-k2.5 (в режиме thinking), так и других легких моделей, комбинируя их по мере необходимости.

Потоковый вывод: обработка ответов в режиме Thinking в реальном времени

При использовании потоковой передачи (streaming) в режиме Thinking необходимо особым образом обрабатывать инкрементальные фрагменты reasoning_content:

from openai import OpenAI

client = OpenAI(

api_key="sk-ваш_API_KEY",

base_url="https://api.apiyi.com/v1"

)

# Пример потокового вызова

stream = client.chat.completions.create(

model="kimi-k2.5",

messages=[

{"role": "user", "content": "Проанализируй временную сложность алгоритма быстрой сортировки в худшем случае"}

],

extra_body={"enable_thinking": True},

temperature=1.0,

max_tokens=16000,

stream=True

)

thinking_buffer = []

answer_buffer = []

is_thinking = True

for chunk in stream:

delta = chunk.choices[0].delta

# Обработка потока процесса мышления

if hasattr(delta, 'reasoning_content') and delta.reasoning_content:

thinking_buffer.append(delta.reasoning_content)

print(delta.reasoning_content, end='', flush=True)

# Обработка потока финального ответа

elif delta.content:

if is_thinking:

print("\n\n=== Финальный ответ ===\n")

is_thinking = False

answer_buffer.append(delta.content)

print(delta.content, end='', flush=True)

print() # Перенос строки

💡 Ключевые моменты потоковой обработки:

reasoning_contentиcontentв потоке являются независимыми полями. Обычно сначала полностью выводитсяreasoning_content, а затемcontent. Вам нужно отслеживать инкрементальные данные для каждого из этих полей отдельно.

Часто задаваемые вопросы (FAQ)

Q1: В ответе нет поля reasoning_content, режим мышления не сработал?

О: Проверьте следующие три пункта:

- Правильно ли передан параметр

"enable_thinking": true. - Установлен ли

max_tokensна уровне 16000 или выше. - При вызове через Python SDK передается ли параметр

extra_body={"enable_thinking": True}.

Рекомендуем сначала протестировать запрос через curl, чтобы убедиться в правильности формата параметров, прежде чем интегрировать его в код. Техническую поддержку можно получить у службы поддержки APIYI на сайте apiyi.com.

Q2: В режиме Thinking потребление токенов слишком высокое, как контролировать расходы?

О: Можно оптимизировать процесс следующими способами:

- Отключать режим Thinking для простых задач (не передавать параметр

enable_thinking). - Умеренно снизить

max_tokens(минимум 8000, но это может привести к обрыву сложных рассуждений). - Разделять задачи: для сложных рассуждений использовать

kimi-k2.5 thinking, а для простых — легкие модели вродеgpt-4o-mini. - Снизить базовые затраты через групповые тарифы APIYI на apiyi.com (0.88).

Q3: Обязательно ли устанавливать temperature на 1.0?

О: Официально настоятельно рекомендуется устанавливать значение 1.0 — это оптимальный параметр температуры для режима kimi-k2.5 thinking. Слишком низкое значение (например, 0.7) сделает модель излишне консервативной при рассуждениях, что снизит качество; слишком высокое (например, 1.5) может привести к нарушению логической цепочки. Значение 1.0 — самый надежный выбор.

Q4: Полностью ли соответствует kimi-k2.5 в APIYI официальной версии?

О: Да. APIYI использует официальные каналы Alibaba Cloud, поэтому веса и возможности модели полностью идентичны официальным Kimi. Разница заключается только в способе передачи параметров: в официальной версии Thinking включен по умолчанию, а в APIYI его нужно активировать вручную через enable_thinking: true. Это стандартное различие для сервисов-прокси API, которое никак не влияет на качество вывода модели.

Резюме: основные моменты режима Kimi K2.5 Thinking

| Ключевой момент | Описание |

|---|---|

| Параметр активации | Необходимо передать "enable_thinking": true |

| Настройка температуры | Используйте фиксированное значение temperature: 1.0 |

| Бюджет токенов | max_tokens ≥ 16000 |

| Поля ответа | Процесс мышления находится в reasoning_content, а сам ответ — в content |

| Адрес подключения | https://api.apiyi.com/v1 (совместимо с OpenAI) |

| Выгодные цены | Дешевле, чем 80% от официального сайта, при пополнении на $100 дарим $10 |

Kimi K2.5 демонстрирует выдающиеся результаты в ключевых тестах, таких как математическое рассуждение AIME (96,1%) и генерация кода (SWE-Bench 76,8%). Режим мышления (thinking) особенно эффективен для решения сложных задач, требующих многошаговых логических выводов.

🎯 Попробуйте прямо сейчас: перейдите на официальный сайт APIYI apiyi.com, зарегистрируйте аккаунт, чтобы получить API-ключ, и подключите режим kimi-k2.5 thinking всего за 5 минут. При пополнении счета на 100 долларов вы получаете бонус в 10 долларов, что в сочетании с групповыми скидками делает итоговую стоимость ниже 80% от цен на официальном сайте Kimi.

Статья подготовлена технической командой APIYI | Источники данных: официальная документация Moonshot AI и отчеты Artificial Analysis (январь 2026 г.)

Для получения технической поддержки посетите справочный центр APIYI: help.apiyi.com