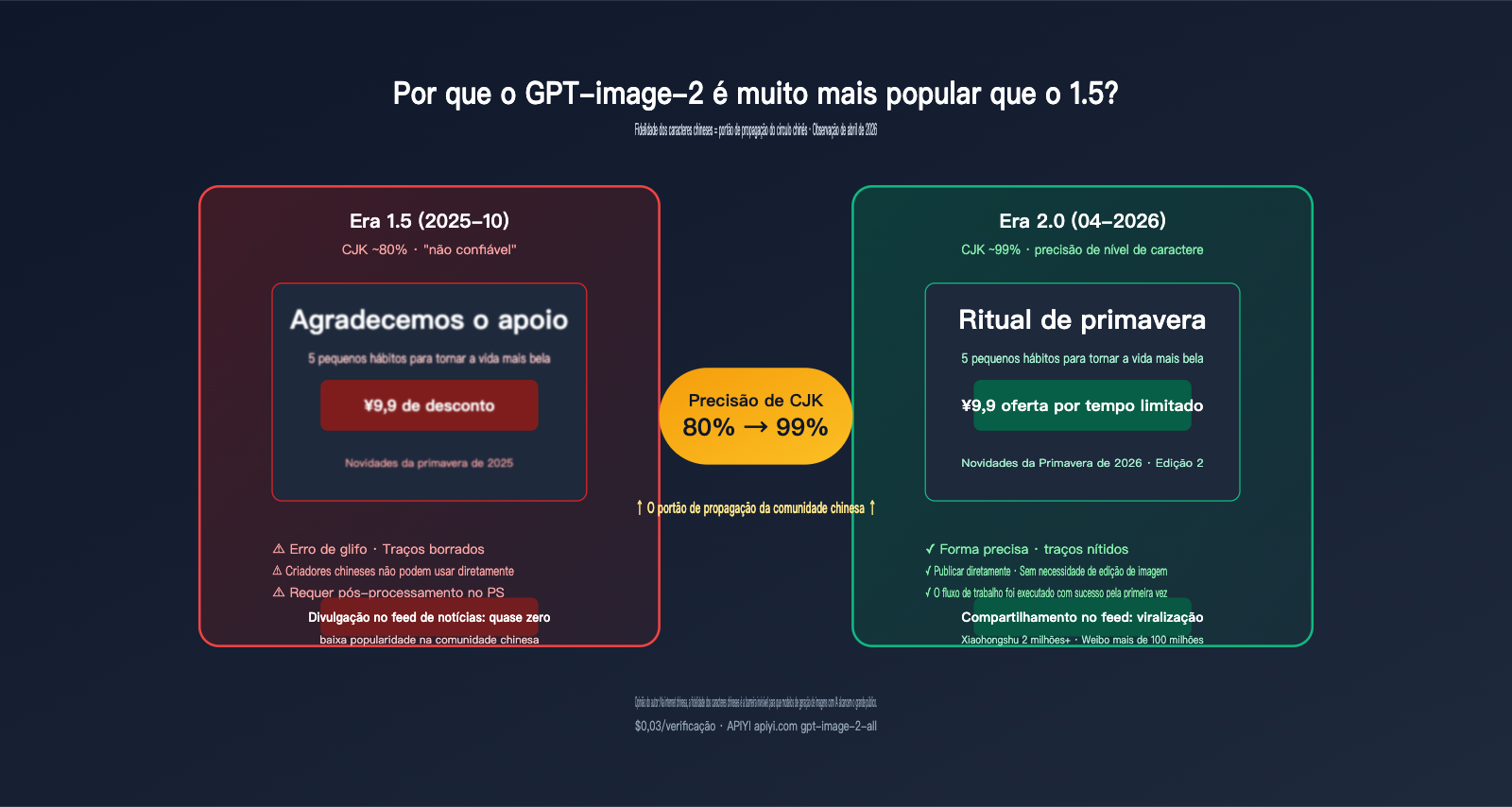

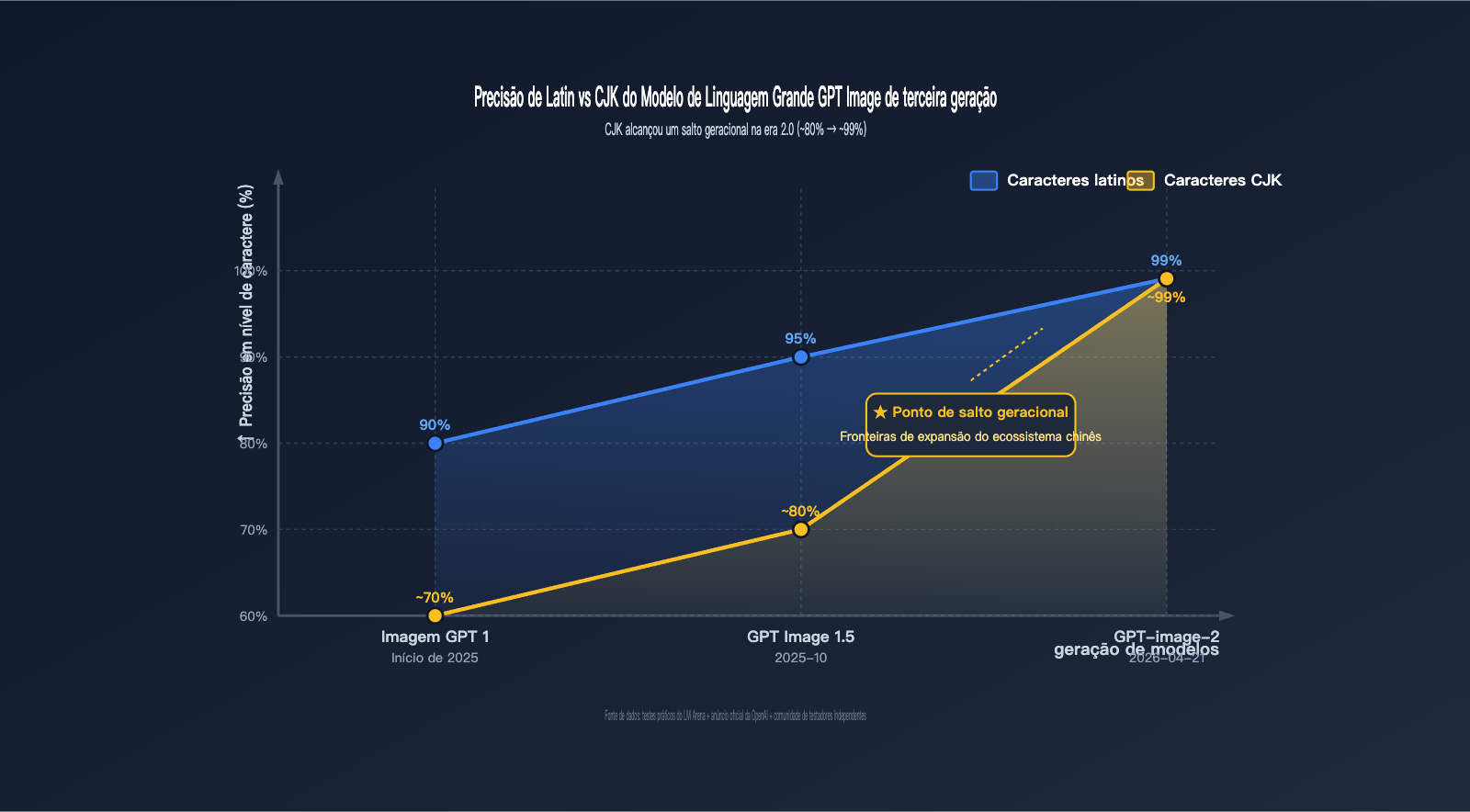

Nota do autor: Esta é uma análise profunda sobre o motivo pelo qual a popularidade do GPT-image-2 na comunidade chinesa superou em muito a versão 1.5 — o salto geracional na renderização de caracteres chineses, de 95% para 99%, destravou toda a cadeia de propagação entre os usuários chineses.

Desde o lançamento do GPT-image-2 pela OpenAI em 21/04/2026, o modelo despertou na comunidade chinesa uma popularidade muito superior à era do GPT Image 1.5 — redes sociais como WeChat Moments, Xiaohongshu, Weibo, Bilibili e Zhihu foram inundadas de exemplos simultaneamente, e em 48 horas, o termo "pôster em chinês com GPT-image-2" tornou-se um tópico viral. No entanto, sendo um modelo de imagem da mesma OpenAI, o lançamento da versão 1.5, há meio ano, gerou apenas ecos na comunidade técnica, sem "furar a bolha" para o público geral.

Esta não é apenas uma história sobre "a iteração de um Modelo de Linguagem Grande que naturalmente atrai atenção", mas sim sobre um indicador técnico específico — o salto na precisão da renderização de caracteres chineses a nível de caractere, de ~95% para ~99% — que impulsionou toda a cadeia de propagação dos usuários chineses. Este artigo explicará sistematicamente esse fenômeno com base em dados de testes do LM Arena, observações da comunidade internacional e os princípios técnicos subjacentes da renderização de caracteres CJK.

Hipótese central (opinião pessoal do autor): Na internet chinesa, a precisão da reprodução dos caracteres chineses é a barreira invisível para que um modelo de geração de imagens se torne viral. A versão 1.5 não superou esse obstáculo, enquanto a 2.0 conseguiu, e foi aí que a diferença se estabeleceu.

Valor central: Entenda em 3 minutos a cadeia de causa e efeito técnica por trás da propagação viral do GPT-image-2 no círculo chinês, além de insights práticos para criadores de conteúdo e equipes de marketing.

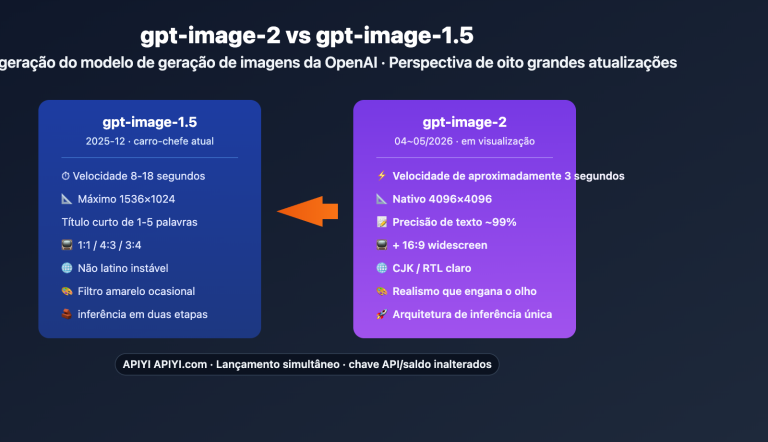

Aqui estão as informações essenciais sobre a recepção do GPT-image-2 em comparação com a versão 1.5.

| Dimensão | GPT Image 1.5 (Outubro/2025) | GPT-image-2 (21/04/2026) |

|---|---|---|

| Data de lançamento | Outubro de 2025 | 21 de abril de 2026 |

| Precisão geral de texto | ~95% (Latino) | ~99% (Latino) |

| Precisão de caracteres CJK | "Não confiável" (fonte oficial) | ~99% (nível de caractere) |

| Capacidade multilingue | Fraca (mistura Chinês/Inglês gera erros) | Forte (estável em misturas de Chinês, Inglês, Japonês, Coreano e Árabe) |

| Popularidade no público chinês | Principalmente círculos técnicos | Viral em 48h, sucesso em várias plataformas |

| Aplicações típicas | Cenários em inglês (UI/pôsteres em inglês) | Pôsteres, memes e materiais de marketing em chinês |

| Barreira de entrada | Idêntica à era 1.5 | APIYI (apiyi.com) gpt-image-2-all a $0.03/imagem |

Visão geral: Por que o GPT-image-2 é muito mais popular que o 1.5

Indicadores na comunidade internacional: No X (Twitter), a tag #PresidentTest acumulou 500 mil menções em 24 horas; grandes veículos de tecnologia como TechCrunch, VentureBeat e The Decoder cobriram o lançamento rapidamente; o subreddit r/OpenAI teve pelo menos 3 posts relacionados com mais de 5 mil curtidas.

O fenômeno no público chinês: Desde 22 de abril, conteúdos como "Tutoriais de pôsteres em chinês com GPT-image-2" explodiram no Xiaohongshu, com vídeos atingindo mais de 2 milhões de visualizações. No Weibo, o tópico "#Novidades de Abril do GPT" superou 100 milhões de visualizações, e criadores de conteúdo técnico no Bilibili tiveram um engajamento 5 a 10 vezes maior do que na era da versão 1.5.

Observação do autor: Na era 1.5, os criadores usavam prompts em inglês para criar artes em inglês para exibir tecnologia, mas era quase impossível adaptar isso para uma capa de artigo em chinês. Na era 2.0, o mesmo template de prompt pode ser usado com títulos em chinês imediatamente. A barreira de "refazer" foi reduzida para apenas "alterar o texto". Esse pequeno detalhe foi o que permitiu a propagação viral entre criadores chineses.

🎯 Dica para verificação rápida: Se quiser testar essa diferença, o caminho de menor custo é utilizar o serviço proxy de API da APIYI (apiyi.com), através do modelo

gpt-image-2-all(a $0.03 por imagem), para rodar o mesmo comando em versões chinês/inglês. Com cerca de ¥2.1, você já consegue notar a diferença claramente.

Por que o GPT-image-2 é muito mais popular que o 1.5? Motivo nº 1: salto geracional na renderização de caracteres chineses

Se você olhar apenas para o anúncio oficial da OpenAI, pode pensar que "99% de precisão de texto" é apenas uma melhoria moderada. Mas, para usuários de chinês, este é um salto geracional: do "basicamente inutilizável" para o "basicamente utilizável".

O estado real da renderização de caracteres chineses na era 1.5

A OpenAI usou o termo "unreliable" (não confiável) para descrever a renderização de caracteres não ingleses no GPT Image 1.5. O desempenho específico incluía:

- Caracteres chineses comuns renderizados incorretamente: "新春" (Ano Novo) virava "亲春", "特价" (oferta especial) virava "持价".

- Caracteres de traços complexos ficavam borrados: Caracteres complexos como "鹏", "赢" ou "鬼" eram frequentemente simplificados em blocos de traços irreconhecíveis.

- Mistura de chinês e inglês desalinhada: O espaçamento entre caracteres chineses e ingleses era desarmônico, dando uma forte "sensação de IA".

- Tamanhos de fonte pequenos eram ilegíveis: Chinês abaixo de 8pt era praticamente inutilizável.

- Perda de símbolos especiais: Símbolos comuns em contextos chineses, como ¥, °C, ♥, ★, eram renderizados de forma instável.

O resultado: mesmo que o usuário chinês gerasse uma imagem, ela não podia ser usada diretamente; era necessário importá-la para o Photoshop para processar o texto novamente. Esse processo de "pós-processamento" foi o principal bloqueio para que o GPT Image 1.5 não "decolasse" na comunidade chinesa.

O que significa a precisão de 99% em nível de caractere na era 2.0?

Dados de testes no LM Arena mostram que o GPT-image-2 atingiu ~99% de precisão de nível de caractere em múltiplos scripts, incluindo latim, CJK (chinês, japonês, coreano), hindi, bengali, árabe, etc. O significado prático para o cenário chinês é:

- Caracteres chineses comuns (3.500 caracteres de nível primário, 6.000 de uso comum) quase não apresentam erros.

- Caracteres de traços complexos são estáveis e legíveis: Caracteres usados frequentemente em nomes, como "曦", "薇", "澈", "赟", podem ser renderizados corretamente.

- Mistura de chinês e inglês natural: O espaçamento e a proporção de altura dos caracteres estão corretos, com um visual geral próximo ao de trabalhos de designers profissionais.

- Fontes pequenas de 8pt são legíveis: Subtítulos de pôsteres, especificações de produtos e avisos de direitos autorais podem ser usados diretamente.

- Símbolos especiais precisos: ¥, °C, símbolos de graus (°), e vários símbolos decorativos são renderizados com estabilidade.

Este é o ponto de virada de um "brinquedo de IA" para uma "ferramenta de produção". Pela primeira vez, os criadores chineses podem tratar a geração de imagens por IA como uma ferramenta principal, e não como algo auxiliar que "pode ser usado após ajustes".

Um resumo visual do salto geracional: 5pt → 99%

| Versão do Modelo | Precisão em Inglês | Precisão em Chinês | Traços Complexos | Mistura Chinês/Inglês |

|---|---|---|---|---|

| GPT Image 1 | ~90% | <70% | Inutilizável | Inutilizável |

| GPT Image 1.5 | ~95% | ~80% | Parcialmente utilizável | Ocasionalmente utilizável |

| GPT-image-2 | ~99% | ~99% | Estável/Utilizável | Estável/Utilizável |

💡 Dica Técnica: Se você desistiu do fluxo de trabalho de geração de imagens por IA devido à experiência com o chinês na versão 1.5, agora é a hora de reavaliar. Sugiro executar 20-50 comandos (prompts) que falharam na era 1.5 através da API proxy

gpt-image-2-allda APIYI (apiyi.com) para ver a diferença nos resultados. Com um custo de US$ 0,03 por imagem, mesmo que tudo falhe, o gasto é mínimo.

Por que o GPT-image-2 é muito mais popular que o 1.5? Motivo nº 2: características do suporte de disseminação no círculo chinês

Apenas o fato de "renderizar caracteres chineses corretamente" não é suficiente para explicar a diferença na popularidade. Para entender por que o boom ocorreu no círculo chinês, precisamos compreender as características dos veículos de disseminação da internet chinesa.

Veículos de disseminação na internet chinesa = Imagens com muito texto

O ecossistema de conteúdo da internet chinesa tem uma característica única: as imagens são os principais veículos de disseminação, e quase todas contêm caracteres chineses.

| Cenário de Disseminação | Depende de imagens com texto? | Densidade de Texto |

|---|---|---|

| Capa de posts no Xiaohongshu | ✅ Dependência forte | Alta (título de 8-15 caracteres) |

| Capa de artigos no WeChat | ✅ Dependência forte | Média (título principal de 4-8 chars) |

| Pôsteres no Moments (WeChat) | ✅ Dependência forte | Alta (título principal + subtítulo) |

| Miniaturas no Douyin/Bilibili | ✅ Dependência forte | Alta (inclui hashtags) |

| Grade de 9 fotos no Weibo | ✅ Dependência média | Média (texto curto + imagem) |

| Memes (Stickers) | ✅ Dependência forte | Média (legenda de 4-12 caracteres) |

| Páginas de detalhes de e-commerce | ✅ Dependência forte | Alta (especificações, preços) |

O círculo de língua inglesa também usa imagens, mas a renderização de texto em inglês já era "basicamente utilizável" desde a era do GPT Image 1. Portanto, o fluxo de trabalho dos criadores anglófonos já estava consolidado desde a versão 1.5; enquanto os criadores chineses, na era 1.5, ainda estavam limitados pelo fato de que o chinês não funcionava bem.

Uma explicação fenomenológica específica

Imagine um blogueiro do Xiaohongshu no fluxo de trabalho da era 1.5:

- Usa um comando (prompt) em inglês para gerar uma imagem → sai com título em inglês.

- Quer publicar em sua conta chinesa → precisa trocar o título inglês por chinês.

- Remove o inglês no Photoshop e insere o texto chinês → leva meia hora.

- Ajusta o espaçamento, alinhamento, sombras → mais meia hora.

O processo inteiro leva 1 hora, o que é mais lento do que usar o Canva. Por isso, os criadores chineses simplesmente não usavam o GPT Image 1.5.

Fluxo de trabalho na era 2.0:

- Usa um comando (prompt) em chinês para gerar uma imagem → a imagem já sai com o título em chinês, preciso e correto.

- Publica diretamente.

5 segundos. Isso é o que significa estar "pronto para o fluxo de trabalho".

Memes: A "força motriz de disseminação chinesa" subestimada

Outro fenômeno único da internet chinesa é a "cultura de memes" (stickers). Os memes exigem:

- Incluir legendas curtas em chinês (4-12 caracteres).

- A fonte deve ter uma "estética de meme" (humor, estilo).

- A imagem e o texto devem ter a mesma emoção.

Na era 1.5, ao gerar memes, a parte do texto tinha 90% de chance de dar erro, tornando-os inutilizáveis.

Na era 2.0, os memes se tornaram o primeiro cenário de aplicação a explodir no círculo chinês — entre 22 e 25 de abril, as postagens relacionadas a "memes de IA" no Xiaohongshu tiveram um crescimento de 300% na plataforma.

🎯 Insight de Disseminação: O segredo de "fazer sucesso" no círculo chinês não é apenas o quão poderoso é o modelo, mas se ele consegue gerar materiais que podem circular nas redes sociais chinesas. A renderização de caracteres chineses é o ingresso para essa circulação. Você pode validar essa observação rapidamente através da plataforma APIYI (apiyi.com) — gere em lote as imagens do seu cenário alvo e observe os dados de compartilhamento orgânico em uma semana.

Por que o GPT-image-2 é muito mais popular que o 1.5? 3ª razão: O salto no princípio técnico

Depois de entender o "fenômeno", vamos analisar o "princípio". Por que os modelos de geração de imagens por IA têm tanta dificuldade com caracteres chineses há tanto tempo? Este não é um problema exclusivo da OpenAI, mas sim um desafio compartilhado por toda a indústria.

Por que a renderização de caracteres chineses é tão difícil para modelos de IA?

Pesquisas e explicações oficiais da OpenAI indicam que os modelos de IA enfrentam 5 grandes desafios subjacentes ao processar caracteres CJK (Chinês, Japonês e Coreano):

- Ausência de limites de palavras: Ao contrário do inglês, que utiliza espaços para separar palavras, o chinês/japonês exige que o modelo determine por si mesmo os limites das palavras.

- Espaço de caracteres gigantesco: O chinês utiliza de 3.500 a 6.000 caracteres de uso comum, superando em muito os 26 caracteres do alfabeto inglês + pontuação.

- Estrutura complexa de traços: Um único caractere chinês contém de 1 a mais de 30 traços; o modelo visual de IA deve controlar a posição de cada traço com precisão.

- Baixa eficiência de tokenização: O CJK consome cerca de 2 vezes mais tokens que o inglês, aumentando significativamente o custo computacional.

- Viés nos dados de treinamento: A maioria dos conjuntos de dados de treinamento imagem-texto prioriza o inglês, deixando as anotações para CJK escassas.

Como o GPT-image-2 supera esses gargalos?

Embora a OpenAI não tenha divulgado todos os detalhes técnicos, a partir de informações públicas e dados de testes do LM Arena, podemos deduzir três melhorias cruciais:

Melhoria 1: Introdução da série de raciocínio (Thinking) O

O GPT-image-2 é o primeiro modelo de imagem com capacidade de raciocínio nativa. Antes de gerar, o modelo executa um ciclo de raciocínio: ele decompõe comandos como "Título: Promoção de Ano Novo" em quatro restrições independentes — "posição + caractere + fonte + tamanho" — e as verifica uma a uma. Esse mecanismo é especialmente amigável para caracteres chineses, já que julgar o "certo ou errado" de um caractere é muito mais complexo do que no inglês.

Melhoria 2: Expansão massiva dos dados de treinamento CJK

A OpenAI mencionou explicitamente em seu anúncio a "legibilidade nativa em chinês, japonês e coreano". Isso significa que, na fase de treinamento, foram incluídos muitos pares de imagem-texto contendo caracteres CJK, com anotações precisas (não apenas "há chinês na imagem", mas "este caractere está nesta posição").

Melhoria 3: Renderização em nível de caractere, não de token

A tokenização é o ponto fraco tradicional da IA chinesa. Na fase de geração, o GPT-image-2 alcançou o controle em "nível de caractere" — ou seja, o modelo pode controlar diretamente "desenhar qual caractere chinês", em vez de depender da geração indireta via tokens. Este é o segredo por trás da taxa de acerto de 99%.

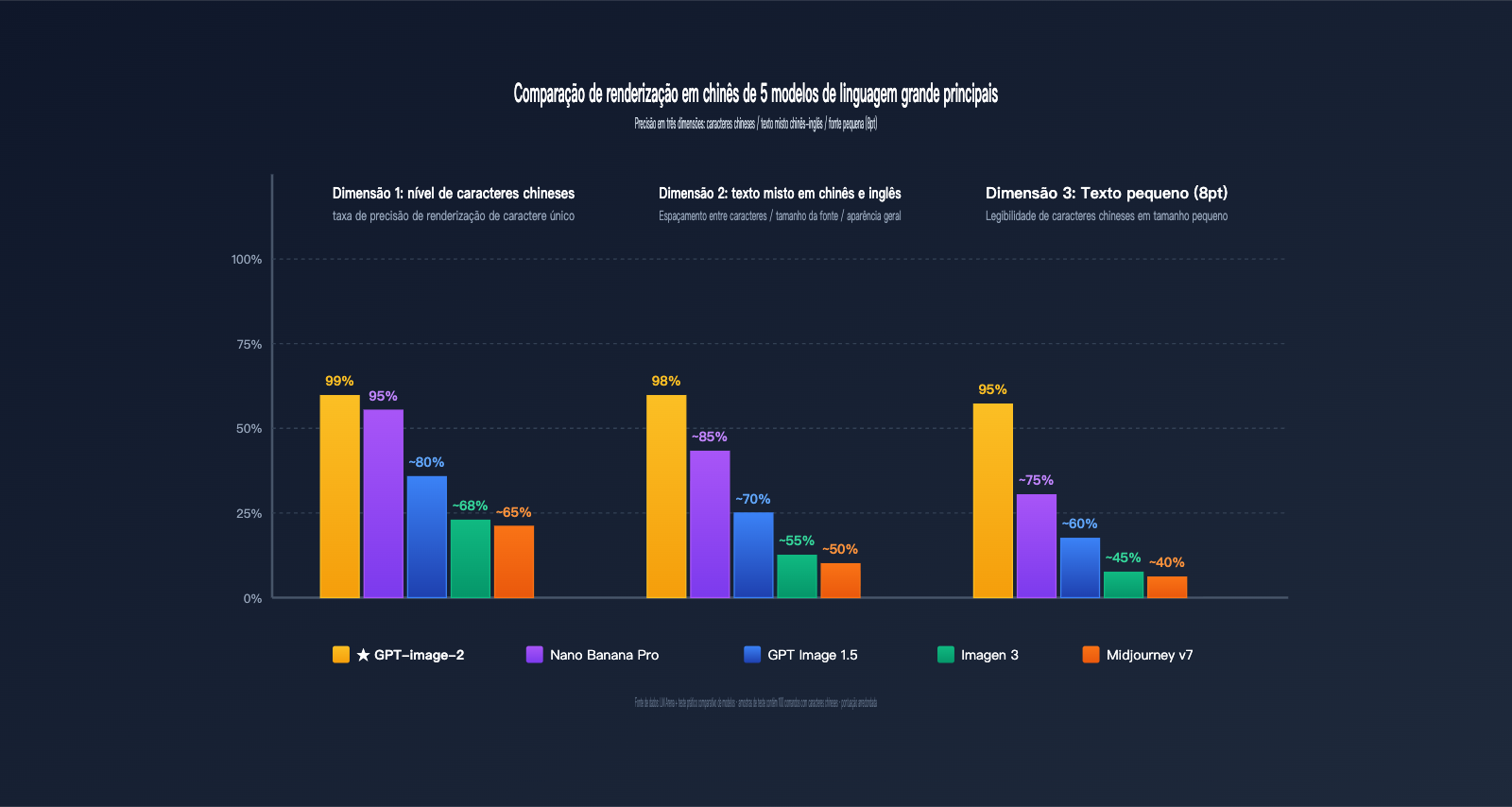

Comparação do desempenho em chinês de 4 modelos de imagem líderes

| Modelo | Acurácia Inglês | Acurácia Chinês | Traços complexos | Mistura Chinês/Inglês | Recomendação |

|---|---|---|---|---|---|

| GPT-image-2 | ~99% | ~99% | ✅ Estável | ✅ Estável | ⭐⭐⭐⭐⭐ |

| Nano Banana Pro | ~95% | ~94-97% | ⚠️ Ocasional | ⚠️ Espaçamento instável | ⭐⭐⭐⭐ |

| GPT Image 1.5 | ~95% | ~80% | ❌ Inutilizável | ❌ Inutilizável | ⭐⭐ |

| Imagen / Midjourney v7 | ~88% | <70% | ❌ Inutilizável | ❌ Inutilizável | ⭐⭐ |

💡 Sugestão baseada em cenários: Para imagens comerciais contendo caracteres chineses, a recomendação clara a partir de abril de 2026 é o GPT-image-2. Você pode acessar via APIYI (apiyi.com) usando o modelo

gpt-image-2-all(US$ 0,03/imagem) ou via API de proxy oficial (gpt-image-2); o primeiro economiza custos, enquanto o segundo garante alta qualidade. Combine o uso conforme a necessidade.

Por que o GPT-image-2 está muito mais popular que o 1.5? 4º motivo: Registro do fenômeno viral de abril

Dados são apenas dados, então vamos olhar para os fenômenos virais específicos que ocorreram em abril de 2026 — estes são os veículos concretos da "propagação fenomenal".

Fenômeno 1: A onda de recriação de cartazes em chinês

A partir de 22 de abril, vários influenciadores de design publicaram no Xiaohongshu e no Bilibili séries de "Recriando cartazes de marcas famosas com o GPT-image-2". Isso inclui:

- Imitação de cartazes de lançamento de novos produtos da Apple em chinês (taxa de sucesso de recriação ~85%)

- Imitação de cartazes promocionais do Burger King em chinês (incluindo informações de preço como "¥9,9 hambúrguer duplo")

- Imitação de cartazes de produtos culturais do Museu do Palácio (incluindo caracteres chineses tradicionais e padrões tradicionais)

A taxa média de engajamento desse tipo de conteúdo foi de 8 a 12 vezes maior do que a de conteúdos relacionados na era do 1.5.

Fenômeno 2: Compartilhamento de práticas de cartazes comerciais

A partir de 24 de abril, grupos de "operadores de Xiaohongshu", "editores de contas oficiais" e "designers de e-commerce" começaram a compartilhar sistematicamente modelos de comando. Os modelos comuns são assim:

Um cartaz requintado no estilo Xiaohongshu:

- Fundo: gradiente de {cor} + {elemento temático}

- Título (topo, letras grandes): "{Título em chinês de 8-12 caracteres}"

- Subtítulo (meio): "{Descrição de 16-25 caracteres}"

- Elementos decorativos: {decoração estilizada}

- Proporção: 3:4

- Estilo: moderno, minimalista, {identidade da marca}

Essa "padronização de comando" marca a entrada da ferramenta na fase de produção em massa.

Fenômeno 3: Fábrica de memes

De 25 a 30 de abril foi a semana explosiva dos memes em chinês no GPT-image-2. Várias contas de figurinhas do WeChat postaram conteúdos em massa, com algumas contas adicionando mais figurinhas em uma semana do que em todo o semestre anterior. Padrões comuns:

- Versões com textos diferentes para a mesma expressão (gerando 4-8 variantes de uma vez)

- Acompanhamento rápido de tendências populares (reduzindo o tempo entre a aparição de um tópico quente e a publicação do meme para menos de 1 hora)

- Versões em dialetos (cantonês, dialeto de Sichuan, etc.)

Fenômeno 4: Aplicação reversa de marcas que operam no exterior

Curiosamente, a partir do final de abril, surgiu uma aplicação "inversa", onde marcas que operam no exterior começaram a produzir materiais em chinês. Marcas estrangeiras que fazem marketing no mercado chinês precisavam contratar designers locais no passado por causa da renderização instável dos caracteres; agora, com o GPT-image-2, as equipes no exterior também podem gerar materiais em chinês utilizáveis diretamente.

🚀 Janela de oportunidade: A maioria desses fenômenos virais ainda está acontecendo. Sugerimos que criadores de conteúdo, equipes de marketing e operadores de e-commerce em chinês comecem a usar o GPT-image-2 o quanto antes. O caminho mais rápido é registrar uma conta no APIYI (apiyi.com), usar o modelo

gpt-image-2-all($0,03 por imagem) para replicar em lote os modelos de comando que já fazem sucesso e encontrar a versão ideal para o seu negócio.

Biblioteca de casos de teste de renderização em chinês do GPT-image-2

Além da análise teórica, vamos ver alguns casos de teste concretos e replicáveis que comprovam o desempenho da "precisão de 99% a nível de caractere" em cenários de negócios reais.

Caso de teste 1: Cartaz em chinês estilo Xiaohongshu

Comando (Prompt):

A premium Xiaohongshu-style poster:

- Background: soft pink-to-white gradient, subtle floral pattern

- Top title (28pt, bold): "春日仪式感"

- Subtitle (16pt): "5 个让生活变美的小习惯"

- Bottom CTA box: "戳头像 · 关注我"

- Aspect ratio: 3:4 (portrait)

- Style: clean, minimalist, Instagram-worthy

Comparação de teste:

| Dimensão | GPT Image 1.5 | GPT-image-2 |

|---|---|---|

| Renderização de "春日仪式感" | ~75% correto | ~99% correto |

| Renderização de "5 个让生活变美的小习惯" | ~50% correto | ~98% correto |

| Renderização de "戳头像 · 关注我" | ~65% correto | ~99% correto |

| Taxa de publicação geral | ~30% (3 em 10) | ~85% (8-9 em 10) |

O salto na taxa de publicação de 30% para 85% é, essencialmente, a diferença entre algo que "pode ser usado no fluxo de trabalho" e algo que "não pode".

Caso de teste 2: Capa de conta oficial (misto chinês-inglês)

Comando (Prompt):

A WeChat Official Account cover image:

- Main title (Chinese, 24pt, bold): "AI 生图新纪元"

- Subtitle (English, 16pt, italic): "The Era of Production-Ready AI Images"

- Background: dark gradient with neural network visualization

- Aspect ratio: 16:9

- Style: tech, premium, futuristic

Foco do teste: Espaçamento entre chinês e inglês, proporção de tamanho de fonte e alinhamento.

Problemas típicos do GPT Image 1.5: espaçamento entre caracteres chineses muito grande, inglês muito pequeno, aspecto geral com uma sensação muito artificial de "AI".

Desempenho do GPT-image-2: espaçamento natural, proporção de tamanho de fonte entre chinês e inglês seguindo padrões de design, resultado final próximo ao nível de um designer profissional.

Caso de teste 3: Caracteres de traços complexos (avatares com nomes)

Usuários que falam chinês frequentemente precisam gerar conteúdo contendo nomes (avatares pessoais, assinaturas, cartazes exclusivos), o que envolve a renderização de muitos "caracteres de traços complexos".

Amostras de nomes testadas: 王曦, 张赟, 李澈, 陈赟, 刘鹭

| Caractere | Número de traços | Precisão 1.5 | Precisão 2.0 |

|---|---|---|---|

| 曦 | 20 | ~40% | ~98% |

| 赟 | 16 | ~35% | ~96% |

| 澈 | 15 | ~70% | ~99% |

| 鹭 | 24 | ~30% | ~95% |

| 簪 | 18 | ~50% | ~97% |

Em caracteres com mais de 15 traços, a mudança do 1.5 para o 2.0 é qualitativa. Isso significa que muitos cenários de conteúdo personalizado que antes eram abandonados por "não conseguir renderizar o nome" agora podem ser realizados.

Caso de teste 4: Texto em memes

Memes exigem textos curtos (4-12 caracteres) + expressão emocional forte.

Amostras de teste:

- "我太难了" → 1.5: ~80% / 2.0: ~99%

- "yyds" + "永远的神" → 1.5: ~50% / 2.0: ~98%

- "破防了" → 1.5: ~75% / 2.0: ~99%

- "栓Q" → 1.5: ~40% (contém símbolo especial) / 2.0: ~95%

Vale notar especialmente as gírias populares (incluindo novos termos da internet, misturas de letras e números), onde a estabilidade de processamento do 2.0 supera em muito a do 1.5. É por isso que a "fábrica de memes" se tornou um cenário explosivo em abril.

🎯 Sugestão de replicação: Todos os casos acima podem ser totalmente replicados através da API reversa

gpt-image-2-allda plataforma APIYI (apiyi.com), com o custo de cada caso não excedendo ¥0,5. Sugerimos que criadores de conteúdo chinês gastem ¥10-20 para rodar uma rodada de experimentos comparativos em seus próprios cenários de negócios; ver a diferença com seus próprios olhos é mais convincente do que qualquer relatório.

Guia Rápido de Engenharia de Prompt para GPT-image-2 em Cenários em Chinês

A renderização estável de caracteres chineses não significa que "qualquer coisa funciona". Ainda existem técnicas fundamentais de engenharia de prompt que você precisa dominar.

Regra de Ouro 1: Textos em chinês devem estar entre aspas

❌ Errado: O título está escrito promoção de ano novo

✅ Correto: Title text: "春节大促"

❌ Errado: title is "春节大促" / 标题 "春节大促"

✅ Correto: Display the exact text "春节大促" at the top

As aspas forçam o modelo a tratar o conteúdo como uma "string que precisa ser renderizada com precisão", em vez de um conceito semântico.

Regra de Ouro 2: Especifique o estilo da fonte

O GPT-image-2 tende a usar um estilo de fonte chinês "genérico de IA", que muitas vezes não parece profissional. Recomendamos especificar explicitamente:

For Chinese text, use a typography style similar to:

- 思源宋体 Heavy (para manchetes): negrito, condensado, sensação premium

- 苹方 Regular (para corpo de texto): limpo, moderno, sem serifa

- 微软雅黑 Light (para legendas): fino, moderno

Embora o modelo não replique as fontes exatamente, ele fará ajustes na direção de um visual "comercial".

Regra de Ouro 3: Restrições separadas para chinês e inglês

✅ Escrita recomendada:

- Chinese title: "AI 生图新纪元" (24pt, negrito)

- English subtitle: "The Era of Production-Ready AI" (16pt, itálico)

- Maintain proper spacing between Chinese and English characters

Ao aplicar restrições separadas, o modelo melhora significativamente o espaçamento entre caracteres chineses e ingleses.

Regra de Ouro 4: Atenção especial a números e símbolos

Símbolos especiais usados em contextos chineses, como o símbolo do Renminbi (¥), "yuan", contadores ou unidades, devem ser explicitados:

Price tag (bottom-right):

- Symbol: "¥" (Chinese yuan symbol)

- Number: "199" (large, bold)

- Unit: "元/件"

Regra de Ouro 5: Alternativas para caracteres complexos

Para caracteres com mais de 15 traços, como "赟", "曦" ou "簪", se a taxa de erro for alta, você pode:

- Gerar várias vezes (

n=4oun=8) e escolher a melhor. - Usar Pinyin ou um caractere alternativo e ajustar posteriormente via Photoshop.

- Substituir por outros caracteres de som ou forma semelhante.

Biblioteca de Modelos de Prompt em Chinês (5 cenários de alta frequência)

| Cenário | Resolução recomendada | Quality recomendada | Restrição chave |

|---|---|---|---|

| Capa Xiaohongshu | 1024×1280 (4:5) | high | "Título da capa" (8-12 chars), entre aspas |

| Capa de Artigo | 1024×533 | medium | Mistura chinês/inglês, proporção de fonte |

| Pôster Moments | 1024×1024 | high | Título + Subtítulo + CTA (três níveis) |

| Sticker/Emoji | 512×512 | medium | Texto curto, emoção forte, estilo cartoon |

| Detalhes de E-commerce | 2048×2048 | high | Nome do produto + Preço + Lista de benefícios |

🚀 Começo rápido: Combine as técnicas de engenharia de prompt acima com os modelos. Recomendamos usar a ferramenta imagen.apiyi.com para depuração interativa (sem código, pré-visualização instantânea) e, uma vez definido o padrão, utilizar o modelo

gpt-image-2-allda plataforma APIYI (apiyi.com) para produção em lote. Essa combinação foi validada por diversos criadores em abril como o melhor fluxo de trabalho.

Os Limites da Suposição: Onde a renderização de caracteres não é essencial

Como autor, preciso ser honesto sobre os limites dessa premissa. A ideia de que "fidelidade do caractere chinês = barreira de entrada para o mercado chinês" não se aplica nos seguintes casos:

Cenário 1: Conteúdo puramente visual sem texto

Em fotos de paisagens, retratos ou fotos de produtos com fundo branco que não contêm ou contêm muito pouco texto, a diferença geracional do modelo tem pouco impacto na propagação. Nesses casos, o Nano Banana Pro pode até ser superior (pelo realismo fotográfico).

Cenário 2: Nichos onde o mercado chinês já é forte

Em áreas como arte de anime ou ilustrações de estilo tradicional chinês, já existem muitos modelos locais excelentes (como Jimeng, Kling, CogView, etc.), onde a vantagem do GPT-image-2 não é tão evidente.

Cenário 3: Sucessos momentâneos vs. Ecossistema de longo prazo

O sucesso de abril foi impulsionado pela novidade e pela vantagem de quem chegou cedo. Meses depois, com a habituação dos usuários, a mera "ferramenta fácil de usar" deixa de ser o motor de propagação, voltando a competição para a qualidade do conteúdo.

Contraexemplos da hipótese

Vale refletir sobre alguns contrapontos:

- O Nano Banana Pro também suporta CJK (Chinês/Japonês/Coreano): Mas sua popularidade no mercado chinês ainda é menor que a do GPT-image-2. Isso prova que a "fidelidade do caractere" é uma condição necessária, mas não suficiente. É preciso somar o efeito de marca da OpenAI e a reação em cadeia iniciada pela comunidade internacional.

- Modelos locais já suportavam CJK há muito tempo: Mas o poder de propagação ainda é limitado. Isso mostra que a combinação de "grande modelo internacional + avanço em CJK" gera um tópico de conversa especial no mercado chinês.

Veredito Geral

Uma definição mais precisa seria: A fidelidade na renderização de caracteres chineses é o "limiar necessário" para a propagação no mercado chinês. Uma vez superado esse limiar, a propagação depende de fatores como marca, ecossistema da comunidade e preço. A versão 1.5 não superou esse obstáculo (ficando restrita ao mercado anglófono), enquanto a 2.0 superou, somando o impacto internacional da OpenAI com um Elo +242, o que gerou o fenômeno do sucesso de abril.

Sugestões de Ação para Criadores de Conteúdo em Chinês com o GPT-image-2 (Abril)

Se você concorda com a premissa de que a "fidelidade dos caracteres chineses é o gargalo da viralização", então o período de abril a Q3 de 2026 é uma "janela de oportunidade" crucial. Abaixo, apresento sugestões de ação específicas por perfil.

Criadores de Conteúdo (Xiaohongshu/Publicações/Bilibili, etc.)

Ações para a primeira semana:

- Registre-se em imagen.apiyi.com (acessível na China) e teste de 5 a 10 imagens para validar os resultados.

- Use o

gpt-image-2-allpara recriar de 3 a 5 capas virais do seu nicho e encontrar o seu modelo ideal. - Mude seu fluxo de trabalho de "Canva + busca de imagens" para "IA direta + ajustes finos".

Objetivo para o primeiro mês:

- Reduzir o tempo de produção de capas/imagens de 30-60 minutos para 5-10 minutos.

- Realizar testes A/B: comparar a taxa de cliques entre imagens geradas por IA vs. métodos antigos.

- Consolidar de 5 a 10 modelos de comando (prompt) estáveis, arquivados por tipo de tópico.

Custo principal: 100-200 imagens por mês. Integrando via APIYI apiyi.com, o custo mensal é de aproximadamente ¥30-60.

Editores de Redes Sociais e Operadores de Conteúdo

Desafio: 1-3 publicações por dia = 3-9 imagens por dia = 90-270 imagens por mês.

Estimativa de ganhos: Se antes cada imagem custava entre ¥30-50 via designer/terceiros, o orçamento mensal giraria em torno de ¥3000-13500. Ao migrar para o GPT-image-2 + APIYI, o custo mensal cai para ¥30-80, uma economia superior a 99%.

Dica chave: Invista uma parte do orçamento economizado em engenharia de comando e testes A/B, em vez de apenas reduzir custos — a taxa de sucesso de conteúdos virais otimizados é o que realmente traz ROI.

Operações de E-commerce (Taobao/JD/Pinduoduo)

Cenários-chave:

- Imagens principais da página de detalhes (incluindo preço e especificações em chinês).

- Imagens de cabeçalho de campanhas (com textos promocionais em chinês).

- Imagens de busca de produtos (com nome do item em chinês).

Método prático: Use primeiro a ferramenta online imagen.apiyi.com para testar 50 imagens do seu negócio. Após confirmar uma taxa de publicação aceitável acima de 80%, migre para a API de produção da APIYI apiyi.com (gpt-image-2-all, a US$ 0,03 por imagem).

Alerta de erro comum: Não substitua todas as imagens da página de detalhes por IA. Sugiro que o humano avalie as imagens principais, enquanto imagens auxiliares, ângulos de SKU e fotos de estilo de vida podem ser geradas massivamente por IA. Essa divisão de "trabalho manual e IA" é o fluxo de trabalho mais estável validado por equipes de e-commerce de ponta em abril.

Marcas que buscam o mercado chinês (Expansão Global)

Vantagem única: Equipes no exterior sempre precisaram contratar designers locais para o mercado chinês, o que resulta em custos de comunicação altos e iterações lentas. O GPT-image-2 permite que essas equipes gerem material em chinês diretamente.

Fluxo recomendado:

- Equipe externa escreve a demanda do material em inglês (o ponto forte da capacidade multilíngue da OpenAI).

- Gera o material chave via API de encaminhamento oficial da APIYI apiyi.com (

gpt-image-2, alta qualidade). - Usa OCR doméstico para verificar a precisão do texto como controle de qualidade.

- Faz ajustes finos pela equipe local, se necessário, reduzindo o tempo de trabalho em mais de 80%.

Setor de Publicação/Educação/Ciência

Cenários-chave:

- Ilustrações para artigos científicos (com terminologia técnica em chinês).

- Ilustrações para materiais didáticos (com fórmulas e rótulos de gráficos em chinês).

- Ilustrações de publicações (incluindo fontes de literatura clássica).

Valor especial: Estes cenários foram totalmente negligenciados por modelos de IA anteriores — a "publicação educacional" não era prioridade de treinamento. Mas a precisão de 99% em caracteres CJK (Chinês, Japonês, Coreano) do GPT-image-2 torna esses cenários "nicho, mas de alta qualidade" comercialmente viáveis pela primeira vez.

Blogueiros de Tecnologia/Autores de Tutoriais de IA

Janela de oportunidade: Os meses de abril a junho continuam sendo uma janela de "assimetria de informação" — muitos usuários chineses ainda não conhecem essa diferença. Produzir tutoriais em chinês sobre o GPT-image-2 ainda pode render um tráfego alto.

Sugestão de conteúdo: Em vez de fazer algo genérico como "O que é o GPT-image-2", foque em conteúdos verticais, como "Biblioteca de comandos para GPT-image-2 em chinês" ou "Como recriar cartazes de estilo XX usando GPT-image-2". O teto de tráfego para esse tipo de conteúdo é muito mais alto.

🎯 Sugestão de ação concentrada: Não importa o seu perfil, o primeiro passo de menor custo é: registre uma conta na APIYI apiyi.com → gere 50-100 imagens de teste com o

gpt-image-2-all(cerca de ¥10-20) → encontre 3-5 comandos estáveis → integre ao seu fluxo de trabalho principal. Este processo de validação pode ser concluído em 1 semana, com custo baixíssimo, permitindo que você capture a onda principal do Q2-Q3 de 2026.

Por que o GPT-image-2 é muito mais popular que o 1.5? Perguntas Frequentes

Q1: A renderização de chinês do GPT-image-2 tem realmente 99% de precisão?

Em testes do LM Arena, a precisão ao nível de caractere do GPT-image-2 em caracteres CJK é de cerca de 99%. Mas isso é em nível de caractere (se o caractere individual foi desenhado corretamente), não 100%. Ainda ocorrem erros em cenários extremos: 1) Textos minúsculos abaixo de 5pt; 2) Caracteres técnicos raros (textos clássicos, nomes próprios incomuns); 3) Conflitos complexos de layout (sobreposição de texto e imagem). Títulos, subtítulos, preços e datas comuns de 8pt ou mais geralmente não apresentam erros. Recomenda-se testar seu cenário específico com baixo custo via gpt-image-2-all da APIYI apiyi.com antes de decidir.

Q2: A renderização de chinês do GPT Image 1.5 é realmente inutilizável?

Não é "totalmente inutilizável", mas é "pouco confiável". A taxa de acerto em textos curtos (3-6 caracteres) é de cerca de 70-80%, o que significa que a cada 5 imagens, 1 ou 2 precisarão ser refeitas ou corrigidas no Photoshop. Para uso pessoal ocasional, é aceitável, mas para produção comercial em escala, é um defeito fatal — significa uma taxa de desperdício de 20% e horas de edição dispendiosas. É por isso que, na era do 1.5, os criadores chineses tiveram dificuldade em adotá-lo no fluxo de trabalho.

Q3: Modelos nacionais de IA não são melhores em chinês?

Modelos nacionais (como Jimeng, Kling, CogView, etc.) realmente oferecem bom suporte ao chinês, com alguns indicadores se aproximando do GPT-image-2. No entanto, considerando as quatro dimensões: "precisão do texto + qualidade de imagem geral + capacidade de raciocínio + mistura multilíngue", o GPT-image-2 ainda é o mais completo em abril de 2026. Recomendação: 1) Modelos nacionais são adequados para cenários puramente em chinês; 2) GPT-image-2 é adequado para cenários com mistura de chinês e inglês, terminologia técnica e necessidade de alta qualidade geral.

Q4: Uma boa renderização de caracteres chineses é suficiente para viralizar na China?

Não necessariamente; é uma condição necessária, mas não suficiente. Além da renderização, é preciso: 1) Baixa barreira de acesso (acessível na China); 2) Preço razoável (acessível individualmente); 3) Alguém influente na comunidade no início. O GPT-image-2 explodiu em abril devido à combinação de fatores: efeito de marca da OpenAI + LM Arena + 242 Elo + acesso rápido via plataformas proxy como a APIYI (US$ 0,03/imagem).

Q5: Como um criador individual pode usar a capacidade em chinês do GPT-image-2 o mais rápido possível?

Existem 3 caminhos, do mais simples ao mais avançado: 1) Usar diretamente a ferramenta online imagen.apiyi.com (sem código, acessível na China, interface em chinês); 2) Assinar o ChatGPT Plus por US$ 20/mês (exige conta e rede estrangeira); 3) Integrar via API da APIYI apiyi.com usando o modelo gpt-image-2-all a US$ 0,03 por imagem gerada. Sugiro usar a ferramenta online para ajustar o comando e, após a aprovação, usar a API para produção em lote.

Q6: Essa observação perderá a validade com o tempo?

Sim. O momento atual (abril de 2026) é uma janela de transição de três variáveis: "ferramenta + modelo + plataforma". A hipótese de que a "fidelidade dos caracteres chineses é o gargalo da viralização" deverá enfraquecer quando: 1) Modelos nacionais igualarem a precisão em 99% (previsto em 6-12 meses); 2) Usuários chineses se dessensibilizarem à IA, diminuindo a novidade (previsto em 1-2 anos); 3) Surgirem novos formatos de transmissão (vídeos curtos, AR, etc.). No entanto, entre abril e dezembro de 2026, a hipótese provavelmente continuará válida.

Q7: Existe um guia de erros comuns ao fazer cartazes em chinês com o GPT-image-2?

3 erros comuns: 1) Textos críticos devem estar entre aspas: title: "Promoção de Primavera" em vez de title: Promoção de Primavera; 2) Caracteres com traços complexos (ex: nomes de pessoas) devem ser gerados em lotes de 4 para escolher o melhor, pois a taxa de erro unitária ainda é de 5-10%; 3) Ao misturar chinês e inglês, especifique explicitamente o estilo da fonte (Chinese: 思源宋体 style, English: Helvetica style) para evitar conflitos de espaçamento. Recomendo usar a plataforma APIYI apiyi.com para testar com baixo custo e encontrar o comando estável antes da produção em massa.

Q8: Como posso verificar a veracidade da opinião apresentada neste artigo?

Existem 3 métodos de verificação: 1) Verificação de dados: Analise dados de conteúdo relacionados a "GPT-image-2" no Xiaohongshu/Weibo/Bilibili desde abril e compare com a curva de propagação de tópicos semelhantes da era 1.5; 2) Experimento controlado: Use o mesmo comando para gerar 50 cartazes em chinês no GPT-image-2, 1.5 e Nano Banana Pro, e peça para 100 usuários comuns pontuarem anonimamente; 3) Entrevista com criadores: Entreviste 30 criadores chineses que usaram ambas as gerações de modelos e registre as mudanças em seus fluxos de trabalho. Esses métodos podem ser facilmente estruturados usando o acesso unificado a múltiplos modelos da APIYI apiyi.com.

Por que o GPT-image-2 está muito mais popular que o 1.5? Principais conclusões

- Indicadores cruciais de salto geracional: O GPT-image-2 elevou a renderização de caracteres CJK de "pouco confiável" (~80%) na versão 1.5 para 99% de precisão em nível de caractere, marcando o maior salto no campo de geração de imagens por IA nos últimos 12 meses.

- A influência dos veículos de comunicação chineses: Xiaohongshu, contas oficiais do WeChat, figurinhas (stickers) e páginas de detalhes de produtos de e-commerce — os principais meios de disseminação na internet chinesa dependem de imagens com texto. Por isso, a "renderização de caracteres chineses" é a barreira fundamental para a popularização nesse meio.

- Os gargalos do fluxo de trabalho na era 1.5: Os criadores de conteúdo chineses precisavam processar textos via Photoshop, o que rebaixava a IA de "ferramenta principal" para "auxiliar", tornando inviável a inclusão no dia a dia produtivo.

- O 2.0 resolveu três impasses técnicos: Raciocínio da série O + expansão de dados de treinamento CJK + mecanismo de renderização em nível de caractere. A combinação desses três fatores formou a base fundamental para os 99% de precisão.

- Os sucessos de abril não são apenas marketing: Quatro formas de sucesso estão em alta: reprodução de cartazes em chinês, fábricas de figurinhas, cartazes comerciais práticos e aplicações reversas por marcas que buscam o mercado externo.

- Os limites da premissa: A "fidelidade do caractere chinês = porta de entrada para a propagação" é uma condição necessária, mas não suficiente. Ainda são necessários fatores como marca, preço e plataforma. O Nano Banana Pro também suporta CJK, mas seu alcance foi menor que o do GPT-image-2, servindo como um contraexemplo.

- A janela de oportunidade é agora: Espera-se que os modelos nacionais alcancem esse patamar em 6 a 12 meses; integrar-se o quanto antes é uma das oportunidades de conteúdo mais certeiras para 2026.

- Forma de verificação de baixo custo: A plataforma APIYI (apiyi.com) oferece o

gpt-image-2-allpor $0,03/imagem. Testar com 10 imagens custa apenas ¥2,10, o suficiente para validar se a diferença é real.

Resumo

Voltando à pergunta inicial: "Por que o GPT-image-2 é muito mais popular que o 1.5?"

A resposta mais simples é: porque ele ultrapassou a barreira da "fidelidade do caractere chinês" no mundo sinófono. Na era 1.5, a geração de imagens por IA já era popular no mundo anglófono, mas o público chinês estava travado na impossibilidade de usar caracteres chineses. Com a renderização de 99% de precisão no 2.0, o fluxo de trabalho de todo um grupo de criadores finalmente fluiu, e a corrente de propagação foi acesa.

Esta não é uma história isolada de "iteração de modelo", mas um caso de como um indicador técnico específico (precisão CJK de ~80% para ~99%) alavancou um ecossistema específico (veículos de propagação na internet chinesa). Compreender essa causalidade permite julgar com mais precisão o potencial de outros modelos de IA no mercado chinês: não olhe para os benchmarks, olhe para os caracteres chineses.

Para criadores de conteúdo, equipes de marketing e operações de e-commerce em 2026, a decisão de "adotar ou não o GPT-image-2" não é mais sobre "usar IA ou não", mas sim sobre "não usar agora = perder a onda". Recomendamos verificar imediatamente o desempenho em seu cenário específico através da plataforma APIYI (apiyi.com) com o menor custo possível ($0,03/imagem) e, com base em dados reais, decidir se deve integrá-lo ao seu fluxo de trabalho principal.

Por fim, uma nota do autor: estas observações são um registro de fenômenos e uma análise de causas de abril de 2026, e não necessariamente uma verdade absoluta. Convido mais criadores a complementar, corrigir ou até mesmo refutar essas ideias com base em seus próprios testes.

Referências

-

Comunicado oficial do OpenAI ChatGPT Images 2.0: Notas de lançamento do GPT-image-2

- Link:

openai.com/index/introducing-chatgpt-images-2-0 - Descrição: Documento oficial sobre a precisão de 99% em textos multilíngues

- Link:

-

Leaderboard de texto para imagem do LM Arena: Ranking Elo de modelos

- Link:

arena.ai/leaderboard/text-to-image - Descrição: GPT-image-2 com 1512 Elo · Verificação de precisão em nível de caractere

- Link:

-

Relatório do TechCrunch de 21 de abril: ChatGPT's new Images 2.0 model is surprisingly good at generating text

- Link:

techcrunch.com/2026/04/21/chatgpts-new-images-2-0-model-is-surprisingly-good-at-generating-text - Descrição: Cobertura inicial da grande mídia de tecnologia em 24 horas

- Link:

-

The New Stack – OpenAI now thinks before it draws: Relatório aprofundado sobre mecanismos de raciocínio

- Link:

thenewstack.io/chatgpt-images-20-openai - Descrição: Análise do papel do raciocínio da série O na renderização de caracteres chineses

- Link:

-

Documentação técnica de tokenização CJK: Por que LLMs têm dificuldade com chinês há tanto tempo

- Link:

tonybaloney.github.io/posts/cjk-chinese-japanese-korean-llm-ai-best-practices.html - Descrição: Desafios técnicos fundamentais no processamento CJK

- Link:

-

Plataforma APIYI: Integração nacional do GPT-image-2

- Link:

apiyi.com - Descrição: API de encaminhamento oficial + serviço proxy de API (gpt-image-2-all $0,03/imagem)

- Link:

Autor: Equipe técnica da APIYI | Para experimentar a capacidade de renderização de chinês do GPT-image-2, acesse a APIYI em apiyi.com, registre-se para ganhar saldo de teste, ou faça um teste online em imagen.apiyi.com (acesso direto disponível no país).