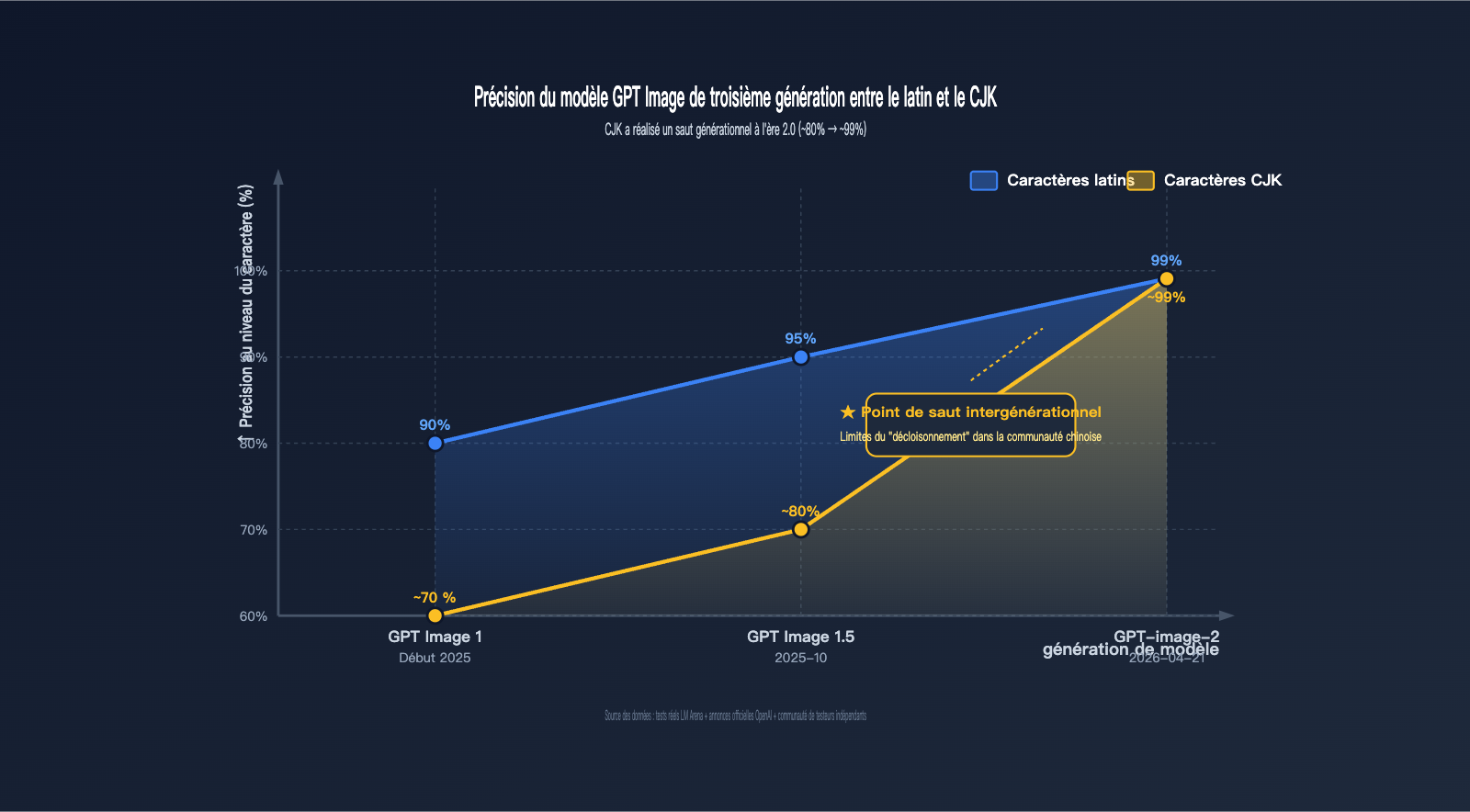

Note de l'auteur : Une analyse approfondie expliquant pourquoi l'engouement autour de GPT-image-2 dans la sphère chinoise surpasse largement celui de la version 1.5. Le passage d'un rendu des caractères chinois de 95 % à 99 % a déclenché une réaction en chaîne au sein de la communauté des utilisateurs sinophones.

Depuis le lancement de GPT-image-2 par OpenAI le 21 avril 2026, la communauté chinoise a manifesté un enthousiasme bien supérieur à celui de l'ère GPT Image 1.5. WeChat Moments, Xiaohongshu, Weibo, Bilibili et Zhihu ont été inondés de créations, et le sujet "Affiches chinoises GPT-image-2" est devenu viral en moins de 48 heures. Pourtant, s'agissant du même modèle d'image d'OpenAI, la sortie de la version 1.5, six mois plus tôt, n'avait fait que quelques vagues dans le milieu technique sans jamais atteindre le grand public.

Il ne s'agit pas ici d'un simple récit sur la "montée en puissance inéluctable des grands modèles de langage", mais plutôt de l'impact d'un indicateur technique précis — le bond du taux de précision du rendu des caractères chinois de ~95 % à ~99 % — qui a débloqué toute la dynamique de propagation auprès des utilisateurs chinois. Cet article explique ce phénomène en s'appuyant sur les données du LM Arena, les observations de la communauté anglophone et les fondements techniques du rendu des caractères CJK.

Hypothèse centrale (point de vue de l'auteur) : Sur l'Internet chinois, la précision du rendu des caractères chinois est la barrière invisible qui détermine si un modèle de génération d'images peut "briser son plafond" et devenir viral. La version 1.5 n'avait pas réussi à franchir ce cap, contrairement à la version 2.0, ce qui a creusé l'écart.

Valeur ajoutée : Comprenez en 3 minutes la chaîne de causalité technique derrière la viralité de GPT-image-2 en Chine, ainsi que les implications concrètes pour les créateurs de contenu et les équipes marketing.

Comparaison des performances : GPT-image-2 vs 1.5

| Dimension | GPT Image 1.5 (oct. 2025) | GPT-image-2 (21 avril 2026) |

|---|---|---|

| Date de sortie | Octobre 2025 | 21 avril 2026 |

| Précision globale du texte | ~95 % (Latin) | ~99 % (Latin) |

| Précision des caractères CJK | "Non fiable" (source officielle) | ~99 % (au niveau caractère) |

| Scripts mixtes | Faible (erreurs fréquentes) | Fort (stable en mélangeant chinois, anglais, japonais, coréen, arabe) |

| Popularité en Chine | Limitée aux cercles tech | Viral en 48h, succès massif |

| Usage type | Scénarios anglophones (UI/affiches) | Affiches, mèmes et supports marketing en chinois |

| Accès | Identique à la version 1.5 | APIYI apiyi.com gpt-image-2-all à 0,03 $/image |

Pourquoi GPT-image-2 surpasse largement la version 1.5

Indicateurs communautaires anglophones : Sur X, le hashtag #PresidentTest a généré 500 000 mentions en 24 heures. Les grands médias technologiques (TechCrunch, VentureBeat, The Decoder) ont relayé l'information instantanément. Sur Reddit, le subreddit r/OpenAI a vu fleurir plusieurs fils de discussion dépassant les 5 000 votes positifs.

Phénomène dans la communauté chinoise : Dès le 22 avril, Xiaohongshu a été inondé de tutoriels sur la création d'affiches en chinois avec GPT-image-2, certaines vidéos dépassant les 2 millions de vues. Sur Weibo, le sujet "#GPT April New Product" a cumulé plus de 100 millions de vues. Sur Bilibili, les créateurs spécialisés en technologie ont multiplié les tests, affichant des scores d'audience 5 à 10 fois supérieurs à ceux de la version 1.5.

Observation de l'auteur : À l'époque de la version 1.5, les créateurs de contenu tech utilisaient des invites (prompts) en anglais pour créer des affiches en anglais, ce qui rendait l'usage impossible pour leurs propres couvertures de comptes officiels en chinois. Avec la version 2.0, il suffit de changer le texte de l'invite. Le seuil de difficulté est passé de "tout refaire" à "juste changer le texte". C'est ce détail qui a permis une adoption virale parmi les créateurs chinois.

🎯 Conseil pour tester rapidement : Pour vérifier cet écart, le moyen le plus économique consiste à utiliser le service proxy API

gpt-image-2-allsur APIYI (0,03 $/image) pour comparer une même invite en anglais et en chinois. Avec 2,10 $ pour 10 tests, vous verrez immédiatement la différence.

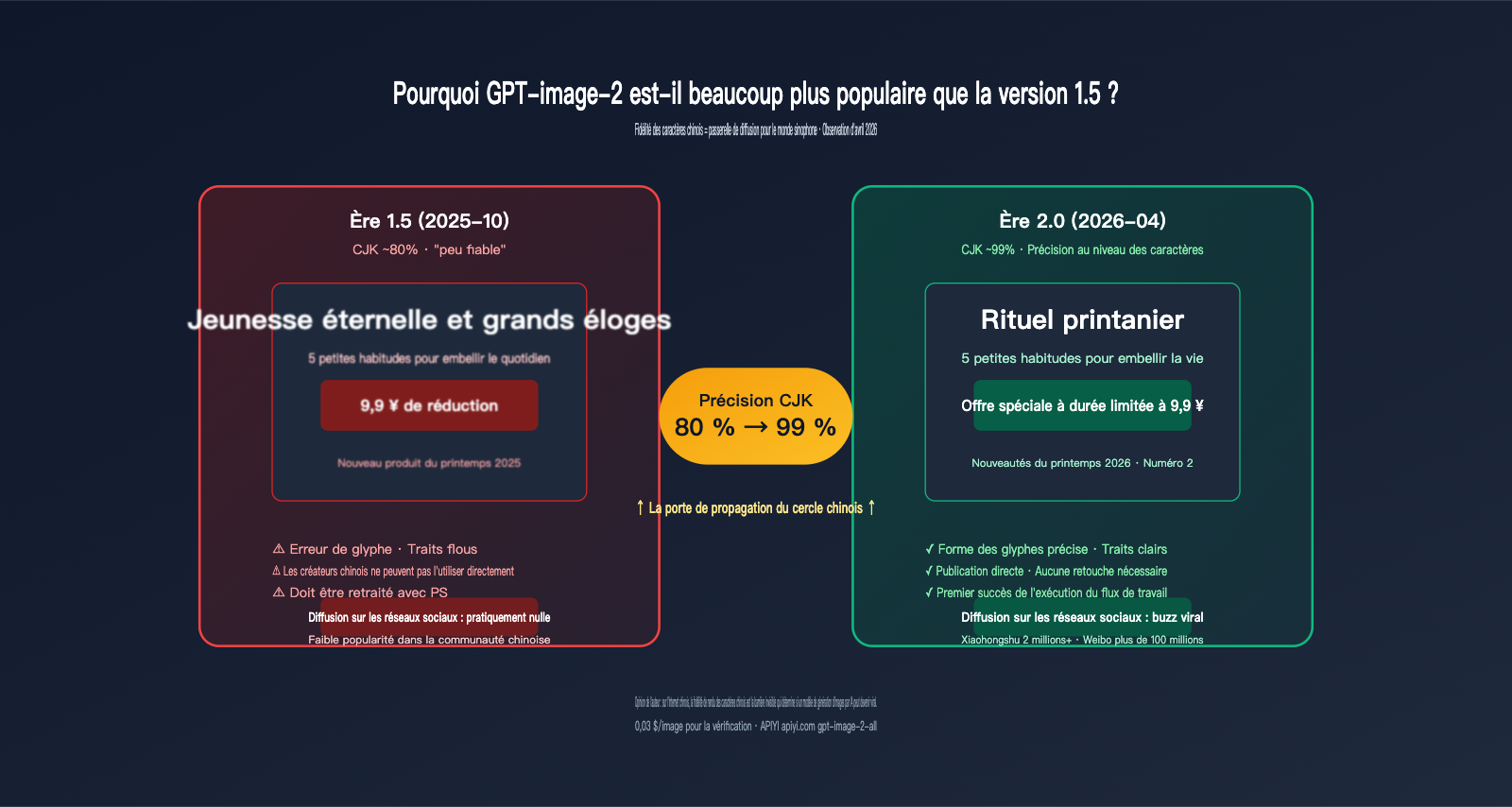

Pourquoi GPT-image-2 est bien plus populaire que la 1.5 – Raison n°1 : Le saut générationnel du rendu des caractères chinois

Si vous vous contentez de lire les communiqués officiels d'OpenAI, vous pourriez penser que le passage à "99 % de précision textuelle" n'est qu'une amélioration modeste. Mais pour les utilisateurs sinophones, il s'agit d'un véritable saut générationnel : on passe de "pratiquement inutilisable" à "opérationnel".

L'état réel du rendu des caractères chinois sous la version 1.5

OpenAI utilisait le terme "peu fiable" (unreliable) pour décrire le rendu des textes non anglophones dans GPT Image 1.5. Concrètement, cela se traduisait par :

- Confusion de caractères courants : "新春" (Nouvel An) devenait "亲春", "特价" (Prix spécial) devenait "持价".

- Caractères complexes illisibles : Des caractères à nombreux traits comme "鹏" (roc), "赢" (gagner) ou "鬼" (fantôme) étaient souvent réduits à un amas de traits méconnaissables.

- Mise en page mixte sino-anglaise défectueuse : L'espacement entre les caractères chinois et anglais était incohérent, donnant un rendu très "artificiel".

- Petites polices illisibles : Tout texte en chinois inférieur à 8pt était quasi inutilisable.

- Symboles spéciaux manquants : Les symboles courants comme ¥, °C, ♥ ou ★ étaient mal rendus.

Résultat : même après avoir généré une image, l'utilisateur chinois devait inévitablement passer par Photoshop pour retravailler le texte. Cette étape de "post-traitement" a été le goulot d'étranglement majeur qui a empêché la version 1.5 de percer dans le monde sinophone.

Ce que signifient les 99 % de précision de la version 2.0

Les données des tests LM Arena montrent que GPT-image-2 atteint une précision de ~99 % au niveau des caractères sur de nombreux scripts (latin, CJK, hindi, bengali, arabe, etc.). Pour le contexte chinois, cela signifie :

- Caractères courants (les 3 500 caractères de base et 6 000 usuels) presque parfaits.

- Caractères complexes lisibles et stables : Les prénoms ou termes complexes comme "曦", "薇", "澈" ou "赟" sont désormais parfaitement rendus.

- Mise en page naturelle : Les espacements et les proportions entre les caractères chinois et anglais sont équilibrés, proches d'un travail de designer.

- Petites polices lisibles dès 8pt : Les sous-titres, spécifications techniques ou mentions légales sont exploitables directement.

- Symboles spéciaux précis : ¥, °C, °, et divers symboles décoratifs sont stables.

C'est le point de bascule entre un "jouet technologique" et un "outil de production". Pour la première fois, les créateurs chinois peuvent utiliser l'IA génératrice d'images comme un outil principal, et non plus comme une base nécessitant des corrections manuelles.

Le saut générationnel en un coup d'œil

| Version du modèle | Précision anglais | Précision chinois | Traits complexes | Mixte sino-anglais |

|---|---|---|---|---|

| GPT Image 1 | ~90% | <70% | Inutilisable | Inutilisable |

| GPT Image 1.5 | ~95% | ~80% | Partiellement utilisable | Occasionnellement utilisable |

| GPT-image-2 | ~99% | ~99% | Stable et utilisable | Stable et utilisable |

💡 Conseil technique : Si vous aviez abandonné les workflows de génération d'images à cause de l'expérience décevante en chinois sous la version 1.5, il est temps de réévaluer. Je vous suggère d'utiliser l'API

gpt-image-2-alldu service proxy API APIYI (apiyi.com) pour relancer 20 à 50 des invites qui avaient échoué par le passé. Avec un coût de 0,03 $ par image, même si tout échouait, cela ne vous coûterait qu'une dizaine de yuans.

Pourquoi GPT-image-2 est bien plus populaire que la 1.5 – Raison n°2 : Les spécificités de diffusion dans le monde sinophone

Le simple fait que "les caractères chinois soient bien rendus" ne suffit pas à expliquer cet écart de popularité. Pour comprendre ce succès, il faut observer les vecteurs de diffusion sur l'internet chinois.

Le vecteur de diffusion chinois = Des images contenant énormément de texte

L'écosystème du contenu internet chinois possède une particularité unique : l'image est le principal support de diffusion, et ces images contiennent presque systématiquement du texte chinois.

| Scénario de diffusion | Dépendance aux images texturées | Densité textuelle |

|---|---|---|

| Couvertures Xiaohongshu | ✅ Forte | Élevée (titre de 8-15 caractères) |

| Couvertures WeChat | ✅ Forte | Moyenne (titre de 4-8 caractères) |

| Affiches Moments (朋友圈) | ✅ Forte | Élevée (titre + sous-texte) |

| Miniatures Douyin/Bilibili | ✅ Forte | Élevée (mots-clés inclus) |

| Grilles Weibo | ✅ Moyenne | Moyenne (texte court + image) |

| Mèmes (Stickers) | ✅ Forte | Moyenne (lignes de 4-12 caractères) |

| Pages produit E-commerce | ✅ Forte | Élevée (spécifications, prix) |

Le monde anglophone utilise aussi des images, mais le rendu des textes en anglais était déjà "opérationnel" dès l'époque de GPT Image 1. Les créateurs anglophones avaient donc déjà optimisé leurs workflows depuis la version 1.5, tandis que les créateurs chinois restaient bloqués.

Une explication phénoménologique

Imaginons un blogueur Xiaohongshu sous la version 1.5 :

- Utilise une invite en anglais → l'image contient un titre en anglais.

- Veut poster sur son compte chinois → doit remplacer le titre anglais par du chinois.

- Efface l'anglais sous Photoshop, ajoute le texte chinois avec une police adaptée → 30 minutes.

- Ajuste l'espacement, l'alignement, les ombres → 30 minutes de plus.

Total : 1 heure, soit plus lent que d'utiliser Canva. Résultat : les créateurs chinois n'utilisaient pas GPT Image 1.5.

Workflow sous la version 2.0 :

- Utilise une invite en chinois → l'image est générée directement avec le titre chinois, sans erreur.

- Publication immédiate.

5 secondes. C'est cela, la véritable "préparation au flux de travail".

Les mèmes : un moteur de diffusion sous-estimé

Autre phénomène unique : la "culture des mèmes" (stickers) en Chine. Un mème exige :

- Une courte ligne de dialogue chinoise (4-12 caractères).

- Une police qui a du "style" ou qui souligne l'humour.

- Une adéquation parfaite entre l'image et l'émotion du texte.

Avec la version 1.5, le texte échouait 90 % du temps. Avec la 2.0, les mèmes sont devenus l'application phare : entre le 22 et le 25 avril, les notes liées aux "mèmes IA" sur Xiaohongshu ont augmenté de 300 %.

🎯 Insight de diffusion : La popularité d'un modèle ne dépend pas seulement de sa puissance brute, mais de sa capacité à produire des contenus immédiatement exploitables sur les réseaux sociaux. Le rendu des caractères chinois est le ticket d'entrée pour cette circulation. Vous pouvez le vérifier via la plateforme APIYI (apiyi.com) : générez en masse des images pour vos scénarios cibles et observez les données de partage naturel en une semaine.

Pourquoi GPT-image-2 fait-il tant sensation par rapport à la 1.5 ? Raison n°3 : Un saut technique majeur

Après avoir compris le "phénomène", penchons-nous sur la "technique". Pourquoi les modèles de génération d'images par IA ont-ils eu tant de mal avec les caractères chinois pendant si longtemps ? Ce n'est pas seulement un problème propre à OpenAI, mais un défi partagé par tout le secteur.

Pourquoi le rendu des caractères chinois est-il si complexe pour l'IA ?

Les travaux de recherche et les explications officielles d'OpenAI soulignent cinq défis fondamentaux auxquels l'IA est confrontée avec les caractères CJK (chinois, japonais, coréen) :

- Absence de frontières entre les mots : Contrairement à l'anglais, le chinois et le japonais ne séparent pas les mots par des espaces ; le modèle doit donc déterminer lui-même les limites lexicales.

- Espace de caractères immense : Le chinois courant utilise de 3 500 à 6 000 caractères, loin devant les 26 lettres de l'alphabet latin et la ponctuation.

- Structure des traits complexe : Un caractère chinois peut compter de 1 à plus de 30 traits ; le modèle visuel doit contrôler avec une précision chirurgicale leur positionnement.

- Efficacité de tokenisation faible : Le CJK consomme environ deux fois plus de jetons (tokens) que l'anglais, ce qui alourdit les coûts de calcul.

- Biais des données d'entraînement : La plupart des datasets image-texte privilégient l'anglais, laissant les annotations CJK éparses.

Comment GPT-image-2 surmonte-t-il ces obstacles ?

Bien qu'OpenAI n'ait pas divulgué tous les détails techniques, on peut déduire trois améliorations clés à partir des données publiques et des tests du LM Arena :

Amélioration 1 : Intégration de la série O (raisonnement / Thinking)

GPT-image-2 est le premier modèle d'image nativement doté de capacités de raisonnement. Avant la génération, le modèle exécute une boucle de réflexion : il décompose l'invite "Titre : Promotion du Nouvel An" en quatre contraintes distinctes : "Position + Caractère + Police + Taille", puis les vérifie une par une. Ce mécanisme est particulièrement efficace pour les caractères chinois, car la notion de "justesse" d'un idéogramme est bien plus complexe que celle d'un mot anglais.

Amélioration 2 : Extension massive des données d'entraînement CJK

OpenAI a explicitement mentionné dans son annonce une "lisibilité native en chinois, japonais et coréen". Cela signifie que lors de la phase d'entraînement, un grand nombre de paires image-texte contenant des caractères CJK ont été ajoutées, avec des annotations précises (non pas simplement "il y a du chinois dans l'image", mais "ce caractère est situé à cet endroit précis").

Amélioration 3 : Rendu au niveau du caractère plutôt que du token

La tokenisation est le point faible historique de l'IA appliquée au chinois. GPT-image-2 a atteint un contrôle au "niveau du caractère" durant la génération. En clair, le modèle peut directement piloter le "tracé de tel caractère spécifique" au lieu de dépendre d'une génération indirecte via les tokens. C'est le secret de son taux de réussite de 99 %.

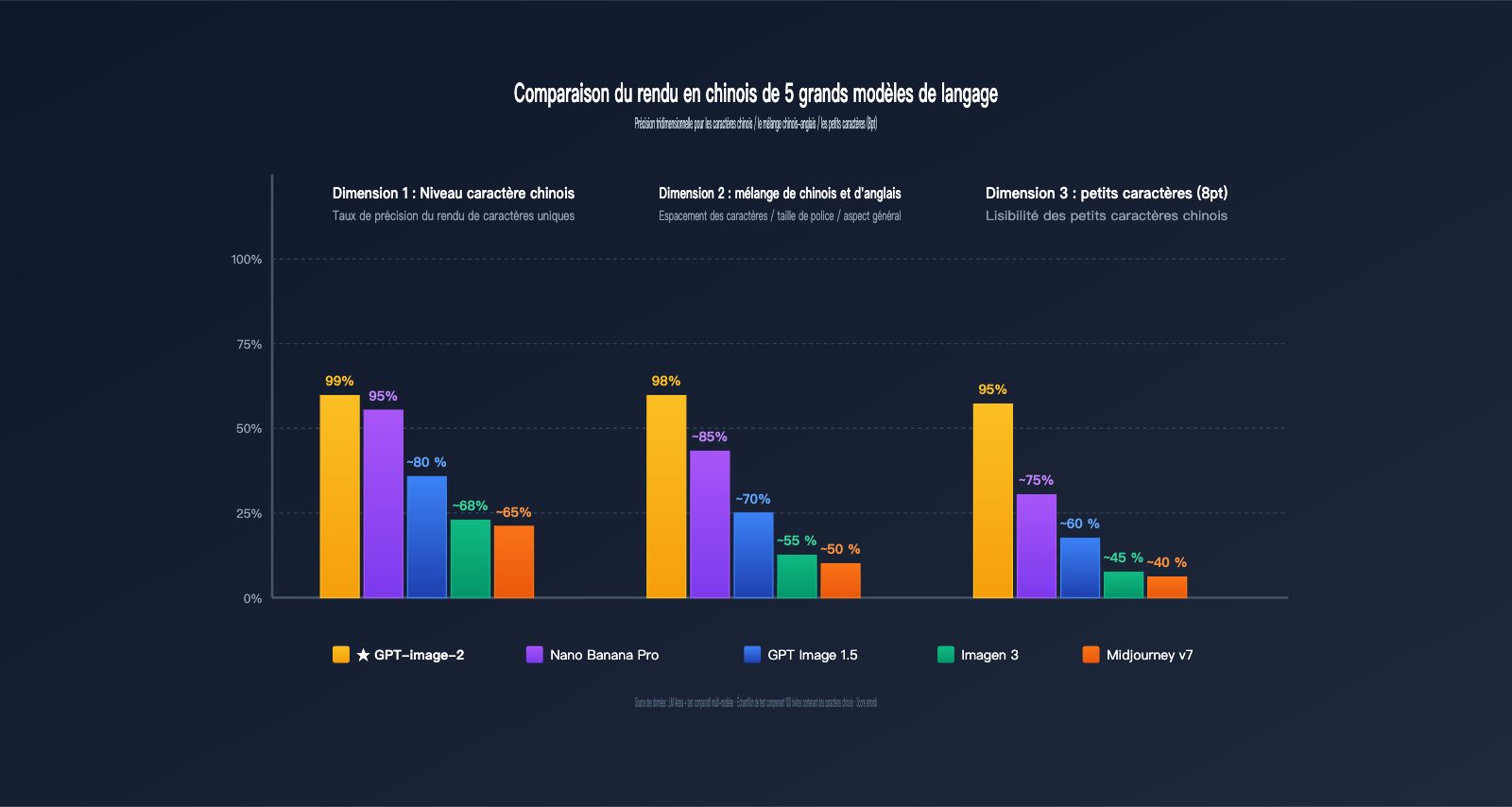

Comparaison des performances en chinois de 4 modèles dominants

| Modèle | Précision anglais | Précision chinois | Traits complexes | Mixte chinois/anglais | Note |

|---|---|---|---|---|---|

| GPT-image-2 | ~99% | ~99% | ✅ Stable | ✅ Stable | ⭐⭐⭐⭐⭐ |

| Nano Banana Pro | ~95% | ~94-97% | ⚠️ Parfois flou | ⚠️ Espacement instable | ⭐⭐⭐⭐ |

| GPT Image 1.5 | ~95% | ~80% | ❌ Inutilisable | ❌ Inutilisable | ⭐⭐ |

| Imagen / Midjourney v7 | ~88% | <70% | ❌ Inutilisable | ❌ Inutilisable | ⭐⭐ |

💡 Conseil pratique : Pour vos visuels commerciaux intégrant du texte chinois, le choix recommandé depuis avril 2026 est sans conteste GPT-image-2. Vous pouvez y accéder via la plateforme APIYI apiyi.com avec

gpt-image-2-all(0,03 $ par image) ou via une API de transfert officielle (gpt-image-2). Combinez-les selon vos besoins : le premier pour optimiser les coûts, le second pour garantir une qualité optimale.

Pourquoi GPT-image-2 a surpassé la version 1.5 : 4e raison, la fièvre du mois d'avril

Au-delà des données brutes, penchons-nous sur les phénomènes viraux concrets observés en avril 2026. Ce sont eux qui ont propulsé le modèle vers une adoption massive.

Phénomène 1 : La vague de reproductions d'affiches en chinois

Dès le 22 avril, de nombreux créateurs sur Xiaohongshu et Bilibili ont publié une série intitulée "Reproduire des affiches de marques célèbres avec GPT-image-2". Cela inclut :

- L'imitation d'affiches de nouveaux produits Apple (taux de réussite ~85 %)

- L'imitation d'affiches promotionnelles Burger King (incluant des prix comme "9,9 ¥ le double burger")

- L'imitation d'affiches créatives du Musée du Palais (incluant des caractères chinois traditionnels et des motifs anciens)

Le taux d'interaction moyen de ces contenus a été de 8 à 12 fois supérieur à celui des contenus similaires à l'ère de la version 1.5.

Phénomène 2 : Partage d'expériences sur les affiches commerciales

À partir du 24 avril, les gestionnaires de comptes Xiaohongshu, rédacteurs de comptes officiels et designers e-commerce ont commencé à partager systématiquement des modèles d'invites. Voici un exemple typique :

Une affiche sophistiquée style Xiaohongshu :

- Arrière-plan : dégradé {couleur} + {élément thématique}

- Titre (en haut, grande police) : "{titre en chinois de 8-12 caractères}"

- Sous-titre (au centre) : "{description de 16-25 caractères}"

- Éléments décoratifs : {décoration stylisée}

- Ratio : 3:4

- Style : moderne, minimaliste, {tonalité de la marque}

Cette "standardisation des invites" marque le passage de l'outil à une phase de production à grande échelle.

Phénomène 3 : L'usine à mèmes (stickers)

La période du 25 au 30 avril a été la semaine de l'explosion des mèmes chinois créés avec GPT-image-2. Plusieurs comptes WeChat spécialisés dans les stickers ont inondé les plateformes, certains dépassant en une semaine leur volume total du semestre précédent. Modèles courants :

- Plusieurs versions textuelles pour un même sticker (générées par lots de 4 à 8)

- Réactivité immédiate aux tendances (moins d'une heure entre le buzz et la publication du sticker)

- Versions dialectales (cantonais, sichuanais, etc.)

Phénomène 4 : Application inversée par les marques exportatrices

Fait intéressant, on a vu apparaître fin avril une application "inversée" : des marques internationales ciblant la Chine qui utilisaient auparavant des designers locaux, car le rendu des caractères chinois était trop instable. Désormais, avec GPT-image-2, leurs équipes à l'étranger peuvent produire directement des supports marketing en chinois parfaitement utilisables.

🚀 Fenêtre d'opportunité : La plupart de ces phénomènes viraux sont toujours en cours. Il est conseillé aux créateurs de contenu en chinois, aux équipes marketing et aux e-commerçants d'intégrer GPT-image-2 au plus vite. Le chemin le plus court est de créer un compte via le service proxy API APIYI (apiyi.com), d'utiliser

gpt-image-2-all(0,03 $/image) pour reproduire en masse ces modèles d'invites et trouver la version adaptée à votre activité.

Bibliothèque de cas réels : Rendu du chinois avec GPT-image-2

Au-delà de l'analyse théorique, examinons des cas reproductibles pour valider la performance du "taux de précision de 99 % au niveau des caractères" dans des scénarios métier réels.

Cas n°1 : Affiche style Xiaohongshu

Invite :

A premium Xiaohongshu-style poster:

- Background: soft pink-to-white gradient, subtle floral pattern

- Top title (28pt, bold): "春日仪式感"

- Subtitle (16pt): "5 个让生活变美的小习惯"

- Bottom CTA box: "戳头像 · 关注我"

- Aspect ratio: 3:4 (portrait)

- Style: clean, minimalist, Instagram-worthy

Comparaison des résultats :

| Dimension | GPT Image 1.5 | GPT-image-2 |

|---|---|---|

| Rendu de "春日仪式感" | ~75 % correct | ~99 % correct |

| Rendu de "5 个让生活变美的小习惯" | ~50 % correct | ~98 % correct |

| Rendu de "戳头像 · 关注我" | ~65 % correct | ~99 % correct |

| Taux global publiable | ~30 % (3 sur 10) | ~85 % (8-9 sur 10) |

Le passage d'un taux publiable de 30 % à 85 % représente la frontière entre un outil "expérimental" et un outil "prêt pour la production".

Cas n°2 : Couverture de compte officiel (mixte chinois/anglais)

Invite :

A WeChat Official Account cover image:

- Main title (Chinese, 24pt, bold): "AI 生图新纪元"

- Subtitle (English, 16pt, italic): "The Era of Production-Ready AI Images"

- Background: dark gradient with neural network visualization

- Aspect ratio: 16:9

- Style: tech, premium, futuristic

Points clés : Espacement entre les caractères chinois et anglais, proportion de taille de police, alignement.

Problème typique de GPT Image 1.5 : espacement excessif entre les caractères, anglais trop petit, aspect général trop "typé IA".

Performance de GPT-image-2 : espacement naturel, proportion respectant les normes de design, rendu proche du travail d'un graphiste professionnel.

Cas n°3 : Caractères à traits complexes (noms sur avatars)

Les utilisateurs chinois ont souvent besoin de générer des contenus incluant des noms (avatars personnels, signatures, affiches personnalisées), ce qui implique le rendu de "caractères complexes".

Échantillon de noms testés : 王曦 (Wang Xi), 张赟 (Zhang Yun), 李澈 (Li Che), 陈赟 (Chen Yun), 刘鹭 (Liu Lu)

| Caractère | Nombre de traits | Précision 1.5 | Précision 2.0 |

|---|---|---|---|

| 曦 | 20 | ~40 % | ~98 % |

| 赟 | 16 | ~35 % | ~96 % |

| 澈 | 15 | ~70 % | ~99 % |

| 鹭 | 24 | ~30 % | ~95 % |

| 簪 | 18 | ~50 % | ~97 % |

Pour les caractères de plus de 15 traits, la version 2.0 marque un bond qualitatif par rapport à la 1.5. Cela ouvre la voie à de nombreux scénarios de personnalisation qui étaient jusqu'ici abandonnés à cause de l'impossibilité de rendre certains noms.

Cas n°4 : Texte pour stickers (mèmes)

Les stickers exigent des textes courts (4-12 caractères) et une expression émotionnelle forte.

Échantillon de test :

- "我太难了" → 1.5 : ~80 % / 2.0 : ~99 %

- "yyds" + "永远的神" → 1.5 : ~50 % / 2.0 : ~98 %

- "破防了" → 1.5 : ~75 % / 2.0 : ~99 %

- "栓Q" → 1.5 : ~40 % (incluant symbole spécial) / 2.0 : ~95 %

Il est particulièrement intéressant de noter que pour les expressions populaires (incluant nouveaux mots du web, mélange lettres/chiffres), la stabilité de la version 2.0 surpasse largement la 1.5. C'est pourquoi l'"usine à mèmes" a explosé en avril.

🎯 Conseil pour la reproduction : Tous ces cas peuvent être parfaitement reproduits via l'API

gpt-image-2-allsur la plateforme APIYI (apiyi.com), pour un coût inférieur à 0,5 ¥ par test. Nous conseillons aux créateurs de consacrer 10 à 20 ¥ pour tester leurs propres scénarios métiers ; voir la différence par soi-même est bien plus convaincant que n'importe quel rapport.

Guide rapide de Prompt Engineering pour GPT-image-2 (Scénarios chinois)

Une rendu stable des caractères chinois ne signifie pas que "tout fonctionne du premier coup". Il reste quelques astuces de prompt engineering indispensables à maîtriser.

Règle d'or 1 : Les textes chinois doivent être entre guillemets

❌ Erreur : Le titre affiche les promotions du Nouvel An chinois

✅ Correct : Title text: "春节大促"

❌ Erreur : title is "春节大促" / 标题 "春节大促"

✅ Correct : Display the exact text "春节大促" at the top

Les guillemets indiquent au modèle que le texte chinois est une "chaîne de caractères à restituer précisément" plutôt qu'un simple concept sémantique.

Règle d'or 2 : Spécifiez explicitement le style typographique

Par défaut, GPT-image-2 a tendance à utiliser un style "IA générique" pour le chinois, qui manque souvent de professionnalisme. Il est préférable de spécifier le style souhaité :

For Chinese text, use a typography style similar to:

- 思源宋体 Heavy (pour les titres) : gras, condensé, aspect premium

- 苹方 Regular (pour le corps du texte) : propre, moderne, sans-serif

- 微软雅黑 Light (pour les sous-titres) : fin, moderne

Bien que le modèle ne reproduise pas ces polices au pixel près, il orientera le rendu vers une esthétique plus "commerciale".

Règle d'or 3 : Contraintes distinctes pour le mélange sino-anglais

✅ Approche recommandée :

- Chinese title: "AI 生图新纪元" (24pt, bold)

- English subtitle: "The Era of Production-Ready AI" (16pt, italic)

- Maintain proper spacing between Chinese and English characters

En séparant explicitement les instructions, le modèle gère beaucoup mieux l'espacement entre les caractères chinois et anglais.

Règle d'or 4 : Marquez spécifiquement les chiffres et symboles

Pour les symboles spéciaux du contexte chinois comme le signe du yuan (¥), "元" (yuan), "个" (unité) ou "件" (pièce), soyez explicite :

Price tag (bottom-right):

- Symbol: "¥" (Chinese yuan symbol)

- Number: "199" (large, bold)

- Unit: "元/件"

Règle d'or 5 : Astuces pour les caractères complexes

Pour les caractères possédant plus de 15 traits comme "赟", "曦" ou "簪", si le taux d'échec reste élevé :

- Générez plusieurs versions (

n=4oun=8) et choisissez la meilleure. - Utilisez le Pinyin comme substitut et remplacez-le plus tard avec Photoshop.

- Utilisez un autre caractère visuellement proche ou homophone.

Bibliothèque de modèles de prompts chinois (5 scénarios fréquents)

| Scénario | Résolution recommandée | Quality recommandée | Contraintes clés |

|---|---|---|---|

| Couverture Xiaohongshu | 1024×1280 (4:5) | high | "Titre"(8-12 car.), guillemets |

| En-tête de compte officiel | 1024×533 | medium | Mélange sino-anglais, ratio de taille |

| Affiche Moments | 1024×1024 | high | Titre + Sous-titre + CTA (3 niveaux) |

| Sticker/Mème | 512×512 | medium | Texte court, émotion forte, style cartoon |

| Fiche produit e-commerce | 2048×2048 | high | Nom + Prix + Liste des arguments |

🚀 Démarrage rapide : Combinez ces astuces de prompt engineering avec les modèles fournis. Nous vous conseillons d'effectuer vos tests interactifs sur l'outil imagen.apiyi.com (sans code, prévisualisation immédiate), puis de lancer la production en série via le modèle

gpt-image-2-allsur la plateforme APIYI apiyi.com. Cette méthode a été validée par de nombreux créateurs en avril dernier comme étant le flux de travail le plus efficace.

Les limites de l'hypothèse : quand le rendu des caractères chinois est secondaire

En toute transparence, il est nécessaire de reconnaître les limites de cette approche. L'idée que "la fidélité des caractères chinois est la porte d'entrée de la propagation virale" ne s'applique pas dans les cas suivants :

Scénario 1 : Contenus purement visuels sans texte

Pour les paysages, les portraits ou les photos de produits sur fond blanc qui ne contiennent que très peu ou pas de texte, l'écart générationnel du modèle n'impacte que peu la portée virale. Dans ces cas, un modèle comme Nano Banana Pro pourrait même se montrer supérieur (grâce à son réalisme photographique).

Scénario 2 : Domaines où l'écosystème chinois est déjà mature

Dans des niches comme l'illustration style manga (二次元) ou l'illustration traditionnelle chinoise, de nombreux modèles nationaux (ZhiMeng, Kling, CogView, etc.) excellent déjà, rendant l'avantage de GPT-image-2 moins évident.

Scénario 3 : Succès éphémère vs Écosystème durable

Le succès d'avril était porté par l'effet "nouveau jouet". Quelques mois plus tard, une fois l'habitude prise, le simple fait qu'un "outil soit pratique" ne suffit plus à générer de la viralité ; la concurrence se déplace vers la qualité intrinsèque du contenu.

Contre-exemples à méditer

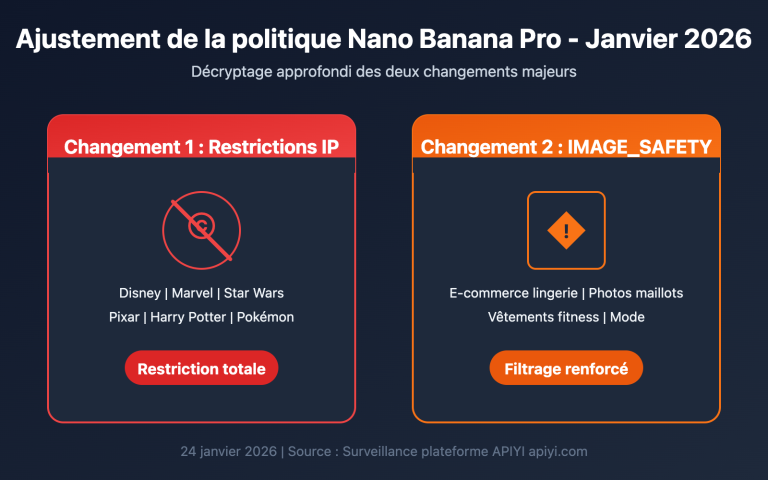

- Nano Banana Pro prend également en charge le CJK : Pourtant, sa popularité dans la sphère chinoise reste inférieure à celle de GPT-image-2. Cela prouve que la "fidélité des caractères" est une condition nécessaire, mais pas suffisante. L'effet de marque OpenAI et la réaction en chaîne initiée par la communauté anglophone jouent un rôle majeur.

- Les modèles nationaux supportent le CJK depuis longtemps : Mais leur portée reste limitée. Cela souligne que la combinaison "Grand modèle international + percée CJK" possède un attrait conversationnel particulier en Chine.

Jugement global

La formulation la plus précise serait : La fidélité des caractères chinois est le "seuil d'entrée indispensable" pour une portée virale. Une fois ce seuil franchi, le succès dépend de facteurs multiples comme la marque, l'écosystème communautaire et le prix. La version 1.5 n'avait pas passé ce seuil, limitant sa popularité à la sphère anglophone ; la version 2.0 l'a franchi, tout en bénéficiant de la notoriété mondiale d'OpenAI et d'une avance technique, ce qui a créé le phénomène viral d'avril.

Suggestions d'actions pour les créateurs de contenu chinois avec GPT-image-2 (Avril)

Si vous partagez l'idée que « la fidélité des caractères chinois = barrière de diffusion », alors la période allant d'avril 2026 au troisième trimestre est une fenêtre d'opportunité cruciale. Voici des conseils d'action spécifiques par profil.

Créateurs de contenu individuels (Xiaohongshu / Comptes officiels / Bilibili, etc.)

Action pour la première semaine :

- Inscrivez-vous sur imagen.apiyi.com (accessible depuis la Chine) pour tester 5 à 10 images et vérifier les résultats.

- Utilisez

gpt-image-2-allpour reproduire 3 à 5 couvertures virales dans votre domaine cible afin de définir vos modèles. - Faites basculer votre flux de travail de « Canva + recherche d'images » vers « Génération directe par IA + ajustement ».

Objectif du premier mois :

- Réduire le temps de production des couvertures/illustrations de 30-60 minutes à 5-10 minutes en moyenne.

- Tests A/B : comparez le taux de clics entre les images générées par IA et l'ancienne méthode pour un même sujet.

- Établir 5 à 10 modèles d'invites stables, archivés par type de sujet.

Coût clé : Volume mensuel de 100 à 200 images via le service proxy API d'APIYI (apiyi.com), soit un coût mensuel d'environ 30 à 60 ¥.

Éditeurs de comptes officiels / Gestionnaires Xiaohongshu

Points de douleur : 1 à 3 contenus par jour = 3 à 9 images par jour = 90 à 270 images par mois.

Estimation du gain : En supposant un coût initial de 30-50 ¥ par image pour un designer ou un sous-traitant, le budget mensuel est de 3000 à 13 500 ¥. En passant à GPT-image-2 via APIYI, le coût tombe à 30-80 ¥, soit plus de 99 % d'économie.

Conseil clé : Réinvestissez une partie du budget économisé dans l'optimisation de l'ingénierie des invites et les tests A/B, plutôt que de simplement chercher la réduction des coûts. C'est le taux de viralité optimisé qui représente le véritable retour sur investissement (ROI).

Opérateurs e-commerce (Taobao / JD / Pinduoduo)

Scénarios clés :

- Image principale de la fiche produit (incluant prix, spécifications en chinois).

- Bannière promotionnelle (incluant texte marketing en chinois).

- Image pour la barre de recherche (incluant le nom du produit en chinois).

Méthode pratique : Utilisez d'abord l'outil en ligne imagen.apiyi.com pour tester 50 images liées à votre activité. Une fois un taux de publication de 80%+ confirmé, passez à la production en masse via l'API gpt-image-2-all d'APIYI (0,03 $/image).

Avertissement : Ne remplacez pas aveuglément toutes les pages de détails par de l'IA. Pour les images principales, un contrôle humain est recommandé. Utilisez l'IA pour les images secondaires, les vues sous différents angles (SKU) et les mises en situation. Cette répartition des tâches a été validée par les meilleures équipes e-commerce en avril.

Marques internationales visant le marché chinois

Avantage unique : Les équipes internationales devaient embaucher des designers locaux, avec des coûts de communication élevés et une itération lente. GPT-image-2 permet aux équipes basées à l'étranger de produire directement des contenus en chinois exploitables.

Flux recommandé :

- L'équipe internationale rédige les besoins de contenu en anglais (force de la capacité multilingue d'OpenAI).

- Utilisation de l'API officielle d'APIYI (

gpt-image-2, haute qualité) pour générer les visuels clés. - Utilisation d'un OCR domestique pour vérifier la précision des textes en tant qu'étape de contrôle qualité.

- Ajustements par l'équipe locale si nécessaire, réduisant le temps de travail de 80 %+.

Secteur de l'édition / Éducation / Vulgarisation

Scénarios clés :

- Illustrations pour contenus de vulgarisation (incluant termes techniques en chinois).

- Supports pédagogiques (incluant formules, annotations de graphiques en chinois).

- Illustrations pour publications (incluant polices de textes classiques).

Valeur ajoutée : Ces scénarios ont été négligés par les modèles d'IA par le passé. La précision de 99 % des caractères CJK (Chinois-Japonais-Coréen) de GPT-image-2 rend ces domaines « de niche mais de haute qualité » commercialement viables pour la première fois.

Blogueurs techniques / Auteurs de tutoriels IA

Fenêtre d'opportunité : Avril-juin reste une période où subsiste un écart d'information. Les blogueurs techniques proposant des tutoriels sur GPT-image-2 peuvent encore profiter d'une forte audience.

Conseils de contenu : Plutôt que de faire du contenu type « encyclopédie », privilégiez des contenus verticaux et concrets comme « Bibliothèque de modèles d'invites chinois pour GPT-image-2 » ou « Comment reproduire des affiches de style XX avec GPT-image-2 ».

🎯 Action prioritaire : Quel que soit votre profil, la première étape la plus économique est : créer un compte APIYI (apiyi.com) → tester 50 à 100 images avec

gpt-image-2-all(10-20 ¥) → trouver 3 à 5 modèles d'invites stables → intégrer votre flux principal. Ce processus de validation prend moins d'une semaine et vous permet de saisir l'opportunité majeure de 2026.

Pourquoi GPT-image-2 est-il si populaire par rapport à la version 1.5 ? Questions fréquentes

Q1 : Le rendu en chinois de GPT-image-2 a-t-il vraiment une précision de 99 % ?

Selon les tests LM Arena, GPT-image-2 affiche une précision au niveau des caractères sur le CJK d'environ 99 %. Mais il s'agit d'une précision au niveau du caractère individuel, pas à 100 %. Des erreurs subsistent dans les cas extrêmes : 1) textes très petits (moins de 5pt) ; 2) caractères spécialisés rares ; 3) conflits de mise en page complexe (superposition texte/image). Pour les titres courants de 8pt+, les sous-titres, les prix et les dates, il ne fait quasiment pas d'erreur.

Q2 : Le rendu chinois de GPT Image 1.5 est-il vraiment inutilisable ?

Ce n'est pas « totalement inutilisable », c'est « peu fiable ». Le taux de succès pour le chinois court (3-6 caractères) est d'environ 70-80 %, ce qui signifie qu'une image sur cinq nécessite une retouche. C'est un défaut rédhibitoire pour une production commerciale de masse, impliquant 20 % de déchets.

Q3 : Les modèles d’IA nationaux ne sont-ils pas meilleurs en chinois ?

Les modèles nationaux (Jimeng, Kling, CogView, etc.) supportent très bien le chinois, avec certains indicateurs proches de GPT-image-2. Toutefois, en combinant précision textuelle, qualité globale, capacité de raisonnement et support multilingue, GPT-image-2 reste globalement le meilleur en avril 2026.

Q4 : Une bonne gestion des caractères chinois suffit-elle à rendre un modèle viral ?

C'est une condition nécessaire, mais pas suffisante. Il faut aussi : 1) une barrière d'accès basse (accessibilité en Chine) ; 2) un prix raisonnable ; 3) une communauté active. La popularité de GPT-image-2 vient de la combinaison de l'effet de marque OpenAI, de sa position dominante sur LM Arena et de l'accès rapide via des plateformes comme APIYI.

Q5 : Comment les créateurs individuels peuvent-ils utiliser GPT-image-2 le plus rapidement ?

3 chemins : 1) Utiliser directement l'outil en ligne imagen.apiyi.com (sans code, interface chinoise) ; 2) S'abonner à ChatGPT Plus à 20 $/mois ; 3) Accéder via l'API d'APIYI (gpt-image-2-all) pour de la génération en masse à 0,03 $/image.

Q6 : Cette tendance va-t-elle s’essouffler ?

Oui. Actuellement (avril 2026), nous sommes dans une fenêtre de transition. L'hypothèse « fidélité = barrière de diffusion » s'affaiblira quand les modèles nationaux atteindront 99 % de précision (d'ici 6-12 mois) ou que l'engouement des utilisateurs diminuera.

Q7 : Y a-t-il des pièges à éviter pour les affiches en chinois ?

3 pièges : 1) Encadrez les textes clés entre guillemets : title: "Promotion" au lieu de title: Promotion ; 2) Pour les caractères complexes, générez 4 variantes pour choisir la meilleure ; 3) Pour les textes mixtes chinois/anglais, spécifiez explicitement le style de police pour éviter les conflits d'espacement.

Q8 : Comment vérifier davantage ces observations ?

- Validation des données : Analysez les données de contenu sur le mot-clé « GPT-image-2 » depuis avril ; 2) Expériences contrôlées : comparez les résultats sur 50 affiches identiques entre plusieurs modèles ; 3) Entretiens : interrogez des créateurs utilisant ces deux générations de modèles.

Pourquoi GPT-image-2 connaît un succès bien plus retentissant que la version 1.5 : Points clés

- Un saut générationnel décisif : GPT-image-2 a propulsé le rendu des caractères CJK, passant d'un état "non fiable" (~80 %) sur la version 1.5 à une précision de 99 % au niveau des caractères. C’est la progression la plus marquante dans le domaine de la génération d'images par IA au cours des 12 derniers mois.

- L'importance cruciale des vecteurs de communication chinois : Xiaohongshu, comptes officiels WeChat, mèmes, pages de détails e-commerce… les piliers de l'Internet chinois reposent presque tous sur des images contenant du texte. Le "rendu des sinogrammes" est donc la barrière infranchissable pour une adoption massive dans l'espace sinophone.

- Les blocages du flux de travail à l'ère de la 1.5 : Les créateurs chinois devaient obligatoirement retoucher les textes sur Photoshop, reléguant l'IA au rang d'outil "auxiliaire" plutôt que "principal", empêchant son intégration dans la production quotidienne.

- La version 2.0 résout trois impasses techniques : La combinaison du raisonnement de la série O, l'extension des données d'entraînement CJK et le mécanisme de rendu au niveau des caractères constitue la base fondamentale de ce taux de précision de 99 %.

- Le succès fulgurant d'avril n'est pas qu'un effet d'annonce : La tendance à la réplication d'affiches en chinois, les usines à mèmes, l'application concrète dans la publicité commerciale et l'utilisation inversée par les marques exportatrices prouvent que quatre formats de contenus à succès se développent durablement.

- Les limites de l'hypothèse : La règle "fidélité des sinogrammes = porte d'entrée de la diffusion" est une condition nécessaire mais non suffisante ; elle doit être complétée par la marque, le prix et les plateformes. Le modèle Nano Banana Pro, bien que compatible CJK, n'a pas atteint la même popularité, ce qui sert de contre-exemple.

- La fenêtre d'opportunité est ouverte maintenant : Les modèles nationaux devraient rattraper ce retard dans les 6 à 12 mois. Pour les créateurs chinois, l'adoption immédiate représente l'une des opportunités de contenu les plus prometteuses pour 2026.

- La méthode de test la plus économique : Via la plateforme APIYI (apiyi.com), le modèle

gpt-image-2-allest accessible à 0,03 $/image. Tester 10 images ne coûte qu'environ 2,1 CNY, ce qui suffit pour vérifier par vous-même la différence de performance.

Conclusion

Pour revenir à la question initiale : "Pourquoi GPT-image-2 est-il bien plus populaire que la version 1.5 ?"

La réponse la plus simple est : Parce qu'il a franchi la barrière du "rendu des sinogrammes" indispensable à la diffusion dans le monde sinophone. À l'ère de la 1.5, la génération d'images par IA s'était déjà généralisée dans le monde anglophone, mais elle restait bloquée dans le monde chinois à cause de l'inutilisabilité des caractères. En atteignant une précision de 99 % pour le rendu des sinogrammes avec la version 2.0, le flux de travail des créateurs chinois s'est enfin fluidifié, déclenchant ainsi une véritable dynamique de diffusion.

Il ne s'agit pas ici d'une simple "itération de modèle" isolée, mais d'une démonstration de causalité où un indicateur technique précis (précision des caractères CJK passant de ~80 % à ~99 %) vient dynamiser un écosystème spécifique (les vecteurs de communication de l'Internet chinois). Comprendre cette logique permet de mieux évaluer le potentiel de diffusion de futurs modèles d'IA sur le marché chinois : ne regardez pas les scores de performance, regardez les sinogrammes.

Pour les créateurs de contenu, les équipes marketing et les gestionnaires e-commerce en 2026, la question de l'intégration de GPT-image-2 n'est plus de savoir "s'il faut utiliser l'IA", mais plutôt de réaliser que "ne pas l'utiliser maintenant, c'est passer à côté de la période dorée". Nous vous recommandons de vérifier son efficacité dans vos scénarios spécifiques via la plateforme APIYI (apiyi.com) au coût le plus bas (0,03 $/image), puis de décider, sur la base de données réelles, s'il convient de l'intégrer à votre flux de production principal.

Pour conclure sur cette réflexion personnelle : ces observations reposent sur des données et analyses de avril 2026, elles ne constituent pas une vérité absolue. Les créateurs sont invités à compléter, corriger, voire réfuter ces propos en se basant sur leurs propres tests.

Références

-

Annonce officielle d'OpenAI concernant ChatGPT Images 2.0: Notes de mise à jour de GPT-image-2

- Lien :

openai.com/index/introducing-chatgpt-images-2-0 - Description : Texte officiel attestant d'un taux de précision multilingue de 99 %

- Lien :

-

Classement LM Arena Text-to-Image: Classement Elo des modèles

- Lien :

arena.ai/leaderboard/text-to-image - Description : GPT-image-2 avec un score Elo de 1512 · Validation de la précision au niveau des caractères

- Lien :

-

Rapport TechCrunch du 21 avril: Le nouveau modèle Images 2.0 de ChatGPT est étonnamment performant pour générer du texte

- Lien :

techcrunch.com/2026/04/21/chatgpts-new-images-2-0-model-is-surprisingly-good-at-generating-text - Description : Couverture médiatique par les grands acteurs technologiques dans les 24 heures suivant le lancement

- Lien :

-

The New Stack – OpenAI réfléchit désormais avant de dessiner: Rapport approfondi sur les mécanismes de raisonnement

- Lien :

thenewstack.io/chatgpt-images-20-openai - Description : Analyse de l'impact du raisonnement de la série O sur le rendu des caractères chinois

- Lien :

-

Documentation technique sur la tokenisation CJK: Pourquoi les grands modèles de langage ont longtemps eu du mal avec le chinois

- Lien :

tonybaloney.github.io/posts/cjk-chinese-japanese-korean-llm-ai-best-practices.html - Description : Défis techniques sous-jacents au traitement CJK

- Lien :

-

Plateforme APIYI: Accès domestique à GPT-image-2

- Lien :

apiyi.com - Description : API de transfert officielle + API inverse (gpt-image-2-all à 0,03 $/image)

- Lien :

Auteur : Équipe technique APIYI | Pour découvrir les capacités de rendu du chinois de GPT-image-2, rendez-vous sur APIYI (apiyi.com), inscrivez-vous pour recevoir des crédits de test, ou essayez l'outil en ligne sur imagen.apiyi.com (accessible directement depuis la Chine).