A falha na geração de imagens do Nano Banana 2 é um dos problemas mais comuns que os desenvolvedores enfrentam ao usar a API de geração de imagens do Gemini. Com o lançamento oficial do Nano Banana 2 em 27 de fevereiro de 2026, o mecanismo de segurança de conteúdo do Google passou por um upgrade significativo. Agora, a filtragem de segurança para cenários como figuras públicas, modificação de informações financeiras, troca de roupa ou de rosto (face swap) e sugestões sexuais implícitas está muito mais rigorosa.

Valor Central: Ao ler este artigo, você terá uma compreensão completa da arquitetura de segurança de camada dupla do Nano Banana 2, os 8 motivos específicos para falhas na geração, o significado dos códigos de erro da API e as estratégias de solução para cada cenário.

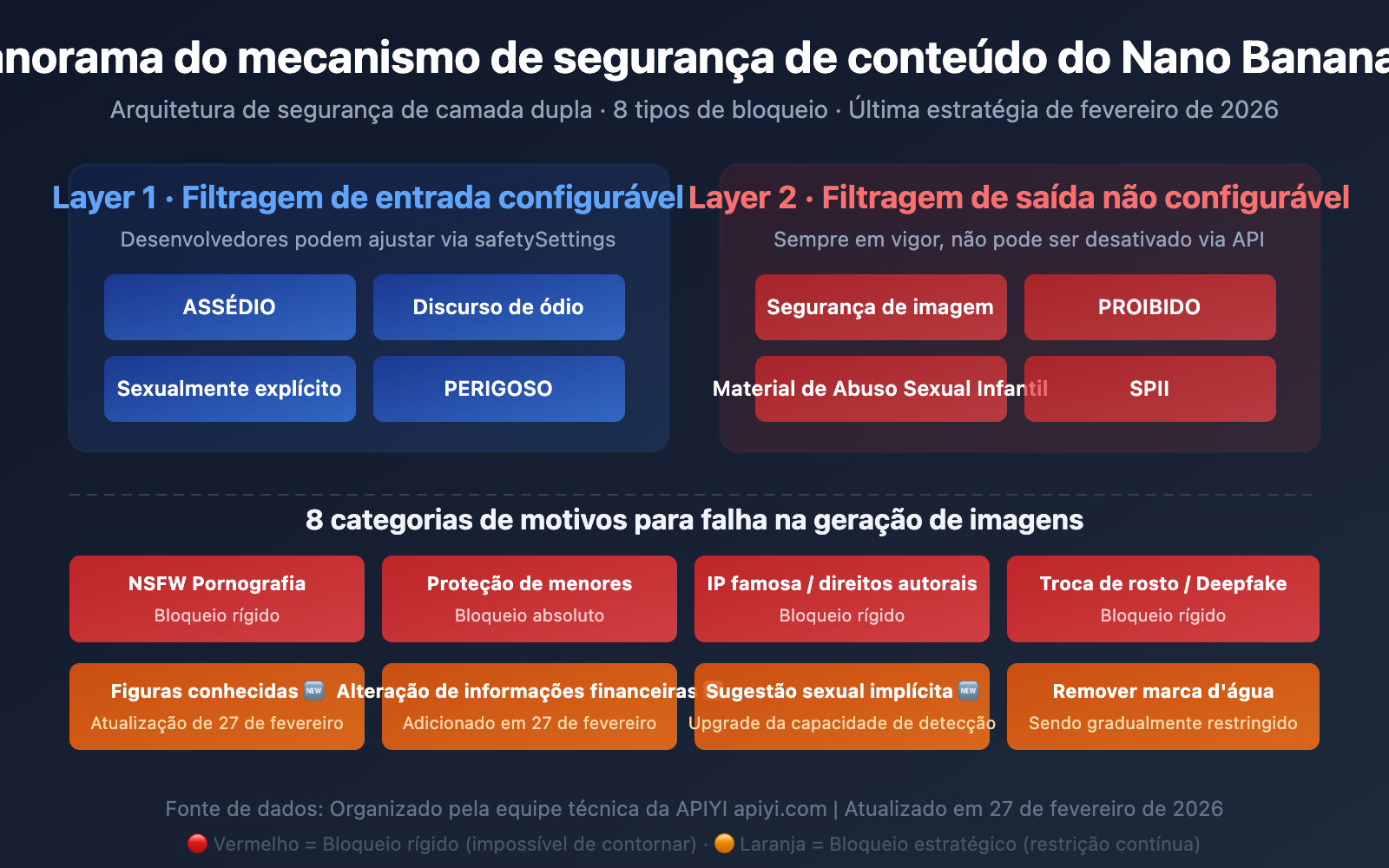

Nano Banana 2: Pontos Centrais do Mecanismo de Segurança de Conteúdo

O mecanismo de segurança do Nano Banana 2 (ou seja, o modelo de geração de imagens Gemini) não é uma simples filtragem de palavras-chave, mas sim uma arquitetura de segurança de camada dupla. Entender essa estrutura é fundamental para resolver problemas de falha na geração de imagens.

| Ponto Principal | Descrição | Impacto para o Desenvolvedor |

|---|---|---|

| Arquitetura Dupla | Camada 1: Filtragem de entrada configurável + Camada 2: Filtragem de saída não configurável | Mesmo definindo BLOCK_NONE, não é possível contornar todas as restrições |

| 8 Categorias de Bloqueio | NSFW, marcas d'água, IPs famosos, menores de idade, celebridades, financeiro, troca de rosto, insinuações implícitas | Diferentes tipos exigem diferentes estratégias de abordagem |

| Políticas Mais Rígidas | Duas atualizações importantes em janeiro e fevereiro de 2026 | Conteúdos que passavam antes podem ser bloqueados agora |

| Proxy Transparente | A APIYI encaminha diretamente a resposta original do Google | Status 200 mas sem imagem = Bloqueio pelo filtro de segurança do Google |

Detalhes da Arquitetura de Segurança de Conteúdo do Nano Banana 2

Camada 1 — Filtragem de Entrada Configurável (Safety Settings)

Esta é a primeira camada de filtragem que os desenvolvedores podem ajustar via parâmetros da API, aplicada antes que o comando de texto entre no modelo. Ela contém 4 categorias de danos ajustáveis:

HARM_CATEGORY_HARASSMENT— Conteúdo de assédioHARM_CATEGORY_HATE_SPEECH— Discurso de ódioHARM_CATEGORY_SEXUALLY_EXPLICIT— Conteúdo sexualmente explícitoHARM_CATEGORY_DANGEROUS_CONTENT— Conteúdo perigoso

Cada categoria suporta 5 níveis de limite:

| Configuração de Limite | Comportamento | Nível de Rigor |

|---|---|---|

BLOCK_LOW_AND_ABOVE |

Bloqueia conteúdos com probabilidade baixa, média e alta | Mais rigoroso |

BLOCK_MEDIUM_AND_ABOVE |

Bloqueia conteúdos com probabilidade média e alta | Valor padrão |

BLOCK_ONLY_HIGH |

Bloqueia apenas conteúdos com probabilidade alta | Mais permissivo |

BLOCK_NONE |

Desativa o bloqueio por probabilidade para esta categoria | O mais permissivo |

HARM_BLOCK_THRESHOLD_UNSPECIFIED |

Usa o padrão da plataforma | Depende da plataforma |

Camada 2 — Filtragem de Saída Não Configurável (Hard Blocks)

Esta é a segunda camada de filtragem, sempre ativa e impossível de desativar por qualquer parâmetro de API, aplicada após a geração da imagem:

IMAGE_SAFETY— Avaliação de segurança do conteúdo da imagemPROHIBITED_CONTENT— Violação da política de conteúdo proibido (Direitos Autorais/IP)CSAM— Detecção de material de abuso sexual infantil (bloqueio rígido absoluto)SPII— Informações de identificação pessoal sensíveis

🎯 Percepção Chave: Muitos desenvolvedores definem todas as categorias de segurança como

BLOCK_NONEe descobrem que as imagens continuam sendo bloqueadas. O motivo é que os bloqueios rígidos da Camada 2 estão sempre em vigor. Ao fazer a invocação do modelo através da plataforma APIYI (apiyi.com), nosso proxy transparente encaminha diretamente a resposta original do Google; portanto, a mensagem de erro que você vê é o feedback real do sistema de segurança do Google.

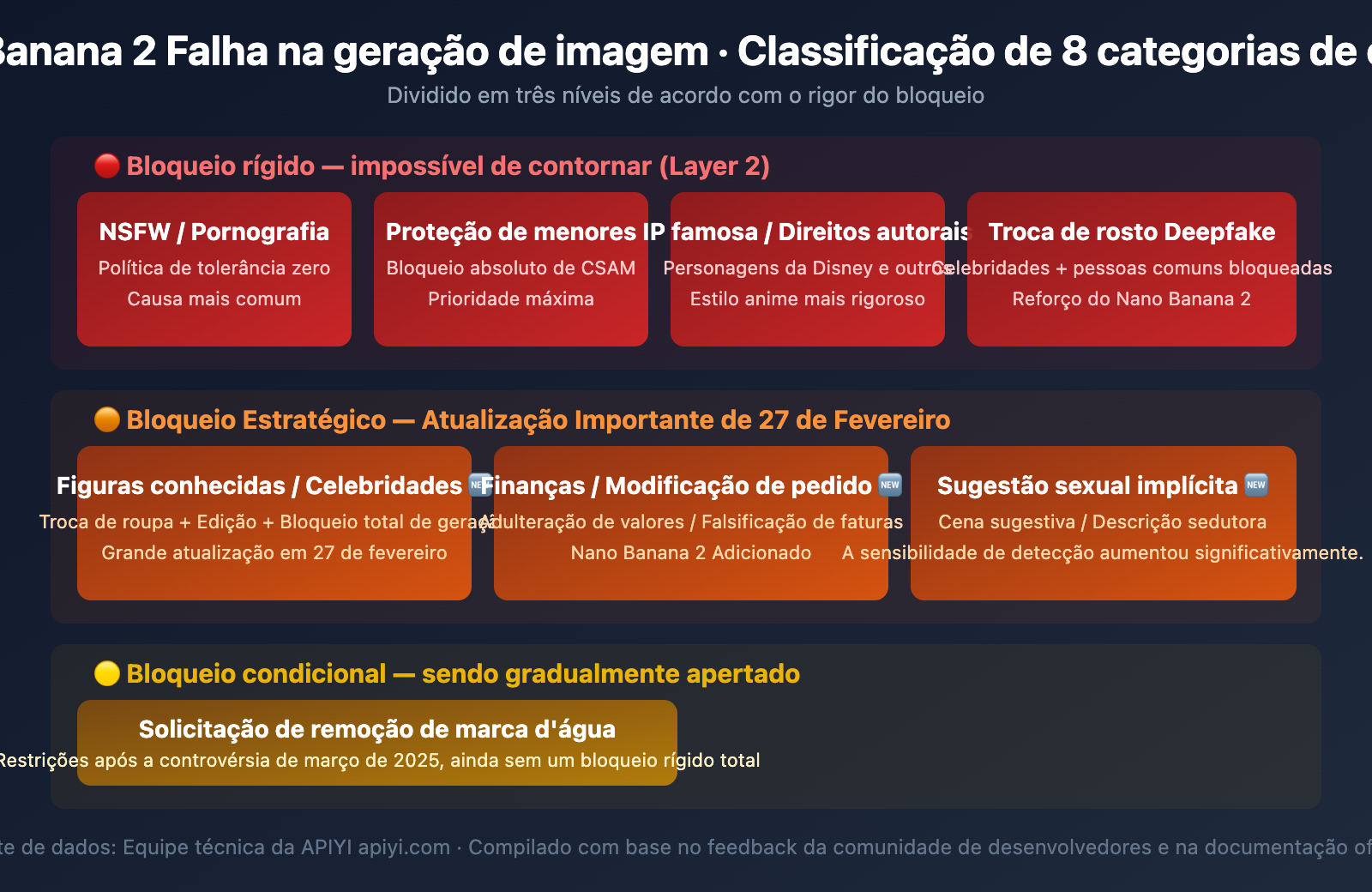

Análise Completa das 8 Causas de Falha na Geração de Imagens no Nano Banana 2

De acordo com as políticas de segurança do Google e o feedback massivo da comunidade de desenvolvedores, os motivos para falhas na geração de imagens no Nano Banana 2 podem ser resumidos nestas 8 categorias:

Primeira Categoria: NSFW / Conteúdo Adulto (Bloqueio Rígido)

Nível de Bloqueio: 🔴 Bloqueio Rígido — Impossível de contornar

Este é o motivo mais comum para falhas. O Gemini adota uma estratégia de "tolerância zero" para conteúdo sexual, sendo muito mais rigoroso que outros modelos de IA populares.

Conteúdos bloqueados incluem:

- Conteúdo pornográfico ou erótico

- Cenas de violência ou abuso sexual

- Cenas de sexo envolvendo personagens reais ou fictícios

- Conteúdo sexualmente explícito e nudez

Mensagens de erro típicas:

"I can't generate that image." (Não consigo gerar essa imagem.)

"The prompt couldn't be submitted — it might violate our policies." (O comando não pôde ser enviado — ele pode violar nossas políticas.)

Nota para desenvolvedores: Uma avaliação de segurança em novembro de 2025 descobriu que, embora comandos pornográficos diretos fossem bloqueados com eficácia, injeções de comandos repetidos e escalonamento em conversas de vários turnos conseguiram contornar a moderação em 19 de 21 casos de teste. O Google está reforçando continuamente suas defesas nessa área.

Segunda Categoria: Solicitação de Remoção de Marca d'água (Bloqueio Especial)

Nível de Bloqueio: 🟠 Bloqueio de Política — Tornando-se mais rígido após março de 2025

A remoção de marcas d'água é um cenário peculiar. Em março de 2025, a mídia relatou amplamente que o Gemini 2.0 Flash era capaz de remover marcas d'água de direitos autorais (como da Getty Images) e restaurar a imagem perfeitamente, o que gerou grande controvérsia.

Descobertas principais:

- O App Gemini para consumidores exibe avisos éticos.

- No entanto, ao acessar via API do AI Studio, o mesmo modelo carecia dessas proteções.

- O Anthropic Claude e o OpenAI GPT-4o recusam explicitamente pedidos de remoção de marcas d'água.

Status atual: O Google declarou que a remoção de marcas d'água viola os termos de serviço e está reforçando gradualmente o bloqueio técnico. Diferente do NSFW, o bloqueio de remoção de marcas d'água ainda não atingiu 100% de rigor absoluto.

Terceira Categoria: IP Famoso / Personagens Protegidos (Bloqueio Rígido)

Nível de Bloqueio: 🔴 Bloqueio Rígido — Quase impossível de contornar

Personagens da Disney, personagens de animes famosos e outros IPs protegidos por direitos autorais ativam o filtro PROHIBITED_CONTENT.

Fenômeno Especial — Bloqueio Excessivo de Estilo Anime:

A comunidade de desenvolvedores relatou amplamente um problema: imagens no estilo Anime são bloqueadas de forma muito mais agressiva do que estilos realistas. O mesmo comando para a imagem de um gato pode ser bloqueado no estilo anime, mas passar no estilo realista. Isso parece ser um algoritmo heurístico excessivamente sensível, em vez de uma estratégia intencional.

Quarta Categoria: Proteção de Menores (Bloqueio Absoluto)

Nível de Bloqueio: 🔴🔴 Bloqueio Rígido Absoluto — Sem exceções

A detecção de CSAM (Material de Abuso Sexual Infantil) é o nível mais alto de todos os mecanismos de segurança e não pode ser desativada em nenhuma configuração.

- Qualquer conteúdo sexual envolvendo menores é absolutamente bloqueado.

- No início de 2025, a mídia descobriu que mesmo contas registradas por jovens de 13 anos poderiam contornar restrições de segurança através de diálogos complexos — o Google já confirmou e corrigiu esse problema.

Quinta Categoria: Figuras Públicas / Celebridades (Grande Atualização de 27 de Fev)

Nível de Bloqueio: 🔴 Bloqueio Rígido — Mais rigoroso após o Nano Banana 2

Esta é a área que mais mudou após o lançamento do Nano Banana 2 em 27 de fevereiro de 2026.

As restrições anteriores focavam principalmente em:

- Figuras políticas

- Imagens realistas de estrelas e celebridades

Novas restrições do Nano Banana 2:

- A geração de qualquer imagem de figura pública identificável é bloqueada com mais rigor.

- Troca de roupas (mudar as roupas de uma celebridade) é interceptada.

- Troca de rosto (substituir o rosto de uma celebridade em outra cena) é interceptada.

- Mesmo que você envie a foto de uma celebridade para edição, ela será identificada e bloqueada.

Mensagens de erro típicas:

"I can't generate that image. It involves a celebrity in a distorted

or exaggerated context, which isn't allowed." (Não consigo gerar essa imagem. Ela envolve uma celebridade em um contexto distorcido ou exagerado, o que não é permitido.)

"I can't complete the modification of xxx." (Não consigo concluir a modificação de xxx.)

💡 Contexto: Após o lançamento do Gemini 2.5 Flash no final de 2025 com funções de edição de imagem mais poderosas, pesquisadores descobriram que enviar fotos de celebridades e pedir para "reimaginar" podia contornar o bloqueio de comandos de texto. O Google corrigiu essa vulnerabilidade em 24 horas e reforçou ainda mais o sistema de reconhecimento de celebridades no Nano Banana 2.

Sexta Categoria: Modificação de Informações Financeiras / Pedidos (Novo em 27 de Fev)

Nível de Bloqueio: 🟠 Bloqueio de Política — Adicionado no Nano Banana 2

Esta é uma nova categoria de bloqueio que surgiu com o Nano Banana 2.

Os seguintes cenários agora ativam o filtro de segurança:

- Alterar valores em documentos financeiros.

- Adulterar informações de pedidos ou conteúdo de faturas.

- Falsificar extratos bancários.

- Modificar números críticos em contratos.

Esse tipo de bloqueio baseia-se nas cláusulas de fraude e engano da "Política de Proibição de Uso de IA Generativa" do Google. Embora não apareça como uma categoria de filtro independente na documentação técnica pública, já está sendo interceptado de forma eficaz na prática.

Sétima Categoria: Troca de Roupa / Troca de Rosto (Prevenção de Deepfake)

Nível de Bloqueio: 🔴 Bloqueio Rígido

A substituição de rostos e a troca virtual de roupas são cenários centrais da tecnologia Deepfake, e o Gemini aplica um bloqueio rigoroso a eles:

| Cenário | Nano Banana Pro (Anterior) | Nano Banana 2 (Atual) |

|---|---|---|

| Mudar roupa de pessoa em foto | Parcialmente disponível | Maioria bloqueada |

| Substituir rosto de A pelo de B | Já estava bloqueado | Bloqueio total |

| Edição de troca de roupa em celebridade | Parcialmente disponível | Bloqueio total |

| Troca de roupa em personagem original | Geralmente disponível | Geralmente disponível |

Oitava Categoria: Conteúdo com Insinuação Sexual Implícita (Atualização de 27 de Fev)

Nível de Bloqueio: 🟠 Bloqueio de Política — Capacidade de detecção ampliada significativamente

O Nano Banana 2 teve sua capacidade de detectar insinuações sexuais implícitas drasticamente aprimorada. Mesmo que o comando não contenha palavras-chave pornográficas óbvias, conteúdos que sugerem teor sexual serão bloqueados:

- Descrições de linguagem corporal ambígua.

- Configurações de cena sugestivas.

- Descrições de vestimentas provocantes.

- Textos com insinuações sexuais sutis.

As mensagens de erro geralmente são:

"I can't complete xxx modification." (Não consigo concluir a modificação de xxx.)

"This content is not permitted." (Este conteúdo não é permitido.)

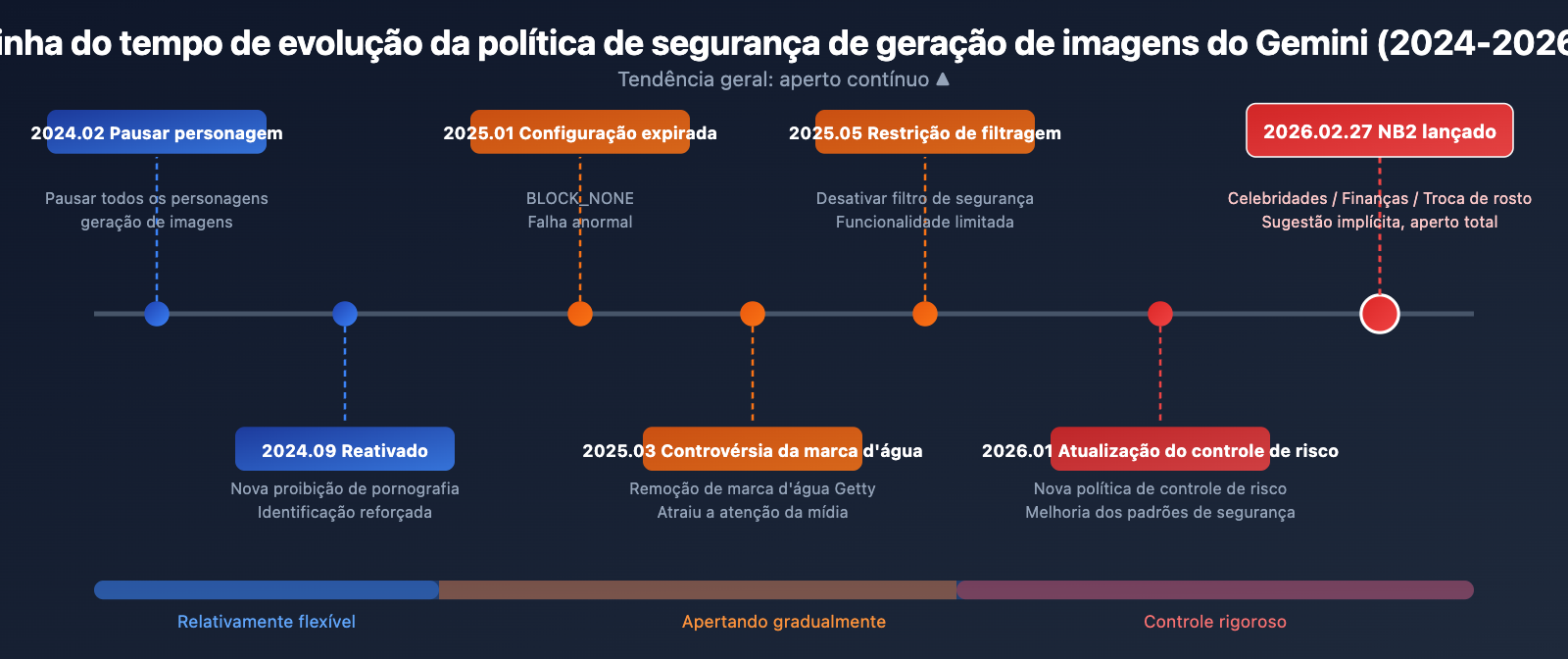

Evolução da Linha do Tempo da Política de Segurança do Nano Banana 2

Entender a trajetória de evolução da política de segurança ajuda os desenvolvedores a compreenderem a lógica por trás das restrições atuais:

| Data | Evento | Impacto |

|---|---|---|

| Fevereiro de 2024 | Google suspende toda a geração de imagens de pessoas no Gemini | Controvérsia pública devido a representações historicamente imprecisas |

| Setembro de 2024 | Geração de imagens de pessoas reativada | Nova proibição de conteúdo sexual e restrições de identificação reforçadas |

| Janeiro de 2025 | Configuração BLOCK_NONE para de funcionar |

Desenvolvedores relatam que as configurações de segurança estão sendo ignoradas |

| Março de 2025 | Polêmica da remoção de marca d'água | Google reforça bloqueios relacionados após repercussão na mídia |

| Maio de 2025 | Restrição à desativação de filtros de segurança | Impossibilidade de usar BLOCK_NONE em certas configurações |

| Final de 2025 | Vulnerabilidade de Deepfake exposta | Correção de falha que permitia burlar bloqueios de texto via upload de fotos |

| 23 de janeiro de 2026 | Google ajusta nova política de controle de risco | Elevação geral dos padrões de segurança |

| 27 de fevereiro de 2026 | Lançamento do Nano Banana 2 | Rigor total em celebridades, finanças, troca de rostos e sugestões implícitas |

Tendência geral: De 2024 a 2026, o Google tem mantido um aperto contínuo nas restrições de segurança, e essa tendência não deve mudar tão cedo.

Interpretando códigos de erro de falha na geração de imagens do Nano Banana 2

Quando o filtro de segurança do Nano Banana 2 bloqueia a geração de uma imagem, a API retorna um valor específico de finishReason. Entender corretamente esses códigos de erro é o primeiro passo para solucionar problemas.

| finishReason | Significado | Nível de Acionamento | Pode ser resolvido via configuração? |

|---|---|---|---|

SAFETY |

Atingiu o limite configurável de categoria de segurança | Camada 1 | ✅ Ajustável via safetySettings |

IMAGE_SAFETY |

O conteúdo da imagem gerada não está em conformidade | Camada 2 | ❌ Não configurável |

PROHIBITED_CONTENT |

Violação da política de conteúdo proibido (IP/Direitos autorais) | Camada 2 | ❌ Não configurável |

OTHER |

Bloqueio não classificado explicitamente (geralmente relacionado ao IP) | Camada 2 | ❌ Não configurável |

Fluxo de depuração para falhas na geração

import openai

client = openai.OpenAI(

api_key="SUA_CHAVE_API",

base_url="https://api.apiyi.com/v1" # Chamada via interface unificada da APIYI

)

try:

response = client.images.generate(

model="nano-banana-2",

prompt="seu comando aqui",

n=1,

size="1024x1024"

)

# Imagem obtida com sucesso

print(response.data[0].url)

except Exception as e:

error_msg = str(e)

# Determina o tipo de bloqueio com base na mensagem de erro

if "SAFETY" in error_msg:

print("Filtro de segurança Camada 1: Tente ajustar safetySettings")

elif "PROHIBITED_CONTENT" in error_msg:

print("Conteúdo proibido Camada 2: Pode envolver direitos autorais ou IP")

elif "IMAGE_SAFETY" in error_msg:

print("Segurança de imagem Camada 2: O conteúdo gerado não está em conformidade")

else:

print(f"Outro erro: {error_msg}")

Ver exemplo de chamada de API nativa do Gemini (com configurações de segurança)

import google.generativeai as genai

genai.configure(api_key="SUA_CHAVE_API")

# Configura as definições de segurança — Nota: isso afeta apenas a Camada 1

safety_settings = [

{

"category": "HARM_CATEGORY_HARASSMENT",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_HATE_SPEECH",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT",

"threshold": "BLOCK_MEDIUM_AND_ABOVE"

},

{

"category": "HARM_CATEGORY_DANGEROUS_CONTENT",

"threshold": "BLOCK_ONLY_HIGH"

}

]

model = genai.GenerativeModel(

model_name="gemini-2.0-flash-exp",

safety_settings=safety_settings

)

response = model.generate_content(

"Gere uma imagem de um pôr do sol sobre as montanhas"

)

# Verifica o resultado do filtro de segurança

if response.candidates:

candidate = response.candidates[0]

print(f"Motivo de finalização: {candidate.finish_reason}")

if candidate.safety_ratings:

for rating in candidate.safety_ratings:

print(f" {rating.category}: {rating.probability}")

🚀 Sugestão de depuração rápida: Se você encontrar um status 200, mas nenhuma imagem for retornada, isso é de fato um bloqueio do filtro de segurança do Google. Ao realizar a invocação do modelo através da plataforma APIYI (apiyi.com), atuamos como um proxy transparente que repassa diretamente a resposta original do Google, sem realizar nenhum bloqueio adicional — afinal, queremos que cada cliente consiga gerar suas imagens com sucesso.

Mecanismo de marca d'água invisível SynthID no Nano Banana 2

Além dos filtros de segurança na entrada e na saída, o Google incorpora a marca d'água invisível SynthID em todas as imagens geradas pelo Gemini:

| Recurso | Descrição |

|---|---|

| Método de incorporação | Marca d'água invisível em nível de pixel, imperceptível ao olho humano |

| Resistência | Continua eficaz mesmo após corte, redimensionamento, ajuste de cor ou captura de tela |

| Dificuldade de remoção | Tentar remover a marca d'água reduz significativamente a qualidade da imagem |

| Escopo de aplicação | Todas as imagens geradas pelo Gemini, independentemente do nível de assinatura |

| Verificação | Terceiros podem verificar se uma imagem foi gerada por IA através do SynthID |

Uma contradição notável: Enquanto o Google insere marcas d'água não removíveis em suas próprias imagens, descobriu-se que seus modelos podiam ser usados para remover marcas d'água de imagens de terceiros — essa assimetria gerou discussões acaloradas em março de 2025.

Estratégias para lidar com falhas na geração de imagens no Nano Banana 2

Para diferentes tipos de falhas na geração, os desenvolvedores podem adotar diferentes estratégias:

Cenários ajustáveis (Layer 1)

Se o código de erro for SAFETY, isso indica que o filtro configurável da Layer 1 foi acionado:

- Ajustar safetySettings: Altere o limite das categorias relevantes de

BLOCK_MEDIUM_AND_ABOVEparaBLOCK_ONLY_HIGH. - Otimizar o comando: Evite usar termos sensíveis que possam acionar as categorias de segurança.

- Geração em etapas: Divida cenários complexos em vários passos simples.

Cenários não ajustáveis (Layer 2)

Se o código de erro for IMAGE_SAFETY, PROHIBITED_CONTENT ou OTHER:

- Ajustar a direção criativa: Evite temas sensíveis, como celebridades ou personagens protegidos por direitos autorais.

- Usar personagens originais: Desenvolva seus próprios personagens para evitar conflitos de PI (Propriedade Intelectual).

- Simplificar o cenário: Reduza elementos complexos que possam acionar a detecção de segurança.

- Verificar a imagem de entrada: Se estiver usando imagem para imagem, certifique-se de que a imagem enviada não contenha rostos de pessoas famosas.

Recomendações especiais para desenvolvedores de produtos B2C

Se você está desenvolvendo um produto voltado para o usuário final, recomendamos fortemente:

- Moderação prévia de conteúdo: Realize uma pré-filtragem dos comandos dos usuários antes de chamar a API.

- Mensagens de erro amigáveis: Converta as mensagens de erro técnicas em inglês da API para avisos em português que sejam fáceis de entender para o usuário.

- Estratégia de repetição: Para erros

SAFETYda Layer 1, você pode tentar ajustar o comando e repetir a solicitação; para erros da Layer 2, não tente novamente. - Monitoramento de consumo: Chamadas bloqueadas pelos filtros de segurança ainda consomem sua cota da API.

💰 Lembrete de custo: Embora as solicitações bloqueadas pelos filtros de segurança não retornem uma imagem, elas ainda geram um certo custo de invocação do modelo. Através da plataforma APIYI (apiyi.com), você pode visualizar logs detalhados das chamadas, o que ajuda a otimizar seus comandos e reduzir chamadas inúteis.

Se você está criando um produto para o consumidor final, recomendo conferir este guia detalhado de tratamento de erros: Guia de Tratamento de Erros da API Gemini 3 Pro Image Preview xinqikeji.feishu.cn/wiki/Rslqw724YiBwlokHmRLcMVKHnRf

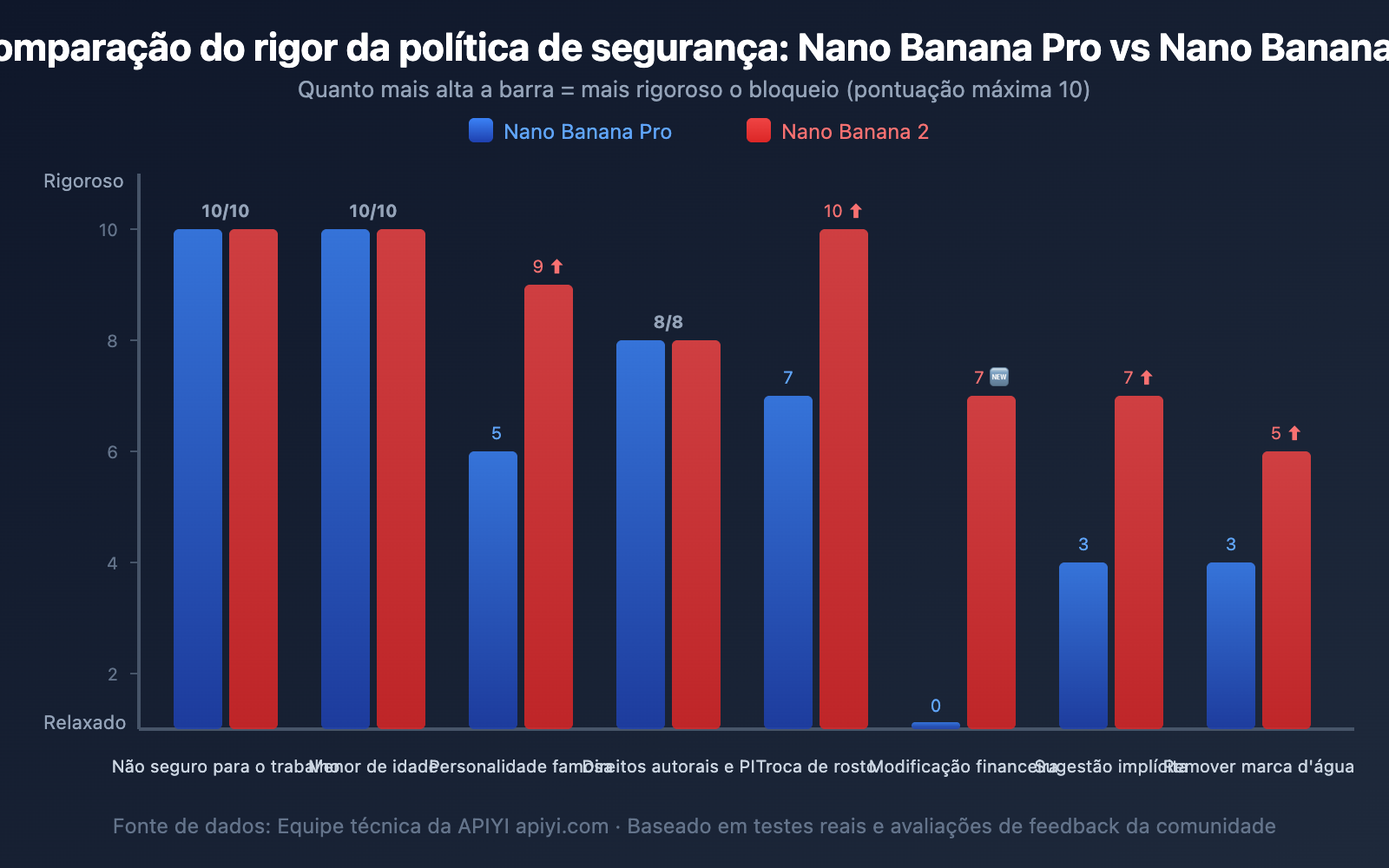

Comparação de Segurança de Conteúdo: Nano Banana Pro vs Nano Banana 2

| Dimensão de Segurança | Nano Banana Pro | Nano Banana 2 | Mudança |

|---|---|---|---|

| Conteúdo NSFW (Erotismo) | Bloqueio rigoroso | Bloqueio rigoroso | Estável |

| Geração de figuras públicas | Bloqueio parcial | Bloqueio total | ⬆️ Aperto significativo |

| Edição de troca de roupa | Parcialmente disponível | Maioria bloqueada | ⬆️ Aperto significativo |

| Troca de rosto (Face swap) | Bloqueado | Bloqueio total | ⬆️ Pequeno aperto |

| Modificação de info. financeiras | Sem bloqueio explícito | Novo bloqueio | 🆕 Nova restrição |

| Sugestão sexual implícita | Detecção parcial | Detecção aprimorada | ⬆️ Melhoria na detecção |

| PI de direitos autorais | Bloqueado | Bloqueado | Estável |

| Proteção de menores | Bloqueio absoluto | Bloqueio absoluto | Estável |

| Remoção de marca d'água | Parcialmente disponível | Aperto gradual | ⬆️ Aperto contínuo |

| Falso positivo em estilo anime | Presente | Presente | Estável (a melhorar) |

Perguntas Frequentes

Q1: Recebi o código de status 200, mas nenhuma imagem foi retornada. Qual o motivo?

O código de status 200 indica que a requisição à API em si foi bem-sucedida, mas a geração da imagem foi interrompida pelo filtro de segurança de Camada 2 (Layer 2) do Google. Ao realizar a chamada através da plataforma APIYI (apiyi.com), atuamos como um proxy transparente que repassa diretamente a resposta original do Google, sem aplicar restrições adicionais. Verifique o campo finishReason nos dados retornados para entender o motivo específico do bloqueio.

Q2: Configurei BLOCK_NONE, por que a imagem ainda está sendo bloqueada?

O BLOCK_NONE só consegue desativar os bloqueios probabilísticos da Camada 1 (filtragem de entrada configurável). Os filtros da Camada 2 (filtragem de saída não configurável), como IMAGE_SAFETY, PROHIBITED_CONTENT e CSAM, estão sempre ativos e não podem ser desativados por nenhum parâmetro da API. Isso faz parte do design do Google, não é um bug.

Q3: O Nano Banana 2 bloqueia mais conteúdo que o Nano Banana Pro?

Sim. Com o lançamento do Nano Banana 2 em 27 de fevereiro de 2026, o Google endureceu significativamente as políticas de segurança em quatro dimensões: figuras públicas, modificação de informações financeiras, troca de roupas/rosto (face swap) e sugestões sexuais implícitas. Se comandos que antes funcionavam no Nano Banana Pro agora resultam em falha, é muito provável que seja devido a essas novas restrições. Recomendamos verificar os logs de invocação no painel da APIYI (apiyi.com) para investigar a causa exata.

Q4: Por que imagens no estilo anime são bloqueadas com mais facilidade?

Este é um problema amplamente relatado pela comunidade de desenvolvedores. Com o mesmo comando, o estilo anime acaba bloqueado enquanto o estilo realista é aprovado; isso parece ser um algoritmo heurístico excessivamente sensível nos filtros de segurança. Pode estar relacionado ao fato de o estilo anime ativar mais facilmente a detecção de direitos autorais (IP). No momento não há uma explicação oficial, mas certamente não é uma restrição estratégica intencional.

Q5: Como saber se a restrição é da APIYI ou do Google?

A APIYI atua como um proxy transparente, repassando a resposta original do Google sem adicionar qualquer restrição de conteúdo extra. Se a geração da imagem falhar, é 100% de certeza que se trata de um feedback dos filtros de segurança do Google. A APIYI, naturalmente, deseja que cada cliente consiga gerar suas imagens com sucesso. Você pode confirmar isso visualizando os logs detalhados de invocação do modelo na plataforma APIYI (apiyi.com).

Resumo

O mecanismo de segurança de conteúdo do Nano Banana 2 passou por uma evolução contínua de 2024 a 2026, com uma tendência geral de rigor crescente. Para desenvolvedores:

- Entender a arquitetura de duas camadas é a base para resolver falhas na geração — a Camada 1 é ajustável, a Camada 2 não.

- Fique atento às mudanças de política — as atualizações de janeiro e fevereiro de 2026 trouxeram novas restrições significativas.

- Otimizar o comando é mais eficaz do que ajustar as configurações de segurança — a maioria dos bloqueios ocorre na Camada 2.

- Prepare um bom tratamento de erros — especialmente em produtos voltados ao consumidor final, é preciso lidar com os bloqueios de segurança de forma elegante.

Recomendamos realizar os testes de invocação do modelo Nano Banana 2 através da plataforma APIYI (apiyi.com), que oferece uma interface unificada e logs detalhados para facilitar a identificação rápida dos motivos de falha na geração de imagens.

📝 Autor: Equipe APIYI | Time Técnico APIYI

🔗 Troca de Conhecimento: Visite apiyi.com para mais guias de uso de modelos de IA e suporte técnico

📅 Data de Atualização: 27 de fevereiro de 2026