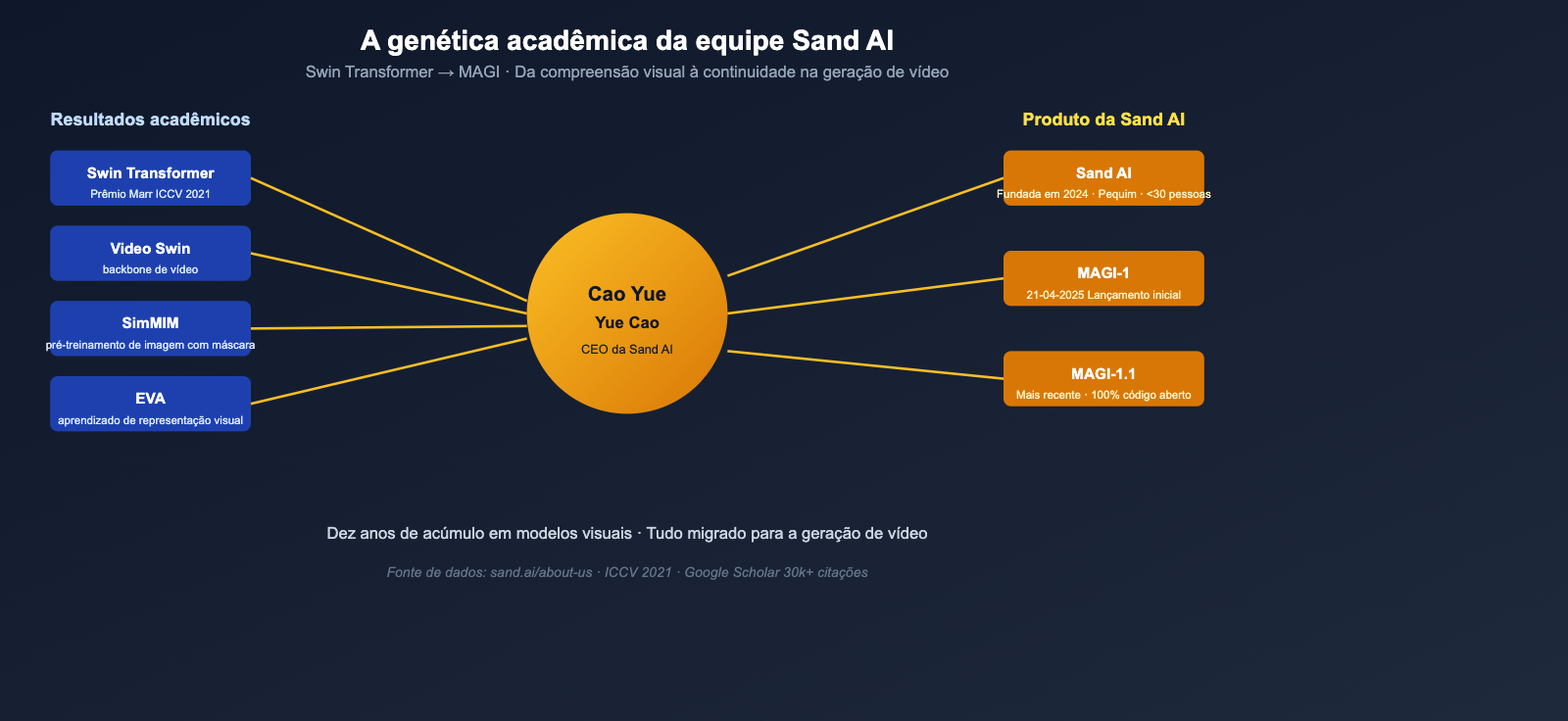

Se você tem visto o nome Sand AI aparecer repetidamente no Hugging Face, GitHub ou no Twitter de IA em inglês ultimamente, e está curioso sobre o lançamento do MAGI-1 / MAGI-1.1, este artigo foi feito para você. Diferente de muitas "equipes de modelos de vídeo que surgiram do nada", a Sand AI tem uma origem bastante sólida: seu CEO, Cao Yue, é o autor principal do Swin Transformer. Este artigo venceu o prêmio de melhor artigo (Marr Prize) no ICCV 2021, acumulou mais de 30 mil citações no Google Scholar e foi amplamente adotado por gigantes como Microsoft Office 365, Azure, TikTok e Kuaishou. Em outras palavras, a Sand AI não é uma equipe que entrou na brincadeira de última hora, mas sim o resultado da equipe original do Swin Transformer aplicando uma década de acúmulo em modelos visuais para a geração de vídeo.

O que mais empolga a comunidade internacional é que a Sand AI não apenas criou um modelo de geração de vídeo competitivo, mas também escolheu abri-lo completamente: todo o conjunto de pesos do MAGI-1 + código + ferramentas de inferência, sob a licença Apache 2.0, disponível diretamente no GitHub e no Hugging Face. Na onda de "modelos de vídeo nacionais de código aberto" de 2025-2026, a Sand AI é uma das poucas equipes que consolidou e abriu a nova rota de "geração de vídeo autorregressiva". Este artigo abordará o que é a Sand AI através de 6 dimensões: histórico da empresa, trajetória do fundador, arquitetura técnica do MAGI, estratégia de código aberto e público-alvo.

Visão geral das informações principais da Sand AI

Antes de começarmos a detalhar, vamos resumir todos os fatos cruciais sobre "o que é a Sand AI" em uma única tabela.

| Dimensão | Informações públicas da Sand AI |

|---|---|

| Nome em inglês | Sand AI (site sand.ai) |

| Histórico de fundação | Fundada pelo autor principal do Swin Transformer, Cao Yue |

| Localização da sede | Pequim, China |

| Tamanho da equipe | Menos de 30 pessoas, idade média abaixo de 30 anos |

| Missão da empresa | "Promover a IA para beneficiar a todos", abraçando o código aberto e a colaboração aberta |

| CEO | Cao Yue (Yue Cao), ex-chefe do Centro de Pesquisa de Modelos Visuais do Instituto de Pesquisa de IA de Pequim (BAAI) |

| Produto principal | Modelo de geração de vídeo autorregressivo MAGI / MAGI-1 / MAGI-1.1 |

| Lançamento inicial | 21 de abril de 2025 (MAGI-1) |

| Versão mais recente | MAGI-1.1 (100% código aberto) |

| Especificações do modelo | Versões de 24B e 4.5B parâmetros |

| Licença de código aberto | Apache 2.0, GitHub SandAI-org/MAGI-1 + Hugging Face sand-ai/MAGI-1 |

| Inovação principal | Combinação de autorregressão + difusão (Autoregressive Denoising Diffusion) |

| Acesso Web | magi.sand.ai/app/projects |

| Plataforma de API | platform.sand.ai/docs |

| Principais concorrentes | Série Wan, HunyuanVideo, Hailuo, Sora, etc. |

🎯 Dica para compreensão rápida: Se você quiser lembrar da Sand AI em apenas uma frase, pode dizer: "É uma startup de código aberto que trouxe a expertise em modelagem visual do Swin Transformer para a geração de vídeo". Se você quiser experimentar agora a diferença entre o MAGI e outros modelos de vídeo, sugerimos usar primeiro uma plataforma unificada como a APIYI (apiyi.com) para testar modelos maduros como Sora 2 / Veo 3.1 / Kling, e depois baixar o MAGI-1.1 no sand.ai / Hugging Face para comparar. Assim, você notará imediatamente a diferença da "rota autorregressiva".

Contexto da Sand AI e o DNA da equipe

Para entender por que a Sand AI conseguiu criar um modelo de vídeo competitivo logo de cara, precisamos olhar para o background da equipe.

Fundador: Cao Yue, o pai do Swin Transformer

O CEO da Sand AI, Cao Yue (Yue Cao), é um nome bastante conhecido no círculo de IA da China e também no meio acadêmico internacional. Seu currículo principal pode ser resumido nos pontos abaixo:

| Período | Experiência |

|---|---|

| 2019-2022 | Pesquisador sênior na Microsoft Research Asia, autor principal do Swin Transformer |

| 2021 | Swin Transformer ganha o prêmio de melhor artigo (Marr Prize) na ICCV 2021 |

| 2022-2023 | Cofundador da Lightyear AI, posteriormente adquirida pela Meituan |

| 2023-2024 | Chefe do centro de pesquisa de modelos visuais na Beijing Academy of Artificial Intelligence (BAAI), focado em modelos visuais fundamentais e modelos de linguagem grande multimodais |

| 2024 até hoje | Fundador da Sand AI, atuando como CEO |

A influência do Swin Transformer continua até hoje — o artigo já foi citado mais de 30.000 vezes no Google Scholar e é amplamente utilizado em fluxos de compreensão visual de produtos como Microsoft Office 365, Azure Cognitive Service, TikTok e Kuaishou. Ele também é o trabalho precursor do Video Swin Transformer. De certa forma, o próprio Cao Yue representa a continuidade da trajetória técnica que vai da "compreensão visual à geração de vídeo".

Tamanho da equipe: um "pequeno time de elite" com menos de 30 pessoas

A estrutura da equipe da Sand AI é muito diferente da maioria das empresas de modelos de linguagem grande: o total de funcionários é inferior a 30 pessoas, cobrindo 4 áreas: produto, marketing, engenharia e pesquisa, com uma idade média da equipe principal abaixo de 30 anos. Essa estrutura de equipe pequena é relativamente rara na onda de startups de modelos de linguagem grande dos últimos anos, mas também significa que:

- A cadeia de decisão é curta e a velocidade de iteração é rápida;

- Engenharia e pesquisa são altamente acopladas, permitindo que inovações de nível acadêmico se tornem produtos diretamente;

- Não existem as "paredes departamentais" típicas de grandes empresas; 3 pessoas conseguem implementar um novo fluxo de trabalho.

Esse DNA "pequeno e robusto" é a razão importante pela qual a Sand AI conseguiu lançar um modelo de alta maturidade como o MAGI-1 em abril de 2025.

Missão da empresa e postura em relação ao código aberto

A missão da Sand AI, definida em sua página "sobre nós", é: "Avançar a IA para beneficiar a todos", e a empresa declara explicitamente que quer "abraçar o código aberto, promover o progresso por meio da colaboração aberta e tornar a IA de ponta acessível a todos". Isso não é apenas um slogan de marketing — os modelos MAGI-1 e MAGI-1.1 lançados posteriormente pela Sand AI foram totalmente abertos sob a licença Apache 2.0, disponibilizando pesos, código de inferência e versões destiladas no GitHub e Hugging Face. Essa postura de código aberto é extremamente agressiva no atual cenário de geração de vídeo.

MAGI, o produto carro-chefe da Sand AI: um novo paradigma para geração de vídeo autorregressiva

Após entender a equipe, vamos ao ponto principal — a série MAGI, produto carro-chefe da Sand AI. Ela tem uma diferença fundamental em relação a soluções convencionais como Sora, Kling, Veo e HunyuanVideo: não é um modelo de difusão puro que "gera o vídeo inteiro de uma vez", mas sim uma combinação de "autorregressão" com "difusão", gerando o vídeo em blocos (chunks).

Fatos importantes sobre o MAGI

| Dimensão | MAGI / MAGI-1 / MAGI-1.1 |

|---|---|

| Lançamento inicial | 21 de abril de 2025 |

| Versão mais recente | MAGI-1.1 (100% código aberto) |

| Especificações de parâmetros | 24B (versão completa) + 4.5B (versão leve) |

| Versões destiladas | 4.5B Distill + Distill+Quant (lançado em 26 de maio de 2025) |

| Licença de código aberto | Apache 2.0 |

| Repositório | github.com/SandAI-org/MAGI-1 / huggingface.co/sand-ai/MAGI-1 |

| Duração da geração de vídeo | Atualmente 1-10 segundos, suporta extensão infinita |

| Quadros por segmento | 24 quadros por chunk, com remoção de ruído conjunta |

| Capacidade de concorrência | Processa até 4 chunks simultaneamente |

| Tempo de geração | Geralmente 1-2 minutos para obter o resultado |

| Suporte a estilos | Vídeo realista + estilo 3D semi-cartoon |

| Capacidade de controle | Controle de linha do tempo em nível de segundo + prompt por bloco |

| Compreensão física | Liderança significativa na continuação de vídeo no benchmark Physics-IQ |

| Posicionamento de desempenho | SOTA entre os modelos de código aberto, superior ao Wan-2.1 / HunyuanVideo, superando o Hailuo (fechado) |

Autorregressão + Difusão: por que é um novo paradigma

Os modelos de difusão de vídeo convencionais (Sora, Veo, Kling, etc.) geralmente tratam o vídeo inteiro como um tensor para realizar a remoção de ruído de uma só vez. Esse método é muito forte na qualidade da imagem, mas tem dois defeitos inerentes:

- Difícil de estender infinitamente: a duração do vídeo que o modelo pode gerar de uma vez é limitada pela memória de vídeo (VRAM) e pela latência durante a inferência;

- Consistência física fraca: ao gerar tudo de uma vez, falta a cadeia causal de "inferir o próximo quadro a partir do quadro anterior".

A rota escolhida pelo MAGI é dividir o vídeo em chunks de 24 quadros, realizando a remoção de ruído por difusão dentro de cada chunk, enquanto os chunks seguem restrições causais autorregressivas entre si. Isso significa que:

- Quer um vídeo mais longo? Basta continuar a autorregressão para trás, teoricamente sem limite — é por isso que o site da sand.ai enfatiza as "capacidades de extensão de vídeo infinito";

- Quer uma física mais realista? Cada quadro é baseado nos quadros gerados anteriormente, por isso tem uma vantagem estrutural em benchmarks de previsão física como o Physics-IQ;

- Quer um controle mais refinado? Você pode fornecer um comando (prompt) separado para cada chunk, criando um efeito de "direção por segmentos".

Esse design teve um desempenho muito notável nos testes da própria Sand AI: superou concorrentes fortes como Wan-2.1 e HunyuanVideo entre os modelos de código aberto, e também superou o Hailuo em comparações com modelos fechados, sendo "significativamente superior a todos os modelos existentes" no benchmark Physics-IQ.

Inovações de engenharia na arquitetura do MAGI

Para fazer a rota de autorregressão + difusão funcionar de verdade, a Sand AI inseriu todo um conjunto de modificações arquiteturais no MAGI:

| Módulo | Função |

|---|---|

| Block-Causal Attention | Permite conexões causais entre chunks, evitando o vazamento de informações futuras |

| Parallel Attention Block | Aumenta a eficiência paralela dentro de um único chunk |

| QK-Norm + GQA | Estabiliza o treinamento + reduz a carga do KV Cache |

| Sandwich Normalization in FFN | Estabiliza ainda mais o treinamento de modelos grandes |

| SwiGLU | Aumenta a capacidade de expressão não linear |

| Softcap Modulation | Controla valores extremos da distribuição de atenção |

| Transformer-based VAE | Velocidade de decodificação mais rápida |

Essas inovações, isoladamente, não são consideradas "revolucionárias", mas, quando combinadas, permitem que o MAGI-1 possua simultaneamente 4 capacidades que muitas vezes são difíceis de conciliar: vídeo longo, física forte, controlabilidade e escalabilidade.

🎯 Sugestão de seleção de arquitetura: se o seu negócio precisa de "continuação de vídeo longo" ou "controlabilidade em nível de cena", o paradigma de autorregressão + difusão do MAGI merece ser considerado. Antes que ele ofereça uma API comercial oficial, você pode usar modelos já comercializados como Sora 2, Veo 3.1, Kling 3.0, etc., no serviço proxy de API da APIYI (apiyi.com) para concluir o protótipo do produto e, quando a API comercial do MAGI estiver madura, fazer a migração sem problemas.

Como a Sand AI entrega o MAGI para desenvolvedores

Ter um modelo poderoso não é tudo; a Sand AI também projetou sua jornada de entrega de forma bastante técnica. Do usuário comum ao desenvolvedor e ao pesquisador, a sand.ai oferece três pontos de entrada distintos.

Três formas de usar o MAGI

| Entrada | Endereço | Público-alvo |

|---|---|---|

| Aplicativo Web | magi.sand.ai/app/projects |

Criadores de conteúdo / Usuários comuns, para gerar imagens diretamente no navegador |

| Plataforma de API | platform.sand.ai/docs |

Desenvolvedores que desejam integrar o MAGI em seus próprios produtos |

| Repositório Open Source | github.com/SandAI-org/MAGI-1 + huggingface.co/sand-ai/MAGI-1 |

Pesquisadores / Equipes de auto-hospedagem, para rodar os pesos localmente |

Esses três caminhos cobrem todo o espectro de necessidades, desde a "geração sem código" até a "integração de engenharia" e a "auto-hospedagem completa". Comparada a equipes que "apenas publicam artigos sem liberar pesos" ou "apenas disponibilizam demos sem abrir o código", a abordagem da Sand AI é muito mais abrangente.

O significado técnico das versões 24B e 4.5B

O MAGI-1 oferece simultaneamente especificações de 24B e 4.5B de parâmetros, o que por si só demonstra que a Sand AI quer atender a dois tipos de usuários:

- Versão completa 24B: voltada para pesquisadores e empresas com recursos de GPU abundantes que buscam a mais alta qualidade de imagem;

- Versão destilada 4.5B: voltada para equipes focadas em implantação de engenharia que buscam o equilíbrio entre custo e latência. Em maio, foi adicionada a versão Distill+Quant, comprimindo ainda mais o uso de VRAM.

Esse ritmo de lançamento de "modelo duplo (alto e baixo desempenho) + destilação contínua" é praticamente a estratégia mais madura para modelos de linguagem grandes open source em 2025-2026. Nesse ponto, a Sand AI mantém o mesmo passo de gigantes do código aberto como Mistral e Qwen.

O posicionamento e as lições da Sand AI no setor de geração de vídeo

Ao conectar o histórico, o produto e a jornada de entrega, o posicionamento da Sand AI no setor de geração de vídeo em 2026 torna-se bastante claro.

Por que vale a pena acompanhar

| Ângulo | Valor diferencial da Sand AI |

|---|---|

| Profundidade acadêmica | DNA da equipe do Swin Transformer, com inovação contínua na arquitetura de rede |

| Escolha de rota | Autorregressão + difusão é um terceiro caminho pouco explorado, não apenas uma cópia do Sora |

| Nível de abertura | Apache 2.0 + pesos + código + versão destilada, tudo público |

| Formato do produto | Três entradas: Web, API e auto-hospedagem |

| Compreensão física | Referência em Physics-IQ, ideal para conteúdos de divulgação científica, educação e pesquisa |

| Vídeos longos | A rota autorregressiva suporta naturalmente extensões ilimitadas |

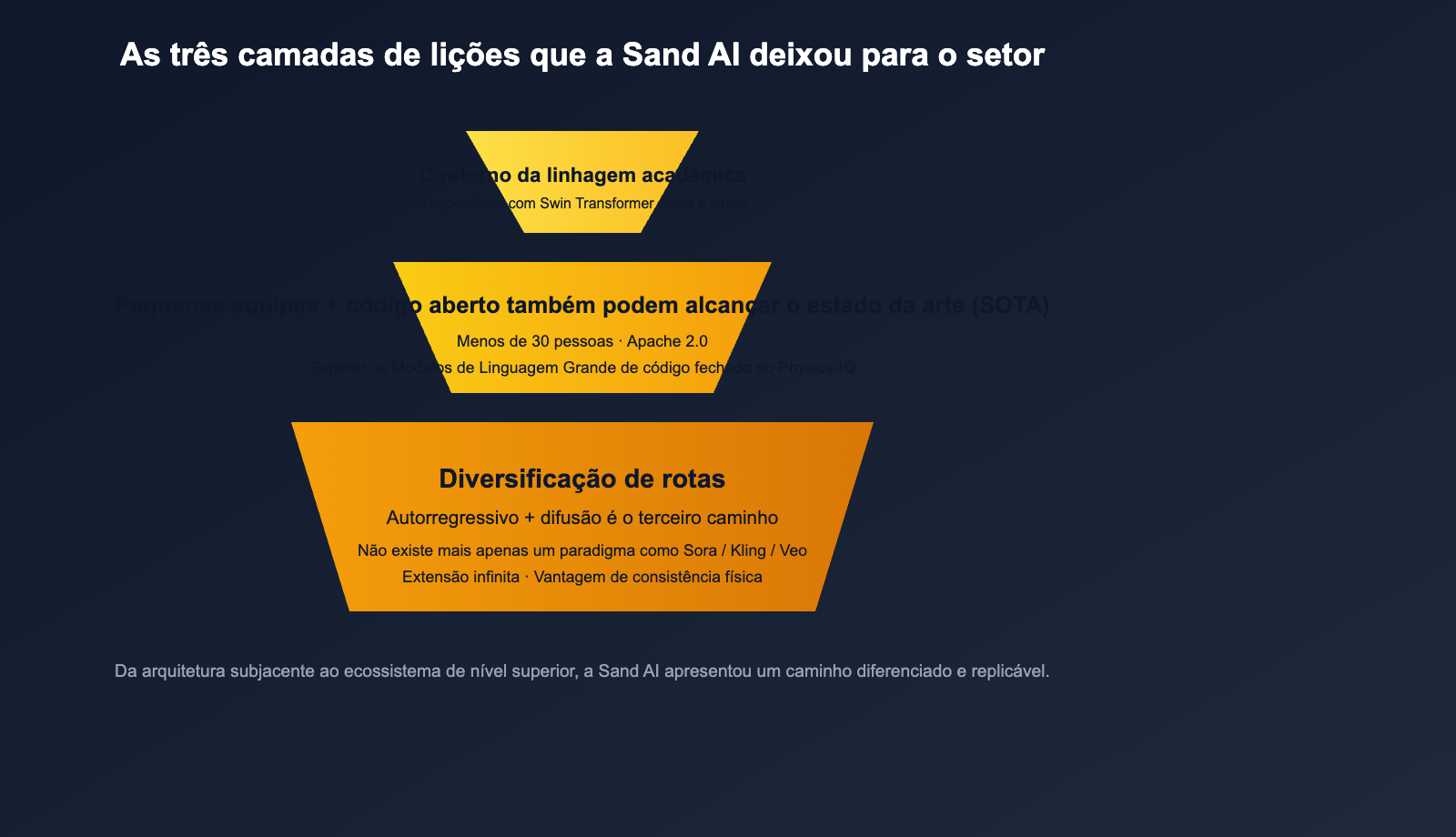

Três lições para a indústria

A rápida ascensão da Sand AI deixou pelo menos três lições para todo o setor de geração de vídeo:

- Diversificação de rotas: Além de Sora, Veo e Kling, o caminho da autorregressão + difusão é viável e possui vantagens estruturais na consistência física;

- Equipes pequenas + código aberto também podem alcançar o SOTA: Com menos de 30 pessoas e licença Apache 2.0, ainda é possível superar muitos gigantes de modelos fechados no Physics-IQ;

- O retorno da linhagem acadêmica: A experiência de treinamento de "modelos visuais clássicos", como o Swin Transformer, ainda possui um forte valor de continuidade na era da geração de vídeo.

Esses três pontos servem como referência direta para equipes que desejam entrar no mercado de geração de vídeo em 2026 — você não precisa de 1.000 GPUs H100 para criar um modelo decente, mas certamente precisa de uma cultura de engenharia que "entenda de arquitetura, tenha coragem de abrir o código e se dedique à consistência física".

🎯 Sugestão de integração de ecossistema: Para equipes que desejam incluir modelos de vídeo "abertos e fechados" em seus produtos, recomendamos gerenciar o Sora 2, Veo 3.1, Kling 3.0, MAGI-1, entre outros, sob uma interface unificada. Enquanto a API comercial do MAGI não for amplamente aberta, você pode começar integrando modelos de vídeo já comercializados através da APIYI (apiyi.com) para validar seu modelo de negócio, enquanto aguarda a abertura da

platform.sand.aipela Sand AI.

Sand AI: Para quem é e para quem não é

Voltando a uma questão muito prática: você deveria usar o MAGI da Sand AI agora? A resposta depende das suas necessidades específicas em geração de vídeo.

Público-alvo

| Público | Motivo da recomendação |

|---|---|

| Pesquisadores / Autores de artigos | Código aberto completo + novo paradigma autorregressivo, ideal para trabalhos acadêmicos |

| Equipes de auto-hospedagem / implantação privada | Licença Apache 2.0 + versão destilada de 4.5B, permite rodar pesos localmente |

| Criadores de conteúdo educacional / física | Liderança em Physics-IQ, excelente consistência física |

| Necessidade de extensão de vídeos longos | Rota autorregressiva com suporte nativo para extensão infinita |

| Produtos de "geração controlável por cena" | Suporte a linha do tempo em segundos + comando por blocos (chunk-wise) |

| Ecossistema de IA em chinês | Equipe sediada em Pequim, excelente suporte a comando em chinês |

Não recomendado para

| Público | Motivo |

|---|---|

| Usuários que buscam apenas "resultado rápido" | A UX de produtos maduros como Sora 2 / Kling ainda é mais leve |

| Pequenas equipes que não querem auto-hospedagem | A API comercial platform.sand.ai ainda está em constante aprimoramento |

| Produções nível cinema (4K + longa duração + áudio) | O foco atual ainda é pesquisa / criatividade, não pós-produção cinematográfica |

| Usuários focados apenas em aplicação sem preocupação com licença | Chamar APIs fechadas é mais prático e descomplicado |

🎯 Sugestão de teste: Se você quer "ver o resultado imediatamente", recomendamos acessar o magi.sand.ai e usar a aplicação web (sem login ou com registro rápido). Se quiser comparar as diferenças reais entre o Sand AI e outros modelos de vídeo, você pode usar o serviço proxy de API APIYI (apiyi.com) para invocar o Sora 2 / Veo 3.1 / Kling 3.0, usando o mesmo comando para gerar vídeos em paralelo e julgar visualmente se a rota autorregressiva do MAGI é realmente a mais adequada para o seu negócio.

FAQ: Perguntas frequentes sobre o Sand AI

Q1: O que é a Sand AI? É do mesmo tipo que a Stability AI ou Midjourney?

A Sand AI é uma startup de IA fundada em Pequim, na China, por Yue Cao, autor principal do Swin Transformer. A equipe central conta com menos de 30 pessoas. Diferente da Stability AI (focada em imagens) e da Midjourney (focada em assinaturas de modelos fechados), a Sand AI é especializada em geração de vídeo e adotou uma rota de código aberto completo (Apache 2.0). Seu produto principal é o modelo de geração de vídeo autorregressivo MAGI-1 / MAGI-1.1.

Q2: Qual a diferença fundamental entre o MAGI-1 e o Sora, Kling ou Veo?

A maior diferença está na rota técnica: enquanto modelos como Sora / Veo / Kling geram o vídeo inteiro de uma só vez, o MAGI divide o vídeo em blocos (chunks) de 24 quadros. Dentro de cada bloco, é feita a difusão para remoção de ruído, e a conexão entre os blocos é feita de forma autorregressiva. Esse paradigma confere ao MAGI vantagens estruturais em "extensão infinita de vídeo" e "consistência física" — a equipe oficial da Sand AI demonstrou resultados significativamente superiores no benchmark Physics-IQ.

Q3: O MAGI-1 é realmente código aberto? Posso usar comercialmente?

Sim. O MAGI-1 e o MAGI-1.1 são licenciados sob o protocolo Apache 2.0 no GitHub (SandAI-org/MAGI-1) e no Hugging Face (sand-ai/MAGI-1), com código, pesos e ferramentas de inferência disponíveis. O Apache 2.0 é uma licença muito amigável que permite uso comercial, modificações e derivações de código fechado, exigindo apenas a manutenção do aviso de direitos autorais. Isso significa que você pode integrar o MAGI-1 em seus produtos ou realizar treinamentos adicionais baseados nele.

Q4: Qual hardware é necessário para rodar o MAGI-1 localmente?

A versão completa do MAGI-1 possui 24B de parâmetros e exige GPUs profissionais com múltiplas placas para inferência local. Se o seu orçamento de hardware for limitado, recomendamos a versão destilada de 4.5B ou a versão Distill+Quant lançada pela Sand AI em maio de 2025; a demanda por VRAM é significativamente menor, permitindo rodar até em uma única GPU de consumo de alto desempenho. Se você quer apenas "ver o resultado", recomendamos usar a aplicação web em magi.sand.ai, sem necessidade de configuração local.

Q5: O Sand AI possui API comercial? Como ela se compara ao Sora e ao Kling?

A plataforma de API comercial da Sand AI, platform.sand.ai, já está no ar, mas a maturidade do ecossistema ainda está correndo atrás de modelos já consolidados como Sora e Kling. Se você está desenvolvendo um produto que precisa de "disponibilidade imediata, cotas robustas e suporte a comandos em chinês", sugerimos usar o serviço proxy de API APIYI (apiyi.com) para invocar modelos já comercializados como Sora 2, Veo 3.1 ou Kling 3.0 para validar seu negócio, enquanto acompanha o ritmo de abertura da API da Sand AI para uma futura migração ou integração paralela.

Q6: Vale a pena ficar de olho na Sand AI?

Com certeza. Por dois motivos: primeiro, a linhagem acadêmica da equipe do Swin Transformer sugere que as iterações futuras do MAGI provavelmente trarão inovações arquiteturais, e não apenas aumento de dados; segundo, a Sand AI escolheu um caminho diferenciado de "autorregressão + difusão + código aberto completo". Se essa estratégia for bem-sucedida, ela influenciará a escolha de paradigmas para todo o setor de geração de vídeo open-source em 2026-2027. Seja você um pesquisador, desenvolvedor de produto ou criador de conteúdo, recomendamos adicionar a sand.ai à sua lista de observação contínua.

Resumo: Qual é a resposta definitiva sobre a Sand AI?

Voltando à pergunta inicial — "O que é a Sand AI?" — agora podemos dar uma resposta bastante completa: A Sand AI é uma startup de IA com menos de 30 pessoas, fundada em Pequim por Cao Yue, um dos autores principais do Swin Transformer. Seu carro-chefe é o modelo de geração de vídeo autorregressivo de código aberto MAGI-1 / MAGI-1.1. O modelo obteve resultados superiores à maioria dos modelos de código aberto e a alguns modelos de código fechado em benchmarks de consistência física, como o Physics-IQ, disponibilizando todo o conjunto de pesos e o código sob a licença Apache 2.0 no GitHub e no Hugging Face. É uma "estrela em ascensão" na geração de vídeo com "DNA acadêmico sólido, uma abordagem inovadora e um compromisso total com o código aberto".

Para desenvolvedores e pesquisadores, o verdadeiro significado da Sand AI não é apenas "mais um modelo de vídeo", mas sim fornecer uma rota diferenciada e replicável para todo o setor de geração de vídeo: sem depender de poder computacional massivo, sem cercadinhos de código fechado e sem bombardeios de marketing, mas sim baseando-se em fundamentos acadêmicos, inovação arquitetônica e código aberto completo. Se antes de 2025 o setor de geração de vídeo era dominado pelo Sora, o surgimento da Sand AI traz para o ecossistema de código aberto de 2026 a possibilidade de que "pequenas equipes também podem alcançar o estado da arte (SOTA)".

🎯 Sugestão final: Para acompanhar as novidades da Sand AI e do MAGI em primeira mão, recomendamos três passos: 1) Acompanhe as atualizações em sand.ai e na organização

sand-aino Hugging Face; 2) Utilize a aplicação web em magi.sand.ai para testar suas próprias demandas e ter uma experiência prática; 3) Integre o MAGI e modelos comerciais como Sora 2, Veo 3.1 e Kling 3.0 em uma plataforma unificada como a APIYI (apiyi.com) para realizar uma comparação horizontal e avaliar o valor real do modelo para o seu negócio com base em seus próprios benchmarks. Após seguir este fluxo, a resposta sobre se a Sand AI merece ser incluída na sua pilha de ferramentas de geração de vídeo surgirá naturalmente.

Autor: Equipe APIYI | Focados na implementação de Modelos de Linguagem Grande e no ecossistema de código aberto. Para mais avaliações de modelos de vídeo e multimodais, visite APIYI em apiyi.com.