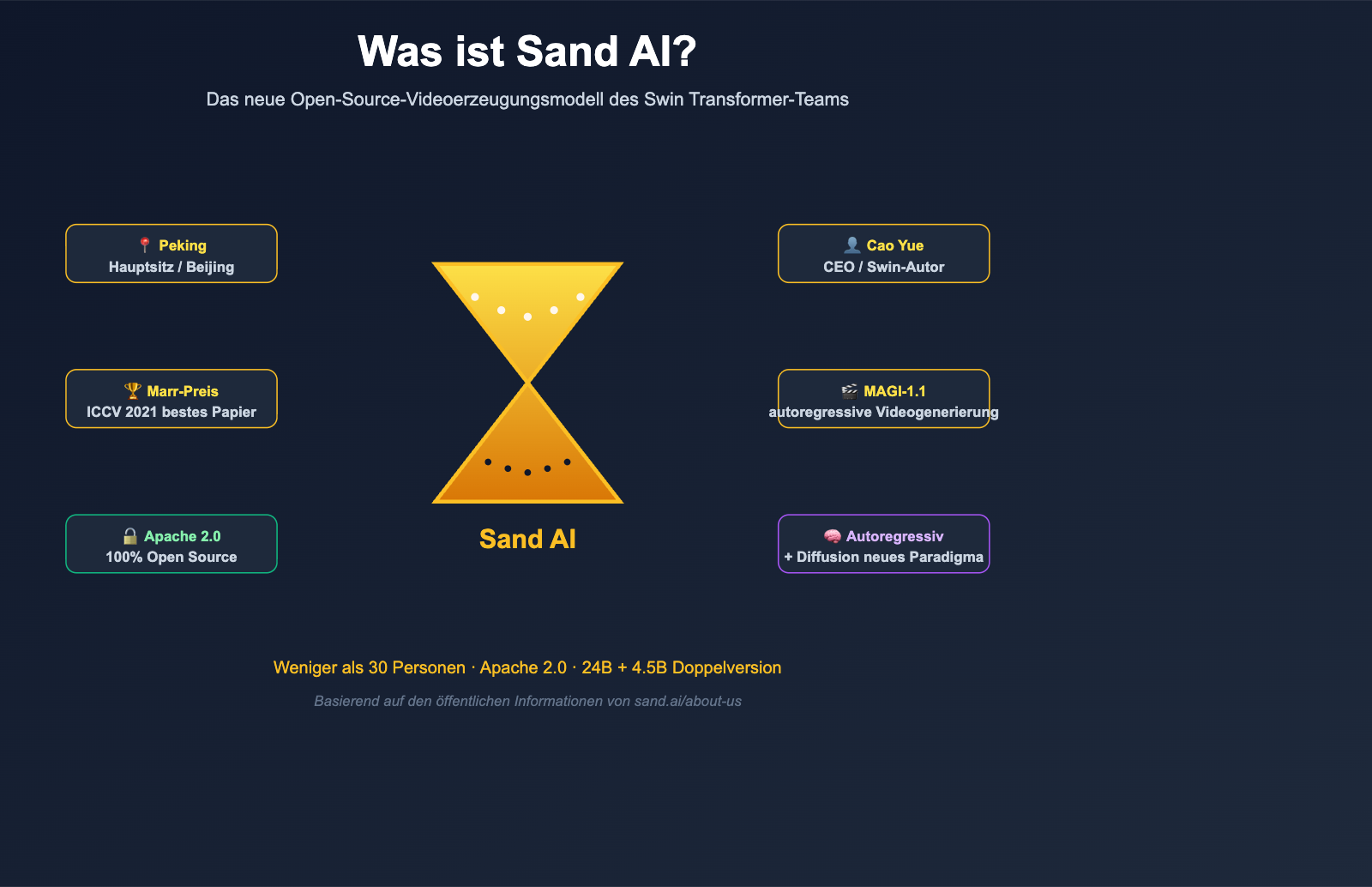

Falls Sie in letzter Zeit auf Hugging Face, GitHub oder im englischsprachigen AI-Twitter immer wieder über den Namen Sand AI gestolpert sind und neugierig auf die Modelle MAGI-1 / MAGI-1.1 geworden sind, ist dieser Artikel genau das Richtige für Sie. Im Gegensatz zu vielen „plötzlich aus dem Nichts aufgetauchten Videomodell-Teams“ hat Sand AI einen äußerst fundierten Hintergrund: Der CEO Cao Yue ist einer der Hauptautoren des Swin Transformer. Dieses Paper gewann den Best Paper Award (Marr Prize) auf der ICCV 2021, wurde über 30.000 Mal zitiert und wird von Branchengrößen wie Microsoft Office 365, Azure, TikTok und Kuaishou eingesetzt. Mit anderen Worten: Sand AI ist kein kurzfristiges Projekt, sondern das Ergebnis eines Teams, das seine zehnjährige Erfahrung mit visuellen Modellen direkt in die Videogenerierung einbringt.

Was die internationale Community besonders begeistert, ist, dass Sand AI nicht nur ein leistungsfähiges Videomodell entwickelt hat, sondern sich auch für eine vollständige Open-Source-Strategie entschieden hat – das gesamte MAGI-1-Paket inklusive Gewichten, Code und Inferenz-Tools steht unter der Apache-2.0-Lizenz auf GitHub und Hugging Face bereit. In der Welle der „Open-Source-Videomodelle aus China“ (2025–2026) ist Sand AI eines der wenigen Teams, das den neuen Ansatz der „autoregressiven Videogenerierung“ erfolgreich umgesetzt und veröffentlicht hat. Dieser Artikel beleuchtet das Unternehmen, den Werdegang des Gründers, die MAGI-Technologiearchitektur, die Open-Source-Strategie und die Zielgruppe – kurzum: alles, was Sie über Sand AI wissen müssen.

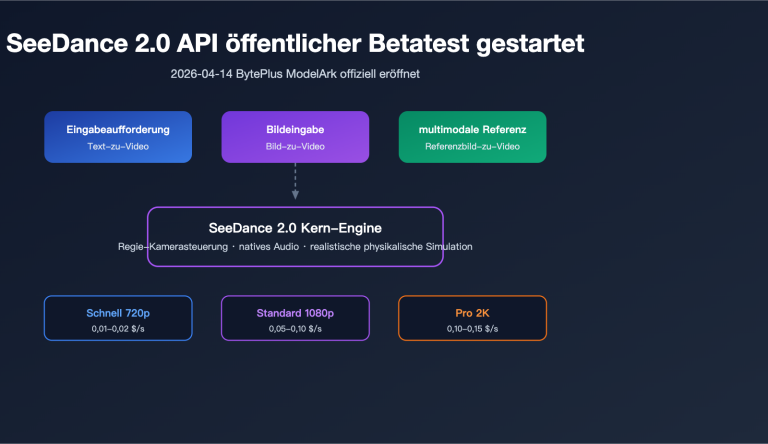

Die wichtigsten Fakten zu Sand AI auf einen Blick

Bevor wir in die Details gehen, haben wir hier die wichtigsten Fakten zu Sand AI kompakt zusammengefasst.

| Dimension | Öffentliche Informationen zu Sand AI |

|---|---|

| Firmenname | Sand AI (Website sand.ai) |

| Hintergrund | Gegründet von Cao Yue, Hauptautor des Swin Transformer |

| Hauptsitz | Peking, China |

| Teamgröße | Unter 30 Personen, Durchschnittsalter unter 30 Jahren |

| Mission | „KI vorantreiben, damit jeder davon profitiert“, Fokus auf Open Source und Zusammenarbeit |

| CEO | Cao Yue (Yue Cao), ehemaliger Leiter des Visual Model Research Center am BAAI |

| Flaggschiff-Produkte | MAGI / MAGI-1 / MAGI-1.1 autoregressive Videogenerierungsmodelle |

| Erstveröffentlichung | 21. April 2025 (MAGI-1) |

| Aktuelle Version | MAGI-1.1 (100% Open Source) |

| Modellgrößen | 24B und 4.5B Parameter-Versionen |

| Lizenz | Apache 2.0, GitHub SandAI-org/MAGI-1 + Hugging Face sand-ai/MAGI-1 |

| Kerninnovation | Kombination aus autoregressiver und Diffusions-Technik (Autoregressive Denoising Diffusion) |

| Web-Portal | magi.sand.ai/app/projects |

| API-Plattform | platform.sand.ai/docs |

| Hauptkonkurrenten | Wan-Serie, HunyuanVideo, Hailuo, Sora etc. |

🎯 Kurztipp für den Einstieg: Wenn Sie Sand AI in einem Satz zusammenfassen wollen: „Es ist ein Open-Source-Startup, das die Expertise aus dem Swin Transformer in die Videogenerierung überträgt.“ Wenn Sie die Unterschiede zwischen MAGI und anderen Videomodellen selbst testen möchten, empfehlen wir, zunächst etablierte Modelle wie Sora 2, Veo 3.1 oder Kling über eine Plattform wie APIYI (apiyi.com) auszuprobieren und anschließend MAGI-1.1 von sand.ai oder Hugging Face zum Vergleich heranzuziehen. So werden die Besonderheiten des „autoregressiven Ansatzes“ sofort deutlich.

Hintergrund und Team-DNA von Sand AI

Um zu verstehen, warum Sand AI auf Anhieb ein wettbewerbsfähiges Videomodell entwickeln konnte, muss man sich den Hintergrund des Teams ansehen.

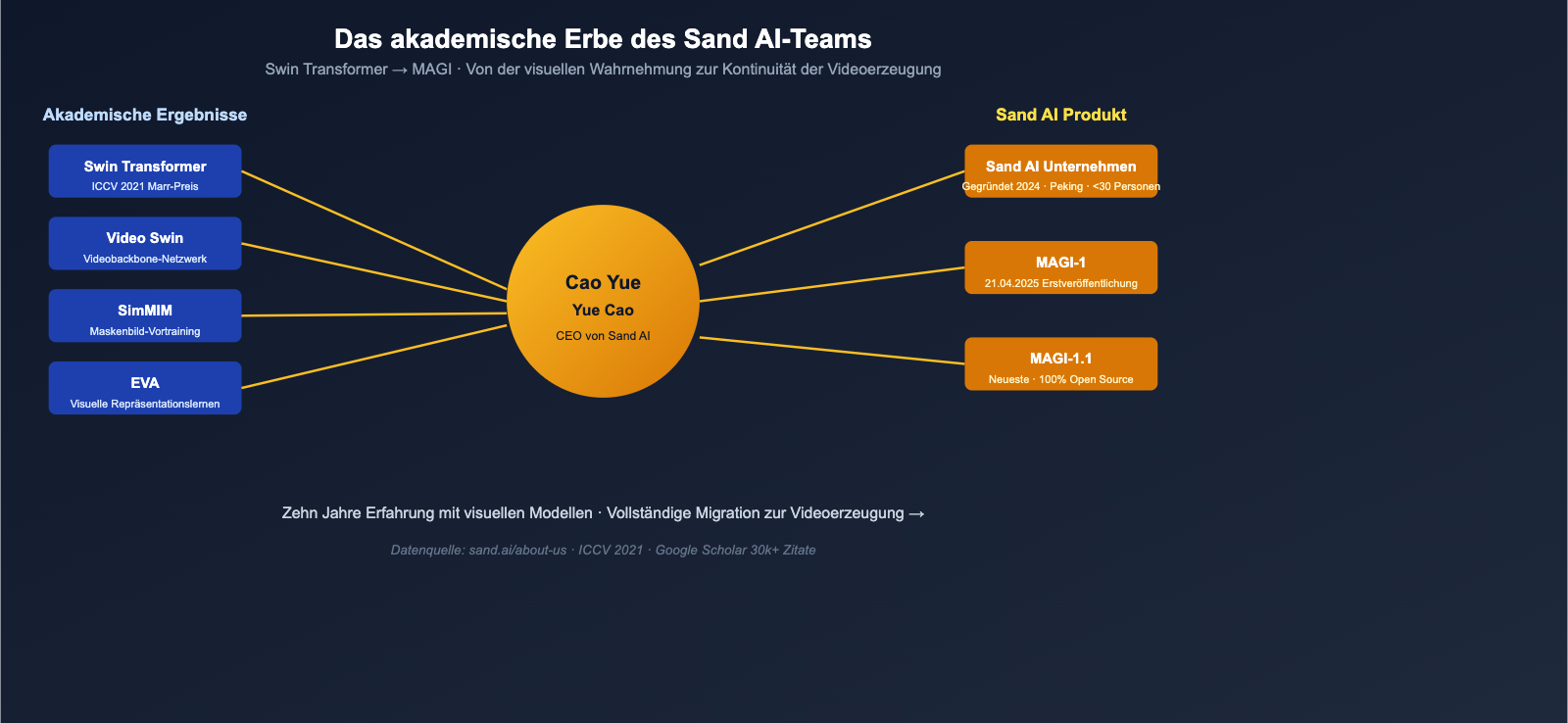

Der Gründer: Cao Yue, der Vater des Swin Transformer

Der CEO von Sand AI, Cao Yue (Yue Cao), ist in der chinesischen KI-Szene ebenso ein bekannter Name wie in der internationalen akademischen Welt. Sein beruflicher Werdegang lässt sich wie folgt zusammenfassen:

| Zeitraum | Erfahrung |

|---|---|

| 2019-2022 | Senior Researcher bei Microsoft Research Asia, Hauptautor des Swin Transformer |

| 2021 | Swin Transformer gewinnt den ICCV 2021 Best Paper Award (Marr Prize) |

| 2022-2023 | Mitgründer von Lightyear AI, später von Meituan übernommen |

| 2023-2024 | Leiter des Visual Model Research Center am Beijing Academy of Artificial Intelligence (BAAI), Fokus auf visuelle Basismodelle und multimodale Großmodelle |

| 2024 bis heute | Gründung von Sand AI, CEO |

Der Einfluss des Swin Transformer hält bis heute an – das Paper wurde bei Google Scholar über 30.000 Mal zitiert und findet breite Anwendung in der visuellen Analyse von Produkten wie Microsoft Office 365, Azure Cognitive Services, TikTok und Kuaishou. Es ist zudem die Grundlage für den Video Swin Transformer. In gewisser Weise verkörpert Cao Yue die Kontinuität des technologischen Pfades "von der visuellen Analyse zur Videoerzeugung".

Teamgröße: Ein "Ultra-Elite-Team" von unter 30 Personen

Die Teamstruktur von Sand AI unterscheidet sich stark von den meisten Unternehmen für Großmodelle: Insgesamt sind weniger als 30 Personen beschäftigt, die die Bereiche Produkt, Marketing, Engineering und Forschung abdecken. Das Durchschnittsalter des Kernteams liegt unter 30 Jahren. Eine solch kleine Struktur ist im aktuellen KI-Boom selten, bedeutet aber:

- Kurze Entscheidungswege und schnelle Iterationszyklen;

- Enge Verzahnung von Engineering und Forschung, wodurch Innovationen aus Forschungspapieren direkt in Produkte einfließen;

- Keine starren Abteilungsstrukturen wie in Großkonzernen; 3 Personen reichen aus, um eine neue Pipeline umzusetzen.

Diese "kleine, aber schlagkräftige" DNA ist der Hauptgrund dafür, dass Sand AI bereits im April 2025 ein so ausgereiftes Modell wie MAGI-1 präsentieren konnte.

Unternehmensmission und Open-Source-Haltung

Auf seiner "About Us"-Seite definiert Sand AI seine Mission als: "Advance AI to benefit everyone (KI voranbringen, um jedem zu nutzen)". Das Unternehmen betont ausdrücklich, dass es "Open Source begrüßt, durch offene Zusammenarbeit Fortschritte erzielt und modernste KI für alle zugänglich macht". Dies ist kein bloßer Marketing-Slogan – die von Sand AI veröffentlichten Modelle MAGI-1 und MAGI-1.1 sind unter der Apache 2.0-Lizenz vollständig quelloffen. Gewichte, Inferenz-Code und destillierte Versionen wurden auf GitHub und Hugging Face bereitgestellt. Diese Open-Source-Einstellung ist im aktuellen Bereich der Videoerzeugung äußerst progressiv.

Sand AI Flaggschiffprodukt MAGI: Ein neues Paradigma der autoregressiven Videoerzeugung

Nachdem wir das Team kennengelernt haben, kommen wir zum eigentlichen Highlight – der MAGI-Serie von Sand AI. Sie unterscheidet sich technologisch grundlegend von gängigen Lösungen wie Sora, Kling, Veo oder HunyuanVideo: Es ist kein reines Diffusionsmodell, das "ein ganzes Video auf einmal generiert", sondern kombiniert "autoregressive" Ansätze mit Diffusion, um Videos blockweise (Chunk-basiert) zu erzeugen.

Wichtige Fakten zu MAGI

| Dimension | MAGI / MAGI-1 / MAGI-1.1 |

|---|---|

| Erstveröffentlichung | 21. April 2025 |

| Aktuelle Version | MAGI-1.1 (100% Open Source) |

| Parameter | 24B (Vollversion) + 4.5B (Light-Version) |

| Destillierte Version | 4.5B Distill + Distill+Quant (veröffentlicht am 26. Mai 2025) |

| Open-Source-Lizenz | Apache 2.0 |

| Repository | github.com/SandAI-org/MAGI-1 / huggingface.co/sand-ai/MAGI-1 |

| Videolänge | Aktuell 1-10 Sekunden, unterstützt unendliche Verlängerung |

| Frames pro Segment | 24 Frames pro Chunk, gemeinsame Entrauschung |

| Parallelität | Gleichzeitige Verarbeitung von bis zu 4 Chunks |

| Generierungsdauer | Normalerweise 1-2 Minuten |

| Stilunterstützung | Realistische Videos + 3D-Halb-Cartoon-Stil |

| Steuerung | Zeitachsensteuerung im Sekundenbereich + segmentierte Eingabeaufforderung |

| Physikverständnis | Führend bei der Videofortsetzung basierend auf Physics-IQ |

| Leistungsniveau | SOTA bei Open-Source-Modellen, übertrifft Wan-2.1 / HunyuanVideo, übertrifft Hailuo |

Autoregressiv + Diffusion: Warum es ein neues Paradigma ist

Gängige Videodiffusionsmodelle (Sora, Veo, Kling etc.) behandeln das gesamte Video meist als einen einzigen Tensor, der entrauscht wird. Dieser Ansatz ist zwar stark bei der Bildqualität, hat aber zwei inhärente Schwächen:

- Schwierige unendliche Verlängerung: Die Länge des Videos, das ein Modell auf einmal generieren kann, ist durch den VRAM und die Latenz bei der Inferenz begrenzt;

- Schwache physikalische Konsistenz: Da das gesamte Video auf einmal generiert wird, fehlt die kausale Kette von "vorherigem Frame zu nachfolgendem Frame".

MAGI wählt einen anderen Weg: Das Video wird in Chunks zu je 24 Frames zerlegt. Innerhalb jedes Chunks erfolgt eine Diffusions-Entrauschung, während zwischen den Chunks eine autoregressive kausale Verknüpfung besteht. Das bedeutet:

- Längeres Video gewünscht? Einfach autoregressiv weiter generieren, theoretisch ohne Obergrenze – deshalb betont die Website von sand.ai auch die "infinite video extension capabilities";

- Physikalisch realistischer? Jeder Frame basiert auf den zuvor generierten Frames, was bei physikalischen Vorhersage-Benchmarks wie Physics-IQ einen strukturellen Vorteil bietet;

- Feinere Steuerung? Für jeden Chunk kann eine separate Eingabeaufforderung (Prompt) eingegeben werden, was zu einer Art "Regie in Segmenten" führt.

Dieses Design hat sich in internen Tests von Sand AI als äußerst effektiv erwiesen: Es schlägt starke Konkurrenten wie Wan-2.1 und HunyuanVideo unter den Open-Source-Modellen und übertrifft auch geschlossene Modelle wie Hailuo. Beim Physics-IQ-Benchmark ist es "signifikant besser als alle existierenden Modelle".

Ingenieurstechnische Innovationen in der MAGI-Architektur

Damit der Ansatz "Autoregressiv + Diffusion" in der Praxis funktioniert, hat Sand AI eine Reihe von Architekturänderungen in MAGI implementiert:

| Modul | Funktion |

|---|---|

| Block-Causal Attention | Ermöglicht kausale Verbindungen zwischen Chunks und verhindert das Durchsickern zukünftiger Informationen |

| Parallel Attention Block | Erhöht die parallele Effizienz innerhalb eines Chunks |

| QK-Norm + GQA | Stabilisiert das Training + reduziert die Last des KV-Cache |

| Sandwich Normalization in FFN | Stabilisiert das Training großer Modelle weiter |

| SwiGLU | Verbessert die nichtlineare Ausdrucksfähigkeit |

| Softcap Modulation | Kontrolliert Extremwerte der Aufmerksamkeitsverteilung |

| Transformer-based VAE | Schnellere Dekodierungsgeschwindigkeit |

Diese Innovationen sind für sich genommen vielleicht nicht "bahnbrechend", aber in ihrer Kombination verleihen sie MAGI-1 die vier Fähigkeiten langes Video, starke Physik, Kontrollierbarkeit und Skalierbarkeit, die oft schwer gleichzeitig zu erreichen sind.

🎯 Empfehlung zur Architekturauswahl: Wenn Ihr Projekt "lange Videofortsetzungen" oder "kontrollierbare Szenenführung" erfordert, ist das autoregressive Diffusions-Paradigma von MAGI eine Überlegung wert. Bevor die kommerzielle API verfügbar ist, können Sie Prototypen mit bereits kommerzialisierten Modellen wie Sora 2, Veo 3.1 oder Kling 3.0 auf APIYI (apiyi.com) erstellen und nahtlos migrieren, sobald die kommerzielle API von MAGI ausgereift ist.

Wie Sand AI MAGI für Entwickler bereitstellt

Ein leistungsstarkes Modell allein reicht nicht aus. Sand AI hat auch den Bereitstellungsprozess sehr durchdacht gestaltet. Von Gelegenheitsnutzern über Entwickler bis hin zu Forschern bietet sand.ai drei verschiedene Zugangspunkte.

Drei Wege zur Nutzung von MAGI

| Zugang | Adresse | Zielgruppe |

|---|---|---|

| Web-App | magi.sand.ai/app/projects |

Content-Ersteller / Gelegenheitsnutzer, direkte Bilderzeugung im Browser |

| API-Plattform | platform.sand.ai/docs |

Entwickler, die MAGI in eigene Produkte integrieren möchten |

| Open-Source-Repository | github.com/SandAI-org/MAGI-1 + huggingface.co/sand-ai/MAGI-1 |

Forscher / Teams mit eigener Infrastruktur, die Gewichte lokal ausführen |

Diese drei Wege decken das gesamte Spektrum von "No-Code-Erstellung → technische Integration → vollständige Selbstverwaltung" ab. Im Vergleich zu Teams, die "nur Paper veröffentlichen, aber keine Gewichte" oder "nur Demos zeigen, aber nicht Open Source gehen", ist der Ansatz von Sand AI deutlich konsequenter.

Die technische Bedeutung der 24B- und 4.5B-Versionen

Dass MAGI-1 sowohl in einer 24B- als auch in einer 4.5B-Parameter-Variante angeboten wird, zeigt, dass Sand AI zwei Nutzertypen gleichzeitig bedienen möchte:

- 24B Vollversion: Für Forscher und Unternehmen mit ausreichenden GPU-Ressourcen, die höchste Bildqualität anstreben.

- 4.5B Distill-Version: Für Teams, die auf technische Bereitstellung setzen und ein Gleichgewicht zwischen Kosten und Latenz suchen. Im Mai wurde zudem eine Distill+Quant-Version nachgereicht, um den VRAM-Bedarf weiter zu senken.

Dieser Veröffentlichungsrhythmus – "High-End- und Low-End-Modell + kontinuierliche Destillation" – ist fast schon der Standard für ausgereifte Open-Source-Große Sprachmodelle im Zeitraum 2025–2026. Sand AI agiert hier auf Augenhöhe mit Open-Source-Größen wie Mistral oder Qwen.

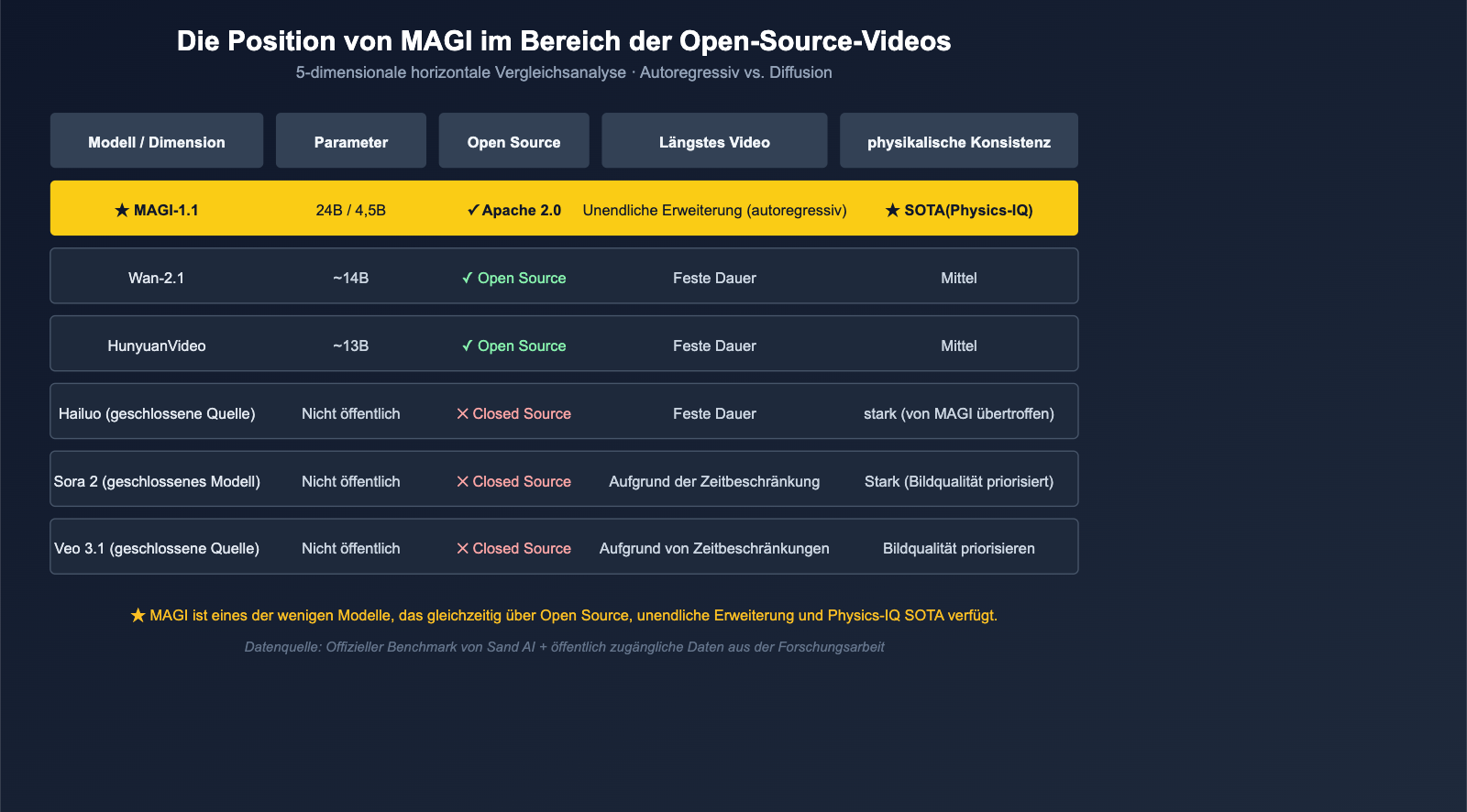

Die Position von Sand AI im Bereich der Videogenerierung und die Erkenntnisse daraus

Wenn man Hintergrund, Produkt und Bereitstellung zusammen betrachtet, ist die Position von Sand AI im Bereich der Videogenerierung für 2026 klar definiert.

Warum es sich lohnt, das Projekt zu verfolgen

| Aspekt | Differenzierungswert von Sand AI |

|---|---|

| Akademische Tiefe | Genetik des Swin-Transformer-Teams, kontinuierliche Innovation bei der Netzwerkarchitektur |

| Routenwahl | Autoregressiv + Diffusion ist ein seltener dritter Weg, kein bloßer Sora-Nachbau |

| Open-Source-Konsequenz | Apache 2.0 + Gewichte + Code + Distill-Versionen vollständig öffentlich |

| Produktform | Web / API / Selbsthosting – alle drei Zugänge vorhanden |

| Physikverständnis | Physics-IQ-Benchmark deutlich führend, ideal für Wissenschaft/Bildung/Forschung |

| Lange Videos | Autoregressive Route unterstützt nativ unendliche Verlängerungen |

Drei Erkenntnisse für die Branche

Der schnelle Aufstieg von Sand AI hinterlässt mindestens drei Lehren für den gesamten Bereich der Videogenerierung:

- Diversifizierung der Ansätze: Neben Sora / Veo / Kling ist der Weg über "Autoregressiv + Diffusion" gangbar und bietet strukturelle Vorteile bei der physikalischen Konsistenz.

- Kleine Teams + Open Source können SOTA erreichen: Mit weniger als 30 Mitarbeitern und Apache 2.0 kann man beim Physics-IQ viele Closed-Source-Giganten schlagen.

- Rückkehr der akademischen Wurzeln: Die Trainingserfahrung mit "klassischen visuellen Modellen" wie dem Swin Transformer hat im Zeitalter der Videogenerierung weiterhin einen hohen Wert.

Diese drei Punkte sind für Teams, die 2026 in die Videogenerierung einsteigen wollen, direkt relevant: Man braucht keine 1000 H100-GPUs, um ein anständiges Modell zu bauen, aber man benötigt eine technische Kultur, die "Architektur versteht, Open Source wagt und konsequent auf physikalische Konsistenz setzt".

🎯 Empfehlung zur Ökosystem-Integration: Für Teams, die "Open Source + Closed Source"-Videomodelle in einem Produkt vereinen möchten, empfehlen wir, Sora 2, Veo 3.1, Kling 3.0, MAGI-1 usw. unter einer einheitlichen Schnittstelle zu verwalten. Bevor die kommerzielle API von MAGI in großem Stil freigegeben wird, können Sie bereits kommerzialisierte Videomodelle über APIYI (apiyi.com) integrieren, um Ihre Geschäftsprozesse zu testen, während Sie auf die weitere Öffnung von platform.sand.ai warten.

Für wen ist Sand AI geeignet – und für wen nicht?

Kommen wir zu einer sehr praktischen Frage: Sollten Sie jetzt schon MAGI von Sand AI verwenden? Die Antwort hängt von Ihren spezifischen Anforderungen an die Bilderzeugung ab.

Zielgruppen

| Zielgruppe | Grund für die Eignung |

|---|---|

| Forscher / Autoren | Vollständig Open Source + neues autoregressives Paradigma, ideal für akademische Arbeiten |

| Teams für Selbst-Hosting / private Bereitstellung | Apache 2.0 + 4.5B-Destillationsversion, Gewichte lokal ausführbar |

| Ersteller von physikalischen Lehrinhalten | Führend bei Physics-IQ, gute physikalische Konsistenz |

| Bedarf an langen Videofortsetzungen | Autoregressiver Ansatz unterstützt von Natur aus unendliche Erweiterungen |

| Produkte für "kontrollierbare Generierung auf Shot-Ebene" | Unterstützt sekundengenaue Zeitachsen + chunk-weises Prompting |

| Akteure im chinesischen KI-Ökosystem | Team aus Peking, gute Unterstützung für chinesische Eingabeaufforderungen |

Weniger geeignete Zielgruppen

| Zielgruppe | Grund |

|---|---|

| Nutzer ohne Programmierkenntnisse, die nur "schnelle Ergebnisse" wollen | UX ausgereifter Produkte wie Sora 2 / Kling ist weiterhin benutzerfreundlicher |

| Kleine Teams, die keine Selbst-Bereitstellung wünschen | Kommerzielle API unter platform.sand.ai befindet sich noch im Ausbau |

| Bedarf an 4K + langer Dauer + Audio für Filmproduktionen | Aktuelle Positionierung eher Forschung / Kreativbereich, kein Filmschnitt |

| Nutzer, denen "Gewichtslizenzen" egal sind | Direkte Nutzung geschlossener APIs ist unkomplizierter |

🎯 Empfehlung zum Ausprobieren: Wenn Sie "sofort Ergebnisse sehen" möchten, empfehlen wir, die Web-App unter magi.sand.ai ohne Login oder mit einer schnellen Registrierung zu testen. Wenn Sie die tatsächlichen Unterschiede zwischen Sand AI und anderen Videomodellen vergleichen möchten, können Sie Sora 2 / Veo 3.1 / Kling 3.0 über den API-Proxy-Dienst APIYI (apiyi.com) mit denselben Eingabeaufforderungen parallel testen, um direkt zu beurteilen, ob der autoregressive Ansatz von MAGI besser zu Ihrem Geschäftsmodell passt.

Häufig gestellte Fragen (FAQ) zu Sand AI

F1: Was ist Sand AI für ein Unternehmen? Ist es mit Stability AI oder Midjourney vergleichbar?

Sand AI ist ein in Peking gegründetes KI-Startup, das von Yue Cao, dem Hauptautor von Swin Transformer, ins Leben gerufen wurde. Das Kernteam besteht aus weniger als 30 Personen. Im Gegensatz zu Stability AI (fokussiert auf Bilder) oder Midjourney (geschlossenes Abo-Modell) konzentriert sich Sand AI auf die Bilderzeugung und verfolgt einen vollständig Open-Source-Ansatz (Apache 2.0). Das Flaggschiff ist das autoregressive Videomodell MAGI-1 / MAGI-1.1.

F2: Was ist der grundlegende Unterschied zwischen MAGI-1 und Sora, Kling oder Veo?

Der größte Unterschied liegt im technischen Ansatz: Sora / Veo / Kling und andere Mainstream-Modelle generieren das gesamte Video in einem Durchgang, während MAGI das Video in Gruppen von 24 Frames (Chunks) unterteilt. Innerhalb eines Chunks erfolgt eine Diffusions-Entrauschung, während zwischen den Chunks eine autoregressive kausale Verbindung besteht. Dieses Paradigma verleiht MAGI strukturelle Vorteile bei der "unendlichen Videoverlängerung" und der "physikalischen Konsistenz" – Sand AI hat hierfür im Physics-IQ-Benchmark deutlich führende Ergebnisse präsentiert.

F3: Ist MAGI-1 wirklich vollständig Open Source? Kann es kommerziell genutzt werden?

Ja. MAGI-1 und MAGI-1.1 sind unter der Apache 2.0-Lizenz auf GitHub (SandAI-org/MAGI-1) und Hugging Face (sand-ai/MAGI-1) verfügbar – inklusive Code, Gewichten und Inferenz-Tools. Apache 2.0 ist eine sehr freundliche Open-Source-Lizenz, die kommerzielle Nutzung, Modifikationen und geschlossene Ableitungen erlaubt, solange der Urheberrechtshinweis beibehalten wird. Das bedeutet, Sie können MAGI-1 in Ihren eigenen Produkten verwenden oder darauf aufbauend weiter trainieren.

F4: Welche Hardware wird benötigt, um MAGI-1 lokal auszuführen?

Die Vollversion von MAGI-1 umfasst 24 Mrd. Parameter; für die lokale Inferenz sind professionelle GPUs mit mehreren Karten erforderlich. Wenn Ihr Hardware-Budget begrenzt ist, empfehlen wir die 4.5B-Distill-Version oder die Distill+Quant-Version, die Sand AI im Mai 2025 veröffentlicht hat. Der VRAM-Bedarf ist deutlich geringer, sodass sie auch auf einer einzelnen High-End-Consumer-GPU laufen. Wenn Sie nur "Ergebnisse sehen" wollen, nutzen Sie am besten die Web-App unter magi.sand.ai.

F5: Bietet Sand AI eine kommerzielle API an? Wie schneidet sie im Vergleich zu Sora oder Kling ab?

Die kommerzielle API-Plattform platform.sand.ai von Sand AI ist bereits online, aber die Ökosystem-Reife hinkt Modellen wie Sora oder Kling, die bereits vollständig kommerzialisiert sind, noch hinterher. Wenn Sie ein Produkt entwickeln, das "sofort einsatzbereit, mit ausreichenden Kontingenten und Unterstützung für chinesische Prompts" sein muss, empfehlen wir, zunächst über eine zentrale Schnittstelle wie APIYI (apiyi.com) bereits kommerzialisierte Videomodelle wie Sora 2, Veo 3.1 oder Kling 3.0 zu nutzen, um Ihr Geschäft zu validieren, während Sie die weitere API-Entwicklung von Sand AI beobachten.

F6: Lohnt es sich, Sand AI weiter zu verfolgen?

Auf jeden Fall. Zwei Gründe: Erstens deutet der akademische Hintergrund des Swin-Transformer-Teams darauf hin, dass zukünftige Iterationen von MAGI wahrscheinlich auf Architekturebene innovativ sein werden, anstatt nur Daten zu skalieren. Zweitens hat Sand AI einen differenzierten Weg gewählt ("autoregressiv + Diffusion + vollständig Open Source"). Sollte dieser Weg erfolgreich sein, wird er die Paradigmenwahl für die Open-Source-Videogenerierung in den Jahren 2026-2027 maßgeblich beeinflussen. Egal ob Forscher, Produktentwickler oder Content Creator – es ist ratsam, sand.ai auf der Beobachtungsliste zu behalten.

Zusammenfassung: Was ist die endgültige Antwort zu Sand AI?

Kommen wir zurück zur ursprünglichen Frage: „Was ist Sand AI?“ Wir können nun eine fundierte Antwort geben: Sand AI ist ein KI-Startup mit einem kleinen Team von weniger als 30 Mitarbeitern, das von Cao Yue, einem der Hauptautoren des Swin Transformer, in Peking gegründet wurde. Ihr Flaggschiffprodukt ist das quelloffene autoregressive Videogenerierungsmodell MAGI-1 / MAGI-1.1. Bei Benchmarks zur physikalischen Konsistenz wie Physics-IQ erzielte es Ergebnisse, die die meisten quelloffenen und einige geschlossene Modelle übertreffen. Zudem stellt das Unternehmen die vollständigen Gewichte und den Code unter der Apache 2.0-Lizenz auf GitHub und Hugging Face bereit. Es ist ein „Dark Horse“ der Videogenerierung mit einer starken akademischen Herkunft, einem innovativen Ansatz und einer kompromisslosen Open-Source-Philosophie.

Für Entwickler und Forscher ist die wahre Bedeutung von Sand AI nicht einfach nur „ein weiteres Videomodell“, sondern die Bereitstellung eines reproduzierbaren, differenzierten Pfades für den gesamten Bereich der Videogenerierung: kein Vertrauen auf massive Rechenleistung, keine geschlossenen Ökosysteme und kein Marketing-Hype, sondern Fokus auf akademische Fundierung, architektonische Innovation und vollständige Offenheit. Wenn der Bereich der Videogenerierung vor 2025 von Sora dominiert wurde, eröffnet das Erscheinen von Sand AI für das Open-Source-Ökosystem 2026 die Möglichkeit, dass auch „kleine Teams SOTA-Ergebnisse erzielen können“.

🎯 Empfehlung: Um die Fortschritte von Sand AI und MAGI hautnah zu verfolgen, empfehlen wir drei Schritte: 1) Verfolgen Sie die Updates auf sand.ai und der Hugging Face-Organisation

sand-ai; 2) Testen Sie Ihre eigenen Anforderungen mit der Web-App unter magi.sand.ai, um ein erstes Gefühl für das Tool zu bekommen; 3) Binden Sie MAGI zusammen mit kommerziellen Modellen wie Sora 2, Veo 3.1 oder Kling 3.0 über eine einheitliche Plattform wie APIYI (apiyi.com) für einen direkten Vergleich ein, um den tatsächlichen Wert für Ihr Unternehmen anhand interner Benchmarks zu beurteilen. Sobald Sie diesen Prozess durchlaufen haben, wird sich die Frage, ob Sand AI einen Platz in Ihrem Tech-Stack für die Videogenerierung verdient, von selbst beantworten.

Autor: APIYI Team | Wir konzentrieren uns auf die Implementierung großer Sprachmodelle und das Open-Source-Ökosystem. Weitere Bewertungen zu Video- und multimodalen Modellen finden Sie unter APIYI (apiyi.com).