Если вы в последнее время постоянно натыкаетесь на название Sand AI в лентах Hugging Face, GitHub или англоязычного AI-сообщества в Twitter и вам стало любопытно, что же такое MAGI-1 / MAGI-1.1, то эта статья — для вас. В отличие от многих «внезапно появившихся команд по созданию видеомоделей», у Sand AI очень серьезный бэкграунд: её генеральный директор Цао Юэ (Cao Yue) является ключевым автором Swin Transformer. Эта работа получила премию Marr Prize на конференции ICCV 2021, набрала более 30 000 цитирований в Google Scholar и широко используется в продуктах таких гигантов, как Microsoft Office 365, Azure, TikTok и Kuaishou. Другими словами, Sand AI — это не команда-однодневка, а результат десятилетнего опыта работы с визуальными моделями, накопленного создателями Swin Transformer и теперь перенесенного в сферу генерации видео.

Что еще больше воодушевило зарубежное сообщество, так это то, что Sand AI не только создала конкурентоспособную модель генерации видео, но и решила сделать её полностью открытой: полный набор весов MAGI-1, исходный код и инструменты для инференса доступны под лицензией Apache 2.0 на GitHub и Hugging Face. В волне «массового открытия исходного кода китайских видеомоделей» 2025–2026 годов Sand AI является одной из немногих команд, которые успешно реализовали и открыли путь «авторегрессионной генерации видео». В этой статье мы подробно разберем, что такое Sand AI, затронув 6 аспектов: историю компании, биографию основателя, архитектуру MAGI, стратегию открытого кода и целевую аудиторию.

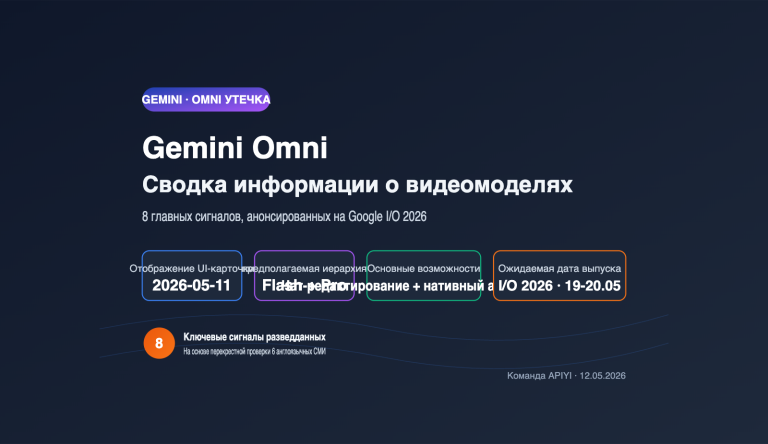

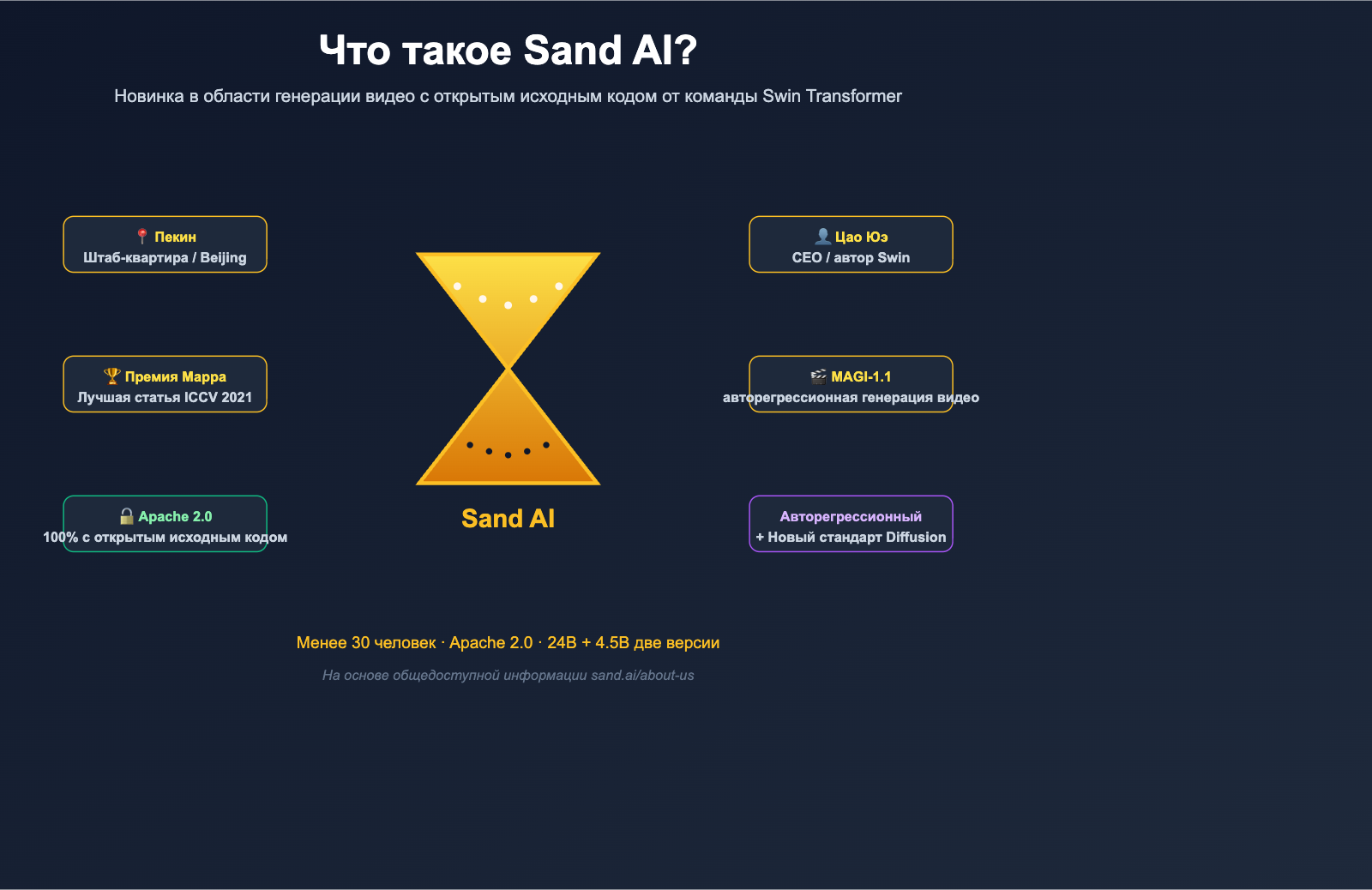

Краткий обзор ключевой информации о Sand AI

Прежде чем углубляться в детали, давайте сведем все важные факты о том, что такое Sand AI, в одну таблицу.

| Измерение | Публичная информация о Sand AI |

|---|---|

| Название компании | Sand AI (сайт sand.ai) |

| История создания | Основана ключевым автором Swin Transformer Цао Юэ |

| Штаб-квартира | Пекин, Китай |

| Размер команды | Менее 30 человек, средний возраст до 30 лет |

| Миссия компании | «Продвигать ИИ на благо каждого», приверженность открытому коду и сотрудничеству |

| CEO | Цао Юэ (Yue Cao), бывший руководитель центра визуальных моделей Пекинской академии искусственного интеллекта (BAAI) |

| Флагманский продукт | Авторегрессионная модель генерации видео MAGI / MAGI-1 / MAGI-1.1 |

| Первый релиз | 21 апреля 2025 г. (MAGI-1) |

| Последняя версия | MAGI-1.1 (100% открытый код) |

| Спецификации модели | Версии с 24 млрд и 4,5 млрд параметров |

| Лицензия | Apache 2.0, GitHub SandAI-org/MAGI-1 + Hugging Face sand-ai/MAGI-1 |

| Ключевые инновации | Комбинация авторегрессии и диффузии (Autoregressive Denoising Diffusion) |

| Веб-интерфейс | magi.sand.ai/app/projects |

| API-платформа | platform.sand.ai/docs |

| Основные конкуренты | Серия Wan, HunyuanVideo, Hailuo, Sora и др. |

🎯 Совет для быстрого понимания: Если вам нужно запомнить Sand AI одной фразой, скажите так: «Это стартап с открытым кодом, который перенес мастерство визуального моделирования Swin Transformer в генерацию видео». Если вы хотите прямо сейчас протестировать разницу между MAGI и другими видеомоделями, мы рекомендуем сначала прогнать серию запросов через такие платформы, как APIYI (apiyi.com), где собраны Sora 2, Veo 3.1, Kling и другие зрелые модели, а затем сравнить их с MAGI-1.1 на sand.ai или Hugging Face. Так вы сразу увидите разницу, которую дает «авторегрессионный подход».

История компании Sand AI и ДНК команды

Чтобы понять, почему Sand AI удалось с ходу создать конкурентоспособную модель для генерации видео, нужно сначала взглянуть на бэкграунд их команды.

Основатель: Цао Юэ, «отец» Swin Transformer

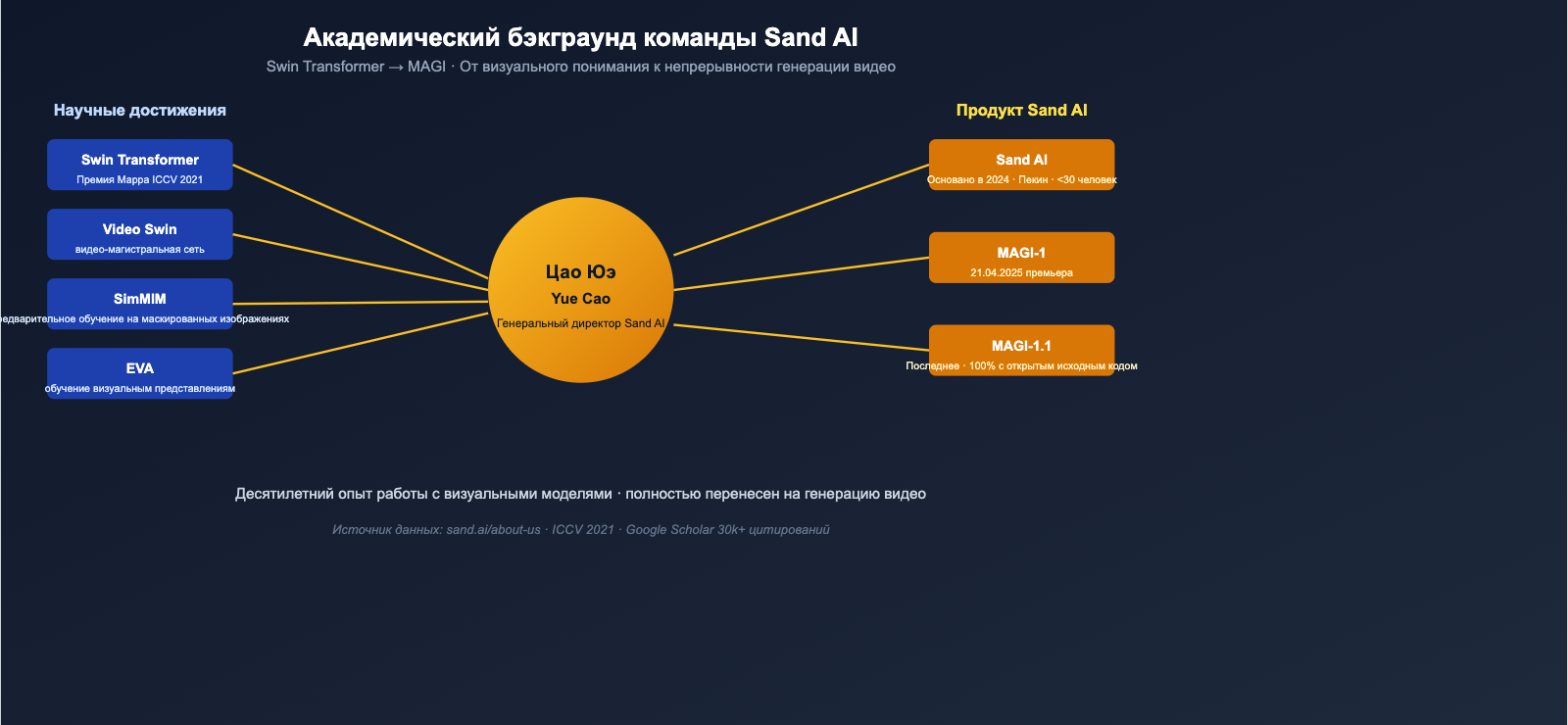

CEO компании Sand AI Цао Юэ (Yue Cao) — имя, хорошо известное как в китайском, так и в мировом академическом сообществе AI. Его ключевой профессиональный путь можно свести к следующим этапам:

| Период | Опыт |

|---|---|

| 2019-2022 | Старший научный сотрудник Microsoft Research Asia, ключевой автор Swin Transformer |

| 2021 | Swin Transformer получил награду за лучшую статью на ICCV 2021 (Marr Prize) |

| 2022-2023 | Сооснователь Lightyear AI, позже компания была приобретена Meituan |

| 2023-2024 | Руководитель центра исследований визуальных моделей в Пекинской академии искусственного интеллекта (BAAI), специализировался на базовых визуальных и мультимодальных больших языковых моделях |

| 2024 — н.в. | Основатель Sand AI, CEO |

Влияние Swin Transformer ощущается до сих пор — эта статья была процитирована в Google Scholar более 30 000 раз и широко используется в системах визуального анализа таких продуктов, как Microsoft Office 365, Azure Cognitive Service, TikTok, Kuaishou и других. Это также стало фундаментом для Video Swin Transformer. В некотором смысле, сам Цао Юэ олицетворяет преемственность технологического пути «от визуального понимания к генерации видео».

Размер команды: «супер-элитная группа» из менее чем 30 человек

Структура команды Sand AI сильно отличается от большинства компаний, занимающихся большими языковыми моделями: всего в штате менее 30 человек, охватывающих 4 направления: продукт, маркетинг, инженерия и исследования, при этом средний возраст ключевых сотрудников — менее 30 лет. Такая компактная структура редко встречается в волне стартапов эпохи больших языковых моделей, но она дает свои преимущества:

- Короткие цепочки принятия решений и высокая скорость итераций;

- Высокая степень интеграции инженерии и исследований: инновации уровня научных статей сразу превращаются в готовые продукты;

- Отсутствие корпоративной бюрократии: 3 человека могут полностью реализовать новый функциональный стек.

Этот «маленький, но мощный» генетический код — важная причина, по которой Sand AI смогла выпустить модель MAGI-1 с высокой степенью готовности уже в апреле 2025 года.

Миссия компании и отношение к Open Source

На странице «О нас» Sand AI определяет свою миссию как: «Развивать AI на благо каждого» (Advance AI to benefit everyone) и четко заявляет о намерении «поддерживать открытый исходный код, способствовать прогрессу через открытое сотрудничество и сделать передовые AI-технологии доступными для всех». Это не просто маркетинговый лозунг — последующие модели MAGI-1 и MAGI-1.1 от Sand AI были полностью открыты по лицензии Apache 2.0. Компания выложила веса, код для инференса и дистиллированные версии на GitHub и Hugging Face. Такой подход к Open Source в текущей гонке генерации видео выглядит крайне смело.

После знакомства с командой переходим к самому интересному — флагманской линейке MAGI от Sand AI. В плане технической реализации она фундаментально отличается от таких популярных решений, как Sora, Kling, Veo или HunyuanVideo: это не чисто диффузионная модель, генерирующая всё видео целиком, а гибрид «авторегрессии» и «диффузии», который создает видео по частям (чанками).

Ключевые факты о MAGI

| Параметр | MAGI / MAGI-1 / MAGI-1.1 |

|---|---|

| Дата первого релиза | 21 апреля 2025 г. |

| Актуальная версия | MAGI-1.1 (100% open source) |

| Параметры | 24B (полная версия) + 4.5B (облегченная) |

| Дистиллированные версии | 4.5B Distill + Distill+Quant (выпущены 26 мая 2025 г.) |

| Лицензия | Apache 2.0 |

| Репозитории | github.com/SandAI-org/MAGI-1 / huggingface.co/sand-ai/MAGI-1 |

| Длительность генерации | Сейчас 1–10 сек, поддерживается бесконечное продление |

| Кадров в сегменте | 24 кадра на чанк, совместное шумоподавление |

| Параллелизм | До 4 чанков одновременно |

| Время генерации | Обычно 1–2 минуты |

| Поддержка стилей | Реалистичное видео + 3D полу-мультяшный стиль |

| Управление | Посекундный контроль таймлайна + промпты для отдельных сегментов |

| Понимание физики | Значительное превосходство в продолжении видео по бенчмарку Physics-IQ |

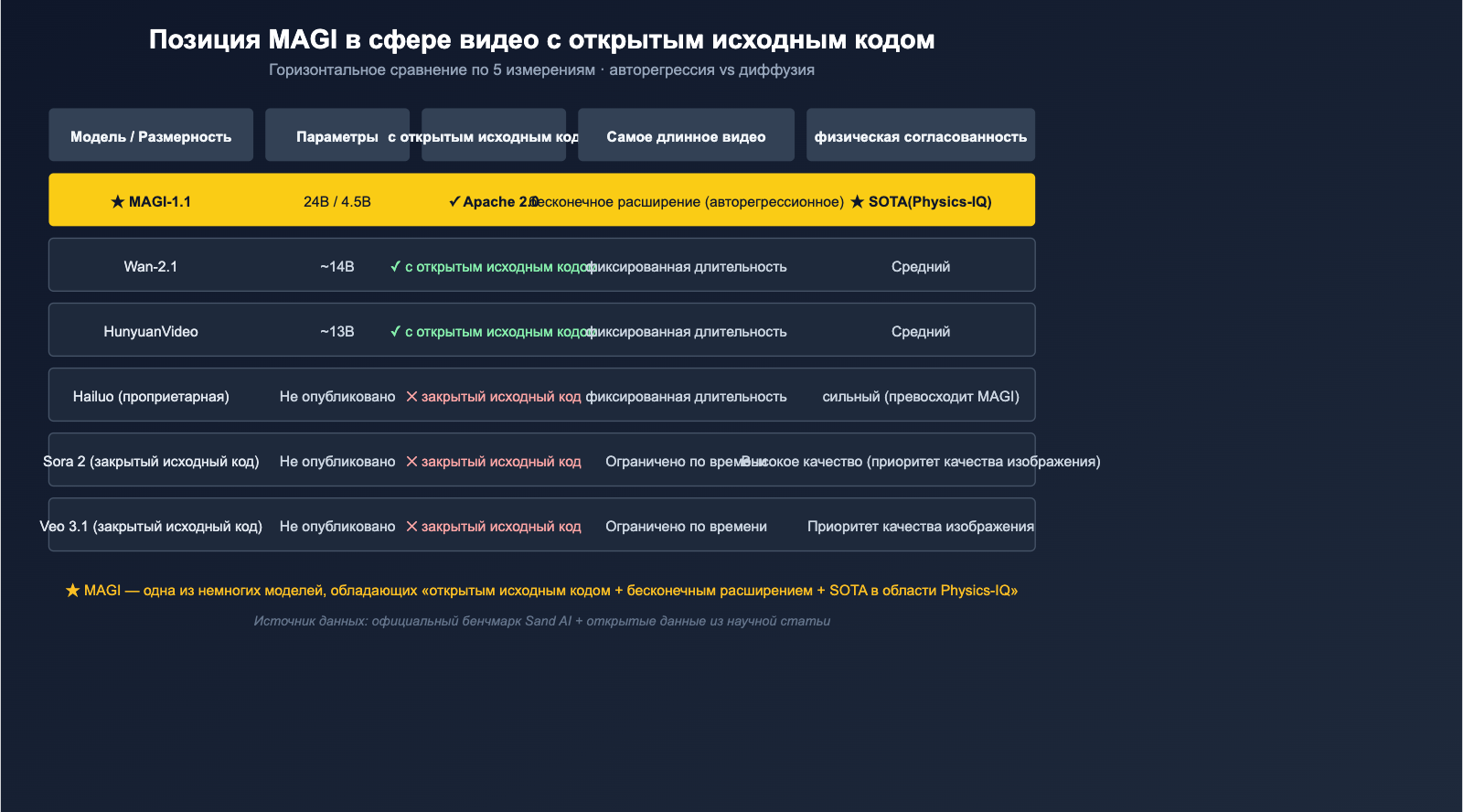

| Позиционирование | SOTA среди открытых моделей, лучше Wan-2.1 / HunyuanVideo, обходит закрытую Hailuo |

Авторегрессия + диффузия: почему это новая парадигма

Большинство видео-диффузионных моделей (Sora, Veo, Kling и др.) обычно обрабатывают всё видео как единый тензор при шумоподавлении. Этот подход дает отличное качество картинки, но имеет два врожденных недостатка:

- Сложно сделать видео бесконечно длинным: длина генерации ограничена объемом видеопамяти и задержками при инференсе;

- Слабая физическая согласованность: при генерации всего ролика сразу теряется причинно-следственная связь «предыдущий кадр определяет следующий».

MAGI выбрала другой путь: видео разбивается на чанки по 24 кадра. Внутри каждого чанка происходит диффузионное шумоподавление, а между чанками действуют авторегрессионные причинно-следственные ограничения. Это значит, что:

- Хотите видео подлиннее? Просто продолжайте авторегрессию дальше, теоретически ограничений нет — именно поэтому на сайте sand.ai акцентируют внимание на «infinite video extension capabilities».

- Хотите больше физической достоверности? Каждый кадр опирается на уже сгенерированные, что дает структурное преимущество в тестах на предсказание физики, таких как Physics-IQ.

- Нужно более тонкое управление? Можно задавать отдельный промпт для каждого чанка, работая как «режиссер по сегментам».

Такой подход показал отличные результаты во внутренних тестах Sand AI: модель обошла сильных конкурентов вроде Wan-2.1 и HunyuanVideo в open-source сегменте, а также превзошла закрытую Hailuo, показав результаты, «значительно превосходящие все существующие модели» по бенчмарку Physics-IQ.

Инженерные инновации в архитектуре MAGI

Чтобы концепция «авторегрессия + диффузия» заработала на практике, Sand AI внедрила в MAGI целый ряд архитектурных доработок:

| Модуль | Назначение |

|---|---|

| Block-Causal Attention | Создает причинно-следственные связи между чанками, предотвращая утечку информации из будущего |

| Parallel Attention Block | Повышает эффективность параллелизации внутри одного чанка |

| QK-Norm + GQA | Стабилизирует обучение + снижает нагрузку на KV Cache |

| Sandwich Normalization in FFN | Дополнительная стабилизация обучения больших моделей |

| SwiGLU | Улучшает нелинейную выразительность |

| Softcap Modulation | Контролирует экстремальные значения распределения внимания |

| Transformer-based VAE | Ускоряет декодирование |

Эти инновации по отдельности не выглядят как «прорыв», но в совокупности они позволили MAGI-1 объединить четыре качества, которые редко встречаются вместе: длинные видео, физическая точность, управляемость и масштабируемость.

🎯 Совет по выбору архитектуры: Если вашему проекту нужно «продление длинных видео» или «покадровое управление», парадигма «авторегрессия + диффузия» от MAGI определенно заслуживает внимания. Пока модель не получила коммерческий API, можно прототипировать на уже доступных решениях вроде Sora 2, Veo 3.1 или Kling 3.0 через сервис-прокси API APIYI (apiyi.com), а после выхода полноценного API для MAGI — бесшовно мигрировать.

Как Sand AI доставляет MAGI разработчикам

Одной лишь мощной модели недостаточно — Sand AI проделали отличную инженерную работу над путями доставки продукта. Для разных категорий пользователей — от обычных юзеров до разработчиков и исследователей — sand.ai предлагает три точки входа.

Три способа использования MAGI

| Точка входа | Адрес | Для кого |

|---|---|---|

| Веб-приложение | magi.sand.ai/app/projects |

Контент-мейкеры / обычные пользователи, генерация прямо в браузере |

| API-платформа | platform.sand.ai/docs |

Разработчики, интегрирующие MAGI в свои продукты |

| Open-source репозитории | github.com/SandAI-org/MAGI-1 + huggingface.co/sand-ai/MAGI-1 |

Исследователи / команды, работающие с локальным развертыванием весов |

Эти три пути покрывают весь спектр потребностей: от «генерации без кода» до инженерной интеграции и полной самостоятельной хостинг-инфраструктуры. По сравнению с командами, которые «публикуют только статьи без весов» или «показывают демо без открытого кода», подход Sand AI выглядит гораздо более основательным.

Инженерное значение двух версий: 24B и 4.5B

Тот факт, что MAGI-1 выпускается сразу в двух вариантах параметров — 24B и 4.5B, — говорит о том, что Sand AI стремится угодить обоим типам пользователей:

- Полная версия 24B: для исследователей и компаний с достаточными ресурсами GPU, которые гонятся за максимальным качеством изображения;

- Дистиллированная версия 4.5B: для команд, занимающихся инженерным развертыванием и ищущих баланс между стоимостью и задержкой. В мае также добавили версию Distill+Quant, что еще сильнее оптимизирует использование видеопамяти.

Такой ритм выпуска «модель высокого уровня + модель низкого уровня + постоянная дистилляция» — это практически золотой стандарт для open-source больших языковых моделей в 2025–2026 годах. В этом плане Sand AI идет в ногу с такими гигантами open-source, как Mistral и Qwen.

Место Sand AI в индустрии генерации видео и выводы

Сложив воедино историю, продукт и пути доставки, мы видим, что позиции Sand AI в индустрии генерации видео в 2026 году стали весьма четкими.

Почему это стоит внимания

| Аспект | Дифференцированная ценность Sand AI |

|---|---|

| Академическая глубина | Гены команды Swin Transformer, преемственность в инновациях архитектуры сети |

| Выбор пути | Авторегрессия + диффузия — это «третий путь», а не просто копирование Sora |

| Открытость | Apache 2.0 + веса + код + версии Distill — всё в открытом доступе |

| Формат продукта | Полный набор: Web / API / Self-hosting |

| Понимание физики | Бенчмарк Physics-IQ значительно опережает конкурентов, идеально для научпопа/образования/исследований |

| Длинные видео | Авторегрессионный подход естественным образом поддерживает бесконечное продление |

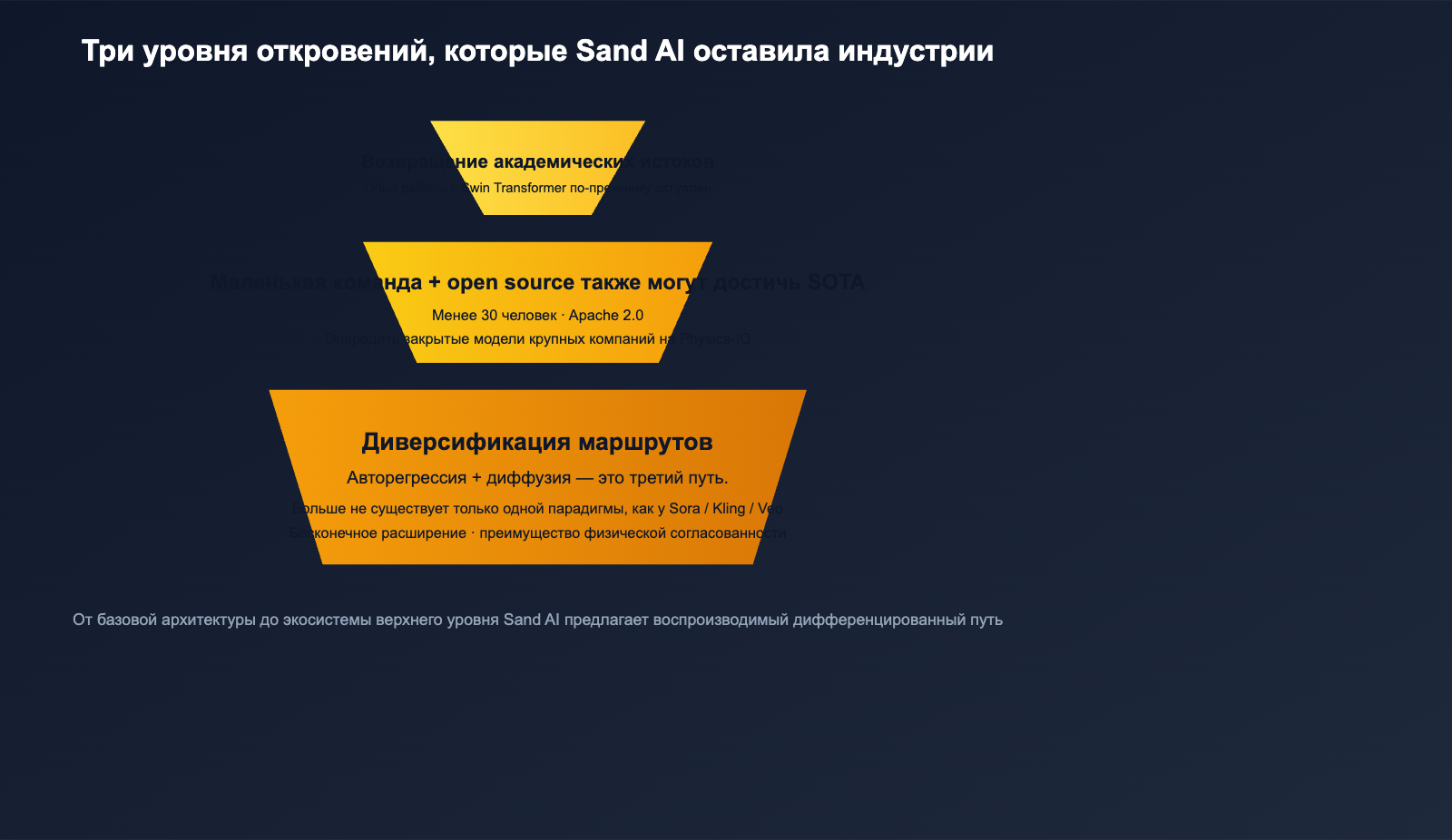

Три вывода для индустрии

Стремительный взлет Sand AI дает как минимум три урока для всей сферы генерации видео:

- Диверсификация путей: помимо Sora / Veo / Kling, путь «авторегрессия + диффузия» вполне жизнеспособен и имеет структурные преимущества в плане физической согласованности;

- Маленькая команда + Open-source = SOTA: даже с командой менее 30 человек и лицензией Apache 2.0 можно обойти многих гигантов с закрытыми моделями в тестах Physics-IQ;

- Возвращение академических корней: опыт обучения «классических визуальных моделей», таких как Swin Transformer, сохраняет огромную ценность в эпоху генерации видео.

Эти три пункта станут прямым ориентиром для команд, которые хотят войти в сферу генерации видео в 2026 году. Вам не нужны 1000 видеокарт H100, чтобы создать достойную модель, но вам определенно нужна инженерная культура, которая «понимает архитектуру, не боится открытого кода и стремится к физической согласованности».

🎯 Рекомендация по интеграции в экосистему: для команд, желающих объединить «открытые + закрытые» видеомодели в одном продукте, мы советуем управлять Sora 2, Veo 3.1, Kling 3.0 и MAGI-1 через единый интерфейс. Пока коммерческое API MAGI еще не открыто для широкого круга лиц, вы можете сначала отладить бизнес-процессы через APIYI (apiyi.com), где уже доступны коммерческие видеомодели, и дождаться полноценного открытия

platform.sand.ai.

Кому подходит, а кому нет Sand AI

Вернемся к практическому вопросу: стоит ли вам прямо сейчас использовать MAGI от Sand AI? Ответ зависит от ваших конкретных задач в области генерации видео.

Кому это подходит

| Аудитория | Почему это подходит |

|---|---|

| Исследователи / авторы статей | Полный open-source + новая парадигма авторегрессии, отлично для академических работ |

| Команды для self-hosting / приватного развертывания | Лицензия Apache 2.0 + дистиллированная версия 4.5B, можно запускать веса локально |

| Популяризаторы науки / авторы образовательного контента | Лидерство в Physics-IQ, высокая физическая согласованность |

| Те, кому нужно создание длинных видео | Авторегрессионный подход естественным образом поддерживает infinite extension |

| Продукты для "покадрового контролируемого создания" | Поддержка таймлайна с точностью до секунды + промптинг по чанкам (chunk-wise) |

| Участники экосистемы китайского AI-контента | Команда из Пекина, отличная поддержка промптов на китайском |

Кому это не очень подходит

| Аудитория | Причина |

|---|---|

| Пользователи без навыков программирования, которым нужно "просто получить результат" | UX у зрелых продуктов вроде Sora 2 / Kling пока более дружелюбный |

| Небольшие команды, не желающие заниматься развертыванием | Коммерческий API на platform.sand.ai все еще находится в стадии доработки |

| Нужен уровень кинопроизводства: 4K + большая длительность + звук | Текущее позиционирование — это скорее исследования и креатив, а не постпродакшн |

| Прикладные разработчики, которым не важна "лицензия на веса" | Проще использовать готовые закрытые API |

🎯 Совет по тестированию: Если ваша цель — "быстро увидеть результат", рекомендуем зайти на magi.sand.ai и попробовать веб-приложение без входа или с быстрой регистрацией. Если же вы хотите сравнить реальные различия между Sand AI и другими моделями, можете вызвать Sora 2 / Veo 3.1 / Kling 3.0 через сервис-прокси API APIYI (apiyi.com). Используйте один и тот же промпт для параллельной генерации, чтобы наглядно понять, действительно ли авторегрессионный путь MAGI лучше подходит для вашего бизнеса.

Часто задаваемые вопросы о Sand AI

Q1: Что такое Sand AI? Это то же самое, что Stability AI или Midjourney?

Sand AI — это AI-стартап из Пекина, основанный Цао Юэ (Yue Cao), одним из ключевых авторов Swin Transformer. В основной команде менее 30 человек. В отличие от Stability AI, сфокусированной на изображениях, или Midjourney, работающей по закрытой подписке, Sand AI специализируется на генерации видео и выбрала путь полного open-source (Apache 2.0). Их флагманский продукт — авторегрессионная модель генерации видео MAGI-1 / MAGI-1.1.

Q2: В чем принципиальное отличие MAGI-1 от Sora, Kling и Veo?

Главное отличие — в техническом подходе: Sora / Veo / Kling и другие популярные модели генерируют видео целиком за один проход, тогда как MAGI разбивает видео на чанки по 24 кадра. Внутри чанка происходит диффузионное шумоподавление, а между чанками — авторегрессионная причинно-следственная связь. Эта парадигма дает MAGI структурное преимущество в "бесконечном продлении видео" и "физической согласованности" — официальные тесты sand.ai на бенчмарке Physics-IQ показывают значительное превосходство.

Q3: MAGI-1 действительно полностью открыт? Можно ли его использовать в коммерческих целях?

Да. MAGI-1 и MAGI-1.1 распространяются по лицензии Apache 2.0 на GitHub (SandAI-org/MAGI-1) и Hugging Face (sand-ai/MAGI-1). Код, веса и инструменты для инференса доступны всем. Apache 2.0 — очень дружелюбная лицензия, которая разрешает коммерческое использование, модификацию и создание закрытых производных продуктов, при условии сохранения уведомления об авторских правах. Это значит, что вы можете использовать MAGI-1 в своем продукте или дообучать его.

Q4: Какое железо нужно для локального запуска MAGI-1?

Полноценная версия MAGI-1 имеет 24 млрд параметров, для локального инференса потребуется профессиональная GPU с несколькими картами. Если бюджет на оборудование ограничен, рекомендуем использовать дистиллированную версию 4.5B или версию Distill+Quant, выпущенную Sand AI в мае 2025 года. Требования к видеопамяти значительно ниже, и модель можно запустить на одной мощной потребительской видеокарте. Если вы хотите просто "посмотреть на результат", лучше воспользоваться веб-приложением на magi.sand.ai — локальная настройка не потребуется.

Q5: Есть ли у Sand AI коммерческий API? Как он выглядит на фоне Sora и Kling?

Коммерческая API-платформа Sand AI (platform.sand.ai) уже запущена, но по зрелости экосистемы она все еще догоняет Sora и Kling. Если вам нужно "готовое решение с квотами и поддержкой китайских промптов", советуем использовать сервис-прокси API APIYI (apiyi.com) для вызова уже коммерциализированных моделей, таких как Sora 2, Veo 3.1 или Kling 3.0. Параллельно следите за развитием API от Sand AI, чтобы в нужный момент переключиться или интегрировать их решение.

Q6: Стоит ли следить за Sand AI в будущем?

Безусловно. Две причины: во-первых, академический бэкграунд команды Swin Transformer означает, что последующие версии MAGI, скорее всего, будут приносить инновации в архитектуре, а не просто наращивать объемы данных. Во-вторых, Sand AI выбрала дифференцированный путь "авторегрессия + диффузия + полный open-source". Если этот путь окажется успешным, он повлияет на выбор парадигмы для всей сферы open-source генерации видео в 2026–2027 годах. Независимо от того, исследователь вы, разработчик или создатель контента, рекомендуем добавить sand.ai в список для постоянного наблюдения.

Итог: что же такое Sand AI?

Возвращаясь к нашему изначальному вопросу — «Что такое Sand AI?» — теперь мы можем дать вполне исчерпывающий ответ: Sand AI — это небольшой AI-стартап из Пекина, насчитывающий менее 30 человек, основанный Цао Юэ, одним из ключевых авторов Swin Transformer. Их флагманский продукт — открытая авторегрессионная модель генерации видео MAGI-1 / MAGI-1.1. Она показала результаты, превосходящие большинство открытых и некоторые закрытые модели на тестах физической согласованности, таких как Physics-IQ. При этом компания выложила все веса и код в открытый доступ на GitHub и Hugging Face под лицензией Apache 2.0. Это «темная лошадка» в сфере генерации видео с мощным академическим бэкграундом, инновационным подходом и бескомпромиссной приверженностью open-source.

Для разработчиков и исследователей истинная ценность Sand AI заключается не в том, что «появилась еще одна видеомодель», а в том, что она предлагает всему рынку генерации видео воспроизводимый и дифференцированный путь: не за счет колоссальных вычислительных мощностей, не за счет закрытых экосистем и не за счет агрессивного маркетинга, а благодаря академической базе, архитектурным инновациям и полноценному открытому исходному коду. Если до 2025 года в сфере генерации видео доминировала Sora, то появление Sand AI открывает для открытой экосистемы 2026 года возможность того, что «даже небольшая команда может достичь уровня SOTA».

🎯 Финальная рекомендация: чтобы быть в курсе последних новостей Sand AI и MAGI, мы советуем сделать три вещи: 1) Следить за обновлениями на sand.ai и в организации

sand-aiна Hugging Face; 2) Попробовать веб-приложение magi.sand.ai на своих реальных задачах, чтобы получить первое впечатление; 3) Подключить MAGI вместе с коммерческими моделями вроде Sora 2, Veo 3.1 или Kling 3.0 к единой платформе, такой как APIYI (apiyi.com), для сравнительного анализа. Это позволит вам объективно оценить реальную ценность модели для вашего бизнеса. После прохождения этого пути ответ на вопрос, стоит ли включать Sand AI в ваш стек инструментов для генерации видео, станет очевидным.

Автор: Команда APIYI | Мы следим за внедрением больших языковых моделей и развитием открытых экосистем. Больше обзоров видео- и мультимодальных моделей вы найдете на APIYI (apiyi.com).