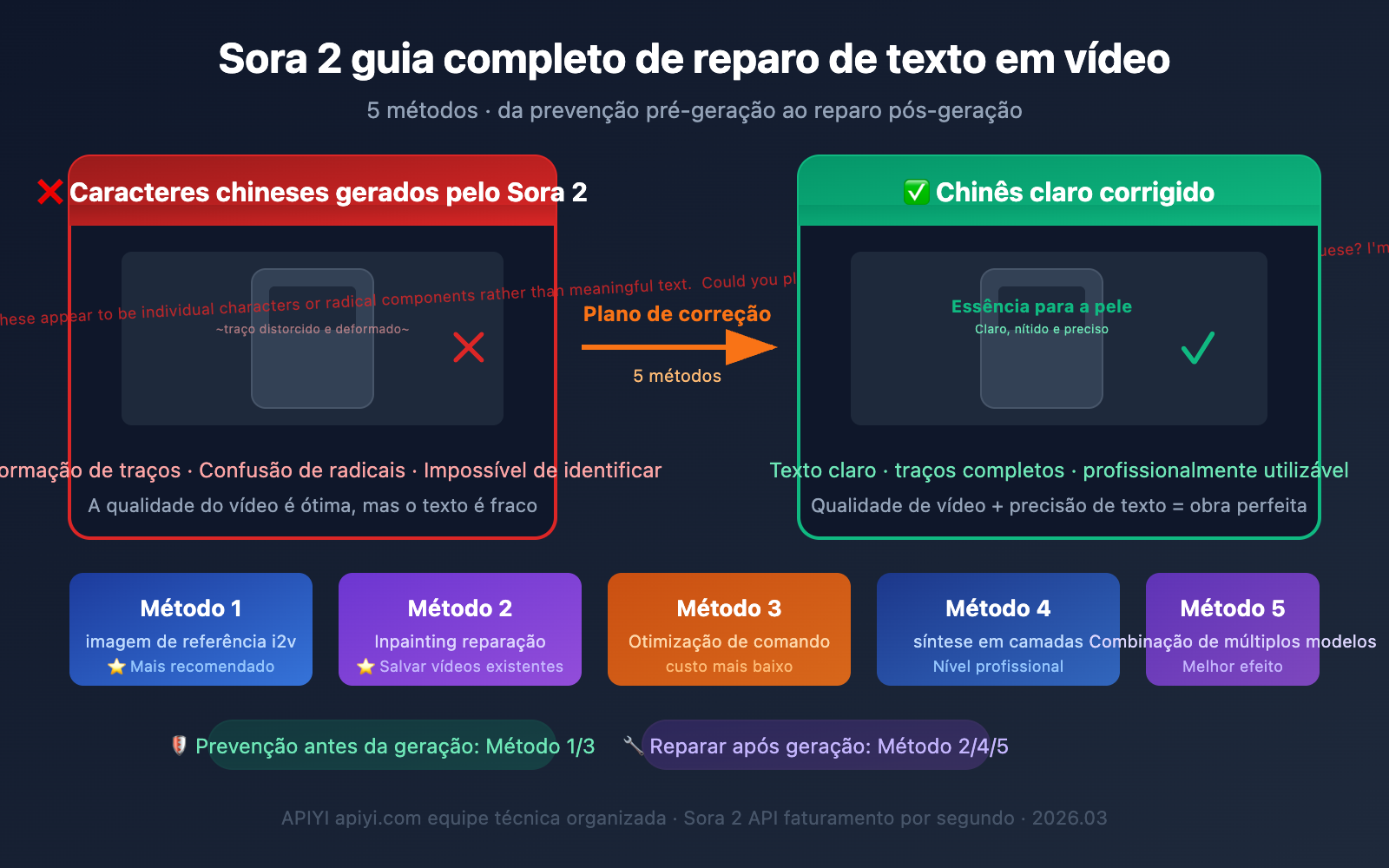

Nota do autor: Gerei um vídeo de qualidade excelente com o Sora 2, mas o texto em chinês na tela ficou torto, confuso e ilegível — é uma pena descartar, mas enviar assim não é profissional. Este é atualmente um dos problemas mais frustrantes para usuários do Sora 2. Este artigo explora 5 soluções práticas para salvar aqueles trabalhos "vídeo bonito, mas texto ruim".

Valor essencial: Aprenda a resolver o problema de renderização de texto em chinês no Sora 2 a partir de duas direções — "prevenção antes da geração" e "reparo após a geração" — para que cada invocação do modelo não seja um desperdício de dinheiro.

Sora 2: Por que caracteres chineses ficam com problemas de codificação – Análise técnica

Antes de explicar as soluções, é importante entender o problema em si — por que a renderização de caracteres chineses no Sora 2 é tão ruim?

A lógica subjacente da renderização de texto no Sora 2

A forma como os modelos de vídeo de IA geram texto é completamente diferente do que você imagina. Ele não está "escrevendo", mas sim "desenhando" — o modelo gera "padrões de pixels que parecem texto", não invoca um mecanismo real de renderização de fontes.

Isso leva a um problema fundamental:

| Tipo de texto | Complexidade dos caracteres | Qualidade de renderização do Sora 2 | Motivo |

|---|---|---|---|

| Letras em inglês | Baixa (26 letras) | ⭐⭐⭐⭐ Aceitável | Traços simples, dados de treinamento abundantes |

| Números | Muito baixa (0-9) | ⭐⭐⭐⭐⭐ Boa | Estrutura simples, fácil para o modelo aprender |

| Chinês simplificado | Alta (milhares de caracteres comuns) | ⭐⭐ Ruim | Traços complexos, radicais facilmente confundidos |

| Chinês tradicional | Muito alta | ⭐ Muito ruim | Densidade de traços alta, detalhes difíceis de restaurar |

| Hiragana/Katakana | Média | ⭐⭐⭐ Regular | Mais simples que caracteres chineses, mas ainda com desvios |

3 manifestações típicas de problemas com caracteres chineses

- Deformação de traços: A estrutura básica do caractere está correta, mas os traços são distorcidos, quebrados ou redundantes

- Confusão de radicais: Combinação incorreta de radicais esquerdo-direito, gerando "símbolos que parecem caracteres mas não são"

- Codificação completamente corrompida: Geração de símbolos sem sentido que se parecem com texto

🎯 Compreensão fundamental: Isso não é um bug do Sora 2, mas um problema comum a todos os modelos de vídeo de IA atuais. Entender isso permite escolher a estratégia correta — ou processar o texto antes da geração, ou usar ferramentas de pós-processamento para corrigir.

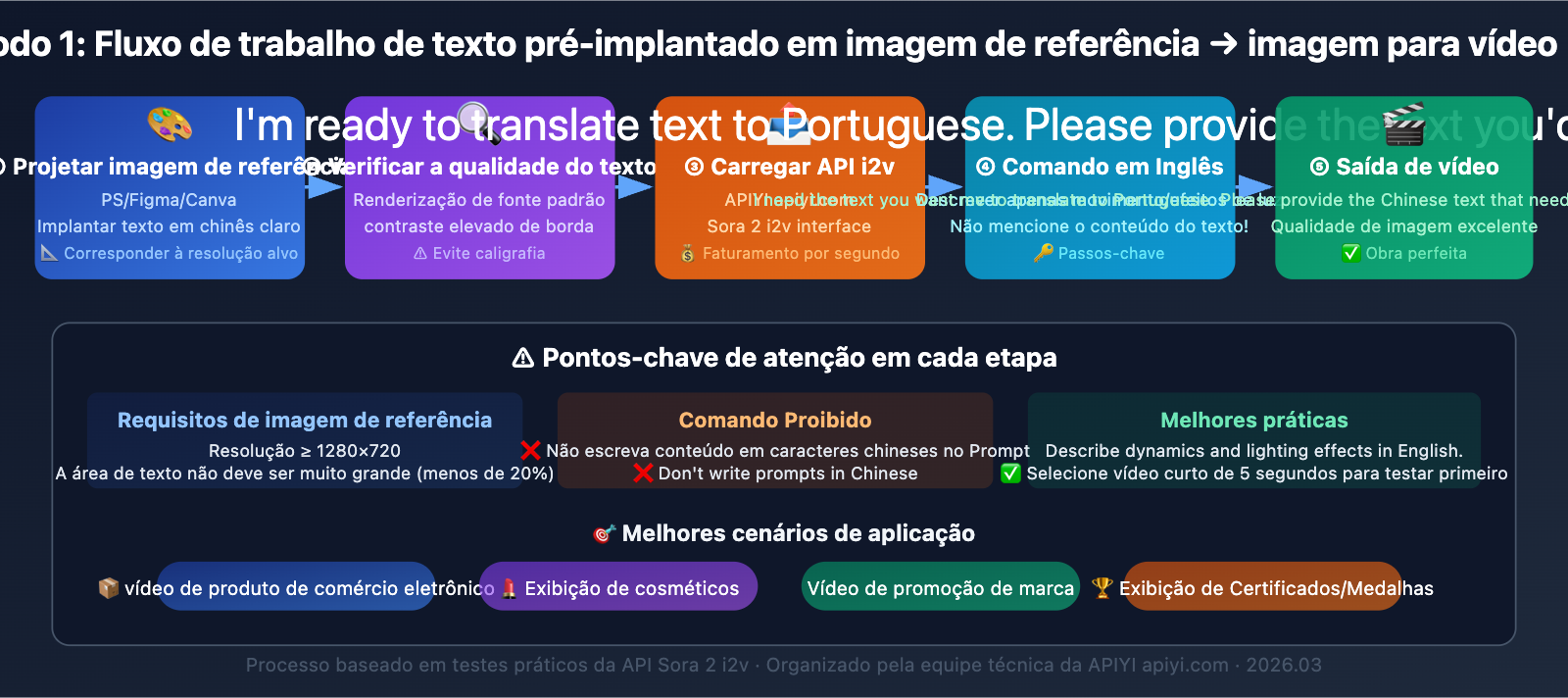

Método 1: Pré-inserir texto em imagem de referência (solução i2v de imagem para vídeo)

Esta é atualmente a solução mais eficaz de "prevenção antes da geração".

Ideia principal: em vez de depender do Sora 2 para "desenhar" caracteres chineses por conta própria, você carrega uma imagem com caracteres chineses claros como quadro de referência, permitindo que o modelo gere o vídeo baseado nesta imagem.

Fluxo de trabalho de imagem para vídeo do Sora 2

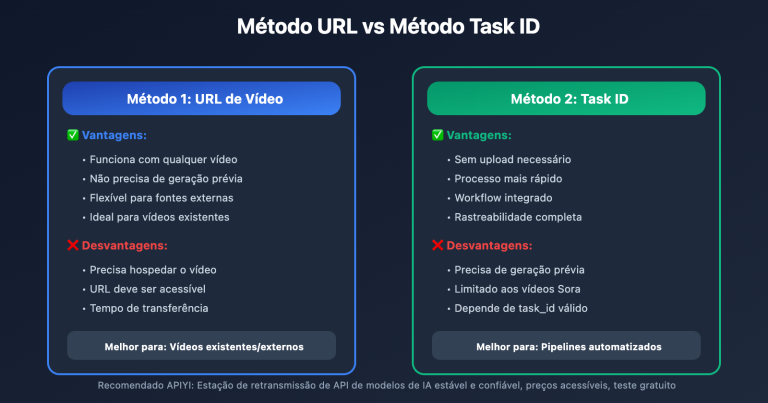

A API do Sora 2 suporta o modo Image-to-Video (i2v), permitindo que você carregue uma imagem com caracteres chineses precisos como primeiro quadro do vídeo, e o modelo tentará manter os elementos visuais do primeiro quadro ao gerar os quadros subsequentes.

Passos operacionais específicos

Passo 1: Preparar a imagem de referência

Use ferramentas de design como Photoshop, Figma ou Canva para criar uma imagem com caracteres chineses claros. Requisitos principais:

- Usar fontes padrão para renderizar o texto (não fontes manuscritas)

- Resolução consistente com o vídeo alvo (como 1280×720)

- Área de texto com alto contraste e bordas nítidas

Passo 2: Enviar via API i2v

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # Interface proxy do APIYI para Sora 2

)

# Modo imagem para vídeo

response = client.chat.completions.create(

model="sora-2-i2v", # Modelo de imagem para vídeo

messages=[

{

"role": "user",

"content": [

{

"type": "image_url",

"image_url": {"url": "https://your-image-url.com/product.png"}

},

{

"type": "text",

"text": "The cosmetic product slowly rotates on a reflective surface, "

"soft studio lighting, cinematic, 8 seconds"

}

]

}

]

)

Passo 3: Dica de Prompt — não mencione o conteúdo do texto

Princípio fundamental: no Prompt, descreva apenas o movimento e mudanças de iluminação, não mencione o conteúdo do texto na imagem. Uma vez que você escreve caracteres chineses no Prompt, o modelo "redesenhará o texto", sobrescrevendo o texto correto da imagem de referência.

| Estratégia de Prompt | Exemplo | Resultado |

|---|---|---|

| ❌ Mencionar texto | "Product with '美白精华' written on it" | Modelo redesenha o texto, pode ficar corrompido |

| ✅ Descrever apenas movimento | "Product rotates slowly, soft light" | Preserva o texto da imagem de referência |

| ❌ Prompt em chinês | "化妆品在旋转" | Pode disparar geração de caracteres chineses |

| ✅ Prompt em inglês | "Cosmetic product rotating" | Mais estável, evita disparar renderização de chinês |

Cenários aplicáveis

- Vídeos de produtos de e-commerce: Produtos como cosméticos, alimentos com embalagem que contêm rótulos em chinês

- Promoção de marca: Cenários onde logo e nome da marca precisam ser exibidos com precisão

- Exibição de certificados/prêmios: Objetos que precisam mostrar informações em chinês com clareza

🚀 Sugestão prática: Use a plataforma APIYI (apiyi.com) para chamar a interface i2v do Sora 2, com cobrança por segundo, permitindo múltiplas tentativas com diferentes imagens de referência e combinações de Prompt para encontrar o melhor resultado. Recomenda-se usar Prompt em inglês combinado com imagem de referência em chinês — esta é atualmente a combinação com maior fidelidade de texto.

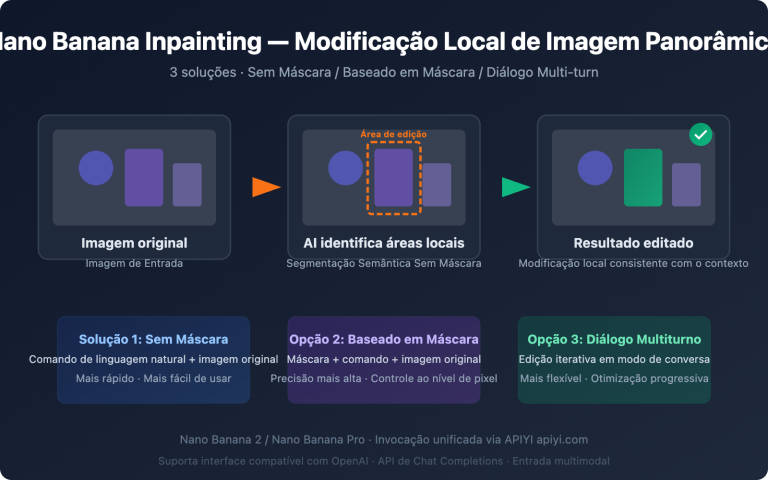

Método 2: Inpainting de Pós-Produção de Vídeo para Substituição Localizada de Texto

Se você já tem um vídeo Sora 2 de qualidade decente mas com texto corrompido, esta é a solução de "reparo pós-geração" mais vale a pena tentar.

O que é Inpainting de Vídeo

A tecnologia de Inpainting de vídeo (reparo/preenchimento) permite apagar e regenerar áreas específicas de um vídeo enquanto mantém o resto da imagem intacto. O fluxo principal é: selecionar a área de texto → IA apaga o texto corrompido → preencher com conteúdo correto.

Comparação das Principais Ferramentas de Inpainting de Vídeo

| Ferramenta | Modo de Operação | Efeito de Substituição de Texto | Custo | Público-alvo |

|---|---|---|---|---|

| Runway Inpainting | Desenhar Mask → Preenchimento com IA | ⭐⭐⭐⭐ Natural | Assinatura | Criadores/Designers |

| After Effects + Sensei | Fluxo VFX profissional | ⭐⭐⭐⭐⭐ Preciso | Assinatura Adobe | Editores profissionais |

| Descript Regenerate | Descrição de texto → Regeneração com IA | ⭐⭐⭐ Aceitável | Assinatura | Criadores de conteúdo |

| Substituição Manual Quadro a Quadro | Processamento quadro a quadro no Photoshop | ⭐⭐⭐⭐⭐ Perfeito | Alto custo de tempo | Perfeccionistas |

Fluxo de Operação do Runway Inpainting

Esta é atualmente a solução mais equilibrada — bom resultado e baixa curva de aprendizado:

- Fazer Upload do Vídeo: Envie o vídeo gerado pelo Sora 2 para o Runway

- Criar Mask: Use a ferramenta de pincel para contornar a área com texto corrompido

- Definir Referência: Diga à IA como essa área deveria ser (fundo puro/texto correto)

- Preenchimento com IA: O Runway analisará e preencherá a área mascarada quadro a quadro

- Verificar Resultado: Verifique quadro a quadro o resultado do preenchimento, especialmente em áreas com movimento rápido

Pontos de Atenção na Operação

- Mask deve cobrir completamente: Inclua sombras e reflexos do texto, caso contrário deixará rastros

- Reproduza em velocidade normal primeiro: Verifique a fluidez geral, depois inspecione detalhes quadro a quadro

- Áreas com movimento rápido: Quanto mais lento o movimento na área de texto, melhor o resultado do Inpainting

- Correspondência de resolução: Certifique-se de que a resolução de saída da ferramenta de Inpainting corresponde ao vídeo original

Método 3: Técnicas de Otimização de Comando para Sora 2 Reduzem Taxa de Erros em Texto

Se você precisa incluir texto durante a geração com Sora 2, as seguintes técnicas de otimização de comando podem melhorar a fidelidade do texto (embora não eliminem completamente o problema).

Estratégia de Otimização de Comando para Texto no Sora 2

| Estratégia | Descrição | Melhoria |

|---|---|---|

| Texto minimalista | Use apenas 1-2 caracteres, evite frases longas | ⭐⭐⭐⭐ Significativa |

| Descrição de alto contraste | "white text on black background" | ⭐⭐⭐ Moderada |

| Comando em inglês | Escreva o comando em inglês, mesmo que o texto alvo seja em chinês | ⭐⭐⭐ Moderada |

| Reduzir duração | Vídeos de 5 segundos são mais estáveis que 12 segundos com texto | ⭐⭐⭐ Moderada |

| Reduzir elementos da cena | Não descreva múltiplos objetos com texto simultaneamente | ⭐⭐⭐ Moderada |

| Câmera fixa | A área do texto não deve ter movimento ou rotação | ⭐⭐⭐⭐ Significativa |

Comparação de Exemplos de Comando

Comando ruim:

Uma garrafa de cosméticos com "肌肤焕新精华液" escrito, a garrafa está girando, fundo com muitos painéis de publicidade em chinês

Comando bom:

A skincare serum bottle with minimalist label, slowly rotating on white surface, studio lighting, static camera, 5 seconds, focus on product texture

Diferença-chave: o comando bom não força o conteúdo do texto, permitindo que o modelo se concentre na qualidade da imagem.

💡 Dica de economia: Otimizar comandos requer testes repetidos. Através da plataforma APIYI apiyi.com, você pode chamar a API Sora 2 com cobrança por segundo. Gerar um vídeo de 4 segundos em 720p custa apenas $0,40, permitindo testar diferentes combinações de comando com baixo custo.

Método 4: Fluxo de Composição em Camadas — Vídeo + Camada de Texto

Esta é a solução comumente usada por equipes de vídeo profissionais: deixar o Sora 2 responsável apenas por gerar material de vídeo sem texto, enquanto a parte de texto é adicionada através de pós-produção.

Fluxo de Composição em Camadas Detalhado

Etapa 1: Gerar vídeo puro sem texto com Sora 2

- Excluir explicitamente elementos de texto no comando

- Deixar espaço para a área de texto (como deixar em branco a área do rótulo do produto)

Etapa 2: Usar rastreamento de movimento para determinar a posição do texto

- After Effects: usar 3D Camera Tracker

- DaVinci Resolve: usar Planar Tracker

- Rastrear o movimento da superfície do produto ou área específica

Etapa 3: Sobrepor camada de texto em chinês

- Usar renderização de fonte padrão para texto em chinês nítido

- Corresponder aos dados de rastreamento, deixando o texto seguir o movimento do objeto

- Ajustar modo de mesclagem e opacidade para integrar à cena

Análise de Vantagens e Desvantagens

| Dimensão | Avaliação |

|---|---|

| Precisão do texto | ⭐⭐⭐⭐⭐ Perfeita, renderização com fonte padrão |

| Grau de fusão natural | ⭐⭐⭐⭐ Requer correspondência de cor |

| Limite operacional | ⭐⭐ Requer habilidades de edição de vídeo |

| Custo de tempo | ⭐⭐ Rastreamento e composição levam tempo |

| Cenários aplicáveis | Produção de vídeo comercial profissional |

Método 5: Estratégia de Combinação de Múltiplos Modelos — Potencializar Forças e Minimizar Fraquezas

Diferentes modelos de vídeo IA têm seus próprios pontos fortes e fracos na renderização de texto. É possível aproveitar as vantagens de qualidade de imagem do Sora 2, combinando com a capacidade de processamento de texto de outras ferramentas.

Pensamento sobre Combinação de Múltiplos Modelos

- Sora 2 gera vídeo principal: Aproveita sua excelente simulação física e qualidade visual

- Flux/DALL·E gera frames com texto: Usa modelos de imagem especializados em renderização de texto para gerar frames-chave

- Software de edição de vídeo faz composição: Integra os frames com texto ao vídeo do Sora 2

Recomendações Práticas de Modelos

As diferenças de capacidade entre modelos na renderização de texto são significativas, permitindo escolher a combinação mais adequada conforme suas necessidades.

🎯 Dica Técnica: Através da plataforma APIYI apiyi.com é possível chamar unificadamente as APIs de múltiplos modelos como Sora 2, DALL·E e Flux, completando fluxos de trabalho com múltiplos modelos em uma única plataforma, alternando modelos conforme necessário, sem precisar gerenciar múltiplas chaves API separadamente.

Guia de Escolha de Soluções para Correção de Vídeos com Texto em Chinês no Sora 2

Escolha a solução mais adequada para sua situação específica:

Situação A: Ainda não começou a gerar vídeos

→ Priorize o Método 1 (imagem para vídeo com referência) ou Método 3 (Otimização de Comando)

Situação B: Já tem vídeo, com texto parcialmente corrompido

→ Priorize o Método 2 (Correção Pós-produção com Inpainting)

Situação C: Precisa de texto em chinês perfeito + vídeo de alta qualidade

→ Escolha o Método 4 (Composição em Camadas) ou Método 5 (Combinação de Múltiplos Modelos)

Situação D: Vídeos de apresentação de produtos (produto com texto integrado)

→ Melhor solução é o Método 1: Use uma foto do produto com texto correto como imagem de referência para o vídeo

💰 Consideração de Custos: Os Métodos 1 e 3 têm o menor custo, podendo ser concluídos através de cobrança por segundo na plataforma APIYI apiyi.com. O Método 2 requer assinatura adicional de ferramentas pós-produção. Os Métodos 4 e 5 têm o maior custo, mas melhor resultado, sendo ideais para projetos comerciais.

Sora 2 – Perguntas Frequentes sobre Vídeos com Texto em Chinês

P1: Se eu colocar o texto no produto antes de gerar o vídeo, o texto não vai deformar?

Não é 100% livre de deformação, mas a probabilidade diminui bastante. Ao usar o modo i2v e enviar uma imagem de referência com texto nítido, o Sora 2 tenta manter os elementos visuais do primeiro quadro. O segredo é não mencionar o conteúdo do texto no comando — descreva apenas o movimento e os efeitos de luz, evitando que o modelo "redesenhe" o texto. Nos testes práticos, textos pequenos na superfície do produto (nome da marca, lista de ingredientes, etc.) têm alta fidelidade, enquanto slogans em grandes áreas ainda correm risco de deformação. Usando a plataforma APIYI (apiyi.com) para chamar a API i2v com cobrança por segundo, você pode testar múltiplas vezes com baixo custo para encontrar os parâmetros ideais.

P2: Se eu corrigir o texto com Inpainting no vídeo, vai ficar artificial?

Depende dos detalhes da operação. Se a área da máscara não for muito grande, o fundo do texto for relativamente simples e o movimento do objeto não for muito intenso, o Inpainting do Runway produz resultados muito naturais. A técnica-chave é fazer a máscara cobrir as sombras e reflexos do texto, além de verificar quadro a quadro após a correção. Para cenas com fundo complexo ou movimento intenso, o processamento profissional do After Effects funciona melhor.

P3: O Sora 2 vai melhorar a renderização de texto em chinês no futuro?

É possível, mas não é otimista a curto prazo. A renderização de texto é um desafio comum a todos os modelos de difusão, não é simplesmente uma questão de dados de treinamento. Envolve limitações no nível da arquitetura do modelo — modelos generativos fazem essencialmente inferência probabilística em nível de pixel, não renderização precisa como um mecanismo de fontes. Enquanto não houver um avanço fundamental na arquitetura do modelo, os 5 métodos acima continuam sendo caminhos de solução viáveis na prática.

P4: Texto em inglês também erra no Sora 2?

Sim, mas com frequência e gravidade muito menores que o chinês. O inglês tem apenas 26 letras com estrutura simples, e o texto em inglês também representa uma proporção maior nos dados de treinamento do Sora 2. Palavras em inglês curtas (nomes de marca, slogans, etc.) geralmente têm qualidade de renderização aceitável, mas frases longas ou texto pequeno em inglês ainda podem errar. Se seu cenário permitir, substituir chinês por inglês é a forma mais simples de evitar o problema.

P5: Há diferença na renderização de texto entre chamar Sora 2 via API e gerar pela web?

O modelo subjacente é o mesmo, então teoricamente não há diferença na renderização de texto. Mas a vantagem de chamar via API é: você pode controlar com precisão os parâmetros (resolução, duração, taxa de quadros), testar em lote diferentes comandos e a rejeição de revisão não é cobrada. Usando a plataforma APIYI (apiyi.com) para chamar com cobrança por segundo, você pode encontrar os parâmetros de geração ideais de forma mais eficiente.

Resumo da Correção de Texto em Chinês no Sora 2

O problema de renderização de texto em chinês no Sora 2 é essencialmente uma limitação técnica dos modelos de vídeo com IA e não será completamente resolvido no nível do modelo a curto prazo. Mas com o design correto do fluxo de trabalho, é totalmente possível produzir vídeos de alta qualidade com texto em chinês preciso.

Lógica central dos 5 métodos:

- Método 1 (imagem de referência i2v) e Método 3 (otimização de comando): resolvem o problema na fase de geração, com menor custo

- Método 2 (Inpainting): corrige o problema na pós-produção, prático e flexível

- Método 4 (composição em camadas) e Método 5 (combinação de múltiplos modelos): as soluções mais profissionais, com melhor resultado mas maior custo

Para a maioria dos cenários, recomendamos o Método 1 (imagem de referência i2v) — incorporar o texto previamente em uma imagem de produto ou cena em alta resolução, gerar o vídeo através da API i2v do Sora 2, combinado com um comando em inglês puro descrevendo os efeitos dinâmicos. Esta é atualmente a solução mais equilibrada entre qualidade e custo.

Através da plataforma APIYI (apiyi.com) você pode chamar unificadamente as APIs t2v e i2v do Sora 2, com cobrança por segundo, suportando múltiplos testes com diferentes combinações de parâmetros — uma escolha conveniente para explorar o fluxo de trabalho ideal.

Referências

-

Solução para caracteres chineses corrompidos no Sora 2: 5 métodos práticos

- Link:

help.apiyi.com/en/sora-2-chinese-text-garbled-solution-en.html - Descrição: Solução completa incluindo otimização de comandos e pós-processamento

- Link:

-

Guia de uso do Runway Inpainting: Reparo localizado de vídeos

- Link:

help.runwayml.com/hc/en-us/articles/19155664495379-Inpainting - Descrição: Passos operacionais e dicas para Inpainting de vídeos

- Link:

-

Guia completo de Inpainting de vídeos com IA: Tutorial passo a passo

- Link:

imagine.art/blogs/inpainting-video-with-ai - Descrição: Tecnologias e ferramentas mais recentes de reparo de vídeos em 2026

- Link:

-

Documentação da API de imagem para vídeo do Sora 2: Parâmetros da interface i2v

- Link:

docs.aimlapi.com/api-references/video-models/openai/sora-2-i2v - Descrição: Como chamar a API Image-to-Video do Sora 2

- Link:

📝 Este artigo foi escrito pela equipe APIYI. Para mais dicas sobre geração de vídeos com Sora 2 e guias de invocação de API, visite APIYI em apiyi.com para obter conteúdo atualizado e suporte técnico.