Autorennotiz: Mit Sora 2 habe ich ein Video mit großartiger Qualität generiert, aber die chinesischen Zeichen im Bild sind schief, verzerrt und unleserlich – einfach zu löschen wäre schade, aber so veröffentlichen ist unprofessionell. Das ist derzeit eines der größten Probleme für Sora-2-Nutzer. Dieser Artikel stellt 5 praktische Lösungen vor, um Videos zu retten, die zwar visuell ansprechend sind, aber bei der Textdarstellung schwächeln.

Kernwert: Lernen Sie, das Problem der chinesischen Textdarstellung in Sora 2 aus zwei Richtungen zu lösen – durch „Prävention vor der Generierung" und „Reparatur nach der Generierung" – damit jeder API-Aufruf sein Geld wert ist.

Sora 2: Warum chinesische Zeichen zu Zeichensalat werden – eine technische Analyse

Bevor wir zu Lösungen kommen, müssen wir das Problem selbst verstehen – warum ist die Darstellung chinesischer Zeichen in Sora 2 so problematisch?

Die technische Grundlage der Textwiedergabe in Sora 2

AI-Videomodelle generieren Text auf eine völlig andere Weise als man denkt. Sie „zeichnen" nicht, sondern „malen" – das Modell erzeugt „pixelbasierte Muster, die wie Text aussehen", anstatt echte Font-Rendering-Engine zu nutzen.

Das führt zu einem grundlegenden Problem:

| Texttyp | Zeichenkomplexität | Sora 2 Renderqualität | Grund |

|---|---|---|---|

| Englische Buchstaben | Niedrig (26 Buchstaben) | ⭐⭐⭐⭐ Akzeptabel | Einfache Striche, ausreichend Trainingsdaten |

| Ziffern | Extrem niedrig (0-9) | ⭐⭐⭐⭐⭐ Gut | Einfache Struktur, leicht zu lernen |

| Vereinfachtes Chinesisch | Hoch (Tausende häufiger Zeichen) | ⭐⭐ Schwach | Komplexe Striche, Radikale leicht verwechselt |

| Traditionelles Chinesisch | Extrem hoch | ⭐ Sehr schwach | Hohe Strichdichte, Details schwer zu rekonstruieren |

| Japanische Hiragana/Katakana | Mittel | ⭐⭐⭐ Befriedigend | Einfacher als Kanji, aber immer noch Abweichungen |

3 typische Fehler bei chinesischen Zeichen

- Strichverzerrung: Die Grundstruktur stimmt, aber Striche sind verzerrt, unterbrochen oder überflüssig

- Radikal-Verwechslung: Linke und rechte Radikale sind falsch kombiniert, es entstehen „Pseudo-Zeichen"

- Völliger Zeichensalat: Es werden bedeutungslose, zeichenähnliche Symbole generiert

🎯 Kernverständnis: Das ist kein Bug von Sora 2, sondern ein gemeinsames Problem aller aktuellen AI-Videomodelle. Wenn man das versteht, kann man die richtige Lösungsstrategie wählen – entweder Text vor der Generierung vorbereiten oder nach der Generierung mit Post-Processing-Tools korrigieren.

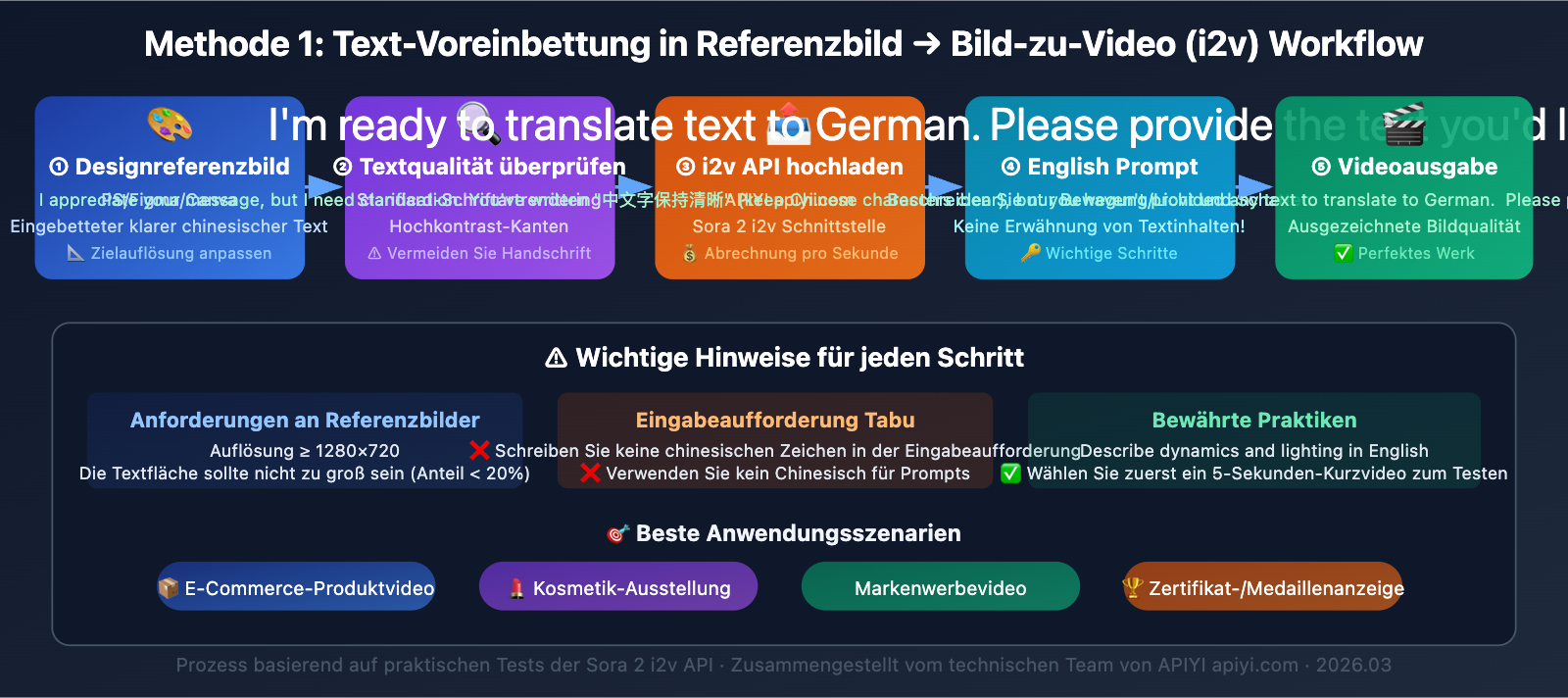

Methode 1: Text in Referenzbild einbetten (Bild-zu-Video i2v-Ansatz)

Das ist derzeit die effektivste „Präventionsstrategie vor der Generierung".

Kernidee: Anstatt Sora 2 selbst chinesische Zeichen „malen" zu lassen, laden Sie ein Bild mit klaren chinesischen Zeichen als Referenzrahmen hoch und lassen das Modell das Video basierend auf diesem Bild generieren.

Sora 2 Bild-zu-Video-Workflow

Die Sora 2 API unterstützt den Image-to-Video-Modus (i2v). Sie können ein Bild mit exakten chinesischen Zeichen als ersten Frame hochladen, und das Modell wird versuchen, die visuellen Elemente des ersten Frames in den nachfolgenden Frames beizubehalten.

Schritt-für-Schritt-Anleitung

Schritt 1: Referenzbild vorbereiten

Erstellen Sie mit Photoshop, Figma oder Canva ein Bild mit klaren chinesischen Zeichen. Wichtige Anforderungen:

- Text mit Standard-Schriftarten rendern (keine Handschrift)

- Auflösung dem Zielvideoformat entsprechend (z. B. 1280×720)

- Hoher Kontrast im Textbereich, scharfe Kanten

Schritt 2: Über i2v API einreichen

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI Sora 2 direkter Proxy-Dienst

)

# Bild-zu-Video-Modus

response = client.chat.completions.create(

model="sora-2-i2v", # Bild-zu-Video-Modell

messages=[

{

"role": "user",

"content": [

{

"type": "image_url",

"image_url": {"url": "https://your-image-url.com/product.png"}

},

{

"type": "text",

"text": "The cosmetic product slowly rotates on a reflective surface, "

"soft studio lighting, cinematic, 8 seconds"

}

]

}

]

)

Schritt 3: Eingabeaufforderungs-Tipps – Text nicht erwähnen

Kernprinzip: In der Eingabeaufforderung nur Bewegung und Lichtwechsel beschreiben, nicht die Textinhalte erwähnen. Sobald Sie chinesische Zeichen in der Eingabeaufforderung schreiben, wird das Modell „den Text neu malen" und die korrekten Zeichen aus dem Referenzbild überschreiben.

| Eingabeaufforderungs-Strategie | Beispiel | Effekt |

|---|---|---|

| ❌ Text erwähnen | "产品上写着'美白精华'" | Modell malt Text neu, möglicherweise Zeichensalat |

| ✅ Nur Dynamik beschreiben | "Product rotates slowly, soft light" | Referenzbild-Text bleibt erhalten |

| ❌ Chinesische Eingabeaufforderung | "化妆品在旋转" | Kann chinesische Zeichengenerierung auslösen |

| ✅ Englische Eingabeaufforderung | "Cosmetic product rotating" | Stabiler, vermeidet chinesische Textwiedergabe |

Anwendungsszenarien

- E-Commerce-Produktvideos: Kosmetik, Lebensmittelverpackungen und andere Produkte mit chinesischen Etiketten

- Markenwerbung: Szenen, in denen Logos und Markennamen präzise angezeigt werden müssen

- Zertifikate/Auszeichnungen: Objekte, die chinesische Informationen klar darstellen müssen

🚀 Praktischer Tipp: Nutzen Sie die APIYI-Plattform (apiyi.com) für den Zugriff auf die Sora 2 i2v-API. Die Abrechnung erfolgt pro Sekunde, sodass Sie verschiedene Kombinationen aus Referenzbild und Eingabeaufforderung testen können, um das beste Ergebnis zu finden. Wir empfehlen, englische Eingabeaufforderungen mit chinesischen Referenzbildern zu kombinieren – das ist derzeit die beste Kombination für Texttreue.

Methode 2: Video-Nachbearbeitung mit Inpainting für lokale Textkorrekturen

Falls du bereits ein qualitativ hochwertiges Sora-2-Video mit fehlerhaftem Text hast, ist dies die lohnendste „Reparatur nach der Generierung"-Lösung.

Was ist Video-Inpainting?

Video-Inpainting (Reparatur/Nachzeichnung) ist eine Technik, mit der bestimmte Bereiche in einem Video gelöscht und neu generiert werden können, während die umgebenden Bildbereiche unverändert bleiben. Der Kernablauf ist: Textbereich auswählen → AI löscht Fehlertext → Korrekte Inhalte neu einfügen.

Vergleich der gängigsten Video-Inpainting-Tools

| Tool | Bedienung | Textersatz-Qualität | Kosten | Zielgruppe |

|---|---|---|---|---|

| Runway Inpainting | Maske zeichnen → AI füllt | ⭐⭐⭐⭐ Natürlich | Abonnement | Creator/Designer |

| After Effects + Sensei | Professioneller VFX-Workflow | ⭐⭐⭐⭐⭐ Präzise | Adobe-Abo | Professionelle Editoren |

| Descript Regenerate | Textbeschreibung → AI regeneriert | ⭐⭐⭐ Akzeptabel | Abonnement | Content Creator |

| Manuelle Frame-für-Frame-Bearbeitung | Photoshop Frame-weise | ⭐⭐⭐⭐⭐ Perfekt | Hoher Zeitaufwand | Perfektionisten |

Arbeitsablauf mit Runway Inpainting

Dies ist derzeit die ausgewogenste Lösung – gute Ergebnisse mit niedrigem Einstiegshürde:

- Video hochladen: Lade das von Sora 2 generierte Video in Runway hoch

- Maske erstellen: Nutze das Pinsel-Werkzeug, um die Bereiche mit fehlerhaftem Text einzukreisen

- Referenz setzen: Teile der AI mit, wie dieser Bereich aussehen soll (reiner Hintergrund/korrekter Text)

- AI-Füllung: Runway analysiert Frame für Frame und füllt die maskierten Bereiche

- Ergebnisse prüfen: Überprüfe Frame für Frame die Füllqualität, besonders bei schnellen Bewegungen

Wichtige Hinweise zur Bedienung

- Maske vollständig abdecken: Schließe auch Schatten und Spiegelungen des Textes ein, sonst bleiben Spuren

- Erst in normaler Geschwindigkeit abspielen: Überprüfe die Gesamtflüssigkeit, dann Frame für Frame die Details

- Schnelle Bewegungen: Je langsamer sich der Textbereich bewegt, desto besser das Inpainting-Ergebnis

- Auflösungsabgleich: Stelle sicher, dass die Ausgabeauflösung des Inpainting-Tools mit dem Original-Video übereinstimmt

Methode 3: Sora 2 Eingabeaufforderung-Optimierungstechniken zur Reduzierung von Textfehlern

Wenn Sie bei der Sora 2-Generierung unbedingt Text einbeziehen müssen, können die folgenden Eingabeaufforderung-Optimierungstechniken die Textwiedergabetreue verbessern (obwohl das Problem nicht vollständig eliminiert werden kann).

Optimierungsstrategien für Text in Sora 2

| Strategie | Beschreibung | Effektivität |

|---|---|---|

| Minimalistischer Text | Nur 1-2 Zeichen verwenden, keine langen Sätze | ⭐⭐⭐⭐ Deutlich |

| Hoher Kontrast | "white text on black background" | ⭐⭐⭐ Mittel |

| Englische Eingabeaufforderung | Eingabeaufforderung auf Englisch schreiben, auch wenn das Ziel chinesischer Text ist | ⭐⭐⭐ Mittel |

| Kürzere Dauer | 5-Sekunden-Videos sind stabiler als 12-Sekunden-Text | ⭐⭐⭐ Mittel |

| Weniger Szenelemente | Nicht mehrere Objekte mit Text gleichzeitig beschreiben | ⭐⭐⭐ Mittel |

| Statische Kamera | Keine Bewegung oder Rotation im Textbereich | ⭐⭐⭐⭐ Deutlich |

Vergleich von Eingabeaufforderungsbeispielen

Schlechte Eingabeaufforderung:

Ein Kosmetikfläschchen mit der Aufschrift "肌肤焕新精华液", das Fläschchen dreht sich, im Hintergrund viele chinesische Werbetafeln

Gute Eingabeaufforderung:

A skincare serum bottle with minimalist label, slowly rotating on white surface, studio lighting, static camera, 5 seconds, focus on product texture

Wichtiger Unterschied: Die gute Eingabeaufforderung erzwingt keine spezifischen Textinhalte und lässt das Modell sich auf die Bildqualität konzentrieren.

💡 Spartipp: Die Optimierung von Eingabeaufforderungen erfordert wiederholte Versuche. Durch die APIYI-Plattform (apiyi.com) mit sekundengenauer Abrechnung für Sora 2 API-Aufrufe kostet die Generierung eines 4-Sekunden-720p-Videos nur 0,40 $, sodass Sie kostengünstig verschiedene Eingabeaufforderungskombinationen testen können.

Methode 4: Schichtweise Compositing-Workflow – Video + Textebene

Dies ist die Lösung, die professionelle Videoteams häufig verwenden: Lassen Sie Sora 2 nur textfreies Videomaterial generieren, während der Text durch Nachbearbeitung als separate Ebene hinzugefügt wird.

Detaillierte Erklärung des schichtweisen Compositing-Workflows

Schritt 1: Generieren Sie mit Sora 2 reines Video ohne Text

- Schließen Sie Textelemente in der Eingabeaufforderung explizit aus

- Reservieren Sie Platz für Textbereiche (z. B. leere Produktetikettenbereiche)

Schritt 2: Verwenden Sie Motion Tracking zur Bestimmung der Textplatzierung

- After Effects: 3D Camera Tracker verwenden

- DaVinci Resolve: Planar Tracker verwenden

- Bewegung der Produktoberfläche oder bestimmter Bereiche verfolgen

Schritt 3: Chinesische Textebene überlagern

- Standardschriftarten für klare chinesische Textrendering verwenden

- Tracking-Daten anpassen, damit Text der Objektbewegung folgt

- Mischmodus und Deckkraft anpassen, um nahtlos in das Bild zu integrieren

Vor- und Nachteile

| Dimension | Bewertung |

|---|---|

| Textgenauigkeit | ⭐⭐⭐⭐⭐ Perfekt, standardisierte Schriftrendering |

| Natürliche Integration | ⭐⭐⭐⭐ Erfordert Farbabstimmung |

| Bedienungskomplexität | ⭐⭐ Erfordert Videobearbeitungsfähigkeiten |

| Zeitaufwand | ⭐⭐ Tracking und Compositing benötigen Zeit |

| Anwendungsszenarien | Professionelle kommerzielle Videoproduktion |

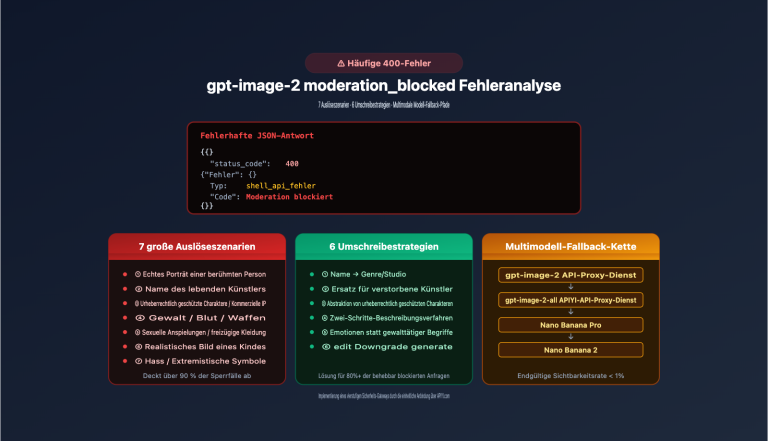

Methode 5: Multi-Modell-Kombinationsstrategie — Stärken nutzen, Schwächen vermeiden

Verschiedene KI-Videomodelle haben unterschiedliche Stärken und Schwächen bei der Textwiedergabe. Sie können die Bildqualitätsvorteile von Sora 2 mit den Textverarbeitungsfähigkeiten anderer Tools kombinieren.

Gedanken zur Multi-Modell-Kombination

- Sora 2 generiert das Hauptvideo: Nutzen Sie die hervorragende physikalische Simulation und Bildqualität

- Flux/DALL·E generiert Text-Frames: Verwenden Sie Bildmodelle, die bei der Textwiedergabe stark sind, um Schlüsselbilder zu erstellen

- Videobearbeitungssoftware kombiniert: Fügen Sie die Text-Frames in das Sora 2-Video ein

Praktische Modellempfehlungen

Verschiedene Modelle zeigen deutliche Unterschiede bei der Textwiedergabe und können je nach Anforderung kombiniert werden.

🎯 Technischer Tipp: Über die APIYI-Plattform apiyi.com können Sie einheitlich auf APIs von Sora 2, DALL·E, Flux und anderen Modellen zugreifen und Multi-Modell-Workflows auf einer Plattform durchführen. Sie können Modelle je nach Bedarf wechseln, ohne mehrere API-Schlüssel separat verwalten zu müssen.

Leitfaden zur Auswahl von Lösungen für chinesische Texte in Sora 2-Videos

Wählen Sie die beste Lösung für Ihre spezifische Situation:

Situation A: Video-Generierung noch nicht gestartet

→ Wählen Sie bevorzugt Methode 1 (Referenzbild i2v) oder Methode 3 (Eingabeaufforderung optimieren)

Situation B: Video vorhanden, Text teilweise fehlerhaft

→ Wählen Sie bevorzugt Methode 2 (Inpainting-Nachbearbeitung)

Situation C: Perfekte chinesische Texte + hochwertige Videos erforderlich

→ Wählen Sie Methode 4 (Schichtweise Zusammensetzung) oder Methode 5 (Multi-Modell-Kombination)

Situation D: Produktdemonstrations-Videos (Produkt hat bereits Text)

→ Beste Lösung ist Methode 1: Verwenden Sie ein Produktfoto mit korrektem Text als i2v-Referenzbild

💰 Kostenüberlegung: Methode 1 und Methode 3 sind am kostengünstigsten und können über APIYI apiyi.com nach Sekunden abgerechnet werden. Methode 2 erfordert zusätzliche Abonnements für Nachbearbeitungstools. Methode 4 und Methode 5 sind am teuersten, bieten aber die beste Qualität und eignen sich für kommerzielle Projekte.

Sora 2 – Häufig gestellte Fragen zu chinesischen Zeichen in Videos

F1: Wenn ich Text auf Produktfotos platziere und dann ein Video generiere, verformt sich der Text dann nicht?

Nicht zu 100 %, aber die Wahrscheinlichkeit einer Verformung sinkt erheblich. Durch den i2v-Modus mit einem Referenzbild, das klare Texte enthält, versucht Sora 2, die visuellen Elemente des ersten Frames beizubehalten. Entscheidend ist, dass Sie im Prompt den Textinhalt nicht erwähnen – beschreiben Sie nur Bewegung und Lichteffekte, um zu vermeiden, dass das Modell den Text „neu zeichnet". In praktischen Tests zeigt sich, dass kleine Textflächen auf Produktoberflächen (Markennamen, Zutatenlisten usw.) eine hohe Wiedergabetreue haben, während große Textbanner immer noch Verformungsrisiken bergen. Durch die Nutzung der APIYI-Plattform (apiyi.com) mit sekundengenauer Abrechnung für i2v-API-Aufrufe können Sie kostengünstig mehrfach testen und optimale Parameter finden.

F2: Wirkt die Reparatur von Text durch Video-Inpainting unnatürlich?

Das hängt von den Operationsdetails ab. Wenn die Maskierungsregion nicht zu groß ist, der Texthintergrund relativ einfach ist und die Objektbewegung nicht zu intensiv ist, liefert Runway Inpainting sehr natürliche Reparaturergebnisse. Der Schlüssel ist, dass die Maske Schatten und Spiegelungen des Textes abdeckt und Sie nach der Reparatur Frame für Frame überprüfen müssen. Bei komplexen Hintergründen oder intensiven Bewegungen bietet die professionelle Bearbeitung in After Effects bessere Ergebnisse.

F3: Wird Sora 2 die Darstellung chinesischer Zeichen in Zukunft verbessern?

Möglich, aber kurzfristig nicht sehr wahrscheinlich. Probleme bei der Textdarstellung sind ein gemeinsames Problem aller Diffusionsmodelle, nicht einfach eine Frage der Trainingsdaten. Dies betrifft Einschränkungen auf Architekturebene – generative Modelle führen im Grunde probabilistische Inferenzen auf Pixelebene durch, nicht präzise Rendering wie eine Schrift-Engine. Solange es keinen grundlegenden Durchbruch in der Modellarchitektur gibt, bleiben die oben genannten fünf Methoden praktisch realisierbare Lösungswege.

F4: Treten auch bei englischen Zeichen in Sora 2 Fehler auf?

Ja, aber Häufigkeit und Schweregrad sind deutlich geringer als bei Chinesisch. Englisch hat nur 26 Buchstaben mit einfacher Struktur, und englischer Text macht einen höheren Anteil der Trainingsdaten von Sora 2 aus. Kurze englische Wörter (Markennamen, Slogans usw.) werden normalerweise akzeptabel dargestellt, aber lange Sätze oder kleine englische Schriftgrößen können immer noch fehlerhaft sein. Wenn Ihr Szenario es zulässt, ist die Umstellung von Chinesisch auf Englisch die einfachste Vermeidungsstrategie.

F5: Gibt es einen Unterschied in der Textdarstellung zwischen API-Aufrufen und der Web-Generierung von Sora 2?

Das zugrunde liegende Modell ist dasselbe, daher sollte die Textdarstellung theoretisch identisch sein. Der Vorteil von API-Aufrufen liegt jedoch darin: Sie können Parameter präzise steuern (Auflösung, Dauer, Bildrate), verschiedene Prompts in Batches testen, und Sentinel-Überprüfungen, die blockiert werden, werden nicht berechnet. Durch die Nutzung der APIYI-Plattform (apiyi.com) mit sekundengenauer Abrechnung für API-Aufrufe können Sie effizienter optimale Generierungsparameter finden.

Zusammenfassung: Reparatur chinesischer Zeichen in Sora-2-Videos

Das Problem der chinesischen Textdarstellung in Sora 2 ist im Grunde eine technische Einschränkung von KI-Videomodellen und wird kurzfristig nicht auf Modellebene vollständig gelöst. Mit dem richtigen Workflow-Design können Sie jedoch problemlos hochwertige Videos mit präzisen chinesischen Zeichen erstellen.

Kernlogik der fünf Methoden:

- Methode 1 (Referenzbild i2v) und Methode 3 (Prompt-Optimierung): Lösen das Problem in der Generierungsphase, niedrigste Kosten

- Methode 2 (Inpainting): Repariert das Problem in der Nachbearbeitung, flexibel und praktisch

- Methode 4 (Schichtkomposition) und Methode 5 (Multi-Modell-Kombination): Die professionellsten Lösungen mit den besten Ergebnissen, aber höchste Kosten

Für die meisten Szenarien empfehlen wir Methode 1 (Referenzbild i2v) – platzieren Sie Text vorab auf hochauflösenden Produkt- oder Szenariobildern und generieren Sie Videos mit Sora 2s i2v-API, kombiniert mit rein englischen Prompts zur Beschreibung von Bewegungseffekten. Dies ist derzeit die ausgewogenste Lösung zwischen Qualität und Kosten.

Über die APIYI-Plattform (apiyi.com) können Sie einheitlich Sora 2s t2v- und i2v-APIs aufrufen, mit sekundengenauer Abrechnung und Unterstützung für mehrfaches Testen verschiedener Parameterkombinationen – eine praktische Wahl zur Erkundung des optimalen Workflows.

Referenzmaterial

-

Sora 2 Chinesische Zeichenkodierung Lösungsansätze: 5 praktische Methoden

- Link:

help.apiyi.com/en/sora-2-chinese-text-garbled-solution-en.html - Beschreibung: Umfassende Lösung mit Eingabeaufforderungs-Optimierung und Nachbearbeitung

- Link:

-

Runway Inpainting Anleitung: Lokale Videoreparatur

- Link:

help.runwayml.com/hc/en-us/articles/19155664495379-Inpainting - Beschreibung: Schritte und Tipps für Video-Inpainting-Operationen

- Link:

-

KI-Video-Inpainting Vollständiger Leitfaden: Schritt-für-Schritt-Anleitung

- Link:

imagine.art/blogs/inpainting-video-with-ai - Beschreibung: Neueste Videoreparaturtechnologie und Tools für 2026

- Link:

-

Sora 2 Bild-zu-Video API-Dokumentation: i2v-Schnittstellenparameter

- Link:

docs.aimlapi.com/api-references/video-models/openai/sora-2-i2v - Beschreibung: API-Aufrufe für Sora 2 Image-to-Video

- Link:

📝 Dieser Artikel wurde vom APIYI-Team verfasst. Weitere Tipps zur Sora 2-Videogenerierung und API-Aufrufleitfäden finden Sie auf APIYI unter apiyi.com für aktuelle Inhalte und technischen Support.