Nota del autor: Generé un video de excelente calidad con Sora 2, pero los caracteres chinos en pantalla quedaron torcidos, ilegibles y poco profesionales. Descartarlo sería una lástima, pero publicarlo así tampoco es opción. Este es uno de los problemas más frustrantes para los usuarios de Sora 2 actualmente. Este artículo explora 5 soluciones prácticas para rescatar esos trabajos «con video impresionante pero texto desastroso».

Valor central: Aprende a resolver el problema de renderizado de caracteres chinos en Sora 2 desde dos frentes: «prevención antes de generar» y «reparación después de generar», para que cada invocación del modelo cuente.

Sora 2 中文字为什么会乱码:技术原理分析

En esta guía te explicaré por qué Sora 2 tiene problemas con el texto en chino y cómo solucionarlo.

La lógica subyacente de la renderización de texto en Sora 2

Los modelos de vídeo de IA generan texto de una manera completamente diferente a la que imaginas. No están "escribiendo", sino "dibujando" — el modelo genera "patrones de píxeles que parecen texto", no invoca realmente un motor de renderización de fuentes.

Esto crea un problema fundamental:

| Tipo de texto | Complejidad de caracteres | Calidad de renderización en Sora 2 | Razón |

|---|---|---|---|

| Letras inglesas | Baja (26 letras) | ⭐⭐⭐⭐ Aceptable | Trazos simples, datos de entrenamiento abundantes |

| Números | Muy baja (0-9) | ⭐⭐⭐⭐⭐ Buena | Estructura simple, fácil de aprender para el modelo |

| Chino simplificado | Alta (miles de caracteres comunes) | ⭐⭐ Pobre | Trazos complejos, radicales fáciles de confundir |

| Chino tradicional | Muy alta | ⭐ Muy pobre | Densidad de trazos alta, detalles difíciles de restaurar |

| Hiragana/Katakana | Media | ⭐⭐⭐ Regular | Más simple que caracteres chinos, pero aún con desviaciones |

3 manifestaciones típicas de problemas con caracteres chinos

- Deformación de trazos: La estructura básica del carácter es correcta, pero los trazos se tuercen, rompen o tienen excesos

- Confusión de radicales: Combinación incorrecta de radicales izquierdo-derecho, generando "símbolos que parecen caracteres pero no lo son"

- Codificación completamente corrupta: Generación de símbolos sin sentido que no parecen texto

🎯 Comprensión clave: Esto no es un error de Sora 2, sino un problema común a todos los modelos de vídeo de IA actuales. Una vez que entiendas esto, podrás elegir la estrategia correcta: procesar el texto antes de la generación o repararlo después con herramientas de postproducción.

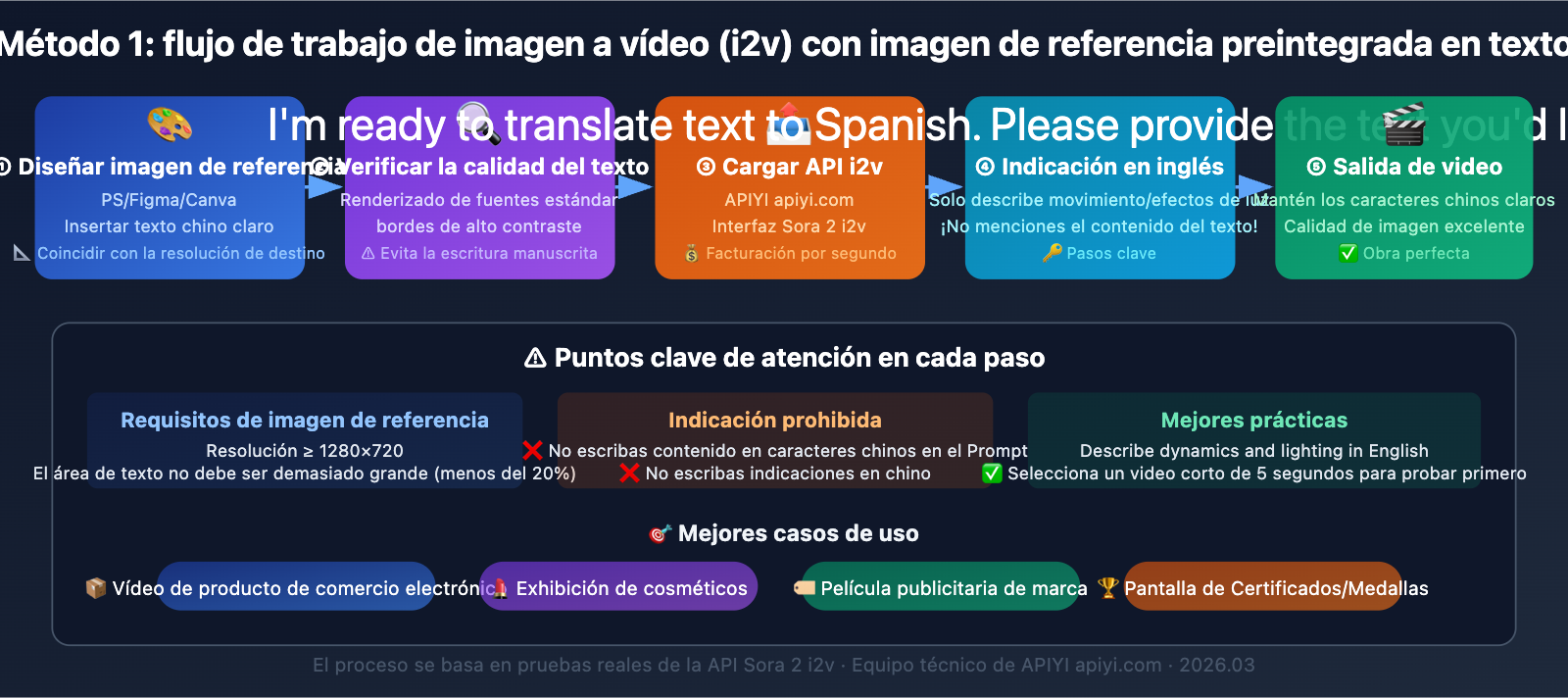

Método 1: Preincrustar texto en una imagen de referencia (solución i2v de imagen a vídeo)

Esta es actualmente la solución más efectiva de "prevención previa a la generación".

La idea central: en lugar de depender de que Sora 2 "dibuje" caracteres chinos por sí solo, carga una imagen con texto chino claro como fotograma de referencia y deja que el modelo genere el vídeo basándose en esa imagen.

Flujo de trabajo de imagen a vídeo en Sora 2

La API de Sora 2 admite el modo Image-to-Video (i2v), donde puedes cargar una imagen con texto chino preciso como primer fotograma del vídeo, y el modelo intentará mantener los elementos visuales del primer fotograma al generar los fotogramas posteriores.

Pasos operativos específicos

Paso 1: Preparar la imagen de referencia

Usa herramientas de diseño como Photoshop, Figma o Canva para crear una imagen con texto chino claro. Requisitos clave:

- Usa fuentes estándar para renderizar el texto (no fuentes manuscritas)

- Resolución consistente con el vídeo objetivo (por ejemplo, 1280×720)

- Área de texto con alto contraste y bordes nítidos

Paso 2: Enviar a través de la API i2v

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # Interfaz proxy directo de APIYI para Sora 2

)

# Modo imagen a vídeo

response = client.chat.completions.create(

model="sora-2-i2v", # Modelo de imagen a vídeo

messages=[

{

"role": "user",

"content": [

{

"type": "image_url",

"image_url": {"url": "https://your-image-url.com/product.png"}

},

{

"type": "text",

"text": "The cosmetic product slowly rotates on a reflective surface, "

"soft studio lighting, cinematic, 8 seconds"

}

]

}

]

)

Paso 3: Trucos de indicación — no menciones el contenido del texto

Principio clave: en la indicación, solo describe el movimiento y los cambios de iluminación, no menciones el contenido del texto en la pantalla. Una vez que escribas caracteres chinos en la indicación, el modelo "redibujará el texto", sobrescribiendo el texto correcto de la imagen de referencia.

| Estrategia de indicación | Ejemplo | Efecto |

|---|---|---|

| ❌ Mencionar texto | "产品上写着'美白精华'" | El modelo redibuja el texto, posible corrupción |

| ✅ Solo describir movimiento | "Product rotates slowly, soft light" | Preserva el texto de la imagen de referencia |

| ❌ Indicación en chino | "化妆品在旋转" | Puede desencadenar generación de caracteres chinos |

| ✅ Indicación en inglés | "Cosmetic product rotating" | Más estable, evita desencadenar renderización de chino |

Casos de uso aplicables

- Vídeos de productos de comercio electrónico: Productos como cosméticos, alimentos con etiquetas chinas

- Promoción de marca: Escenas donde logos y nombres de marca necesitan mostrarse con precisión

- Exhibición de certificados/medallas: Objetos que necesitan mostrar información en chino de forma clara

🚀 Consejo práctico: Usa la plataforma APIYI en apiyi.com para invocar la interfaz i2v de Sora 2, con facturación por segundo. Puedes intentar múltiples combinaciones de imágenes de referencia e indicaciones para encontrar el mejor resultado. Se recomienda usar indicaciones en inglés combinadas con imágenes de referencia en chino, que es actualmente la combinación con mayor fidelidad de texto.

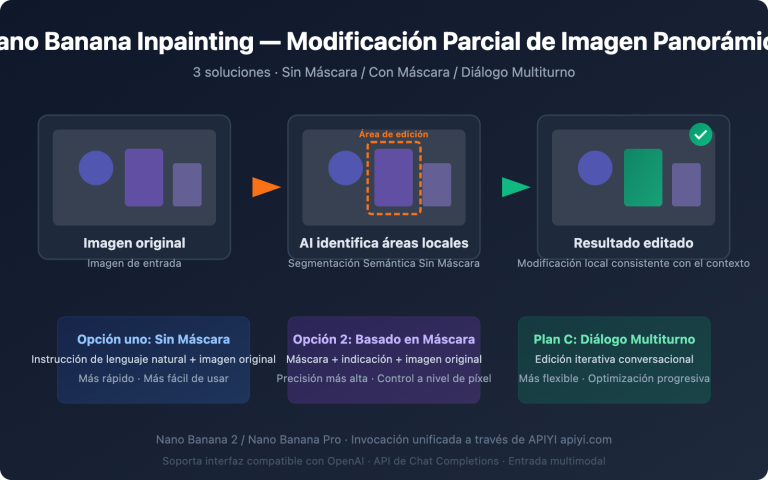

Método 2: Inpainting de video en postproducción para reemplazar texto localmente

Si ya tienes un video de Sora 2 de buena calidad pero con texto corrupto, esta es la solución de "reparación post-generación" más recomendable.

Qué es el Inpainting de video

El Inpainting de video (técnica de reparación/repintado) permite borrar y regenerar áreas específicas de un video mientras mantiene el resto de la imagen intacta. El flujo principal es: seleccionar el área de texto → IA borra el texto corrupto → rellenar con contenido correcto.

Comparativa de herramientas principales de Inpainting de video

| Herramienta | Modo de operación | Efecto de reemplazo de texto | Costo | Ideal para |

|---|---|---|---|---|

| Runway Inpainting | Dibujar Mask → Relleno IA | ⭐⭐⭐⭐ Natural | Suscripción | Creadores/Diseñadores |

| After Effects + Sensei | Flujo VFX profesional | ⭐⭐⭐⭐⭐ Preciso | Suscripción Adobe | Editores profesionales |

| Descript Regenerate | Descripción de texto → Regeneración IA | ⭐⭐⭐ Aceptable | Suscripción | Creadores de contenido |

| Reemplazo manual fotograma a fotograma | Procesamiento fotograma a fotograma en Photoshop | ⭐⭐⭐⭐⭐ Perfecto | Alto costo de tiempo | Perfeccionistas |

Flujo de operación con Runway Inpainting

Esta es actualmente la solución más equilibrada: buen resultado y umbral de operación bajo:

- Subir video: Carga el video generado por Sora 2 a Runway

- Crear Mask: Usa la herramienta de pincel para rodear las áreas con texto corrupto

- Establecer referencia: Indica a la IA cómo debería verse esa área (fondo limpio/texto correcto)

- Relleno IA: Runway analiza fotograma a fotograma y rellena las áreas enmascaradas

- Verificar resultado: Revisa fotograma a fotograma el resultado del relleno, prestando especial atención a las partes con movimiento rápido

Consideraciones operativas

- Mask debe ser completo: Incluye sombras y reflejos del texto, de lo contrario quedarán rastros

- Reproducción a velocidad normal primero: Verifica la fluidez general, luego revisa fotograma a fotograma los detalles

- Áreas con movimiento rápido: Cuanto más lento sea el movimiento del área de texto, mejor será el resultado del Inpainting

- Coincidencia de resolución: Asegúrate de que la resolución de salida de la herramienta Inpainting coincida con la del video original

Método 3: Técnicas de optimización de indicaciones en Sora 2 para reducir errores de texto

Si necesitas incluir texto durante la generación con Sora 2, las siguientes técnicas de optimización de indicaciones pueden mejorar la precisión del texto (aunque no eliminarán completamente el problema).

Estrategia de optimización de texto en indicaciones para Sora 2

| Estrategia | Descripción | Mejora |

|---|---|---|

| Texto minimalista | Solo 1-2 caracteres, sin oraciones largas | ⭐⭐⭐⭐ Significativa |

| Descripción de alto contraste | "white text on black background" | ⭐⭐⭐ Moderada |

| Indicación en inglés | Escribe la indicación en inglés, incluso si el objetivo es texto en chino | ⭐⭐⭐ Moderada |

| Reducir duración | Videos de 5 segundos son más estables que los de 12 segundos | ⭐⭐⭐ Moderada |

| Minimizar elementos de escena | No describas múltiples objetos con texto simultáneamente | ⭐⭐⭐ Moderada |

| Cámara fija | El área de texto no debe tener movimiento ni rotación | ⭐⭐⭐⭐ Significativa |

Comparación de ejemplos de indicaciones

Indicación deficiente:

Una botella de cosméticos con "肌肤焕新精华液" escrito, la botella está rotando, hay muchos carteles publicitarios en chino de fondo

Indicación efectiva:

A skincare serum bottle with minimalist label, slowly rotating on white surface, studio lighting, static camera, 5 seconds, focus on product texture

Diferencia clave: la indicación efectiva no fuerza el contenido de texto, permitiendo que el modelo se enfoque en la calidad visual.

💡 Consejo para ahorrar: Optimizar indicaciones requiere pruebas iterativas. A través de la plataforma APIYI apiyi.com, invoca la API de Sora 2 con facturación por segundo. Generar un video de 4 segundos a 720p cuesta solo $0,40, permitiéndote probar diferentes combinaciones de indicaciones a bajo costo.

Método 4: Flujo de composición por capas — video + capa de texto

Esta es la solución que utilizan los equipos de video profesionales: dejar que Sora 2 genere solo material de video sin texto, e integrar el texto mediante composición en postproducción.

Explicación detallada del flujo de composición por capas

Paso 1: Generar video puro sin texto con Sora 2

- Excluir explícitamente elementos de texto en la indicación

- Dejar espacio reservado para el texto (como áreas en blanco en etiquetas de productos)

Paso 2: Usar seguimiento de movimiento para determinar la posición del texto

- After Effects: utilizar 3D Camera Tracker

- DaVinci Resolve: utilizar Planar Tracker

- Rastrear el movimiento de la superficie del producto o área específica

Paso 3: Superponer capa de texto en chino

- Renderizar texto claro usando fuentes estándar

- Hacer coincidir los datos de seguimiento para que el texto siga el movimiento del objeto

- Ajustar modo de fusión y opacidad para integrar en la escena

Análisis de ventajas y desventajas

| Aspecto | Evaluación |

|---|---|

| Precisión del texto | ⭐⭐⭐⭐⭐ Perfecta, renderizado con fuentes estándar |

| Grado de fusión natural | ⭐⭐⭐⭐ Requiere ajuste de color |

| Umbral de operación | ⭐⭐ Requiere habilidades de edición de video |

| Costo de tiempo | ⭐⭐ El seguimiento y composición requieren tiempo |

| Escenarios aplicables | Producción de video comercial profesional |

Método 5: Estrategia de combinación multimodelo — aprovechar fortalezas y evitar debilidades

Los diferentes modelos de video de IA tienen ventajas y desventajas distintas en la renderización de texto. Puedes aprovechar las ventajas de calidad de imagen de Sora 2, combinándolas con las capacidades de procesamiento de texto de otras herramientas.

Enfoque de combinación multimodelo

- Sora 2 genera el video principal: aprovecha su excelente simulación física y calidad visual

- Flux/DALL·E generan fotogramas con texto: utiliza modelos de imagen especializados en renderización de texto para generar fotogramas clave

- Software de edición de video para composición: integra los fotogramas con texto en el video de Sora 2

Recomendaciones prácticas de modelos

Las capacidades de renderización de texto varían significativamente entre modelos, permitiéndote elegir la combinación más adecuada según tus necesidades.

🎯 Recomendación técnica: A través de la plataforma APIYI apiyi.com puedes invocar de forma unificada las APIs de múltiples modelos como Sora 2, DALL·E y Flux, completando flujos de trabajo multimodelo en una sola plataforma, cambiando entre modelos según sea necesario, sin necesidad de gestionar múltiples claves API por separado.

Guía de selección de soluciones para reparación de video con texto en chino en Sora 2

Elige la solución más adecuada según tu situación específica:

Situación A: Aún no has comenzado a generar video

→ Prioriza el Método 1 (imagen de referencia i2v) o el Método 3 (optimización de indicación)

Situación B: Ya tienes video, con texto parcialmente corrupto

→ Prioriza el Método 2 (reparación posterior con Inpainting)

Situación C: Necesitas texto en chino perfecto + video de alta calidad

→ Elige el Método 4 (composición en capas) o el Método 5 (combinación multimodelo)

Situación D: Video de demostración de productos (el producto incluye texto)

→ La mejor solución es el Método 1: utiliza una foto del producto con texto correcto como imagen de referencia para i2v

💰 Consideraciones de costo: Los Métodos 1 y 3 tienen el costo más bajo, completándose mediante facturación por segundo a través de APIYI apiyi.com. El Método 2 requiere suscripciones adicionales a herramientas de postproducción. Los Métodos 4 y 5 tienen el costo más alto pero ofrecen los mejores resultados, siendo ideales para proyectos comerciales.

Preguntas frecuentes sobre Sora 2 y texto en videos

P1: ¿Si coloco el texto en la imagen del producto antes de generar el video, el texto no se deformará?

No es 100% libre de deformación, pero la probabilidad se reduce significativamente. Al cargar una imagen de referencia con texto claro mediante el modo i2v, Sora 2 hará su mejor esfuerzo por mantener los elementos visuales del primer fotograma. Lo clave es no mencionar el contenido del texto en la indicación, solo describir el movimiento y los efectos de luz y sombra, evitando que el modelo "redibuje" el texto. En pruebas reales, el texto de pequeña área en superficies de productos (nombres de marca, listas de ingredientes, etc.) tiene una fidelidad bastante alta, mientras que los textos de gran área siguen teniendo riesgo de deformación. A través de la plataforma APIYI (apiyi.com), puedes invocar la API i2v con facturación por segundo para probar múltiples veces con diferentes parámetros a bajo costo.

P2: ¿Después de reparar el texto con inpainting de video, se verá muy artificial?

Depende de los detalles de la operación. Si la región de máscara no es demasiado grande, el fondo del texto es relativamente simple y el movimiento del objeto no es muy intenso, la reparación con Runway Inpainting es muy natural. La técnica clave es que la máscara debe cubrir las sombras y reflejos del texto, y después de la reparación necesitas revisar fotograma por fotograma. Para escenas con fondos complejos o movimiento intenso, el procesamiento de nivel profesional de After Effects ofrece mejores resultados.

P3: ¿Mejorará Sora 2 la renderización de texto en chino en el futuro?

Es posible pero poco probable a corto plazo. El problema de renderización de texto es un desafío común en todos los modelos de difusión, no es simplemente un problema de datos de entrenamiento. Esto implica limitaciones a nivel de arquitectura del modelo: los modelos generativos esencialmente hacen inferencia probabilística a nivel de píxeles, no renderización precisa como un motor de fuentes. Hasta que no haya un avance fundamental en la arquitectura del modelo, los 5 métodos mencionados anteriormente siguen siendo rutas de solución prácticamente viables.

P4: ¿También comete errores el texto en inglés en Sora 2?

Sí, pero con una frecuencia y gravedad mucho menores que el chino. El inglés tiene solo 26 letras con una estructura simple, y el texto en inglés también ocupa una proporción mayor en los datos de entrenamiento de Sora 2. La calidad de renderización de palabras en inglés cortas (nombres de marca, eslóganes, etc.) generalmente es aceptable, pero las oraciones largas o el texto en inglés de tamaño pequeño aún pueden cometer errores. Si tu escena lo permite, reemplazar el chino con inglés es la forma más simple de evitar el problema.

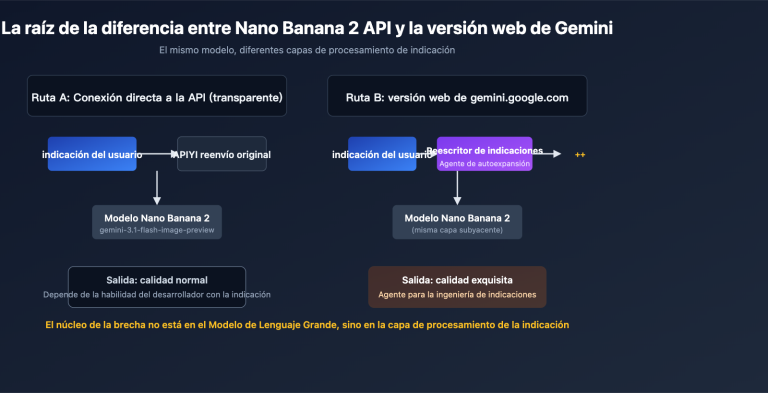

P5: ¿Hay diferencia en el efecto de renderización de texto entre invocar Sora 2 por API y generar desde la web?

El modelo subyacente es el mismo, por lo que teóricamente no hay diferencia en el efecto de renderización de texto. Pero la ventaja de invocar por API es que puedes controlar con precisión los parámetros (resolución, duración, velocidad de fotogramas), puedes probar lotes de diferentes indicaciones, y el bloqueo de revisión de Sentinel no se cobra. A través de la plataforma APIYI (apiyi.com) con facturación por segundo, puedes encontrar de manera más eficiente los parámetros de generación óptimos.

Resumen de reparación de texto en chino para Sora 2

El problema de renderización de texto en chino de Sora 2 es esencialmente una limitación técnica de los modelos de video de IA, que no se resolverá completamente a nivel de modelo a corto plazo. Pero con el diseño correcto del flujo de trabajo, es completamente posible producir videos de alta calidad con texto en chino preciso.

Lógica central de los 5 métodos:

- Método 1 (imagen de referencia i2v) y Método 3 (optimización de indicación): resuelven el problema en la fase de generación, con el costo más bajo

- Método 2 (Inpainting): repara el problema en la fase de postproducción, práctico y flexible

- Método 4 (composición en capas) y Método 5 (combinación multimodelo): la solución más profesional, con los mejores resultados pero el costo más alto

Para la mayoría de escenarios, recomendamos Método 1 (imagen de referencia i2v): preintegra el texto en una imagen de producto o escena de alta definición, genera el video a través de la API i2v de Sora 2, combinado con una indicación en inglés puro que describa los efectos dinámicos. Esta es actualmente la solución más equilibrada entre efectividad y costo.

A través de la plataforma APIYI (apiyi.com) puedes invocar unificadamente las APIs t2v e i2v de Sora 2, con facturación por segundo, compatible con múltiples pruebas de diferentes combinaciones de parámetros, siendo una opción conveniente para explorar el flujo de trabajo óptimo.

Referencias

-

Solución de caracteres chinos distorsionados en Sora 2: 5 métodos prácticos

- Enlace:

help.apiyi.com/en/sora-2-chinese-text-garbled-solution-en.html - Descripción: Solución completa que incluye optimización de indicaciones y procesamiento posterior

- Enlace:

-

Guía de uso de Runway Inpainting: Reparación de video localizada

- Enlace:

help.runwayml.com/hc/en-us/articles/19155664495379-Inpainting - Descripción: Pasos operativos y técnicas para Inpainting de video

- Enlace:

-

Guía completa de Inpainting de video con IA: Tutorial paso a paso

- Enlace:

imagine.art/blogs/inpainting-video-with-ai - Descripción: Tecnologías y herramientas más recientes de reparación de video en 2026

- Enlace:

-

Documentación de API de imagen a video de Sora 2: Parámetros de interfaz i2v

- Enlace:

docs.aimlapi.com/api-references/video-models/openai/sora-2-i2v - Descripción: Forma de invocar la API de Sora 2 Image-to-Video

- Enlace:

📝 Este artículo fue escrito por el equipo de APIYI. Para más técnicas de generación de video con Sora 2 y guías de invocación de API, te invitamos a visitar APIYI en apiyi.com para obtener contenido actualizado y soporte técnico.