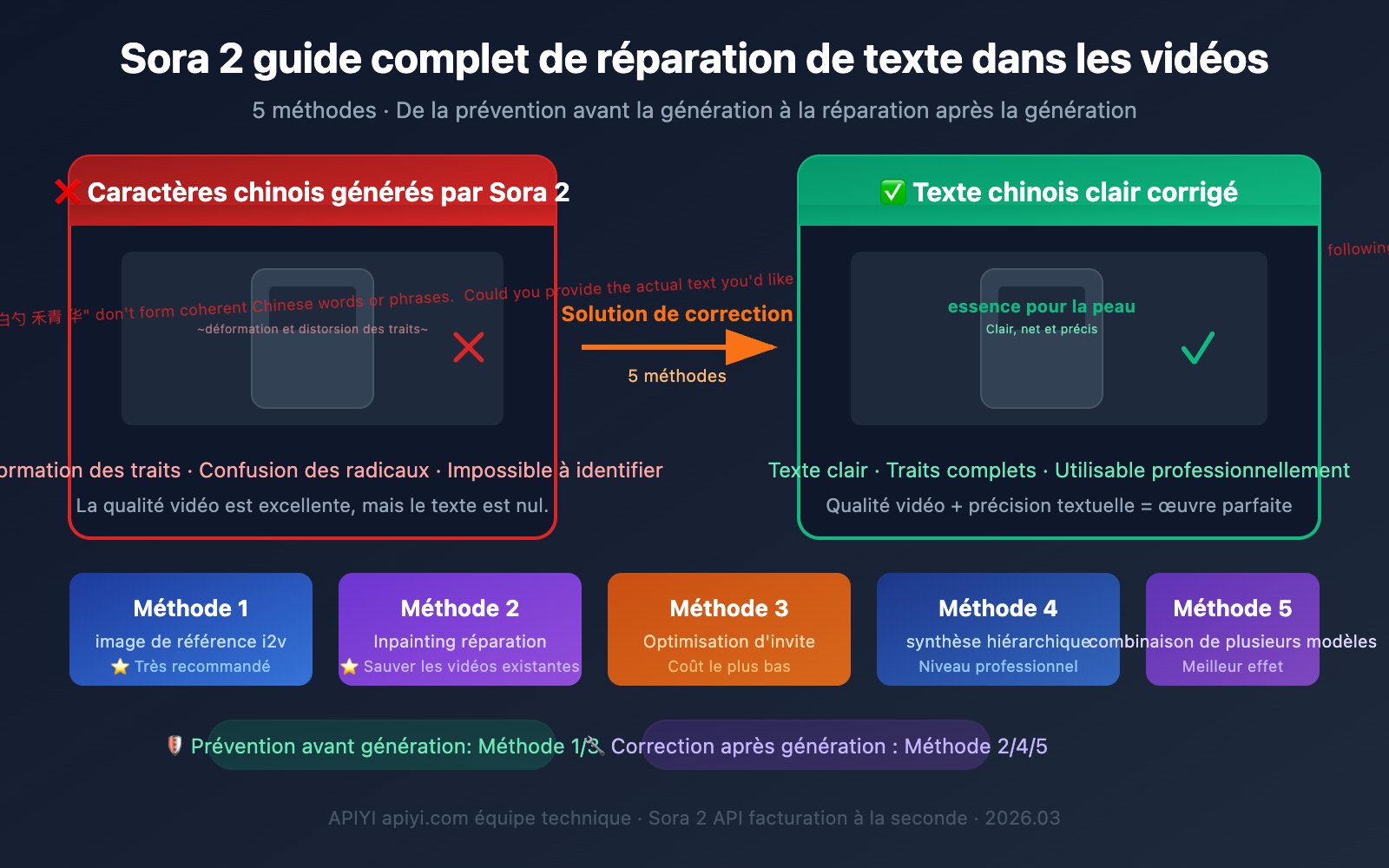

Note de l'auteur : J'ai généré une vidéo de très bonne qualité avec Sora 2, mais le texte chinois à l'écran était tordu, flou et peu lisible — c'est dommage de la jeter, mais l'envoyer ainsi n'est pas professionnel. C'est actuellement l'un des problèmes les plus frustrants pour les utilisateurs de Sora 2. Cet article explore 5 solutions pratiques pour sauver vos créations « vidéo superbe mais texte catastrophique ».

Valeur clé : Apprenez à résoudre le problème du rendu de texte chinois dans Sora 2 sous deux angles — « prévention avant génération » et « correction après génération » — pour que chaque appel API ne soit pas gaspillé.

Sora 2 : pourquoi les caractères chinois s'affichent mal — Analyse technique

Avant de présenter les solutions, il faut d'abord comprendre le problème lui-même — pourquoi le rendu des caractères chinois dans Sora 2 est-il si mauvais ?

La logique sous-jacente du rendu de texte dans Sora 2

La façon dont les modèles vidéo IA génèrent du texte est complètement différente de ce que vous imaginez. Ce n'est pas « écrire des caractères », mais « dessiner des caractères » — le modèle génère des « motifs de pixels qui ressemblent à du texte », plutôt que d'appeler un véritable moteur de rendu de polices.

Cela crée un problème fondamental :

| Type de texte | Complexité des caractères | Qualité de rendu Sora 2 | Raison |

|---|---|---|---|

| Lettres anglaises | Faible (26 lettres) | ⭐⭐⭐⭐ Acceptable | Traits simples, données d'entraînement suffisantes |

| Chiffres | Très faible (0-9) | ⭐⭐⭐⭐⭐ Bon | Structure simple, facile à apprendre pour le modèle |

| Chinois simplifié | Élevé (milliers de caractères courants) | ⭐⭐ Faible | Traits complexes, radicaux facilement confondus |

| Chinois traditionnel | Très élevé | ⭐ Très faible | Densité de traits élevée, détails difficiles à restituer |

| Hiragana/Katakana | Moyen | ⭐⭐⭐ Moyen | Plus simple que les caractères chinois, mais encore imprécis |

3 manifestations typiques des problèmes de caractères chinois

- Déformation des traits : la structure de base du caractère est correcte, mais les traits sont tordus, cassés ou superflus

- Confusion des radicaux : combinaison incorrecte des radicaux gauche-droit, générant des « caractères qui ne sont pas des caractères »

- Charabia complet : génération de symboles sans sens ressemblant vaguement à du texte

🎯 Concept clé : ce n'est pas un bug de Sora 2, c'est un problème commun à tous les modèles vidéo IA actuels. Une fois que vous comprenez cela, vous pouvez choisir la bonne stratégie — soit traiter le texte avant la génération, soit le corriger après avec des outils de post-production.

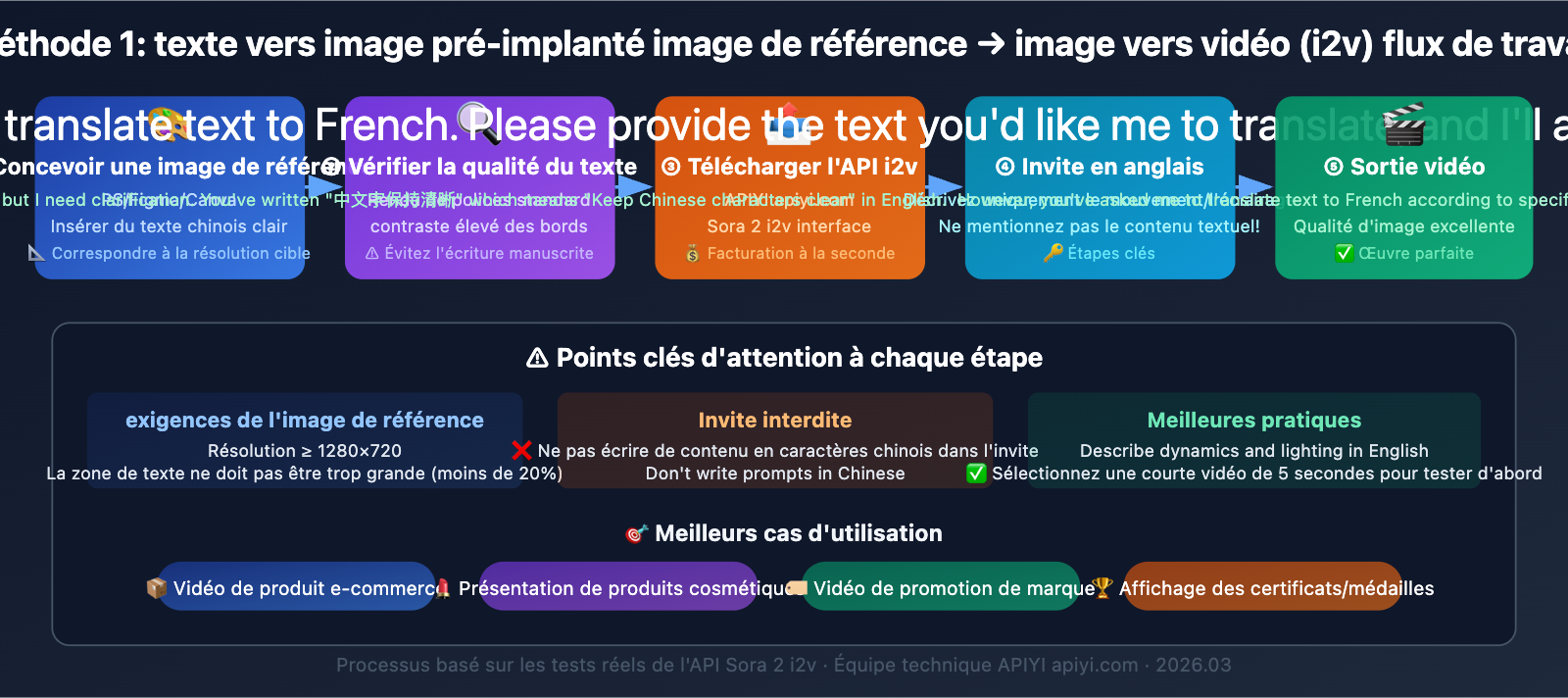

Méthode 1 : Intégrer le texte dans une image de référence (approche i2v image vers vidéo)

C'est actuellement la meilleure solution de « prévention avant génération ».

Idée clé : au lieu de laisser Sora 2 « dessiner » les caractères chinois lui-même, vous téléchargez une image contenant des caractères chinois clairs comme cadre de référence, et le modèle génère la vidéo en conservant les éléments visuels de cette première image.

Étapes opérationnelles détaillées

Étape 1 : Préparer l'image de référence

Créez une image contenant des caractères chinois clairs à l'aide d'outils de conception comme Photoshop, Figma ou Canva. Exigences clés :

- Utilisez des polices standard pour le rendu du texte (pas de polices manuscrites)

- Résolution cohérente avec la vidéo cible (par exemple 1280×720)

- Zones de texte avec contraste élevé et bords nets

Étape 2 : Soumettre via l'API i2v

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # Service proxy API APIYI pour Sora 2

)

# Mode image vers vidéo

response = client.chat.completions.create(

model="sora-2-i2v", # Modèle image vers vidéo

messages=[

{

"role": "user",

"content": [

{

"type": "image_url",

"image_url": {"url": "https://your-image-url.com/product.png"}

},

{

"type": "text",

"text": "The cosmetic product slowly rotates on a reflective surface, "

"soft studio lighting, cinematic, 8 seconds"

}

]

}

]

)

Étape 3 : Astuces pour l'invite — ne pas mentionner le contenu textuel

Principe clé : dans votre invite, décrivez uniquement les mouvements et les changements d'éclairage, sans mentionner le contenu textuel de l'image. Dès que vous écrivez du texte chinois dans l'invite, le modèle « redessine » le texte, ce qui peut recouvrir le texte correct de l'image de référence.

| Stratégie d'invite | Exemple | Résultat |

|---|---|---|

| ❌ Mentionner le texte | "产品上写着'美白精华'" | Le modèle redessine le texte, risque de charabia |

| ✅ Décrire uniquement la dynamique | "Product rotates slowly, soft light" | Préserve le texte de l'image de référence |

| ❌ Invite en chinois | "化妆品在旋转" | Peut déclencher la génération de caractères chinois |

| ✅ Invite en anglais | "Cosmetic product rotating" | Plus stable, évite de déclencher le rendu de texte chinois |

Cas d'usage appropriés

- Vidéos de produits e-commerce : produits cosmétiques, emballages alimentaires et autres produits portant naturellement des étiquettes en chinois

- Communications de marque : scénarios où le logo et le nom de la marque doivent être affichés avec précision

- Présentation de certificats/médailles : objets nécessitant un affichage clair d'informations en chinois

🚀 Conseil pratique : utilisez la plateforme APIYI (apiyi.com) pour appeler l'interface i2v de Sora 2, avec facturation à la seconde. Vous pouvez essayer plusieurs fois différentes combinaisons d'images de référence et d'invites pour trouver le meilleur résultat. Il est recommandé d'utiliser une invite en anglais avec une image de référence en chinois — c'est actuellement la combinaison offrant la meilleure fidélité textuelle.

Méthode 2 : Inpainting vidéo en post-production pour remplacer du texte localement

Si vous avez déjà une vidéo Sora 2 de bonne qualité mais avec du texte corrompu, c'est la solution de « réparation après génération » la plus intéressante à essayer.

Qu'est-ce que l'Inpainting vidéo

L'Inpainting vidéo (technique de réparation/remplissage) permet d'effacer et de régénérer des zones spécifiques d'une vidéo tout en conservant le reste de l'image intacte. Le processus clé est : sélectionner la zone de texte → l'IA efface le texte corrompu → remplissage avec le contenu correct.

Comparaison des principaux outils d'Inpainting vidéo

| Outil | Mode opératoire | Effet de remplacement de texte | Coût | Public cible |

|---|---|---|---|---|

| Runway Inpainting | Dessiner un masque → Remplissage IA | ⭐⭐⭐⭐ Naturel | Abonnement | Créateurs/Designers |

| After Effects + Sensei | Processus VFX professionnel | ⭐⭐⭐⭐⭐ Précis | Abonnement Adobe | Monteurs professionnels |

| Descript Regenerate | Description textuelle → Régénération IA | ⭐⭐⭐ Acceptable | Abonnement | Créateurs de contenu |

| Remplacement manuel image par image | Traitement image par image dans Photoshop | ⭐⭐⭐⭐⭐ Parfait | Coût en temps élevé | Perfectionnistes |

Processus opérationnel avec Runway Inpainting

C'est actuellement la solution la plus équilibrée — bonne qualité et seuil d'accès peu élevé :

- Télécharger la vidéo : Importez la vidéo générée par Sora 2 dans Runway

- Créer un masque : Utilisez l'outil pinceau pour encercler les zones de texte corrompu

- Définir une référence : Indiquez à l'IA ce que cette zone devrait être (fond pur/texte correct)

- Remplissage IA : Runway analyse et remplit les zones masquées image par image

- Vérifier les résultats : Examinez image par image le résultat du remplissage, en particulier les zones en mouvement rapide

Points d'attention lors de l'opération

- Le masque doit être complet : Incluez les ombres et reflets du texte, sinon des traces resteront visibles

- Lecture à vitesse normale d'abord : Vérifiez la fluidité générale, puis examinez les détails image par image

- Zones en mouvement rapide : Plus le texte se déplace lentement, meilleur sera le résultat de l'Inpainting

- Correspondance de résolution : Assurez-vous que la résolution de sortie de l'outil d'Inpainting correspond à celle de la vidéo originale

Méthode 3 : Techniques d'optimisation des invites Sora 2 pour réduire les erreurs textuelles

Si vous devez absolument inclure du texte lors de la génération avec Sora 2, les techniques d'optimisation d'invites suivantes peuvent améliorer la fidélité du texte (bien qu'elles ne puissent pas éliminer complètement le problème).

Stratégies d'optimisation des invites pour le texte dans Sora 2

| Stratégie | Description | Amélioration |

|---|---|---|

| Texte minimaliste | Utiliser seulement 1-2 caractères, pas de phrases longues | ⭐⭐⭐⭐ Significative |

| Description haute contraste | "white text on black background" | ⭐⭐⭐ Modérée |

| Invite en anglais | Rédiger l'invite en anglais, même si le texte cible est en chinois | ⭐⭐⭐ Modérée |

| Durée réduite | Une vidéo de 5 secondes est plus stable qu'une de 12 secondes avec texte | ⭐⭐⭐ Modérée |

| Moins d'éléments de scène | Ne pas décrire plusieurs objets contenant du texte simultanément | ⭐⭐⭐ Modérée |

| Caméra fixe | Pas de mouvement ou rotation dans la zone de texte | ⭐⭐⭐⭐ Significative |

Comparaison d'exemples d'invites

Mauvaise invite :

Un flacon de cosmétique avec écrit "肌肤焕新精华液", le flacon tourne, arrière-plan avec beaucoup de panneaux publicitaires en chinois

Bonne invite :

A skincare serum bottle with minimalist label, slowly rotating on white surface, studio lighting, static camera, 5 seconds, focus on product texture

Différence clé : la bonne invite ne force pas le contenu textuel, permettant au modèle de se concentrer sur la qualité de l'image.

💡 Conseil pour économiser : L'optimisation des invites nécessite des essais répétés. En utilisant la plateforme APIYI (apiyi.com) pour appeler l'API Sora 2 avec facturation à la seconde, générer une vidéo 720p de 4 secondes coûte seulement 0,40 $, ce qui permet de tester à faible coût différentes combinaisons d'invites.

Méthode 4 : Flux de composition en couches — vidéo + couche de texte

C'est la solution couramment utilisée par les équipes vidéo professionnelles : laisser Sora 2 générer uniquement des matériaux vidéo sans texte, et ajouter le texte par composition en post-production.

Flux de composition en couches détaillé

Étape 1 : Générer une vidéo pure sans aucun texte avec Sora 2

- Exclure explicitement les éléments textuels dans l'invite

- Prévoir de l'espace pour le texte (par exemple, laisser la zone d'étiquette du produit vierge)

Étape 2 : Utiliser le suivi de mouvement pour déterminer la position du texte

- After Effects : utiliser 3D Camera Tracker

- DaVinci Resolve : utiliser Planar Tracker

- Suivre le mouvement de la surface du produit ou d'une zone spécifique

Étape 3 : Superposer la couche de texte en chinois

- Utiliser un rendu de police standard pour un texte chinois net

- Faire correspondre les données de suivi pour que le texte suive le mouvement de l'objet

- Ajuster le mode de fusion et l'opacité pour intégrer l'image

Analyse des avantages et inconvénients

| Dimension | Évaluation |

|---|---|

| Précision du texte | ⭐⭐⭐⭐⭐ Parfaite, rendu en police standard |

| Degré de fusion naturelle | ⭐⭐⭐⭐ Nécessite un ajustement des couleurs |

| Seuil opérationnel | ⭐⭐ Nécessite des compétences en édition vidéo |

| Coût en temps | ⭐⭐ Le suivi et la composition prennent du temps |

| Scénarios applicables | Production vidéo commerciale professionnelle |

Méthode 5 : Stratégie de combinaison multi-modèles — jouer sur les forces respectives

Les différents modèles vidéo IA présentent chacun des avantages et des inconvénients en matière de rendu de texte. On peut exploiter les avantages de qualité visuelle de Sora 2, en les combinant avec les capacités de traitement de texte d'autres outils.

Approche de combinaison multi-modèles

- Sora 2 génère la vidéo principale : en tirant parti de sa simulation physique exceptionnelle et de sa qualité visuelle

- Flux/DALL·E génèrent les cadres texte : en utilisant des modèles d'images spécialisés dans le rendu de texte pour générer les cadres clés

- Logiciel de montage vidéo pour la composition : intégrer les cadres texte à la vidéo Sora 2

Recommandations de modèles pratiques

Les différents modèles présentent des capacités distinctes en matière de rendu de texte, et vous pouvez choisir la combinaison appropriée selon vos besoins.

🎯 Conseil technique : Via la plateforme APIYI apiyi.com, vous pouvez appeler uniformément les API de plusieurs modèles comme Sora 2, DALL·E et Flux, accomplir des workflows multi-modèles sur une seule plateforme, basculer entre les modèles selon les besoins, sans avoir à gérer plusieurs clés API séparément.

Guide de sélection des solutions de correction vidéo texte chinois pour Sora 2

Choisissez la solution la plus adaptée à votre situation spécifique :

Situation A : Vous n'avez pas encore commencé à générer de vidéo

→ Privilégiez la méthode 1 (image de référence i2v) ou la méthode 3 (optimisation d'invite)

Situation B : Vous avez une vidéo avec du texte partiellement corrompu

→ Privilégiez la méthode 2 (correction en post-production par inpainting)

Situation C : Vous avez besoin de texte chinois parfait + vidéo de haute qualité

→ Choisissez la méthode 4 (composition en couches) ou la méthode 5 (combinaison multi-modèles)

Situation D : Vidéo de présentation de produit (le produit lui-même porte du texte)

→ La meilleure solution est la méthode 1 : utiliser une photo du produit avec le texte correct comme image de référence i2v

💰 Considérations de coût : Les méthodes 1 et 3 sont les moins coûteuses, vous pouvez les réaliser via APIYI apiyi.com avec une facturation à la seconde. La méthode 2 nécessite un abonnement à des outils de post-production supplémentaires. Les méthodes 4 et 5 sont les plus coûteuses mais offrent les meilleurs résultats, idéales pour les projets commerciaux.

Sora 2 – Questions fréquentes sur la génération vidéo avec texte en chinois

Q1 : Si j’ajoute le texte sur l’image produit avant de générer la vidéo, le texte ne sera-t-il pas déformé ?

Ce n'est pas 100% sans déformation, mais la probabilité de distorsion diminue considérablement. En utilisant le mode image vers image (i2v) et en téléchargeant une image de référence contenant du texte clair, Sora 2 s'efforce de préserver les éléments visuels de la première image. L'essentiel est de ne pas mentionner le contenu du texte dans l'invite — décrivez uniquement les mouvements et les effets d'éclairage, en évitant que le modèle ne « redessine » le texte. Dans les tests pratiques, le texte de petite surface sur les produits (noms de marque, listes d'ingrédients, etc.) a une fidélité assez élevée, tandis que les grands textes et slogans présentent toujours un risque de déformation. En utilisant la plateforme APIYI (apiyi.com) pour appeler l'API i2v à la facturation à la seconde, vous pouvez tester à faible coût plusieurs fois pour trouver les paramètres optimaux.

Q2 : Après correction du texte par inpainting vidéo, le résultat ne sera-t-il pas trop artificiel ?

Cela dépend des détails de l'opération. Si la zone de masque n'est pas trop grande, l'arrière-plan du texte est relativement simple et le mouvement de l'objet n'est pas trop intense, la correction par inpainting Runway est très naturelle. L'astuce clé est que le masque doit couvrir les ombres et les reflets du texte, et il faut vérifier image par image après la correction. Pour les scènes avec arrière-plan complexe ou mouvement intense, le traitement professionnel d'After Effects donne de meilleurs résultats.

Q3 : Sora 2 améliorera-t-il le rendu du texte chinois à l’avenir ?

C'est possible mais peu probable à court terme. Le problème du rendu de texte est une difficulté commune à tous les modèles de diffusion, ce n'est pas simplement une question de données d'entraînement. Cela implique des limitations au niveau de l'architecture du modèle — les modèles génératifs font essentiellement de l'inférence probabiliste au niveau des pixels, plutôt que du rendu précis comme un moteur de polices. Tant que l'architecture du modèle n'aura pas connu une percée fondamentale, les 5 méthodes mentionnées ci-dessus restent les voies de solution pratiques et viables.

Q4 : Le texte en anglais est-il aussi sujet à des erreurs dans Sora 2 ?

Oui, mais la fréquence et la gravité sont bien inférieures au chinois. L'anglais n'a que 26 lettres avec une structure simple, et la proportion de texte anglais dans les données d'entraînement de Sora 2 est également plus élevée. Le rendu des courts mots anglais (noms de marque, slogans, etc.) est généralement acceptable, mais les phrases longues ou le texte en petits caractères anglais peuvent toujours présenter des erreurs. Si votre scénario le permet, remplacer le chinois par l'anglais est la solution d'évitement la plus simple.

Q5 : Y a-t-il une différence dans le rendu du texte entre l’appel API de Sora 2 et la génération via l’interface web ?

Le modèle sous-jacent est le même, donc théoriquement il n'y a pas de différence dans le rendu du texte. Mais l'avantage de l'appel API est que vous pouvez contrôler précisément les paramètres (résolution, durée, fréquence d'images), tester par lots différentes invites, et les rejets de modération Sentinel ne sont pas facturés. En utilisant la plateforme APIYI (apiyi.com) pour appeler l'API à la facturation à la seconde, vous pouvez trouver plus efficacement les paramètres de génération optimaux.

Résumé de la correction du texte chinois dans Sora 2

Le problème du rendu du texte chinois dans Sora 2 est essentiellement une limitation technique des modèles vidéo IA, et ne sera pas complètement résolu au niveau du modèle à court terme. Cependant, en concevant correctement votre flux de travail, vous pouvez tout à fait produire des vidéos de haute qualité avec du texte chinois précis.

Logique centrale des 5 méthodes :

- Méthode 1 (image de référence i2v) et Méthode 3 (optimisation de l'invite) : résoudre le problème lors de la génération, coût minimal

- Méthode 2 (Inpainting) : corriger le problème en post-production, flexible et pratique

- Méthode 4 (composition en couches) et Méthode 5 (combinaison multi-modèles) : approches les plus professionnelles, meilleur résultat mais coût plus élevé

Pour la plupart des scénarios, nous recommandons la Méthode 1 (image de référence i2v) — intégrez le texte au préalable dans une image produit ou scène haute résolution, générez la vidéo via l'API i2v de Sora 2, en combinaison avec une invite en anglais pur décrivant les effets dynamiques. C'est actuellement la solution la plus équilibrée en termes d'efficacité et de coût.

Via la plateforme APIYI (apiyi.com), vous pouvez appeler de manière unifiée les API t2v et i2v de Sora 2, avec facturation à la seconde et support pour tester plusieurs combinaisons de paramètres — c'est un choix pratique pour explorer le flux de travail optimal.

Références

-

Solution pour les caractères chinois corrompus dans Sora 2 : 5 méthodes pratiques

- Lien :

help.apiyi.com/en/sora-2-chinese-text-garbled-solution-en.html - Description : Solution complète incluant l'optimisation des invites et le post-traitement

- Lien :

-

Guide d'utilisation de Runway Inpainting : Retouche vidéo localisée

- Lien :

help.runwayml.com/hc/en-us/articles/19155664495379-Inpainting - Description : Étapes opérationnelles et astuces pour l'inpainting vidéo

- Lien :

-

Guide complet de l'Inpainting vidéo IA : Tutoriel opérationnel étape par étape

- Lien :

imagine.art/blogs/inpainting-video-with-ai - Description : Dernières technologies et outils de retouche vidéo en 2026

- Lien :

-

Documentation API Sora 2 Image vers Vidéo : Paramètres de l'interface i2v

- Lien :

docs.aimlapi.com/api-references/video-models/openai/sora-2-i2v - Description : Méthode d'invocation de l'API Sora 2 Image-to-Video

- Lien :

📝 Cet article a été rédigé par l'équipe APIYI. Pour plus de conseils sur la génération vidéo Sora 2 et des guides d'invocation d'API, visitez APIYI sur apiyi.com pour accéder aux derniers contenus et au support technique.