모델의 지식에는 마감 기한이 있지만, 실제 비즈니스 문제는 항상 '현재'의 데이터를 필요로 합니다. Claude는 2025년에 공식 web_search 도구를 출시했고, 2026년에는 동적 필터링을 지원하는 web_search_20260209 버전으로 업그레이드했습니다. 덕분에 Claude API의 웹 검색 기능은 '직접 구축해야 하는 번거로운 작업'에서 '한 줄의 파라미터'로 간단하게 구현할 수 있게 되었습니다.

이 글에서는 2026년 기준 Claude API 웹 검색의 최신 구현 방안을 체계적으로 정리합니다. 공식 web_search / web_fetch 도구의 파라미터, 과금, 제한 사항 및 코드 템플릿을 중점적으로 다루며, 서드파티 MCP 및 자체 구축 RAG와의 차이점을 비교합니다. 글 하단에는 APIYI(apiyi.com)의 투명한 중계 서비스를 활용한 통합 예제를 제공하며, base_url과 api_key만 교체하면 국내 환경에서도 전체 프로세스를 바로 실행할 수 있습니다.

Claude API 웹 검색 핵심 요약

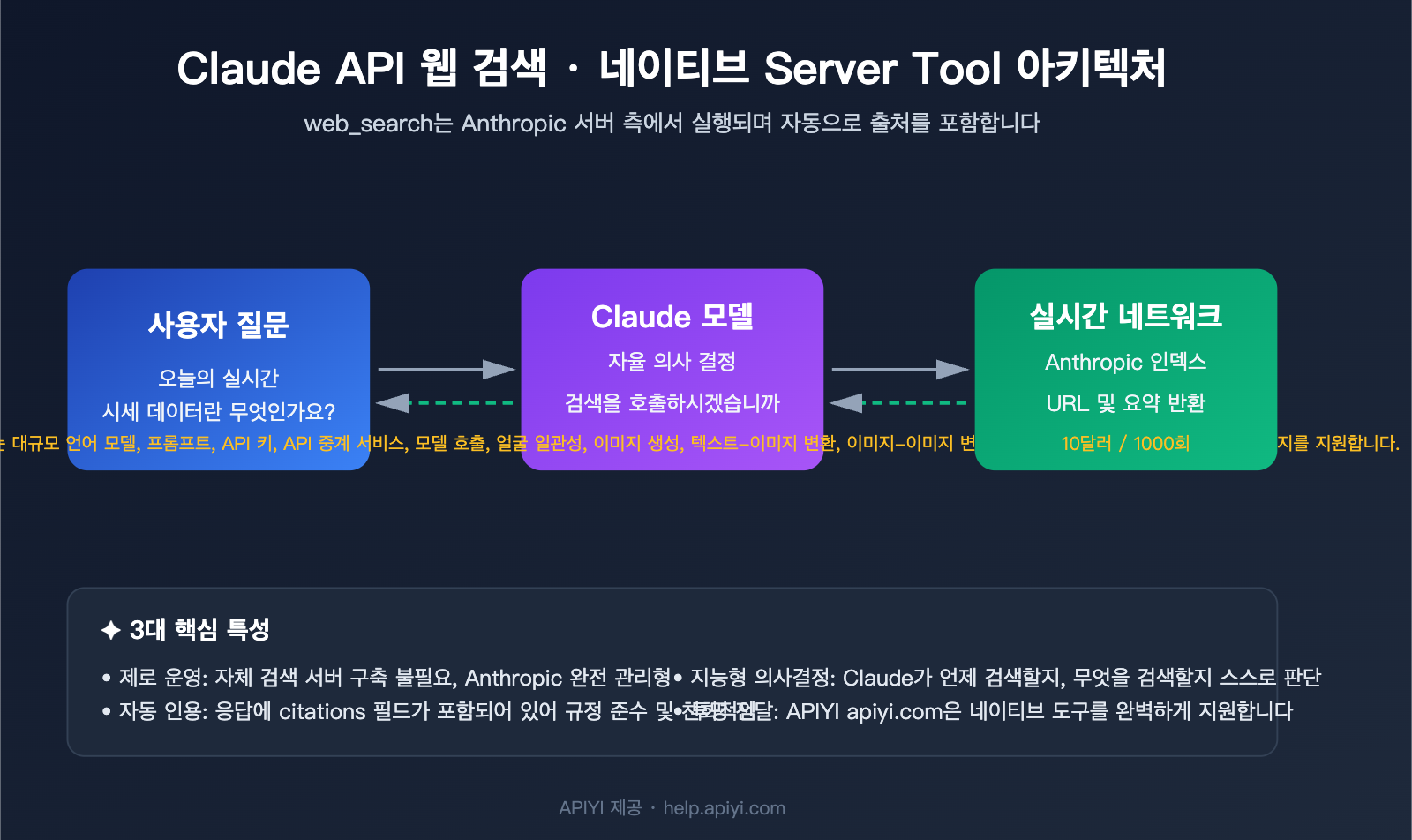

코드를 작성하기 전에 개념부터 확실히 잡아볼까요? Claude API 웹 검색은 본질적으로 Anthropic이 공식 제공하는 **서버 도구(Server Tool)**입니다. 즉, 검색은 Anthropic 클라우드에서 실행되므로, 사용자가 직접 Google/Bing API를 연결하거나 크롤러를 배포할 필요가 없습니다.

3가지 주요 구현 방식 비교

| 방식 | 통합 복잡도 | 비용 | 실시간성 | 출처 및 규정 준수 |

|---|---|---|---|---|

공식 web_search |

★☆☆ (tool 필드 하나) | $10 / 1000회 + 토큰 | 높음 (Anthropic 실시간 인덱스) | 자동 출처 표기 |

| 서드파티 MCP (예: Brave/Tavily) | ★★☆ (MCP 서버 필요) | 서드파티 검색 API 과금 | 중~높음 | 직접 처리 필요 |

| 자체 구축 (Google CSE + 도구 호출) | ★★★ (커스텀 tool + 파싱) | Google API 할당량 | 중 | 직접 관리 |

🎯 방식 선택 가이드: "Claude가 최근 사건에 답변하고 실시간 데이터를 보완하도록 하는 것"이 핵심 목표라면, 공식

web_search가 현재 가장 좋은 선택입니다. 운영 부담이 없고, 출처 표기가 정확하며, Sonnet 4.6 / Opus 4.7 등 주요 모델을 모두 지원합니다. APIYI(apiyi.com)의 투명한 중계 서비스를 통해 접속하면 VPN 없이도 Anthropic 공식 인터페이스의 모든 기능을 활용할 수 있습니다.

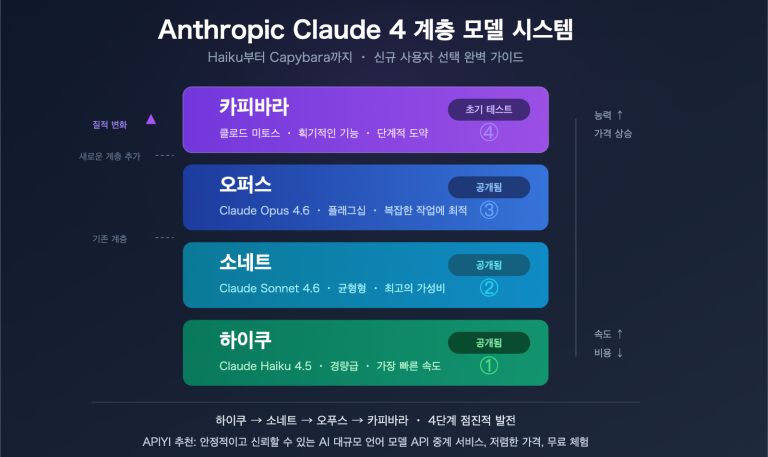

Claude API 웹 검색 지원 모델 매트릭스

모든 Claude 모델이 web_search를 지원하는 것은 아닙니다. 최신 버전인 web_search_20260209는 모델별로 명확한 요구 사항이 있습니다.

| 모델 | 기본 버전 web_search_20250305 |

동적 필터링 버전 web_search_20260209 |

|---|---|---|

| Claude Opus 4.7 | ✅ | ✅ |

| Claude Opus 4.6 | ✅ | ✅ |

| Claude Sonnet 4.6 | ✅ | ✅ |

| Claude Sonnet 4.5 | ✅ | ❌ |

| Claude Haiku 4.5 | ✅ | ❌ |

**동적 필터링(Dynamic Filtering)**은 2026년 버전의 핵심 업그레이드입니다. Claude가 검색 결과를 컨텍스트에 포함하기 전에 코드 실행 도구를 사용하여 먼저 필터링을 수행하며, 관련성이 높은 조각만 남깁니다. 긴 문서 검색이나 기술 문헌 요약 시 토큰 소모량을 획기적으로 줄여줍니다.

Claude API 인터넷 검색 공식 네이티브 도구 상세 가이드

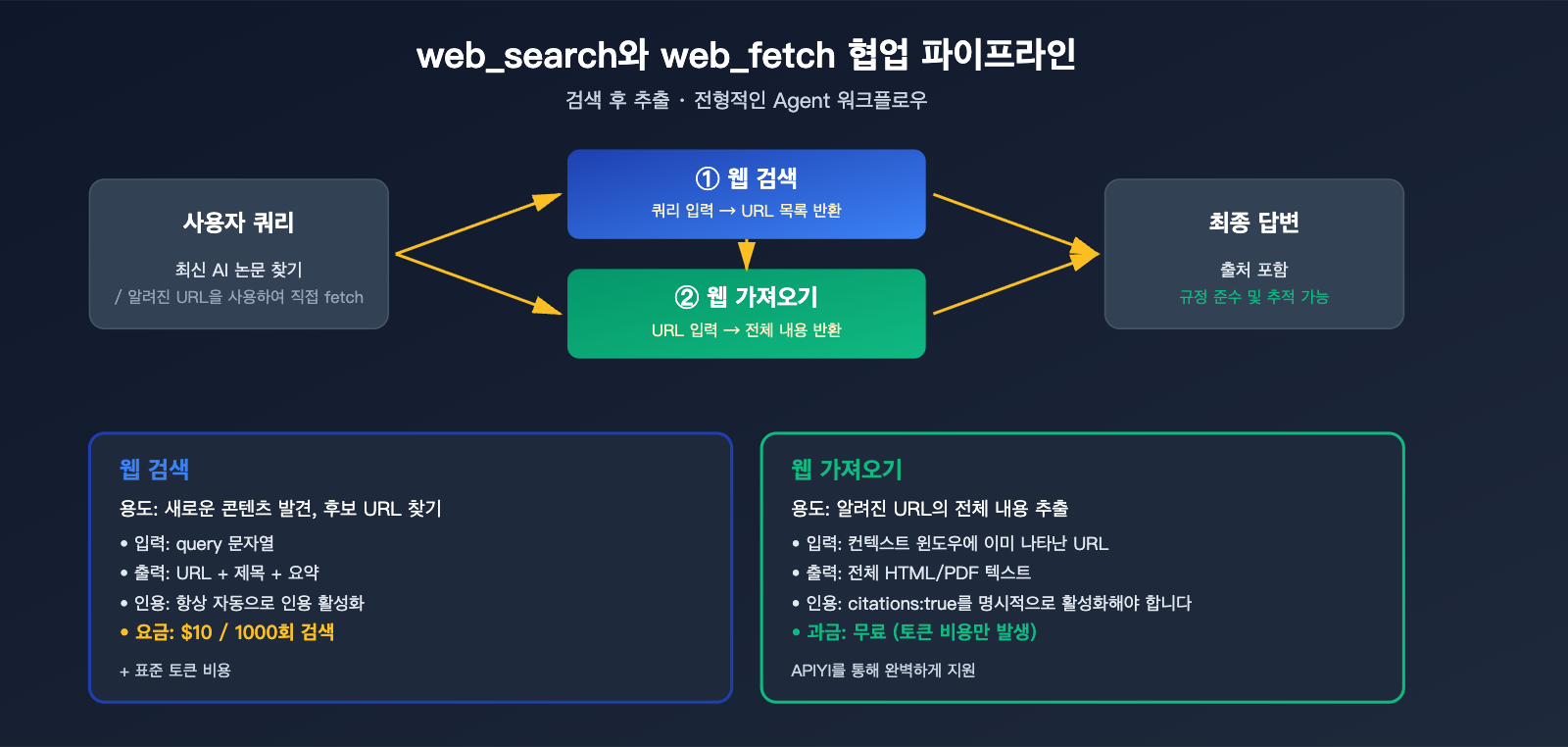

Anthropic은 상호 보완적인 두 가지 네이티브 도구를 제공합니다. 이 도구들의 경계를 이해하는 것이 Claude API 인터넷 검색을 제대로 활용하기 위한 첫걸음입니다.

web_search와 web_fetch의 역할 분담

| 도구 | 용도 | 입력 | 출력 | 과금 |

|---|---|---|---|---|

web_search |

새로운 정보 발견 | 쿼리 문자열 | URL + 제목 + 요약 | $10 / 1000회 |

web_fetch |

특정 URL의 전문 추출 | URL 문자열 | 전체 HTML/PDF 텍스트 | 무료 (토큰 비용만 발생) |

🎯 아키텍처 팁: 일반적인 에이전트 워크플로우는 「먼저 search, 그 다음 fetch」입니다.

web_search로 후보 페이지를 찾고,web_fetch로 가장 관련성 높은 페이지의 전문을 가져오는 방식이죠. 사용자가 이미 URL을 제공했다면(예: "example.com/article 이 글 분석해줘"), 검색 할당량을 소모할 필요 없이 바로web_fetch를 사용하면 됩니다. APIYI(apiyi.com)에서는 이 두 도구를 모두 투명하게 지원하므로 별도의 설정이 필요 없습니다.

web_search 도구의 전체 매개변수 정의

아래 표는 공식 JSON 매개변수 설명입니다. 실제 사용 시 필요에 따라 조합하세요.

| 매개변수 | 타입 | 필수 | 기본값 | 설명 |

|---|---|---|---|---|

type |

string | ✅ | – | web_search_20250305 또는 web_search_20260209로 고정 |

name |

string | ✅ | – | web_search로 고정 |

max_uses |

integer | ❌ | 제한 없음 | 단일 요청에서 허용되는 최대 검색 횟수 |

allowed_domains |

string[] | ❌ | – | 해당 도메인의 결과만 허용 (blocked와 상호 배타적) |

blocked_domains |

string[] | ❌ | – | 해당 도메인의 결과 차단 |

user_location |

object | ❌ | – | 로컬 검색을 위한 사용자 대략적 위치 |

user_location 필드 구조:

{

"type": "approximate",

"city": "Shanghai",

"region": "Shanghai",

"country": "CN",

"timezone": "Asia/Shanghai"

}

Claude API 인터넷 검색 오류 처리

검색 실패 시에도 Anthropic API는 HTTP 200을 반환하며, 오류 정보는 응답 본문의 web_search_tool_result에 포함됩니다. 클라이언트 코드에서 다음 오류 코드를 식별하도록 구현하세요.

| 오류 코드 | 의미 | 처리 권장사항 |

|---|---|---|

too_many_requests |

속도 제한 초과 | 지수 백오프(재시도), 동시성 낮춤 |

max_uses_exceeded |

max_uses 제한 초과 |

상한선 조정 또는 요청 분할 |

query_too_long |

쿼리 문자열이 너무 김 | 쿼리 단축 또는 재작성 |

invalid_input |

매개변수 형식 오류 | JSON 구조 확인 |

unavailable |

Anthropic 내부 오류 | 잠시 후 재시도 |

⚠️ 과금 팁: 실패한

web_search요청은 과금되지 않습니다. 단, 이미 성공한 검색 후 실패가 발생했다면, 앞선 성공 호출은 $10 / 1000회 기준으로 차감됩니다. APIYI(apiyi.com) 콘솔에서 상세 요청 내역을 확인하여 비정상적인 비용 발생을 파악하는 것을 권장합니다.

Claude API 인터넷 검색 빠른 시작

최소한의 코드로 전체 흐름을 구현해 봅시다. 모든 예제는 APIYI(apiyi.com)의 투명한 중계 인터페이스를 사용합니다. 비즈니스 로직을 수정할 필요 없이 base_url을 중계 노드로 지정하고, ANTHROPIC_API_KEY를 APIYI 키로 교체하기만 하면 됩니다.

cURL 최소 예제

실행 가능한 Claude API 인터넷 검색 최소 요청:

curl https://vip.apiyi.com/v1/messages \

-H "x-api-key: $APIYI_API_KEY" \

-H "anthropic-version: 2023-06-01" \

-H "content-type: application/json" \

-d '{

"model": "claude-sonnet-4-6",

"max_tokens": 1024,

"messages": [

{"role": "user", "content": "2026년 4월 OpenAI가 발표한 최신 모델들을 중국어로 요약해줘"}

],

"tools": [{

"type": "web_search_20250305",

"name": "web_search",

"max_uses": 5

}]

}'

응답 구조에는 Claude의 결정 텍스트, server_tool_use(실제 실행된 쿼리), web_search_tool_result(URL 목록), 그리고 citations가 포함된 최종 답변 텍스트가 포함됩니다.

Python SDK 전체 예제 (web_fetch 연동 포함)

import anthropic

client = anthropic.Anthropic(

base_url="https://vip.apiyi.com",

api_key="sk-your-apiyi-key",

)

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=4096,

messages=[{

"role": "user",

"content": "최근 한 달간 AI 에이전트 평가 관련 논문을 찾아 가장 관련성 높은 논문 하나를 상세히 요약해줘"

}],

tools=[

{

"type": "web_search_20260209",

"name": "web_search"

},

{

"type": "web_fetch_20260209",

"name": "web_fetch",

"max_uses": 3,

"citations": {"enabled": True}

}

]

)

for block in response.content:

if block.type == "text":

print(block.text)

elif block.type == "server_tool_use":

print(f"[도구 호출] {block.name}: {block.input}")

🎯 코드 팁: 위 예제는

web_search_20260209+web_fetch_20260209의 동적 필터링 조합을 사용했습니다. Claude Opus 4.7과 함께 사용하면 긴 문서 처리 시 토큰 소모를 크게 줄일 수 있습니다. 간단한 실시간 질의응답이 목적이라면 모델을claude-sonnet-4-6으로 변경하고 기본 버전인web_search_20250305를 사용하세요. 비용이 더 저렴합니다. 모든 호출은 APIYI(apiyi.com)를 통해 전달되며 안정성은 공식 API와 동일합니다.

TypeScript / Node.js 예제

import Anthropic from "@anthropic-ai/sdk";

const client = new Anthropic({

baseURL: "https://vip.apiyi.com",

apiKey: process.env.APIYI_API_KEY,

});

const response = await client.messages.create({

model: "claude-sonnet-4-6",

max_tokens: 2048,

messages: [

{ role: "user", content: "오늘 상하이 날씨 어때?" }

],

tools: [{

type: "web_search_20250305",

name: "web_search",

max_uses: 3,

user_location: {

type: "approximate",

city: "Shanghai",

region: "Shanghai",

country: "CN",

timezone: "Asia/Shanghai"

}

}]

});

console.log(response.content);

스트리밍 응답 처리

stream: true를 활성화하면 검색 과정이 SSE 이벤트로 실시간 푸시됩니다. 검색 실행 중에는 잠시 "일시 정지" 상태가 발생하는데, 이는 Claude가 Anthropic 서버 측의 검색 완료를 기다리기 때문입니다.

with client.messages.stream(

model="claude-sonnet-4-6",

max_tokens=2048,

messages=[{"role": "user", "content": "최신 Claude 4.7 가격 정책 조회"}],

tools=[{"type": "web_search_20250305", "name": "web_search", "max_uses": 2}]

) as stream:

for event in stream:

if event.type == "content_block_start":

block = event.content_block

if block.type == "server_tool_use":

print(f"\n[검색 중] 쿼리 스트리밍 시작...")

elif block.type == "web_search_tool_result":

print(f"[검색 완료] 총 {len(block.content)}개의 결과")

elif event.type == "content_block_delta":

if hasattr(event.delta, "text"):

print(event.delta.text, end="", flush=True)

Claude API 인터넷 검색 솔루션 비교 및 선정

공식 인터페이스에 대해 알아보았으니, 이제 어떤 솔루션을 선택할지 결정해 봅시다. Claude API 인터넷 검색은 크게 세 가지 경로가 있으며, 각각 적합한 시나리오가 다릅니다.

솔루션 A: 공식 네이티브 web_search (가장 추천)

장점:

- 유지보수 제로: 별도의 서버 구축 없이 Anthropic이 완전히 관리함

- 자동 인용: 답변마다 자동으로

citations가 포함되어 신뢰성 확보 - 모델 통합: Claude가 직접 검색 시점과 검색어를 결정

- 투명한 과금: 1,000회당 $10로 Anthropic 청구서에 통합 관리

단점:

- Anthropic이 인덱싱한 소스만 지원(검색 엔진 교체 불가)

- 일부 모델 버전 제한(Haiku/구형 Sonnet은 기본 버전만 지원)

적합한 시나리오: 90%의 범용 대화형 에이전트, 질문 답변 어시스턴트, 연구 관련 작업.

솔루션 B: 서드파티 MCP 서비스 (Brave/Tavily/Serper 등)

Model Context Protocol을 통해 로컬 또는 원격 MCP 서버를 실행하여 Claude에 검색 기능을 주입합니다:

# Tavily MCP 예시, 먼저 npm install -g @tavily/mcp-server 필요

claude mcp add tavily-search npx -- @tavily/mcp-server

장점:

- 검색 백엔드 자유 선택 가능(개인정보 보호 중심의 Brave, LLM 친화적인 Tavily 등)

- 커스터마이징 가능: 결과에 대한 2차 정제 및 메타데이터 추가 가능

- Claude Code, Cursor 등 클라이언트에서 네이티브 지원

단점:

- 별도의 MCP 서버 프로세스 유지보수 필요

- 검색 결과가 Anthropic 규격의

citations를 자동으로 생성하지 않음 - 서드파티 검색 API의 할당량과 비용을 직접 관리해야 함

적합한 시나리오: 이미 Brave/Tavily 기업 계정을 보유하고 있거나, 검색 백엔드에 대한 강력한 커스터마이징 요구가 있는 경우.

솔루션 C: 직접 구축한 도구 호출 (Google CSE + Custom Tool)

가장 전통적인 방식입니다. 직접 tool을 정의하고 백엔드 코드에서 Google Custom Search / Bing API를 호출한 뒤, 결과를 다시 메시지에 삽입합니다:

tools = [{

"name": "google_search",

"description": "Google 검색을 수행하고 상위 N개의 결과를 반환합니다",

"input_schema": {

"type": "object",

"properties": {

"query": {"type": "string"}

},

"required": ["query"]

}

}]

장점: 완전 제어 가능, 기업 내부망 검색이나 사설 지식 베이스 연동 가능.

단점: 프롬프트 설계, 결과 정렬, 인용 생성, 오류 재시도 등 모든 작업을 직접 수행해야 함. 또한 Claude가 "자동으로" 호출하지 않으므로 시스템 프롬프트에서 명시적으로 가이드해야 함.

적합한 시나리오: 강력한 규정 준수, 고도의 커스터마이징, 사설 데이터 소스 연동이 필요한 엔터프라이즈급 시나리오.

세 가지 솔루션의 의사결정 트리

| 요구사항 | 추천 솔루션 |

|---|---|

| 가장 빠르게 구현하고 싶고, 기능은 무난하면 됨 | 솔루션 A 네이티브 web_search |

| 검색 백엔드를 교체해야 함 (개인정보/규정 준수) | 솔루션 B 서드파티 MCP |

| 사설 데이터 소스 연동이 필수임 | 솔루션 C 직접 구축 도구 + RAG |

| Anthropic 접속이 불안정함 | 솔루션 A + APIYI apiyi.com 투명 중계 |

🎯 국내 개발자 참고: Anthropic 공식 API는 국내에서 접속이 불안정할 수 있으며, 해외 전화번호 인증이 필요합니다. APIYI(apiyi.com)의 투명 중계 서비스를 통해 접속하는 것을 권장합니다. 이 서비스는 Anthropic의 모든 서버 도구(

web_search/web_fetch/code_execution포함)를 완벽하게 지원하므로, 코드를 수정할 필요 없이base_url을https://vip.apiyi.com으로 변경하고 API 키만 APIYI 키로 교체하면 바로 사용할 수 있습니다.

Claude API 인터넷 검색 고급 활용법

도메인 화이트리스트: "수직 검색" 구현하기

Claude가 특정 도메인 내에서만 검색하도록 제한하고 싶다면 allowed_domains를 사용하세요.

tools=[{

"type": "web_search_20250305",

"name": "web_search",

"max_uses": 5,

"allowed_domains": [

"docs.python.org",

"pypi.org",

"github.com"

]

}]

몇 가지 주의사항이 있습니다:

allowed_domains와blocked_domains는 동시에 사용할 수 없습니다.- 하위 도메인은 정확히 일치해야 합니다:

docs.example.com을 설정해도api.example.com은 포함되지 않습니다. - 요청 수준의 도메인 제한은 조직 수준의 구성과 호환되어야 하며, 관리자가 설정한 범위를 확장할 수 없습니다.

web_fetch 인용 활성화

web_search는 기본적으로 인용(citations)이 켜져 있지만, web_fetch는 명시적으로 활성화해야 합니다:

{

"type": "web_fetch_20250910",

"name": "web_fetch",

"max_uses": 5,

"citations": {"enabled": True},

"max_content_tokens": 50000

}

max_content_tokens는 너무 큰 문서를 잘라내어 한 번의 fetch로 컨텍스트가 넘치는 것을 방지합니다. 참고 수치는 다음과 같습니다:

| 콘텐츠 유형 | 크기 | 약 토큰 수 |

|---|---|---|

| 일반 웹페이지 | 10 KB | ~2,500 |

| 대형 문서 페이지 | 100 KB | ~25,000 |

| 연구 논문 PDF | 500 KB | ~125,000 |

다중 대화에서의 encrypted_content

web_search가 반환하는 각 결과에는 encrypted_content 필드가 포함되어 있습니다. 다중 대화에서 Claude가 이전 검색 결과를 계속 참조하게 하려면 이 필드를 그대로 전달해야 합니다. 그렇지 않으면 이후 대화에서 인용 컨텍스트가 유실됩니다.

messages.append({

"role": "assistant",

"content": previous_response.content # encrypted_content를 포함하여 전체 유지

})

messages.append({

"role": "user",

"content": "방금 검색한 두 번째 문서를 바탕으로 상세히 분석해줘"

})

🎯 엔지니어링 팁: LangChain, LlamaIndex와 같은 에이전트 프레임워크를 사용할 때는 프레임워크가 Claude 응답의 모든 콘텐츠 블록을 완전히 전달하는지 확인하세요. 많은 프레임워크가

server_tool_use와 같은 필드를 "정리"해버려 인용이 실패하는 경우가 많습니다. APIYI(apiyi.com)를 통해 anthropic SDK로 직접 구축하는 것을 권장하며, 공식 API와 완전히 동일한 동작을 보장합니다.

Claude API 인터넷 검색 실전 사례

이론은 여기까지 하고, 실제 비즈니스 환경에서 Claude API 인터넷 검색을 조합하는 베스트 프랙티스를 살펴보겠습니다.

사례 1: 실시간 뉴스 질의응답 어시스턴트

사용자가 "오늘 주식 시장 어때?"라고 묻는다면 실시간 데이터가 필요합니다. 구성 전략은 다음과 같습니다:

response = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=1024,

system="당신은 금융 어시스턴트입니다. 실시간 시세나 뉴스를 다룰 때는 반드시 web_search를 사용하세요. 답변에는 반드시 출처를 표기해야 합니다.",

messages=[{"role": "user", "content": "오늘 상하이 종합지수 종가는 얼마인가요? 등락은 어떤가요?"}],

tools=[{

"type": "web_search_20250305",

"name": "web_search",

"max_uses": 3,

"allowed_domains": ["sina.com.cn", "eastmoney.com", "163.com"],

"user_location": {

"type": "approximate",

"country": "CN",

"timezone": "Asia/Shanghai"

}

}]

)

핵심: allowed_domains로 신뢰할 수 있는 금융 사이트를 고정하고, user_location을 설정하여 Claude가 중국어 결과를 우선적으로 반환하도록 합니다.

사례 2: 기술 문서 RAG 강화

기술적인 질문에 답변할 때 공식 문서를 우선적으로 검색하도록 설정합니다:

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=4096,

messages=[{

"role": "user",

"content": "FastAPI에서 WebSocket 하트비트 유지를 어떻게 구현하나요? 전체 예제를 보여주세요."

}],

tools=[

{

"type": "web_search_20260209",

"name": "web_search",

"max_uses": 5,

"allowed_domains": [

"fastapi.tiangolo.com",

"docs.python.org",

"github.com",

"stackoverflow.com"

]

},

{

"type": "web_fetch_20260209",

"name": "web_fetch",

"max_uses": 3,

"citations": {"enabled": True}

}

]

)

핵심: web_search_20260209의 동적 필터링으로 불필요한 HTML을 제거하고, web_fetch로 가장 관련성 높은 공식 문서 전문을 가져옵니다.

사례 3: 학술 연구 어시스턴트

엄격한 인용과 긴 컨텍스트 분석이 필요한 경우, Opus 4.7과 이중 도구 조합을 추천합니다:

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=8192,

messages=[{

"role": "user",

"content": "2026년 LLM 에이전트 보안 평가 관련 논문을 찾아 상위 3개를 종합 비교해줘"

}],

tools=[

{

"type": "web_search_20260209",

"name": "web_search",

"max_uses": 8,

"allowed_domains": ["arxiv.org", "openreview.net", "acm.org"]

},

{

"type": "web_fetch_20260209",

"name": "web_fetch",

"max_uses": 5,

"citations": {"enabled": True},

"max_content_tokens": 80000

}

]

)

🎯 시나리오별 제언: 비즈니스마다 검색 품질, 인용 준수, 비용에 대한 가중치가 다릅니다. 모든 호출을 섞지 말고, APIYI(apiyi.com)에서 각 비즈니스 시나리오별로 API 키를 독립적으로 생성하여 시나리오별 비용 정산, 실제 검색 횟수 및 토큰 소비 모니터링을 수행하는 것을 권장합니다.

Claude API 인터넷 검색을 위한 엔지니어링 베스트 프랙티스

데모를 실행하는 것은 어렵지 않지만, Claude API 인터넷 검색 기능을 실제 프로덕션 환경에 적용하려면 몇 가지 넘어야 할 산이 있습니다.

실전 1: 프롬프트 캐싱(Prompt Caching)으로 비용 절감 및 효율화

Server Tool 정의는 짧지만, 시스템 프롬프트와 함께 사용하면 여전히 적지 않은 고정 비용이 발생합니다. 프롬프트 캐싱을 활성화하세요:

response = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=2048,

system=[{

"type": "text",

"text": "당신은 전문적인 연구 보조원입니다...(500자 시스템 프롬프트 생략)",

"cache_control": {"type": "ephemeral"}

}],

messages=[...],

tools=[

{

"type": "web_search_20250305",

"name": "web_search",

"max_uses": 5,

"cache_control": {"type": "ephemeral"}

}

]

)

실측 결과: 5분 이내의 반복 요청 시, 시스템 + 도구 부분의 토큰 비용을 90%까지 절감할 수 있습니다.

실전 2: 스트리밍 응답으로 타임아웃 방지

web_search는 한 번 실행에 5~15초가 소요될 수 있습니다. 만약 하위 시스템(게이트웨이, 클라이언트)에 30초 타임아웃 제한이 있다면, 반드시 stream=True를 활성화하여 스트리밍 하트비트로 연결을 유지하세요.

실전 3: encrypted_content의 다중 턴 일관성

다중 턴 대화에서 Claude는 이전 턴의 검색 결과를 참조할 수 있습니다. 매 요청마다 이전 모든 assistant 메시지의 전체 content 배열을 유지해야 합니다. text 부분만 남기지 마세요:

# ❌ 잘못된 방법

messages.append({"role": "assistant", "content": response.content[-1].text})

# ✅ 올바른 방법

messages.append({"role": "assistant", "content": response.content})

실전 4: 속도 제한 및 재시도 전략

web_search의 속도 제한은 일반 메시지 인터페이스와 독립적입니다. SDK 레벨에서 지수 백오프(Exponential Backoff)를 포함한 재시도 로직을 구현하는 것을 권장합니다:

| 오류 코드 | 재시도 전략 | 최대 재시도 횟수 |

|---|---|---|

too_many_requests |

지수 백오프 (2초/4초/8초) | 3 |

unavailable |

고정 지연 (5초) | 2 |

max_uses_exceeded |

재시도 안 함, max_uses 상향 | – |

query_too_long |

재시도 안 함, 쿼리 단축 | – |

🎯 프로덕션 환경 제언:

web_search의 모든 오류 응답을 로그 모니터링 시스템에 기록하고,too_many_requests의 비중을 정기적으로 분석하세요. 이는 현재 동시성 처리를 위해 증설이 필요한지 판단하는 핵심 지표입니다. APIYI(apiyi.com) 플랫폼에서 호출할 경우, 콘솔에서 직접 요청 성공률, 평균 응답 시간 등 주요 지표를 확인하여 운영 효율을 높일 수 있습니다.

Claude API 인터넷 검색 FAQ

Q1: APIYI의 API 중계 서비스는 네이티브 web_search를 지원하나요? 코드를 수정해야 하나요?

지원하며, 코드 수정도 필요 없습니다. APIYI(apiyi.com)는 투명 전달(Transparent Forwarding) 아키텍처를 사용하여 Anthropic 공식 Server Tool을 완벽하게 통과시킵니다. base_url을 https://vip.apiyi.com으로 변경하고 api_key를 APIYI 키로 바꾸기만 하면, 기존에 공식 API를 호출하던 코드를 한 줄도 수정하지 않고 그대로 사용할 수 있습니다. web_search / web_fetch / code_execution 등 모든 네이티브 도구가 포함됩니다.

Q2: web_search의 과금 방식은 어떻게 되나요? 1,000회당 $10는 비싼가요?

검색 1회당 $0.01이며, 결과 개수와 상관없이 1회로 계산됩니다. 실패한 검색은 과금되지 않습니다. 타 서비스와 비교하면 Tavily $0.005/회, Brave $0.006/회, Google CSE $0.005/쿼리(무료 할당량 초과 시)입니다. 네이티브 web_search가 다소 비싸지만, MCP 서버 운영 및 인용 처리와 관련된 엔지니어링 비용을 절감할 수 있어 중소 규모 팀에게는 오히려 경제적일 수 있습니다.

Q3: 왜 max_uses_exceeded 오류가 발생하나요?

Claude는 한 번의 대화에서 여러 번 web_search를 호출할 수 있습니다(스스로 판단하여 결정). 만약 "max_uses": 1로 설정했는데 답변을 위해 3번의 검색이 필요하다면 이 오류가 발생합니다. 복잡한 질문에는 510회 정도의 예산을 할당하고, 간단한 질의응답에는 12회만 할당하는 것을 권장합니다.

Q4: web_search로 한국어 웹사이트도 검색할 수 있나요?

네, 가능합니다. web_search는 Anthropic의 실시간 인덱스를 기반으로 하며, 한국어 콘텐츠(블로그, 커뮤니티 등)에 대한 커버리지도 우수합니다. 특정 도메인만 검색하도록 제한하고 싶다면 allowed_domains 화이트리스트 기능을 함께 사용하세요.

Q5: web_search로 긴 글을 연구할 때 토큰 소모가 큰데, 어떻게 최적화하나요?

세 가지 최적화 방향:

web_search_20260209동적 필터링 버전(Claude Opus/Sonnet 4.6+ 필요)을 사용하여 관련 없는 내용을 자동 제거합니다.web_fetch의max_content_tokens매개변수를 사용하여 페이지당 가져올 토큰 상한선을 제한합니다.- 프롬프트 캐싱을 활성화하여 도구 정의와 시스템 프롬프트를 캐시하고 반복 요청 비용을 줄입니다.

Q6: 서드파티 MCP 검색 솔루션과 네이티브 web_search를 혼용할 수 있나요?

가능합니다. Claude는 여러 도구를 동시에 정의할 수 있지만, 도구 설명을 명확하게 구분해야 합니다. 예를 들어 MCP의 tavily_search는 "학술 논문 검색", 네이티브 web_search는 "일반 웹 검색"으로 설명하면 Claude가 이를 기반으로 스스로 선택합니다. 하지만 혼선을 줄이기 위해 단일 시나리오에서는 하나의 검색 도구만 사용하는 것을 권장합니다.

Q7: 국내에서 Claude API 인터넷 검색 호출이 실패하는데 어떻게 하나요?

주요 원인은 두 가지입니다: Anthropic API와의 네트워크 불안정, 그리고 web_search 실행 시 Anthropic 백엔드에서 중국 본토 IP를 차단할 가능성입니다. 가장 확실한 해결책은 APIYI(apiyi.com) 중계 서비스를 이용하는 것입니다. 모든 web_search 요청이 APIYI 해외 노드를 거쳐 Anthropic으로 전달되고 응답이 돌아오므로, 해외에서 직접 호출하는 것과 동일한 안정성을 확보할 수 있습니다.

Claude API 인터넷 검색 솔루션 요약 및 선택 가이드

전체 내용을 되돌아보면, 2026년 현재 Claude API 인터넷 검색은 '즉시 사용 가능한(Out-of-the-box)' 수준으로 성숙했습니다. 한 문장으로 요약하자면 다음과 같습니다.

✅ 프로젝트의 80%는 공식 네이티브

web_search만으로 충분합니다. 설정이 간편하고, 인용이 규정을 준수하며, Anthropic이 직접 관리하기 때문이죠. 강력한 커스텀 기능이 필요한 나머지 20%의 경우에만 서드파티 MCP나 자체 구축 도구를 고려하세요.

실무 적용 체크리스트

오늘 바로 Claude API 인터넷 검색을 프로젝트에 도입할 계획이라면 다음 단계를 따라보세요.

- 모델 선택: 일반적인 상황에서는

claude-sonnet-4-6(가성비 우수)을, 복잡한 연구가 필요할 때는claude-opus-4-7을 사용하세요. - 도구 버전 선택: 동적 필터링이 가능한

web_search_20260209를 우선적으로 사용하고, 구형 모델은web_search_20250305로 대체하세요. - max_uses 설계: 간단한 질의응답은 1

3회, 복잡한 연구는 510회로 설정하세요. - web_fetch 활용: 전체 텍스트 분석이 필요할 때는

web_fetch를 함께 사용하여 후보 페이지를 추출하세요. - 접속 설정: 국내에서는 APIYI(apiyi.com)의 투명한 중계 서비스를 통해 VPN 없이, 코드 수정 없이 바로 이용할 수 있습니다.

🎯 마지막 제언: Claude API 인터넷 검색의 핵심은 "사용할 수 있는가"가 아니라 "검색 결과 품질, 토큰 비용, 응답 지연 시간 사이의 균형을 어떻게 맞출 것인가"입니다. 우선 APIYI(apiyi.com) 플랫폼에서 실제 비즈니스 사례를 몇 가지 테스트해 보시고, 대화 한 번당 발생하는 실제 검색 횟수와 토큰 소모량을 확인한 뒤 프롬프트 캐싱(prompt caching)이나 동적 필터링 같은 고급 최적화 도입을 결정하는 것을 추천합니다. 해당 플랫폼은 Claude 전 모델과 네이티브 서버 도구를 지원하여 빠르게 반복 테스트를 수행하기 좋습니다.

작성자: APIYI 기술팀 | 더 많은 Claude API 실전 튜토리얼은 help.apiyi.com에서 확인하세요.