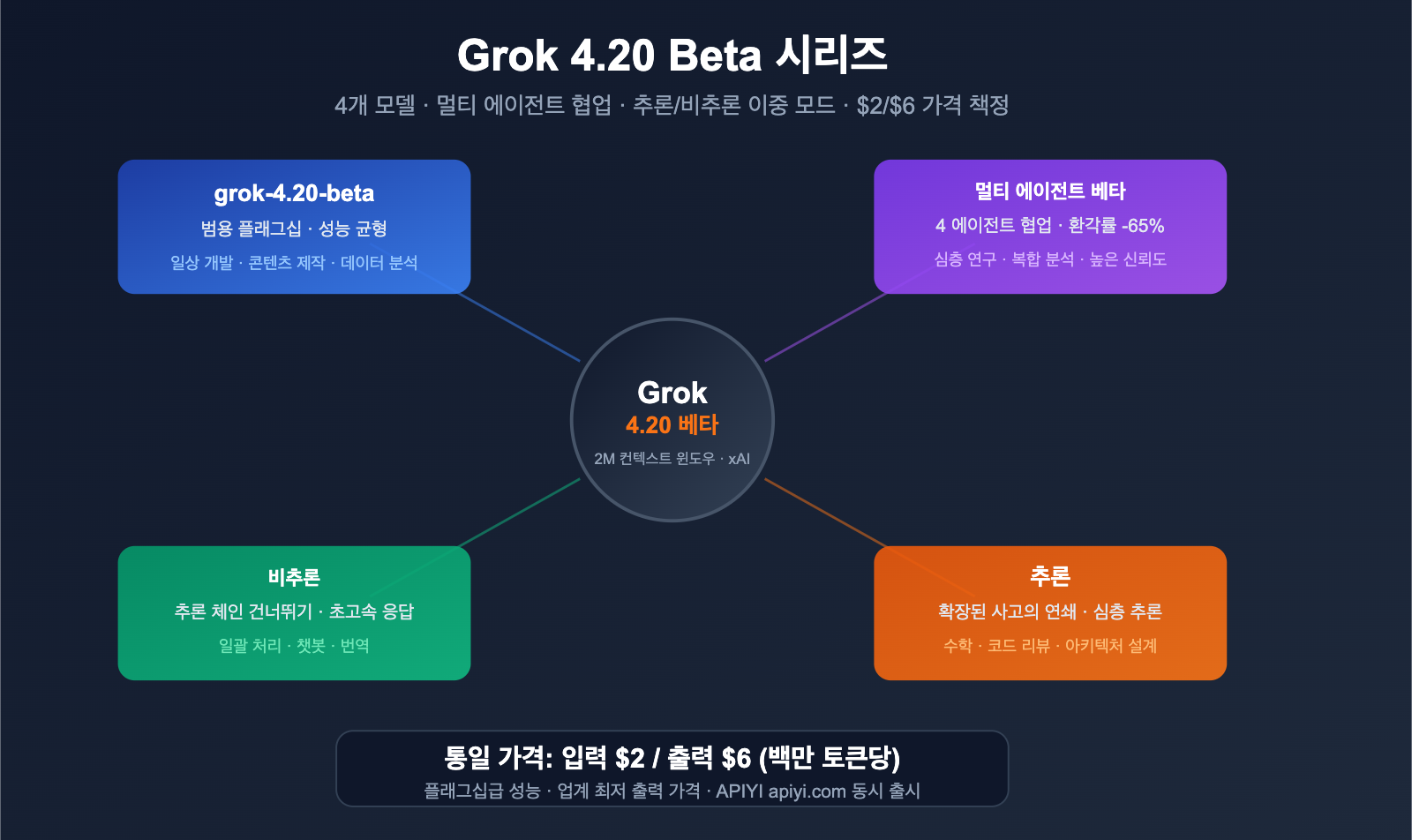

xAI의 Grok 4.20 Beta 시리즈가 APIYI 플랫폼에 공식 출시되었습니다. 이번 업데이트로 4종의 모델이 새롭게 추가되었으며, 빠른 질의응답부터 멀티 에이전트 기반의 심층 연구까지 모든 시나리오를 커버합니다. 가격은 입력 100만 토큰당 $2, 출력 100만 토큰당 $6로, 현재 주요 플래그십 모델 중 가장 가성비가 뛰어난 선택지 중 하나입니다.

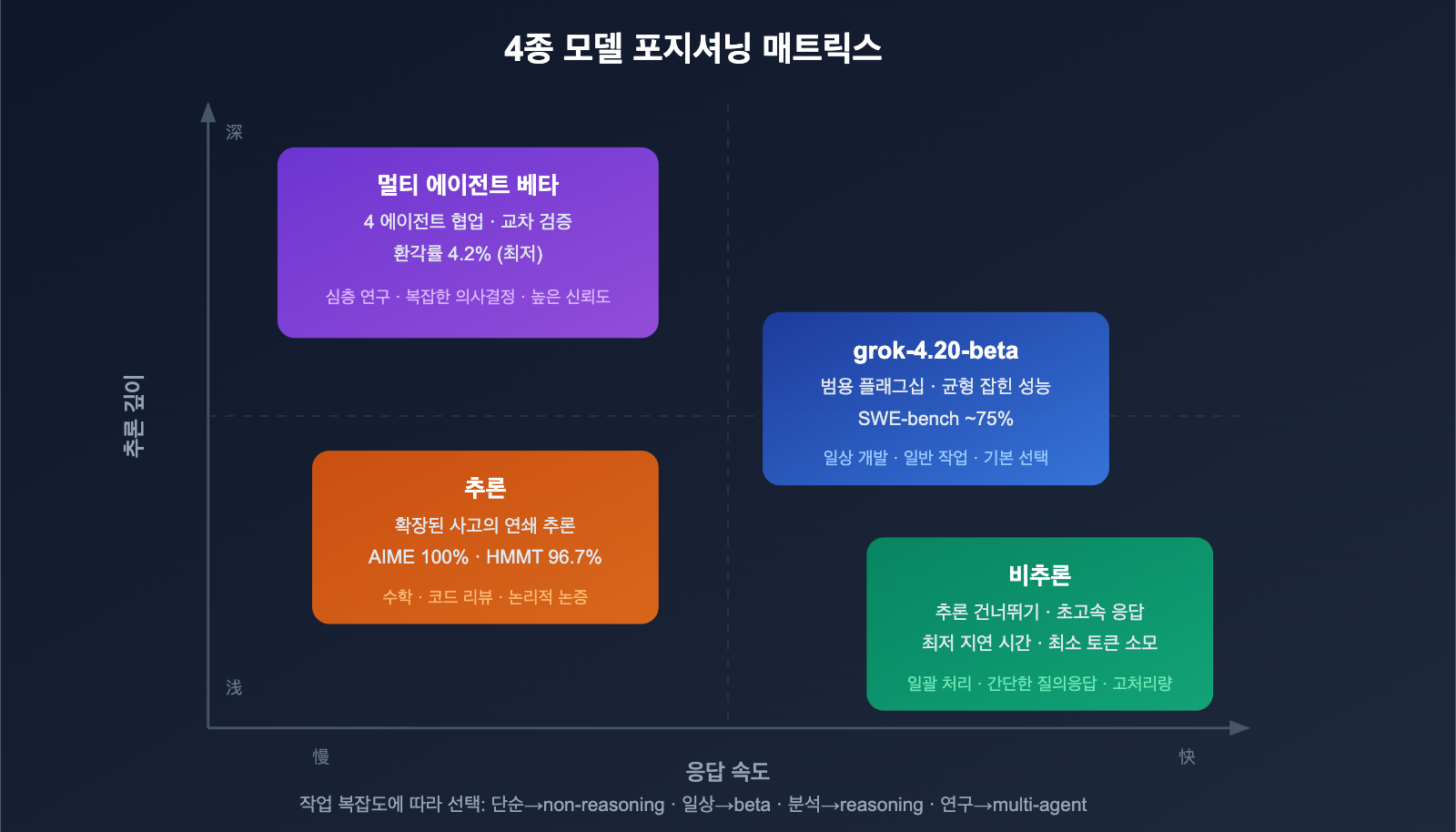

이 4종의 모델은 단순한 버전 업그레이드가 아니라 아키텍처 차원에서 구분됩니다. 초고속 응답을 지향하는 모델, 심층 추론에 특화된 모델, 그리고 4개의 AI 에이전트가 동시에 협업하여 환각 현상을 65%까지 낮춘 모델 등이 포함되어 있습니다.

핵심 가치: 이 글을 통해 4종의 Grok 4.20 Beta 모델별 포지셔닝과 최적의 사용 사례를 이해하고, API 호출 방법을 익혀 최적의 모델 선택 결정을 내릴 수 있습니다.

4종 모델 한눈에 보기: 핵심 차이점 요약

모델 매트릭스

| 모델 ID | 포지셔닝 | 핵심 특징 | 최적 활용 사례 |

|---|---|---|---|

grok-4.20-beta |

범용 플래그십 | 성능과 속도의 균형 | 일상적인 개발, 범용 작업 |

grok-4.20-multi-agent-beta-0309 |

멀티 에이전트 협업 | 4개 에이전트 병렬 협업 | 심층 연구, 복잡한 분석 |

grok-4.20-beta-0309-non-reasoning |

빠른 응답 | 추론 체인 생략, 저지연 | 대량 처리, 간단한 질의응답 |

grok-4.20-beta-0309-reasoning |

심층 추론 | 확장된 사고 체인 추론 | 수학, 코드 분석, 논리적 논증 |

통합 가격 정책

| 항목 | 가격 |

|---|---|

| 입력 토큰 | $2.00 / 100만 토큰 |

| 출력 토큰 | $6.00 / 100만 토큰 |

| 컨텍스트 윈도우 | 200만 토큰 (2M) |

| 배치 처리 할인 | 50% |

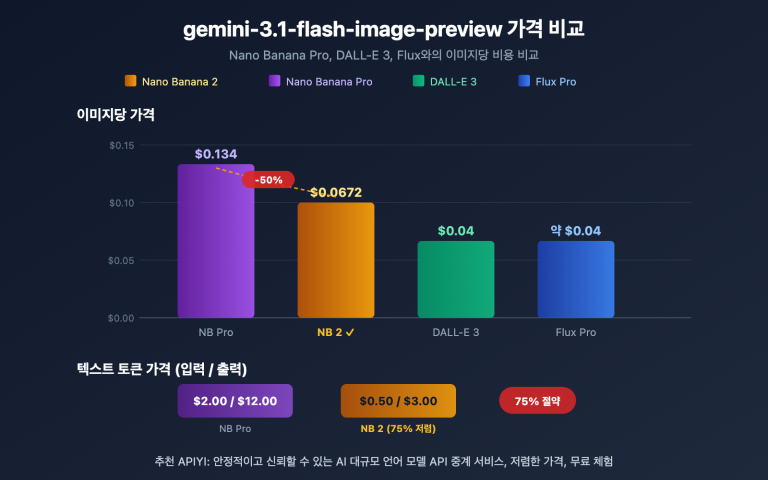

경쟁사 가격 비교:

| 모델 | 입력 가격 | 출력 가격 | 가성비 |

|---|---|---|---|

| Grok 4.20 Beta | $2.00 | $6.00 | 🟢 최상 |

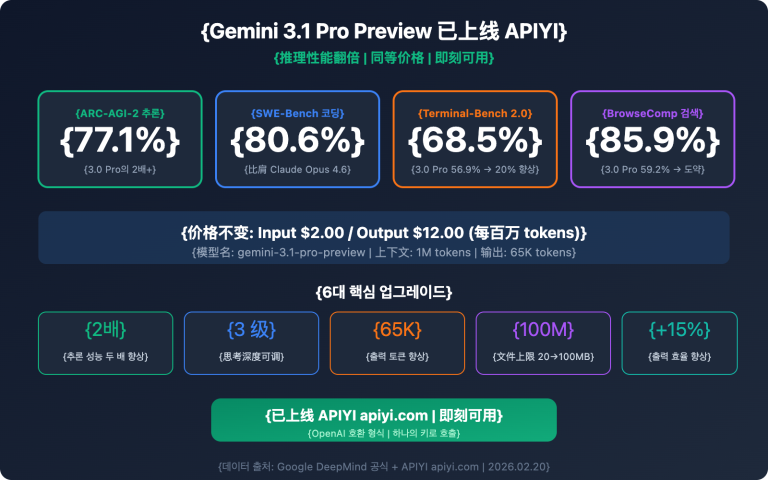

| Gemini 3.1 Pro | $2.00 | $12.00 | 양호 |

| GPT-5.4 | $2.50 | $15.00 | 보통 |

| Claude Sonnet 4.6 | $3.00 | $15.00 | 보통 |

| Claude Opus 4.6 | $15.00 | $75.00 | 높음 |

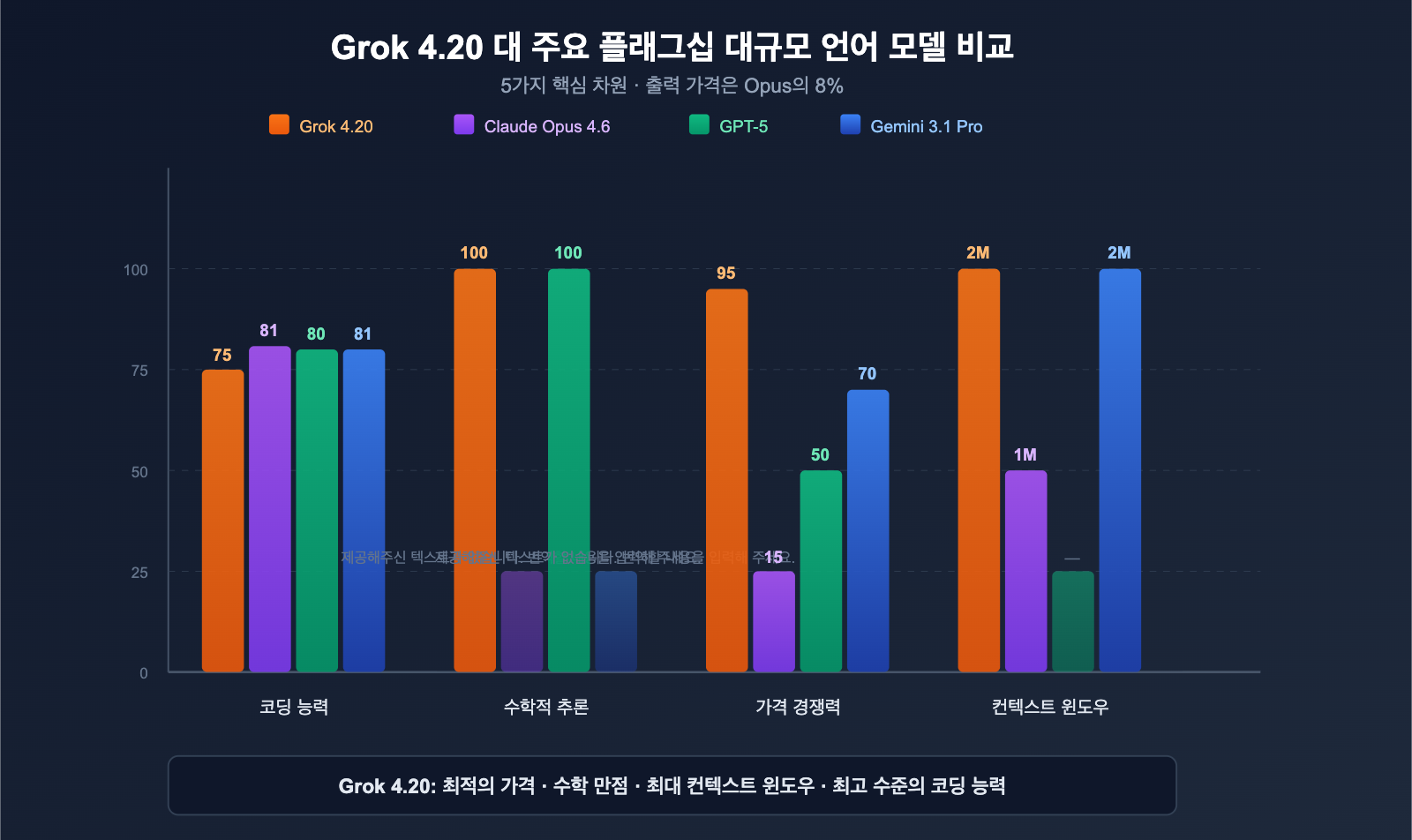

Grok 4.20의 출력 가격은 Claude Sonnet 4.6의 40%, Claude Opus 4.6의 8% 수준입니다. 코드 생성이나 긴 텍스트 처리와 같이 출력 비중이 높은 작업에서 비용 효율성이 매우 뛰어납니다.

🎯 가격 안내: APIYI(apiyi.com)에 출시된 Grok 4.20 Beta 시리즈의 가격은 xAI 공식 홈페이지와 동일(입력 $2 / 출력 $6)하며, 플랫폼 충전 이벤트 등을 통해 추가 할인을 받으실 수 있습니다. 하나의 API 키로 Grok, Claude, GPT 등 200개 이상의 모델을 모두 호출할 수 있습니다.

4가지 모델 심층 분석

모델 1: grok-4.20-beta (범용 플래그십)

Grok 4.20 시리즈의 기본 모델로, 성능과 속도, 비용 사이의 균형을 완벽하게 맞췄습니다.

핵심 특징:

- Grok 4 제품군의 모든 기능 계승

- 200만 토큰 컨텍스트 윈도우 지원 (서구권 최첨단 모델 중 최대 규모)

- 이미지 입력 지원 (JPG/PNG)

- 실제 사용자 피드백을 바탕으로 매주 지속적인 개선

벤치마크 성능:

- SWE-bench: ~75% (GPT-5의 74.9%와 유사)

- GPQA (대학원 수준): 88.4%

- Arena Elo: ~1,505-1,535

활용 분야: 일상적인 프로그래밍 보조, 콘텐츠 제작, 데이터 분석, 범용 대화

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI 통합 인터페이스

)

response = client.chat.completions.create(

model="grok-4.20-beta",

messages=[

{"role": "user", "content": "Python으로 LRU 캐시를 구현해줘"}

]

)

print(response.choices[0].message.content)

모델 2: grok-4.20-multi-agent-beta-0309 (멀티 에이전트)

Grok 4.20의 가장 혁신적인 변형 모델로, 4개의 AI 에이전트가 동시에 협업하여 요청을 처리합니다.

4개 에이전트의 역할:

| 에이전트 | 역할 | 전문 분야 |

|---|---|---|

| Grok (팀장) | 코디네이터 | 작업 분할, 프로세스 관리, 결과 통합 |

| Harper | 연구원 | 실시간 데이터 검색, 사실 확인 (X/Twitter 데이터 연동) |

| Benjamin | 분석가 | 논리적 추론, 수학 계산, 코드 분석 |

| Lucas | 챌린저 | 창의적 종합, 내장된 반대 입장 — 다른 에이전트의 결론 검증 |

작업 프로세스:

사용자 질문

↓

Grok이 작업 분할 → 4개 에이전트에게 배분

↓

Harper 데이터 수집 | Benjamin 논리 분석 | Lucas 반론 제기

↓

에이전트 간 내부 토론 및 교차 검증

↓

Grok이 합의 도출 → 최종 답변 반환

최대 강점 — 환각 현상 65% 감소:

| 지표 | 단일 모델 기준 | 멀티 에이전트 모드 | 개선율 |

|---|---|---|---|

| 환각률 | ~12% | ~4.2% | 65% 감소 |

| "모를 때 모른다고 답하기" 비율 | — | 78% | 업계 최고 |

Lucas의 "내장된 반대 입장" 기능이 핵심입니다. 다른 에이전트의 결론에서 허점을 찾는 것이 이 에이전트의 임무죠. 이러한 대립적 협업 덕분에 최종 결과물의 신뢰도가 훨씬 높습니다.

활용 분야: 심층 연구 보고서, 복잡한 의사결정 분석, 높은 신뢰도가 필요한 작업

response = client.chat.completions.create(

model="grok-4.20-multi-agent-beta-0309",

messages=[

{"role": "user", "content": "2026년 AI 프로그래밍 도구 시장의 경쟁 구도와 트렌드를 분석해줘"}

]

)

모델 3: grok-4.20-beta-0309-non-reasoning (비추론)

속도와 처리량에 최적화된 모델입니다. 내부 추론 체인(Chain-of-Thought) 과정을 생략하고 즉시 답변을 생성합니다.

핵심 특징:

- 낮은 지연 시간, 높은 처리량

- 내부 추론 토큰을 생성하지 않아 출력 비용 절감

- 단순하고 명확한 작업에 적합

활용 분야:

- 고빈도 API 호출 (대량 데이터 처리)

- 챗봇 / 고객 서비스 시스템

- 콘텐츠 분류, 태그 추출

- 간단한 코드 완성

- 번역, 요약

부적합: 복잡한 수학적 추론, 다단계 논리 분석, 깊은 사고가 필요한 아키텍처 설계

response = client.chat.completions.create(

model="grok-4.20-beta-0309-non-reasoning",

messages=[

{"role": "user", "content": "다음 JSON을 CSV 형식으로 변환해줘: ..."}

]

)

모델 4: grok-4.20-beta-0309-reasoning (추론)

비추론 모델과 반대로 심층 추론에 특화된 모델입니다. 확장된 사고 체인(Extended Chain-of-Thought)을 활성화하여 답변 전 깊이 있는 내부 추론 과정을 거칩니다.

핵심 특징:

- 확장된 추론 토큰을 통한 문제 심층 분석

- 수학 및 논리 작업에서 탁월한 성능 (AIME 2025: 100%, HMMT25: 96.7%)

- Artificial Analysis 지능 지수: 48

활용 분야:

- 수학 증명 및 추론

- 코드 리뷰 및 버그 분석

- 아키텍처 설계 트레이드오프 분석

- 복잡한 논리적 논증

- 학술 논문 분석

response = client.chat.completions.create(

model="grok-4.20-beta-0309-reasoning",

messages=[

{"role": "user", "content": "이 동시성 코드에서 발생할 수 있는 경쟁 상태(Race Condition)와 데드락 위험을 분석해줘"}

]

)

💡 모델 선택 팁: 일상적인 작업은

grok-4.20-beta로 충분합니다. 높은 신뢰도가 필요하면 멀티 에이전트 버전을, 대량 처리가 필요하면 비추론 버전을, 복잡한 분석이 필요하면 추론 버전을 사용하세요. APIYI(apiyi.com)에서 발급받은 하나의 API 키로 4가지 모델을 모두 호출할 수 있으며, 필요에 따라 자유롭게 전환 가능합니다.

모델 선택 의사결정 트리

작업 유형별 선택

| 작업 유형 | 추천 모델 | 이유 |

|---|---|---|

| 일상적인 프로그래밍 보조 | grok-4.20-beta |

성능과 비용의 균형 |

| 대량 데이터 처리 | non-reasoning |

최고 속도, 최저 지연 시간 |

| 코드 리뷰/버그 분석 | reasoning |

심층적인 추론 필요 |

| 연구 보고서 작성 | multi-agent |

4개 에이전트 교차 검증 |

| 실시간 데이터 분석 | multi-agent |

Harper가 실시간 X 데이터 연동 |

| 수학/논리 추론 | reasoning |

AIME 100% 만점 |

| 챗봇 | non-reasoning |

낮은 지연 시간, 빠른 응답 |

| 콘텐츠 번역/요약 | non-reasoning |

단순 작업은 추론 불필요 |

| 아키텍처 설계 | reasoning 또는 multi-agent |

트레이드오프 분석 필요 |

비용 민감도별 선택

극강의 가성비 → non-reasoning (추론 토큰 없음, 출력 최소화)

↓

일상적인 가성비 → grok-4.20-beta (범용 균형)

↓

품질 우선 → reasoning (심층 추론, 출력 토큰 많음)

↓

최고의 신뢰도 → multi-agent (4개 에이전트, 가장 상세한 출력)

🚀 빠른 시작:

grok-4.20-beta부터 경험해 보시는 것을 추천합니다. APIYI(apiyi.com)에서 가입 후 API 키를 발급받으세요. 가격은 xAI 공식 홈페이지와 동일하며(입력 $2 / 출력 $6), 충전 이벤트 등을 통해 할인 혜택을 누릴 수 있습니다.

Grok 4.20 vs 주요 모델 비교

전체 차원 비교

| 차원 | Grok 4.20 Beta | Claude Opus 4.6 | GPT-5 시리즈 | Gemini 3.1 Pro |

|---|---|---|---|---|

| SWE-bench | ~75% | 81.4% | ~80% | ~80.6% |

| 수학 (AIME) | 100% | — | 100% | — |

| GPQA | 88.4% | — | — | — |

| 컨텍스트 윈도우 | 200만 | 100만 | 모델별 상이 | 200만 |

| 입력 가격 | $2 | $15 | $2.50 | $2 |

| 출력 가격 | $6 | $75 | $15 | $12 |

| 멀티 에이전트 | ✅ 4개 에이전트 | ❌ | ❌ | ❌ |

| 실시간 데이터 | ✅ X/Twitter | ❌ | ✅ 검색 | ✅ 검색 |

| 환각 제어 | 4.2% (최저) | 낮음 | 낮음 | 보통 |

| 이미지 입력 | ✅ JPG/PNG | ✅ 다중 형식 | ✅ 다중 형식 | ✅ 다중 형식 |

모델별 최적 활용 사례

- Grok 4.20: 가성비 범용 모델, 심층 연구(멀티 에이전트), 실시간 데이터 분석

- Claude Opus 4.6: 소프트웨어 엔지니어링(SWE-bench 최고), 초장문 출력(128K), 기업용 보안

- GPT-5: 수학 만점, 데스크톱 자동화, 최대 사용자 생태계

- Gemini 3.1 Pro: 구글 생태계 통합, 200만 컨텍스트 윈도우, 적절한 비용

💰 가성비 분석: Grok 4.20의 출력 가격($6/MTok)은 Claude Opus 4.6($75/MTok)의 8% 수준입니다. 긴 코드 생성이나 연구 보고서 작성처럼 출력량이 많은 작업 시, Grok 4.20을 사용하면 비용을 90% 이상 절감할 수 있습니다. APIYI(apiyi.com)를 통해 Grok, Claude, GPT 전 시리즈를 통합하여 작업 특성에 맞춰 유연하게 전환해 보세요.

API 호출 실전

기본 호출 예제

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI 통합 인터페이스

)

# 일반 작업 → 기본 버전

response = client.chat.completions.create(

model="grok-4.20-beta",

messages=[

{"role": "system", "content": "당신은 베테랑 파이썬 개발자입니다."},

{"role": "user", "content": "비동기 작업 큐를 구현해줘"}

],

max_tokens=4096

)

print(response.choices[0].message.content)

작업에 따른 자동 모델 선택

def choose_grok_model(task_type):

"""작업 유형에 따라 최적의 Grok 모델을 자동으로 선택합니다."""

model_map = {

"quick": "grok-4.20-beta-0309-non-reasoning",

"general": "grok-4.20-beta",

"analysis": "grok-4.20-beta-0309-reasoning",

"research": "grok-4.20-multi-agent-beta-0309"

}

return model_map.get(task_type, "grok-4.20-beta")

# 사용 예시

model = choose_grok_model("analysis")

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": "이 코드의 성능 병목 현상을 분석해줘..."}]

)

다중 모델 비교 테스트 코드 보기

import openai

import time

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

models = [

"grok-4.20-beta",

"grok-4.20-beta-0309-non-reasoning",

"grok-4.20-beta-0309-reasoning",

"grok-4.20-multi-agent-beta-0309"

]

prompt = "파이썬으로 퀵 정렬을 구현하고 시간 복잡도를 분석해줘"

for model in models:

try:

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=2048

)

elapsed = time.time() - start

tokens = response.usage.total_tokens

print(f"{model}")

print(f" 소요 시간: {elapsed:.1f}s | 토큰: {tokens}")

print(f" 미리보기: {response.choices[0].message.content[:80]}...")

print()

except Exception as e:

print(f"{model} | 오류: {e}")

time.sleep(1)

🎯 실전 팁: 먼저

grok-4.20-beta로 벤치마크 테스트를 진행한 후, 복잡한 작업에서reasoning버전과 출력 품질 차이를 비교해 보세요. APIYI(apiyi.com)를 통해 4가지 모델을 모두 호출할 수 있으며, 가격은 공식 홈페이지와 동일하고 충전 이벤트 등을 통해 할인 혜택을 받을 수 있습니다.

자주 묻는 질문(FAQ)

Q1: 4개 모델의 가격은 모두 동일한가요?

네, 4개 모델의 가격은 백만 토큰당 입력 $2 / 출력 $6로 동일합니다. 하지만 실제 비용은 모델별로 다릅니다. 추론 모델은 더 많은 추론 토큰(출력으로 계산)을 생성하며, 멀티 에이전트 버전은 4개의 에이전트가 협업하므로 토큰 소모가 더 많을 수 있습니다. 비추론 버전은 추론 과정을 건너뛰고 출력 토큰이 가장 적어 가장 경제적입니다. APIYI(apiyi.com)를 통한 호출 가격은 xAI 공식 홈페이지와 동일하며, 플랫폼 충전 이벤트를 통해 할인 혜택이 제공됩니다.

Q2: 멀티 에이전트 버전과 추론 버전의 차이점은 무엇인가요?

추론 버전은 단일 에이전트가 심층적으로 사고하는 방식으로, 수학이나 코드 리뷰처럼 명확한 정답이 있는 분석 작업에 적합합니다. 멀티 에이전트 버전은 4개의 에이전트가 협업하여 토론하는 방식으로, 시장 조사나 의사결정 분석처럼 다각도의 분석이 필요한 개방형 질문에 적합합니다. 멀티 에이전트 버전의 핵심 강점은 교차 검증을 통해 환각 현상을 줄이는 것(12%에서 4.2%로 감소)입니다.

Q3: Grok 4.20이 Claude를 대신하여 코드 리뷰를 할 수 있나요?

일부 상황에서는 가능합니다. Grok 4.20 추론 버전은 SWE-bench에서 약 75%의 성능을 기록하여 Claude Opus 4.6의 81.4%보다는 낮지만, 가격은 8% 수준에 불과합니다. 보안이 핵심이 아닌 일상적인 코드 리뷰에는 가성비 좋은 선택지입니다. 다만, 보안 감사나 대규모 아키텍처 검토에는 Claude Opus 4.6이 여전히 더 신뢰할 수 있습니다. APIYI(apiyi.com)를 이용하면 두 모델을 모두 연동하여 작업에 따라 유연하게 전환할 수 있습니다.

Q4: 200만 토큰 컨텍스트 윈도우는 실제로 어디에 쓰이나요?

200만 토큰은 약 1,500페이지 분량의 기술 서적과 맞먹는 양입니다. 실제 활용 사례로는 (1) 중대형 코드베이스 전체를 한 번에 로드하여 분석, (2) 법률 계약서나 학술 논문집 등 초장문 문서 처리, (3) 초장기 대화 기억 유지 등이 있습니다. 이는 현재 서구권 최첨단 모델 중 가장 큰 컨텍스트 윈도우입니다.

Q5: APIYI 플랫폼에서 이 모델들을 어떻게 호출하나요?

APIYI(apiyi.com)에 가입하여 키를 발급받은 후, OpenAI 호환 형식으로 호출하면 됩니다. base_url을 https://api.apiyi.com/v1으로 설정하고, model을 해당 모델 ID(예: grok-4.20-beta)로 지정하세요. 코드 예제는 위 내용을 참고해 주세요. 4개 모델의 가격은 공식 홈페이지와 동일하며, 할인 혜택은 충전 이벤트를 통해 제공됩니다.

요약: 4가지 모델의 최적 활용 전략

Grok 4.20 Beta 시리즈는 다양한 상황에 맞춰 정밀한 모델 선택지를 제공합니다. 핵심 전략은 작업 복잡도에 따라 모델을 매칭하는 것입니다.

| 복잡도 | 추천 모델 | 비용 |

|---|---|---|

| 🟢 단순/고빈도 | non-reasoning |

최저 |

| 🟡 일상 범용 | grok-4.20-beta |

보통 |

| 🟠 심층 분석 | reasoning |

높음 |

| 🔴 최고 신뢰도 | multi-agent |

최고 |

$2/$6라는 가격 정책 덕분에 Grok 4.20은 현재 시장에서 출력 비용이 가장 저렴한 플래그십 모델로 자리 잡았습니다. 200만 토큰의 컨텍스트 윈도우와 멀티 에이전트 시스템을 결합하면 연구, 분석 및 대량 처리 작업에서 매우 강력한 경쟁력을 발휘합니다.

APIYI(apiyi.com)를 통해 Grok 4.20 Beta 전 시리즈를 원스톱으로 연동해 보세요. 공식 홈페이지와 동일한 가격 정책이 적용되며, 충전 이벤트 등을 통해 추가 할인 혜택을 누릴 수 있습니다. 하나의 API 키로 Grok, Claude, GPT 등 200개 이상의 모델을 모두 호출할 수 있습니다.

참고 자료

-

xAI 공식 문서: Grok 모델 및 가격 안내

- 링크:

docs.x.ai/developers/models

- 링크:

-

Artificial Analysis: Grok 4.20 Beta 벤치마크 평가

- 링크:

artificialanalysis.ai/models/grok-4-20

- 링크:

-

xAI 멀티 에이전트 문서: 멀티 에이전트 기능 상세 설명

- 링크:

docs.x.ai/developers/model-capabilities/text/multi-agent

- 링크:

-

OpenRouter: Grok 4.20 Beta 모델 페이지

- 링크:

openrouter.ai

- 링크:

작성자: APIYI Team | 최신 AI 모델을 가장 빠르게 제공합니다. APIYI(apiyi.com)를 방문하여 Grok 4.20 Beta 전 시리즈를 경험해 보세요.