国产开源大模型在 2026 年迎来重要节点 —— 月之暗面 (Moonshot AI) 旗舰模型 Kimi K2.6 正式开源,在 SWE-Bench Pro 基准上以 58.6 分反超 GPT-5.4 (57.7) 与 Claude Opus 4.6 (53.4),成为目前真实 GitHub Issue 解决率最高的可调用模型。

本文将围绕 Kimi K2.6 API 的接入流程,深入解析其 1T MoE 架构、256K 上下文、Function Call 与前缀续写能力,并通过完整代码示例帮助你在 5 分钟内完成 API 集成。同时对比官方计费,API易 (apiyi.com) 通过华为云官转通道挂牌 $0.60 输入 / $2.40 输出 每 1M tokens,约为官网 ¥6.5 / ¥27 价格的 6 折。

核心价值: 读完本文,你将掌握 Kimi K2.6 API 的完整调用方法、Function Call 工具编排、前缀缓存优化技巧,并了解何时选用 K2.6 才是性价比最优解。

Kimi K2.6 API 核心要点

Kimi K2.6 是月之暗面在 2026 年 4 月正式发布的新一代旗舰开源模型,沿用 Kimi K2 系列 MoE 架构,在编码、长上下文、工具调用三大方向均有显著升级。下表汇总了开发者最关心的核心规格:

| 要点 | 详细规格 | 实际价值 |

|---|---|---|

| MoE 架构 | 1T 总参数 / 32B 激活 / 384 专家 (8选+1共享) | 千亿级能力,推理成本仅与 32B 模型相当 |

| 上下文窗口 | 256K tokens (精确 262,144) | 一次性处理超长仓库代码或法律文档 |

| 最大生成 | 单次输出最高 98,304 tokens | 满足长篇代码重构与文档生成场景 |

| 多模态能力 | 内置 400M MoonViT 视觉编码器 | 原生支持图像与视频输入 |

| 代理编排 | Agent Swarm 支持 300 子代理 / 4,000 协调步 | 可处理复杂多步骤研发流程 |

| 开源协议 | Modified MIT License | 商业使用友好,无显著限制 |

Kimi K2.6 API 重点能力详解

相比上一代 K2.5,K2.6 在三个维度有跨越式提升: 一是 SWE-Bench Pro 突破 58.6 分,首次在真实开源仓库 Issue 解决任务上压倒 GPT-5.4 与 Claude Opus 4.6;二是 Agent Swarm 子代理数从 100 提升到 300,协调步骤从 1500 提升到 4000,可承接更长链路的研发任务;三是 256K 上下文全系列开放,且通过 Multi-head Latent Attention (MLA) 显著降低了长上下文推理的显存与延迟成本。

🎯 技术建议: 在实际开发中,我们建议通过 API易 apiyi.com 平台直接调用 Kimi K2.6,该平台通过华为云官转通道接入官方模型,接口完全兼容 OpenAI SDK,无需改动现有代码即可切换模型。

Kimi K2.6 API 技术架构详解

理解 Kimi K2.6 的底层架构,有助于在不同业务场景下做出合理选型。其架构设计兼顾了"千亿级参数容量"与"百亿级推理成本"的平衡。

MoE 稀疏激活机制

Kimi K2.6 采用 1 万亿参数的混合专家 (MoE) 架构,包含 384 个专家网络。每个 token 推理时仅激活其中 8 个 (加 1 个共享专家),即 32B 参数参与计算。这种设计使模型既具备千亿级模型的知识广度,又保持了 32B 级别的推理速度,是当前 API 调用成本最优的旗舰模型之一。

长上下文优化

| 技术组件 | 作用 | K2.6 配置 |

|---|---|---|

| Multi-head Latent Attention (MLA) | 降低长上下文推理的 KV cache 体积 | 64 个注意力头 |

| 网络层数 | 决定模型推理深度 | 61 层 Transformer |

| 上下文窗口 | 单次输入最大 token 数 | 262,144 tokens (256K) |

| 位置编码 | 支持超长序列的关键技术 | 经过专门长上下文训练 |

| 前缀缓存 | 重复 prompt 命中缓存,降低成本 | 命中后输入价降低约 75% |

💡 架构洞察: K2.6 在多轮对话或固定 system prompt 场景下,前缀缓存可显著降低输入成本。建议生产环境保持 system prompt 稳定,以最大化缓存命中率。

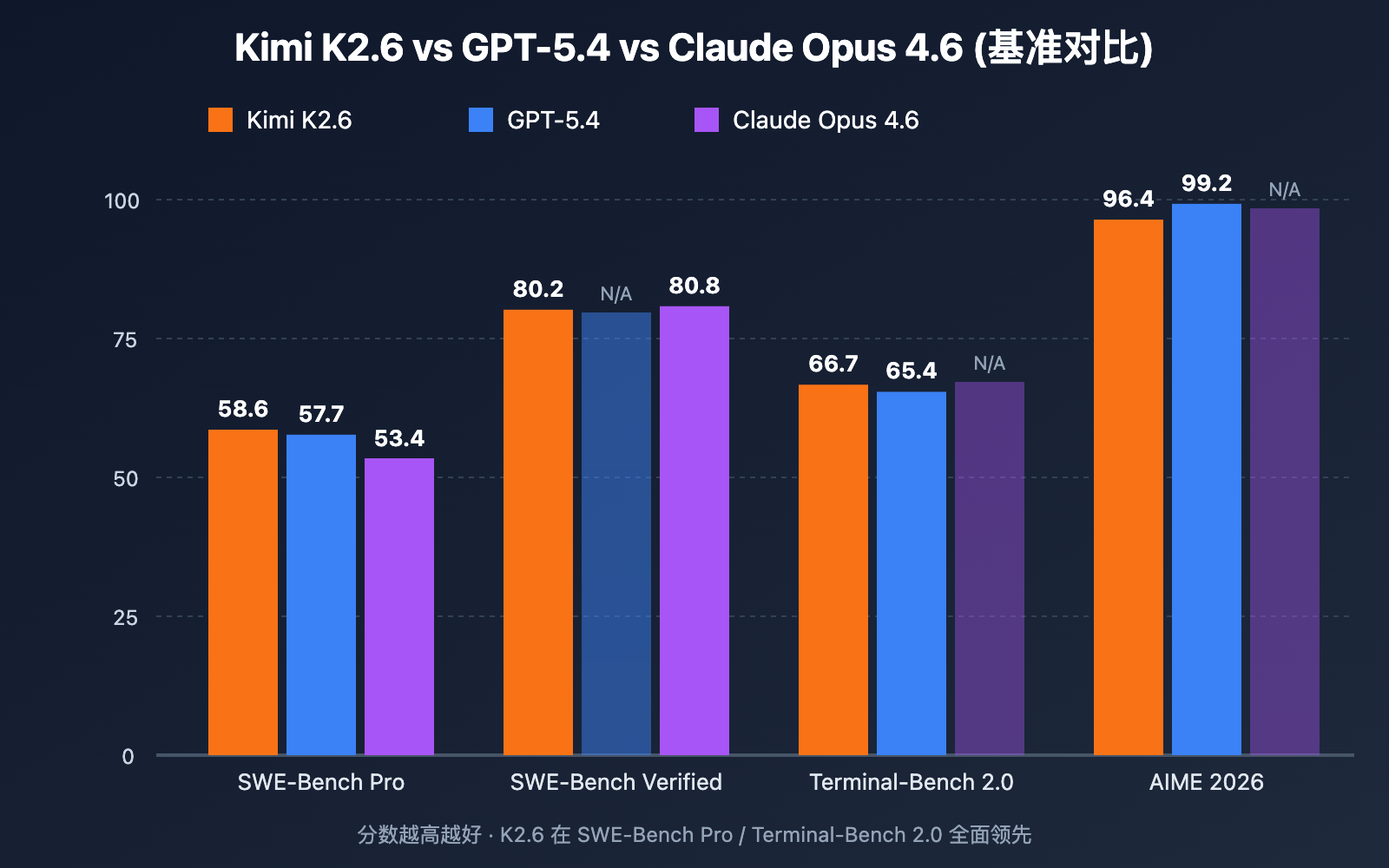

Kimi K2.6 API 性能基准对比

判断一个模型是否值得接入,基准测试是最直观的依据。下面对比 Kimi K2.6、GPT-5.4、Claude Opus 4.6 在五大权威基准上的表现。

编码与软件工程能力

| 基准测试 | Kimi K2.6 | GPT-5.4 | Claude Opus 4.6 | 优势模型 |

|---|---|---|---|---|

| SWE-Bench Pro | 58.6 | 57.7 | 53.4 | Kimi K2.6 |

| SWE-Bench Verified | 80.2 | – | 80.8 | Claude Opus 4.6 |

| Terminal-Bench 2.0 | 66.7 | 65.4 | – | Kimi K2.6 |

| HLE (with tools) | 54.0 | – | 53.0 | Kimi K2.6 |

| AIME 2026 | 96.4 | 99.2 | – | GPT-5.4 |

| GPQA-Diamond | 90.5 | – | – | – |

关键解读:

- SWE-Bench Pro 测量真实 GitHub Issue 的端到端解决能力。K2.6 拿下 58.6 分,首次让开源模型在该基准上反超闭源旗舰,意味着代码维护、bug 修复类任务可优先选 K2.6。

- SWE-Bench Verified 是相对简化版,Claude Opus 4.6 略胜 (80.8 vs 80.2),差距很小但表明 Claude 在标准化代码任务上仍有优势。

- Terminal-Bench 2.0 测试终端命令编排能力,K2.6 的 66.7 分领先,适合 DevOps、自动化运维场景。

- AIME / HMMT 等纯数学推理仍是 GPT-5.4 强项,纯数学场景仍建议保留 GPT-5.4 选项。

🎯 场景建议: 不同任务建议跨模型 A/B 测试 —— 代码维护类优先 K2.6,数学推理优先 GPT-5.4,长篇创意写作可保留 Claude 选项。

Kimi K2.6 API 快速上手

接下来通过完整代码演示如何调用 Kimi K2.6。Kimi 系列 API 完全兼容 OpenAI SDK 协议,如果你已有 OpenAI 调用代码,只需替换 base_url 和 model 即可。

极简示例 (Python)

from openai import OpenAI

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

response = client.chat.completions.create(

model="kimi-k2.6",

messages=[

{"role": "system", "content": "你是一位资深 Python 工程师。"},

{"role": "user", "content": "用 asyncio 实现一个并发请求池,限制最大并发 10。"}

],

temperature=0.3,

max_tokens=2048

)

print(response.choices[0].message.content)

查看完整异步流式调用示例 (含错误处理)

import asyncio

from openai import AsyncOpenAI

from openai import APIError, RateLimitError

client = AsyncOpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1",

max_retries=3,

timeout=120.0

)

async def call_kimi_k26_stream(prompt: str, system: str = "") -> str:

"""流式调用 Kimi K2.6 并实时打印 token"""

messages = []

if system:

messages.append({"role": "system", "content": system})

messages.append({"role": "user", "content": prompt})

full_response = ""

try:

stream = await client.chat.completions.create(

model="kimi-k2.6",

messages=messages,

stream=True,

temperature=0.3,

max_tokens=8192

)

async for chunk in stream:

if chunk.choices[0].delta.content:

token = chunk.choices[0].delta.content

print(token, end="", flush=True)

full_response += token

except RateLimitError:

print("\n[遇到限流, 建议配置重试或升级套餐]")

raise

except APIError as e:

print(f"\n[API 错误: {e}]")

raise

return full_response

async def main():

result = await call_kimi_k26_stream(

prompt="解释 MoE 架构如何降低推理成本",

system="你是 AI 架构专家,回答简洁专业"

)

print(f"\n\n[完整 token 数: {len(result)}]")

if __name__ == "__main__":

asyncio.run(main())

🚀 快速开始: 通过 API易 apiyi.com 平台获取 API Key 后,只需将

base_url设为https://api.apiyi.com/v1,所有 OpenAI 生态的 SDK (Python/Node.js/Go) 均可直接使用,5 分钟即可完成集成。

Node.js / TypeScript 调用

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_KEY,

baseURL: "https://api.apiyi.com/v1",

});

const completion = await client.chat.completions.create({

model: "kimi-k2.6",

messages: [

{ role: "user", content: "用 TypeScript 写一个防抖函数,带泛型支持" }

],

temperature: 0.2,

});

console.log(completion.choices[0].message.content);

cURL 直接调用

curl https://api.apiyi.com/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_APIYI_KEY" \

-d '{

"model": "kimi-k2.6",

"messages": [

{"role": "user", "content": "Hello, Kimi K2.6"}

],

"max_tokens": 1024

}'

Function Call 工具调用实战

K2.6 的 Function Call (工具调用) 能力是其相比 K2 系列的显著升级,在 Berkeley Function-Calling Leaderboard 上表现优异。下面通过一个"查询天气"的完整示例展示工具编排流程。

工具定义与调用

from openai import OpenAI

import json

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

tools = [

{

"type": "function",

"function": {

"name": "get_weather",

"description": "查询指定城市的实时天气",

"parameters": {

"type": "object",

"properties": {

"city": {"type": "string", "description": "城市名称"},

"unit": {"type": "string", "enum": ["celsius", "fahrenheit"]}

},

"required": ["city"]

}

}

}

]

def get_weather(city: str, unit: str = "celsius") -> dict:

"""模拟天气查询接口"""

return {"city": city, "temperature": 22, "unit": unit, "condition": "晴"}

messages = [{"role": "user", "content": "帮我查一下北京和上海的天气"}]

response = client.chat.completions.create(

model="kimi-k2.6",

messages=messages,

tools=tools,

tool_choice="auto"

)

assistant_msg = response.choices[0].message

messages.append(assistant_msg)

if assistant_msg.tool_calls:

for tool_call in assistant_msg.tool_calls:

args = json.loads(tool_call.function.arguments)

result = get_weather(**args)

messages.append({

"role": "tool",

"tool_call_id": tool_call.id,

"content": json.dumps(result, ensure_ascii=False)

})

final_response = client.chat.completions.create(

model="kimi-k2.6",

messages=messages

)

print(final_response.choices[0].message.content)

前缀续写 (Partial Mode)

K2.6 支持 OpenAI 风格的"前缀续写",即在 assistant 消息中预先填入开头,模型从该位置继续生成。常用于强制 JSON 输出或特定格式约束:

response = client.chat.completions.create(

model="kimi-k2.6",

messages=[

{"role": "user", "content": "用 JSON 格式返回北京的GDP数据 (2023)"},

{"role": "assistant", "content": '{"city": "北京", "year": 2023, "gdp":'}

],

max_tokens=200

)

print(response.choices[0].message.content)

💰 成本优化: 对于长 system prompt 场景 (如 RAG、Agent),前缀缓存命中后输入价格降至约 25%,适合多轮对话和高频固定模板的业务。建议在 apiyi.com 平台启用账户级缓存监控,实时观察命中率。

Kimi K2.6 API 高级能力实战

K2.6 在 Function Call 之外,还提供了 Agent Swarm 多代理编排、256K 长上下文、原生多模态三大进阶能力,共同构成其在编码、研发自动化、文档分析场景下的核心竞争力。

Agent Swarm 多代理编排

K2.6 最具差异化的能力之一是 Agent Swarm —— 单次任务可调度多达 300 个并行子代理,执行 4,000 步协调动作。这一特性使 K2.6 在大型代码库重构、多文档跨引用分析、复杂研发流水线等场景中表现突出。

子代理调度模式

K2.6 的 Agent Swarm 支持三种典型编排模式:

| 编排模式 | 适用场景 | 子代理数 | 协调步数 |

|---|---|---|---|

| 单层并行 | 文档批量摘要、代码审查 | 10-50 | < 200 |

| 分层调度 | 多模块代码重构 | 50-150 | 500-1500 |

| 深度协同 | 跨仓库 Agent 流水线 | 150-300 | 1500-4000 |

简易代理调度示例

下面演示如何用 K2.6 协调 5 个并行子代理完成代码审查任务:

from openai import OpenAI

import asyncio

import json

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

async def review_module(module_name: str, code: str) -> dict:

"""单个模块审查子代理"""

response = client.chat.completions.create(

model="kimi-k2.6",

messages=[

{"role": "system", "content": "你是一位代码审查专家,关注安全性和性能。"},

{"role": "user", "content": f"审查模块 {module_name}:\n{code}"}

],

temperature=0.2

)

return {

"module": module_name,

"review": response.choices[0].message.content

}

async def parallel_review(modules: dict) -> list:

"""并行调度多个子代理"""

tasks = [review_module(name, code) for name, code in modules.items()]

return await asyncio.gather(*tasks)

# 主流程: 协调 5 个子代理审查 5 个模块

modules = {

"auth.py": "...",

"database.py": "...",

"api_routes.py": "...",

"cache.py": "...",

"logger.py": "..."

}

results = asyncio.run(parallel_review(modules))

for r in results:

print(f"[{r['module']}] {r['review'][:100]}...")

Agent Swarm 关键最佳实践

- 任务粒度控制: 单个子代理处理 5K-20K tokens,过大会导致协调开销;

- 错误隔离: 每个子代理独立 try/except,避免单点故障级联;

- 结果聚合: 设置一个"主代理"统一收集子代理结果并交叉验证;

- 超时管理: 单子代理超时 60-120 秒,主代理总超时 10-30 分钟;

- 速率控制: 通过信号量限制最大并发数,避免触发 API 限流。

256K 长上下文实战

256K (262,144 tokens) 上下文是 K2.6 的核心卖点。对应中文约 40-50 万字,可一次性容纳大型代码仓库或整本技术书籍。

长上下文典型用法

import os

from openai import OpenAI

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

def load_repo_files(repo_path: str, extensions=(".py", ".ts", ".md")) -> str:

"""加载仓库内所有指定后缀文件"""

contents = []

for root, _, files in os.walk(repo_path):

for f in files:

if f.endswith(extensions):

full_path = os.path.join(root, f)

with open(full_path, "r", encoding="utf-8") as fp:

contents.append(f"## {full_path}\n```\n{fp.read()}\n```")

return "\n\n".join(contents)

repo_text = load_repo_files("./my_project")

print(f"仓库总 token 估算: {len(repo_text) // 2}") # 中文 1 token≈2 字符

response = client.chat.completions.create(

model="kimi-k2.6",

messages=[

{"role": "system", "content": "你是资深架构师,擅长大型代码库分析。"},

{"role": "user", "content": f"分析以下项目架构,给出重构建议:\n{repo_text}"}

],

temperature=0.3,

max_tokens=8192

)

print(response.choices[0].message.content)

长上下文成本与性能权衡

| 输入规模 | 估算成本/次 | 首 token 延迟 | 适用场景 |

|---|---|---|---|

| 8K | $0.005 | 1-2 秒 | 单文件分析 |

| 32K | $0.019 | 3-5 秒 | 模块级审查 |

| 100K | $0.06 | 8-15 秒 | 中型仓库分析 |

| 200K | $0.12 | 18-30 秒 | 大型仓库 / 整本书 |

| 256K (满载) | $0.154 | 25-40 秒 | 极限长文档场景 |

🎯 长文档优化技巧: 长上下文场景建议拆分 system prompt 为"固定指令 + 动态文档"两部分,固定部分被前缀缓存命中后,后续调用仅按变化部分计费,实测在 RAG 场景下可将 100 次调用的总成本降低 40%-60%。

多模态视觉调用

K2.6 内置 400M 参数的 MoonViT 视觉编码器,原生支持图像与视频输入。多模态接口同样兼容 OpenAI 协议:

from openai import OpenAI

import base64

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

def encode_image(image_path: str) -> str:

with open(image_path, "rb") as f:

return base64.b64encode(f.read()).decode("utf-8")

image_b64 = encode_image("./architecture_diagram.png")

response = client.chat.completions.create(

model="kimi-k2.6",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "分析这张架构图,识别潜在的单点故障"},

{

"type": "image_url",

"image_url": {"url": f"data:image/png;base64,{image_b64}"}

}

]

}

],

max_tokens=2048

)

print(response.choices[0].message.content)

多模态适用场景:

- 架构图/流程图分析与修改建议

- UI 设计稿审查与代码生成

- 技术文档截图理解

- 数据图表内容提取

- 工业质检视觉识别

Kimi K2.6 API 迁移与性能优化

如果你的项目当前使用 OpenAI、K2.5、其他厂商模型,迁移到 K2.6 通常只需 3-5 行代码改动;同时,合理的并发与缓存策略可让 K2.6 的成本优势进一步放大。

从 OpenAI GPT 系列迁移

# 原代码 (OpenAI)

client = OpenAI(api_key="OPENAI_KEY")

response = client.chat.completions.create(

model="gpt-5.4",

messages=[...]

)

# 迁移到 K2.6 (仅改 base_url 和 model)

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

response = client.chat.completions.create(

model="kimi-k2.6",

messages=[...]

)

从 Kimi K2 / K2.5 迁移

K2 系列模型 ID 不同,但 API 协议完全一致:

| 旧模型 ID | 新模型 ID | 计划下线时间 |

|---|---|---|

kimi-k2 |

kimi-k2.6 |

2026-05-25 |

kimi-k2.5 |

kimi-k2.6 |

持续支持但建议升级 |

moonshot-v1-128k |

kimi-k2.6 |

2026年内 |

迁移前的兼容性检查

迁移前建议检查以下点:

- max_tokens 上限: K2.6 单次输出可达 98K,如果你的代码硬编码了 8K 限制,可放宽

- temperature 范围: K2.6 推荐 0.1-0.7,过高会影响代码质量

- stop sequences: K2.6 支持自定义停止符,与 OpenAI 一致

- tool_choice 行为: K2.6 的

auto模式更倾向于调用工具,如需保守可改为none或显式指定 - 流式协议: SSE 格式完全一致,前端代码无需改动

性能优化最佳实践

调用速度优化

| 优化项 | 实施方法 | 预期提升 |

|---|---|---|

| 并发请求 | 使用 AsyncOpenAI + asyncio.gather | 吞吐量 3-10x |

| 流式输出 | 启用 stream=True | 首屏延迟降低 70% |

| 前缀缓存 | 固定 system prompt | 输入成本降 75% |

| 合理 max_tokens | 根据任务设定上限 | 单次延迟降 30% |

| 温度控制 | 代码任务 temp=0.2 | 输出更稳定 |

错误处理建议

from openai import OpenAI, APIError, RateLimitError, APITimeoutError

import time

def call_with_retry(prompt: str, max_retries: int = 3):

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1",

timeout=120.0

)

for attempt in range(max_retries):

try:

return client.chat.completions.create(

model="kimi-k2.6",

messages=[{"role": "user", "content": prompt}]

)

except RateLimitError:

wait = 2 ** attempt

print(f"限流,等待 {wait}s 后重试")

time.sleep(wait)

except APITimeoutError:

print(f"超时,第 {attempt+1} 次重试")

except APIError as e:

print(f"API 错误: {e}")

if attempt == max_retries - 1:

raise

raise Exception("达到最大重试次数")

Kimi K2.6 API 价格优势与场景选型

价格是模型选型不可忽视的因素。下表对比 Kimi K2.6 在不同渠道的挂牌价 (单位: 每 1M tokens):

| 调用渠道 | 输入价格 | 输出价格 | 备注 |

|---|---|---|---|

| Kimi 官方平台 | ¥6.5 (~$0.95) | ¥27 (~$4.00) | 国内官方计费 |

| API易 (华为云官转) | $0.60 | $2.40 | 约官网 6 折 |

| OpenRouter (Parasail) | $0.60 | $2.40+ | 非官方通道 |

| GPT-5.4 (参考) | $2.50 | $15.00 | 比 K2.6 贵 4-6 倍 |

| Claude Opus 4.6 (参考) | $15.00 | $75.00 | 比 K2.6 贵 25 倍以上 |

实际成本估算

以日常代码助手场景为例 (假设单次会话: 输入 5K tokens / 输出 2K tokens),月调用 10 万次:

| 模型 | 月输入成本 | 月输出成本 | 月总成本 |

|---|---|---|---|

| Kimi K2.6 (API易) | $300 | $480 | $780 |

| GPT-5.4 | $1,250 | $3,000 | $4,250 |

| Claude Opus 4.6 | $7,500 | $15,000 | $22,500 |

结论: 在编码、Agent、长上下文三类高频场景下,K2.6 性能与 GPT-5.4/Claude Opus 4.6 同档,但成本仅为 1/5 至 1/30。对于预算敏感的中小团队和个人开发者尤其友好。

🎯 选型建议: 选择哪个模型主要取决于您的具体应用场景和质量要求。我们建议通过 API易 apiyi.com 平台进行实际测试,以便做出最适合您需求的选择。该平台支持 Kimi K2.6、GPT-5.4、Claude Opus 4.6 等多种主流模型的统一接口调用,便于快速对比和切换。

应用场景推荐

不同业务场景下,K2.6 的适配度差异较大。下表给出明确的选型建议:

| 应用场景 | 推荐度 | 理由 |

|---|---|---|

| 代码维护与重构 | ⭐⭐⭐⭐⭐ | SWE-Bench Pro 第一,256K 可载入大型仓库 |

| Agent 编排 | ⭐⭐⭐⭐⭐ | 300 子代理 / 4000 步,支持复杂研发流 |

| 长文档分析 | ⭐⭐⭐⭐⭐ | 256K 上下文 + MLA 优化,长文成本可控 |

| 多模态理解 | ⭐⭐⭐⭐ | 原生 MoonViT,图像视频输入开箱即用 |

| 客服与对话 | ⭐⭐⭐⭐ | Function Call 优秀,前缀缓存降低成本 |

| 纯数学推理 | ⭐⭐⭐ | AIME 96.4 分尚可,但 GPT-5.4 更强 |

| 创意写作 | ⭐⭐⭐ | 中文表达自然,但风格化任务略逊 Claude |

常见问题

Q1: Kimi K2.6 API 与 K2.5 / K2 主要区别是什么?

K2.6 在三个方向显著升级: 1) SWE-Bench Pro 从 K2.5 的 53 分跃升至 58.6,首次反超 GPT-5.4 与 Claude Opus 4.6;2) Agent Swarm 子代理从 100 提升到 300,协调步骤从 1500 提升到 4000;3) 256K 上下文全系列开放 (K2 早期版本部分变体仅支持 128K)。Kimi 官方公告显示,K2 早期版本将于 2026年5月25日下线,新项目应直接接入 K2.6,模型 ID 为 kimi-k2.6,完全兼容 OpenAI SDK。

Q2: Kimi K2.6 API 与 OpenAI SDK 完全兼容吗?

是的。K2.6 通过 API易等渠道调用时,API 协议完全兼容 OpenAI 的 chat completions 接口,包括 streaming、tools (Function Call)、tool_choice、temperature、top_p、max_tokens 等参数。Python/Node.js/Go 等主流 SDK 只需修改 base_url 和 model 两个参数即可切换。注意 K2.6 的最大输出 token 是 98,304,远高于 GPT-5 的 16K。

Q3: K2.6 的 256K 上下文实际使用时延迟和成本如何?

K2.6 通过 Multi-head Latent Attention (MLA) 显著优化了长上下文的 KV cache 体积。实测在 100K 输入场景下,首 token 延迟约 8-15 秒 (取决于服务器负载),后续 token 流式返回。成本方面,256K 输入按 $0.60/1M 计算约 $0.15 一次。如果是相同 system prompt 的多轮对话,前缀缓存命中后输入成本降至约 25%。生产前建议针对你的典型 prompt 做端到端实测,关注 token 消耗日志以优化成本。

Q4: K2.6 的 Function Call 与 GPT-5 / Claude 的工具调用有何不同?

接口层完全一致 (OpenAI 风格的 tools 协议),但内部能力侧重不同: 1) K2.6 支持 300 子代理并发,在多工具并行编排上有原生优势;2) K2.6 在 Berkeley Function-Calling Leaderboard 上属于第一梯队,接近 GPT-5 水平;3) K2.6 支持 前缀续写 (Partial Mode),可强制 JSON 输出格式,降低工具调用失败率。对于复杂 Agent 流水线,K2.6 是性价比最佳选择。

Q5: 通过 API易调用 K2.6 是官方授权吗? 数据安全有保障吗?

API易 通过华为云官转通道接入 Kimi 官方模型,属于合规授权渠道,模型权重和推理结果与官方一致。数据传输使用 HTTPS 加密,平台不留存请求内容。对于企业级用户,提供独立子账号、API Key 权限分级、消费限额等安全特性。如对数据合规有严格要求,可在 apiyi.com 合规说明页面查阅详细政策。

Q6: K2.6 适合哪些类型的项目? 何时该选 GPT-5.4 或 Claude?

优先选 K2.6 的场景: 代码助手、SWE 类任务、长上下文 RAG、Agent 流程编排、对成本敏感的中小项目。优先选 GPT-5.4 的场景: 高难度数学竞赛 (AIME/HMMT)、需要顶级推理深度的科研任务。优先选 Claude Opus 4.6 的场景: 长篇创意写作、严格格式合规的合同/法律文档生成。建议保留多模型可切换的接口设计,针对具体任务做对比测试再确定生产模型。

总结

Kimi K2.6 是 2026 年开源大模型的一个重要里程碑 —— 它证明了千亿级 MoE 架构在编码、Agent、长上下文三大方向上,完全可以与闭源旗舰正面竞争。SWE-Bench Pro 58.6 分的成绩,以及 256K 上下文 + 300 子代理的工程能力,使其成为代码助手、研发自动化项目的优选模型。

核心要点回顾:

- 架构优势: 1T MoE / 32B 激活,千亿级能力 + 32B 推理成本

- 基准领先: SWE-Bench Pro / Terminal-Bench 2.0 / HLE 三项第一

- 价格优势: API易渠道 $0.60 / $2.40,约官网 6 折

- 生态友好: OpenAI SDK 完全兼容,5 分钟完成迁移

- 工程能力: 256K 上下文 + 300 子代理 + 前缀缓存

对于希望在 2026 年构建 AI 产品的团队,Kimi K2.6 API 是一个性能、成本、生态都极具竞争力的选择。推荐通过 API易 apiyi.com 平台快速验证效果,对比不同模型在你具体业务场景下的真实表现,做出最优选型决策。

作者: APIYI 技术团队 | 持续关注 AI 大模型动态,欢迎通过 API易 apiyi.com 进行技术交流与方案咨询。