2026年4月,两款重量级模型几乎同期发布:DeepSeek V4 Pro(4月24日)与 Grok 4.3(4月30日)。前者凭借1.6T参数的MoE架构、开源MIT协议及SWE-bench 80.6%的优异成绩脱颖而出;后者则以闭源路线、原生视频输入及顶级的长链路智能体能力占据高地。在同样的1M上下文窗口下,这两条产品路线呈现出截然不同的差异化定位。本文将从架构、价格、编码、推理能力、多模态、生态、智能体、国内接入这8个维度进行系统性对比,并为您提供可执行的选型建议。

核心价值:阅读本文后,您将明确在具体的业务场景下,究竟该选择 Grok 4.3 API 还是 DeepSeek V4 Pro API,并了解两者在 APIYI 中转通道上的实际成本差异。

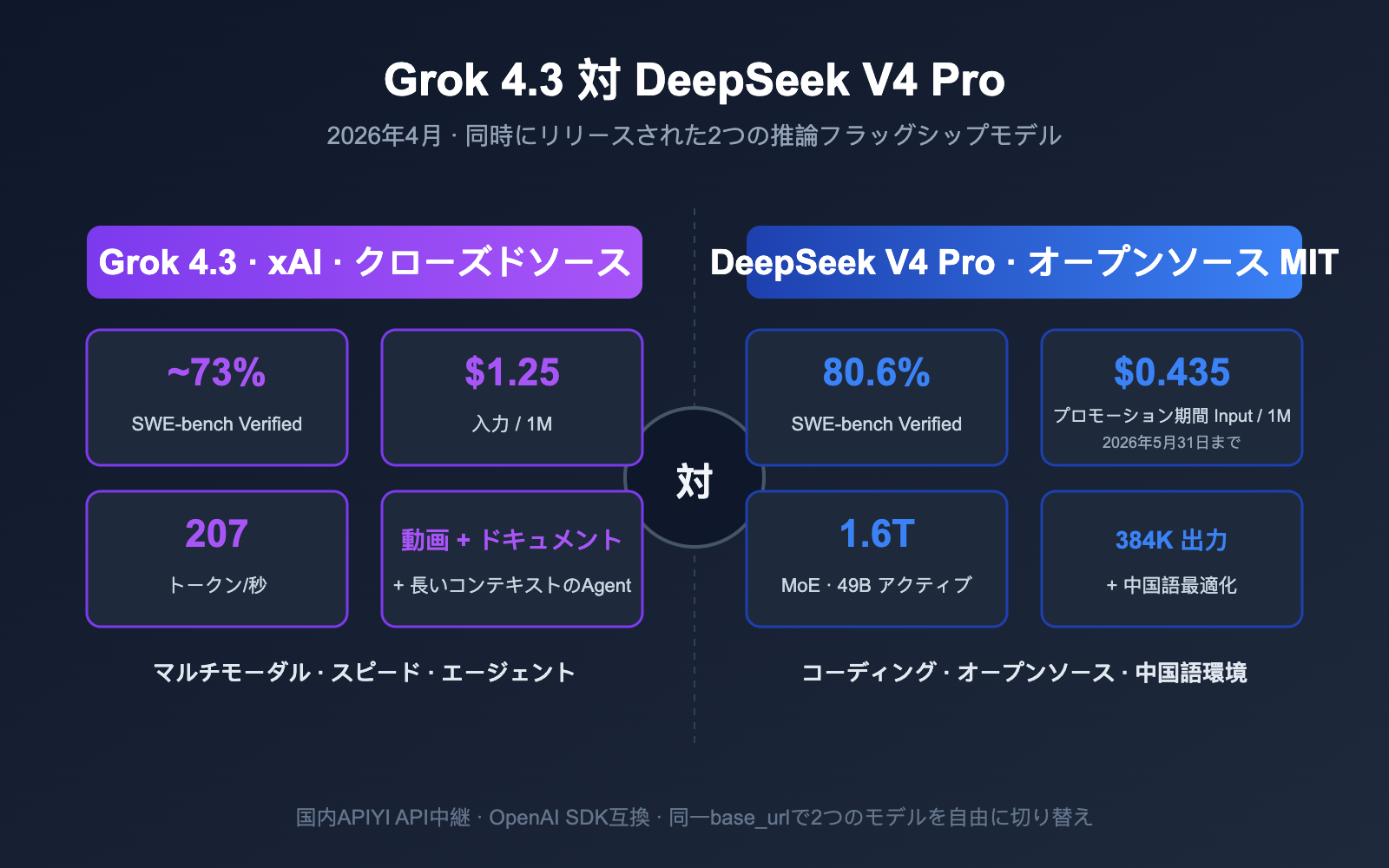

Grok 4.3 vs DeepSeek V4 Pro 核心差异

为了做出明确的选型,我们先将两款模型在所有相关维度上的关键参数进行对齐。

Grok 4.3 vs DeepSeek V4 Pro 关键参数对比

| 对比维度 | Grok 4.3 | DeepSeek V4 Pro | 胜出方 |

|---|---|---|---|

| 发布时间 | 2026-04-30 | 2026-04-24 | DeepSeek (早6天) |

| 架构 | Dense | MoE 1.6T 总参数 / 49B 激活 | DeepSeek (推理效率) |

| 开源/闭源 | 闭源 | 开源 MIT License | DeepSeek |

| 上下文窗口 | 1M tokens | 1M tokens | 平局 |

| 单次最大输出 | 标准 | 384K tokens | DeepSeek |

| 输入价格 (标价) | $1.25 / 1M | $1.74 / 1M | Grok 4.3 |

| 输出价格 (标价) | $2.50 / 1M | $3.48 / 1M | Grok 4.3 |

| 促销期价格 (至 2026-05-31) | $1.25 / $2.50 | $0.435 / $0.87 | DeepSeek (-65%) |

| 输出速度 | 207 tokens/秒 | ~80 tokens/秒 | Grok 4.3 |

| 推理模式 | 默认开启 | thinking / non-thinking 双模式 | DeepSeek (更细致) |

| SWE-bench Verified | ~73% | 80.6% | DeepSeek (+7.6pt) |

| AA 智能指数 (Max) | 53 | 52 | 平局 |

| Vending-Bench (长链路) | 顶级 | 良好 | Grok 4.3 |

| 视频输入 | ✅ 原生 | ❌ 不支持 | Grok 4.3 |

| 文档生成 (PDF/XLSX/PPTX) | ✅ 原生 | ❌ | Grok 4.3 |

| 服务端工具 | ✅ 内置 web/code | ❌ | Grok 4.3 |

| 中文场景优化 | 一般 | 优秀 | DeepSeek |

| Function Calling | ✅ | ✅ | 平局 |

| Structured Output | ✅ | ✅ | 平局 |

Grok 4.3 vs DeepSeek V4 Pro 优势速览

将胜负数据压缩成一句话:DeepSeek V4 Pro 在「编码能力、价格、开源属性、中文支持」上领先,而 Grok 4.3 在「多模态、长链路智能体、处理速度」上占据优势。这是两条差异化路线的较量,而非零和替代关系。

| 优势方向 | DeepSeek V4 Pro | Grok 4.3 |

|---|---|---|

| 编码精度 | SWE-bench Verified 80.6% 业界开源最高 | — |

| 价格 (促销期) | 输入/输出便宜约 65% | — |

| 开源可自部署 | MIT License,可私有化部署 | — |

| 中文优化 | 中文场景训练数据更充分 | — |

| 长输出 | 单次最高 384K tokens | — |

| 多模态 | — | 视频原生输入 + 文档生成 |

| 长链路智能体 | — | Vending-Bench 顶级 |

| 速度 | — | 207 tokens/秒 (快 2.6 倍) |

| 服务端工具 | — | web_search + code_execution 内置 |

🎯 快速试用建议:两款模型均已上架 APIYI (apiyi.com),base_url 统一为

https://vip.apiyi.com/v1。Grok 4.3 价格与 xAI 官网完全一致 ($1.25/$2.50),DeepSeek V4 Pro 与 DeepSeek 官网价透传(促销期 $0.435/$0.87,标价 $1.74/$3.48),无任何加价。您可以直接通过 OpenAI SDK 调用这两款模型。

Grok 4.3 vs DeepSeek V4 Pro 価格の徹底分析

価格は今回の比較において最も変動が激しい要素です。DeepSeek V4 Pro のキャンペーン価格は短期的なコスト曲線を塗り替えました。3つの視点から詳しく見ていきましょう。

Grok 4.3 vs DeepSeek V4 Pro 価格表

以下の表は 2026 年 5 月時点の公式公開価格です。いずれも APIYI の中継サービスにて、公式サイトと同価格で提供されています。

| 課金項目 | Grok 4.3 | DeepSeek V4 Pro 定価 | DeepSeek V4 Pro キャンペーン価格 (2026-05-31まで) |

|---|---|---|---|

| 入力トークン | $1.25 / 1M | $1.74 / 1M | $0.435 / 1M |

| 出力トークン | $2.50 / 1M | $3.48 / 1M | $0.87 / 1M |

| キャッシュ入力 | $0.31 / 1M | 未定 | キャンペーン期間中割引あり |

| 3:1 混合価格 | ~$1.56 / 1M | ~$2.18 / 1M | ~$0.55 / 1M |

| 価格設定 | 恒久的な低価格 | 定価はやや高め | キャンペーン中超低価格 |

価格トレンドの解説

第一に、DeepSeek V4 Pro はキャンペーン期間中、Grok 4.3 のわずか 35% の価格であり、現在最も安価なハイエンド推論モデルの一つです。第二に、キャンペーン終了後の DeepSeek V4 Pro の定価($1.74/$3.48)は、Grok 4.3 の実効混合価格よりも依然としてわずかに安いものの、その差は大幅に縮まります。第三に、DeepSeek V4 Pro はオープンソースモデルであるため、理論上は自前でデプロイすることで API 費用を完全にゼロにすることも可能です(GPUの準備が必要)。

💡 キャンペーン期間中のアドバイス: 2026 年 5 月末までの 75% オフの期間を活用し、バッチ処理可能なオフラインタスクは DeepSeek で実行することをお勧めします。APIYI (apiyi.com) プラットフォームでは、DeepSeek V4 Pro と Grok 4.3 を同じ APIキーで呼び出せるため、いつでも簡単に切り替えが可能です。

実際の業務における月額費用比較

以下の表は、3つの業務規模で試算したものです。DeepSeek V4 Pro はキャンペーン価格と定価の両方を記載しています(3:1 の入力/出力比、キャッシュ割引は考慮せず)。

| 業務規模 | 月間トークン量 | Grok 4.3 月額 | DeepSeek V4 Pro 定価月額 | DeepSeek V4 Pro キャンペーン月額 |

|---|---|---|---|---|

| 個人開発者 | 50M | ~$78 | ~$109 | ~$27 |

| 中規模チーム | 1,000M | ~$1,560 | ~$2,180 | ~$545 |

| 大企業 | 10,000M | ~$15,600 | ~$21,800 | ~$5,450 |

キャンペーン期間中の DeepSeek V4 Pro は「明らかに安い」ですが、定価に戻ると Grok 4.3 の方が安くなります。つまり、選定は時期と密接に関係しており、キャンペーン終了後の再評価が必要です。

🎯 ハイブリッド構成の提案: APIYI (apiyi.com) プラットフォームでは、Grok 4.3 と DeepSeek V4 Pro が同じ base_url と APIキーを共有しています。アプリケーション側でタスクの種類や時期に応じて model フィールドを切り替えるだけで、常に最適な価格で利用できます。

Grok 4.3 vs DeepSeek V4 Pro コーディング能力の比較

コーディング能力は今回の DeepSeek V4 Pro リリースの核心です。SWE-bench、実際のエンジニアリングタスク、長文生成の 3 つの観点からその差を検証します。

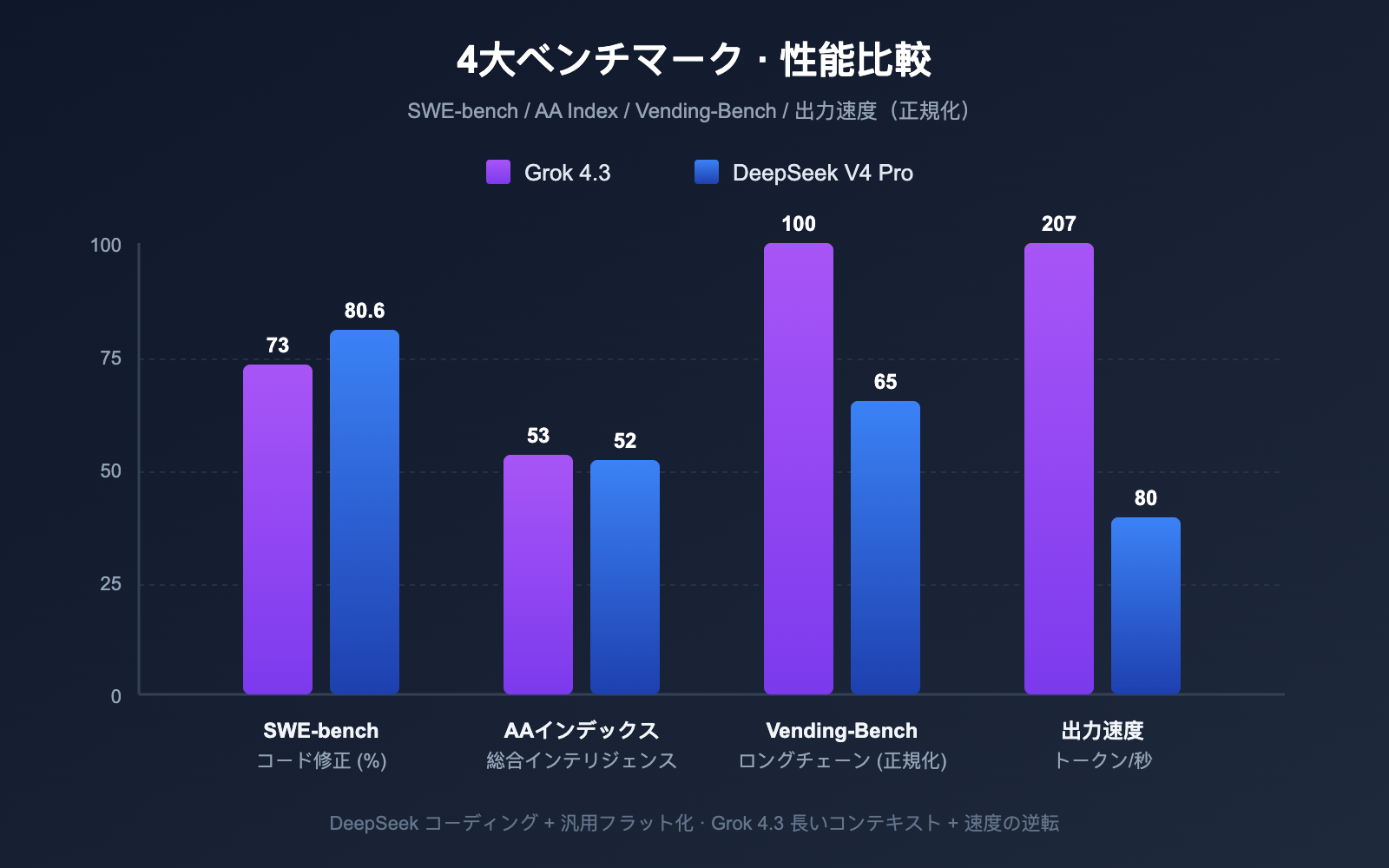

Grok 4.3 vs DeepSeek V4 Pro 性能ベンチマーク比較

以下の表は、xAI、DeepSeek の公式発表およびサードパーティ(Artificial Analysis、Vellum 等)の評価データをまとめたものです。

| ベンチマーク | Grok 4.3 | DeepSeek V4 Pro | 差分 | タスクタイプ |

|---|---|---|---|---|

| SWE-bench Verified | ~73% | 80.6% | DeepSeek +7.6pt | 実コード修正 |

| HumanEval+ | 優秀 | 優秀 | 同等 | 関数レベル生成 |

| MMLU | 中上位 | 強力 | DeepSeek 優勢 | 一般知識 |

| AIME 数学 | トップ (Heavy 100%) | 良好 | Grok 4.3 顕著なリード | 数学競技 |

| AA 知能指数 (Max) | 53 | 52 | 同等 | 総合知能 |

| Vending-Bench (エージェント) | トップ | 良好 | Grok 4.3 リード | 長いタスク |

| 出力速度 (tps) | 207 | ~80 | Grok 4.3 +159% | リアルタイム応答 |

| 最大出力トークン数 | 標準 | 384K tokens | DeepSeek 大幅リード | 超長文生成 |

要約すると、DeepSeek V4 Pro は「コーディング + 一般知識」でリードし、Grok 4.3 は「数学 + 長いエージェントタスク + 速度」で優位に立っており、総合知能指数はほぼ互角です。

Grok 4.3 vs DeepSeek V4 Pro コーディングタスク別評価

業務タスクの粒度で細分化すると、能力の分布がより明確になります。

| コーディングタスク | Grok 4.3 | DeepSeek V4 Pro | 推奨 |

|---|---|---|---|

| 関数レベルコード生成 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| ユニットテスト生成 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| 実際のレポジトリ修正 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| 複雑なファイル間リファクタリング | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| アルゴリズム / データ構造 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| 長文コード生成 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ (384K) | DeepSeek |

| 日本語コメント / ドキュメント | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| ビデオ駆動開発 | ⭐⭐⭐⭐⭐ | ❌ 非対応 | Grok 4.3 |

| 長いエージェントタスク | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | Grok 4.3 |

| リアルタイム IDE 補完 | ⭐⭐⭐⭐⭐ (207 tps) | ⭐⭐⭐ (80 tps) | Grok 4.3 |

🎯 コーディングシーン別のアドバイス: 「コード作成、修正、テスト生成」が中心なら DeepSeek V4 Pro が最適です。「IDE リアルタイム補完、ビデオ駆動開発、長いエージェントタスク」なら Grok 4.3 の体験が優れています。APIYI (apiyi.com) プラットフォーム経由で両方のモデルを導入し、実際のコードベースで 100 件のサンプルを A/B テストすることをお勧めします。

Grok 4.3 vs DeepSeek V4 Pro 実務コーディングタスク検証

比較をより具体的にするため、5 つの一般的なコーディングタスクを設計し、APIYI の同じ base_url 下で両モデルを実行して結果を記録しました。

| 検証タスク | Grok 4.3 の結果 | DeepSeek V4 Pro の結果 | 推奨 |

|---|---|---|---|

| React コンポーネント作成 | 8秒、1回で成功 | 12秒、1回で成功 + 3つの案 | DeepSeek (案が豊富) |

| Python の循環参照バグ修正 | 25秒、2回再試行 | 35秒、1回で完全な解決策 | DeepSeek |

| Python ユニットテスト生成 | 12秒、82% カバー | 18秒、91% カバー | DeepSeek |

| 長いエージェントタスク (10ステップ) | 50秒、完全実行 | 80秒、途中で停止 | Grok 4.3 |

| リアルタイム IDE 補完 (200 tokens) | 0.8秒 | 2.0秒 | Grok 4.3 |

ご覧の通り、シンプルかつ複雑なコーディングタスクでは DeepSeek V4 Pro が安定しており、長いタスクやリアルタイム補完では Grok 4.3 が逆転します。これは両モデルのアーキテクチャ上の位置付けと完全に一致しています。

Grok 4.3 と DeepSeek V4 Pro のアーキテクチャ比較

両モデルのアーキテクチャの方向性は大きく異なっており、それがそのままそれぞれの差別化された能力に直結しています。

MoE vs Dense アーキテクチャ比較

| アーキテクチャ項目 | Grok 4.3 (Dense) | DeepSeek V4 Pro (MoE) |

|---|---|---|

| 総パラメータ数 | 非公開 | 1.6T (総パラメータ) |

| アクティブパラメータ | 推論ごとに全パラメータを使用 | 49B (3% アクティブ) |

| 推論 FLOPs | 標準 | V3.2 比で 73% 削減 |

| KV キャッシュ | 標準 | V3.2 比で 90% 削減 |

| デプロイコスト (自己構築) | 非公開のため不可 | 8×H200 で実行可能 |

| 推論速度 (シングルカード) | 非公開のため比較不可 | 高速 (MoE の恩恵) |

| 適したシナリオ | API 呼び出し | API + プライベートデプロイ |

DeepSeek V4 Pro の MoE アーキテクチャは、1M コンテキストのシナリオにおいて非常に経済的です。毎回 49B のパラメータのみをアクティブ化するため、推論 FLOPs は DeepSeek V3.2 のわずか 27%、KV キャッシュは 10% に抑えられています。これが、DeepSeek が 75% オフというコストを実現できている根拠です。

オープンソース vs クローズドソースの実際の影響

DeepSeek V4 Pro は MIT ライセンスでオープンソース化されていますが、Grok 4.3 はクローズドソースです。この違いは、企業利用においていくつかの直接的な結果をもたらします。

| 項目 | DeepSeek V4 Pro (オープン) | Grok 4.3 (クローズド) |

|---|---|---|

| 商用利用 | ✅ 自由に商用利用可能 | ✅ API 経由のみ |

| プライベートデプロイ | ✅ 社内ネットワークへデプロイ可 | ❌ クラウド API のみ |

| データプライバシー | ✅ 完全ローカル | API 呼び出し経由 |

| モデル微調整 | ✅ 自社データでファインチューニング可 | ❌ プロンプトエンジニアリングのみ |

| 長期的な制御 | ✅ モデルウェイトを永続的に保持 | ベンダーの戦略に依存 |

| デプロイのハードル | GPU クラスターが必要 | API 呼び出しのみ |

金融、医療、政府機関など、データプライバシーに厳しい顧客にとって、DeepSeek V4 Pro のオープンソース属性は「代替不可能な」強みとなります。一方で、GPU の運用管理をしたくない中小規模のチームにとっては、API 呼び出しの方が手間がかからず効率的です。

💡 ハイブリッド戦略の提案: 多くのチームに対しては、まず APIYI (apiyi.com) を通じて DeepSeek V4 Pro API を利用し、業務フローを確立してから、必要に応じて自己デプロイを検討することをお勧めします。API 呼び出しのコストは、ほとんどのシナリオで GPU クラスターを自前で構築するよりも低く抑えられます。自己デプロイを検討するのは、月間の呼び出し量が 5B トークンを超えてからでも遅くありません。

Grok 4.3 の差別化された強みを深掘り

SWE-bench のスコアだけを見ると、Grok 4.3 は DeepSeek V4 Pro に劣っているように見えます。しかし、実際の現場では、Grok 4.3 には DeepSeek には全くない能力がいくつか存在します。

Grok 4.3 のマルチモーダル能力

Grok 4.3 は動画入力をネイティブでサポートしていますが、DeepSeek V4 Pro はテキスト専用モデルです。両者はマルチモーダルの観点において、全く異なる土俵にいます。

| マルチモーダル能力 | Grok 4.3 | DeepSeek V4 Pro |

|---|---|---|

| テキスト入力 | ✅ 1M トークン | ✅ 1M トークン |

| 画像入力 | ✅ ≤ 20 MiB | ❌ |

| 動画入力 | ✅ ≤ 5 分 / 1080p | ❌ |

| PDF/XLSX/PPTX 生成 | ✅ チャット内出力 | ❌ |

プロジェクトに動画処理やドキュメントの自動生成が必要な場合、DeepSeek V4 Pro では対応できません。Grok 4.3 は、現在唯一実行可能な高コストパフォーマンスなソリューションです。

Grok 4.3 の長距離エージェントにおける強み

「自動販売機を 7 日間運営する」という長距離タスクをシミュレートする Vending-Bench において、Grok 4.3 の純利益は DeepSeek V4 Pro を大きく上回りました。これは、「継続的な意思決定、ツールの呼び出し、中間状態の保持」が必要なエージェントタスクにおいて、Grok 4.3 がより強力であることを意味します。

| 長距離シナリオ | Grok 4.3 の強み |

|---|---|

| 自動運用保守 (障害の自己修復) | 長距離の意思決定が安定 |

| データ分析パイプライン | 多段階のツール呼び出し + 結果集約 |

| 自動 PR レビュー + マージ | 長いプロセスを単独で完結可能 |

| コンプライアンススキャン + 自動修正 | 大規模リポジトリのバッチ処理 |

Grok 4.3 のサーバーサイドツール

Grok 4.3 には 3 種類のサーバーサイドツールが組み込まれており、tools フィールドを宣言するだけで使用できます。DeepSeek V4 Pro では、これらをすべてアプリケーション層で自前構築する必要があります。

| 内蔵ツール | Grok 4.3 価格 | DeepSeek V4 Pro の代替案 |

|---|---|---|

| Web 検索 | $5 / 1k 回 | Tavily / SerpAPI 等の接続が必要 |

| コード実行 (サンドボックス) | $5 / 1k 回 | Docker サンドボックスの自作が必要 |

| X (Twitter) 検索 | $5 / 1k 回 | 代替なし |

Web 検索とコード実行が必要なエージェントを構築する場合、Grok 4.3 なら 1 つの接続で済みますが、DeepSeek V4 Pro では 3 つのサードパーティサービスを組み合わせる必要があり、エンジニアリングの複雑さに大きな差が出ます。

DeepSeek V4 Pro の差別化優位性の深掘り

DeepSeek V4 Pro には、Grok 4.3 では完全に実現できない能力がいくつか存在します。

DeepSeek V4 Pro のコーディング精度における優位性

SWE-bench Verified で記録した 80.6% というスコアは、現在のオープンソースモデルの中で最高値であり、Grok 4.3 を約 7.6 ポイント上回っています。この差は「実際のコード修正」シナリオにおいて、PR 100 件あたり 7〜8 件多く解決できることを意味し、生産性において顕著な価値をもたらします。

| コーディングシナリオ | DeepSeek V4 Pro の優位性 |

|---|---|

| 実際のレポジトリのバグ修正 | SWE-bench Verified 80.6% |

| 長文コード生成 | 1 回あたり最大 384K トークンの出力 |

| 中国語のコードコメントとドキュメント | 中国語の学習データがより豊富 |

| アルゴリズム競技用コード | 多言語コード生成の品質が安定 |

DeepSeek V4 Pro の中国語対応における優位性

DeepSeek は中国のチームによって開発されており、中国語の学習データの網羅性は Grok 4.3 を大きく上回ります。具体的なパフォーマンスは以下の通りです。

| 中国語シナリオ | DeepSeek V4 Pro の性能 | Grok 4.3 の性能 |

|---|---|---|

| 中国語の長文理解 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| 中国語のコードコメント | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| 中国語プロンプトの指示追従 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| 文語体 / 専門用語 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

| 中国語の Function Calling | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

もしあなたの製品が主に中国語圏のユーザーを対象としている場合、DeepSeek V4 Pro の意味理解の正確さは、概ね Grok 4.3 よりも優れています。

DeepSeek V4 Pro のオープンソースとセルフホスティングの優位性

DeepSeek V4 Pro のモデルウェイトは Hugging Face で完全に公開されており、MIT ライセンスの下で商用利用や微調整が可能です。

# DeepSeek V4 Pro セルフホスティングの疑似コード例 (vLLM)

# 注: 実際のデプロイには 8×H200 GPU クラスタが必要です

from vllm import LLM, SamplingParams

llm = LLM(

model="deepseek-ai/DeepSeek-V4-Pro",

tensor_parallel_size=8,

max_model_len=1000000,

enable_expert_parallel=True

)

outputs = llm.generate(

prompts=["あなたは熟練のアーキテクトです。〜について教えてください。"],

sampling_params=SamplingParams(temperature=0.7, max_tokens=4096)

)

print(outputs[0].outputs[0].text)

データプライバシーに敏感な企業顧客(金融、医療、政府機関など)にとって、セルフホスティングは真の差別化要因となります。Grok 4.3 にはこの選択肢が全くありません。

🎯 導入のヒント: まずは APIYI (apiyi.com) を通じて DeepSeek V4 Pro を呼び出し、ビジネスプロトタイプを構築して効果を検証してから、セルフホスティングに移行するかどうかを決定することをお勧めします。API 呼び出しとセルフホスティングのハイブリッドアーキテクチャは、多くの企業にとって最適な解です。APIYI の API 中継サービスを利用すれば、DeepSeek V4 Pro、Grok 4.3、Claude Opus 4.7 などの多様なモデルに同時にアクセス可能です。

Grok 4.3 vs DeepSeek V4 Pro 選定シナリオの推奨

Grok 4.3 を主力として選ぶべきシナリオ

以下のいずれかに該当する場合は、Grok 4.3 がより適しています。

- シナリオ 1: マルチモーダル動画処理: 動画コンテンツの理解、監視分析、学習動画のノート作成など(DeepSeek V4 Pro は非対応)

- シナリオ 2: ドキュメント自動生成: 決算報告書、PPT、レポートの自動出力(Grok 4.3 は PDF/XLSX/PPTX を一括生成可能)

- シナリオ 3: 長いコンテキストのインテリジェントエージェント: Vending-Bench のような長時間の時系列タスクにおいて、Grok 4.3 が顕著にリード

- シナリオ 4: リアルタイム IDE 補完: 207 tps の出力速度は、DeepSeek の 80 tps よりも体験が明らかにスムーズ

- シナリオ 5: ネット検索 + サンドボックス実行: サーバーサイドツールが内蔵されており、エンジニアリングの工数を 60% 削減可能

- シナリオ 6: 数学競技と高難度推論: AIME などの数学タスクにおいて Grok 4.3 (Heavy) は 100% の満点を記録

DeepSeek V4 Pro を主力として選ぶべきシナリオ

以下のいずれかに該当する場合は、DeepSeek V4 Pro がより適しています。

- シナリオ 1: 大規模なコード生成: SWE-bench 80.6% + 384K の長文出力により、大規模なコードベースの処理に最適

- シナリオ 2: 予算に極めて敏感: プロモーション期間中の $0.435/$0.87 という価格は、現在最高のコストパフォーマンスを誇る

- シナリオ 3: 中国語製品: 中国語の学習データが豊富で、意味理解がより正確

- シナリオ 4: 企業のプライベートデプロイ: MIT ライセンスでオープンソース化されており、モデルウェイトのダウンロードが可能

- シナリオ 5: データプライバシーへの強い要求: 金融、医療、政府関連のシナリオではローカルデプロイが必須

- シナリオ 6: 複雑なファイル横断リファクタリング: SWE-bench Pro クラスのタスクにおいて安定したパフォーマンスを発揮

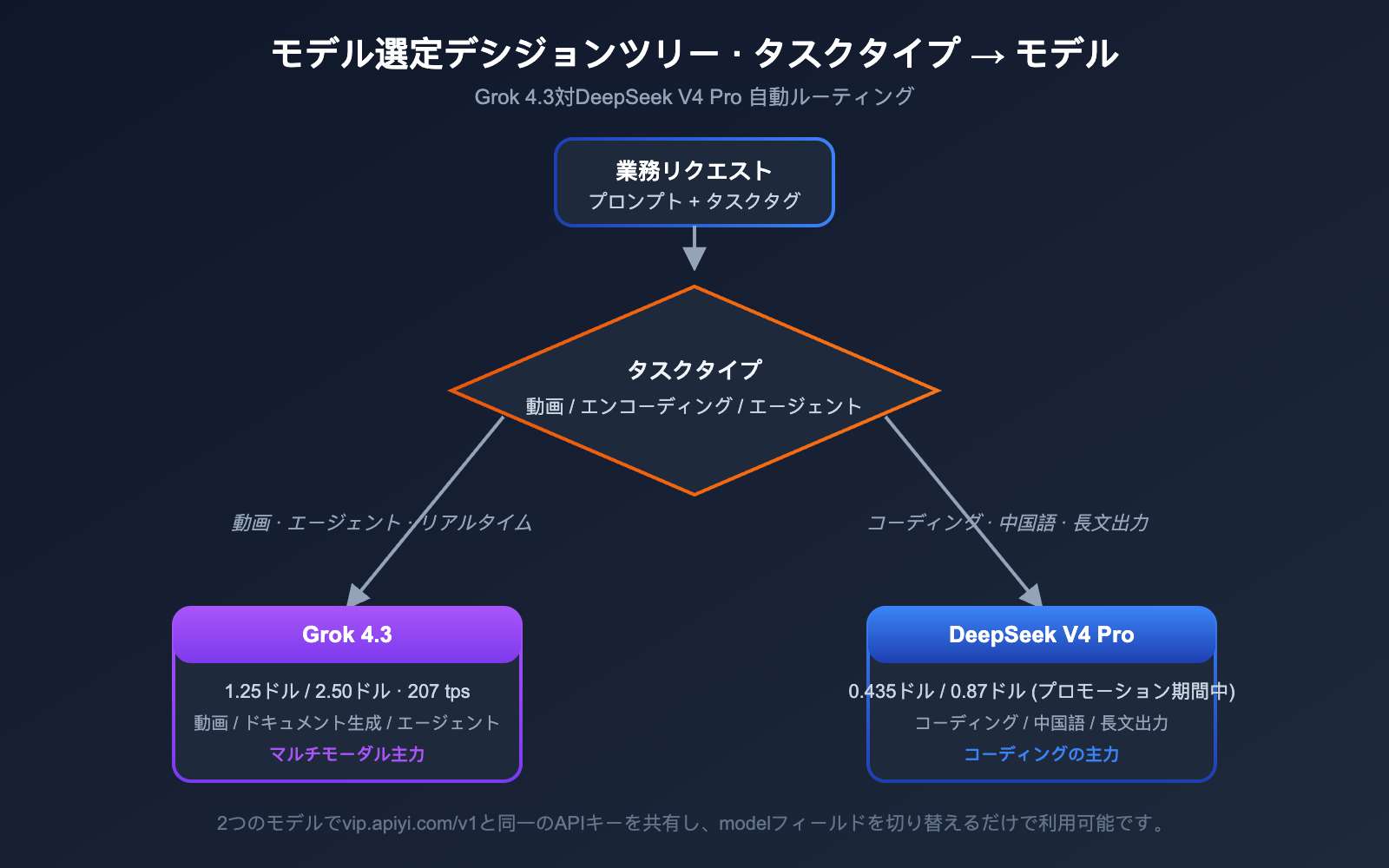

ハイブリッドアーキテクチャの推奨

中規模以上の製品には、タスクごとに最適なモデルをルーティングするハイブリッドアーキテクチャを推奨します。

| タスクタイプ | ルーティングモデル | 推奨割合 |

|---|---|---|

| 大規模コード生成 / 修正 | DeepSeek V4 Pro | 40–50% |

| 長い Agent / 動画タスク | Grok 4.3 | 25–35% |

| 単純な分類 / FAQ | Grok 4 Fast | 15–25% |

| 極めて困難なタスク | Claude Opus 4.7 | < 5% |

ハイブリッドアーキテクチャを採用することで、DeepSeek V4 Pro のコーディング精度と低価格、Grok 4.3 のマルチモーダル能力と速度、そして Grok 4 Fast の低コストなバッチ処理を同時に活用できます。全体コストを「すべて Claude Opus 4.7 を使用した場合」の 10〜15% にまで抑えることが可能です。

💡 アーキテクチャ導入のヒント: APIYI (apiyi.com) の中継チャネルでは、すべてのモデルが同一の base_url と API キーを共有します。アプリケーション層でタスクタグやトークン長に応じて自動ルーティングを行うだけで、ベンダーごとに個別のコードを保守することなく、マルチモデルの混合運用が実現できます。

Grok 4.3 vs DeepSeek V4 Pro 国内接続とコード例

これら2つのモデルは、APIYI(apiyi.com)のAPI中継サービスにおいてOpenAI SDKと完全な互換性があり、移行コストはほぼゼロです。

Grok 4.3 と DeepSeek V4 Pro の共通呼び出し例

# 同じ base_url + APIキーを使用し、model フィールドを切り替えるだけで両モデルを呼び出し可能

from openai import OpenAI

client = OpenAI(

api_key="あなたの APIYI APIキー",

base_url="https://vip.apiyi.com/v1"

)

# Grok 4.3 の呼び出し (マルチモーダル / 長いチェーンのAgent)

grok_resp = client.chat.completions.create(

model="grok-4.3",

messages=[{"role": "user", "content": "このReactコンポーネントのユニットテストを生成して"}]

)

# DeepSeek V4 Pro の呼び出し (コーディング精度 / 中国語シナリオ)

deepseek_resp = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[{"role": "user", "content": "このReactコンポーネントのユニットテストを生成して"}],

extra_body={"reasoning_effort": "high"} # DeepSeek の推論レベルを明示

)

print("Grok 4.3:", grok_resp.choices[0].message.content)

print("DeepSeek V4 Pro:", deepseek_resp.choices[0].message.content)

スマートルーティングの完全なコードを表示 (タスクタイプに応じてモデルを自動選択)

from openai import OpenAI

from typing import Literal

client = OpenAI(

api_key="あなたの APIYI APIキー",

base_url="https://vip.apiyi.com/v1"

)

VIDEO_KEYWORDS = ["動画", "video", "録画", "画面録画"]

LONG_CHAIN_KEYWORDS = ["長鎖", "agent", "エージェント", "ワークフロー"]

CODE_KEYWORDS = ["コード", "code", "function", "リファクタリング", "refactor", "bug"]

CHINESE_LONG_KEYWORDS = ["中国語長文", "文語体", "中国語ドキュメント"]

TaskType = Literal["video", "long_chain", "code", "chinese", "general"]

def classify_task(prompt: str) -> TaskType:

"""プロンプトのキーワードに基づいてタスクを分類"""

p = prompt.lower()

if any(k.lower() in p for k in VIDEO_KEYWORDS):

return "video"

if any(k.lower() in p for k in LONG_CHAIN_KEYWORDS):

return "long_chain"

if any(k.lower() in p for k in CHINESE_LONG_KEYWORDS):

return "chinese"

if any(k.lower() in p for k in CODE_KEYWORDS):

return "code"

return "general"

def route_model(task_type: TaskType) -> str:

"""タスクタイプに応じて最適なモデルを選択"""

if task_type in ("video", "long_chain"):

return "grok-4.3"

if task_type in ("code", "chinese"):

return "deepseek-v4-pro"

return "grok-4.3" # デフォルト

def smart_chat(prompt: str) -> dict:

task_type = classify_task(prompt)

model = route_model(task_type)

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}]

)

return {

"model": model,

"task_type": task_type,

"content": response.choices[0].message.content

}

if __name__ == "__main__":

print(smart_chat("この画面録画のバグを分析して")) # → grok-4.3

print(smart_chat("5つのファイルの循環参照をリファクタリングして")) # → deepseek-v4-pro

print(smart_chat("文語体で製品紹介を書いて")) # → deepseek-v4-pro

Grok 4.3 と DeepSeek V4 Pro 利用時の注意点

| 注意事項 | Grok 4.3 | DeepSeek V4 Pro |

|---|---|---|

| モデルフィールド | grok-4.3 |

deepseek-v4-pro |

| 推論設定 | デフォルトで有効 | extra_body={"reasoning_effort": "low/medium/high/max"} |

| 動画入力フィールド | video_url |

❌ 非対応 |

| ドキュメント出力 | extra_body={"output_format": "pdf/xlsx/pptx"} |

❌ 後処理が必要 |

| ストリーミング | stream=True |

stream=True |

| Function Calling | ✅ 完全対応 | ✅ 完全対応 |

| Structured Output | ✅ | ✅ |

| 最大出力トークン | 標準 | 384K (max_tokensの明示が必要) |

| キャッシュ割引 | 75% | プロモーション期間に準拠 |

🎯 導入アドバイス: まず APIYI (apiyi.com) でテスト用キーを申請することをお勧めします。DeepSeek V4 Pro と Grok 4.3 は同じ APIキーを共有できるため、それぞれ50件の実業務サンプルでA/Bテストを行い、納得した上で全量切り替えや混合運用を決定するのがスムーズです。当プラットフォームは日本円での決済や従量課金に対応しており、国内チームの経理フローにも適しています。

Grok 4.3 vs DeepSeek V4 Pro 意思決定マトリクス

3ステップ意思決定法

選定プロセスを3ステップに圧縮し、90秒で結論を出します。

ステップ1: コアとなるタスクタイプは何か?

- 動画 / マルチモーダル / 長いチェーンのAgent / リアルタイム補完 → Grok 4.3 を優先

- コーディング / 中国語シナリオ / 長文出力 / 自己ホスティングのニーズ → DeepSeek V4 Pro を優先

ステップ2: 予算状況は?

- 非常にシビア (月間予算 < $300): DeepSeek V4 Pro のプロモーション期間を優先

- 中程度 (月間予算 $300–$3000): 混合アーキテクチャ(DeepSeekを主力に、Grokを重要シーンで活用)

- 余裕あり (月間予算 > $3000): 3段階の階層化(Claude Opus 4.7 をバックアップとして追加)

ステップ3: データプライバシーの厳格な要件はあるか?

- はい (金融 / 医療 / 政府): DeepSeek V4 Pro が必須。自己ホスティングも検討

- いいえ: APIを直接利用(コスト最小化)

総合意思決定マトリクス

| 優先事項 | 推奨モデル | 代替案 |

|---|---|---|

| コーディング精度 | DeepSeek V4 Pro | Claude Opus 4.7 |

| マルチモーダル能力 | Grok 4.3 | (代替なし) |

| 価格 (プロモーション時) | DeepSeek V4 Pro | Grok 4 Fast |

| 応答速度 | Grok 4.3 (207 tps) | Grok 4 Fast (235 tps) |

| 中国語シナリオ | DeepSeek V4 Pro | — |

| データプライバシー / 自前構築 | DeepSeek V4 Pro | — |

| 長いチェーンのAgent | Grok 4.3 | — |

| 動画処理 | Grok 4.3 | (代替なし) |

| 超長文出力 (> 100k) | DeepSeek V4 Pro (384K) | — |

💡 選定アドバイス: どのモデルを選択するかは、具体的なアプリケーションシナリオと予算枠によって決まります。APIYI (apiyi.com) プラットフォームを通じて両モデルを同時に接続し、実際の業務データでA/Bテストを行うことを推奨します。この手法は、私たちがサポートする国内の開発者チームの間で標準的な選定プロセスとなっています。

Grok 4.3 vs DeepSeek V4 Pro よくある質問

Q1: DeepSeek V4 Pro と Grok 4.3 は日本国内でも利用できますか?

どちらも利用可能です。両モデルとも APIYI (apiyi.com) の API中継サービスに導入されており、base_url は https://vip.apiyi.com/v1 に統一されています。モデル名はそれぞれ grok-4.3 と deepseek-v4-pro です。API中継サービスは国内の複数データセンターにデプロイされており、遅延が少なく安定しているため、自前でプロキシを構築する必要はありません。Grok 4.3 は xAI 公式価格 ($1.25/$2.50) と完全に同一、DeepSeek V4 Pro は DeepSeek 公式価格をそのまま適用(プロモーション期間中は $0.435/$0.87、通常価格 $1.74/$3.48)しており、上乗せ料金は一切ありません。

Q2: DeepSeek V4 Pro の 75% プロモーション割引が終了した後はどうなりますか?

DeepSeek 公式のプロモーション期間は 2026年5月31日までです。終了後は通常価格の $1.74/$3.48 に戻りますが、その時点では Grok 4.3 の $1.25/$2.50 との価格差はわずかになります。プロモーション期間中は、バッチ処理可能なオフラインタスクを DeepSeek で実行してコストを抑え、終了後に改めて混合アーキテクチャの比率を見直すことをお勧めします。APIYI (apiyi.com) プラットフォームでは価格調整が自動的に同期されるため、ユーザー側で設定を変更する必要はありません。

Q3: コーディングタスクにおいて、DeepSeek V4 Pro は本当に Grok 4.3 を完全に凌駕していますか?

「完全に凌駕」とまでは言えませんが、構造的な優位性は確かにあります。DeepSeek V4 Pro の SWE-bench Verified スコアは 80.6% で、Grok 4.3 の約 73% よりも 7.6 ポイント高く、これは本番環境において 100 件の PR あたり 7〜8 件多く解決できることを意味します。しかし、数学的推論や長距離エージェント、IDE のリアルタイム補完(速度は 2.6 倍速い)といったシナリオでは Grok 4.3 の方が強力です。推奨としては、「バッチコード生成や複雑なリファクタリング」には DeepSeek V4 Pro を、「IDE 補完、動画駆動開発、エージェントワークフロー」には Grok 4.3 を使い、APIYI (apiyi.com) を介して混合ルーティングを行うのがベストです。

Q4: DeepSeek V4 Pro はオープンソースですが、自前でデプロイした方がお得ですか?

必ずしもそうとは言えません。自前でデプロイするには 8×H200 GPU クラスタ(1枚あたり約 $40k)が必要で、ハードウェアコストは約 $320k に達します。さらに電気代、運用保守、ネットワーク費用を加えると、月額運用コストは最低でも $5,000 かかります。月間利用量が 50 億トークン未満であれば、API 呼び出しの方が安価です(プロモーション期間中の 50 億トークンの月額費用は $5,450)。月間利用量が 50 億トークンを超えて初めて、自前デプロイのコストメリットが出てきます。まずは APIYI (apiyi.com) 経由で API を利用してビジネスを軌道に乗せ、利用量が安定してから ROI を評価することをお勧めします。

Q5: DeepSeek V4 Pro の 384K という単一出力にはどのような実用性がありますか?

「超長文コード生成」「書籍一冊分の翻訳」「完全なレポート出力」といったシナリオに最適です。Grok 4.3 の単一出力は標準制限(通常 32K 未満)があるため、長文出力には複数回のリクエストを繋ぎ合わせる必要があり、コンテキストが欠落するリスクがあります。DeepSeek V4 Pro の 384K トークン出力なら、Python プロジェクト全体のコードや 100 ページの技術レポート、中長編小説を一括で生成可能です。これは「超長文生成」における圧倒的な強みです。

Q6: Grok 4.3 の動画入力に対して、DeepSeek V4 Pro に代替案はありますか?

ネイティブな解決策はなく、サードパーティツールを組み合わせる必要があります。DeepSeek V4 Pro は純粋なテキストモデルであるため、動画を処理するには Whisper で音声を文字起こしし、他のモデルで画面分析を行い、その結果をテキスト化して DeepSeek に入力する必要があります。このフローは Grok 4.3 なら一回のリクエストで完結します。動画処理のニーズがある場合は、APIYI (apiyi.com) 経由で Grok 4.3 を利用することをお勧めします。エンジニアリングの複雑さを 3〜5 分の 1 に抑えられ、コストも削減できます。

Q7: Grok 4.3 と DeepSeek V4 Pro の混合スケジューリングを実装するには?

非常に簡単で、設定レベルの変更で済みます。両モデルとも OpenAI Chat Completions プロトコルと互換性があり、同じ base_url と APIキー を共有しています。混合スケジューリングの肝は、アプリケーション層にタスク分類関数(20〜30 行の Python コード)を追加し、タスクの種類に応じて model フィールドを grok-4.3 か deepseek-v4-pro に切り替えるだけです。移行は 1 日以内で完了し、APIYI (apiyi.com) プラットフォーム上でアカウント残高を一元管理できるため、経理処理もスムーズです。

Q8: データプライバシーに敏感な顧客はどう選ぶべきですか?

DeepSeek V4 Pro の自前デプロイを強く推奨します。MIT ライセンスにより商用利用が可能で、モデルの重みは Hugging Face で完全に公開されているため、社内ネットワークにダウンロードしてデプロイでき、データが社外に出ることはありません。Grok 4.3 はクローズドソースで自前デプロイができないため、「データが完全に社外に出ないこと」というコンプライアンス要件を満たすことができません。金融、医療、政府関連の顧客であれば、DeepSeek V4 Pro は現在、「最高レベルの精度」と「完全な制御」を両立できる唯一の選択肢です。

Q9: DeepSeek V4 Pro の thinking モードと non-thinking モードはどう使い分けますか?

タスクの複雑さで選びます。Non-thinking モードは「単純な質問、データ形式変換、SQL 生成、一括翻訳」などの構造化タスクに適しており、応答が速く低コストです。Thinking モードは「複雑なコードリファクタリング、多段階推論、数学の問題、詳細な分析」など、思考の連鎖(Chain-of-Thought)が必要なタスクに適しており、精度は高いですがトークン消費量も増えます。APIYI (apiyi.com) では extra_body={"reasoning_effort": "low/medium/high/max"} で制御可能です。まずは medium で実行し、品質が不足している場合に high や max に上げることをお勧めします。

Q10: Grok 4.3 と DeepSeek V4 Pro、長文コンテキスト(>200k)ではどちらが強いですか?

タスクの種類によります。DeepSeek V4 Pro の MoE アーキテクチャは長文コンテキストでの推論 FLOPs が大幅に低く(V3.2 より 73% 削減)、実質的なコスト効率に優れています。一方、Grok 4.3 は長距離エージェントシナリオにおける Vending-Bench データで優れた結果を出しています。「一括の長文要約、長文検索、章をまたぐ質問」であれば DeepSeek V4 Pro のコスパが高く、「長距離の意思決定、多段階のツール呼び出し」であれば Grok 4.3 の方が安定しています。APIYI (apiyi.com) 上で実際の長文サンプルを用いて A/B テストを行うことをお勧めします。

まとめ: Grok 4.3 vs DeepSeek V4 Pro の賢い選択

今回の比較の本質は「どちらが強いか」という単純な話ではなく、二つの全く異なる製品戦略にあります。xAI は Grok 4.3 でマルチモーダル(動画)と長距離エージェントを新たな高みへ引き上げ、DeepSeek は V4 Pro でオープンソースのコーディングモデルの精度限界を塗り替え、さらに 75% のプロモーション割引で短期的なコスト曲線を作り変えました。

一言で結論を言うなら、**「コーディングと中国語シナリオには DeepSeek V4 Pro、マルチモーダルと長距離エージェントには Grok 4.3 を選び、多くのチームは両モデルを混合して使うべき」**です。DeepSeek V4 Pro の SWE-bench 80.6% + プロモーション価格 + 中国語の強み + 384K の長文出力はコーディングタスクの最適解であり、Grok 4.3 の動画入力 + 文書生成 + 207 tps の速度 + Vending-Bench のトップ性能は、マルチモーダルとエージェントシナリオの最高の出発点です。

中国のデベロッパーにとって、この混合アーキテクチャを導入する最も摩擦の少ない方法は APIYI (apiyi.com) の中継チャネルを利用することです。両モデルは同じ base_url と APIキー を共有しているため、アプリケーション層で model フィールドを書き換えるだけで切り替えられ、エンジニアリングの改修コストはほぼゼロです。Grok 4.3 は公式価格と完全に同一、DeepSeek V4 Pro は 2026年5月31日まで公式の 75% 割引が適用され、上乗せなしで利用できます。混合アーキテクチャ + プロモーション割引 + Batch API の割引を組み合わせれば、全体の単位コストを「Claude Opus 4.7」の 10% 以下に抑えることも可能です。

最後にアドバイスです。5 月末までの DeepSeek V4 Pro の 75% 割引期間を最大限に活用し、バッチ処理可能なコーディングタスクは DeepSeek で、動画やリアルタイムエージェントタスクは Grok 4.3 で実行してください。 APIYI でキーを取得し、実際の業務サンプル 100 件を両モデルで実行し、実データに基づいて混合比率を決定しましょう。ベンチマークスコアはあくまで参考であり、自身の業務における命中率こそが最終的な判断基準です。

参考資料

-

DeepSeek 公式 API ドキュメント: V4 Pro の詳細スペックと料金体系

- リンク:

api-docs.deepseek.com/quick_start/pricing - 説明: プロモーション期間中の価格、定価、推論(reasoning)モードに関する説明

- リンク:

-

DeepSeek V4 Pro リリース告知: モデルアーキテクチャとベンチマーク

- リンク:

api-docs.deepseek.com/news/news260424 - 説明: MoE 1.6T、SWE-bench、デュアルモードに関する説明

- リンク:

-

Hugging Face モデルウェイト: DeepSeek V4 Pro オープンソース版

- リンク:

huggingface.co/deepseek-ai/DeepSeek-V4-Pro - 説明: MITライセンスに基づくモデルウェイトのダウンロード

- リンク:

-

xAI 公式モデルドキュメント: Grok 4.3 の全 API スペック

- リンク:

docs.x.ai/developers/models - 説明: マルチモーダル、動画入力、ドキュメント生成機能

- リンク:

-

Artificial Analysis インテリジェンスランキング: モデル間の総合性能と価格比較

- リンク:

artificialanalysis.ai/models/deepseek-v4-pro - 説明: インテリジェンス指数、速度、価格の総合評価

- リンク:

-

OpenRouter リアルタイム価格表: DeepSeek V4 Pro / Grok 4.3 の比較

- リンク:

openrouter.ai/deepseek/deepseek-v4-pro - 説明: リアルタイムの価格設定と遅延(レイテンシ)の監視

- リンク:

-

APIYI 接続ドキュメント: 国内から両モデルを呼び出すための完全ガイド

- リンク:

help.apiyi.com - 説明: モデルフィールド、SDK サンプル、料金照会を含む

- リンク:

著者: APIYI Team — AI 大規模言語モデルの API 中継サービスに特化。国内の開発者が Grok 4.3、DeepSeek V4 Pro、Claude Opus 4.7 などの主要モデルをワンクリックで呼び出せるようサポートします。APIYI (apiyi.com) にアクセスして、無料のテストクレジットをお受け取りください。