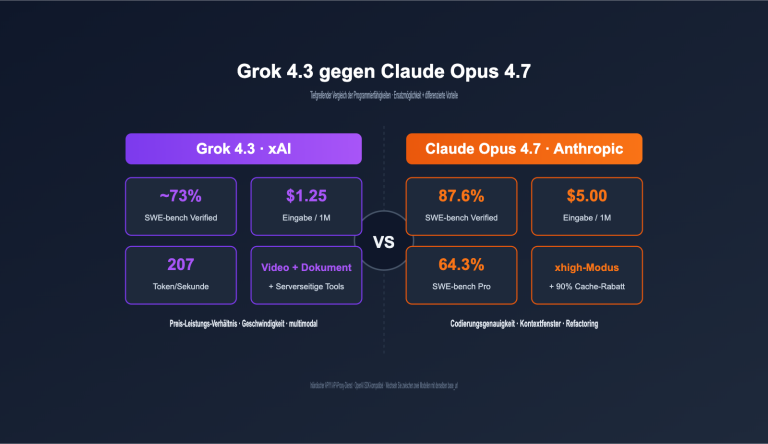

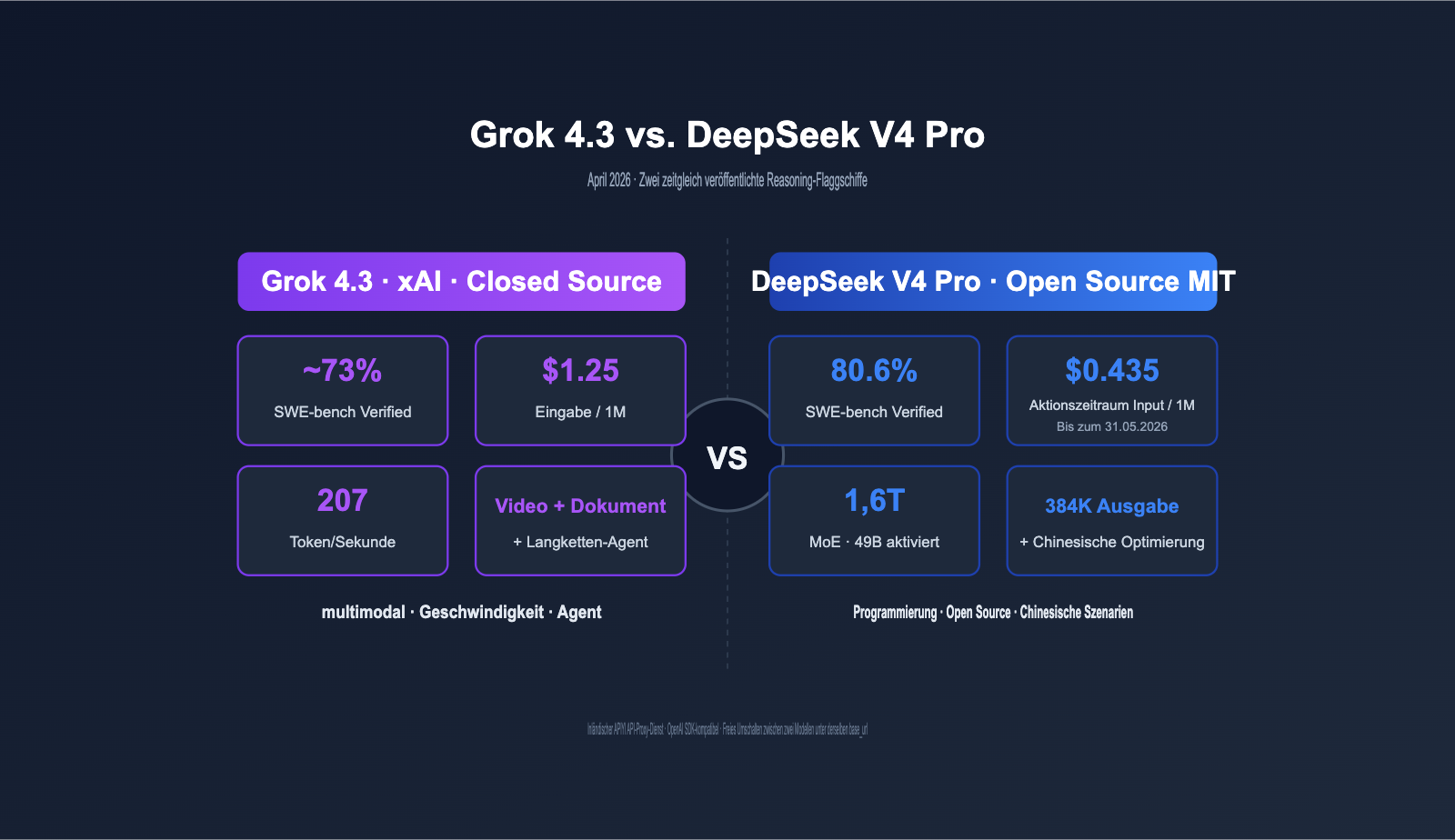

Im April 2026 wurden fast zeitgleich zwei neue Modelle veröffentlicht: DeepSeek V4 Pro (24. April) und Grok 4.3 (30. April). Auf der einen Seite steht eine 1,6T-Parameter-MoE-Architektur mit Open-Source-MIT-Lizenz und 80,6 % bei SWE-bench; auf der anderen Seite ein geschlossenes Modell mit nativer Videoeingabe und Spitzenleistung bei komplexen Agenten-Workflows. Trotz identischer Kontextfenster von 1M Tokens verfolgen beide Produkte völlig unterschiedliche Differenzierungsstrategien. Dieser Artikel analysiert beide Modelle anhand von acht Dimensionen – Architektur, Preis, Programmierung, Reasoning, Multimodalität, Ökosystem, Agenten und lokale Anbindung – und bietet eine fundierte Entscheidungshilfe für Ihre Modellauswahl.

Kernnutzen: Nach der Lektüre dieses Artikels wissen Sie genau, ob Sie für Ihr spezifisches Geschäftsszenario die Grok 4.3 API oder die DeepSeek V4 Pro API wählen sollten, und verstehen die tatsächlichen Kostenunterschiede über den API-Proxy-Dienst von APIYI.

Kernunterschiede: Grok 4.3 vs. DeepSeek V4 Pro

Um eine fundierte Entscheidung zu treffen, gleichen wir zunächst die Schlüsselparameter beider Modelle ab.

Vergleich der Schlüsselparameter

| Vergleichsdimension | Grok 4.3 | DeepSeek V4 Pro | Gewinner |

|---|---|---|---|

| Veröffentlichungsdatum | 30.04.2026 | 24.04.2026 | DeepSeek (6 Tage früher) |

| Architektur | Dense | MoE 1.6T Gesamt / 49B aktiv | DeepSeek (Inferenz-Effizienz) |

| Open/Closed Source | Closed Source | Open Source (MIT) | DeepSeek |

| Kontextfenster | 1M Tokens | 1M Tokens | Unentschieden |

| Max. Output pro Anfrage | Standard | 384K Tokens | DeepSeek |

| Input-Preis (Listenpreis) | $1.25 / 1M | $1.74 / 1M | Grok 4.3 |

| Output-Preis (Listenpreis) | $2.50 / 1M | $3.48 / 1M | Grok 4.3 |

| Aktionspreis (bis 31.05.2026) | $1.25 / $2.50 | $0.435 / $0.87 | DeepSeek (-65%) |

| Ausgabegeschwindigkeit | 207 Tokens/Sek. | ~80 Tokens/Sek. | Grok 4.3 |

| Reasoning-Modus | Standardmäßig aktiv | thinking / non-thinking Modi | DeepSeek (detaillierter) |

| SWE-bench Verified | ~73% | 80.6% | DeepSeek (+7.6pt) |

| AA Intelligenz-Index (Max) | 53 | 52 | Unentschieden |

| Vending-Bench (lange Ketten) | Top-Niveau | Gut | Grok 4.3 |

| Videoeingabe | ✅ Nativ | ❌ Nicht unterstützt | Grok 4.3 |

| Dokumentgenerierung (PDF/XLSX/PPTX) | ✅ Nativ | ❌ | Grok 4.3 |

| Server-Tools | ✅ Integriert (Web/Code) | ❌ | Grok 4.3 |

| Optimierung für Chinesisch | Durchschnittlich | Exzellent | DeepSeek |

| Function Calling | ✅ | ✅ | Unentschieden |

| Strukturierte Ausgabe | ✅ | ✅ | Unentschieden |

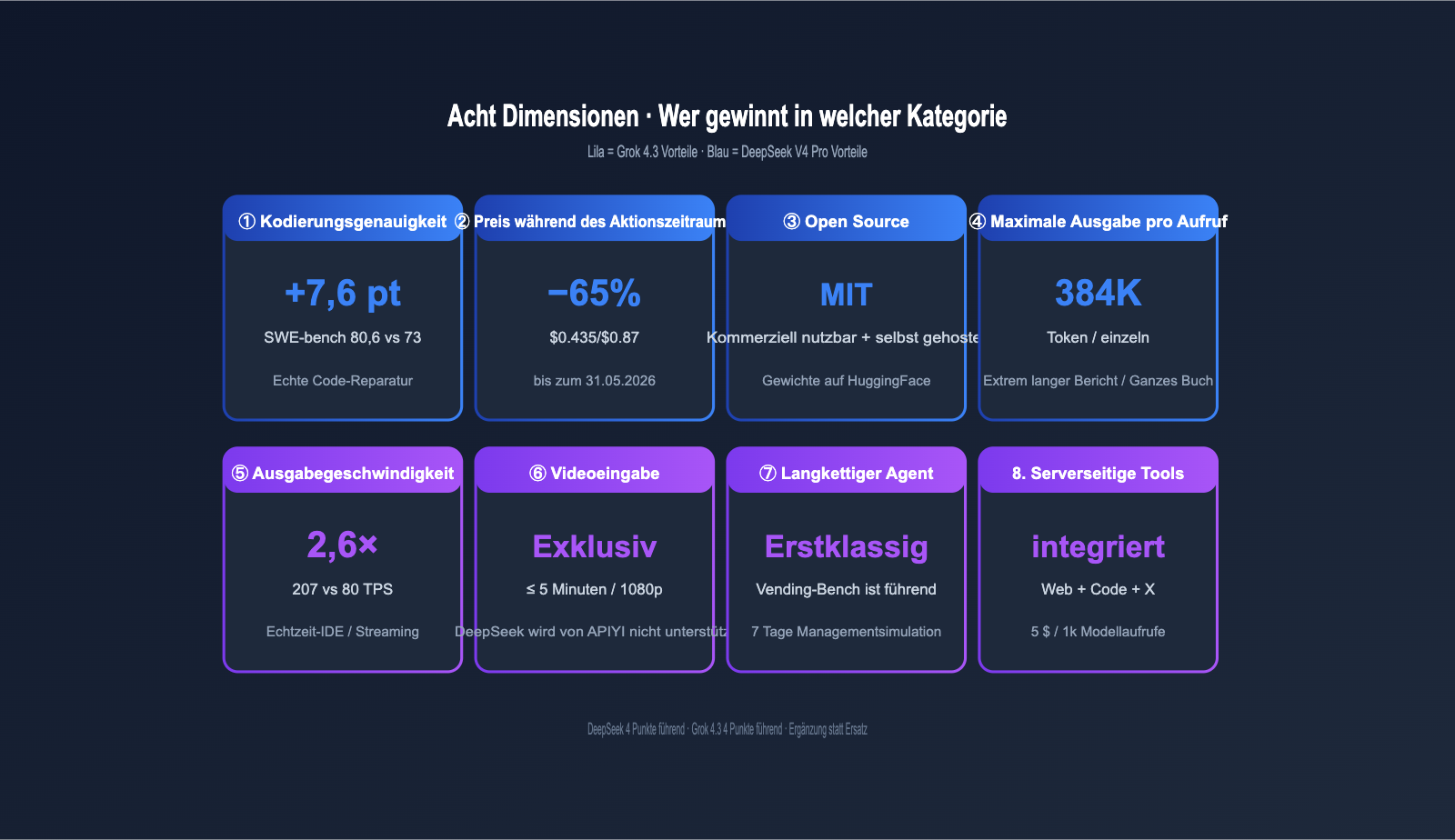

Vorteile auf einen Blick

Zusammengefasst: DeepSeek V4 Pro führt bei „Programmierung + Preis + Open Source + Chinesisch“, während Grok 4.3 bei „Multimodalität + komplexe Agenten-Workflows + Geschwindigkeit“ punktet. Es handelt sich um zwei unterschiedliche Ansätze, nicht um ein Nullsummenspiel.

| Vorteil | DeepSeek V4 Pro | Grok 4.3 |

|---|---|---|

| Programmiergenauigkeit | SWE-bench Verified 80.6% (führend) | — |

| Preis (Aktionszeitraum) | Input/Output ca. 65% günstiger | — |

| Open Source | MIT-Lizenz, lokal bereitstellbar | — |

| Chinesisch-Optimierung | Bessere Trainingsdaten für Chinesisch | — |

| Lange Ausgaben | Bis zu 384K Tokens pro Anfrage | — |

| Multimodalität | — | Native Videoeingabe + Dok-Generierung |

| Komplexe Agenten | — | Vending-Bench Top-Niveau |

| Geschwindigkeit | — | 207 Tokens/Sek. (2,6x schneller) |

| Server-Tools | — | web_search + code_execution integriert |

🎯 Empfehlung zum Testen: Beide Modelle sind über APIYI (apiyi.com) verfügbar; die

base_urlist einheitlichhttps://vip.apiyi.com/v1. Die Preise für Grok 4.3 entsprechen exakt denen der xAI-Website ($1.25/$2.50), während DeepSeek V4 Pro die offiziellen Preise von DeepSeek durchreicht (Aktionspreis $0.435/$0.87, Listenpreis $1.74/$3.48) – ohne Aufschläge. Sie können beide Modelle direkt über das OpenAI SDK aufrufen.

Grok 4.3 vs. DeepSeek V4 Pro: Eine tiefgehende Preisanalyse

Der Preis ist bei diesem Vergleich die am häufigsten variierende Dimension. Die Aktionspreise des DeepSeek V4 Pro haben die kurzfristige Kostenkurve verändert. Wir betrachten dies auf drei Ebenen.

Preistabelle: Grok 4.3 vs. DeepSeek V4 Pro

Die folgende Tabelle zeigt die offiziellen Listenpreise mit Stand Mai 2026. Beide Modelle werden über den API-Proxy-Dienst von APIYI zum offiziellen Preis abgerechnet.

| Abrechnungsposten | Grok 4.3 | DeepSeek V4 Pro Listenpreis | DeepSeek V4 Pro Aktionspreis (bis 31.05.2026) |

|---|---|---|---|

| Input-Tokens | $1,25 / 1M | $1,74 / 1M | $0,435 / 1M |

| Output-Tokens | $2,50 / 1M | $3,48 / 1M | $0,87 / 1M |

| Cache-Input | $0,31 / 1M | ausstehend | Synchroner Rabatt zur Aktion |

| 3:1 Mischpreis | ~$1,56 / 1M | ~$2,18 / 1M | ~$0,55 / 1M |

| Preispositionierung | Dauerhaft günstig | Listenpreis leicht höher | Aktionspreis extrem niedrig |

Interpretation der Preistrends

Erstens: Während der Aktionsphase liegt der Preis für DeepSeek V4 Pro bei nur 35 % des Grok 4.3-Preises und ist damit eines der günstigsten High-End-Reasoning-Modelle auf dem Markt. Zweitens: Nach Ende der Aktion liegt der Listenpreis von DeepSeek V4 Pro ($1,74/$3,48) immer noch leicht unter dem äquivalenten Mischpreis von Grok 4.3, wobei sich der Abstand jedoch deutlich verringert. Drittens: DeepSeek V4 Pro ist ein Open-Source-Modell, das theoretisch selbst gehostet werden kann, um API-Kosten vollständig zu eliminieren (eigene GPU-Ressourcen vorausgesetzt).

💡 Empfehlung zur Aktionsphase: Wir empfehlen, das 75%-Rabattfenster für DeepSeek V4 Pro bis Ende Mai 2026 zu nutzen und batchfähige Offline-Aufgaben bevorzugt über DeepSeek abzuwickeln. Auf der Plattform APIYI (apiyi.com) teilen sich DeepSeek V4 Pro und Grok 4.3 denselben API-Schlüssel, was einen schnellen Wechsel jederzeit ermöglicht.

Vergleich der monatlichen Kosten für reale Geschäftsszenarien

Die folgende Tabelle schätzt die Kosten für drei Geschäftsvolumina. Für DeepSeek V4 Pro werden sowohl Aktions- als auch Listenpreise angegeben (Annahme: 3:1 Input-Output-Verhältnis, ohne Berücksichtigung von Cache-Rabatten).

| Geschäftsvolumen | Monatliches Token-Volumen | Grok 4.3 Monatskosten | DeepSeek V4 Pro Listenpreis | DeepSeek V4 Pro Aktionspreis |

|---|---|---|---|---|

| Einzelentwickler | 50M | ~$78 | ~$109 | ~$27 |

| Mittelgroßes Team | 1.000M | ~$1.560 | ~$2.180 | ~$545 |

| Großunternehmen | 10.000M | ~$15.600 | ~$21.800 | ~$5.450 |

Während der Aktionsphase ist DeepSeek V4 Pro „deutlich günstiger“, nach Ablauf der Aktion ist Grok 4.3 hingegen preiswerter. Dies bedeutet, dass die Entscheidung stark vom Zeitfenster abhängt und nach Ende der Aktion neu bewertet werden sollte.

🎯 Empfehlung zur hybriden Architektur: Auf der Plattform APIYI (apiyi.com) nutzen Grok 4.3 und DeepSeek V4 Pro denselben

base_urlund API-Schlüssel. Auf Anwendungsebene müssen Sie lediglich das Feldmodelje nach Aufgabentyp und Zeitfenster anpassen, um in jedem Zyklus vom optimalen Preis zu profitieren.

Grok 4.3 vs. DeepSeek V4 Pro: Vergleich der Programmierfähigkeiten

Die Programmierung ist das Kernverkaufsargument der Veröffentlichung von DeepSeek V4 Pro. Wir betrachten die Unterschiede anhand von SWE-bench, realen technischen Aufgaben und langen Ausgaben.

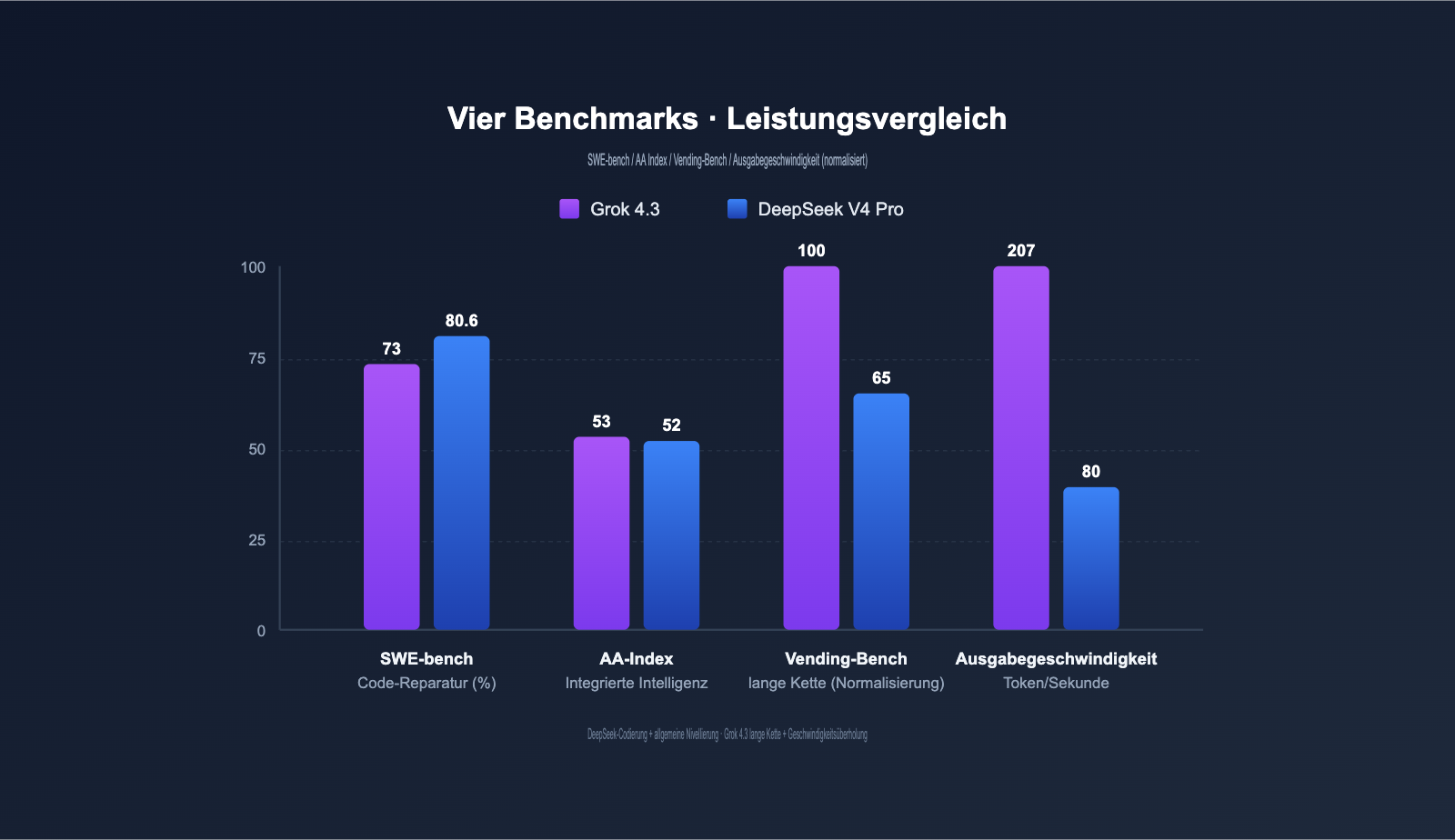

Leistungs-Benchmark: Grok 4.3 vs. DeepSeek V4 Pro

Die folgende Tabelle fasst die wichtigsten Daten von xAI, DeepSeek und Drittanbietern (Artificial Analysis, Vellum etc.) zusammen.

| Benchmark | Grok 4.3 | DeepSeek V4 Pro | Differenz | Aufgabentyp |

|---|---|---|---|---|

| SWE-bench Verified | ~73% | 80,6% | DeepSeek +7,6pt | Reale Code-Korrektur |

| HumanEval+ | Exzellent | Exzellent | Gleichstand | Funktions-Generierung |

| MMLU | Überdurchschnittlich | Stark | DeepSeek leicht vorn | Allgemeinwissen |

| AIME Mathematik | Top (Heavy 100%) | Gut | Grok 4.3 deutlich vorn | Mathe-Wettbewerb |

| AA Intelligenz-Index (Max) | 53 | 52 | Gleichstand | Gesamte Intelligenz |

| Vending-Bench (Agenten) | Top | Gut | Grok 4.3 vorn | Langkettige Aufgaben |

| Output-Geschwindigkeit (tps) | 207 | ~80 | Grok 4.3 +159% | Echtzeit-Antwort |

| Max. Output pro Anfrage | Standard | 384K Tokens | DeepSeek deutlich vorn | Extrem lange Generierung |

Zusammenfassend: DeepSeek V4 Pro führt deutlich bei „Programmierung + Allgemeinwissen“, während Grok 4.3 bei „Mathematik + langkettigen Agenten + Geschwindigkeit“ überlegen ist. Der Gesamt-Intelligenz-Index ist nahezu ausgeglichen.

Bewertung der Programmieraufgaben nach Granularität

Nach Aufgabentyp unterteilt, lässt sich die Leistungsverteilung besser nachvollziehen.

| Programmieraufgabe | Grok 4.3 | DeepSeek V4 Pro | Empfehlung |

|---|---|---|---|

| Funktions-Code-Generierung | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| Unit-Test-Generierung | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| Bug-Fixing in Repos | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| Komplexe Refactorings | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| Algorithmen / Datenstrukturen | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| Lange Code-Generierung | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ (384K) | DeepSeek |

| Chinesische Kommentare / Doku | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| Video-gesteuerte Entwicklung | ⭐⭐⭐⭐⭐ | ❌ Nicht unterstützt | Grok 4.3 |

| Langkettige Agenten | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | Grok 4.3 |

| Echtzeit-IDE-Vervollständigung | ⭐⭐⭐⭐⭐ (207 tps) | ⭐⭐⭐ (80 tps) | Grok 4.3 |

🎯 Empfehlung für Coding-Szenarien: Wenn Ihr Fokus auf „Code schreiben, korrigieren und Tests generieren“ liegt, ist DeepSeek V4 Pro die bessere Wahl. Für „Echtzeit-IDE-Vervollständigung, Video-gesteuerte Entwicklung oder langkettige Agenten“ ist die Erfahrung mit Grok 4.3 besser. Wir empfehlen, beide Modelle über die Plattform APIYI (apiyi.com) anzubinden und einen A/B-Test mit 100 Stichproben aus Ihrem eigenen Code-Repository durchzuführen.

Praxistest: Reale Programmieraufgaben

Um den Vergleich praxisnah zu gestalten, haben wir 5 häufige Programmieraufgaben entworfen und beide Modelle unter demselben base_url auf APIYI getestet.

| Testaufgabe | Grok 4.3 Leistung | DeepSeek V4 Pro Leistung | Empfehlung |

|---|---|---|---|

| React-Komponente schreiben | 8 Sek., 1 Versuch | 12 Sek., 1 Versuch + 3 Lösungsansätze | DeepSeek (mehr Optionen) |

| Python-Zirkelbezug-Bug fixen | 25 Sek., 2 Versuche | 35 Sek., 1 Versuch (komplett) | DeepSeek |

| Python-Unit-Tests (Coverage) | 12 Sek., 82% Abdeckung | 18 Sek., 91% Abdeckung | DeepSeek |

| Langkettiger Agent (10 Schritte) | 50 Sek., volle Ausführung | 80 Sek., Hänger zwischendurch | Grok 4.3 |

| Echtzeit-IDE-Vervollst. (200 tokens) | 0,8 Sek. | 2,0 Sek. | Grok 4.3 |

Man sieht: Bei einfachen und komplexen Programmieraufgaben ist DeepSeek V4 Pro meist stabiler; bei langkettigen Aufgaben und Echtzeit-Vervollständigung liegt Grok 4.3 vorn. Dies deckt sich exakt mit der architektonischen Ausrichtung der beiden Modelle.

Architekturunterschiede: Grok 4.3 vs. DeepSeek V4 Pro

Die Architekturansätze beider Modelle unterscheiden sich grundlegend, was ihre spezifischen Stärken und Einsatzgebiete maßgeblich bestimmt.

MoE vs. Dense: Ein Architekturvergleich

| Architektur-Dimension | Grok 4.3 (Dense) | DeepSeek V4 Pro (MoE) |

|---|---|---|

| Gesamtparameter | Nicht öffentlich | 1,6 T (Gesamt) |

| Aktivierte Parameter | Alle Parameter bei jedem Inferenzschritt | 49 B (3 % Aktivierung) |

| Inferenz-FLOPs | Standard | 73 % weniger als V3.2 |

| KV-Cache | Standard | 90 % weniger als V3.2 |

| Bereitstellungskosten (selbst gehostet) | Geschlossen, nicht bereitstellbar | 8×H200 ausreichend |

| Inferenzgeschwindigkeit (einzelne GPU) | Nicht vergleichbar | Hoch (dank MoE) |

| Ideale Einsatzszenarien | Modellaufruf (API) | API + private Bereitstellung |

Die MoE-Architektur von DeepSeek V4 Pro ist besonders bei einem Kontextfenster von 1 Mio. Tokens äußerst wirtschaftlich: Da pro Durchlauf nur 49 Mrd. Parameter aktiviert werden, betragen die Inferenz-FLOPs lediglich 27 % von DeepSeek V3.2, während der KV-Cache auf 10 % reduziert wird. Dies ist die Grundlage für die 75-prozentige Kostenersparnis von DeepSeek.

Praktische Auswirkungen: Open Source vs. Closed Source

DeepSeek V4 Pro steht unter der MIT-Lizenz, während Grok 4.3 proprietär ist. Dieser Unterschied hat direkte Konsequenzen für den Unternehmenseinsatz.

| Dimension | DeepSeek V4 Pro (Open Source) | Grok 4.3 (Closed Source) |

|---|---|---|

| Kommerzielle Nutzung | ✅ Frei nutzbar | ✅ Über API |

| Private Bereitstellung | ✅ Im internen Netzwerk möglich | ❌ Nur Cloud-API |

| Datenschutz | ✅ Vollständig lokal | Über Modellaufruf |

| Modell-Feinabstimmung | ✅ Auf eigenen Daten möglich | ❌ Nur Eingabeaufforderung |

| Langfristige Kontrolle | ✅ Modellgewichte dauerhaft verfügbar | Abhängig von Anbieterstrategie |

| Bereitstellungshürde | Erfordert GPU-Cluster | Einfacher API-Aufruf |

Für Kunden aus den Bereichen Finanzen, Gesundheitswesen oder öffentliche Verwaltung, bei denen Datenschutz oberste Priorität hat, ist der Open-Source-Charakter von DeepSeek V4 Pro ein unersetzlicher Vorteil. Kleine und mittlere Teams, die den Betrieb von GPUs vermeiden möchten, profitieren hingegen von der Bequemlichkeit der API-Nutzung.

💡 Empfehlung zur Hybrid-Strategie: Wir empfehlen den meisten Teams, zunächst den API-Proxy-Dienst von APIYI (apiyi.com) zu nutzen, um den DeepSeek V4 Pro API-Aufruf in die Geschäftsprozesse zu integrieren und erst bei Bedarf eine eigene Bereitstellung zu evaluieren. In den meisten Fällen sind die Kosten für API-Aufrufe niedriger als der Betrieb eines eigenen GPU-Clusters; eine eigene Bereitstellung lohnt sich meist erst ab einem monatlichen Volumen von über 5 Mrd. Tokens.

Detaillierte Analyse der Stärken von Grok 4.3

Betrachtet man nur den SWE-bench, scheint Grok 4.3 in vielen Punkten hinter DeepSeek V4 Pro zurückzubleiben. In der Praxis bietet Grok 4.3 jedoch Fähigkeiten, die DeepSeek gänzlich fehlen.

Multimodale Fähigkeiten von Grok 4.3

Grok 4.3 unterstützt nativ die Videoeingabe, während DeepSeek V4 Pro ein reines Textmodell ist. Beide Modelle bewegen sich in dieser Hinsicht in völlig unterschiedlichen Kategorien.

| Multimodale Fähigkeit | Grok 4.3 | DeepSeek V4 Pro |

|---|---|---|

| Texteingabe | ✅ 1 Mio. Tokens | ✅ 1 Mio. Tokens |

| Bildeingabe | ✅ ≤ 20 MiB | ❌ |

| Videoeingabe | ✅ ≤ 5 Minuten / 1080p | ❌ |

| PDF/XLSX/PPTX-Erstellung | ✅ Ausgabe im Chat | ❌ |

Wenn Ihr Projekt Anforderungen an Videoverarbeitung oder die automatisierte Dokumentenerstellung stellt, ist DeepSeek V4 Pro nicht geeignet. Grok 4.3 ist hier die derzeit einzige praktikable und kosteneffiziente Lösung.

Vorteile von Grok 4.3 bei komplexen Agenten-Workflows

Im Vending-Bench, der das Szenario „7 Tage Betrieb eines Verkaufsautomaten“ simuliert, erzielt Grok 4.3 signifikant höhere Nettogewinne als DeepSeek V4 Pro. Dies unterstreicht die Stärke von Grok 4.3 bei Agenten-Aufgaben, die kontinuierliche Entscheidungsfindung, Werkzeugnutzung und das Speichern von Zwischenzuständen erfordern.

| Langkettige Szenarien | Vorteil von Grok 4.3 |

|---|---|

| Automatisierte Wartung (Selbstheilung) | Stabile Entscheidungsfindung |

| Datenanalyse-Pipelines | Mehrstufige Werkzeugaufrufe + Aggregation |

| Automatisches PR-Review + Merging | Vollständige Abwicklung langer Prozesse |

| Compliance-Scans + automatische Korrektur | Batch-Verarbeitung großer Repositories |

Server-seitige Werkzeuge von Grok 4.3

Grok 4.3 verfügt über drei integrierte server-seitige Werkzeuge, die einfach durch die Deklaration des tools-Feldes genutzt werden können. Bei DeepSeek V4 Pro müssten diese auf Anwendungsebene selbst implementiert werden.

| Integrierte Werkzeuge | Preis Grok 4.3 | Alternative für DeepSeek V4 Pro |

|---|---|---|

| Websuche | $5 / 1k Aufrufe | Integration von Tavily / SerpAPI nötig |

| Code-Ausführung (Sandbox) | $5 / 1k Aufrufe | Eigene Docker-Sandbox nötig |

| X (Twitter) Suche | $5 / 1k Aufrufe | Keine Alternative |

Für einen Agenten, der sowohl Internetrecherchen als auch Code-Ausführungen benötigt, ist Grok 4.3 mit einer einzigen Schnittstelle einsatzbereit, während bei DeepSeek V4 Pro drei verschiedene Drittanbieterdienste kombiniert werden müssten, was die technische Komplexität deutlich erhöht.

DeepSeek V4 Pro: Eine tiefgehende Analyse der Differenzierungsmerkmale

DeepSeek V4 Pro bietet einige Fähigkeiten, die mit Grok 4.3 schlichtweg nicht realisierbar sind.

Die Stärken von DeepSeek V4 Pro bei der Codierung

Mit einem Wert von 80,6 % bei SWE-bench Verified erzielt das Modell das derzeit höchste Ergebnis unter den Open-Source-Modellen und liegt damit etwa 7,6 Prozentpunkte vor Grok 4.3. In Szenarien der „echten Fehlerbehebung“ bedeutet dieser Vorsprung, dass pro 100 Pull Requests 7–8 Fehler mehr gelöst werden – ein signifikanter Mehrwert für die Produktion.

| Codierungsszenario | DeepSeek V4 Pro Vorteil |

|---|---|

| Echte Bug-Fixes in Repositories | SWE-bench Verified 80,6 % |

| Generierung von langem Code | Bis zu 384K Token Ausgabe pro Durchlauf |

| Chinesische Code-Kommentare & Doku | Umfassendere Trainingsdaten für Chinesisch |

| Code für Wettbewerbsalgorithmen | Stabile Qualität bei mehrsprachiger Codegenerierung |

Die Stärken von DeepSeek V4 Pro im chinesischen Kontext

Da DeepSeek von einem chinesischen Team entwickelt wurde, ist die Abdeckung chinesischer Trainingsdaten weitaus größer als bei Grok 4.3. Hier die Details:

| Chinesisches Szenario | DeepSeek V4 Pro Leistung | Grok 4.3 Leistung |

|---|---|---|

| Verständnis langer chinesischer Texte | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Chinesische Code-Kommentare | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Befolgung chinesischer Eingabeaufforderungen | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Klassisches Chinesisch / Fachbegriffe | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

| Chinesisches Function Calling | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

Wenn Ihr Produkt primär chinesischsprachige Nutzer bedient, ist die semantische Genauigkeit von DeepSeek V4 Pro der von Grok 4.3 in der Regel überlegen.

Vorteile von DeepSeek V4 Pro bei Open Source und Self-Hosting

Die Modellgewichte von DeepSeek V4 Pro sind auf Hugging Face vollständig offen zugänglich; die MIT-Lizenz erlaubt sowohl die kommerzielle Nutzung als auch das Fine-Tuning.

# DeepSeek V4 Pro Self-Hosting Pseudocode (vLLM)

# Hinweis: Für die tatsächliche Bereitstellung ist ein 8×H200 GPU-Cluster erforderlich

from vllm import LLM, SamplingParams

llm = LLM(

model="deepseek-ai/DeepSeek-V4-Pro",

tensor_parallel_size=8,

max_model_len=1000000,

enable_expert_parallel=True

)

outputs = llm.generate(

prompts=["Du bist ein erfahrener Architekt, bitte..."],

sampling_params=SamplingParams(temperature=0.7, max_tokens=4096)

)

print(outputs[0].outputs[0].text)

Für Unternehmenskunden mit hohen Anforderungen an den Datenschutz (Finanzen, Gesundheitswesen, Behörden) ist das Self-Hosting ein echtes Alleinstellungsmerkmal. Grok 4.3 bietet diese Option überhaupt nicht an.

🎯 Empfehlung zur Anbindung: Wir empfehlen, zunächst über den API-Proxy-Dienst APIYI (apiyi.com) einen Modellaufruf von DeepSeek V4 Pro durchzuführen, um den Business-Prototyp zu validieren, bevor Sie sich für ein Self-Hosting entscheiden. Eine hybride Architektur aus API-Aufrufen und Self-Hosting ist für die meisten Unternehmen die optimale Lösung. Über den API-Proxy-Dienst von APIYI können Sie gleichzeitig auf DeepSeek V4 Pro, Grok 4.3, Claude Opus 4.7 und weitere Modelle zugreifen.

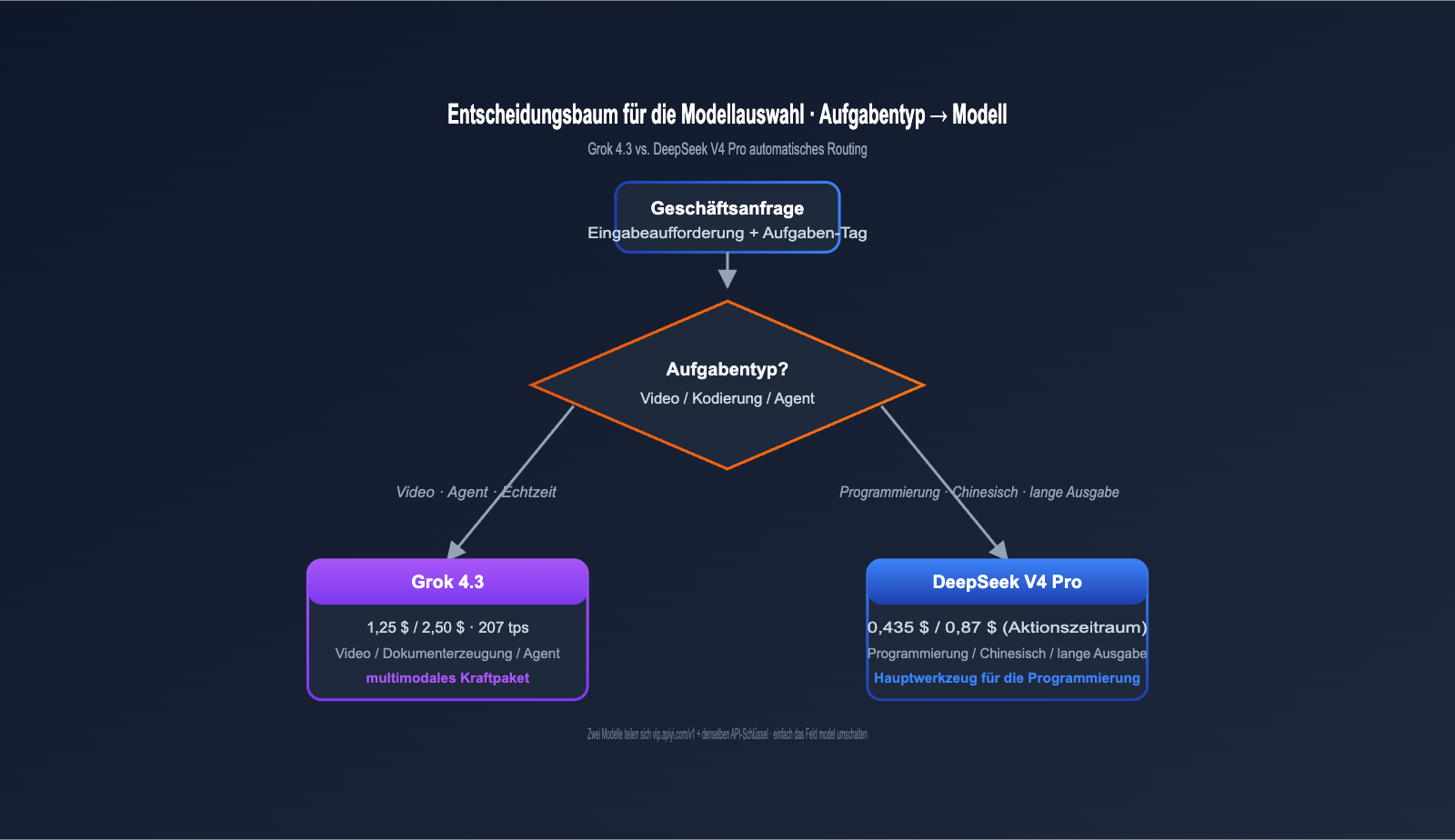

Empfehlungen für die Modellauswahl: Grok 4.3 vs. DeepSeek V4 Pro

Szenarien für den Einsatz von Grok 4.3 als Hauptmodell

Wenn Ihr Unternehmen einen der folgenden Punkte priorisiert, ist Grok 4.3 die bessere Wahl:

- Szenario 1: Multimodale Videoverarbeitung: Verständnis von Videoinhalten, Überwachungsanalysen, Notizen für Lehrvideos – DeepSeek V4 Pro unterstützt dies nicht.

- Szenario 2: Automatisierte Dokumentenerstellung: Automatisierte Ausgabe von Finanzberichten, Präsentationen oder Tabellen; Grok 4.3 erstellt direkt PDF/XLSX/PPTX-Dateien.

- Szenario 3: Langkettige Agenten: Bei zeitlich ausgedehnten Aufgaben (ähnlich Vending-Bench) ist Grok 4.3 deutlich führend.

- Szenario 4: Echtzeit-IDE-Vervollständigung: Die Ausgabegeschwindigkeit von 207 tps bietet ein spürbar besseres Erlebnis als die 80 tps von DeepSeek.

- Szenario 5: Web-Suche + Sandbox-Ausführung: Integrierte serverseitige Tools reduzieren den Engineering-Aufwand um 60 %.

- Szenario 6: Mathematik-Wettbewerbe & komplexe Schlussfolgerungen: Bei Aufgaben wie AIME erreicht Grok 4.3 (Heavy) 100 % der Punkte.

Szenarien für den Einsatz von DeepSeek V4 Pro als Hauptmodell

Wenn Ihr Unternehmen einen der folgenden Punkte priorisiert, ist DeepSeek V4 Pro die bessere Wahl:

- Szenario 1: Groß angelegte Codegenerierung: SWE-bench 80,6 % + 384K lange Ausgabe, ideal für die Verarbeitung großer Codebases.

- Szenario 2: Extreme Budgetsensibilität: Der Aktionspreis von $0,435/$0,87 macht es zum aktuellen Preis-Leistungs-Sieger.

- Szenario 3: Chinesische Produkte: Umfassendere chinesische Trainingsdaten, präziseres semantisches Verständnis.

- Szenario 4: Private Bereitstellung im Unternehmen: MIT-Open-Source + herunterladbare Modellgewichte.

- Szenario 5: Strenge Anforderungen an den Datenschutz: Lokale Bereitstellung ist in Finanz-, Medizin- und Regierungssektoren zwingend erforderlich.

- Szenario 6: Komplexe dateiübergreifende Refactorings: Stabile Leistung bei Aufgaben des Typs SWE-bench Pro.

Empfehlung zur hybriden Architektur

Für mittelgroße bis große Produkte empfehlen wir eine hybride Architektur, bei der verschiedene Aufgaben an das jeweils am besten geeignete Modell weitergeleitet werden.

| Aufgabentyp | Routing-Modell | Empfohlener Anteil |

|---|---|---|

| Groß angelegte Codegenerierung / Fixes | DeepSeek V4 Pro | 40–50 % |

| Langkettige Agenten / Videoaufgaben | Grok 4.3 | 25–35 % |

| Einfache Klassifizierung / FAQ | Grok 4 Fast | 15–25 % |

| Extrem schwierige Aufgaben | Claude Opus 4.7 | < 5 % |

Eine hybride Architektur nutzt die Codierungspräzision und den günstigen Aktionspreis von DeepSeek V4 Pro, die multimodalen Fähigkeiten und die Geschwindigkeit von Grok 4.3 sowie die kostengünstige Stapelverarbeitung von Grok 4 Fast. Die Gesamtkosten können so auf 10–15 % einer „reinen Claude Opus 4.7“-Lösung gesenkt werden.

💡 Tipp zur Implementierung: Über den API-Proxy-Dienst von APIYI (apiyi.com) nutzen alle Modelle denselben

base_urlund API-Schlüssel. Die Anwendungsschicht muss lediglich basierend auf Aufgaben-Tags oder der Token-Länge ein automatisches Routing vornehmen. So realisieren Sie ein hybrides Modell-Management, ohne für jeden Anbieter separaten Integrationscode pflegen zu müssen.

Grok 4.3 vs. DeepSeek V4 Pro: Anbindung und Code-Beispiele

Beide Modelle sind über den API-Proxy-Dienst von APIYI vollständig mit dem OpenAI SDK kompatibel, wodurch die Migrationskosten nahezu bei null liegen.

Einheitliches Aufrufbeispiel für Grok 4.3 und DeepSeek V4 Pro

# Mit derselben base_url und demselben API-Schlüssel lässt sich durch

# einfaches Wechseln des model-Feldes zwischen beiden Modellen umschalten.

from openai import OpenAI

client = OpenAI(

api_key="Dein APIYI API-Schlüssel",

base_url="https://vip.apiyi.com/v1"

)

# Aufruf von Grok 4.3 (multimodal / Long-Chain Agent)

grok_resp = client.chat.completions.create(

model="grok-4.3",

messages=[{"role": "user", "content": "Erstelle Unit-Tests für diese React-Komponente"}]

)

# Aufruf von DeepSeek V4 Pro (Kodiergenauigkeit / chinesische Kontexte)

deepseek_resp = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[{"role": "user", "content": "Erstelle Unit-Tests für diese React-Komponente"}],

extra_body={"reasoning_effort": "high"} # Explizite Reasoning-Stufe für DeepSeek

)

print("Grok 4.3:", grok_resp.choices[0].message.content)

print("DeepSeek V4 Pro:", deepseek_resp.choices[0].message.content)

Vollständigen Code für intelligentes Routing anzeigen (automatische Modellauswahl nach Aufgabentyp)

from openai import OpenAI

from typing import Literal

client = OpenAI(

api_key="Dein APIYI API-Schlüssel",

base_url="https://vip.apiyi.com/v1"

)

VIDEO_KEYWORDS = ["Video", "video", "Aufnahme", "Bildschirmaufnahme"]

LONG_CHAIN_KEYWORDS = ["Long-Chain", "agent", "Intelligenter Agent", "Workflow"]

CODE_KEYWORDS = ["Code", "code", "function", "Refactoring", "refactor", "bug"]

CHINESE_LONG_KEYWORDS = ["Langer chinesischer Text", "klassisch chinesisch", "chinesische Dokumentation"]

TaskType = Literal["video", "long_chain", "code", "chinese", "general"]

def classify_task(prompt: str) -> TaskType:

"""Klassifiziert Aufgaben basierend auf Schlüsselwörtern in der Eingabeaufforderung"""

p = prompt.lower()

if any(k.lower() in p for k in VIDEO_KEYWORDS):

return "video"

if any(k.lower() in p for k in LONG_CHAIN_KEYWORDS):

return "long_chain"

if any(k.lower() in p for k in CHINESE_LONG_KEYWORDS):

return "chinese"

if any(k.lower() in p for k in CODE_KEYWORDS):

return "code"

return "general"

def route_model(task_type: TaskType) -> str:

"""Wählt das optimale Modell basierend auf dem Aufgabentyp"""

if task_type in ("video", "long_chain"):

return "grok-4.3"

if task_type in ("code", "chinese"):

return "deepseek-v4-pro"

return "grok-4.3" # Standard

def smart_chat(prompt: str) -> dict:

task_type = classify_task(prompt)

model = route_model(task_type)

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}]

)

return {

"model": model,

"task_type": task_type,

"content": response.choices[0].message.content

}

if __name__ == "__main__":

print(smart_chat("Analysiere den Bug in dieser Bildschirmaufnahme")) # → grok-4.3

print(smart_chat("Hilf mir beim Refactoring der zirkulären Abhängigkeiten in 5 Dateien")) # → deepseek-v4-pro

print(smart_chat("Schreibe eine Produkteinführung im klassischen chinesischen Stil")) # → deepseek-v4-pro

Hinweise zum Aufruf von Grok 4.3 und DeepSeek V4 Pro

| Hinweis | Grok 4.3 | DeepSeek V4 Pro |

|---|---|---|

| Modellfeld | grok-4.3 |

deepseek-v4-pro |

| Reasoning-Konfiguration | Standardmäßig aktiv | extra_body={"reasoning_effort": "low/medium/high/max"} |

| Video-Eingabefeld | video_url |

❌ Nicht unterstützt |

| Dokument-Ausgabefeld | extra_body={"output_format": "pdf/xlsx/pptx"} |

❌ Erfordert Nachbearbeitung |

| Streaming-Ausgabe | stream=True |

stream=True |

| Funktionsaufruf | ✅ Voll unterstützt | ✅ Voll unterstützt |

| Strukturierte Ausgabe | ✅ | ✅ |

| Max. Ausgabe pro Aufruf | Standard | 384K (erfordert explizite max_tokens Angabe) |

| Cache-Rabatt | 75% | Synchron mit Aktionszeitraum |

🎯 Empfehlung zur Anbindung: Wir empfehlen, zunächst einen Test-Schlüssel auf der APIYI-Plattform (apiyi.com) zu beantragen. Da DeepSeek V4 Pro und Grok 4.3 denselben API-Schlüssel nutzen, können Sie jeweils 50 reale Geschäftsbeispiele für einen A/B-Test durchführen, bevor Sie sich für eine vollständige Umstellung oder ein hybrides Scheduling entscheiden. Die Plattform unterstützt die Abrechnung in RMB und nutzungsbasierte Tarife, was ideal für die Finanzprozesse lokaler Teams ist.

Grok 4.3 vs. DeepSeek V4 Pro: Entscheidungsmatrix

Drei-Schritte-Entscheidungsverfahren

Der Auswahlprozess lässt sich in drei Schritte unterteilen, die in 90 Sekunden zum Ergebnis führen.

Schritt 1: Was ist Ihr primärer Aufgabentyp?

- Video / multimodal / Long-Chain Agent / Echtzeit-Vervollständigung → Bevorzugen Sie Grok 4.3

- Programmierung / chinesische Kontexte / lange Ausgaben / Anforderungen an Selbst-Deployment → Bevorzugen Sie DeepSeek V4 Pro

Schritt 2: Wie sieht Ihr Budget aus?

- Sehr sensibel (monatliches Budget < 300 $): Bevorzugen Sie DeepSeek V4 Pro während des Aktionszeitraums

- Mittel (monatliches Budget 300 $–3000 $): Hybride Architektur, DeepSeek als Hauptmodell + Grok für kritische Szenarien

- Ausreichend (monatliches Budget > 3000 $): Dreistufige Schichtung, ergänzt durch Claude Opus 4.7 als Fallback

Schritt 3: Haben Sie strenge Anforderungen an den Datenschutz?

- Ja (Finanzen / Medizin / Regierung): Zwingend DeepSeek V4 Pro, ggf. mit Selbst-Deployment

- Nein: Direkte Nutzung der API für minimale Kosten

Umfassende Entscheidungsmatrix

| Ihre Priorität | Empfohlene Wahl | Alternative |

|---|---|---|

| Maximale Kodiergenauigkeit | DeepSeek V4 Pro | Claude Opus 4.7 |

| Maximale multimodale Fähigkeiten | Grok 4.3 | (keine Alternative) |

| Maximaler Preisvorteil (Aktion) | DeepSeek V4 Pro | Grok 4 Fast |

| Maximale Reaktionsgeschwindigkeit | Grok 4.3 (207 tps) | Grok 4 Fast (235 tps) |

| Chinesische Kontexte | DeepSeek V4 Pro | — |

| Datenschutz / Selbst-Deployment | DeepSeek V4 Pro | — |

| Long-Chain Agenten | Grok 4.3 | — |

| Videoverarbeitung | Grok 4.3 | (keine Alternative) |

| Extrem lange Ausgabe (> 100k) | DeepSeek V4 Pro (384K) | — |

💡 Auswahlempfehlung: Die Wahl des Modells hängt maßgeblich von Ihrem spezifischen Anwendungsszenario und Ihrem Budgetfenster ab. Wir empfehlen, beide Modelle über die APIYI-Plattform (apiyi.com) anzubinden und einen A/B-Vergleich mit realen Geschäftsdaten durchzuführen. Dieser Ansatz hat sich bei den von uns betreuten Entwicklerteams bereits als Standard-Auswahlprozess etabliert.

Grok 4.3 vs. DeepSeek V4 Pro – Häufig gestellte Fragen (FAQ)

Q1: Sind DeepSeek V4 Pro und Grok 4.3 in China verfügbar?

Ja, beide. Beide Modelle sind über den API-Proxy-Dienst von APIYI (apiyi.com) verfügbar. Die base_url ist einheitlich https://vip.apiyi.com/v1, die Modellbezeichnungen lauten grok-4.3 bzw. deepseek-v4-pro. Der API-Proxy-Dienst ist auf mehreren inländischen Servern bereitgestellt, bietet stabile Latenzzeiten und erfordert keinen eigenen Proxy. Die Preise für Grok 4.3 entsprechen exakt denen der xAI-Website ($1,25/$2,50), während DeepSeek V4 Pro ohne Aufschlag zum offiziellen Preis (während der Aktionsphase $0,435/$0,87, regulär $1,74/$3,48) weitergegeben wird.

Q2: Was passiert nach Ablauf des 75%-Rabatts für DeepSeek V4 Pro?

Laut offizieller Ankündigung von DeepSeek endet die Aktion am 31.05.2026. Danach gilt der reguläre Preis von $1,74/$3,48, womit der Preisunterschied zu Grok 4.3 ($1,25/$2,50) gering ausfällt. Wir empfehlen, während der Aktionsphase möglichst viele Batch-fähige Offline-Aufgaben über DeepSeek abzuwickeln, um von den niedrigen Kosten zu profitieren, und nach Ende der Aktion die Architektur-Mischung neu zu bewerten. Auf der Plattform APIYI werden Preisänderungen automatisch synchronisiert; Sie müssen keine Konfigurationsanpassungen vornehmen.

Q3: Ist DeepSeek V4 Pro bei Programmieraufgaben Grok 4.3 in jeder Hinsicht überlegen?

Nicht unbedingt „überlegen“, aber es bietet strukturelle Vorteile. DeepSeek V4 Pro erreicht 80,6 % bei SWE-bench Verified, verglichen mit ca. 73 % bei Grok 4.3 – das entspricht in der Produktion etwa 7–8 zusätzlichen gelösten PRs pro 100 Aufgaben. Grok 4.3 ist jedoch bei mathematischen Schlussfolgerungen, komplexen Agenten-Workflows und der Echtzeit-Codevervollständigung in der IDE (2,6-mal schneller) stärker. Unsere Empfehlung: Nutzen Sie DeepSeek V4 Pro für „Batch-Codegenerierung und komplexes Refactoring“ und Grok 4.3 für „IDE-Vervollständigung, videobasierte Entwicklung und Agenten-Workflows“ mittels Hybrid-Routing über APIYI.

Q4: DeepSeek V4 Pro ist Open Source – ist eine eigene Bereitstellung kostengünstiger?

Nicht unbedingt. Eine Eigenbereitstellung erfordert einen 8×H200 GPU-Cluster (ca. $40.000 pro Karte), was Hardwarekosten von etwa $320.000 bedeutet. Hinzu kommen Strom, Wartung und Netzwerk, was die monatlichen Betriebskosten auf mindestens $5.000 treibt. Bei einem monatlichen Volumen von unter 5 Mrd. Tokens ist die API-Nutzung günstiger (während der Aktion ca. $5.450 für 5 Mrd. Tokens). Erst ab über 5 Mrd. Tokens pro Monat lohnt sich die Eigenbereitstellung. Unser Rat: Nutzen Sie zuerst die API über APIYI, um Ihr Geschäft zu skalieren, und evaluieren Sie den ROI für eine Eigenbereitstellung erst bei stabilen Volumina.

Q5: Welchen praktischen Nutzen hat die 384K-Ausgabe von DeepSeek V4 Pro?

Dies ist ideal für „umfangreiche Codegenerierung“, „Übersetzung ganzer Bücher“ oder „vollständige Berichterstellung“. Die Ausgabe von Grok 4.3 ist standardmäßig begrenzt (meist < 32K), was bei langen Texten ein Zusammenfügen mehrerer Anfragen erfordert und das Risiko von Kontextverlust birgt. DeepSeek V4 Pro kann 384K Tokens in einem Rutsch ausgeben, was die Generierung ganzer Python-Projekte, 100-seitiger technischer Berichte oder ganzer Romane ermöglicht. Dies ist ein Alleinstellungsmerkmal für „extrem lange Generierungen“.

Q6: Gibt es für die Videoeingabe von Grok 4.3 eine Alternative bei DeepSeek V4 Pro?

Keine native Lösung; man müsste Drittanbieter-Tools kombinieren. DeepSeek V4 Pro ist ein reines Textmodell. Für Videos müsste man zuerst Whisper für die Transkription und ein anderes Modell für die Bildanalyse nutzen und die Ergebnisse als Text an DeepSeek übergeben. Dieser Prozess wird bei Grok 4.3 in einer einzigen Anfrage erledigt. Wenn Ihr Projekt Videoverarbeitung erfordert, empfehlen wir direkt Grok 4.3 über APIYI, da dies die technische Komplexität um das 3- bis 5-Fache reduziert und kostengünstiger ist.

Q7: Wie lässt sich die hybride Steuerung von Grok 4.3 und DeepSeek V4 Pro technisch umsetzen?

Das ist sehr einfach und findet fast ausschließlich auf Konfigurationsebene statt. Beide Modelle sind mit dem OpenAI Chat Completions-Protokoll kompatibel und teilen sich dieselbe base_url und denselben API-Schlüssel. Der Kern der hybriden Steuerung ist eine Klassifizierungsfunktion in der Anwendungsschicht (20–30 Zeilen Python-Code), die je nach Aufgabentyp das Feld model auf grok-4.3 oder deepseek-v4-pro setzt. Die Migration dauert weniger als einen Tag, und das Guthaben wird auf APIYI zentral verwaltet.

Q8: Was sollten datenschutzsensible Kunden wählen?

Wir empfehlen dringend die Eigenbereitstellung von DeepSeek V4 Pro. Die MIT-Lizenz erlaubt die kommerzielle Nutzung, und die Modellgewichte sind auf Hugging Face öffentlich zugänglich. Sie können das Modell in Ihrem internen Netzwerk bereitstellen, ohne dass Daten das Unternehmen verlassen. Grok 4.3 ist proprietär und nicht selbst bereitstellbar; es erfordert die API-Nutzung, was Compliance-Anforderungen wie „Daten dürfen das Unternehmen nicht verlassen“ ausschließt. Für Finanz-, Medizin- oder Regierungssektoren ist DeepSeek V4 Pro die einzige Wahl, die „Top-Präzision + volle Kontrolle“ vereint.

Q9: Wie wählt man zwischen Thinking- und Non-Thinking-Modus bei DeepSeek V4 Pro?

Wählen Sie nach Aufgabenkomplexität. Der Non-Thinking-Modus eignet sich für strukturierte Aufgaben wie „einfache Fragen, Datenformatkonvertierung, SQL-Generierung, Batch-Übersetzung“ – er ist schnell und günstig. Der Thinking-Modus ist für Aufgaben mit Chain-of-Thought-Bedarf wie „komplexes Refactoring, mehrstufige Schlussfolgerungen, mathematische Probleme, Tiefenanalysen“ gedacht, bietet höhere Präzision, verbraucht aber mehr Tokens. Auf APIYI steuern Sie dies über extra_body={"reasoning_effort": "low/medium/high/max"}. Wir empfehlen, mit medium zu starten und bei unzureichender Qualität auf high oder max zu erhöhen.

Q10: Wer ist bei langem Kontext (>200k) stärker: Grok 4.3 oder DeepSeek V4 Pro?

Das hängt vom Aufgabentyp ab. Die MoE-Architektur von DeepSeek V4 Pro weist bei langem Kontext deutlich geringere FLOPs auf (73 % weniger als V3.2), was die Kosten optimiert. Grok 4.3 zeigt bei Vending-Bench-Daten für komplexe Agenten-Szenarien bessere Ergebnisse. Für „einmalige lange Zusammenfassungen, Suche in langen Dokumenten, kapitelübergreifende Fragen“ bietet DeepSeek V4 Pro ein besseres Preis-Leistungs-Verhältnis. Für „langkettige Entscheidungsfindungen und mehrstufige Tool-Aufrufe“ ist Grok 4.3 stabiler. Wir empfehlen, eigene Stichproben auf APIYI für einen A/B-Vergleich zu nutzen.

Fazit: Die richtige Wahl zwischen Grok 4.3 und DeepSeek V4 Pro

Im Kern geht es bei diesem Vergleich nicht darum, „wer besser ist“, sondern um zwei unterschiedliche Produktstrategien: xAI hebt mit Grok 4.3 Multimodalität (Video) und langkettige Agenten auf ein neues Niveau, während DeepSeek mit V4 Pro die Messlatte für Open-Source-Codemodelle höher legt und mit dem 75%-Rabatt die kurzfristige Kostenkurve neu definiert.

Kurz gefasst: Für Programmierung und chinesische Kontexte wählen Sie DeepSeek V4 Pro, für Multimodalität und langkettige Agenten Grok 4.3. Die meisten Teams sollten beide Modelle hybrid einsetzen. DeepSeek V4 Pro ist mit 80,6 % SWE-bench, dem Aktionspreis und 384K-Ausgabe die erste Wahl für Coding-Aufgaben. Grok 4.3 ist mit Videoeingabe, Dokumentengenerierung und 207 tps Geschwindigkeit der ideale Ausgangspunkt für multimodale Agenten-Szenarien.

Für chinesische Entwickler ist die Implementierung über den API-Proxy-Dienst von APIYI der reibungsloseste Weg. Da beide Modelle dieselbe base_url und denselben API-Schlüssel nutzen, ist der Anpassungsaufwand minimal. Nutzen Sie die 75%-Aktion von DeepSeek bis zum 31.05.2026 und kombinieren Sie dies mit Batch-API-Rabatten, um die Kosten auf unter 10 % von „Claude Opus 4.7“ zu senken.

Empfehlung: Nutzen Sie das Rabattfenster für DeepSeek V4 Pro bis Ende Mai, führen Sie Batch-Coding-Aufgaben dort aus und verlagern Sie Video- sowie Echtzeit-Agenten-Aufgaben auf Grok 4.3. Testen Sie 100 reale Geschäftsbeispiele auf beiden Modellen über APIYI, um das optimale Mischverhältnis für Ihre spezifischen Anforderungen zu finden.

Referenzen

-

Offizielle DeepSeek API-Dokumentation: Vollständige Spezifikationen und Preisgestaltung für V4 Pro

- Link:

api-docs.deepseek.com/quick_start/pricing - Beschreibung: Enthält Informationen zu Aktionszeiträumen, Listenpreisen und dem Reasoning-Modus.

- Link:

-

DeepSeek V4 Pro Veröffentlichungsankündigung: Modellarchitektur und Benchmarks

- Link:

api-docs.deepseek.com/news/news260424 - Beschreibung: MoE 1.6T, SWE-bench und Erläuterungen zum Dual-Modus.

- Link:

-

Hugging Face Modellgewichte: Open-Source-Version von DeepSeek V4 Pro

- Link:

huggingface.co/deepseek-ai/DeepSeek-V4-Pro - Beschreibung: Download der Modellgewichte unter der MIT-Lizenz.

- Link:

-

Offizielle xAI Modelldokumentation: Vollständige API-Spezifikationen für Grok 4.3

- Link:

docs.x.ai/developers/models - Beschreibung: Multimodalität, Videoeingabe und Dokumentengenerierung.

- Link:

-

Artificial Analysis Intelligenz-Ranking: Umfassender Leistungs- und Preisvergleich zwischen Modellen

- Link:

artificialanalysis.ai/models/deepseek-v4-pro - Beschreibung: Umfassende Bewertung von Intelligenzindex, Geschwindigkeit und Preis.

- Link:

-

OpenRouter Echtzeit-Preistabelle: Direkter Vergleich zwischen DeepSeek V4 Pro und Grok 4.3

- Link:

openrouter.ai/deepseek/deepseek-v4-pro - Beschreibung: Echtzeit-Preise und Latenzüberwachung.

- Link:

-

APIYI Integrationsdokumentation: Vollständiges Tutorial zur Anbindung beider Modelle über unseren API-Proxy-Dienst

- Link:

help.apiyi.com - Beschreibung: Enthält Modellfelder, SDK-Beispiele und Abfrage der Abrechnung.

- Link:

Autor: APIYI Team — Wir sind spezialisiert auf API-Proxy-Dienste für große Sprachmodelle und unterstützen Entwickler dabei, führende Modelle wie Grok 4.3, DeepSeek V4 Pro und Claude Opus 4.7 mit nur einem Klick einzubinden. Besuchen Sie APIYI unter apiyi.com, um ein kostenloses Testguthaben zu erhalten.