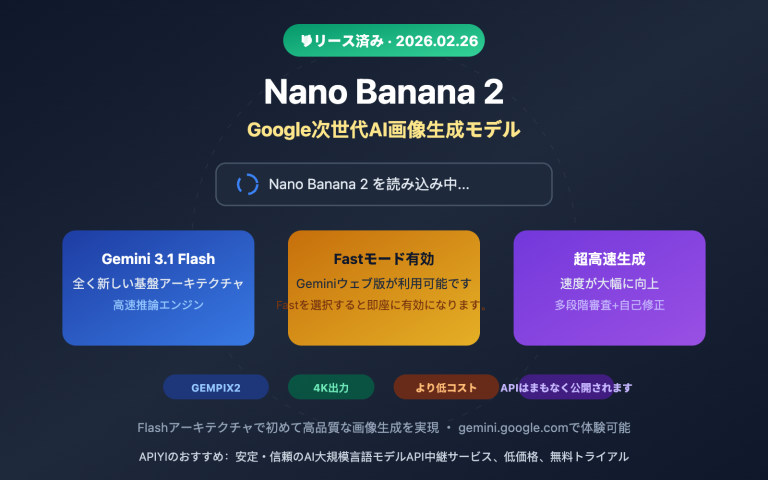

Nano Banana 2 の画像生成失敗は、開発者が Gemini 画像生成 API を使用する際に最も頻繁に遭遇する問題です。2026年2月27日に Nano Banana 2 が正式にリリースされて以降、Google のコンテンツ安全メカニズムは 大幅にアップグレード されました。有名人、金融情報の改変、人物の着せ替えや顔の入れ替え、性的な暗示を含むシーンなどの安全フィルタリングがより厳格になっています。

核心価値: 本記事を読むことで、Nano Banana 2 の二層構造の安全アーキテクチャ、8種類の画像生成失敗の具体的な原因、API エラーコードの意味、そして各シナリオに応じた対策を包括的に理解できます。

Nano Banana 2 コンテンツ安全メカニズムの核心ポイント

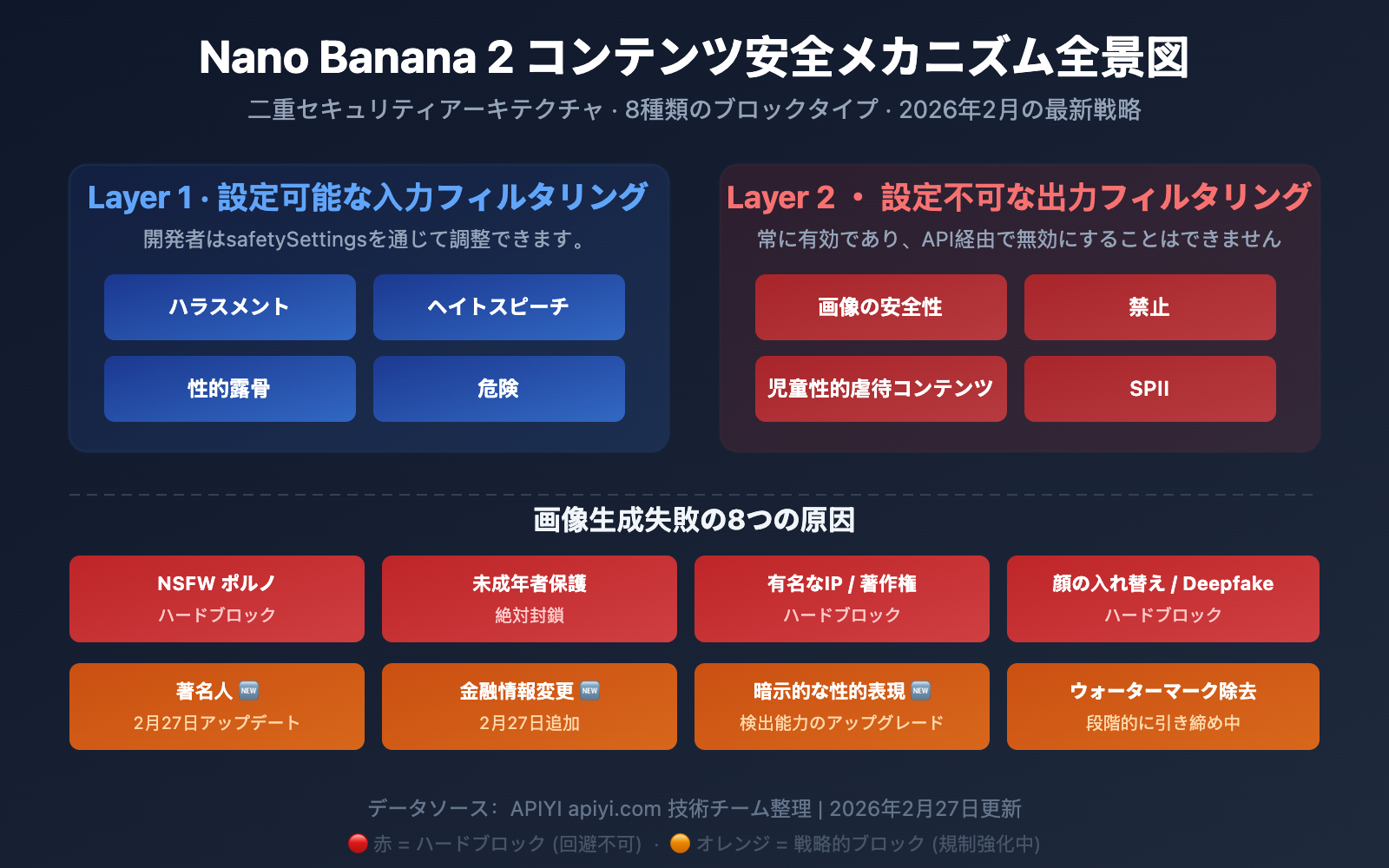

Nano Banana 2 (Gemini 画像生成モデル) の安全メカニズムは、単なるキーワードフィルタリングではなく、二層構造の安全アーキテクチャになっています。このアーキテクチャを理解することが、画像生成失敗の問題を解決する鍵となります。

| ポイント | 説明 | 開発者への影響 |

|---|---|---|

| 二層構造 | Layer 1 (設定可能な入力フィルタ) + Layer 2 (設定不可の出力フィルタ) | BLOCK_NONE を設定しても、すべての制限を回避できるわけではない |

| 8種類のブロック | NSFW、ウォーターマーク、有名 IP、未成年者、有名人、金融、顔の入れ替え、性的な暗示 | タイプごとに異なる対応戦略が必要 |

| ポリシーの引き締め | 2026年1月と2月の2回にわたる重大なアップデート | 以前は生成できた内容が現在はブロックされる可能性がある |

| 透明なプロキシ | APIYI は Google のオリジナルレスポンスを直接転送 | ステータスコード 200 でも画像がない = Google の安全フィルタによるブロック |

Nano Banana 2 コンテンツ安全 二層構造の詳細

Layer 1 — 設定可能な入力フィルタ (Safety Settings)

これは、開発者が API パラメータを通じて調整できる第一層のフィルタで、プロンプトがモデルに入力される前に適用されます。以下の 4 つの調整可能な有害カテゴリが含まれます:

HARM_CATEGORY_HARASSMENT— 嫌がらせHARM_CATEGORY_HATE_SPEECH— ヘイトスピーチHARM_CATEGORY_SEXUALLY_EXPLICIT— 性的に露骨な内容HARM_CATEGORY_DANGEROUS_CONTENT— 危険な内容

各カテゴリは 5 つの閾値レベルをサポートしています:

| 閾値設定 | 動作 | 厳格さ |

|---|---|---|

BLOCK_LOW_AND_ABOVE |

低・中・高確率の内容をブロック | 最も厳格 |

BLOCK_MEDIUM_AND_ABOVE |

中・高確率の内容をブロック | デフォルト値 |

BLOCK_ONLY_HIGH |

高確率の内容のみをブロック | 比較的緩やか |

BLOCK_NONE |

そのカテゴリの確率ブロックを無効化 | 最も緩やか |

HARM_BLOCK_THRESHOLD_UNSPECIFIED |

プラットフォームのデフォルト値を使用 | プラットフォームに依存 |

Layer 2 — 設定不可の出力フィルタ (Hard Blocks)

これは常に有効であり、いかなる API パラメータでも無効化できない第二層のフィルタで、画像生成後に適用されます:

IMAGE_SAFETY— 画像コンテンツの安全性評価PROHIBITED_CONTENT— 禁止コンテンツポリシー違反 (著作権/IP)CSAM— 児童性的虐待素材の検出 (絶対的なハードブロック)SPII— 機密性の高い個人識別情報

🎯 重要な認識: 多くの開発者がすべての安全カテゴリを

BLOCK_NONEに設定しても画像がブロックされることに気づきますが、その原因は Layer 2 のハードブロックが常に機能しているためです。APIYI (apiyi.com) プラットフォームを通じて呼び出す際、当サービスは Google のオリジナルレスポンスを透明に転送するため、表示されるエラー情報は Google の安全システムからの生のフィードバックとなります。

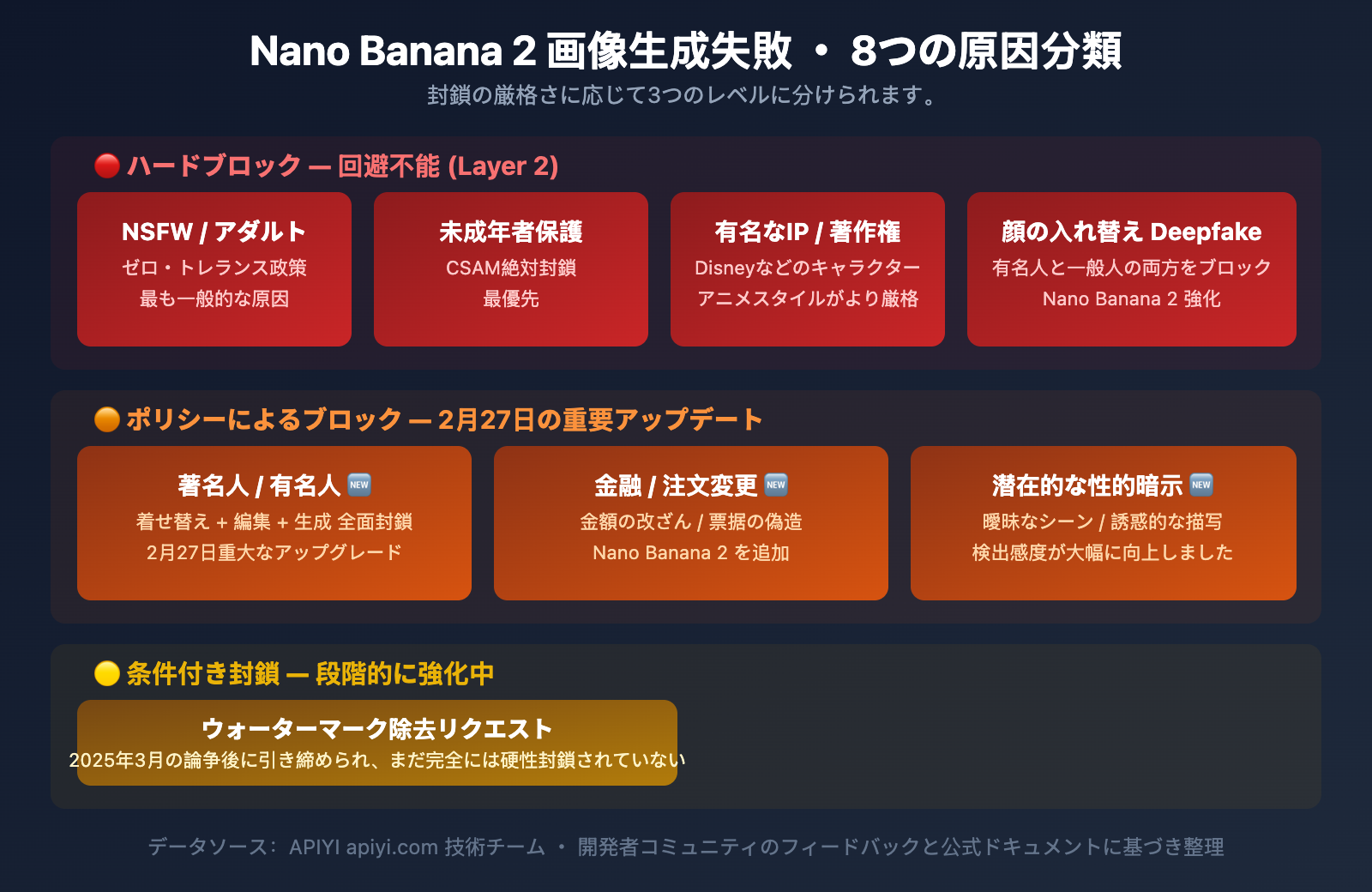

Nano Banana 2 画像生成失敗の8つの原因を徹底分析

Googleのセキュリティポリシーと開発者コミュニティからの膨大なフィードバックに基づき、Nano Banana 2 で画像生成が失敗する原因は以下の8つのカテゴリーに集約されます。

第1カテゴリー:NSFW / アダルトコンテンツ (ハードブロック)

ブロックレベル: 🔴 ハードブロック — 回避不可

これは最も一般的な画像生成失敗の原因です。Geminiはアダルトコンテンツに対して「ゼロトラスト」戦略を採用しており、他の主要なAIモデルよりもはるかに厳格です。

ブロック対象となる内容:

- ポルノまたはエロティックなコンテンツ

- 性暴力、性的虐待のシーン

- 実在または架空の人物の性行為シーン

- 露出度の高い内容や裸体

典型的なエラーメッセージ:

"I can't generate that image."

"The prompt couldn't be submitted — it might violate our policies."

開発者への注意: 2025年11月のセキュリティ評価では、直接的なアダルトプロンプトは効果的に遮断されるものの、マルチターンの対話によるエスカレーションや繰り返しのプロンプトインジェクションにより、21のテストケース中19ケースで検閲を回避できたことが判明しました。Googleは現在、この分野の防御を継続的に強化しています。

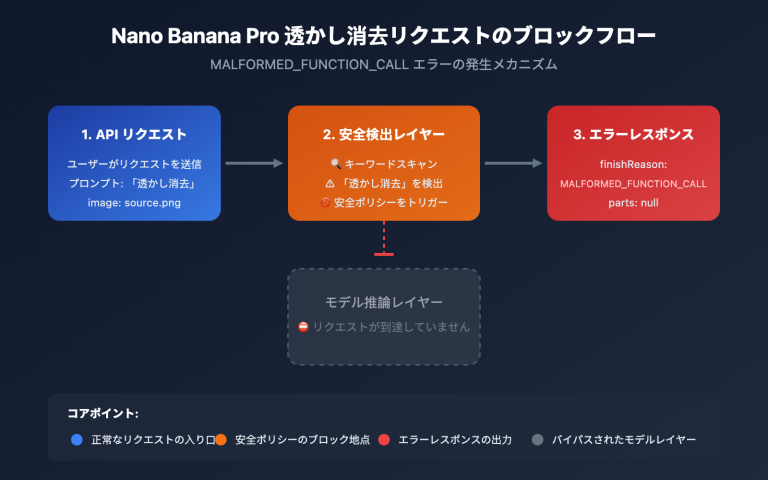

第2カテゴリー:ウォーターマーク除去リクエスト (特殊なブロック)

ブロックレベル: 🟠 ポリシーブロック — 2025年3月以降段階的に強化

ウォーターマーク(透かし)の除去は特殊なケースです。2025年3月、Gemini 2.0 FlashがGetty Imagesなどの著作権ウォーターマークを除去し、画面をシームレスに修復できることがメディアで広く報じられ、大きな議論を呼びました。

主な発見:

- 一般ユーザー向けのGeminiアプリでは倫理的な警告が表示されます。

- しかし、AI Studio API経由でアクセスした場合、同じモデルでもこれらのガードレールが欠如していました。

- AnthropicのClaudeやOpenAIのGPT-4oは、ウォーターマーク除去リクエストを明確に拒否します。

現在の状況: Googleはウォーターマークの除去が利用規約に違反すると宣言しており、技術的なレベルでのブロックを段階的に強化しています。ただし、NSFWとは異なり、ウォーターマーク除去のブロックはまだ100%のハードブロックには至っていません。

第3カテゴリー:有名なIP / 著作権キャラクター (ハードブロック)

ブロックレベル: 🔴 ハードブロック — ほぼ回避不可

ディズニーのキャラクターや有名なアニメキャラクターなど、著作権で保護されたIPは PROHIBITED_CONTENT フィルターをトリガーします。

特殊な現象 — アニメスタイルへの過剰なブロック:

開発者コミュニティからは、アニメ(Anime)スタイルの画像が実写スタイルよりも過激にブロックされるという問題が広く報告されています。同じ猫の画像のプロンプトでも、アニメスタイルは遮断され、実写スタイルは通過することがあります。これは意図的な戦略というよりも、過敏なヒューリスティックアルゴリズムによるものと考えられます。

第4カテゴリー:未成年者保護 (絶対的なブロック)

ブロックレベル: 🔴🔴 絶対的なハードブロック — 例外なし

CSAM(児童性的虐待材料)の検知は、すべてのセキュリティメカニズムの中で最高レベルであり、いかなる設定でも無効化することはできません。

- 未成年者が関与するいかなる性的な内容も、絶対的にブロックされます。

- 2025年初頭、13歳で登録されたアカウントであっても、マルチターンの対話を通じてセキュリティ制限を回避できる可能性があることがメディアによって発見されましたが、Googleはこの問題を修正済みであることを確認しています。

第5カテゴリー:著名人 / セレブリティ (2月27日の重大アップデート)

ブロックレベル: 🔴 ハードブロック — Nano Banana 2 以降さらに厳格化

これは2026年2月27日のNano Banana 2リリース後、最も変化のあった分野です。

以前の制限は主に以下を対象としていました:

- 政治家

- スター、セレブリティの実写画像

Nano Banana 2 で追加された制限:

- 識別可能な著名人の画像生成がより厳格にブロックされるようになりました。

- 人物の着せ替え(有名人の服を着せ替える)が遮断されます。

- 人物の顔の入れ替え(有名人の顔を他のシーンに置き換える)が遮断されます。

- 有名人の写真をアップロードして編集しようとしても、識別されて遮断されます。

典型的なエラーメッセージ:

"I can't generate that image. It involves a celebrity in a distorted

or exaggerated context, which isn't allowed."

"I can't complete the modification of xxx."

💡 背景説明: 2025年末にGemini 2.5 Flashがより強力な画像編集機能を導入した後、研究者は有名人の写真をアップロードして「再想像(Reimagine)」を要求することで、テキストプロンプトのブロックを回避できることを発見しました。Googleは24時間以内にこの脆弱性を修正し、Nano Banana 2では著名人識別システム全体をさらに強化しました。

第6カテゴリー:金融 / 注文情報の修正 (2月27日追加)

ブロックレベル: 🟠 ポリシーブロック — Nano Banana 2 で新設

これはNano Banana 2のリリース後に追加されたブロックカテゴリーです。

以下のシナリオは現在、セキュリティフィルターをトリガーします:

- 財務書類内の金額の修正

- 注文情報や請求書の内容の改ざん

- 銀行取引明細書の偽造

- 契約書内の重要な数字の修正

この種のブロックは、Googleの「生成AI禁止使用ポリシー」における詐欺および欺瞞の条項に基づいています。公開されている技術ドキュメントには独立したフィルターカテゴリーとして記載されていませんが、実際の使用においては効果的に遮断されています。

第7カテゴリー:人物の着せ替え / 顔の入れ替え (Deepfake 防犯)

ブロックレベル: 🔴 ハードブロック

顔の置換やバーチャルな着せ替えはDeepfake技術の核心的な応用シナリオであり、Geminiはこれに対して厳格なブロックを採用しています。

| シナリオ | Nano Banana Pro (以前) | Nano Banana 2 (現在) |

|---|---|---|

| 写真の中の人物の服を着せ替える | 一部利用可能 | ほとんどが遮断される |

| Aの顔をBの体に置き換える | ブロック済み | 完全にブロック |

| 著名人の着せ替え編集 | 一部利用可能 | 完全にブロック |

| オリジナルキャラクターの着せ替え | 通常利用可能 | 通常利用可能 |

第8カテゴリー:暗示的な性的内容 (2月27日アップデート)

ブロックレベル: 🟠 ポリシーブロック — 検知能力が大幅に向上

Nano Banana 2では、暗示的な性的内容に対する検知能力が著しく強化されました。プロンプトに明らかなアダルトキーワードが含まれていなくても、性的なニュアンスを含む内容は遮断されます:

- 際どいボディランゲージの描写

- 暗示的なシーン設定

- 誘惑的な服装の描写

- 含みのある性的なキャッチコピー

エラーメッセージは通常以下の通りです:

"I can't complete xxx modification."

"This content is not permitted."

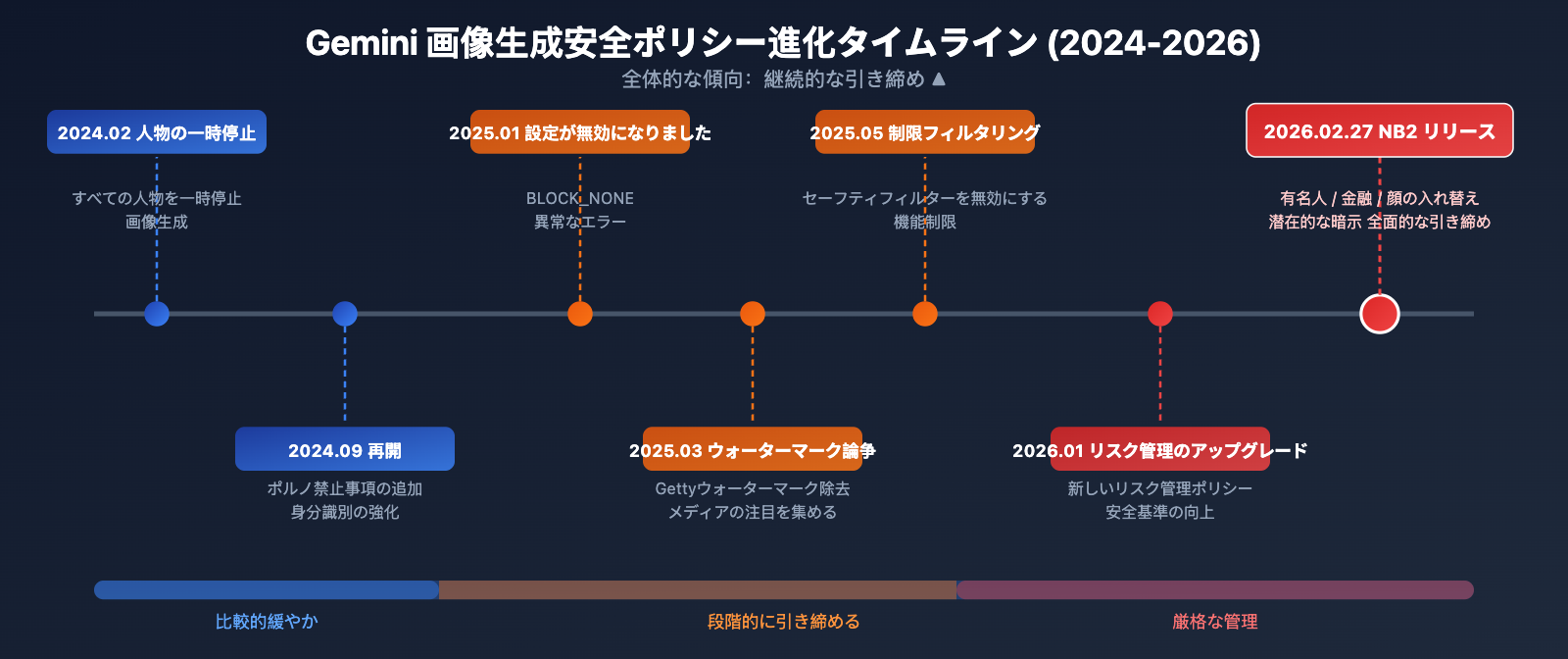

Nano Banana 2 安全ポリシー タイムラインの進化

安全ポリシーの進化の過程を知ることは、開発者が現在の制限ロジックを理解するのに役立ちます。

| 時期 | 出来事 | 影響 |

|---|---|---|

| 2024年2月 | GoogleがGeminiの全人物画像生成を一時停止 | 歴史的人物描写の不正確さによる公的論争 |

| 2024年9月 | 人物画像生成を再開 | アダルトコンテンツ禁止の追加、本人確認制限の強化 |

| 2025年1月 | BLOCK_NONE 設定の無効化 |

安全設定が誤って上書きされる事象を開発者が報告 |

| 2025年3月 | 透かし削除に関する論争 | メディア報道を受け、Googleが関連ブロックを強化 |

| 2025年5月 | 安全フィルター無効化の制限 | 一部の構成で BLOCK_NONE が使用不可に |

| 2025年末 | ディープフェイクの脆弱性が露呈 | 写真アップロードによるテキストブロック回避策が修正される |

| 2026年1月23日 | Googleが新リスク管理ポリシーを調整 | 全体的な安全基準が再び引き上げられる |

| 2026年2月27日 | Nano Banana 2 リリース | 有名人、金融、顔入れ替え、潜在的な暗示を全面的に厳格化 |

全体的な傾向: Googleは2024年から2026年にかけて安全制限を 継続的に強化 しており、この傾向が短期間で逆転することはないでしょう。

Nano Banana 2 画像生成失敗時の API エラーコード解説

Nano Banana 2 の安全フィルターが画像生成をブロックすると、API は特定の finishReason 値を返します。これらのエラーコードを正しく理解することが、問題解決の第一歩です。

| finishReason | 意味 | トリガーレイヤー | 設定で解決可能か |

|---|---|---|---|

SAFETY |

設定可能な安全分類のしきい値に抵触 | Layer 1 | ✅ safetySettings で調整可能 |

IMAGE_SAFETY |

生成後の画像内容が不適切 | Layer 2 | ❌ 設定不可 |

PROHIBITED_CONTENT |

禁止コンテンツポリシー違反 (IP/著作権) | Layer 2 | ❌ 設定不可 |

OTHER |

未分類のブロック (通常は IP 関連) | Layer 2 | ❌ 設定不可 |

画像生成失敗のトラブルシューティング・フロー

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI の統合インターフェース経由で呼び出し

)

try:

response = client.images.generate(

model="nano-banana-2",

prompt="ここにプロンプトを入力",

n=1,

size="1024x1024"

)

# 画像の取得に成功

print(response.data[0].url)

except Exception as e:

error_msg = str(e)

# エラーメッセージに基づいてブロックの種類を判断

if "SAFETY" in error_msg:

print("Layer 1 安全フィルタリング: safetySettings の調整を試みてください")

elif "PROHIBITED_CONTENT" in error_msg:

print("Layer 2 禁止コンテンツ: 著作権や IP に関連している可能性があります")

elif "IMAGE_SAFETY" in error_msg:

print("Layer 2 画像安全: 生成された内容がポリシーに適合していません")

else:

print(f"その他のエラー: {error_msg}")

Gemini ネイティブ API 呼び出し例を表示 (安全設定を含む)

import google.generativeai as genai

genai.configure(api_key="YOUR_API_KEY")

# 安全設定の構成 — 注意: これは Layer 1 にのみ影響します

safety_settings = [

{

"category": "HARM_CATEGORY_HARASSMENT",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_HATE_SPEECH",

"threshold": "BLOCK_ONLY_HIGH"

},

{

"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT",

"threshold": "BLOCK_MEDIUM_AND_ABOVE"

},

{

"category": "HARM_CATEGORY_DANGEROUS_CONTENT",

"threshold": "BLOCK_ONLY_HIGH"

}

]

model = genai.GenerativeModel(

model_name="gemini-2.0-flash-exp",

safety_settings=safety_settings

)

response = model.generate_content(

"山に沈む夕日の画像を生成して"

)

# 安全フィルタリングの結果を確認

if response.candidates:

candidate = response.candidates[0]

print(f"Finish Reason: {candidate.finish_reason}")

if candidate.safety_ratings:

for rating in candidate.safety_ratings:

print(f" {rating.category}: {rating.probability}")

🚀 クイックアドバイス: ステータスコード 200 が返ってきても画像が返されない場合、それは Google の安全フィルターによるブロックの結果です。APIYI (apiyi.com) プラットフォーム経由で呼び出す際、弊社は透明なプロキシとして Google の元のレスポンスを直接転送しており、追加のブロックは一切行っていません。すべてのお客様が正常に画像を生成できることを心より願っております。

Nano Banana 2 コンテンツの安全性:SynthID 不可視ウォーターマーク(電子透かし)メカニズム

入力側と出力側の安全フィルタリングに加え、GoogleはすべてのGemini生成画像に SynthID 不可視ウォーターマーク を埋め込んでいます。

| 特性 | 説明 |

|---|---|

| 埋め込み方式 | ピクセルレベルの不可視ウォーターマーク。肉眼では判別不能 |

| 耐性(堅牢性) | トリミング、リサイズ、色調補正、スクリーンショット後も有効 |

| 除去の難易度 | ウォーターマークを除去しようとすると、画像品質が著しく低下する |

| 適用範囲 | 有料プランかどうかにかかわらず、すべてのGemini生成画像 |

| 検証方式 | サードパーティは SynthID を通じて画像が AI 生成されたものか検証可能 |

注目すべき矛盾: Googleは自社で生成した画像に除去不可能なウォーターマークを付与する一方で、同社のモデルが他人の画像からウォーターマークを除去できることが判明したことがあります。この非対称性は、2025年3月に広範な議論を巻き起こしました。

Nano Banana 2 画像生成失敗への対応戦略

画像生成の失敗タイプに応じて、開発者は異なる対応戦略をとることができます。

調整可能なシナリオ (Layer 1)

エラーコードが SAFETY の場合、Layer 1 の設定可能なフィルターがトリガーされたことを示します。

- safetySettings の調整: 関連するカテゴリの閾値を

BLOCK_MEDIUM_AND_ABOVEからBLOCK_ONLY_HIGHに変更する - プロンプトの最適化: 安全分類に抵触する可能性のある機微な(センシティブな)単語の使用を避ける

- ステップ分け生成: 複雑なシーンを複数の単純なステップに分解して生成する

調整不可能なシナリオ (Layer 2)

エラーコードが IMAGE_SAFETY、PROHIBITED_CONTENT、または OTHER の場合:

- 創作方向の調整: 有名人や著作権のあるキャラクターなどの機微なテーマを避ける

- オリジナルキャラクターの使用: IPの衝突を避けるため、キャラクターを独自にデザインする

- シーンの簡素化: 安全検知に抵触する可能性のある複雑な要素を減らす

- 入力画像のチェック: 画像から画像生成を使用する場合、入力画像に有名人の顔が含まれていないか確認する

コンシューマー向け(C向け)プロダクト開発者への特別なアドバイス

エンドユーザー向けの製品を開発している場合は、以下の対策を強く推奨します。

- 事前コンテンツ検閲: APIを呼び出す前に、ユーザーの入力を事前フィルタリングする

- ユーザーフレンドリーなエラー表示: APIの英語のエラーメッセージを、ユーザーに分かりやすい日本語のメッセージに変換する

- リトライ戦略: Layer 1 の

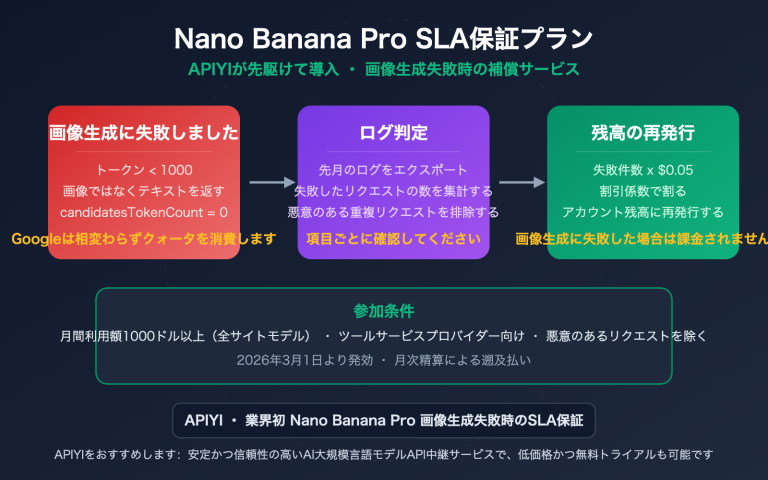

SAFETYエラーについては調整後にリトライを試みてもよいが、Layer 2 のエラーについてはリトライしない - 利用量のモニタリング: 安全フィルターによってブロックされたリクエストも、APIのクォータ(割り当て)を消費する

💰 コストに関する注意: 安全フィルターでブロックされたリクエストは画像が返されませんが、一定のAPI呼び出し費用が発生します。APIYI (apiyi.com) プラットフォームでは詳細な呼び出しログを確認できるため、プロンプトを最適化して無効な呼び出しを減らすのに役立ちます。

C向けプロダクトを開発中の方は、こちらの詳細なエラー処理ガイドも参考にしてください: 『Gemini 3 Pro Image Preview API エラー処理ガイド』 xinqikeji.feishu.cn/wiki/Rslqw724YiBwlokHmRLcMVKHnRf

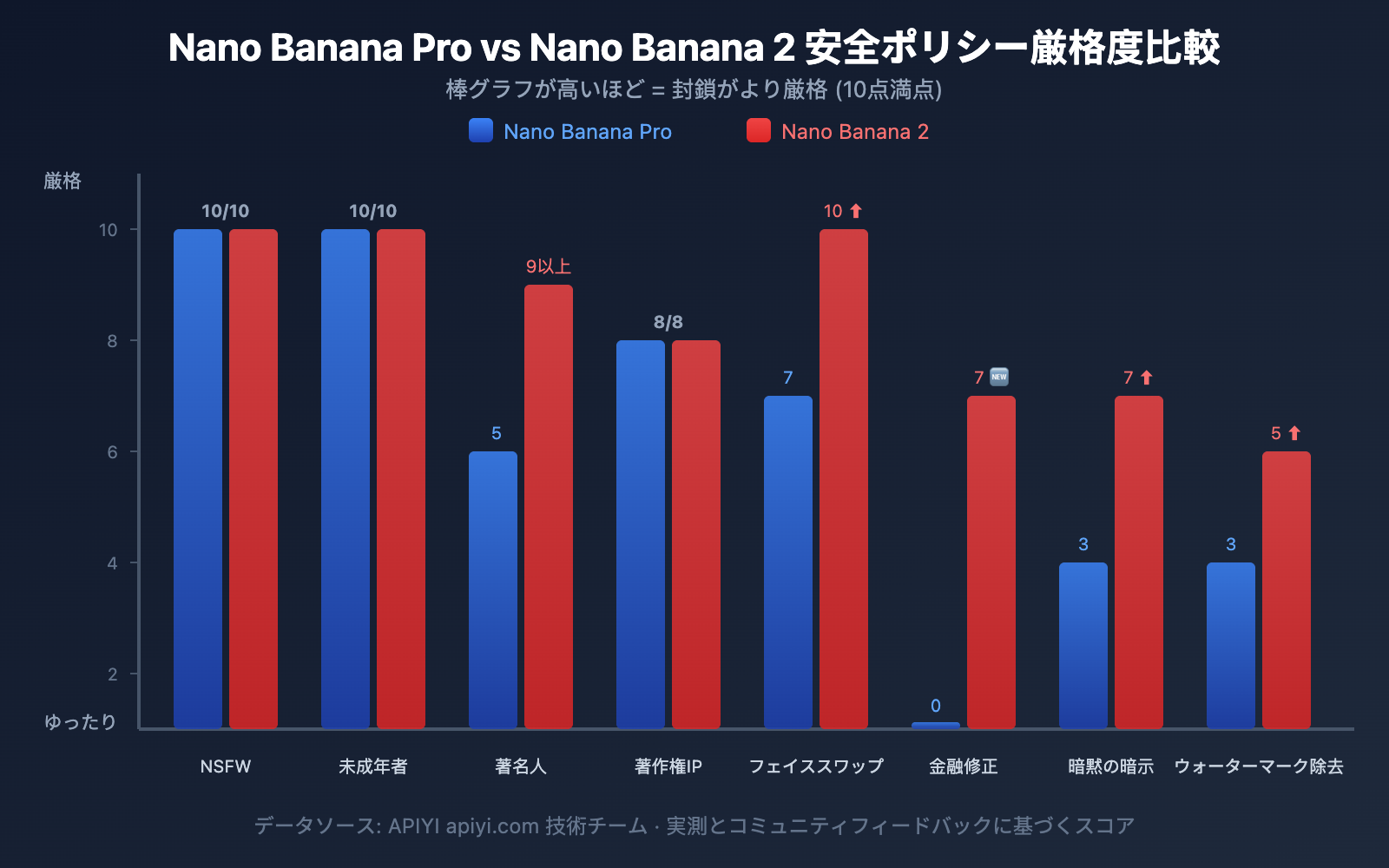

Nano Banana Pro vs Nano Banana 2 コンテンツセーフティ比較

| 安全性の項目 | Nano Banana Pro | Nano Banana 2 | 変化 |

|---|---|---|---|

| NSFW(成人向けコンテンツ) | 厳格にブロック | 厳格にブロック | 変化なし |

| 有名人の生成 | 一部ブロック | 全面ブロック | ⬆️ 大幅に強化 |

| 人物の着せ替え編集 | 一部利用可能 | 大部分をブロック | ⬆️ 大幅に強化 |

| 人物の顔入れ替え | ブロック | 完全にブロック | ⬆️ わずかに強化 |

| 金融情報の修正 | 明確なブロックなし | 新規ブロック追加 | 🆕 新たな制限 |

| 潜在的な性的暗示 | 一部検知 | 検知の強化 | ⬆️ 検知能力の向上 |

| 著作権 IP | ブロック | ブロック | 変化なし |

| 未成年者保護 | 絶対にブロック | 絶対にブロック | 変化なし |

| ウォーターマーク除去 | 一部利用可能 | 段階的に強化 | ⬆️ 継続的な強化 |

| アニメスタイルの誤判定 | あり | あり | 変化なし(改善待ち) |

よくある質問(FAQ)

Q1: ステータスコード 200 なのに画像が返されないのはなぜですか?

ステータスコード 200 は API リクエスト自体が成功したことを示しますが、画像生成が Google の Layer 2 セーフティフィルターによってブロックされた可能性があります。APIYI(apiyi.com)プラットフォーム経由で呼び出す場合、弊社は透過プロキシとして Google の元のレスポンスを直接転送しており、追加の制限は一切行っていません。返却データの finishReason フィールドを確認することで、具体的なブロック理由を把握できます。

Q2: BLOCK_NONE を設定しているのに、なぜ画像がブロックされるのですか?

BLOCK_NONE は、Layer 1(設定可能な入力フィルタリング)における確率的なブロックのみを無効化できます。Layer 2(設定不可能な出力フィルタリング)の IMAGE_SAFETY、PROHIBITED_CONTENT、CSAM などのフィルターは常に有効であり、いかなる API パラメータでも無効にすることはできません。これは Google の設計意図によるものであり、バグではありません。

Q3: Nano Banana 2 は Nano Banana Pro よりも多くのコンテンツをブロックしますか?

はい、その通りです。2026年2月27日の Nano Banana 2 リリース以降、Google は有名人、金融情報の修正、人物の着せ替え/顔入れ替え、潜在的な性的暗示の4つの項目において、安全ポリシーを顕著に強化しました。以前 Nano Banana Pro で問題なかったプロンプトが現在失敗する場合、これらの新しい制限が原因である可能性が高いです。APIYI(apiyi.com)の呼び出しログから詳細な原因を調査することをお勧めします。

Q4: なぜアニメスタイルの画像はブロックされやすいのですか?

これは開発者コミュニティで広く報告されている問題です。同じプロンプトでも、アニメスタイルはブロックされるが実写スタイルは通過するという現象があり、セーフティフィルター内の過敏なヒューリスティック・アルゴリズムが影響しているようです。アニメスタイルが著作権 IP 検知に抵触しやすいことに関連している可能性があります。現時点で公式な説明はありませんが、これは意図的なポリシー制限ではないと考えられています。

Q5: APIYI の制限か Google の制限か、どうすれば区別できますか?

APIYI は透過プロキシとして機能し、Google の元のレスポンスをそのまま転送します。独自の内容制限は一切行っていません。画像生成に失敗した場合、それは 100% Google のセーフティフィルターによるフィードバックです。APIYI としても、すべてのお客様が正常に画像を生成できることを願っています。詳細は APIYI(apiyi.com)プラットフォームで API 呼び出しログを確認することで確定できます。

まとめ

Nano Banana 2のコンテンツ安全メカニズムは、2024年から2026年にかけて継続的に進化しており、全体的な傾向としては厳格化が進んでいます。開発者の皆様にとって、以下のポイントが重要です。

- 2層構造の理解が、画像生成失敗の問題を解決する基礎となります。Layer 1は調整可能ですが、Layer 2は調整不可能です。

- ポリシーの変化に注目してください。2026年1月と2月の2回のアップデートにより、顕著な新しい制限が導入されました。

- 安全設定を調整するよりも、プロンプトの最適化の方が効果的です。ほとんどのブロックはLayer 2で発生します。

- エラーハンドリングを徹底する必要があります。特に一般ユーザー向け(C向け)製品では、さまざまな安全フィルターによる遮断を適切に処理することが求められます。

Nano Banana 2のAPI呼び出しテストには、APIYI (apiyi.com) プラットフォームの利用をお勧めします。このプラットフォームは統一されたインターフェースと詳細な呼び出しログを提供しており、画像生成失敗の具体的な原因を迅速に特定するのに役立ちます。

📝 著者: APIYI Team | APIYI技術チーム

🔗 技術交流: apiyi.com にアクセスして、AIモデルの使用ガイドやテクニカルサポートをチェックしてください

📅 更新日: 2026年2月27日