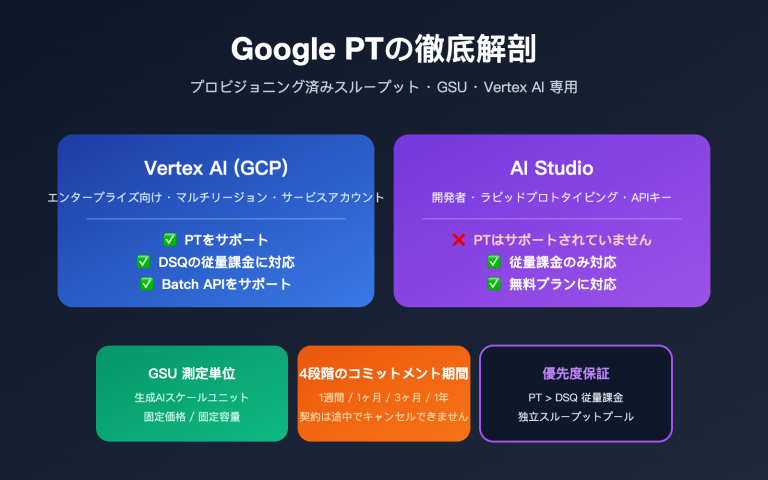

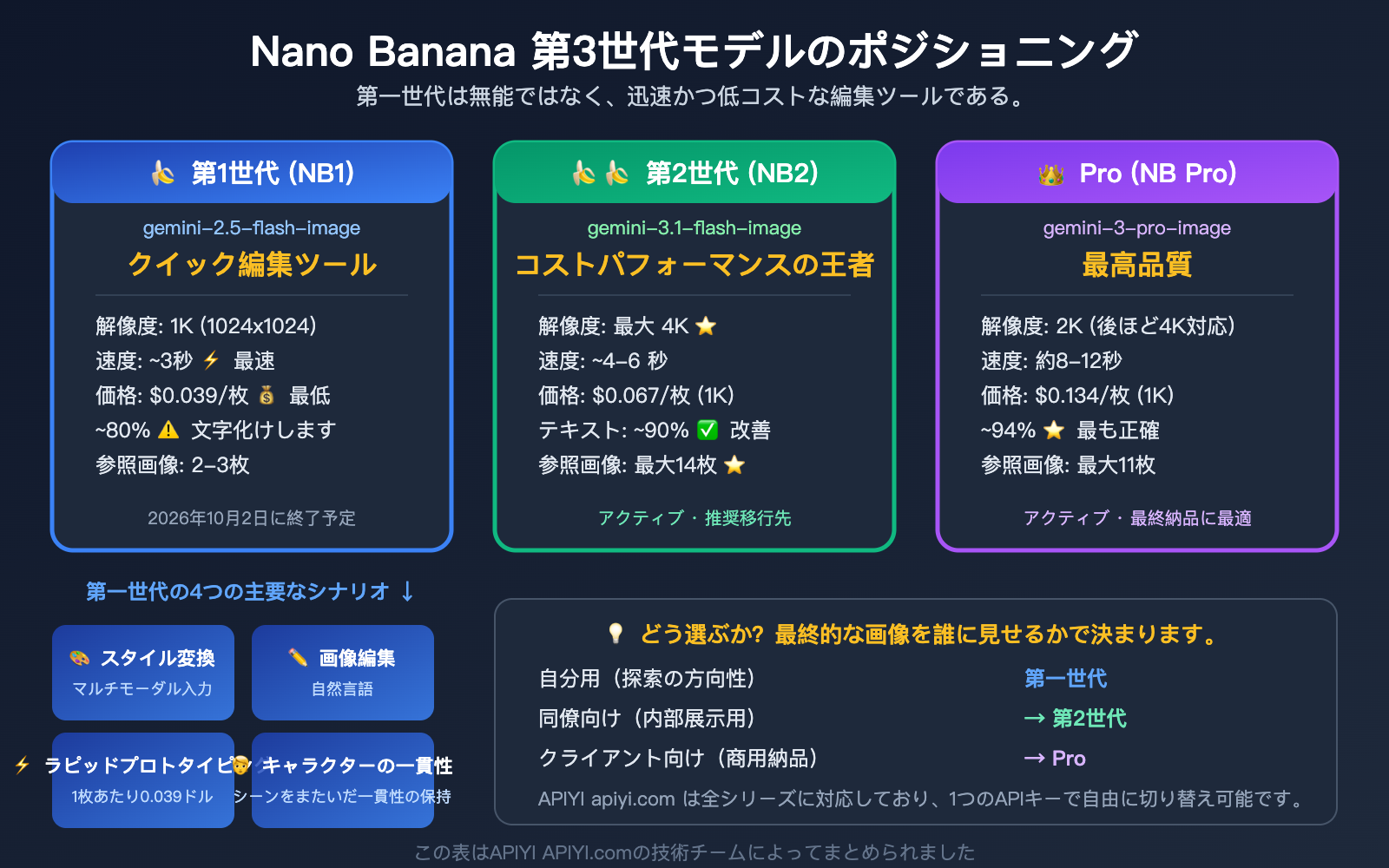

結論から申し上げます。Nano Banana 第1世代(gemini-2.5-flash-image)には確かに弱点があります。解像度が1K止まりで、文字が頻繁に文字化けするというのは紛れもない事実です。Nano Banana Proが2Kの高画質画像を生成し、Nano Banana 2が4Kに対応している現在、「美しい画像を生成する」という点において、第1世代は確かに一歩遅れをとっています。

しかし、第1世代は決して「使えない」わけではありません。その真の価値は「何でもできる画像モデル」ではなく、「3秒で生成でき、1枚あたりわずか2銭(約0.02元)で利用できる高速編集ツール」である点にあります。

核心的価値: 本記事を読み終える頃には、Nano Banana 第1世代がどのようなシーンで依然として価値を発揮するのか、また、どのような場合に第2世代やProへ切り替えるべきかが明確になり、モデルの選択ミスによる時間や予算の無駄を防げるようになります。

description: Nano Banana 一代の限界を正直に解説し、その強みである「速度・コスト・編集能力」を活かしたスタイル変換などの活用事例を紹介します。

Nano Banana 一代の弱点:正直に向き合う

一代で何ができるかを紹介する前に、何が苦手なのかを明確にし、正しい期待値を持てるようにしましょう。

| 制限事項 | 具体的な現象 | 深刻度 |

|---|---|---|

| 解像度が1Kのみ | 1024×1024に固定、2K/4K非対応 | 高:印刷や大判展示には不向き |

| 文字レンダリングが苦手 | 精度は約80%、特に日本語は低い | 高:文字が多いシーンでは使用不可 |

| 細かいディテールの欠落 | 複雑なシーンで細部がぼやける | 中:単純なシーンではあまり影響なし |

| 透明背景非対応 | PNGの透過チャンネルをサポートしない | 中:アイコンやステッカー作成には不向き |

| 圧縮ノイズ | 出力時にJPEG特有のノイズが出ることがある | 低:多くのシーンで許容範囲 |

| 入力画像数の制限 | 参照画像は最大2〜3枚まで | 低:基本的な編集には十分 |

ユーザーからのフィードバック:「小香蕉(Nano Banana)一代はサイズが小さく1Kしかなく、文字もよく崩れる」——この評価は完全に的を射ています。

では、なぜ今も使われているのでしょうか?それは、上記の制限がすべて生成品質レベルの話だからです。一代の強みは生成品質ではなく、速度、コスト、そして編集能力にあります。

Nano Banana 一代の真の立ち位置

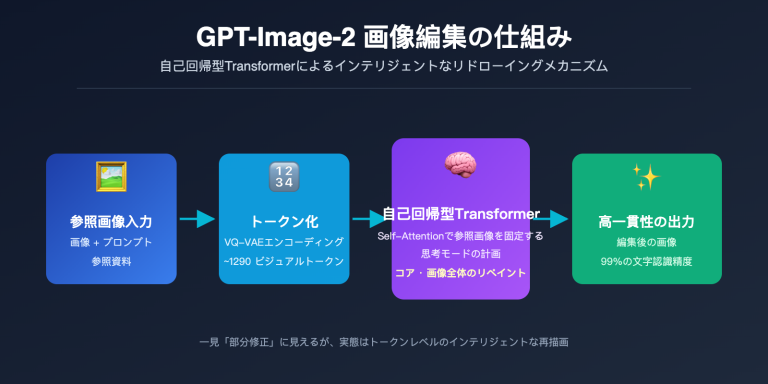

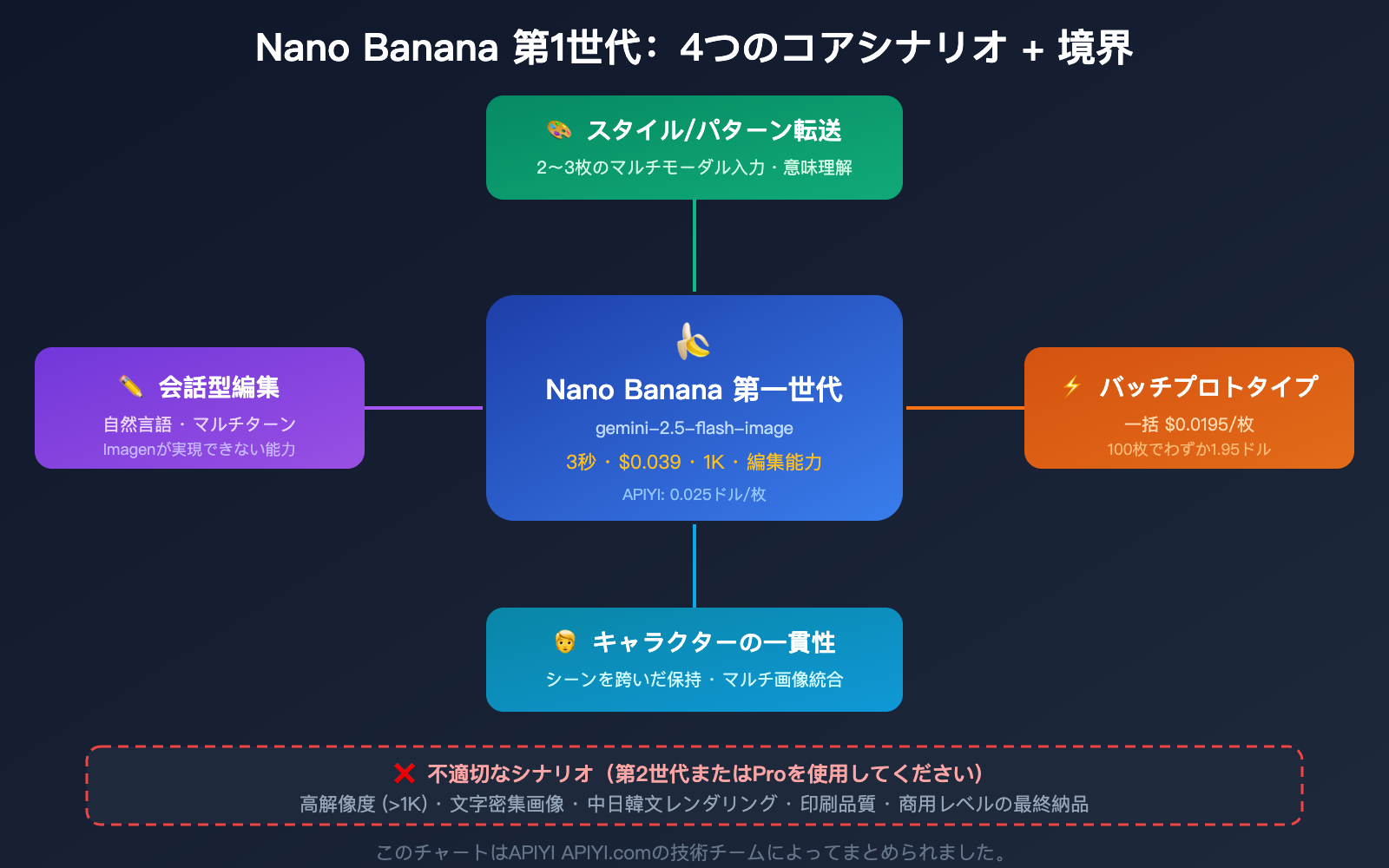

一代のアーキテクチャは二代やProと同様、ネイティブなマルチモーダルモデルであり、画像生成機能が大規模言語モデルに組み込まれています。しかし、一代はより軽量な Gemini 2.5 Flash をベースにしているため、以下の特徴があります。

- 最速のスピード:約3秒で生成(二代は4〜6秒、Proは8〜12秒)

- 最低のコスト:1枚あたり$0.039(バルク時は$0.0195)、Proの3分の1

- 完全な編集能力:自然言語による画像編集をサポート(これはImagenシリーズにはない強み)

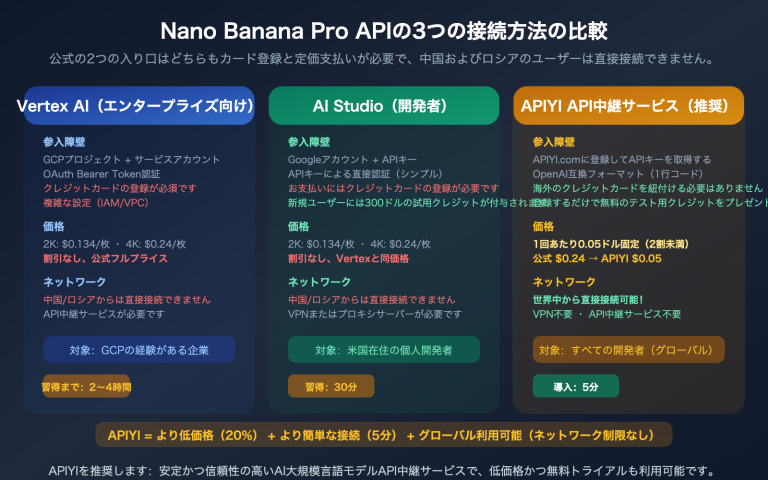

🎯 選択のアドバイス: どの小香蕉モデルを使うべきかの判断は簡単です。最終成果物をユーザーやクライアントに直接見せる必要がある場合は、二代またはProを使ってください。ワークフローの中間処理や、アイデアの迅速な検証であれば、一代が最も経済的な選択肢です。APIYI (apiyi.com) では、小香蕉モデルシリーズのAPIアクセスを提供しており、必要に応じて柔軟に切り替えることが可能です。

Nano Banana 一代の活用事例1:スタイル変換とパターン変換

これは Nano Banana 一代の最も核心的な活用シーンであり、クライアントが最も頻繁に使用する機能です。

スタイル変換とは?

簡単に言えば、画像Aの「スタイル」(色調、筆致、テクスチャ、芸術的スタイル)を抽出し、画像Bに適用することで、内容はBのままでスタイルがAである新しい画像を生成することです。

典型的な用途:

- ECサイトの商品画像のスタイル統一

- 実写写真を水彩画/油絵/ピクセルアート風に変換

- ブランドのビジュアルスタイル統一

- インテリアデザインのスタイルプレビュー

なぜ一代はスタイル変換に適しているのか?

| 強み | 説明 |

|---|---|

| ネイティブなマルチモーダル理解 | 単なるフィルターではなく、画像の内容とスタイルの意味関係を「理解」できる |

| 複数画像の入力 | 2〜3枚の参照画像を同時に入力可能(スタイル用と内容用を分けて指定できる) |

| 対話的な調整 | スタイルが気に入らなければ自然言語で微調整可能:「色をもう少し暖かく」「筆致をより荒々しく」など |

| 速度とコスト | 3秒で結果が出て、$0.039/回と試行錯誤のコストが非常に低い |

| 1Kで十分 | スタイル変換は通常ワークフローの中間ステップであり、高解像度の最終出力は不要なことが多い |

スタイル変換のAPI呼び出し例

import google.generativeai as genai

import base64

genai.configure(api_key="YOUR_API_KEY")

model = genai.GenerativeModel("gemini-2.5-flash-image")

# スタイル参照画像と内容画像を読み込む

with open("style_reference.jpg", "rb") as f:

style_img = base64.b64encode(f.read()).decode()

with open("content_image.jpg", "rb") as f:

content_img = base64.b64encode(f.read()).decode()

response = model.generate_content([

{"mime_type": "image/jpeg", "data": style_img},

{"mime_type": "image/jpeg", "data": content_img},

"2枚目の画像を1枚目の画像の芸術的スタイルに変換してください。元の構図と被写体は維持してください。"

])

OpenAI互換インターフェース経由での呼び出し(APIYI)

from openai import OpenAI

import base64

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

with open("style_reference.jpg", "rb") as f:

style_b64 = base64.b64encode(f.read()).decode()

with open("content_image.jpg", "rb") as f:

content_b64 = base64.b64encode(f.read()).decode()

response = client.chat.completions.create(

model="gemini-2.5-flash-image",

messages=[{

"role": "user",

"content": [

{"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{style_b64}"}},

{"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{content_b64}"}},

{"type": "text", "text": "2枚目の画像を1枚目の画像の芸術的スタイルに変換してください"}

]

}]

)

ポイント:スタイル変換は通常ワークフローの中間ステップであるため、4K解像度は必要ありません。最終的に高解像度出力が必要な場合は、まず一代でスタイルの方向性を確定させ、その後に二代やProを使って最終バージョンを生成するのが効率的です。

💡 実用的なテクニック: スタイル変換のプロンプトは具体的であればあるほど効果的です。「スタイルを変換して」とだけ書くのではなく、「元の構図と被写体の位置は変えず、色調と筆致のスタイルのみを変更してください。彩度は参照画像と一致させてください」のように指示しましょう。

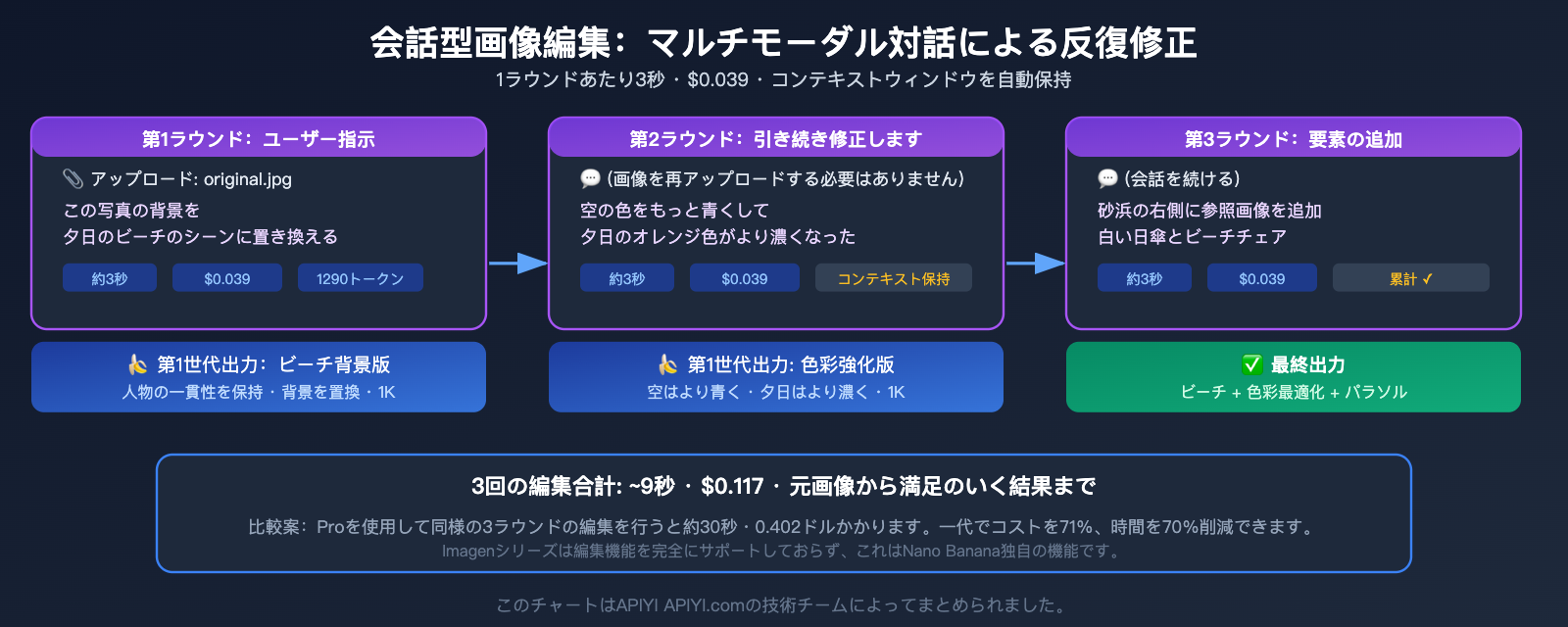

Nano Banana 第1世代の活用シーンその2:対話型画像編集

これは Nano Banana 第1世代の2つ目の核心的な能力であり、Imagen シリーズとの最大の違いでもあります。Imagen は画像の生成のみが可能で、編集には一切対応していません。

対話型編集の仕組み

第1世代の画像編集は自然言語に基づいています。画像をアップロードし、変更したい内容をテキストで指示するだけで、モデルが直接編集後の画像を出力します。

一般的な編集操作:

| 編集タイプ | 指示例 | 効果 |

|---|---|---|

| 背景置換 | 「背景を夜の都市の風景にして」 | 被写体を維持し、背景のみを置換 |

| 要素追加 | 「テーブルの上にコーヒーを置いて」 | 指定位置に新しい要素を追加 |

| 要素削除 | 「画面右側の通行人を消して」 | 指定要素を削除し、背景を補完 |

| 色調調整 | 「全体を暖色系にして」 | 画面の色彩や雰囲気を調整 |

| 季節変更 | 「冬の雪景色に変えて」 | シーンの時間や季節を変更 |

| 服装変更 | 「人物の服を青色にして」 | 特定の要素の属性を変更 |

なぜ第1世代は画像編集に適しているのか?

- コストパフォーマンスの高さ:1回の編集で$0.039。3〜5回修正を繰り返しても$0.12〜$0.20程度です。

- 高速なレスポンス:3秒で結果が出力されるため、納得いくまで即座に修正可能です。

- 1K解像度は編集に十分:編集段階では方向性の確認がメインであり、最終出力品質は求められません。

- 対話コンテキストの保持:複数回の修正においてモデルが以前の対話を記憶しているため、段階的な編集が可能です。

編集シーンのコード例

from openai import OpenAI

import base64

# クライアントの設定

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

# 編集対象の画像を読み込む

with open("original.jpg", "rb") as f:

img_b64 = base64.b64encode(f.read()).decode()

# 第1ラウンドの編集

response = client.chat.completions.create(

model="gemini-2.5-flash-image",

messages=[{

"role": "user",

"content": [

{"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{img_b64}"}},

{"type": "text", "text": "この写真の背景を夕暮れのビーチの風景に置き換えて。人物はそのまま維持して。"}

]

}]

)

🚀 クイックスタート: Nano Banana 第1世代の画像編集機能は、APIYI (apiyi.com) プラットフォームから呼び出すことができます。OpenAI 互換フォーマットをサポートしており、Google のネイティブ API を直接統合する必要はありません。1回あたりの編集コストはわずか $0.025 です。

Nano Banana 第1世代の活用シーン3:低コストな大量プロトタイプ生成

クリエイティブな方向性の検証や、UIプロトタイプの埋め込み画像、ムードボード作成のために大量の画像を素早く生成する必要がある場合、第1世代のスピードとコストパフォーマンスは圧倒的です。

なぜプロトタイプ作成に第2世代やProを使わないのか?

| 比較項目 | 第1世代で100枚生成 | 第2世代で100枚生成 | Proで100枚生成 |

|---|---|---|---|

| 合計所要時間 | 約5分 | 約10分 | 約20分 |

| 合計費用(公式) | $3.9 | $6.7 | $13.4 |

| 合計費用(APIYI) | $2.5 | $4.5 | $5.0 |

| 合計費用(大量API) | $1.95 | $3.4 | $6.7 |

| 画像品質 | 十分(方向性検証用) | 良好(展示可能) | 非常に良い(納品可能) |

100枚のプロトタイプ画像が、APIYI価格ならわずか$2.5、5分で完成します。このコストパフォーマンスがあれば、気兼ねなく大量の試行錯誤が可能です。気に入らなければプロンプトを変えてすぐに次のバッチを生成できるため、コストを気にする必要はありません。

プロトタイプ作成の典型的な用途

- UIデザインのプロトタイプ:アプリやWebサイトのデザインに素早くプレースホルダー画像を配置

- ムードボード作成:クライアントにクリエイティブの方向性を提示(精細な品質は不要な場合)

- EC商品の選定テスト:異なるスタイルの商品画像を作成し、どのスタイルがコンバージョン率が高いかA/Bテストを実施

- コンテンツ運用素材の作成:SNS投稿用の画像ドラフトを大量生成

- ゲームのコンセプトデザイン:シーンやキャラクターのコンセプトアートを高速生成

大量生成のコード例

import asyncio

from openai import AsyncOpenAI

# APIYIのクライアント設定

client = AsyncOpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

prompts = [

"ミニマルスタイルのカフェのインテリアシーン",

"モダンなテクノロジーオフィスの風景",

"温かみのある家庭のキッチン",

# ... 他のプロンプト

]

async def generate_one(prompt):

response = await client.chat.completions.create(

model="gemini-2.5-flash-image",

messages=[{"role": "user", "content": prompt}]

)

return response

# 並列生成(429エラーを避けるため、並列数を制御してください)

async def batch_generate(prompts, concurrency=5):

semaphore = asyncio.Semaphore(concurrency)

async def limited(p):

async with semaphore:

return await generate_one(p)

return await asyncio.gather(*[limited(p) for p in prompts])

💰 コスト最適化: 大量生成した画像の一部を高品質化したい場合は、以下のワークフローがおすすめです。まず第1世代で大量生成して方向性を絞り込み(1枚$0.025)、気に入ったものを第2世代で高解像度版として再生成(1枚$0.045)します。APIYI(apiyi.com)なら1つのAPIキーで全シリーズのモデルを呼び出せるため、プラットフォームを切り替える手間もありません。

Nano Banana 第1世代の活用シーン4:顔の一貫性と複数画像の融合

第1世代は複数画像の入力(2〜3枚)に対応しており、参照画像からキャラクターの特徴を抽出し、新しいシーンでもキャラクターの一貫性を保つことができます。

キャラクターの一貫性を保つ仕組み

キャラクターの参照画像を1〜2枚アップロードし、シーンの説明文を入力すると、第1世代はそのキャラクターを新しいシーンに配置し、顔の特徴や服装のスタイルなどを維持した画像を生成します。

適したシーン:

- 漫画や絵本のキャラクターを異なるシーンで一貫して描画

- バーチャルIPキャラクターの多シーン素材作成

- 商品マスコットキャラクターを異なるマーケティングシーンで展開

- 3Dキャラクターのポーズデザインの参考

複数画像の融合

2〜3枚の画像の要素を1枚の新しい画像に融合させます:

- 画像Aの人物 + 画像Bのシーン → 新しい合成画像

- 画像Aの商品 + 画像Bのシーン + 画像Cのライティング → 商品シーン画像

注意:第1世代は2〜3枚の参照画像入力のみ対応しています。より複雑な多画像参照(4枚以上)が必要な場合は、第2世代(最大14枚)またはPro(最大11枚)をご利用ください。

🎯 技術的なアドバイス: キャラクターの一貫性を保つタスクでは、参照画像の品質が結果に直結します。キャラクターの参考には、遮蔽物がない高解像度の正面写真を使用することをお勧めします。キャラクターの一貫性が非常に重要な場合(商用IPなど)は、保持能力が高いNano Banana Proの使用を推奨します。APIYI(apiyi.com)は全シリーズのモデル呼び出しに対応しているため、まずは第1世代で方向性をテストし、満足できたらProに切り替えて最終稿を作成するのが効率的です。

Nano Banana 第1世代 vs 第2世代 vs Pro 選定ガイド

シーン別モデル選定

| 利用シーン | 第1世代 | 第2世代 | Pro | 推奨モデル |

|---|---|---|---|---|

| スタイル/パターン変換 | ✅ 推奨 | ✅ 可 | ✅ 最適 | 第1世代(十分かつ最安) |

| 会話型画像編集 | ✅ 推奨 | ✅ 可 | ✅ 最適 | 第1世代(高速で試行錯誤コストが低い) |

| バッチ原型生成 | ✅ 推奨 | ⚠️ やや高い | ❌ 高すぎる | 第1世代(バッチ $0.0195/枚) |

| キャラクターの一貫性(基本) | ✅ 十分 | ✅ 良い | ✅ 最適 | 第1世代(参照画像2-3枚で十分) |

| キャラクターの一貫性(複雑) | ⚠️ 参照不足 | ✅ 推奨 | ✅ 可 | 第2世代(参照画像14枚) |

| 高解像度出力(>1K) | ❌ 非対応 | ✅ 推奨 | ✅ 可 | 第2世代(最大4K) |

| 文字密集画像 | ❌ 文字化け | ⚠️ 90%の精度 | ✅ 推奨 | Pro(精度94%) |

| ビジネス向け最終納品 | ❌ 品質不足 | ✅ 可 | ✅ 推奨 | Pro(最高品質) |

予算別モデル選定

| 予算感度 | 推奨モデル | 理由 |

|---|---|---|

| 極めて敏感(コスト重視) | 第1世代 | $0.025/枚(APIYI)、バッチ利用でさらに安価 |

| 適度に敏感 | 第2世代 | $0.045/枚、品質とコストパフォーマンスのバランスが最高 |

| 品質優先 | Pro | $0.05/枚(APIYI)、最高品質 |

| ハイブリッド戦略 | 第1世代 + 第2世代/Pro | 第1世代で方向性を探索 → 第2世代/Proで最終稿を作成 |

第1世代の「スイート・ワークフロー」

最も効率的な使い方は、第1世代単体で完成させることではなく、ワークフローのフロントエンドに配置することです:

第1世代(探索) → 第2世代/Pro(精緻化)

1. 第1世代で10-20個の方向性を素早く生成($0.25-0.50、1分)

2. その中から満足のいく2-3個の方向性を選択

3. 第2世代またはProで、選択した方向性に基づき高解像度の最終稿を生成($0.10-0.15)

4. 合計コスト $0.35-0.65 で、探索の幅と最終的な品質を両立

💡 選択のアドバイス: どのモデルを使うか迷ったら?最もシンプルな判断基準は、**「この画像を最終的に誰に見せるか?」**です。自分用なら第1世代、同僚や社内展示用なら第2世代、クライアントやユーザー用ならProを選びましょう。APIYI (apiyi.com) はすべてのNano Bananaモデルに対応しており、一つのAPIキーで3世代間を自由に切り替えられます。

Nano Banana 第1世代のサービス終了に伴う移行アドバイス

注意点として、gemini-2.5-flash-image は 2026年10月2日にサービス終了 が予定されています。現在第1世代を利用している場合は、早めの移行計画をおすすめします。

移行パス

| 現在の用途 | 移行先 | 説明 |

|---|---|---|

| スタイル変換 | 第2世代 gemini-3.1-flash-image |

能力が向上し、より多くの参照画像に対応 |

| 画像編集 | 第2世代 gemini-3.1-flash-image |

速度は同等で、編集能力が向上 |

| バッチ原型 | 第2世代 gemini-3.1-flash-image |

価格はわずかに上がるが、品質が大幅に向上 |

| キャラクターの一貫性 | 第2世代 または Pro | より多くの参照画像入力に対応 |

第2世代は第1世代の正統な後継モデルです。同じFlashベースでありながら、速度と価格のバランスを維持しつつ、解像度は1Kから4Kへ、文字認識精度は80%から90%へと向上しています。

Nano Banana 第1世代 よくある質問(FAQ)

Q1: 第1世代の文字レンダリングはどれくらいひどいですか?使えますか?

第1世代の文字レンダリング精度は約80%です。短い英語テキスト(3〜5単語)であれば通常問題ありませんが、10文字を超える長いテキストになると、文字化けや欠落、変形が発生しやすくなります。中国語はさらに不安定で、画数の欠けや誤字が頻繁に起こります。画像内に文字を含める必要がある場合は、まず第1世代で文字を含まないベース画像を生成し、画像編集ソフトで文字レイヤーを重ねることをお勧めします。あるいは、Nano Banana Pro(精度94%)を直接使用してください。

Q2: 第1世代で生成した1K画像を後から拡大できますか?

可能ですが、Real-ESRGANやTopaz AIなどの外部の超解像ツールを利用する必要があります。第1世代自体は1Kを超える出力をサポートしていません。より良い方法は、第1世代で構図とスタイルを決定し、第2世代を使って同じプロンプトで2Kまたは4Kバージョンを生成することです。APIYI(apiyi.com)は全シリーズのモデルをサポートしており、切り替えも非常に簡単です。

Q3: 第1世代とImagen 4はどちらが良いですか?

それぞれ得意とする側面が異なります。Imagen 4は単一生成時の画像品質が優れています(プロ仕様の拡散モデル)が、画像編集をサポートしておらず、複数画像の入力やスタイル転送にも対応していません。第1世代の核心的な強みは、編集能力とマルチモーダル理解にあります。なお、Imagen 4の全シリーズは2026年6月24日にサービス終了予定であり、Google公式はNano Bananaシリーズへの移行を推奨しています。

Q4: 第1世代はどのような画像比率に対応していますか?

10種類以上の比率に対応しています:1:1、16:9、9:16、4:3、3:4、3:2、2:3、21:9、5:4、4:5。ただし、どの比率であっても長辺は1024pxを超えません。

Q5: 第1世代をバッチ呼び出しすると頻繁に429エラーが発生します。どうすればいいですか?

第1世代には厳格なレート制限があり、短時間に連続して呼び出すと429 RESOURCE_EXHAUSTEDエラーが発生しやすくなります。同時実行数を3〜5リクエスト/秒に抑えるか、バッチAPI(Batch API)を使用することをお勧めします。APIYI(apiyi.com)経由で呼び出すと、より安定したインターフェース体験と高いレート上限が得られます。

Q6: 第1世代がサービス終了した後、コードを大幅に変更する必要がありますか?

大幅な変更は不要です。modelパラメータを gemini-2.5-flash-image から gemini-3.1-flash-image-preview(第2世代)に変更するだけで、API呼び出し形式は完全に互換性があります。第2世代のAPIインターフェースは第1世代の上位互換であり、第1世代がサポートしていたすべてのパラメータを第2世代でも利用可能です。

Q7: 第1世代はECサイトの商品メイン画像に適していますか?

推奨しません。ECサイトのメイン画像は通常、少なくとも800x800px以上の高精細さが求められます。第1世代の1K解像度では品質が不足し、文字レンダリングも信頼できません。EC用途にはNano Banana Pro(高品質)または第2世代(コストパフォーマンス)をお勧めします。ただし、第1世代はECの初期段階における商品選定テストやスタイル探索には活用できます。

まとめ

Nano Banana 第1世代(gemini-2.5-flash-image)は、決して「完璧な画像生成モデル」ではありません。1Kの解像度制限や文字化けは確かに弱点です。しかし、以下の4つのシナリオにおいて、優れた低コスト画像処理ツールとして独自の価値を発揮します:

- スタイル/パターンの転送: 参照画像からスタイルを抽出し、新しい画像に適用する(複数画像入力能力が高い)

- 会話型画像編集: 自然言語による迅速な編集(Imagenシリーズにはできない機能)

- 低コストなバッチプロトタイプ: 1枚あたり$0.025、3秒で生成可能。大量の試行錯誤も低コスト

- キャラクターの一貫性と複数画像の融合: キャラクターのシーン間の一貫性を維持し、2〜3枚の参照画像を融合する

最も賢い使い方は、ワークフローのフロントエンドで第1世代を使って探索と編集を行い、方向性が決まってから第2世代やProで最終稿を出力することです。APIYI(apiyi.com)は全シリーズのNano BananaモデルのAPIアクセスを提供しており、1つのキーで3つの世代を自由に切り替え、コストと品質の最適なバランスを見つけることができます。

執筆者: APIYI 技術チーム

技術交流: APIYI(apiyi.com)にアクセスして、全シリーズのNano BananaモデルAPIと技術サポートを入手してください

更新日: 2026年4月

適用バージョン: gemini-2.5-flash-image(2026年10月2日にサービス終了予定)

参考資料:

- Google AI 画像生成ドキュメント: ai.google.dev/gemini-api/docs/image-generation

- Gemini API 料金: ai.google.dev/gemini-api/docs/pricing

- Gemini モデルリスト: ai.google.dev/gemini-api/docs/models