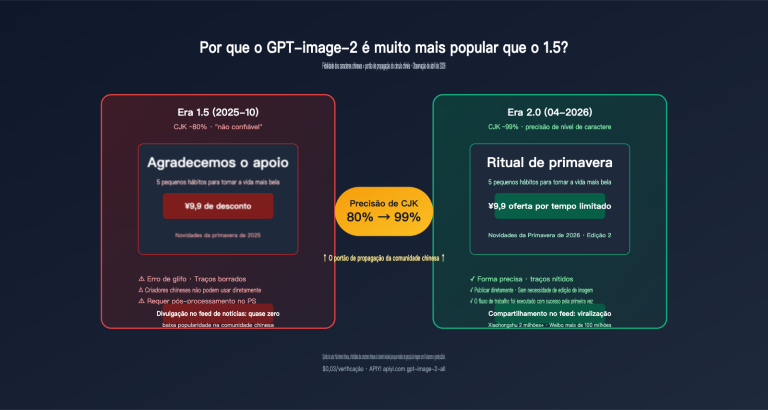

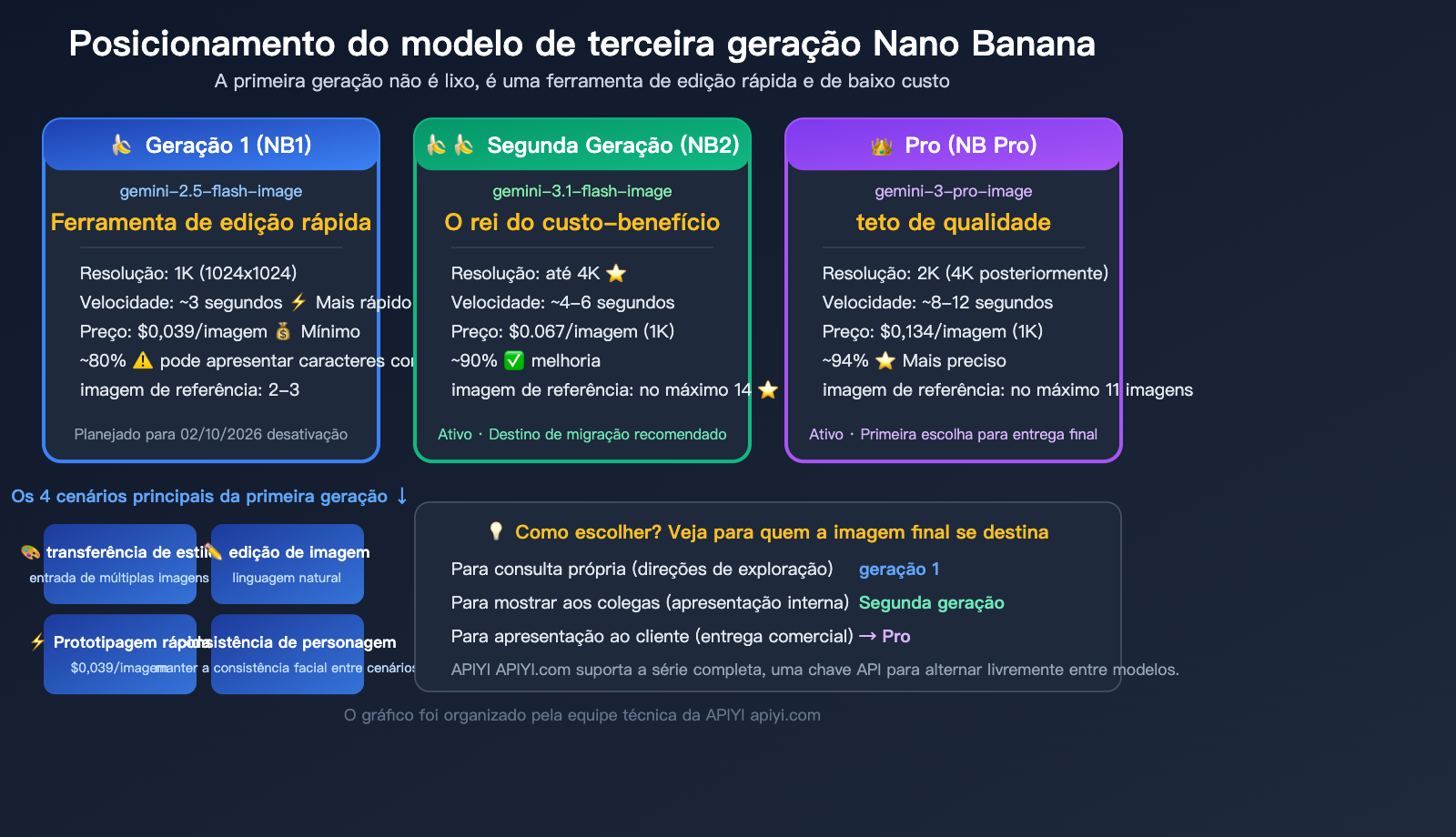

Para começar, vamos direto ao ponto: a primeira geração do Nano Banana (gemini-2.5-flash-image) tem, sim, limitações técnicas claras — a resolução é limitada a 1K e o texto frequentemente apresenta erros de codificação, isso é um fato. Hoje, com o Nano Banana Pro entregando imagens de alta qualidade em 2K e o Nano Banana 2 chegando aos 4K, a primeira geração ficou, de fato, para trás quando o objetivo é "gerar imagens esteticamente perfeitas".

Mas não se engane, a primeira geração não é inútil. O seu verdadeiro propósito nunca foi ser um "modelo de imagem que faz tudo", mas sim uma ferramenta de edição rápida que gera resultados em 3 segundos e custa apenas 2 centavos por imagem.

Valor central: Ao terminar de ler este artigo, você saberá exatamente em quais cenários o Nano Banana de primeira geração ainda vale a pena e quando deve migrar para a segunda geração ou para o Pro, evitando desperdiçar tempo e orçamento com o modelo errado.

As falhas da primeira geração do Nano Banana: encarando a realidade

Antes de apresentar o que a primeira geração é capaz de fazer, vamos deixar claro onde ela não brilha, para que você possa alinhar suas expectativas.

| Limitação | Comportamento | Nível de gravidade |

|---|---|---|

| Resolução limitada a 1K | Limite rígido de 1024×1024, sem suporte a 2K/4K | Alto — inviável para impressão ou exibição em grandes formatos |

| Renderização de texto ruim | Precisão de cerca de 80%, pior em chinês | Alto — inutilizável em cenários com muito texto |

| Perda de detalhes finos | Detalhes ficam borrados em cenas complexas | Médio — pouco impacto em cenas simples |

| Sem fundo transparente | Não suporta canal alfa PNG | Médio — inutilizável para ícones ou adesivos |

| Artefatos de compressão | Saídas às vezes apresentam artefatos JPEG | Baixo — aceitável na maioria dos casos |

| Entrada limitada de imagens | Máximo de 2-3 imagens de referência | Baixo — suficiente para edições básicas |

Feedback real de clientes: "A primeira geração do Nano Banana não atinge o tamanho necessário, só tem 1K e o texto geralmente sai bagunçado." — essa avaliação é totalmente precisa.

Então, por que ainda há pessoas usando? Porque essas limitações estão no nível da qualidade de geração. O ponto forte da primeira geração não é a qualidade final, mas sim a velocidade, o custo e a capacidade de edição.

O posicionamento real da primeira geração do Nano Banana

A arquitetura da primeira geração é a mesma da segunda e da Pro — ambas são modelos multimodais nativos, com a geração de imagens integrada ao modelo de linguagem. No entanto, a primeira geração é baseada na base mais leve Gemini 2.5 Flash, por isso:

- Velocidade máxima: gera imagens em cerca de 3 segundos (a segunda geração leva 4-6s, a Pro 8-12s)

- Custo mínimo: $0,039/imagem ($0,0195 em lote), 1/3 do valor da Pro

- Capacidade de edição completa: suporta edição de imagens via linguagem natural, algo que a série Imagen não possui

🎯 Dica de escolha: Decidir qual geração do Nano Banana usar é simples: se o seu produto final precisa ser exibido diretamente para usuários ou clientes, use a segunda geração ou a Pro. Se você está apenas processando imagens em um fluxo de trabalho ou validando ideias rapidamente, a primeira geração é a escolha mais econômica. A APIYI (apiyi.com) oferece acesso via API a toda a série de modelos Nano Banana, permitindo alternar conforme a necessidade.

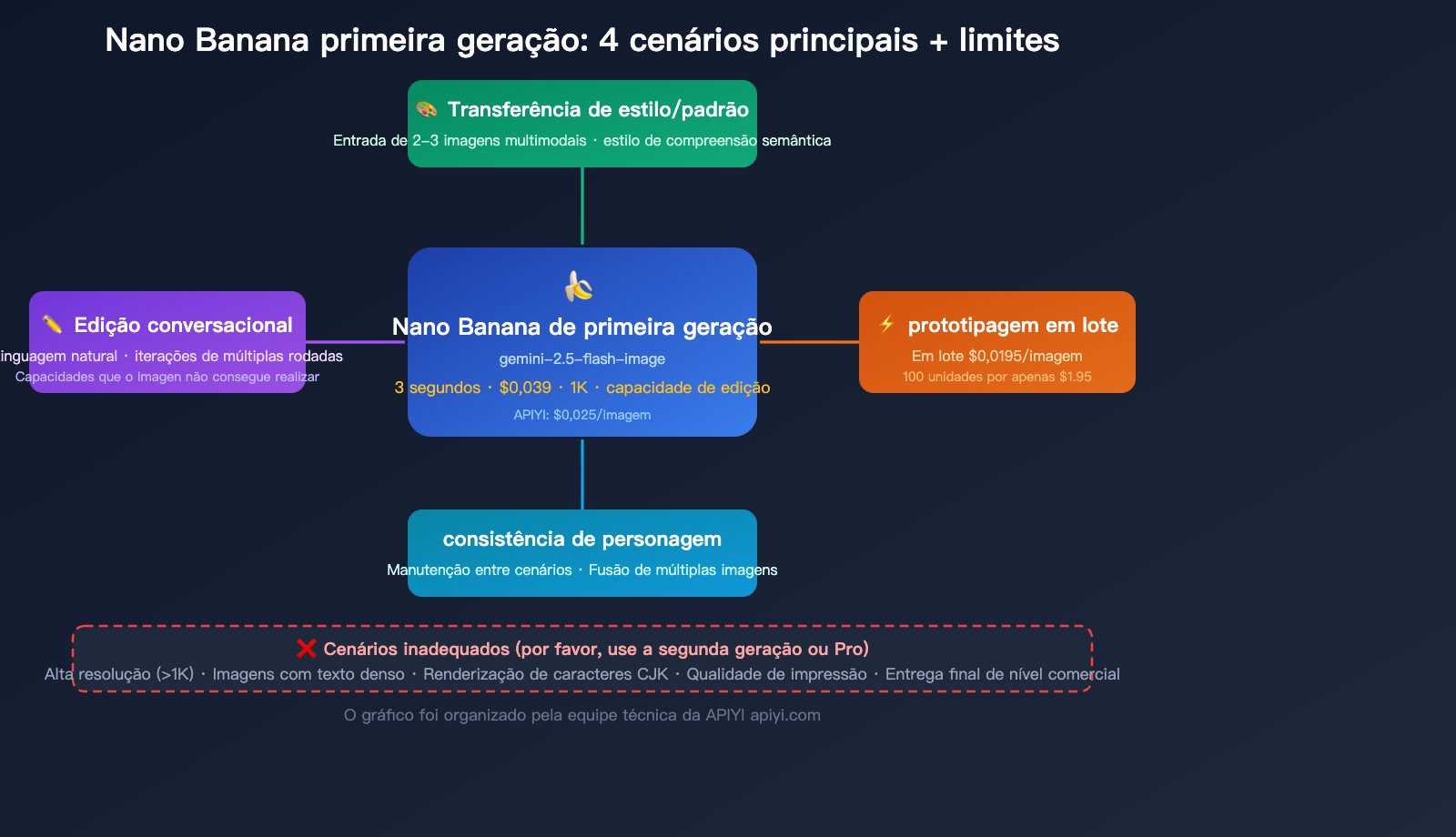

Nano Banana: Cenário de aplicação 1: Transferência de estilo e padrão

Este é o cenário de aplicação principal da primeira geração do Nano Banana e também a função mais utilizada pelos clientes.

O que é transferência de estilo?

Em resumo, é extrair o "estilo" (tom, pinceladas, textura, estilo artístico) da imagem A e aplicá-lo à imagem B, gerando uma nova imagem que mantém o conteúdo de B, mas com o estilo de A.

Usos típicos:

- Unificação de estilo em fotos de produtos de e-commerce

- Conversão de fotos reais em aquarela/pintura a óleo/pixel art

- Padronização de identidade visual de marca

- Pré-visualização de estilos de design de interiores

Por que a primeira geração é ideal para transferência de estilo?

| Vantagem | Explicação |

|---|---|

| Compreensão multimodal nativa | A primeira geração "entende" a relação semântica entre o conteúdo e o estilo da imagem, não é apenas um filtro simples |

| Entrada de múltiplas imagens | Suporta a entrada de 2-3 imagens de referência simultaneamente; uma fornece o estilo e a outra o conteúdo |

| Ajuste via diálogo | Se o estilo não estiver bom, você pode ajustar com linguagem natural: "deixe as cores mais quentes", "pinceladas mais rústicas" |

| Velocidade e custo | Resultado em 3 segundos, $0,039 por vez, custo de tentativa e erro extremamente baixo |

| 1K é suficiente | A transferência de estilo geralmente é uma etapa intermediária, não exigindo alta resolução na saída final |

Exemplo de chamada de API para transferência de estilo

import google.generativeai as genai

import base64

genai.configure(api_key="SUA_CHAVE_API")

model = genai.GenerativeModel("gemini-2.5-flash-image")

# Lê a imagem de referência de estilo e a imagem de conteúdo

with open("style_reference.jpg", "rb") as f:

style_img = base64.b64encode(f.read()).decode()

with open("content_image.jpg", "rb") as f:

content_img = base64.b64encode(f.read()).decode()

response = model.generate_content([

{"mime_type": "image/jpeg", "data": style_img},

{"mime_type": "image/jpeg", "data": content_img},

"Converta a segunda imagem para o estilo artístico da primeira, mantendo a composição original e o assunto inalterados"

])

Chamada via interface compatível com OpenAI (APIYI)

from openai import OpenAI

import base64

client = OpenAI(

api_key="SUA_CHAVE_APIYI",

base_url="https://api.apiyi.com/v1"

)

with open("style_reference.jpg", "rb") as f:

style_b64 = base64.b64encode(f.read()).decode()

with open("content_image.jpg", "rb") as f:

content_b64 = base64.b64encode(f.read()).decode()

response = client.chat.completions.create(

model="gemini-2.5-flash-image",

messages=[{

"role": "user",

"content": [

{"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{style_b64}"}},

{"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{content_b64}"}},

{"type": "text", "text": "Converta a segunda imagem para o estilo artístico da primeira"}

]

}]

)

Ponto importante: A transferência de estilo não exige resolução 4K, pois geralmente é um passo intermediário no fluxo de trabalho. Se precisar de uma saída de alta resolução, você pode usar a primeira geração para definir a direção do estilo e, em seguida, usar a segunda geração ou a Pro para gerar a versão final.

💡 Dica prática: Quanto mais específico for o comando (prompt) de transferência de estilo, melhor será o resultado. Não escreva apenas "converta o estilo"; escreva "mantenha a composição original e a posição do assunto inalteradas, altere apenas o tom e o estilo das pinceladas, mantendo a saturação de cor consistente com a imagem de referência".

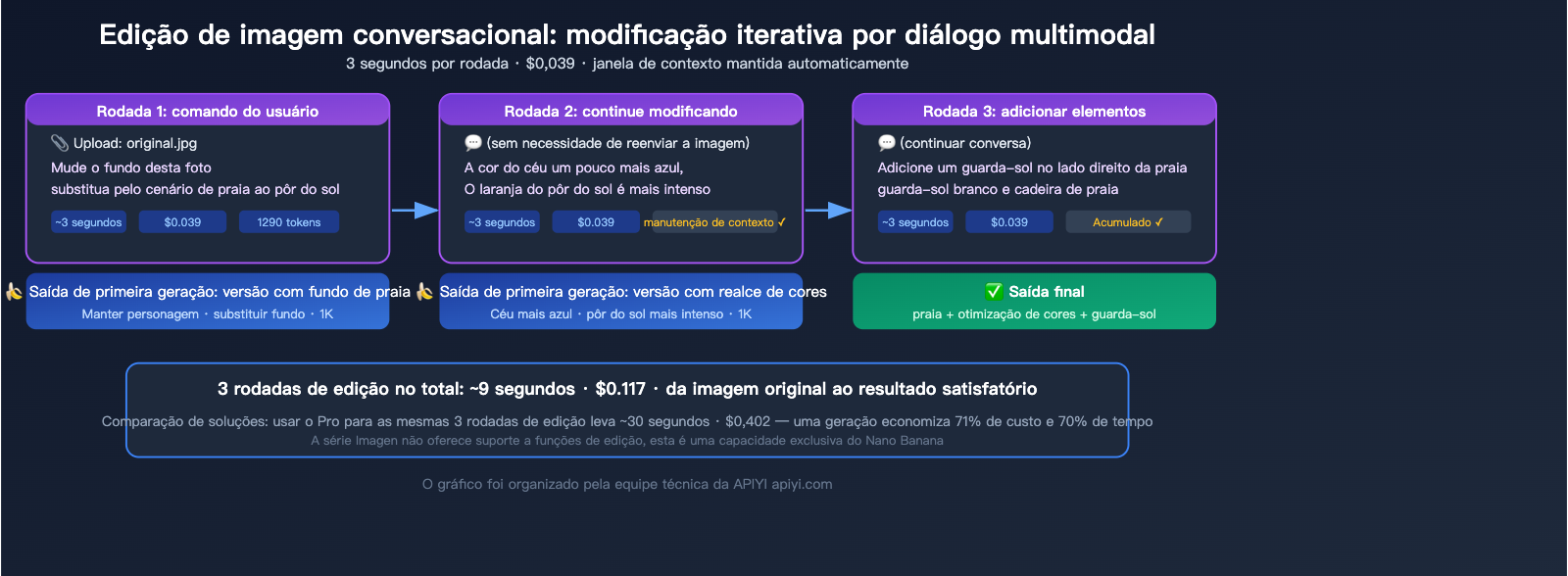

Nano Banana Geração 1: Cenários de Aplicação 2: Edição de Imagens Conversacional

Esta é a segunda maior capacidade central da primeira geração do Nano Banana, e é também o que o diferencia da série Imagen — o Imagen apenas gera imagens e não oferece qualquer suporte para edição.

Como funciona a edição conversacional

A edição de imagens da primeira geração é baseada em linguagem natural: você envia uma imagem, descreve as alterações desejadas com texto e o modelo gera diretamente a imagem modificada.

Operações de edição comuns:

| Tipo de Edição | Exemplo de Comando | Efeito |

|---|---|---|

| Substituição de fundo | "Troque o fundo por uma paisagem urbana noturna" | Mantém o objeto principal, substitui todo o fundo |

| Adição de elemento | "Adicione uma xícara de café na mesa" | Adiciona um novo elemento na posição especificada |

| Remoção de elemento | "Remova a pessoa à direita da imagem" | Remove o elemento especificado e preenche o fundo |

| Ajuste de tom | "Mude o tom geral para tons quentes" | Ajusta a atmosfera de cores da imagem |

| Mudança de estação | "Mude a cena para inverno com neve" | Altera o tempo/estação da cena |

| Mudança de vestuário | "Mude a roupa da pessoa para azul" | Modifica atributos de elementos específicos |

Por que a primeira geração é adequada para edição de imagens?

- Vantagem de custo clara: $0,039 por edição; 3 a 5 rodadas de modificação custam apenas $0,12 a $0,20.

- Velocidade rápida: Resultado em 3 segundos; se não estiver satisfeito, pode alterar imediatamente.

- Resolução 1K é suficiente para edição: A fase de edição serve geralmente para confirmar a direção, não exigindo a qualidade de entrega final.

- Manutenção do contexto da conversa: O modelo lembra das conversas anteriores durante as modificações, tornando o processo progressivo.

Exemplo de código para cenários de edição

from openai import OpenAI

import base64

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

# Ler a imagem a ser editada

with open("original.jpg", "rb") as f:

img_b64 = base64.b64encode(f.read()).decode()

# Primeira rodada de edição

response = client.chat.completions.create(

model="gemini-2.5-flash-image",

messages=[{

"role": "user",

"content": [

{"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{img_b64}"}},

{"type": "text", "text": "Substitua o fundo desta foto por uma cena de praia ao pôr do sol, mantendo a pessoa inalterada"}

]

}]

)

🚀 Comece rápido: A capacidade de edição de imagens da primeira geração do Nano Banana pode ser invocada através da plataforma APIYI apiyi.com, com suporte ao formato compatível com OpenAI, sem necessidade de integrar a API nativa do Google. O custo por edição é de apenas $0,025.

Nano Banana Geração 1: Cenário de aplicação 3: Geração de protótipos em lote de baixo custo

Quando você precisa gerar rapidamente um grande volume de imagens para validar direções criativas, preencher protótipos de UI ou criar painéis de humor (mood boards), a velocidade e a vantagem de custo da primeira geração são imbatíveis.

Por que não usar a segunda geração ou a Pro para protótipos?

| Item de comparação | Geração 1 (100 protótipos) | Geração 2 (100 protótipos) | Pro (100 protótipos) |

|---|---|---|---|

| Tempo total | ~5 minutos | ~10 minutos | ~20 minutos |

| Custo total (oficial) | $3,9 | $6,7 | $13,4 |

| Custo total (APIYI) | $2,5 | $4,5 | $5,0 |

| Custo total (API em lote) | $1,95 | $3,4 | $6,7 |

| Qualidade da imagem | Suficiente (validação) | Boa (apresentável) | Muito boa (entregável) |

100 imagens de protótipo custam apenas $2,5 (preço APIYI) e ficam prontas em 5 minutos. Esse custo-benefício permite que você teste e erre à vontade — se não gostar, basta mudar o comando e gerar outro lote sem peso na consciência.

Usos típicos em cenários de prototipagem

- Protótipos de design de UI: Preenchimento rápido de imagens de espaço reservado para apps/sites.

- Criação de painéis de humor (mood boards): Mostrar direções criativas para clientes sem precisar de qualidade de acabamento final.

- Testes de seleção de produtos (e-commerce): Gerar rapidamente imagens de produtos em estilos diferentes para testes A/B e ver qual converte mais.

- Banco de materiais para operações de conteúdo: Geração em lote de rascunhos de imagens para redes sociais.

- Design de conceito de jogos: Geração rápida de conceitos de cenários/personagens.

Exemplo de código para geração em lote

import asyncio

from openai import AsyncOpenAI

client = AsyncOpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

prompts = [

"Um cenário interno de cafeteria em estilo minimalista",

"Um escritório de tecnologia com visual moderno",

"Uma cozinha familiar aconchegante",

# ... mais comandos

]

async def generate_one(prompt):

response = await client.chat.completions.create(

model="gemini-2.5-flash-image",

messages=[{"role": "user", "content": prompt}]

)

return response

# Geração concorrente (cuidado para controlar a concorrência e evitar erro 429)

async def batch_generate(prompts, concurrency=5):

semaphore = asyncio.Semaphore(concurrency)

async def limited(p):

async with semaphore:

return await generate_one(p)

return await asyncio.gather(*[limited(p) for p in prompts])

💰 Otimização de custos: Se parte das imagens geradas em lote precisar de maior qualidade, recomendo este fluxo de trabalho: use a primeira geração para filtrar direções ($0,025/imagem) e, em seguida, gere novamente as versões de alta resolução com a segunda geração ($0,045/imagem). Através da APIYI apiyi.com, você pode invocar toda a série de modelos com uma única chave, sem precisar trocar de plataforma.

Nano Banana Geração 1: Cenário de aplicação 4: Consistência facial e fusão de múltiplas imagens

A primeira geração suporta a entrada de várias imagens (2-3), permitindo extrair características de personagens a partir de uma imagem de referência e manter a consistência facial em novos cenários.

Como funciona a consistência facial

Envie 1-2 imagens de referência do personagem + uma descrição de cenário, e a primeira geração criará imagens do personagem no novo cenário, mantendo características faciais, estilo de vestimenta, etc.

Cenários aplicáveis:

- Representação consistente de personagens de quadrinhos/livros ilustrados em diferentes cenas.

- Materiais de personagens de IP virtual em diferentes cenários.

- Exibição de mascotes de produtos em diferentes contextos de marketing.

- Referência de design de pose para personagens 3D.

Fusão de múltiplas imagens

Combine elementos de 2-3 imagens em uma nova:

- Personagem da Imagem A + Cenário da Imagem B → Nova imagem composta.

- Produto da Imagem A + Cenário da Imagem B + Iluminação da Imagem C → Imagem de produto em cenário.

Atenção: A primeira geração suporta apenas 2-3 imagens de referência. Se precisar de referências mais complexas (>3 imagens), use a segunda geração (até 14 imagens) ou a Pro (até 11 imagens).

🎯 Dica técnica: Em tarefas de consistência facial, a qualidade da imagem de referência afeta diretamente o resultado. Recomenda-se usar fotos de rosto de alta definição como referência, evitando obstruções ou ângulos extremos. Se a exigência de consistência for muito alta (como em IPs comerciais), use o Nano Banana Pro, que possui uma capacidade de manutenção de personagem superior. A APIYI apiyi.com suporta a invocação de toda a série de modelos; você pode testar a direção com a primeira geração e, ao ficar satisfeito, mudar para a Pro para a versão final.

Guia de Seleção: Nano Banana 1ª Geração vs. 2ª Geração vs. Pro

Escolhendo o modelo por cenário

| Cenário de aplicação | 1ª Geração | 2ª Geração | Pro | Escolha recomendada |

|---|---|---|---|---|

| Transferência de estilo/padrão | ✅ Preferencial | ✅ Funciona | ✅ Melhor | 1ª Geração (suficiente e mais barato) |

| Edição de imagem conversacional | ✅ Preferencial | ✅ Funciona | ✅ Melhor | 1ª Geração (rápido e baixo custo de teste) |

| Geração de protótipos em lote | ✅ Preferencial | ⚠️ Caro | ❌ Muito caro | 1ª Geração ($0,0195/imagem em lote) |

| Consistência facial (básica) | ✅ Suficiente | ✅ Melhor | ✅ Melhor | 1ª Geração (2-3 imagens de referência bastam) |

| Consistência facial (complexa) | ⚠️ Ref. insuficiente | ✅ Preferencial | ✅ Funciona | 2ª Geração (14 imagens de referência) |

| Saída de alta resolução (>1K) | ❌ Não suportado | ✅ Preferencial | ✅ Funciona | 2ª Geração (até 4K) |

| Imagens com muito texto | ❌ Texto confuso | ⚠️ 90% precisão | ✅ Preferencial | Pro (94% de precisão) |

| Entrega final de nível comercial | ❌ Qualidade baixa | ✅ Aceitável | ✅ Preferencial | Pro (qualidade máxima) |

Escolhendo o modelo por orçamento

| Sensibilidade ao orçamento | Modelo recomendado | Motivo |

|---|---|---|

| Extremamente sensível | 1ª Geração | $0,025/imagem (APIYI), menor em lote |

| Moderadamente sensível | 2ª Geração | $0,045/imagem, melhor equilíbrio custo-benefício |

| Qualidade em primeiro lugar | Pro | $0,05/imagem (APIYI), qualidade máxima |

| Estratégia mista | 1ª Geração + 2ª/Pro | 1ª Geração para explorar → 2ª/Pro para finalização |

O "fluxo de trabalho ideal" da 1ª Geração

A maneira mais eficiente não é usar a 1ª Geração sozinha para a imagem final, mas sim colocá-la no início do seu fluxo:

1ª Geração (Exploração) → 2ª Geração/Pro (Refinamento)

1. Use a 1ª Geração para gerar rapidamente 10-20 direções ($0,25-0,50, 1 minuto)

2. Escolha 2-3 direções satisfatórias

3. Use a 2ª Geração ou Pro para gerar a versão final em alta resolução ($0,10-0,15)

4. Custo total $0,35-0,65, equilibrando amplitude de exploração e qualidade final

💡 Dica de escolha: Não sabe qual modelo usar? O critério mais simples é: Para quem é esta imagem? Para você mesmo → 1ª Geração; Para colegas/apresentação interna → 2ª Geração; Para clientes/usuários → Pro. O serviço proxy de API APIYI (apiyi.com) suporta toda a linha de modelos Nano Banana; com uma única chave API, você pode alternar livremente entre as três gerações.

1ª Geração do Nano Banana será descontinuada: sugestões de migração

Vale notar que o gemini-2.5-flash-image tem previsão de descontinuação para 2 de outubro de 2026. Se você ainda usa a 1ª Geração, planeje sua migração com antecedência.

Caminho de migração

| Uso atual | Migrar para | Observação |

|---|---|---|

| Transferência de estilo | 2ª Geração gemini-3.1-flash-image |

Mais capaz, suporta mais imagens de referência |

| Edição de imagem | 2ª Geração gemini-3.1-flash-image |

Velocidade similar, melhores capacidades de edição |

| Protótipos em lote | 2ª Geração gemini-3.1-flash-image |

Preço um pouco maior, mas com salto na qualidade |

| Consistência facial | 2ª Geração ou Pro | Suporta mais entradas de imagens de referência |

A 2ª Geração é a sucessora direta da 1ª — baseada na mesma arquitetura Flash, é rápida e tem preço justo, mas a resolução salta de 1K para 4K e a precisão de texto sobe de 80% para 90%.

FAQ sobre o Nano Banana de Primeira Geração

Q1: Quão ruim é a renderização de texto da primeira geração? É utilizável?

A precisão da renderização de texto da primeira geração é de cerca de 80%. Textos curtos em inglês (3-5 palavras) geralmente não apresentam problemas, mas textos longos com mais de 10 caracteres tendem a exibir letras embaralhadas, ausentes ou deformadas. O chinês é ainda mais instável, apresentando frequentemente traços quebrados ou caracteres incorretos. Se a sua imagem precisar conter texto, recomendo gerar a imagem base sem texto usando a primeira geração e, em seguida, adicionar a camada de texto com um software de edição de imagem. Ou, alternativamente, utilize diretamente o Nano Banana Pro (94% de precisão).

Q2: As imagens de 1K geradas pela primeira geração podem ser ampliadas posteriormente?

Sim, mas você precisará recorrer a ferramentas externas de super-resolução (como Real-ESRGAN, Topaz AI, etc.). A primeira geração, por si só, não suporta saídas superiores a 1K. Uma estratégia melhor é: usar a primeira geração para definir a composição e o estilo e, em seguida, usar a segunda geração com o mesmo comando para gerar versões em 2K ou 4K. O serviço proxy de API APIYI (apiyi.com) suporta toda a série de modelos, tornando a alternância muito conveniente.

Q3: Qual é melhor, a primeira geração ou o Imagen 4?

Cada um tem suas vantagens em diferentes dimensões. O Imagen 4 oferece melhor qualidade de imagem em uma única geração (modelo de difusão profissional), mas não suporta edição de imagem, nem entrada de múltiplas imagens ou transferência de estilo. O principal diferencial da primeira geração é sua capacidade de edição e compreensão multimodal. Além disso, toda a série Imagen 4 será descontinuada em 24 de junho de 2026, e o Google recomenda oficialmente a migração para a série Nano Banana.

Q4: Quais proporções de imagem a primeira geração suporta?

Suporta mais de 10 proporções: 1:1, 16:9, 9:16, 4:3, 3:4, 3:2, 2:3, 21:9, 5:4, 4:5. No entanto, independentemente da proporção, o lado mais longo não ultrapassa 1024px.

Q5: O que fazer se eu encontrar frequentemente o erro 429 ao fazer invocações em lote da primeira geração?

A primeira geração possui limites de taxa bastante rigorosos, e invocações rápidas e consecutivas podem facilmente disparar o erro 429 RESOURCE_EXHAUSTED. Sugerimos manter a concorrência entre 3-5 solicitações por segundo ou utilizar a API de lote (Batch API). Ao realizar a invocação através do serviço proxy de API APIYI (apiyi.com), você obtém uma experiência de interface mais estável e limites de taxa mais elevados.

Q6: Meu código precisará de grandes alterações após a descontinuação da primeira geração?

Não são necessárias grandes mudanças. Basta alterar o parâmetro model de gemini-2.5-flash-image para gemini-3.1-flash-image-preview (segunda geração); o formato de invocação da API é totalmente compatível. A interface da API da segunda geração é um superconjunto da primeira, portanto, todos os parâmetros suportados pela primeira geração também são suportados pela segunda.

Q7: A primeira geração é adequada para imagens principais de produtos de e-commerce?

Não é recomendado. Imagens principais de e-commerce geralmente exigem pelo menos 800x800px e alta nitidez. A resolução de 1K da primeira geração é apenas aceitável, mas a qualidade é insuficiente e a renderização de texto não é confiável. Para cenários de e-commerce, recomendamos o Nano Banana Pro (alta qualidade) ou a segunda geração (melhor custo-benefício). No entanto, a primeira geração pode ser usada na fase inicial de seleção de produtos e exploração de estilo.

Resumo

O Nano Banana de primeira geração (gemini-2.5-flash-image) não é um "bom modelo de geração de imagens" — sua limitação de 1K e os erros de texto são falhas reais. No entanto, é uma excelente ferramenta de processamento de imagem de baixo custo, mantendo um valor único em 4 cenários:

- Transferência de estilo/padrão: Extração de estilo de uma imagem de referência para aplicar em uma nova, com forte capacidade de entrada de múltiplas imagens.

- Edição de imagem conversacional: Edição rápida orientada por linguagem natural, algo que a série Imagen não consegue fazer.

- Prototipagem em lote de baixo custo: US$ 0,025 por imagem, geração em 3 segundos, ideal para testes extensivos sem preocupações com custos.

- Consistência facial e fusão de múltiplas imagens: Manter a consistência de personagens entre diferentes cenas e fusão de 2-3 imagens de referência.

A forma mais inteligente de utilizá-lo é colocar a primeira geração no início do fluxo de trabalho para exploração e edição e, após definir a direção, usar a segunda geração ou o Pro para a versão final. O serviço proxy de API APIYI (apiyi.com) oferece acesso à API de toda a série de modelos Nano Banana; com uma única chave, você pode alternar livremente entre as três gerações e encontrar o equilíbrio ideal entre custo e qualidade para o seu cenário.

Autor deste artigo: Equipe Técnica APIYI

Troca técnica: Visite APIYI (apiyi.com) para obter a API de toda a série de modelos Nano Banana e suporte técnico.

Data de atualização: Abril de 2026

Versão aplicável: gemini-2.5-flash-image (planejado para descontinuação em 02/10/2026)

Referências:

- Documentação de geração de imagem do Google AI: ai.google.dev/gemini-api/docs/image-generation

- Preços da API Gemini: ai.google.dev/gemini-api/docs/pricing

- Lista de modelos Gemini: ai.google.dev/gemini-api/docs/models