Catatan Penulis: Meta merilis Llama 4 Scout dan Maverick, yang mengadopsi arsitektur MoE multimodal asli. Scout memiliki jendela konteks 10 juta token, sementara Maverick melampaui GPT-4o dalam evaluasi komprehensif. Artikel ini mengulas detail teknis dan dampaknya bagi pengembang.

Meta resmi merilis keluarga model Llama 4, dengan Llama 4 Scout dan Maverick sebagai model sumber terbuka (open-source) multimodal MoE asli pertama yang menarik perhatian luas komunitas AI. Artikel ini memberikan ulasan cepat mengenai dampak signifikan dari tonggak sejarah ini bagi pengembang AI dan industri secara keseluruhan.

Nilai Utama: Pahami terobosan teknis, performa evaluasi, dan nilai aplikasi praktis Llama 4 Scout dan Maverick dalam 3 menit.

Sekilas Informasi Utama Llama 4 Scout dan Maverick

| Item Informasi | Llama 4 Scout | Llama 4 Maverick |

|---|---|---|

| Tanggal Rilis | 5 April 2025 | 5 April 2025 |

| Tipe Arsitektur | Multimodal MoE Asli | Multimodal MoE Asli |

| Parameter Aktif | 17 Miliar | 17 Miliar |

| Jumlah Pakar | 16 | 128 |

| Total Parameter | 109 Miliar | 400 Miliar |

| Jendela Konteks | 10 Juta token | 1 Juta token |

| Lisensi Terbuka | Lisensi Llama | Lisensi Llama |

Penempatan Kunci Llama 4 Scout dan Maverick

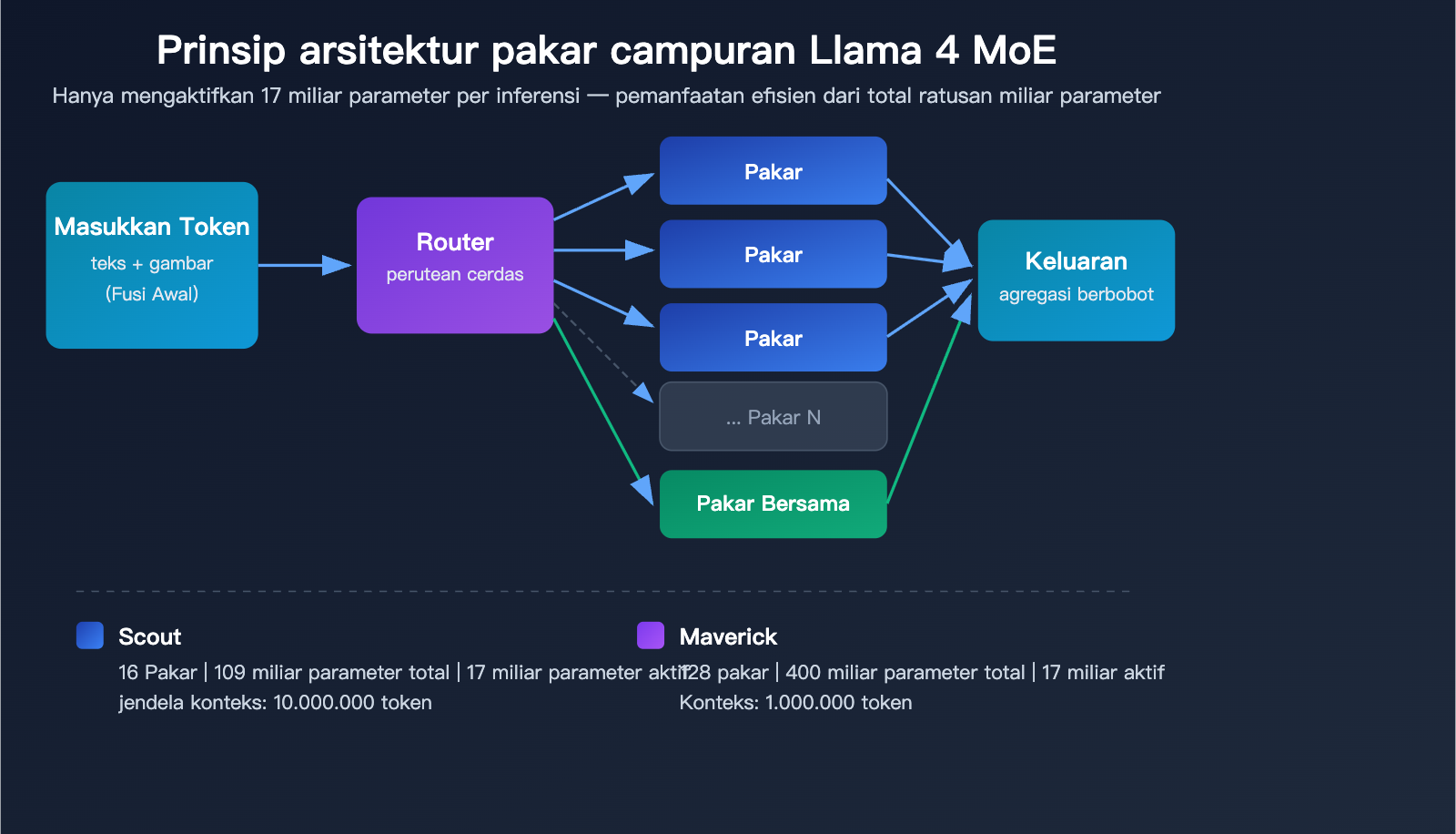

Llama 4 adalah keluarga Model Bahasa Besar generasi keempat yang diluncurkan oleh Meta, sekaligus menjadi versi pertama dalam seri Llama yang mengadopsi arsitektur multimodal asli dan Mixture of Experts (MoE). Dibandingkan dengan seri Llama 3 sebelumnya, Llama 4 telah mengalami perombakan mendasar pada tingkat arsitektur.

Scout diposisikan sebagai model pemrosesan teks panjang yang efisien, menawarkan jendela konteks 10 juta token terpanjang di industri dengan biaya inferensi yang sangat rendah. Sementara itu, Maverick diposisikan sebagai model serbaguna berkinerja tinggi, yang mencapai kemampuan komprehensif melampaui GPT-4o melalui 128 jaringan pakar.

Kedua model ini telah membuka akses unduhan bobot, dan pengembang dapat memperolehnya melalui llama.com serta Hugging Face.

Analisis Arsitektur Teknis Llama 4 Scout dan Maverick

Arsitektur Early Fusion Multimodal Native

Inovasi arsitektur terbesar Llama 4 terletak pada pelatihan multimodal native. Berbeda dengan pendekatan sebelumnya yang menyambungkan modul visual ke model bahasa di tahap akhir, Llama 4 menggunakan skema Early Fusion (fusi awal) sejak tahap pra-pelatihan, di mana token teks dan visual diintegrasikan langsung ke dalam jaringan tulang punggung model.

Ini berarti saat Llama 4 memahami konten campuran gambar dan teks, ia tidak lagi melakukan pemrosesan dua tahap "lihat gambar dulu baru bicara", melainkan benar-benar memahami dan menalar gambar serta teks sebagai satu kesatuan input.

Mekanisme Mixture of Experts (MoE) Llama 4

| Detail Teknis | Scout (16 Pakar) | Maverick (128 Pakar) |

|---|---|---|

| Total Parameter | 109 Miliar | 400 Miliar |

| Aktivasi per Inferensi | 17 Miliar parameter | 17 Miliar parameter |

| Jumlah Pakar Router | 16 + Pakar Bersama | 128 + Pakar Bersama |

| Efisiensi Inferensi | Bisa dijalankan di 1x H100 (INT4) | Bisa dijalankan di 1x H100 DGX |

| Arsitektur Konteks | iRoPE (tanpa atensi interleaving posisi) | Atensi Standar |

Keunggulan utama arsitektur MoE adalah: meskipun total parameter masing-masing mencapai 109 miliar dan 400 miliar, hanya 17 miliar parameter yang diaktifkan setiap kali inferensi. Hal ini memungkinkan Llama 4 Scout berjalan pada satu GPU NVIDIA H100 dengan kuantisasi INT4, yang secara drastis menurunkan hambatan penyebaran.

Data Pelatihan dan Skala Llama 4

Skala data pelatihan Llama 4 mencapai 30 triliun+ token, dua kali lipat dari Llama 3. Jumlah data multibahasa bahkan 10 kali lipat dari Llama 3, mencakup 200 bahasa. Pelatihan menggunakan presisi FP8, mencapai efisiensi pelatihan 390 TFLOPs per GPU pada model Behemoth.

Performa Evaluasi Llama 4 Scout dan Maverick

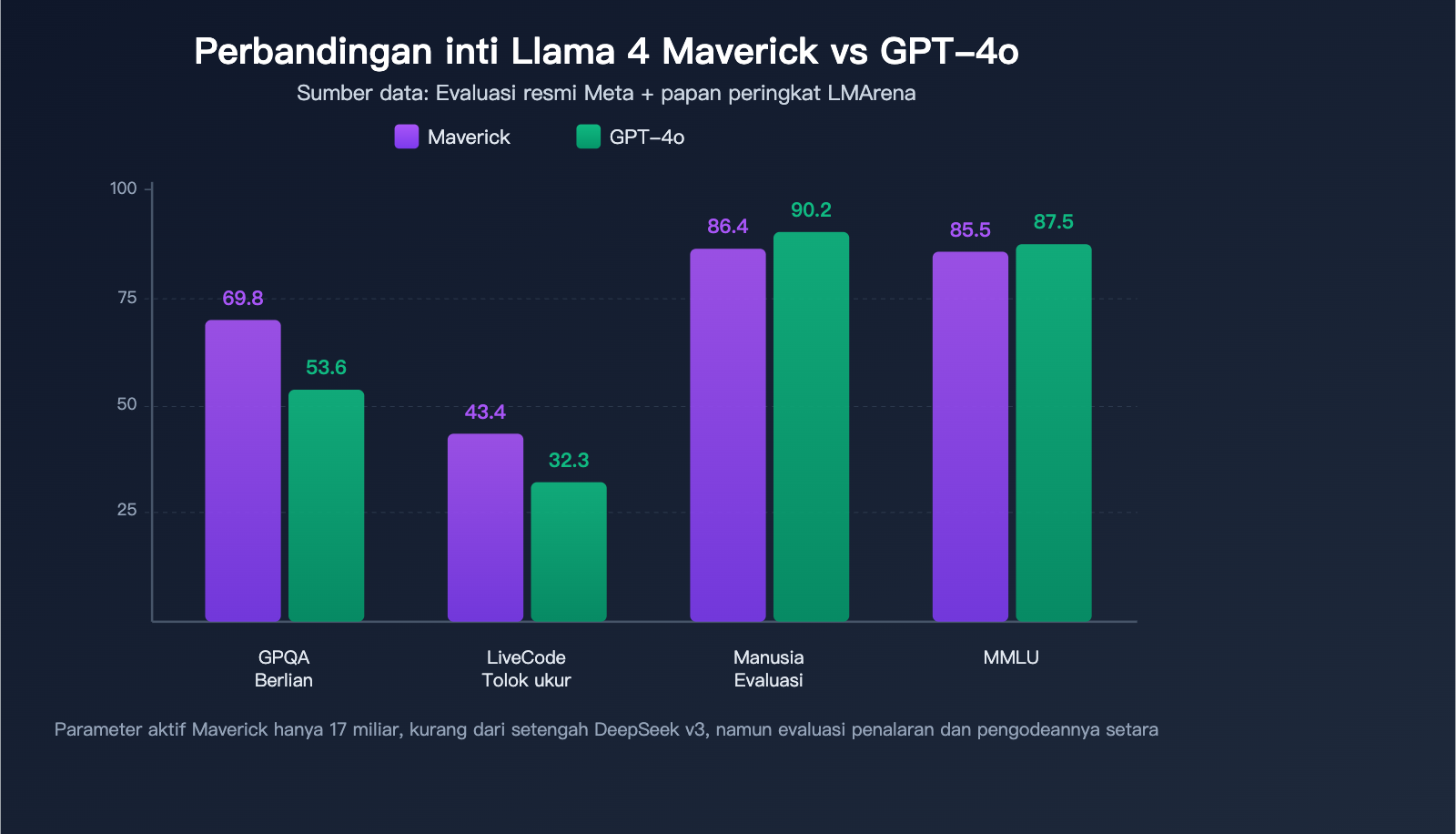

Data Evaluasi Llama 4 Maverick

Maverick tampil menonjol dalam berbagai evaluasi otoritatif, dengan kemampuan komprehensif yang melampaui GPT-4o dan Gemini 2.0 Flash:

| Tolok Ukur Evaluasi | Llama 4 Maverick | GPT-4o | Gemini 2.0 Flash | Penilaian |

|---|---|---|---|---|

| MMLU | 85.5 | ~87-88 | – | Mendekati puncak |

| GPQA Diamond | 69.8 | 53.6 | – | Unggul jauh |

| LiveCodeBench | 43.4 | 32.3 | – | Unggul signifikan |

| HumanEval | 86.4% | 90.2% | – | Mendekati setara |

| LMArena ELO | 1417 | Di bawah 1417 | Di bawah 1417 | Tingkat teratas |

Beberapa poin menarik yang patut diperhatikan:

Keunggulan Penalaran Ilmiah GPQA Diamond: Maverick mencetak skor 69,8 pada GPQA Diamond, lebih tinggi 16 poin persentase dibandingkan GPT-4o yang meraih 53,6, menunjukkan kemampuan penalaran disiplin profesional yang kuat.

Kemampuan Coding LiveCodeBench yang Menonjol: Dalam evaluasi pemrograman real-time LiveCodeBench, Maverick memimpin dengan skor 43,4 dibandingkan 32,3 milik GPT-4o, sekaligus setara dengan DeepSeek v3 dalam tugas penalaran dan coding—padahal jumlah parameter aktif Maverick kurang dari setengah DeepSeek v3.

Evaluasi Preferensi Manusia LMArena Tingkat Atas: Versi eksperimental Maverick memperoleh skor ELO 1417 di LMArena (Chatbot Arena), menjadikannya jajaran model top dunia.

Sorotan Evaluasi Llama 4 Scout

Sebagai model "kecil" dengan hanya 17 miliar parameter aktif, performa Scout sangat mengesankan:

- Melampaui Gemma 3, Gemini 2.0 Flash-Lite, dan Mistral 3.1 pada berbagai tolok ukur evaluasi.

- Melampaui semua model Llama 3 generasi sebelumnya, termasuk Llama 3.3 70B yang memiliki parameter lebih besar.

- Memiliki jendela konteks 10 juta token terpanjang di industri, yang dapat memproses sekitar 7,5 juta kata teks.

- Dapat dijalankan hanya dengan satu GPU H100, dengan biaya inferensi yang sangat rendah.

🎯 Saran Pengembang: Llama 4 Scout dan Maverick keduanya telah mendukung pemanggilan antarmuka yang kompatibel dengan OpenAI. Jika Anda perlu menguji efek aktual dari model-model ini dengan cepat, Anda bisa mendapatkan antarmuka API terpadu melalui platform APIYI (apiyi.com). Cukup satu kunci API untuk beralih memanggil berbagai model open-source maupun closed-source.

Dampak Llama 4 Scout dan Maverick bagi Pengembang

Nilai Aplikasi Jendela Konteks 10 Juta Token

Jendela konteks 10 juta token milik Scout adalah yang terpanjang di antara model yang dirilis ke publik saat ini. Kemampuan ini membuka ruang aplikasi baru bagi pengembang:

- Analisis Basis Kode Lengkap: Anda dapat memasukkan seluruh kode proyek skala menengah hingga besar ke dalam model untuk dianalisis sekaligus.

- Pemrosesan Dokumen Panjang: Memproses ratusan halaman dokumen teknis, kontrak hukum, atau makalah penelitian dalam sekali jalan.

- Memori Percakapan Multi-putaran: Mempertahankan memori konteks yang sangat panjang dalam aplikasi berbasis percakapan.

- Ekstraksi Data Skala Besar: Mengekstraksi informasi terstruktur secara massal dari teks tidak terstruktur dalam jumlah besar.

Dampak Ekosistem Open Source Llama 4

| Dimensi Dampak | Perubahan Spesifik | Keuntungan bagi Pengembang |

|---|---|---|

| Ambang Batas Deployment | Scout dapat dijalankan di satu GPU | Menurunkan biaya perangkat keras |

| Kemampuan Model | Melampaui level GPT-4o | Open source menyamai model tertutup |

| Multimodal | Pemahaman teks dan gambar asli | Tidak perlu modul visual tambahan |

| Konteks | 10 juta token | Skenario aplikasi baru |

| Kustomisasi | Fine-tuning bobot terbuka | Optimalisasi skenario vertikal |

Perilisan Llama 4 menandai pertama kalinya model open source menyamai atau bahkan melampaui kemampuan komprehensif model komersial tertutup arus utama. Bagi pengembang, ini berarti:

Keunggulan Biaya: Deployment privat berbasis Llama 4 dapat secara signifikan menurunkan biaya pemanggilan model, terutama untuk skenario produksi dengan frekuensi tinggi.

Kebebasan Kustomisasi: Bobot yang terbuka berarti pengembang dapat melakukan fine-tuning, kuantisasi, distilasi, dan operasi lainnya pada Llama 4 untuk membangun model khusus bagi skenario vertikal.

Ekosistem yang Berkembang: Pada hari peluncurannya, Llama 4 langsung didukung oleh berbagai platform cloud seperti AWS, Google Cloud, Azure, Together.ai, Groq, dan Fireworks.

Integrasi Platform Llama 4

Meta telah mengintegrasikan Llama 4 ke dalam platform media sosial mereka untuk memberikan kemampuan multimodal pada asisten Meta AI:

- WhatsApp: Mendukung pengiriman gambar untuk analisis AI dan percakapan.

- Messenger: Tanya jawab interaktif multimodal.

- Instagram Direct: Pemahaman gambar dan bantuan kreatif.

- Meta.ai: Penggunaan langsung melalui web.

Ini adalah pertama kalinya model bahasa besar AI dideploy langsung ke konsumen dalam skala sebesar ini, menjangkau miliaran pengguna.

Llama 4 Behemoth: Model Unggulan yang Masih dalam Pelatihan

Selain Scout dan Maverick, Meta juga memberikan bocoran mengenai model unggulan keluarga Llama 4, yaitu Behemoth:

| Parameter | Spesifikasi Behemoth |

|---|---|

| Parameter Aktif | 288 miliar |

| Jumlah Pakar | 16 |

| Total Parameter | Sekitar 2 triliun |

| Status Pelatihan | Sedang berlangsung |

Berdasarkan data checkpoint awal yang diumumkan Meta, Behemoth telah melampaui GPT-4.5, Claude Sonnet 3.7, dan Gemini 2.0 Pro dalam berbagai evaluasi STEM. Maverick memperoleh peningkatan kemampuan dari Behemoth melalui distilasi pengetahuan selama proses pelatihan, yang menjelaskan mengapa Maverick mampu mencapai performa tingkat atas dengan parameter aktif yang lebih kecil.

💡 Saran: Perilisan akhir Behemoth akan semakin mendorong batas atas kemampuan model open source. Saat ini, pengembang dapat mulai membangun aplikasi berbasis Scout dan Maverick, melakukan pengujian perbandingan multi-model di platform APIYI apiyi.com, dan beralih dengan mulus setelah Behemoth dirilis.

Akses Cepat Llama 4 Scout dan Maverick

Contoh Pemanggilan API yang Sangat Sederhana

Melalui antarmuka yang kompatibel dengan OpenAI, Anda dapat memanggil model Llama 4 hanya dengan 10 baris kode:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Memanggil model Llama 4

response = client.chat.completions.create(

model="meta-llama/llama-4-maverick",

messages=[{"role": "user", "content": "Jelaskan cara kerja arsitektur MoE"}]

)

print(response.choices[0].message.content)

Lihat contoh pemanggilan multimodal

import openai

import base64

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Membaca gambar lokal dan melakukan encoding

with open("image.jpg", "rb") as f:

image_data = base64.b64encode(f.read()).decode()

response = client.chat.completions.create(

model="meta-llama/llama-4-maverick",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": "Tolong jelaskan isi gambar ini"},

{"type": "image_url", "image_url": {

"url": f"data:image/jpeg;base64,{image_data}"

}}

]

}]

)

print(response.choices[0].message.content)

🚀 Mulai Cepat: Kami merekomendasikan untuk mendapatkan kunci API dan kuota uji coba gratis melalui APIYI (apiyi.com). Platform ini mendukung antarmuka terpadu untuk Llama 4 Scout, Maverick, dan model utama lainnya, sehingga memudahkan Anda membandingkan performa aktual antar model dengan cepat.

Pertanyaan Umum

Q1: Bagaimana cara memilih antara Llama 4 Scout dan Maverick?

Jika Anda perlu memproses teks yang sangat panjang (seperti basis kode lengkap atau analisis dokumen panjang), pilihlah Scout (jendela konteks 10 juta token). Jika Anda membutuhkan model serba guna dengan kemampuan paling komprehensif, pilihlah Maverick (128 pakar, hasil evaluasi melampaui GPT-4o). Keduanya dapat diuji performa aktualnya melalui platform APIYI (apiyi.com) untuk membantu Anda menentukan pilihan terbaik.

Q2: Apakah Llama 4 sepenuhnya gratis?

Llama 4 menggunakan lisensi Llama dengan bobot terbuka yang mengizinkan penggunaan komersial. Namun, perusahaan dengan pengguna aktif bulanan lebih dari 700 juta harus mengajukan izin khusus kepada Meta. Bagi sebagian besar pengembang dan perusahaan, model ini dapat digunakan secara gratis. Jika Anda tidak ingin melakukan deployment sendiri, Anda juga dapat memanggilnya sesuai kebutuhan melalui platform pihak ketiga seperti APIYI (apiyi.com).

Q3: Apakah Llama 4 Maverick benar-benar lebih kuat dari GPT-4o?

Pada evaluasi utama seperti GPQA Diamond (penalaran ilmiah) dan LiveCodeBench (pemrograman real-time), Maverick memang unggul secara signifikan dibandingkan GPT-4o. Pada MMLU dan HumanEval, keduanya memiliki performa yang setara. Dalam evaluasi preferensi manusia LMArena, Maverick juga mencapai skor ELO tingkat atas. Secara keseluruhan, Maverick berada di tingkat yang sama dengan GPT-4o dalam evaluasi komprehensif, bahkan memimpin di beberapa indikator.

Ringkasan

Poin-poin utama Llama 4 Scout dan Maverick:

- Inovasi Arsitektur: Model open-source MoE multimodal asli pertama, arsitektur Early Fusion mewujudkan pemahaman teks dan gambar yang benar-benar terintegrasi.

- Terobosan Performa: Maverick mengungguli GPT-4o lebih dari 16 poin persentase di GPQA Diamond, sementara Scout dengan 17 miliar parameter aktif melampaui Llama 3.3 70B.

- Transformasi Aplikasi: Jendela konteks 10 juta token dan bobot terbuka membuka skenario aplikasi baru serta kemungkinan penerapan bagi para pengembang.

Peluncuran Llama 4 menandai era baru bagi Model Bahasa Besar open-source. Baik untuk membangun aplikasi tingkat perusahaan maupun proyek pribadi, pengembang kini bisa mendapatkan kemampuan yang setara dengan model closed-source papan atas berbasis Llama 4. Kami merekomendasikan untuk mencoba seri model Llama 4 melalui APIYI di apiyi.com. Platform ini menyediakan kuota gratis dan antarmuka terpadu untuk berbagai model, membantu pengembang dalam pemilihan model secara efisien.

📚 Referensi

-

Blog Resmi Meta AI – Pengumuman Peluncuran Llama 4: Sumber otoritatif untuk detail teknis model dan data evaluasi.

- Tautan:

ai.meta.com/blog/llama-4-multimodal-intelligence - Keterangan: Berisi pengenalan arsitektur lengkap, data evaluasi, dan detail peluncuran.

- Tautan:

-

Situs Resmi Llama – Unduhan Model: Dapatkan bobot model dan dokumentasi Llama 4.

- Tautan:

llama.com/models/llama-4 - Keterangan: Menyediakan unduhan model, informasi lisensi, dan dokumentasi teknis.

- Tautan:

-

Hugging Face – Repositori Model Llama 4: Panduan penggunaan dan hosting komunitas open-source.

- Tautan:

huggingface.co/meta-llama - Keterangan: Menyediakan kartu model, versi kuantisasi, dan diskusi komunitas.

- Tautan:

Penulis: Tim Teknis APIYI

Diskusi Teknis: Silakan diskusikan pengalaman Anda menggunakan Llama 4 di kolom komentar. Untuk materi akses model AI lainnya, kunjungi pusat dokumentasi APIYI di docs.apiyi.com.