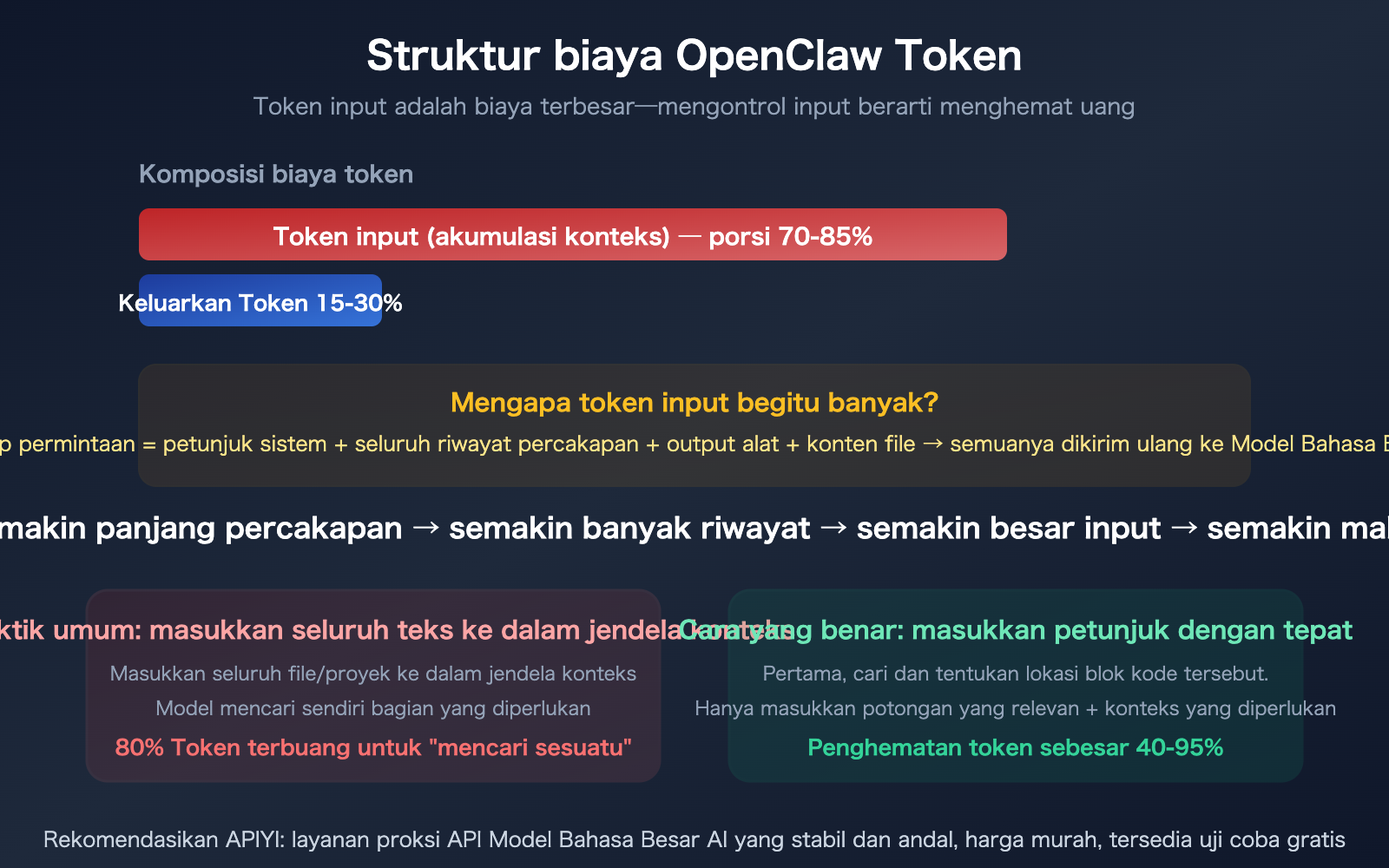

Catatan Penulis: Tanpa harus beralih ke saluran model yang murah, artikel ini akan mengupas tuntas bagaimana OpenClaw menghemat biaya dengan mengontrol panjang Token input: isolasi tugas percakapan baru, pengambilan blok kode yang presisi sebagai pengganti memasukkan seluruh teks, pemangkasan konteks, pencarian lokal QMD, dan 6 strategi lainnya.

OpenClaw dikenal sangat boros Token—ada pengguna yang menghabiskan 21,5 juta Token dalam sehari dengan tagihan bulanan lebih dari $600. Reaksi pertama banyak orang adalah beralih ke saluran model yang lebih murah, tetapi ini akan mengorbankan kualitas. Cara nyata untuk menghemat Token adalah dengan mengontrol sisi input—seberapa banyak konteks yang Anda berikan kepada model adalah faktor penentu biaya. Artikel ini berfokus pada satu pertanyaan inti: tanpa mengganti model dan tanpa menurunkan kualitas, bagaimana cara mengubah input dari "memasukkan seluruh teks" menjadi "memberikan input secara presisi".

Nilai Inti: Setelah membaca artikel ini, Anda akan menguasai 6 strategi praktis untuk mengontrol Token input, dengan potensi penghematan biaya Token sebesar 50-90%.

Poin Utama Penghematan Token OpenClaw

Mari kita tetapkan satu premis: artikel ini membahas metode penghematan token tanpa mengganti model dan tanpa menurunkan kualitas. Anda tetap menggunakan Claude Opus 3.5 atau GPT-4o dengan harga standar, modelnya tidak berubah, yang dihemat adalah sisi inputnya.

| Strategi | Rasio Hemat | Kesulitan Implementasi | Konsep Inti |

|---|---|---|---|

| Isolasi Tugas di Obrolan Baru | 60-80% | Rendah | Buka obrolan baru untuk setiap tugas independen, hindari akumulasi riwayat |

| Pengambilan Kode Presisi | 40-95% | Menengah | Hanya masukkan potongan kode yang relevan, jangan masukkan seluruh file |

| Pemangkasan Konteks | 30-50% | Rendah | Bersihkan riwayat obrolan yang tidak berguna secara manual atau otomatis |

| Pencarian Lokal QMD | 80-90% | Menengah | Pencarian vektor lokal, hanya kirim potongan yang relevan |

| Prompt Caching | 80-90% (biaya input) | Rendah | Manfaatkan cache untuk menghindari pengiriman ulang petunjuk sistem |

| Matikan Mode Thinking | 10-50x | Rendah | Matikan mode berpikir untuk tugas yang bukan penalaran |

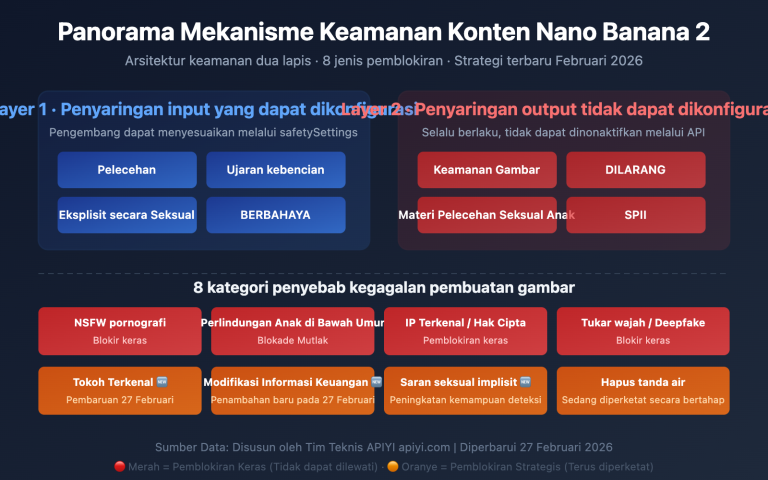

Mekanisme Dasar Konsumsi Token OpenClaw

Memahami cara menghemat token berarti memahami mengapa OpenClaw boros token.

Setiap kali Anda mengirim pesan di OpenClaw, sistem tidak hanya mengirim pesan Anda saat ini—tetapi mengirim seluruh riwayat obrolan kembali ke model. Semakin panjang obrolan, semakin besar token input untuk setiap permintaan.

Secara spesifik, input untuk satu permintaan mencakup:

- Petunjuk Sistem (System Prompt): Instruksi inti OpenClaw, biasanya 2000-5000 token

- AGENTS.md / SOUL.md: File konfigurasi ruang kerja

- Skill yang Dimuat: Setiap Skill yang diaktifkan memakan token

- Riwayat Obrolan Lengkap: Semua pesan dari awal sesi hingga sekarang

- Hasil Pemanggilan Alat: Output dari setiap pembacaan file atau eksekusi perintah

- Hasil Pencarian Memori: Konten relevan yang diambil dari basis memori

Dalam sesi OpenClaw yang berlangsung selama 30 menit, token input untuk pesan terakhir mungkin sudah mencapai 100 ribu hingga 1 juta—padahal sebagian besar konten dari 29 menit pertama sudah tidak berguna untuk tugas saat ini.

Strategi 1: Buka Obrolan Baru untuk Tugas Berbeda di OpenClaw

Ini adalah strategi yang paling sederhana namun paling efektif.

Mengapa Obrolan Baru Menghemat Token

Misalkan Anda melakukan 3 hal dalam sesi yang sama: Memperbaiki Bug A → Menulis Fitur B → Refaktorisasi Modul C. Pada tugas ketiga, input model berisi semua riwayat obrolan dan hasil pembacaan file dari dua tugas sebelumnya—padahal semua itu sama sekali tidak berguna untuk refaktorisasi Modul C.

Sesi yang sama:

Riwayat obrolan Tugas A (20K Token)

+ Konten file Tugas A (30K Token)

+ Riwayat obrolan Tugas B (25K Token)

+ Konten file Tugas B (40K Token)

+ Pesan saat ini Tugas C (5K Token)

= 120K Token input (di mana 115K adalah beban sejarah)

Sesi baru:

Pesan saat ini Tugas C (5K Token)

+ Petunjuk sistem (3K Token)

= 8K Token input (hemat 93%)

Praktik Terbaik dalam Skenario Obrolan

| Skenario | Apakah perlu buka obrolan baru? | Alasan |

|---|---|---|

| Beralih ke tugas yang benar-benar berbeda | Ya | Konteks tugas sebelumnya sama sekali tidak berguna |

| Penyesuaian iteratif fitur yang sama | Tidak | Memerlukan konteks diskusi sebelumnya |

| Memperbaiki Bug berbeda di file berbeda | Ya | Setiap Bug independen, tidak butuh konteks silang |

| Modifikasi berkelanjutan pada modul yang sama | Tidak | Model perlu memahami niat modifikasi sebelumnya |

| Obrolan melebihi 20 putaran | Ya atau ringkas | Akumulasi riwayat sudah terlalu banyak |

🎯 Saran Praktis: Standar penilaian yang sederhana—jika Anda perlu mengatakan "lupakan yang sebelumnya, sekarang kerjakan hal lain", maka langsung buka obrolan baru.

Prinsip ini tidak hanya berlaku untuk OpenClaw, tetapi juga untuk Claude Code dan alat pengodean AI lainnya. Setiap permintaan API independen yang dipanggil melalui APIYI (apiyi.com) secara alami adalah "sesi baru", sehingga tidak ada masalah akumulasi konteks.

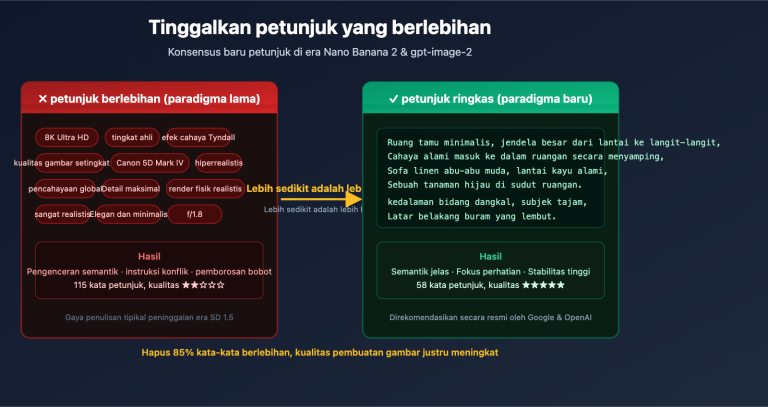

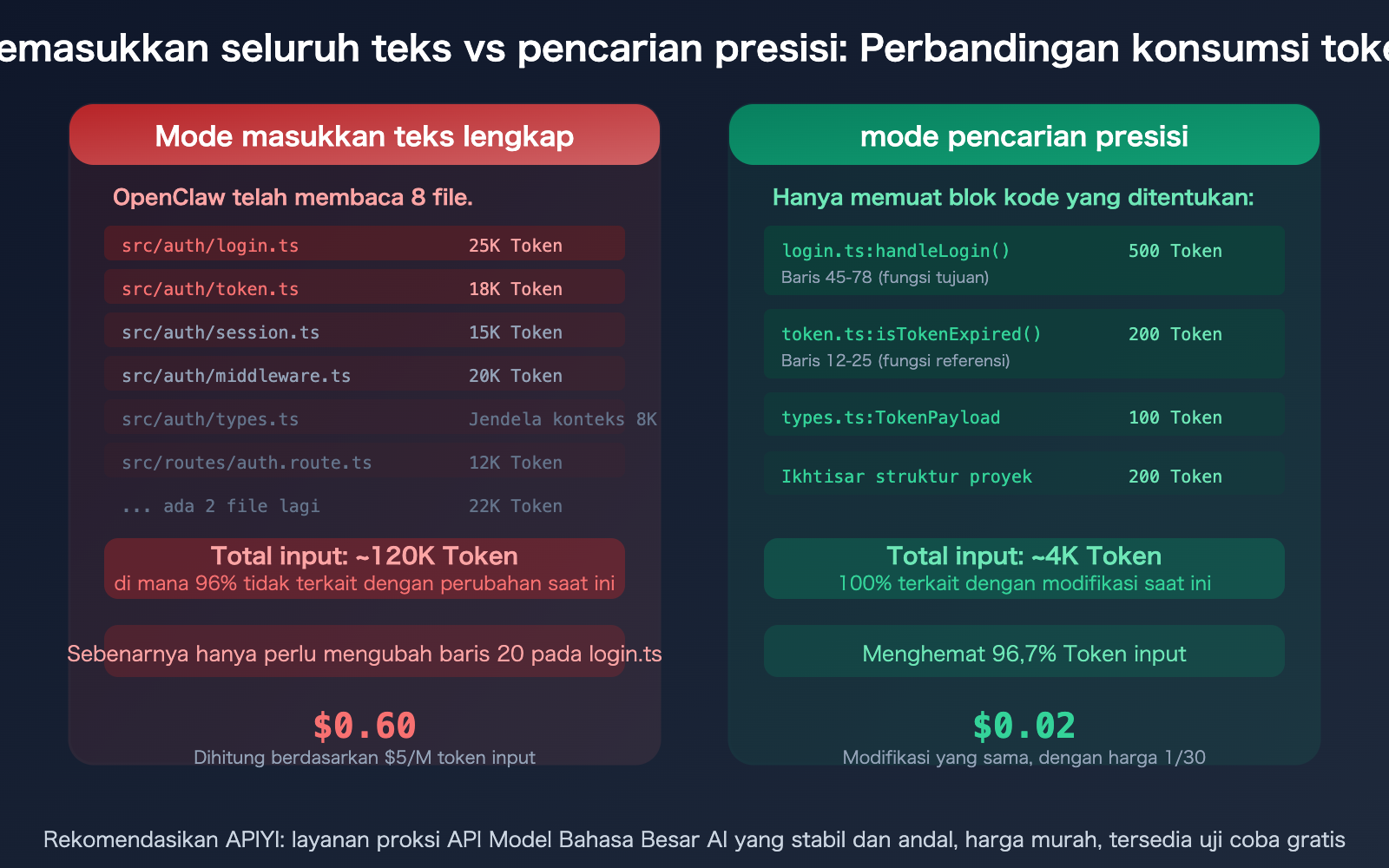

Strategi 2: Pengambilan Blok Kode Presisi OpenClaw, Jangan Masukkan Seluruh File

Ini adalah poin inti dari artikel ini—bagaimana cara agar model hanya melihat blok kode yang perlu diubah, alih-alih memasukkan seluruh file atau bahkan seluruh proyek?

Esensi Masalah: Mengapa "Memasukkan Seluruh File" Itu Pemborosan

Data penelitian menunjukkan bahwa 80% Token pada Agen pengodean AI terbuang percuma untuk "mencari sesuatu". Skenario tipikal: Anda meminta OpenClaw untuk mengubah satu fungsi, ia malah membaca 25 file hanya untuk menemukan 3 fungsi yang benar-benar relevan—biaya Token untuk membaca 25 file tersebut dibebankan sepenuhnya kepada Anda.

Satu file berisi 1000 baris kode setara dengan sekitar 15.000-25.000 Token. Jika Anda hanya perlu mengubah 20 baris (sekitar 300-500 Token), namun seluruh file diberikan kepada model, maka 96-98% Token input Anda terbuang sia-sia.

4 Cara OpenClaw Melakukan Pengambilan Blok Kode Secara Presisi

Metode 1: Tentukan File dan Nomor Baris Secara Spesifik

Jangan katakan "perbaiki fitur login", tetapi katakan "ubah fungsi handleLogin di src/auth/login.ts pada baris 45-78". Semakin presisi instruksi Anda, semakin sedikit file yang dibaca OpenClaw.

❌ "Perbaiki Bug login"

→ OpenClaw membaca 10+ file, menghabiskan 200K+ Token

✅ "Perbaiki pemeriksaan null pointer pada baris 52 di src/auth/login.ts"

→ OpenClaw hanya membaca bagian relevan dari 1 file, menghabiskan ~20K Token

Metode 2: Manfaatkan Pencarian Semantik Lokal QMD

QMD (Quick Memory Database) milik OpenClaw dapat membangun indeks vektor secara lokal. Setelah mengambil potongan kode yang relevan, ia hanya akan mengirimkan konten yang paling sesuai kepada model.

Cara mengaktifkan: Aktifkan QMD di pengaturan OpenClaw, maka ia akan secara otomatis mengindeks file proyek dan riwayat percakapan Anda. Saat melakukan kueri berikutnya, QMD akan mencari blok kode terkait secara lokal dan hanya mengirimkan potongan yang cocok secara presisi ke model.

Metode 3: Gunakan Sintaks @file untuk Referensi Langsung

Di OpenClaw, Anda dapat menggunakan sintaks @file untuk mereferensikan file secara akurat, guna menghindari model melakukan pencarian mandiri:

Ubah fungsi handleLogin di @src/auth/login.ts,

tambahkan logika penanganan untuk refreshToken yang kedaluwarsa.

Referensi metode isTokenExpired di @src/token.ts.

Dengan cara ini, OpenClaw hanya akan memuat 2 file yang Anda tentukan, alih-alih memindai seluruh direktori src/auth/.

Metode 4: Panduan Struktur Proyek

Tuliskan gambaran umum struktur proyek di dalam AGENTS.md atau SOUL.md agar OpenClaw mengetahui "fitur mana ada di file mana", sehingga mengurangi pemindaian file secara eksploratif.

## Struktur Proyek

- Terkait Autentikasi: src/auth/ (login.ts, token.ts, session.ts)

- Manajemen Pengguna: src/user/ (profile.ts, settings.ts)

- Rute API: src/routes/ (auth.route.ts, user.route.ts)

Gambaran umum ini sendiri hanya memakan beberapa ratus Token, tetapi dapat membantu OpenClaw menghemat puluhan ribu Token dari pemindaian file yang tidak perlu.

Strategi 3 hingga 6: Teknik Lanjutan Hemat Token OpenClaw

Strategi 3: Pemangkasan Konteks (Context Pruning)

OpenClaw mendukung pemangkasan konteks secara manual maupun otomatis. Saat percakapan terlalu panjang, Anda bisa membersihkan riwayat pesan yang tidak lagi diperlukan.

OpenClaw 2026.3.7 memperkenalkan Context Engine Plugins, yang memungkinkan plugin pihak ketiga menyediakan strategi manajemen konteks alternatif (sebelumnya bagian ini dikodekan secara permanen di inti sistem). Plugin lossless-claw dapat memadatkan riwayat percakapan tanpa kehilangan informasi penting.

Saran praktis:

- Setelah menyelesaikan setiap sub-tugas, bersihkan output pemanggilan alat yang tidak relevan secara manual

- Atur

contextTokens: 50000untuk membatasi ukuran jendela konteks - Gunakan fitur compact untuk memadatkan riwayat percakapan

Strategi 4: Pencarian Semantik Lokal QMD

QMD (Quick Memory Database) adalah fitur pencarian vektor lokal OpenClaw. Fitur ini membangun basis data vektor pada perangkat lokal untuk mengindeks riwayat percakapan dan dokumen. Saat melakukan kueri, sistem akan mencari konten yang relevan secara lokal terlebih dahulu, lalu hanya mengirimkan potongan yang paling relevan ke model.

Hasilnya: Mengurangi biaya Token input sebesar 80-90%.

Strategi 5: Memanfaatkan Prompt Caching

Keluarga model Claude dan GPT mendukung Prompt Caching—ketika petunjuk sistem atau konteks yang sering digunakan tidak berubah, API secara otomatis menggunakan versi yang di-cache, sehingga biaya Token input berkurang 80-90%.

Namun, ada batasan utama: Pemanggilan Claude melalui format yang kompatibel dengan OpenAI (/v1/chat/completions) tidak mendukung Prompt Caching; Anda harus menggunakan format asli Anthropic (/v1/messages). Jika Anda memanggil melalui APIYI apiyi.com, platform tersebut mendukung Prompt Caching dengan format asli.

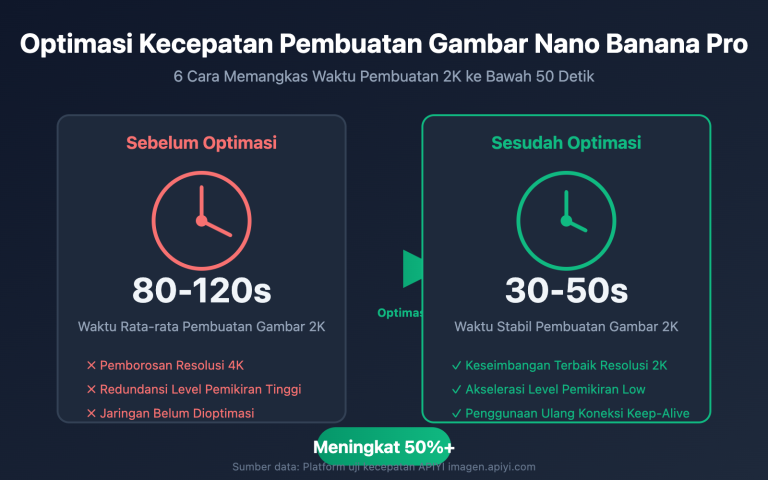

Strategi 6: Matikan Thinking untuk Tugas Non-Penalaran

Mode Thinking/Reasoning akan membuat konsumsi Token melonjak 10-50 kali lipat. Jika tugas saat ini tidak memerlukan penalaran mendalam (seperti pemformatan sederhana, pemindahan file, atau penggantian teks), mematikan mode Thinking dapat menghemat biaya secara signifikan.

| Jenis Tugas | Perlu Thinking? | Perbedaan Token |

|---|---|---|

| Analisis Bug Kompleks | Ya | Konsumsi normal |

| Desain Arsitektur | Ya | Konsumsi normal |

| Pemformatan Sederhana | Tidak | Hemat 10-50x jika dimatikan |

| Pindah/Ganti Nama File | Tidak | Hemat 10-50x jika dimatikan |

| Buat Kode Boilerplate | Tergantung | Template simpel bisa dimatikan |

Tips: Context Compaction pada Claude Code dan Context Pruning pada OpenClaw menyelesaikan masalah yang sama—mengontrol akumulasi Token input. Jika Anda menggunakan kedua alat tersebut, Anda dapat mengelola kuota pemanggilan API secara terpusat melalui APIYI apiyi.com.

Perbandingan Hemat Token OpenClaw dan Claude Code

Kedua alat menghadapi masalah yang sama, namun dengan solusi yang berbeda.

Pertanyaan Umum

Q1: Apa yang harus dilakukan jika model tidak memahami latar belakang proyek setelah memulai percakapan baru?

Manfaatkan sistem Memory OpenClaw dan file AGENTS.md. Memory akan secara otomatis mengambil informasi latar belakang proyek yang relevan dalam sesi baru (hanya mengirimkan potongan yang paling relevan, bukan seluruh riwayat). Tuliskan struktur proyek dan kesepakatan utama dalam AGENTS.md, yang akan dimuat secara otomatis di setiap sesi baru—ini jauh lebih efisien daripada membawa seluruh riwayat percakapan 20 putaran.

Q2: Bagaimana cara mengetahui berapa banyak Token yang digunakan dalam sesi saat ini?

Catatan percakapan OpenClaw disimpan dalam file JSONL di direktori .openclaw/agents.main/sessions/, Anda dapat langsung memeriksa jumlah Token untuk setiap permintaan. Cara yang lebih mudah adalah menggunakan panel penggunaan penyedia API—saat melakukan pemanggilan melalui APIYI apiyi.com, Anda dapat melihat konsumsi Token dan biaya yang tepat untuk setiap permintaan di dasbor.

Q3: Apa perbedaan antara QMD dan pencarian langsung menggunakan grep?

grep adalah pencocokan tepat—jika Anda mencari "handleLogin", Anda hanya akan menemukan tempat yang berisi string tersebut. QMD adalah pencarian semantik—jika Anda mencari "penanganan error login pengguna", ia dapat menemukan semua blok kode yang relevan secara semantik, meskipun kode tersebut tidak mengandung string "login" atau "penanganan error". Akurasi pencarian semantik jauh lebih tinggi, konten yang tidak relevan yang dikirim ke model lebih sedikit, sehingga lebih hemat Token.

Q4: Mengapa Heartbeat menghabiskan banyak Token?

Mekanisme Heartbeat (detak jantung) OpenClaw secara berkala memeriksa status tugas. Jika interval yang diatur terlalu singkat (misalnya setiap 5 menit), setiap detak jantung akan mengirimkan konteks percakapan lengkap ke model—beberapa pengguna mendapati fitur pemeriksaan email otomatis menghabiskan $50 dalam sehari. Solusinya: perpanjang interval detak jantung, atau hentikan Heartbeat saat pemantauan otomatis tidak diperlukan.

Kesimpulan

Poin utama untuk menghemat Token di OpenClaw (tanpa mengganti model dan tanpa menurunkan kualitas):

- Token input adalah biaya terbesar (70-85%): Mengirim ulang seluruh riwayat percakapan di setiap permintaan membuat percakapan semakin panjang semakin mahal. Cara paling mudah untuk berhemat adalah dengan memulai percakapan baru untuk tugas yang berbeda.

- Pengambilan blok kode yang akurat adalah pengungkit terbesar: Dari "memasukkan seluruh teks" (120K Token) menjadi "memberikan data secara akurat" (4K Token), modifikasi yang sama menghemat 96%. Caranya: tentukan nomor baris file secara spesifik, gunakan referensi @file, pencarian semantik QMD, dan deklarasi struktur AGENTS.md.

- Jalur optimasi tiga tahap: Hasil dalam 5 menit (percakapan baru + matikan Thinking, hemat 50%) → Hasil dalam 30 menit (instruksi akurat + batasi konteks, hemat 80%) → Jangka panjang (QMD + Caching, hemat 97%).

Disarankan untuk mengelola pemanggilan API OpenClaw melalui APIYI apiyi.com. Platform ini menyediakan statistik penggunaan Token yang akurat dan pemantauan biaya, membantu Anda mengukur hasil nyata dari setiap optimasi yang dilakukan.

📚 Referensi

-

Panduan Penggunaan Token dan Kontrol Biaya OpenClaw: Dokumentasi resmi manajemen Token

- Tautan:

docs.openclaw.ai/reference/token-use - Penjelasan: Berisi konfigurasi contextTokens dan optimasi Heartbeat

- Tautan:

-

Praktik Hemat Token OpenClaw: Dari $600 Turun ke $20: Kerangka kerja optimasi tiga tahap yang lengkap

- Tautan:

blog.laozhang.ai/en/posts/openclaw-save-money-practical-guide - Penjelasan: Berisi parameter konfigurasi spesifik dan estimasi rasio penghematan

- Tautan:

-

80% Token Agen Coding AI Terbuang untuk Mencari Data: Studi tentang akurasi konteks

- Tautan:

medium.com/@jakenesler/context-compression-to-reduce-llm-costs - Penjelasan: Menjelaskan mengapa pencarian presisi lebih efektif daripada memperbesar jendela konteks

- Tautan:

-

Pusat Dokumentasi APIYI: Statistik penggunaan Token dan pemantauan biaya

- Tautan:

docs.apiyi.com - Penjelasan: Mendukung manajemen pemanggilan model untuk OpenClaw dan Claude Code

- Tautan:

Penulis: Tim Teknis APIYI

Diskusi Teknis: Silakan berdiskusi di kolom komentar, untuk materi lebih lanjut kunjungi pusat dokumentasi APIYI di docs.apiyi.com