2026 年 5 月 6 日,xAI 向所有 API 用户群发了一封标题为「Grok 4.3 release and xAI API model retirement」的官方邮件,一次性传递了两条对开发者影响最大的消息:Grok 4.3 已经全量上线 API,同时 grok-4-fast、grok-4-0709、grok-3、grok-code-fast-1、grok-imagine-image-pro 等 8 款老模型将于 2026 年 5 月 15 日 12:00 PT 集中下线。这份邮件背后,既是一次重大版本迭代,也是一次需要在 9 天内完成的迁移倒计时。

Grok 4.3 这次发布最值得关注的不是名字升级,而是 1M token 上下文窗口、$1.25/$2.50 的输入输出定价以及 3 档可调推理强度的组合。这个价格档位让 Grok 4.3 直接进入了与 Gemini 3.1 Pro、GPT-5.4 同价位的主流推理模型竞争区间,但保留了 xAI 一贯的高 token 吞吐速度优势。我们建议有 Grok 系列依赖的团队尽早通过 API易 apiyi.com 平台进行接入测试,统一的 OpenAI 兼容接口可以让多模型切换的迁移成本降到最低。

Grok 4.3 核心规格与定价全面解读

Grok 4.3 是 xAI 在邮件中明确称为「the fastest, most intelligent model we've ever built」的最新一代旗舰模型。它在 agentic tool calling 与 instruction following 两条排行榜上都位列前排,定位是覆盖代码、Agent、复杂推理的通用型旗舰。从规格上看,Grok 4.3 把上下文窗口从 Grok 4 时代的 256K 直接扩展到 1M token,与 Gemini 3 Pro、Claude 4.7 同档位,意味着可以单次塞入完整的代码库或长篇技术文档。

下表汇总了 Grok 4.3 在 xAI API 上的核心参数,所有数据均来自 xAI 官方邮件与 Artificial Analysis 第三方实测页面。

| 参数项 | Grok 4.3 取值 | 备注说明 |

|---|---|---|

| 上下文窗口 | 1,000,000 token | 输入 + 输出共享 |

| 输入定价 | $1.25 / 1M token | 比 GPT-5.4 低 50%,与 Gemini 3.1 Pro 持平 |

| 输出定价 | $2.50 / 1M token | 比 Grok 4 时代的 $15 下调约 83% |

| 推理强度 | low / medium / high 共 3 档 | 通过参数控制深度推理预算 |

| 输入模态 | 文本 + 图像 | 支持视觉理解 |

| 输出模态 | 文本 | 不直接生图 |

| 工具调用 | 原生 function calling | 支持结构化输出与并行调用 |

| 输出速度 | 约 207 tokens/s | Artificial Analysis 实测 |

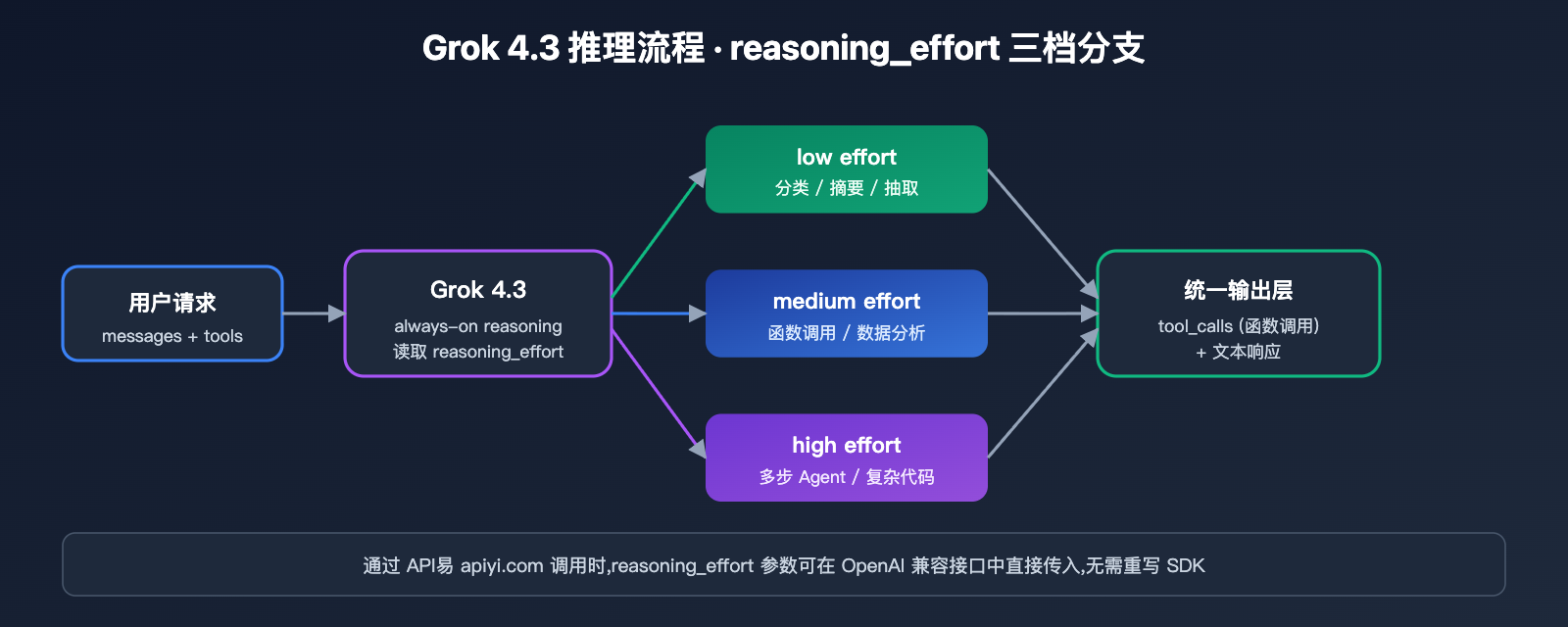

3 档推理强度(reasoning effort)是 Grok 4.3 区别于上一代的关键新特性,它允许开发者根据任务复杂度调节模型「思考」深度,直接影响延迟与成本。这一机制借鉴自 OpenAI 的 reasoning_effort 设计,但 xAI 把推理本身设为「always-on」常驻状态,只是允许调节深度。下表整理了 3 档强度的典型适用场景与影响。

| 推理强度 | 典型场景 | 延迟特征 | 成本影响 |

|---|---|---|---|

| low | 简单分类、摘要、规则化抽取 | 接近非推理模型 | 输出 token 量最小 |

| medium | 函数调用、数据分析、代码补全 | 平衡延迟与质量 | 默认推荐档位 |

| high | 多步 Agent、复杂数学、长链路代码 | 较长 thinking 阶段 | 输出 token 显著增加 |

🎯 接入建议: 对于不确定该选哪一档的团队,我们建议先在 API易 apiyi.com 平台上用 medium 档跑一组真实业务样本,再根据准确率与成本回报决定是否升级到 high 档。统一接口可以让 reasoning_effort 参数在不同模型间一键切换,无需重写 SDK。

Grok 4.3 在 agentic 与 instruction following 排行榜的实测表现

Grok 4.3 之所以能在邮件里被 xAI 重点强调「tops leaderboards in agentic tool calling and instruction following」,核心数据来自 Artificial Analysis、τ²-Bench、IFBench、GDPval-AA 等第三方榜单。Artificial Analysis Intelligence Index 给出的综合得分是 53.2,跑完整套评测的总成本约 $395,比 Grok 4.20 节省约 20%。在 τ²-Bench Telecom(模拟电信客服双向工具调用)这条最贴近真实 Agent 场景的榜单上,Grok 4.3 拿到了 98% 的成绩,相比 Grok 4.20 提升了 5 个百分点,与 GLM-5.1 持平。

对开发者而言,更值得关注的是 GDPval-AA 这条衡量真实经济价值的工作流榜单。Grok 4.3 在 GDPval-AA 上拿到 1500 ELO,比上一代 Grok 4.20 0309 v2 的 1179 ELO 直接提升 321 分,反超 Gemini 3.1 Pro Preview、Muse Spark、GPT-5.4 mini(xhigh)、Kimi K2.5 等模型。Instruction Following 方面,Grok 4.3 在 IFBench 上保持 81% 的成绩,与 Grok 4.20 0309 v2 持平。

| 基准测试 | Grok 4.3 成绩 | 同档参考 | 主要考察能力 |

|---|---|---|---|

| AA Intelligence Index | 53.2 | 优于 98% 受测模型 | 综合智能 |

| AA Coding Index | 41.0 | 优于 89% 受测模型 | 编码与重构 |

| τ²-Bench Telecom | 98% | 与 GLM-5.1 持平 | 工具调用 + 用户协同 |

| IFBench | 81% | 与 Grok 4.20 持平 | 复杂指令遵循 |

| GDPval-AA | ELO 1500 | 反超 Gemini 3.1 Pro Preview | 真实工作流价值 |

需要注意的是,Grok 4.3 的强项在 Agent 工作流与工具调用,而不是纯算法竞赛。对于代码 Agent、Browser Agent、客服 Bot 这类需要稳定 JSON 输出与多轮工具调用的应用,Grok 4.3 的可靠性会比上一代有明显提升。但如果团队的核心场景是 SWE-bench 类的纯代码合成,我们建议在 API易 apiyi.com 平台上把 Grok 4.3、Claude 4.7 Opus、GPT-5.4 都拉到同一组测试集里跑一遍,再根据通过率决定主力模型。

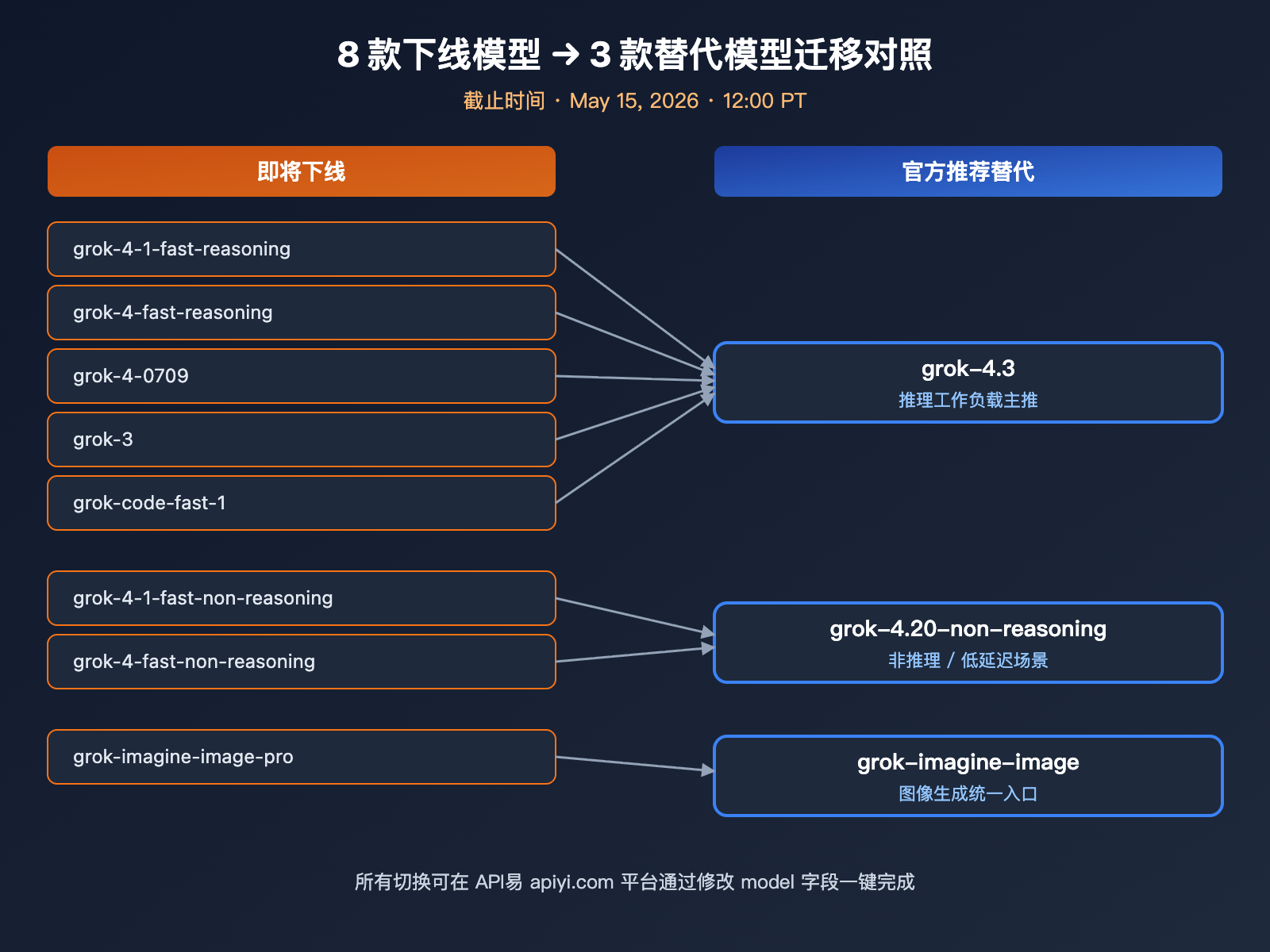

xAI API 模型下线清单与每款模型的迁移建议

xAI 这次同时下线 8 款模型,跨度覆盖文本推理、代码模型与图像生成,基本上把 Grok 4 时代的整套 SKU 一次性清理。对于业务里直接 hard-code 模型名的团队,这是一次必须在 9 天内完成代码改造的硬性截止。下表整理了所有受影响模型与官方推荐的替代路径。

| 即将下线模型 | 类型 | 官方推荐替代 | 迁移备注 |

|---|---|---|---|

| grok-4-1-fast-reasoning | 推理 | grok-4.3 | 推理质量提升,价格下降 |

| grok-4-1-fast-non-reasoning | 非推理 | grok-4.20-non-reasoning | 保留低延迟特性 |

| grok-4-fast-reasoning | 推理 | grok-4.3 | 同时获得 1M 上下文 |

| grok-4-fast-non-reasoning | 非推理 | grok-4.20-non-reasoning | API 形态保持兼容 |

| grok-4-0709 | 推理 | grok-4.3 | 早期 Grok 4 快照下线 |

| grok-code-fast-1 | 代码 | grok-4.3 | 代码场景统一到 4.3 |

| grok-3 | 通用 | grok-4.3 | Grok 3 时代正式终结 |

| grok-imagine-image-pro | 图像生成 | grok-imagine-image | 图像生成 SKU 简化 |

下线时间是 2026 年 5 月 15 日 12:00 PT(北京时间 5 月 16 日凌晨 3 点),截止时间一过,所有发往这 8 个模型 ID 的请求都会直接报错。从 5 月 6 日邮件发出算起,留给开发者的窗口是 9 天,对中大型业务来说是一个非常紧张的时间表。我们建议把迁移工作拆成 3 步:第一步定位代码里所有 hard-code 的模型 ID,第二步在 API易 apiyi.com 平台上跑一套灰度测试,第三步通过环境变量切换实际 model 字段而不是修改业务逻辑。

特别提醒一下,grok-code-fast-1 是过去半年里很多代码 Agent 项目的默认模型,它的下线意味着所有依赖这个 ID 的 Cursor 类工具、IDE 插件、CLI Agent 都需要切到 grok-4.3。代码场景下,Grok 4.3 的工具调用稳定性比 grok-code-fast-1 更好,但单 token 成本略高,需要重新评估调用预算。

Grok 4.3 与 GPT-5.4、Claude 4.7、Gemini 3.1 Pro 横向对比

Grok 4.3 落地的 2026 年第二季度,前沿模型市场正处于历史上最激烈的竞争期。Claude Opus 4.7 在 SWE-bench Verified 上保持 87.6% 的领先,Gemini 3.1 Pro 在 GPQA Diamond 取得 94.3%,GPT-5.4 在长文本推理稳定性上仍是基线参考。Grok 4.3 的卡位则是「中等智商 + 极低价格 + 极强 Agent 工具链」,主打成本敏感的高频调用场景。

下表把 4 个旗舰模型在常见维度上的关键数据放到一起对比,价格单位均为美元每百万 token。

| 模型 | 输入价 | 输出价 | 上下文 | 主要优势场景 |

|---|---|---|---|---|

| Grok 4.3 | $1.25 | $2.50 | 1M | Agent 工具链、高频调用、中等推理 |

| GPT-5.4 | $2.50 | $15.00 | 400K | 长文本一致性、复杂规划 |

| Claude 4.7 Opus | $15.00 | $75.00 | 1M | 顶级编码、文档写作、深度分析 |

| Gemini 3.1 Pro | $2.00 | $12.00 | 2M | 多模态、视频理解、超长文档 |

从这张对比表能直观看到一个事实:Grok 4.3 的输出 token 价格比 Claude 4.7 Opus 便宜 30 倍,比 Gemini 3.1 Pro 便宜约 4.8 倍。对于高频调用的客服 Agent、代码 Linter、批量数据清洗这类业务,Grok 4.3 的单位成本优势会被无限放大。但在需要极致编码质量或多模态理解的场景,Claude 4.7 Opus 与 Gemini 3.1 Pro 仍然是不可替代的。

🎯 多模型策略建议: 我们建议把 Grok 4.3 用作高频通用层、Claude 4.7 Opus 用作复杂代码与文档输出层、Gemini 3.1 Pro 用作多模态层,通过 API易 apiyi.com 的统一接口在业务路由层做模型分发,这样既能享受 Grok 4.3 的低成本红利,也能在关键节点用上更强的模型。

Grok 4.3 API 迁移指南与代码示例

迁移到 Grok 4.3 在工程层面非常直接,xAI 提供 OpenAI 兼容的 chat completions 接口,大部分迁移工作就是修改 base_url 与 model 字段。对于已经使用 OpenAI SDK 的项目,下面这份极简 Python 示例就是完整的接入代码。

from openai import OpenAI

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1",

)

resp = client.chat.completions.create(

model="grok-4.3",

messages=[

{"role": "user", "content": "用一句话解释 reasoning effort"},

],

extra_body={"reasoning_effort": "medium"},

)

print(resp.choices[0].message.content)

把 base_url 指向 API易 apiyi.com 平台后,业务侧就同时拥有了 Grok 4.3、Claude 4.7、GPT-5.4、Gemini 3.1 Pro 的统一调用入口,后续切换模型只需要改 model 参数,不需要重写鉴权与路由代码。这种统一抽象在 5 月 15 日下线截止前能显著降低迁移风险。

针对老模型的迁移,我们整理了一份从老模型 ID 切到新模型 ID 的最小改动对照,可以直接套用到代码里。

| 旧 model 字段 | 新 model 字段 | 是否需要改其他参数 |

|---|---|---|

| grok-3 | grok-4.3 | 可选加 reasoning_effort |

| grok-4-0709 | grok-4.3 | 可选加 reasoning_effort |

| grok-4-fast-reasoning | grok-4.3 | 可选加 reasoning_effort |

| grok-4-fast-non-reasoning | grok-4.20-non-reasoning | 无需修改其他参数 |

| grok-code-fast-1 | grok-4.3 | 建议 reasoning_effort=high |

| grok-imagine-image-pro | grok-imagine-image | 图像 API 端点保持一致 |

Grok 4.3 常见问题 FAQ

Q1: Grok 4.3 真的支持 1M 上下文吗?长文本性能会衰减吗?

是的,Grok 4.3 在 xAI API 上正式提供 1M token 上下文窗口,与 Claude 4.7 Opus 同档。但和所有长上下文模型一样,在 600K 之后的需求理解会出现一定衰减,我们建议关键信息放在文档前半部分。可以通过 API易 apiyi.com 平台先用真实业务长文档跑一组检索召回率测试,再决定是否把 Grok 4.3 作为长文本主力。

Q2: 推理强度 low / medium / high 该怎么选?

低风险任务(分类、摘要、规则抽取)用 low,常规业务(客服、函数调用、数据分析)用 medium,复杂推理(多步 Agent、长链路代码、复杂数学)用 high。high 档会显著增加输出 token 与延迟,建议结合预算与延迟 SLA 评估。

Q3: 5 月 15 日 12:00 PT 之后,老模型还能继续用吗?

不能。xAI 邮件明确写到「After May 15, 2026, requests to these models will no longer work」,过期请求会直接返回错误。所有 hard-code 老 model ID 的代码必须在截止前完成切换。

Q4: 怎样让迁移成本最低?

最稳妥的做法是在业务里把 model 字段抽象成环境变量或配置项,而不是写死在代码里。配合 API易 apiyi.com 的 OpenAI 兼容入口,迁移就只剩一行配置变更与一次回归测试。

Q5: Grok 4.3 适合做 Coding Agent 吗?

适合。Grok 4.3 在 τ²-Bench Telecom 拿到 98%,工具调用与多轮对话稳定性比 grok-code-fast-1 更好,而且单位成本极低,非常适合高频调用的 IDE 插件、CLI Agent 与自动化运维脚本。

总结:Grok 4.3 上线与 xAI API 迁移的核心要点

Grok 4.3 这次发布最大的看点不在「更强」,而在「更便宜的同时也更强」。$1.25/$2.50 的定价让 xAI 把 1M 上下文与高质量 Agent 工具调用一起带到了和 Gemini 3.1 Pro 同档的价格区间,直接重新定义了高频通用层的性价比基线。同时 8 款老模型 5 月 15 日的集中下线也提醒所有团队:模型 ID 不应该被 hard-code 到业务代码里,而是应该被抽象到一层可配置的路由层背后。

我们建议把 Grok 4.3 作为高频调用与 Agent 工具链的主力,通过 API易 apiyi.com 的统一接口完成迁移,把切换成本压到最低,同时保留 Claude 4.7 Opus、GPT-5.4、Gemini 3.1 Pro 的多模型组合能力,在不同任务上动态调度,以拿到全局最优的成本与质量平衡。

APIYI 技术团队 · 关注 AI 模型 API 与开发者工具的实战内容,更多技术文章请访问 apiyi.com