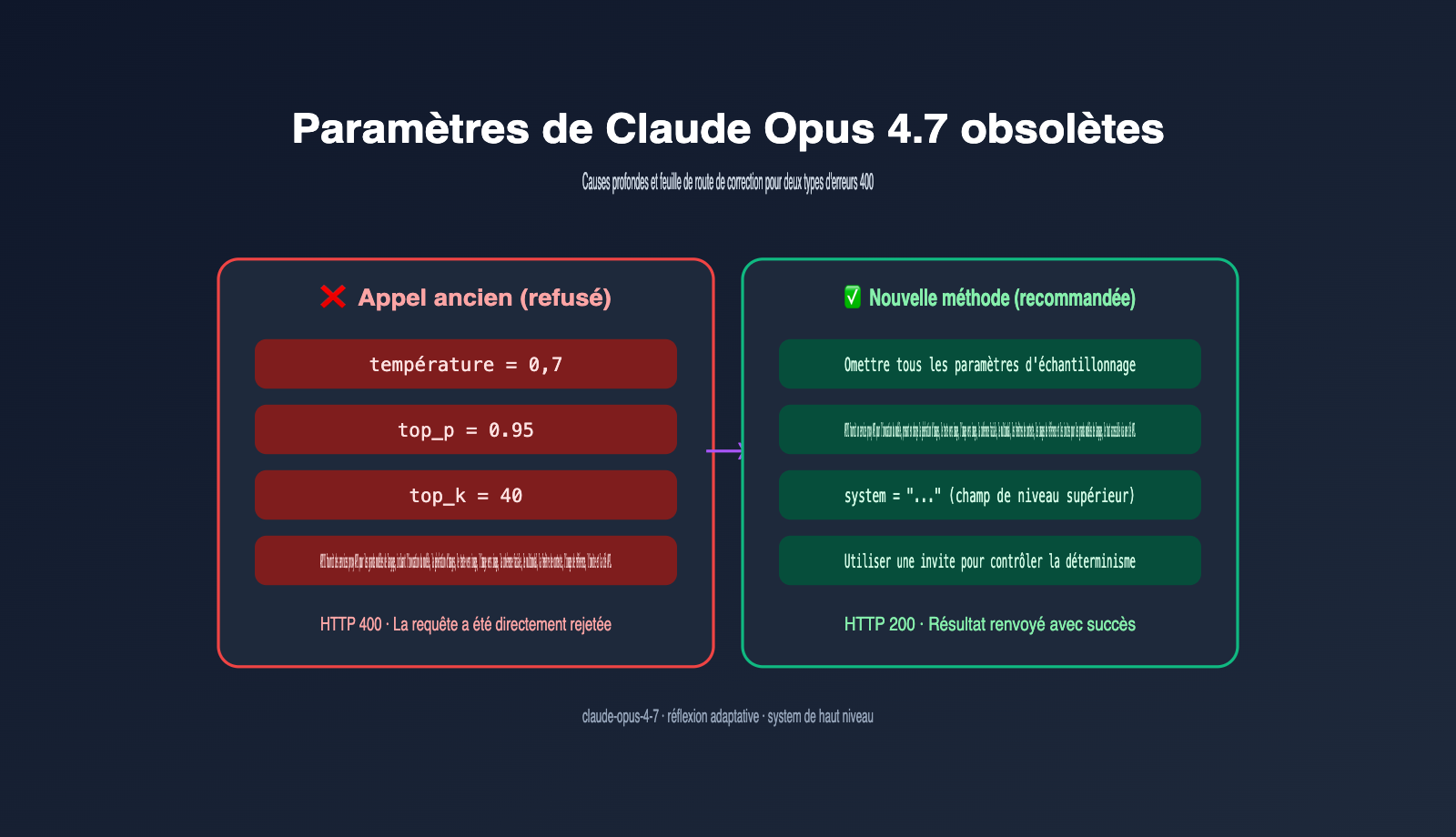

Note de l'auteur : Claude Opus 4.7 a abandonné les paramètres d'échantillonnage tels que temperature, top_p et top_k, et exige désormais que le system soit passé au niveau supérieur plutôt qu'en tant que rôle dans les messages. Cet article clarifie les causes profondes des deux erreurs 400 courantes et propose des solutions de code pour les corriger.

Après la mise à niveau vers Claude Opus 4.7, ce qui bloque le plus souvent les développeurs n'est pas le modèle lui-même, mais les paramètres de requête. La première erreur fréquente est temperature is deprecated for this model, et la seconde est Unexpected role "system". The Messages API accepts a top-level system parameter, not "system" as an input message role. Bien que ces deux erreurs HTTP 400 semblent sans rapport, elles pointent vers un fait unique : Anthropic a procédé à une convergence assez radicale de son API avec Opus 4.7.

Avant de bien comprendre ces changements, de nombreuses équipes avaient l'habitude de "régler la température à 0" ou d'"ajouter un message système supplémentaire" comme solution miracle pour améliorer la précision. Opus 4.7 bloque directement ces deux voies. Ce guide explique en détail ces deux types de problèmes sous l'angle des causes, des erreurs et des correctifs, et fournit un code de migration prêt à l'emploi. Après lecture, vous serez non seulement capable de résoudre vos erreurs 400 en 10 minutes, mais vous comprendrez également la logique profonde derrière ce changement de conception d'Anthropic, évitant ainsi de retomber dans les mêmes pièges lors de la prochaine mise à jour du modèle.

Quels paramètres ont été abandonnés dans Claude Opus 4.7

Avant de comprendre les erreurs, examinons la "liste des abandons" complète. Les changements effectués par Anthropic sur Opus 4.7 sont plus nombreux qu'il n'y paraît, et leur impact est bien plus important que les dépréciations de l'ère 4.6.

| Paramètre | État | Comportement | Alternative |

|---|---|---|---|

temperature |

Abandonné | Toute valeur autre que celle par défaut renvoie une erreur 400 | À omettre totalement, utilisez l'invite pour contrôler le caractère aléatoire |

top_p |

Abandonné | Idem | À omettre totalement |

top_k |

Abandonné | Idem | À omettre totalement |

thinking.budget_tokens |

Supprimé | Un budget explicite renvoie une erreur 400 | thinking: { type: "adaptive" } |

reasoning_effort (ancien) |

Supprimé | L'ancien champ n'est plus actif | output_config: { effort: "max" } |

role: "system" dans les messages |

Non supporté | Toujours été le cas, mais erreur plus stricte en 4.7 | Paramètre system au niveau supérieur |

🎯 À lire avant la mise à jour : Si vous utilisez le SDK Python, toute présence de

temperature=0.7,top_p=0.95oumessages=[{"role": "system", ...}]dans votre ancien code provoquera une erreur 400 sur Opus 4.7. Nous vous recommandons de passer par APIYI apiyi.com pour accéder à Opus 4.7 ; la plateforme gère la rétrocompatibilité des paramètres de manière élégante, permettant une transition en douceur vers la nouvelle interface.

L'élément le plus facile à négliger dans la liste est le paramètre thinking. À l'ère d'Opus 4.6, vous pouviez transmettre thinking: {"type": "enabled", "budget_tokens": 8000} pour laisser le modèle réfléchir un peu plus longtemps, mais sur Opus 4.7, cette utilisation est directement rejetée. La nouvelle version n'accepte que le type adaptive, où le modèle décide lui-même de l'intensité du raisonnement. De plus, le raisonnement adaptatif est désactivé par défaut et doit être activé explicitement.

Un autre changement caché concerne le tokenizer. Opus 4.7 utilise un nouveau tokenizer ; pour un même texte, le nombre de jetons sur le nouveau modèle sera de 0 % à 35 % plus élevé qu'en 4.6. Cela signifie que votre budget de coûts estimé pour la version 4.6 risque fort d'augmenter "silencieusement" sur la 4.7, nécessitant une vérification de vos factures.

Pourquoi Claude Opus 4.7 abandonne-t-il le paramètre temperature ?

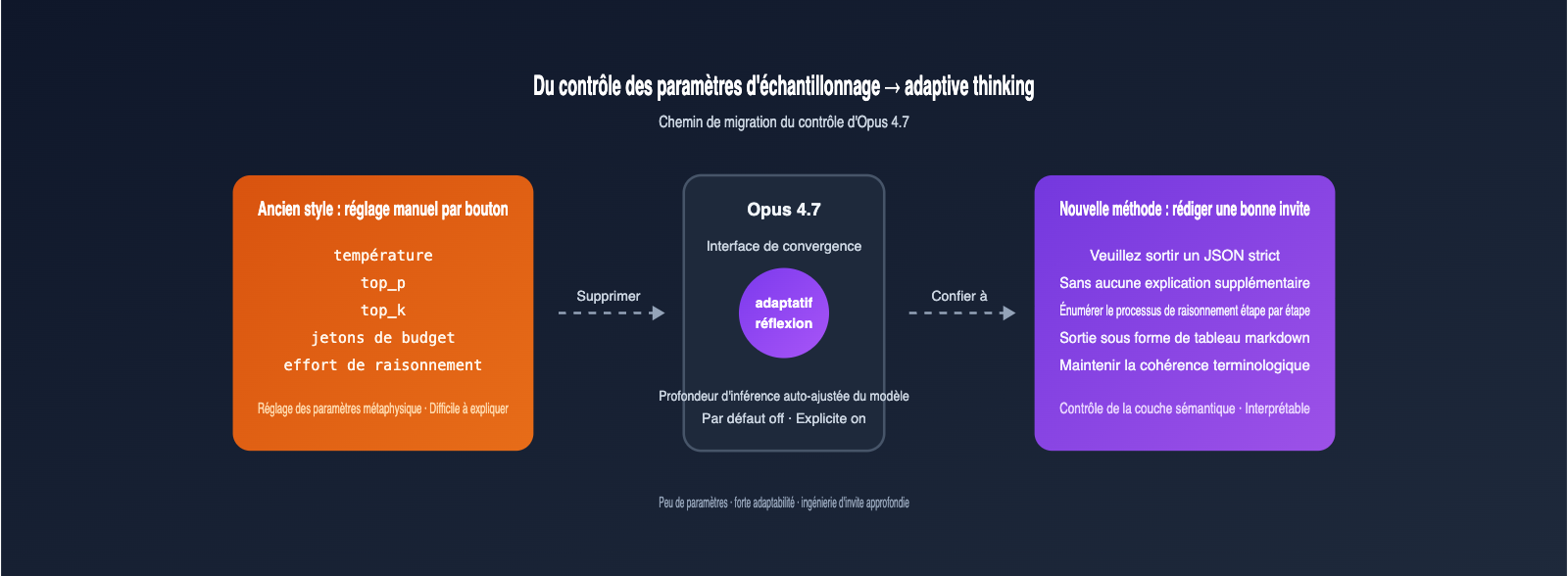

Comprendre la logique derrière ce changement vous évitera bien des déboires. Si Anthropic a "retiré" les trois paramètres d'échantillonnage (temperature, top_p, top_k) sur Opus 4.7, c'est essentiellement pour faire passer le modèle d'une "bibliothèque de paramètres ajustables" à une "boîte noire adaptative".

Du point de vue de l'architecture, Opus 4.7 confie désormais le contrôle de l'intensité du raisonnement au module adaptive thinking, qui intègre nativement la gestion de l'incertitude. En clair, les méthodes comme la température, qui servent à "ajuster le caractère aléatoire au niveau de l'échantillonnage", sont devenues incompatibles avec la logique de raisonnement interne du modèle. Forcer ces paramètres ne ferait que perturber les chemins d'optimisation de cette nouvelle version. Anthropic est clair dans sa documentation : lors de leurs évaluations internes, l'utilisation de l' adaptive thinking surpasse systématiquement la combinaison extended thinking et réglage manuel de la température.

D'un autre côté, cette "suppression des boutons" est aussi une mise à jour bienvenue pour les débutants. Auparavant, les développeurs passaient un temps fou à se demander si leur température était "la bonne", sans jamais trouver de valeur optimale ni pouvoir expliquer les variations de résultats. Opus 4.7 ferme cette voie d'optimisation "illusoire" pour vous permettre de concentrer vos efforts sur ce qui apporte réellement de la valeur : la conception des invites (prompts) et la gestion du contexte.

Sur le plan pratique, l'abandon de ces trois paramètres signifie qu'Anthropic ne recommande plus de "compter sur la température pour stabiliser les résultats". La nouvelle approche consiste à utiliser l'ingénierie d'invite pour exiger explicitement des réponses déterministes ou des formats JSON stricts, forçant ainsi le modèle à s'auto-contraindre au niveau sémantique plutôt que par des réglages d'échantillonnage. Nous conseillons aux équipes utilisant APIYI (apiyi.com) pour appeler Opus 4.7 de migrer progressivement leur code, qui dépendait jusqu'ici de temperature=0, vers une approche où la détermination est explicitement requise dans le system prompt.

Cette philosophie fait écho aux "cinq niveaux de reasoning effort" de GPT-5.5. OpenAI offre "des réglages plus fins aux développeurs", tandis qu'Anthropic "reprend la main pour la confier au modèle". Aucune de ces approches n'est meilleure que l'autre, mais toutes deux marquent un déclin du réglage traditionnel des hyperparamètres. La leçon pour les développeurs est claire : l'optimisation des LLM se déplace du "réglage de boutons" vers la "rédaction de meilleures invites et la gestion du contexte".

Il est intéressant de noter que cette "convergence radicale" d'Anthropic n'est pas une surprise. Dès l'ère Opus 4.6, la documentation marquait l' extended thinking comme obsolète, invitant les développeurs à migrer vers l' adaptive thinking. Si vous aviez déjà adopté ces bonnes pratiques, cette mise à jour 4.7 ne vous coûtera rien. À l'inverse, si vous comptiez encore sur le réglage de la température pour gérer la créativité ou la stabilité, cette transition sera plus douloureuse.

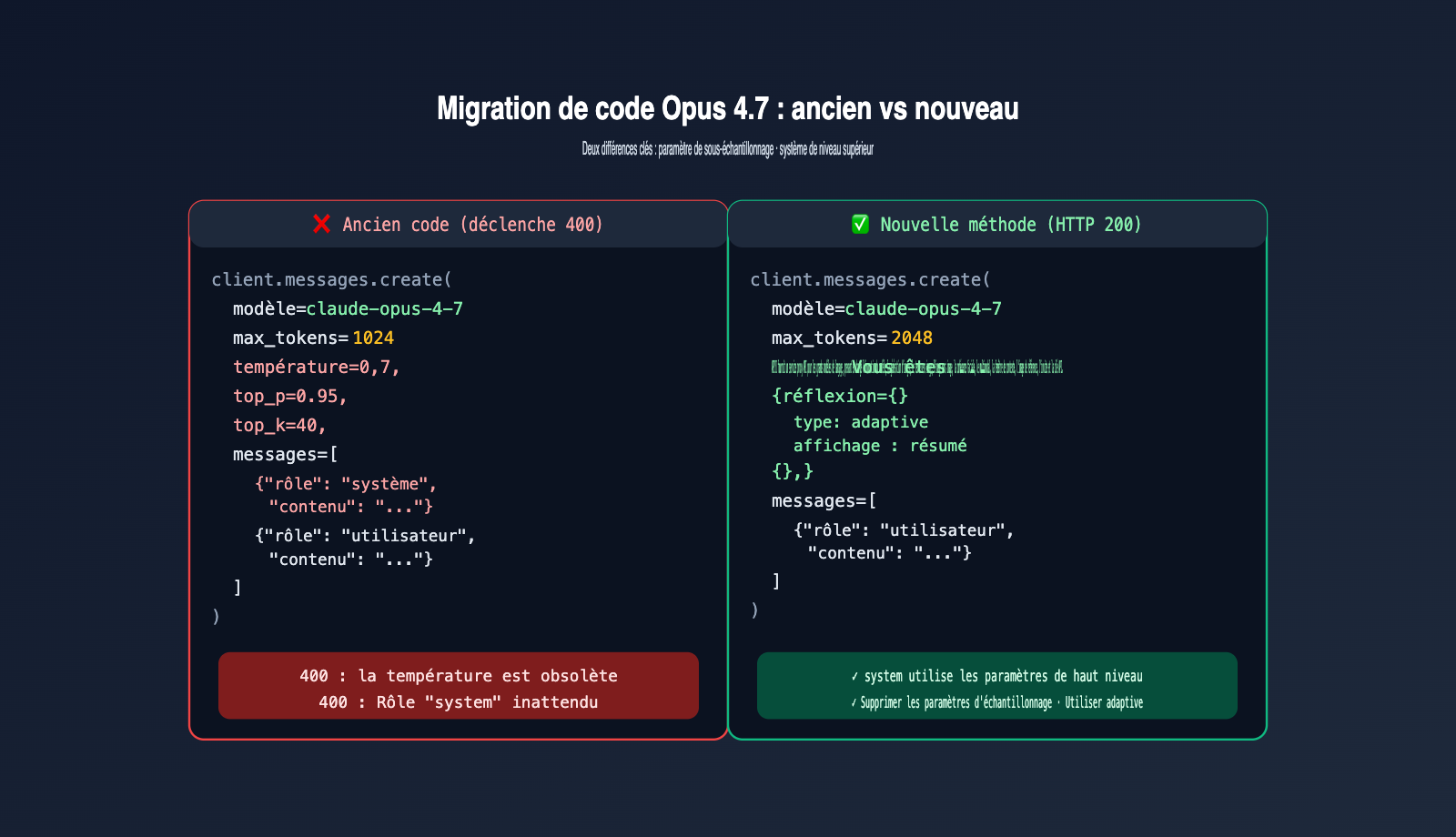

Solution pour corriger l'erreur 400 liée au paramètre temperature

Maintenant que vous en connaissez la cause, la correction est simple. Voici un exemple minimaliste qui fonctionne de manière stable en France et ailleurs via l'URL de base d'APIYI (apiyi.com).

# pip install anthropic

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # Appel unifié d'Opus 4.7 via APIYI

)

# ❌ Ancien code : déclenche une erreur 400 (temperature is deprecated)

# response = client.messages.create(

# model="claude-opus-4-7",

# max_tokens=1024,

# temperature=0.7,

# top_p=0.95,

# messages=[{"role": "user", "content": "Hello"}]

# )

# ✅ Nouveau code : omettez simplement les paramètres d'échantillonnage

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You must return strict JSON. No extra commentary.",

messages=[{"role": "user", "content": "Hello"}]

)

🎯 Conseil de réparation rapide : basculez votre

base_urlvershttps://api.apiyi.comet utilisez la clé compatible Anthropic fournie par APIYI. Il vous suffit de supprimer les trois lignes de paramètres d'échantillonnage dans votre ancien code. Si vous craignez de ne pas tout modifier immédiatement, APIYI (apiyi.com) gère par défaut une rétrogradation fluide des paramètres obsolètes pour vous laisser une période de transition.

Le tableau ci-dessous résume trois scénarios de migration courants pour vous aider à choisir la meilleure approche.

| Ancien usage | Nouvelle approche | Bénéfice |

|---|---|---|

temperature=0 pour la détermination |

system prompt : "Retourner un JSON strict, sans texte superflu" | Sortie plus stable, économie de tokens |

temperature=1 pour la créativité |

Ne définir aucun paramètre d'échantillonnage | Comportement natif d'Opus 4.7 |

top_p / top_k pour limiter l'échantillonnage |

Utiliser effort: "max" avec l'adaptive thinking |

Remplacer le découpage par la profondeur de raisonnement |

Si vous utilisez le protocole compatible OpenAI (ce que font beaucoup de frameworks tiers par défaut), vérifiez si votre SDK n'injecte pas en arrière-plan temperature=1.0. De nombreux tickets dans la communauté signalent que le codage en dur de ces valeurs par les frameworks provoque le rejet des requêtes par Opus 4.7. Dans ce cas, mettez à jour votre framework ou passez par la couche de compatibilité d'APIYI (apiyi.com).

La nature et la résolution de l'erreur du rôle system

La deuxième erreur 400 la plus fréquente n'a rien à voir avec la temperature. C'est un vieux problème qui a été "amplifié" sur les nouveaux modèles. L'API Messages d'Anthropic n'a jamais autorisé l'utilisation de system en tant que rôle dans les messages, mais beaucoup de codes migrés depuis l'API Chat Completions d'OpenAI le font par réflexe, ce qui déclenche l'erreur Unexpected role "system".

La clé pour comprendre cela est qu'Anthropic considère system comme une "configuration de session" plutôt que comme du "contenu de dialogue". Il doit apparaître au niveau supérieur du corps de la requête, et non dans le tableau messages. Le tableau ci-dessous compare les différences entre OpenAI et Anthropic.

| Élément | OpenAI Chat Completions | Anthropic Messages |

|---|---|---|

Emplacement de system |

Première entrée du tableau messages |

Champ system au niveau supérieur |

Nombre de system |

Plusieurs possibles | Une seule chaîne de caractères |

| Erreur en 4.7 | Aucune | Unexpected role "system" 400 |

| Difficulté de migration | — | Faible, il suffit de déplacer l'emplacement |

🎯 Conseil de migration : Si votre projet utilise une logique "OpenAI / Claude", je vous suggère d'encapsuler un adaptateur : placez

systemdansmessagespour OpenAI, et déplacez-le vers le champsystemsupérieur pour Claude. En passant par APIYI (apiyi.com) pour accéder aux deux modèles, vous pouvez gérer l'ensemble avec un système de clés unique, évitant ainsi les configurations redondantes.

La correction est très directe. Voici une comparaison entre la mauvaise et la bonne méthode, vous pouvez copier-coller.

# ❌ Mauvaise méthode : déclenche l'erreur 400 Unexpected role "system"

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

messages=[

{"role": "system", "content": "You are a coding assistant."},

{"role": "user", "content": "Write a quicksort in Python."}

]

)

# ✅ Bonne méthode : system passe par le paramètre de niveau supérieur

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You are a coding assistant.",

messages=[

{"role": "user", "content": "Write a quicksort in Python."}

]

)

Il est important d'ajouter que si vous souhaitez réellement donner à Claude "plusieurs instructions system", la bonne pratique consiste à les fusionner en une seule chaîne de caractères, séparées par des sauts de ligne ou une numérotation. Le SDK Anthropic permet également de définir le champ system sous forme de bloc de contenu, mais il s'agit d'une utilisation avancée ; les débutants peuvent se contenter de la "chaîne unique". Cette méthode offre un avantage caché : une fois fusionné en une seule chaîne, il est plus facile de déclencher la mise en cache des invites via APIYI (apiyi.com), ce qui réduit encore les coûts pour les tâches longues.

Modèle de code complet pour la migration vers Claude Opus 4.7

En combinant les corrections pour ces deux types d'erreurs, voici un code "prêt à l'emploi pour Opus 4.7", incluant l'adaptive thinking, le paramètre system au niveau supérieur et une configuration optimisée pour la facturation avec cache.

from anthropic import Anthropic

client = Anthropic(

api_key="VOTRE_CLE_APIYI",

base_url="https://api.apiyi.com" # Appel d'Opus 4.7 via APIYI

)

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=2048,

system="You are an expert Python engineer. Always return strict JSON.",

thinking={

"type": "adaptive",

"display": "summarized"

},

messages=[

{"role": "user", "content": "Refactor my quicksort to be O(n log n) average."}

]

)

print(response.content[0].text)

🎯 Conseil pour l'environnement de production : Lors de l'appel à Opus 4.7 via APIYI (apiyi.com), placez votre system prompt stable et les descriptions d'outils au début pour déclencher une facturation avec cache à 0,1x, ce qui peut réduire les coûts des requêtes répétées à 10 % du prix initial. C'est particulièrement avantageux pour les agents longue durée et les tâches de génération de documents.

Lors de la migration réelle, quelques détails méritent votre attention. Premièrement, le champ thinking n'est pas obligatoire, mais si votre tâche est sensible à la profondeur de raisonnement, je vous suggère d'activer explicitement l'adaptive thinking, sinon le modèle restera en mode de raisonnement léger par défaut. Deuxièmement, comme le nouveau tokenizer peut compter 0 % à 35 % de jetons en plus pour le même texte, le budget max_tokens doit être ajusté en conséquence, sous peine d'être tronqué dans les scénarios de sortie longue. Troisièmement, les anciens paramètres périphériques comme thinking_budget doivent également être supprimés ; les champs résiduels ne provoquent pas d'erreur mais sont ignorés, ce qui peut vous faire croire à tort qu'ils sont toujours actifs. Quatrièmement, si votre application appelle à la fois 4.6 et 4.7, il est préférable d'enregistrer la facturation par nom de modèle pour éviter que la confusion entre les anciens et nouveaux tokenizers ne fausse l'attribution des coûts.

Si vous maintenez une base de code devant être compatible à la fois avec Opus 4.6 et Opus 4.7, la méthode la plus sûre consiste à utiliser une liste blanche de paramètres par nom de modèle. Ignorez les "paramètres d'échantillonnage + anciens champs thinking" lors de l'appel à 4.7, et conservez-les pour 4.6, afin de ne pas avoir à maintenir deux fonctions d'appel distinctes.

Le tableau de dépannage ci-dessous résume les erreurs 400 les plus courantes lors de la mise à niveau vers Opus 4.7, pour vous permettre de localiser et corriger rapidement les problèmes.

| Mot-clé d'erreur | Signification de l'erreur | Méthode de réparation |

|---|---|---|

temperature is deprecated |

Champ temperature obsolète utilisé | Supprimer totalement temperature du corps de la requête |

top_p is deprecated |

Champ top_p obsolète utilisé | Supprimer top_p, laisser le modèle s'adapter |

top_k is deprecated |

Champ top_k obsolète utilisé | Supprimer top_k, laisser le modèle s'adapter |

| Unexpected role "system" | system écrit dans le tableau messages | Déplacer vers le champ system au niveau supérieur |

Invalid budget_tokens |

Utilisation de l'ancien budget extended thinking | Passer à adaptive thinking sans transmettre de budget |

Unknown parameter reasoning_effort |

Utilisation de l'ancien champ d'intensité de raisonnement | Passer à output_config: {effort: "max"} |

FAQ sur l'abandon des paramètres de Claude Opus 4.7

Q1 : Pourquoi Opus 4.7 abandonne-t-il autant de paramètres d'un coup ?

La raison principale est que le mode adaptive thinking prend désormais en charge la gestion de la "stochastique et de la profondeur de raisonnement", des tâches qui étaient auparavant déléguées individuellement à temperature, top_p, top_k et thinking budget. Les évaluations internes d'Anthropic montrent que l' adaptive thinking surpasse systématiquement le réglage manuel, d'où le choix de centraliser ces contrôles.

Q2 : Puis-je définir temperature à 1.0 pour "contourner" l'erreur ?

Non. Opus 4.7 vérifie la présence des paramètres d'échantillonnage, et non leur valeur. Dès que cette clé apparaît dans le corps de la requête, elle est identifiée comme une configuration non standard et renvoie une erreur 400. La bonne pratique consiste à supprimer totalement ce champ de votre requête et à laisser le SDK utiliser le comportement d'échantillonnage par défaut du modèle.

Q3 : L'utilisation du SDK OpenAI via APIYI pour appeler Opus 4.7 déclenchera-t-elle une erreur liée à temperature ?

Cela dépend de la version du SDK et du framework utilisé. Le SDK OpenAI ajoute par défaut temperature=1.0. Si vous transférez directement cette requête vers le backend d'Anthropic, elle sera rejetée par Opus 4.7. Lorsque vous passez par APIYI (apiyi.com), la plateforme gère élégamment ces problèmes de compatibilité courants en filtrant automatiquement les champs obsolètes.

Q4 : L'erreur sur le rôle system est-elle spécifique à la version 4.7 ? Les anciens modèles Claude ne l'avaient pas ?

Non. L'API Messages d'Anthropic n'a jamais autorisé l'insertion de system dans le tableau messages. Cependant, la validation d'Opus 4.7 est plus stricte, alors que certains anciens modèles pouvaient être plus "tolérants". La meilleure pratique a toujours été de placer system au niveau supérieur du corps de la requête. Une fois migré à ce niveau, tous les modèles Claude fonctionneront correctement.

Q5 : Pour du code migré depuis OpenAI, combien de lignes faut-il modifier au minimum pour faire tourner Opus 4.7 ?

Généralement trois points : 1) changer le model pour claude-opus-4-7 ; 2) déplacer l'entrée system du tableau messages vers le champ system de niveau supérieur ; 3) supprimer les paramètres d'échantillonnage comme temperature ou top_p. En basculant votre base_url vers https://api.apiyi.com, l'ensemble du projet est généralement opérationnel en moins de 10 minutes. Si votre projet comporte des dizaines de points d'appel, je vous conseille de créer une fonction utilitaire call_claude() pour centraliser ces trois modifications, facilitant ainsi toute future mise à jour de l'API.

Q6 : L' adaptive thinking est-il activé par défaut ? Faut-il l'activer explicitement ?

Il est désactivé par défaut. Si votre tâche nécessite une profondeur de raisonnement importante (raisonnement mathématique, refactorisation de code, planification complexe), je vous recommande de transmettre explicitement thinking: {type: "adaptive"}. Vous pouvez également combiner cela avec output_config: {effort: "max"} pour obtenir une capacité de réflexion maximale, au prix d'une consommation de jetons plus élevée. Il faudra donc trouver un équilibre entre qualité et coût.

Q7 : L'appel à Opus 4.7 est-il stable depuis la Chine ?

Une connexion directe aux interfaces d'Anthropic peut être affectée par l'environnement réseau, ce qui entraîne souvent des interruptions, surtout pour les tâches longues. Passer par APIYI (apiyi.com) pour appeler Opus 4.7 résout les problèmes de stabilité d'accès local. La plateforme est stable et, combinée à la facturation avec mise en cache à 0,1x, elle permet de réduire considérablement les coûts.

Q8 : De combien le nouveau tokenizer augmente-t-il les coûts ? Comment y faire face ?

Le taux d'expansion du nouveau tokenizer varie de 0 % à 35 % selon le texte, avec une moyenne d'environ 10 % à 15 %. La stratégie la plus efficace consiste à placer les system prompts et les descriptions d'outils (pouvant être mis en cache) au début de la requête pour bénéficier de la facturation en cache à 0,1x. Cela permet de réduire le coût unitaire au lieu de l'augmenter.

Points clés sur l'abandon des paramètres de Claude Opus 4.7

- Opus 4.7 abandonne totalement les trois paramètres d'échantillonnage

temperature,top_pettop_k. Toute valeur transmise déclenchera une erreur 400. - L' Extended thinking a été supprimé au profit de l' adaptive thinking, qui est désactivé par défaut et doit être activé explicitement.

- L'erreur

Unexpected role "system"est une règle historique de l'API Messages :systemdoit être placé au niveau supérieur et non en tant que rôle dans le message. - Le nouveau tokenizer augmente le nombre de jetons pour un même texte de 0 % à 35 % par rapport à la version 4.6 ; le budget et le

max_tokensdoivent être recalculés. - La correction minimale se fait en trois étapes : supprimer les paramètres d'échantillonnage, déplacer

systemau niveau supérieur et renommer le modèle enclaude-opus-4-7. - L'appel à Opus 4.7 via APIYI (apiyi.com) permet de bénéficier d'une rétrogradation élégante des paramètres, d'une facturation en cache à 0,1x et d'une connexion stable depuis la Chine.

- L'utilisation de l' adaptive thinking combinée à

output_config: {effort: "max"}est la méthode recommandée pour obtenir la meilleure capacité de raisonnement sur Opus 4.7.

Résumé

L'abandon des paramètres dans Claude Opus 4.7 peut sembler être un "changement destructeur", mais il s'agit en réalité d'une étape clé dans l'évolution d'Anthropic : transformer le modèle d'un "outil aux détails exposés" en une "boîte noire adaptative". Pour les développeurs, cela signifie que la stabilité, autrefois obtenue via des "interrupteurs" comme la temperature ou le thinking budget, doit désormais reposer sur une combinaison d'ingénierie d'invite et de réflexion adaptative. À court terme, cela implique des coûts de migration, mais à long terme, cela rendra le code plus concis et les performances du modèle plus stables. Cette trajectoire d'évolution n'est pas isolée ; les principaux grands modèles de langage suivent tous cette tendance vers "moins de paramètres, plus d'auto-adaptation". Plus vite vous vous adapterez, plus vite vous en récolterez les bénéfices.

Si vous êtes en train de migrer vers Opus 4.7 ou d'évaluer l'impact de ce changement sur votre production, nous vous recommandons de tester la nouvelle version via APIYI (apiyi.com). La plateforme prend déjà en charge Opus 4.7 de manière stable et assure une rétrocompatibilité pour les paramètres obsolètes. Associé à une facturation du cache à 0,1x, c'est actuellement le moyen le plus accessible pour effectuer votre migration.

En espérant que vous éviterez les pièges et finirez votre journée plus tôt.

— L'équipe technique d'APIYI. Pour plus de tutoriels pratiques sur les modèles d'IA, rendez-vous sur APIYI apiyi.com