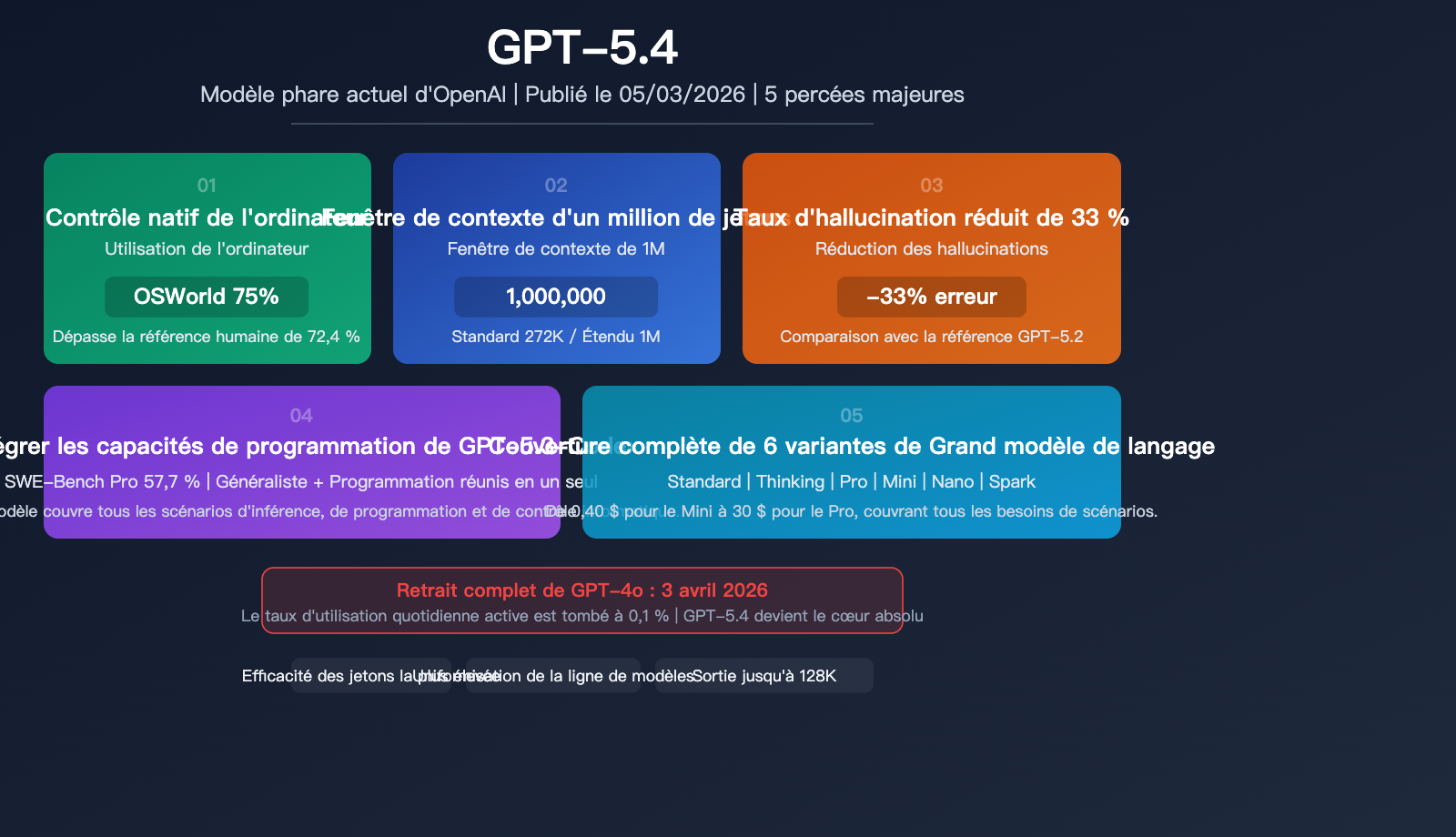

Note de l'auteur : Le GPT-5.4 devient officiellement le modèle phare actuel d'OpenAI, avec un contrôle natif de l'ordinateur surpassant les standards humains, une fenêtre de contexte d'un million de jetons, une intégration des capacités de programmation Codex et un taux d'hallucination réduit de 33 %. Cet article propose une analyse approfondie des détails techniques, des données d'évaluation et de l'impact du retrait de GPT-4o.

Le 5 mars 2026, OpenAI a officiellement lancé GPT-5.4, le premier modèle phare unifié intégrant le contrôle natif de l'ordinateur, une fenêtre de contexte d'un million de jetons et les capacités de programmation Codex. Parallèlement, GPT-4o sera totalement retiré le 3 avril, marquant la fin d'une époque. Cet article analyse en profondeur les 5 percées majeures apportées par GPT-5.4 à travers trois dimensions : l'architecture technique, les données d'évaluation et les applications pratiques.

Valeur ajoutée : 5 minutes pour comprendre toutes les capacités principales, les plans tarifaires, la comparaison avec la concurrence et la stratégie de migration après le retrait de GPT-4o.

Aperçu des informations clés sur GPT-5.4

| Élément | Détails |

|---|---|

| Date de sortie | 5 mars 2026 |

| Éditeur | OpenAI |

| Positionnement | Modèle phare actuel, remplace la série GPT-5.2 |

| Percées majeures | Contrôle natif de l'ordinateur, fenêtre de contexte d'un million de jetons, intégration de Codex |

| Taux d'hallucination | Réduit de 33 % par rapport à GPT-5.2 |

| Évaluation OSWorld | 75 % (dépasse la référence humaine de 72,4 %) |

| SWE-Bench Pro | 57,7 % (dépasse les 56,8 % de GPT-5.3-Codex) |

| Variantes du modèle | Standard / Thinking / Pro / Mini / Nano / Spark |

| Retrait de GPT-4o | Retrait complet le 3 avril 2026 |

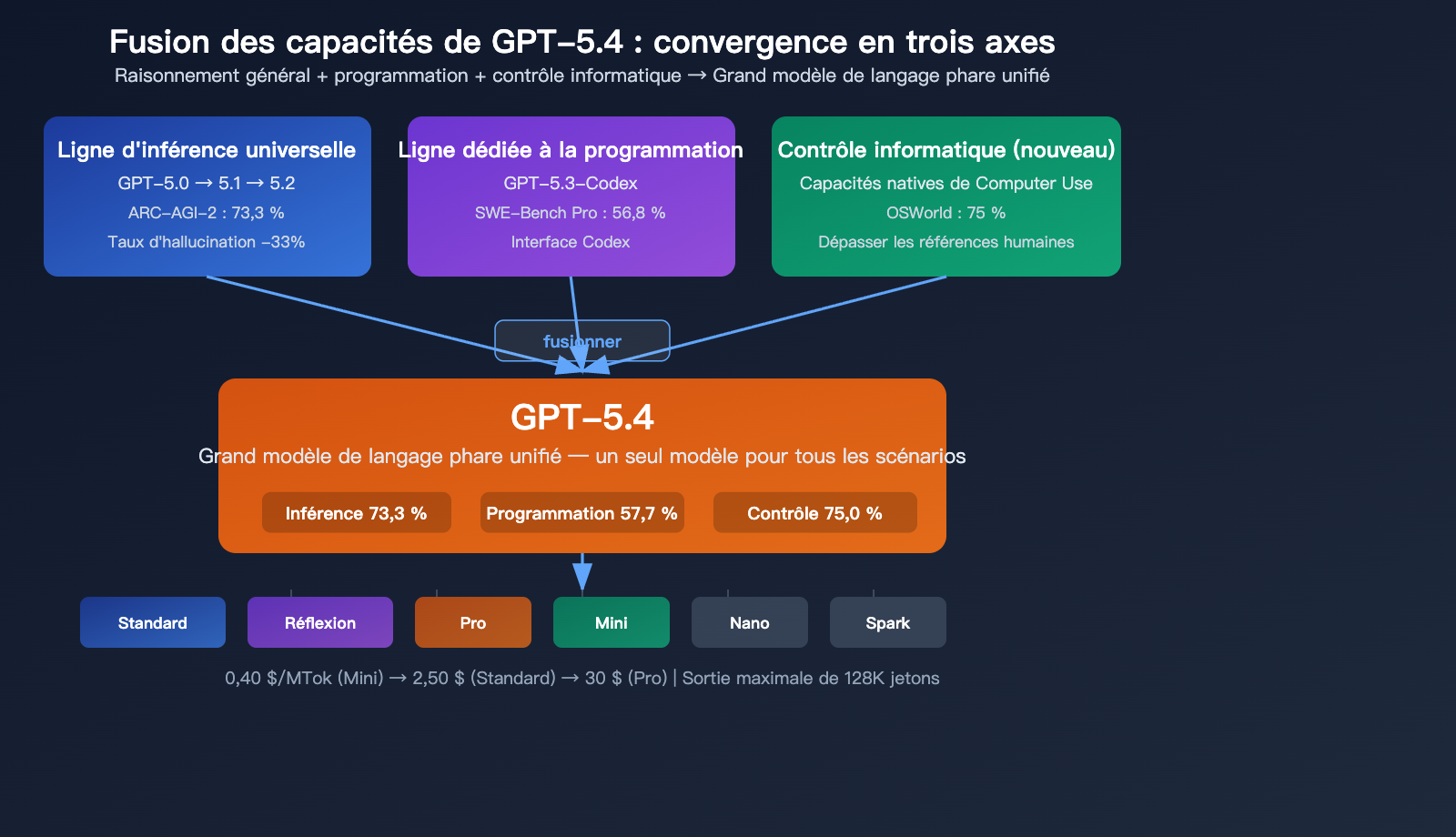

Positionnement historique de GPT-5.4

GPT-5.4 n'est pas une simple mise à jour de version, mais une fusion majeure de la gamme de modèles d'OpenAI. Auparavant, OpenAI gérait deux lignes de modèles distinctes : le raisonnement général (GPT-5.x) et la programmation spécialisée (GPT-5.3-Codex). GPT-5.4 fusionne pour la première fois ces deux lignes en un modèle phare unifié. Il s'agit à la fois du modèle de raisonnement le plus puissant, du meilleur modèle de programmation, et du premier modèle généraliste doté de capacités natives de contrôle d'ordinateur.

Cela signifie que les développeurs n'ont plus besoin de jongler entre "utiliser GPT-5.2 pour le raisonnement" et "utiliser Codex pour la programmation". Un seul modèle, GPT-5.4, couvre désormais tous les scénarios.

Analyse détaillée des 5 percées majeures de GPT-5.4

Percée 1 : Contrôle natif de l'ordinateur (Computer Use)

La nouvelle capacité la plus marquante de GPT-5.4 est le contrôle natif de l'ordinateur (Computer Use). Il ne s'agit pas d'une fonctionnalité implémentée via des plugins ou des outils externes, mais d'une capacité native intégrée au modèle. GPT-5.4 peut voir directement le contenu de l'écran, déplacer la souris, cliquer sur des boutons et saisir du texte, opérant ainsi un ordinateur comme un humain pour accomplir des flux de travail complexes.

| Référence d'évaluation | GPT-5.4 | Référence expert humain | Évaluation |

|---|---|---|---|

| OSWorld-Verified | 75,0 % | 72,4 % | Dépasse l'humain |

Lors de l'évaluation OSWorld-Verified, GPT-5.4 a obtenu un score de 75 %, dépassant pour la première fois la référence des experts humains (72,4 %). Cela signifie que GPT-5.4 est désormais plus fiable qu'un expert humain moyen pour automatiser des tâches réelles sur ordinateur.

Les cas d'utilisation concrets incluent :

- Automatisation des processus de bureau : saisie automatique de données et génération de rapports dans Excel, CRM, ERP, etc.

- Flux de travail inter-applications : extraction d'informations depuis des e-mails, création de tâches dans des outils de gestion de projet, puis notification des personnes concernées.

- Automatisation Web : navigation automatique sur le Web, remplissage de formulaires et soumission de demandes.

- Tests logiciels : manipulation automatique de l'interface graphique (GUI) pour des tests de bout en bout.

Percée 2 : Fenêtre de contexte d'un million de jetons

La fenêtre de contexte de GPT-5.4 est étendue à 1 million de jetons (en mode API), avec 272 000 jetons en mode standard. Cela permet au modèle de traiter des documents extrêmement longs, des bases de code complètes et des tâches d'agent complexes en plusieurs étapes.

| Mode de contexte | Capacité | Scénarios d'utilisation |

|---|---|---|

| Mode standard | 272K jetons | Conversations quotidiennes et tâches générales |

| Mode étendu | 1M jetons | Analyse de longs documents, traitement de bases de code |

| Sortie maximale | 128K jetons | Génération de longs textes |

La valeur fondamentale du million de jetons réside dans la prise en charge de la planification d'agents à long terme. Le modèle peut effectuer une boucle complète de planification, d'exécution et de vérification au sein d'une même session, sans perdre d'informations critiques dues à un dépassement de contexte.

Percée 3 : Taux d'hallucination réduit de 33 %

OpenAI a réalisé une amélioration significative de la précision factuelle avec GPT-5.4 :

- Taux d'erreur par déclaration unique : réduction de 33 % par rapport à GPT-5.2.

- Taux d'erreur global des réponses : réduction de 18 % par rapport à GPT-5.2.

Cela signifie que GPT-5.4 est plus fiable lors du traitement de requêtes factuelles. Il s'agit d'une avancée cruciale pour les applications d'entreprise, les conseils médicaux, l'analyse juridique et tout scénario exigeant une précision extrême.

Percée 4 : Intégration des capacités de programmation de GPT-5.3-Codex

GPT-5.4 intègre toutes les capacités de programmation de GPT-5.3-Codex, avec des améliorations supplémentaires :

| Évaluation de programmation | GPT-5.4 | GPT-5.3-Codex | Évolution |

|---|---|---|---|

| SWE-Bench Pro | 57,7 % | 56,8 % | +0,9 % |

| SWE-Bench Verified | ~80 % | – | Haut niveau |

GPT-5.4 a obtenu un score de 57,7 % sur SWE-Bench Pro, dépassant légèrement les 56,8 % de GPT-5.3-Codex. Cela signifie qu'il n'est plus nécessaire d'utiliser séparément un modèle Codex pour les tâches de programmation : GPT-5.4 suffit pour gérer le raisonnement, le code et le contrôle de l'ordinateur.

L'interface Codex existe toujours, mais elle est désormais propulsée par GPT-5.4.

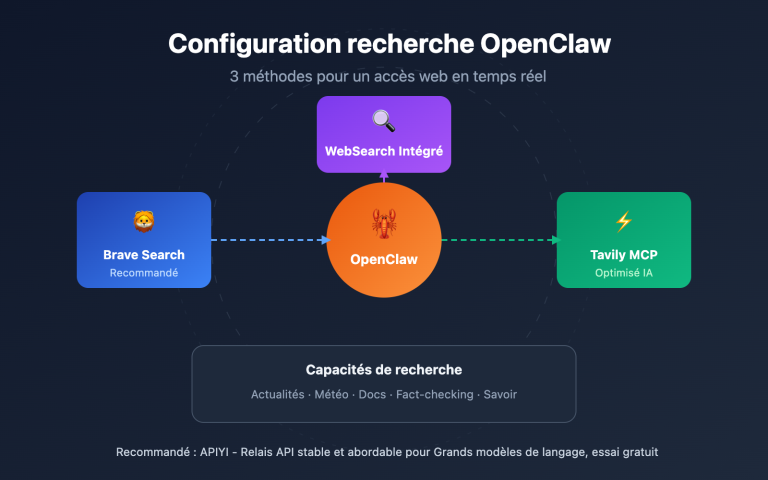

Percée 5 : Recherche d'outils intelligente (Tool Search)

GPT-5.4 introduit une capacité de recherche d'outils, permettant au modèle de découvrir et d'appeler automatiquement l'outil le plus approprié au sein d'un vaste écosystème, sans que l'humain n'ait besoin de configurer manuellement chaque intégration. Cela améliore considérablement l'autonomie des agents dans les flux de travail complexes.

🎯 Conseil aux développeurs : Ces avancées de GPT-5.4 signifient que vous pouvez couvrir tous vos besoins en raisonnement, programmation et automatisation avec un seul modèle. Via la plateforme APIYI (apiyi.com), une seule clé API vous permet d'invoquer toutes les variantes de GPT-5.4, tout en supportant la comparaison avec des modèles concurrents comme Claude ou Gemini.

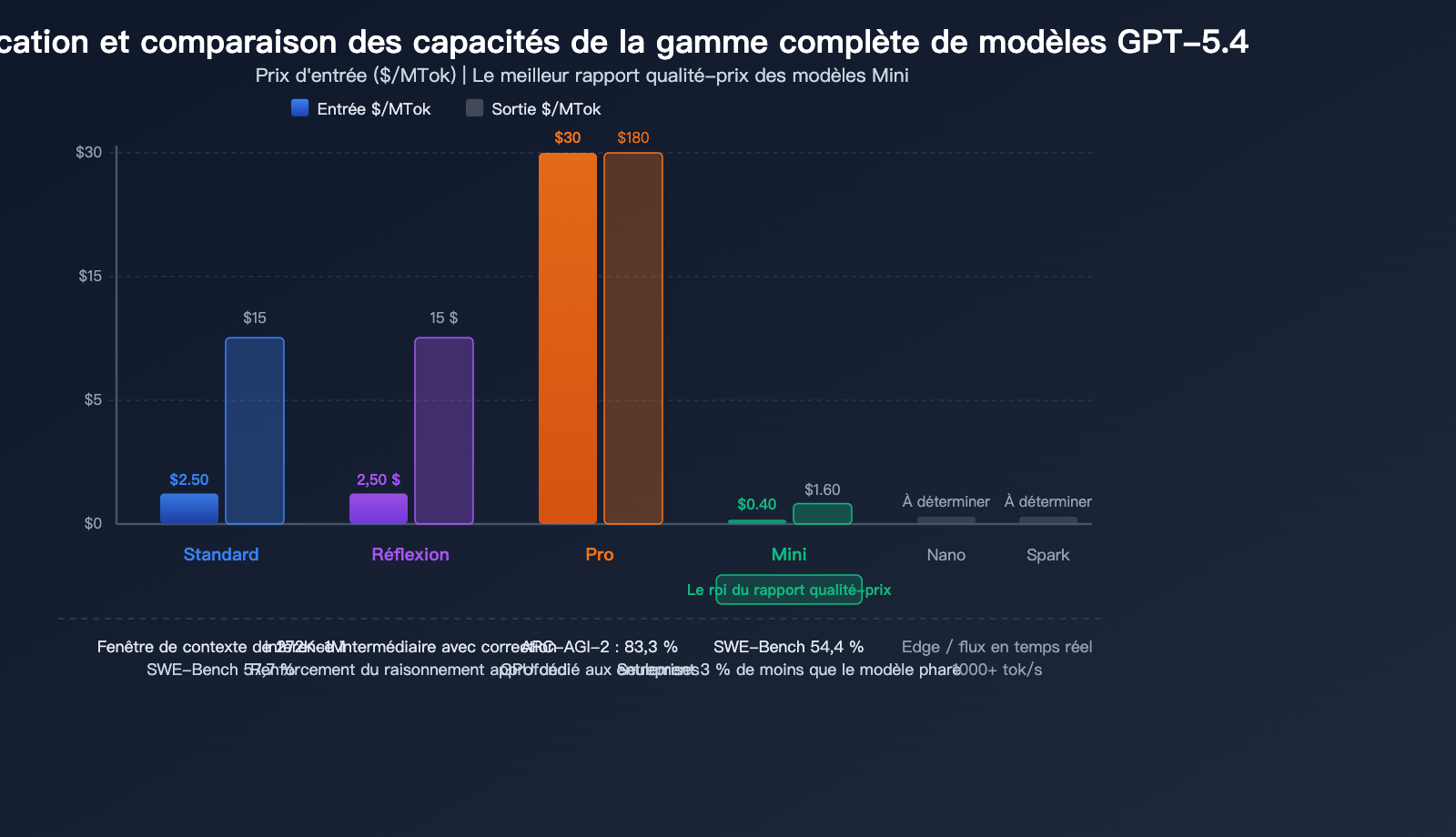

Variantes et tarification du modèle GPT-5.4

La gamme complète GPT-5.4

GPT-5.4 propose 6 variantes de modèles, couvrant tous les besoins, du haut de gamme aux solutions légères :

| Variante du modèle | Positionnement | Prix entrée ($/MTok) | Prix sortie ($/MTok) | Points forts |

|---|---|---|---|---|

| GPT-5.4 | Flagship polyvalent | 2,50 $ | 15,00 $ | Contexte standard 272K |

| GPT-5.4 (>272K) | Contexte étendu | 5,00 $ | 15,00 $ | Jusqu'à 1M de contexte |

| GPT-5.4 Thinking | Raisonnement profond | – | – | Correction en cours de réflexion |

| GPT-5.4 Pro | Entreprise | 30,00 $ | 180,00 $ | GPU dédié, précision maximale |

| GPT-5.4 Mini | Léger et efficace | ~0,40 $ | ~1,60 $ | Excellent rapport qualité-prix |

| GPT-5.4 Spark | Streaming temps réel | – | – | 1000+ tokens/seconde |

Analyse tarifaire : Le prix d'entrée de la version standard de GPT-5.4 est de 2,50 $/MTok, et 15,00 $/MTok pour la sortie. Le GPT-5.4 Mini, avec ses tarifs bas d'environ 0,40 $/1,60 $, est idéal pour les déploiements à grande échelle. Le GPT-5.4 Pro est destiné aux tâches d'entreprise exigeant une précision absolue, mais son coût est logiquement plus élevé.

💰 Optimisation des coûts : Pour la plupart des scénarios de développement, le GPT-5.4 Mini suffit largement et offre un rapport qualité-prix imbattable. En passant par la plateforme APIYI (apiyi.com), vous bénéficiez d'une facturation flexible et d'un outil unique pour comparer les performances et les coûts de chaque variante de GPT-5.4 face à la concurrence.

La conception unique de GPT-5.4 Thinking

La capacité la plus distinctive de GPT-5.4 Thinking est la correction du raisonnement en cours de route : le modèle est capable de détecter ses propres erreurs pendant le processus de réflexion et de les corriger en temps réel, au lieu d'attendre la réponse finale. C'est un atout majeur pour les tâches de raisonnement complexe en plusieurs étapes.

Les performances impressionnantes de GPT-5.4 Mini

Lancé le 17 mars, le GPT-5.4 Mini a obtenu un score de 54,38 % sur le benchmark SWE-Bench Pro. C'est seulement 3 points de pourcentage de moins que la version phare, pour un prix environ 6 fois inférieur. Cela fait du Mini l'un des modèles de programmation les plus rentables du marché actuel.

Données d'évaluation et analyse comparative de GPT-5.4

Performances d'évaluation clés de GPT-5.4

| Benchmark | GPT-5.4 | GPT-5.4 Pro | Note |

|---|---|---|---|

| OSWorld-Verified | 75,0 % | – | Contrôle informatique, au-delà des standards humains |

| SWE-Bench Pro | 57,7 % | – | Capacités de programmation |

| SWE-Bench Verified | ~80 % | – | Correction de code |

| ARC-AGI-2 | 73,3 % | 83,3 % | Raisonnement général |

| GDPval | – | 83 % | Travail intellectuel |

Amélioration de l'efficacité des jetons (tokens) de GPT-5.4

GPT-5.4 est qualifié par OpenAI de « modèle de raisonnement à l'efficacité de jetons la plus élevée » : pour résoudre un même problème, GPT-5.4 utilise nettement moins de jetons que GPT-5.2, ce qui se traduit directement par une réduction des coûts et une vitesse accrue.

Pour les environnements de production à haute fréquence d'invocation, cela signifie :

- Réduction des coûts : moins de jetons consommés pour les mêmes tâches.

- Vitesse accrue : moins de jetons impliquent des réponses plus rapides.

- Fenêtre de contexte plus efficace : le modèle exploite mieux les informations contextuelles au sein d'une fenêtre d'un million de jetons.

🎯 Conseil comparatif : GPT-5.4 excelle dans le contrôle informatique et la programmation, mais pour les tâches de raisonnement pur, la série Claude conserve des avantages uniques. Il est recommandé d'accéder simultanément à GPT-5.4 et à Claude via la plateforme APIYI apiyi.com pour choisir le modèle optimal selon la tâche spécifique.

Retrait de GPT-4o : la fin d'une ère

Chronologie du retrait de GPT-4o

Le retrait de GPT-4o s'effectue de manière progressive :

| Date | Événement |

|---|---|

| 13 février 2026 | Retrait de GPT-4o de la plupart des plans ChatGPT |

| 13 février 2026 | Retrait simultané : GPT-4.1, GPT-4.1 Mini, o4-mini |

| 3 avril 2026 | Retrait complet de GPT-4o des versions Entreprise/Éducation |

| Niveau API | Conservé temporairement, mais une migration rapide est conseillée |

Impact du retrait de GPT-4o

Avant l'annonce du retrait, la part d'utilisation quotidienne active de GPT-4o était tombée en dessous de 0,1 %. La grande majorité des utilisateurs a déjà migré naturellement vers la série GPT-5.x. Cependant, le retrait a un impact sur les scénarios suivants :

Migration des systèmes d'entreprise : les systèmes internes basés sur GPT-4o doivent être réadaptés au format d'API et aux capacités de GPT-5.4.

Custom GPTs : les GPT personnalisés basés sur GPT-4o doivent effectuer la transition vers le nouveau modèle avant le 3 avril.

Utilisateurs Azure : Azure AI Foundry dispose d'un calendrier de retrait indépendant, qui n'est pas totalement synchronisé avec celui d'OpenAI.

Conseils pour la migration de GPT-4o vers GPT-5.4

| Dimension de migration | GPT-4o | GPT-5.4 | Remarques |

|---|---|---|---|

| Contexte | 128K | 272K-1M | Augmentation significative de la longueur |

| Tarification | Faible | 2,50 $ / 15 $ | Prix de la version standard légèrement supérieur |

| Programmation | Moyenne | SWE-Bench 57,7 % | Amélioration notable |

| Contrôle informatique | Non supporté | Support natif | Nouvelle capacité |

| Précision | Standard | Taux d'hallucination réduit de 33 %+ | Amélioration majeure |

💡 Conseil de migration : Si votre système utilise encore GPT-4o, nous vous conseillons de finaliser la migration avant le 3 avril. Vous pouvez commencer par tester GPT-5.4 Mini (dont le prix est le plus proche de GPT-4o) pour vérifier la compatibilité avant de choisir la variante adaptée à vos besoins. Via la plateforme APIYI apiyi.com, vous pouvez changer de modèle en un clic sans modifier votre code, réduisant ainsi les coûts de migration.

Accès rapide à GPT-5.4

Exemple d'invocation d'API simplifiée

import openai

# Initialisation du client avec les paramètres APIYI

client = openai.OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://vip.apiyi.com/v1"

)

# Exemple d'invocation du modèle

response = client.chat.completions.create(

model="gpt-5.4",

messages=[{"role": "user", "content": "Analyse les goulots d'étranglement de performance de ce code"}]

)

print(response.choices[0].message.content)

Voir l’exemple d’invocation de GPT-5.4 Computer Use

import openai

client = openai.OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://vip.apiyi.com/v1"

)

# Mode Computer Use de GPT-5.4

response = client.chat.completions.create(

model="gpt-5.4",

messages=[{

"role": "user",

"content": "Ouvre le navigateur, recherche les derniers articles sur l'IA et organise-les dans un tableau"

}],

tools=[{

"type": "computer_use",

"display_width": 1920,

"display_height": 1080

}]

)

print(response.choices[0].message.content)

🚀 Démarrage rapide : Nous vous recommandons d'obtenir votre clé API via APIYI (apiyi.com). La plateforme prend en charge l'intégralité de la gamme GPT-5.4, ainsi que les interfaces unifiées pour des modèles concurrents comme Claude ou Gemini. Une seule clé suffit pour basculer et comparer les modèles.

Questions fréquentes

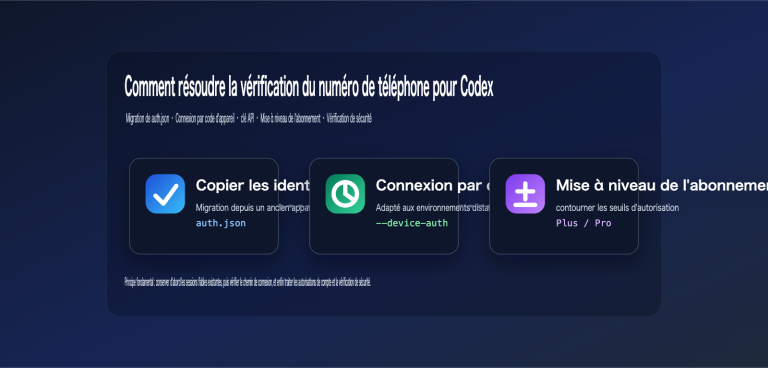

Q1 : Lequel choisir entre GPT-5.4 et GPT-5.3-Codex ?

Choisissez directement GPT-5.4. GPT-5.4 intègre déjà toutes les capacités de programmation de GPT-5.3-Codex et le surpasse sur SWE-Bench Pro avec un score de 57,7 % contre 56,8 %. L'interface Codex est toujours présente, mais elle est désormais propulsée par GPT-5.4. Via APIYI (apiyi.com), vous pouvez basculer en un clic vers les différentes variantes de GPT-5.4 pour vos tests.

Q2 : Existe-t-il une alternative après le retrait de GPT-4o ?

GPT-5.4 Mini est l'alternative la plus proche du positionnement de GPT-4o. Avec un tarif d'environ 0,40 $/1,60 $ par million de jetons et un score de 54,38 % sur SWE-Bench Pro, il surpasse largement GPT-4o. Si votre système dépend de GPT-4o, vous pouvez migrer en toute transparence vers GPT-5.4 Mini via la plateforme APIYI (apiyi.com) sans modifier votre architecture de code.

Q3 : La fonctionnalité Computer Use de GPT-5.4 est-elle sécurisée ?

OpenAI a mis en place des mécanismes de sécurité multicouches pour la fonctionnalité Computer Use, incluant la confirmation des actions, l'interception des opérations sensibles et des journaux d'audit. Dans un environnement d'entreprise, il est conseillé de l'utiliser avec un contrôle des permissions approprié. Actuellement, la fonctionnalité Computer Use est principalement accessible via l'API et l'interface Codex ; elle n'est pas encore totalement ouverte au grand public sur ChatGPT.

Résumé

Les 5 percées majeures du modèle phare GPT-5.4 :

- Contrôle natif de l'ordinateur : Avec 75 % de réussite sur le benchmark OSWorld, c'est le premier modèle généraliste doté de capacités natives de "Computer Use".

- Fenêtre de contexte d'un million de tokens : 272 000 tokens en standard / 1 million en extension, idéal pour la planification de tâches d'agents sur le long terme.

- Réduction de 33 % des hallucinations : Une précision factuelle nettement améliorée, rendant le modèle plus fiable pour les usages en entreprise.

- Intégration de la programmation Codex : 57,7 % sur SWE-Bench Pro, un seul modèle couvrant à la fois le raisonnement et le développement.

- 6 variantes de modèles : Du modèle Mini à 0,40 $ au modèle Pro à 30 $, pour répondre à tous les besoins.

Le lancement de GPT-5.4 marque une nouvelle étape pour OpenAI, passant d'une approche "multi-modèles" à une stratégie de "modèle phare unifié". Avec le retrait complet de GPT-4o prévu pour le 3 avril, GPT-5.4 devient le cœur absolu de l'écosystème OpenAI. Nous vous recommandons d'accéder rapidement à la gamme complète des modèles GPT-5.4 via APIYI (apiyi.com). La plateforme offre une interface unifiée et une gestion simplifiée du basculement entre modèles, aidant les développeurs à migrer et à sélectionner le modèle idéal en toute efficacité.

📚 Références

-

Annonce officielle d'OpenAI – GPT-5.4 : Présentation officielle du modèle et données d'évaluation.

- Lien :

openai.com/index/introducing-gpt-5-4 - Description : Contient les spécifications techniques complètes, les données de test et les détails du lancement.

- Lien :

-

Annonce de retrait de GPT-4o par OpenAI : Calendrier de retrait de GPT-4o et des anciens modèles.

- Lien :

openai.com/index/retiring-gpt-4o-and-older-models - Description : Inclut les dates butoirs par plan et un guide de migration.

- Lien :

-

Guide complet de GPT-5.4 – NxCode : Analyse approfondie des fonctionnalités, des évaluations et de la tarification.

- Lien :

nxcode.io/resources/news/gpt-5-4-complete-guide-features-pricing-models-2026 - Description : Détaille la tarification de toutes les variantes et propose une comparaison détaillée.

- Lien :

-

Comparaison GPT-5.4 vs GPT-5.3-Codex : Est-il judicieux de migrer depuis Codex ?

- Lien :

nxcode.io/resources/news/gpt-5-4-vs-gpt-5-3-codex-upgrade-comparison-2026 - Description : Analyse comparative détaillée des fonctionnalités et des performances des deux modèles.

- Lien :

Auteur : Équipe technique APIYI

Échanges techniques : N'hésitez pas à partager votre expérience avec GPT-5.4 dans les commentaires. Pour plus d'informations sur l'intégration de modèles d'IA, consultez la documentation d'APIYI sur docs.apiyi.com.